博主介绍:✌全网粉丝10W+,前互联网大厂软件研发、集结硕博英豪成立工作室。专注于计算机相关专业项目实战6年之久,选择我们就是选择放心、选择安心毕业✌

> 🍅想要获取完整文章或者源码,或者代做,拉到文章底部即可与我联系了。🍅🍅**感兴趣的可以先收藏起来,点赞、关注不迷路,大家在毕设选题,项目以及论文编写等相关问题都可以给我留言咨询,希望帮助同学们顺利毕业 。**🍅

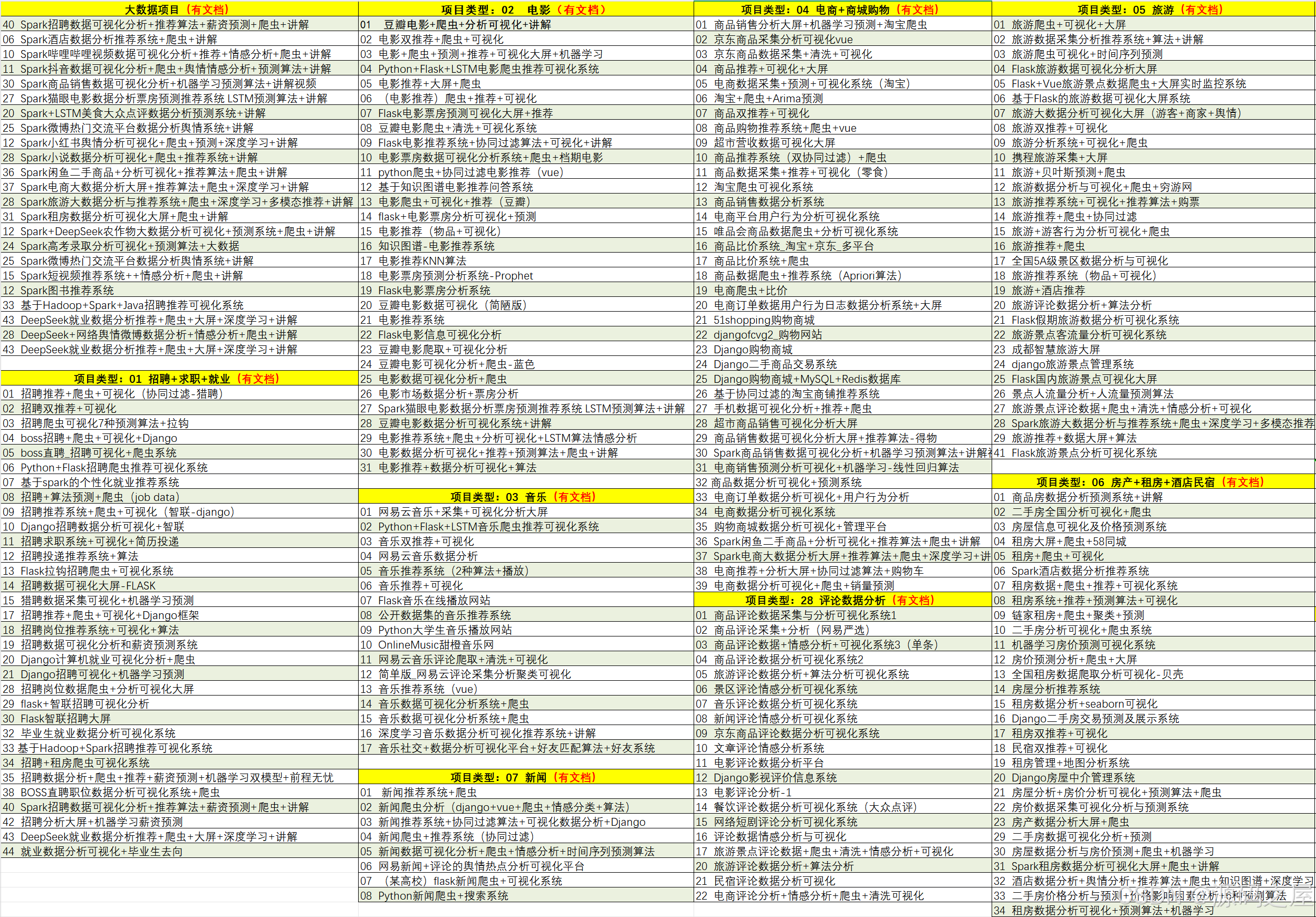

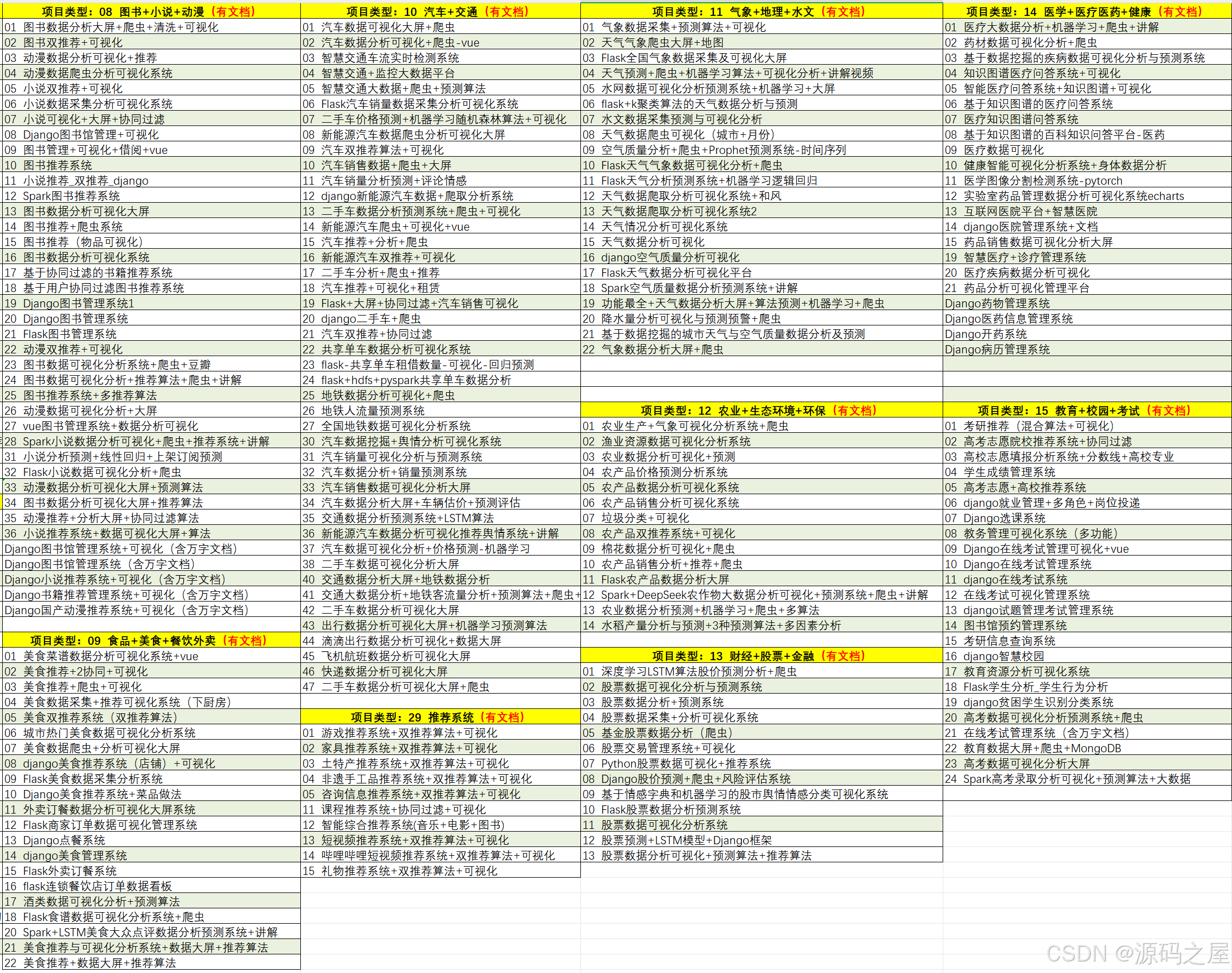

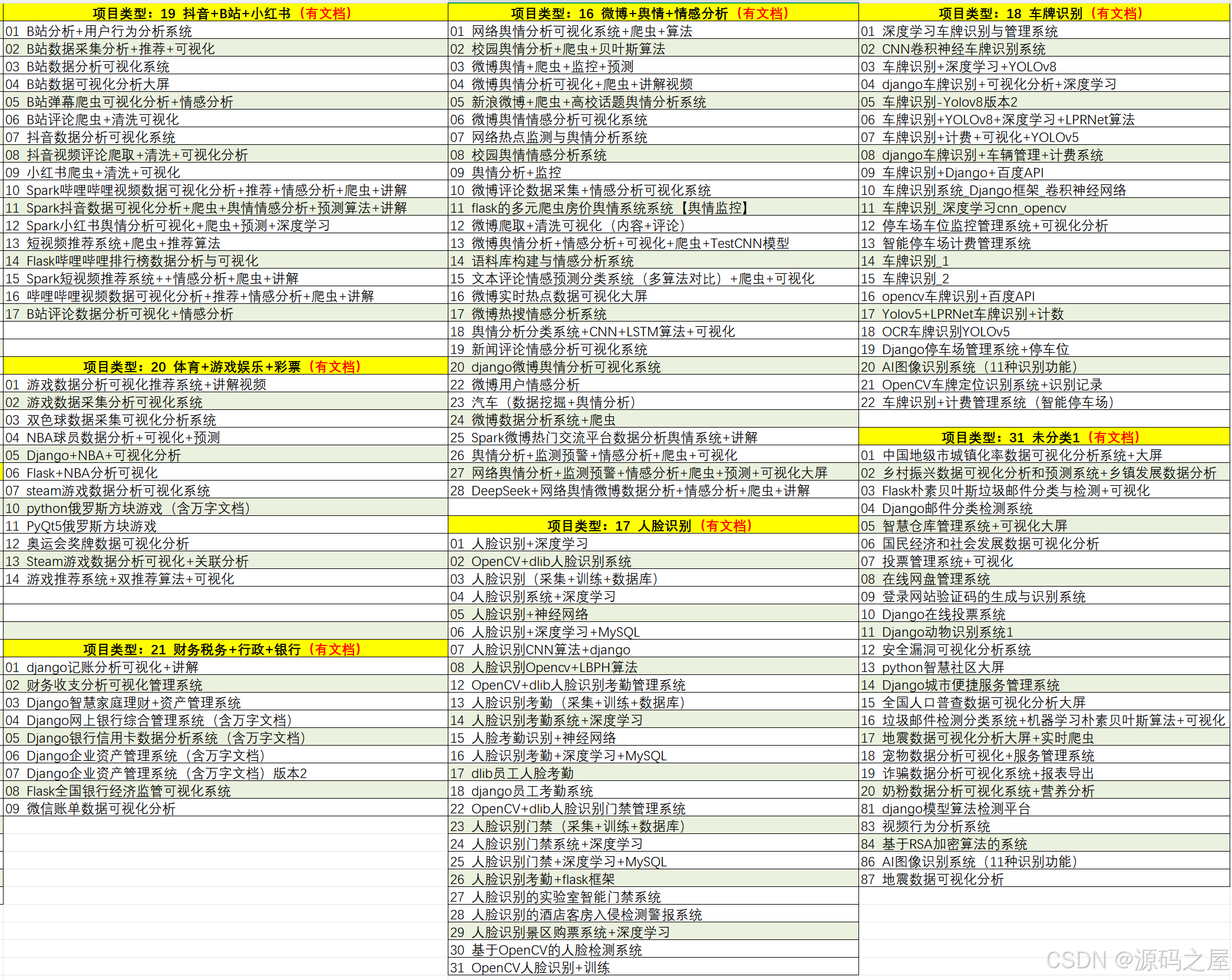

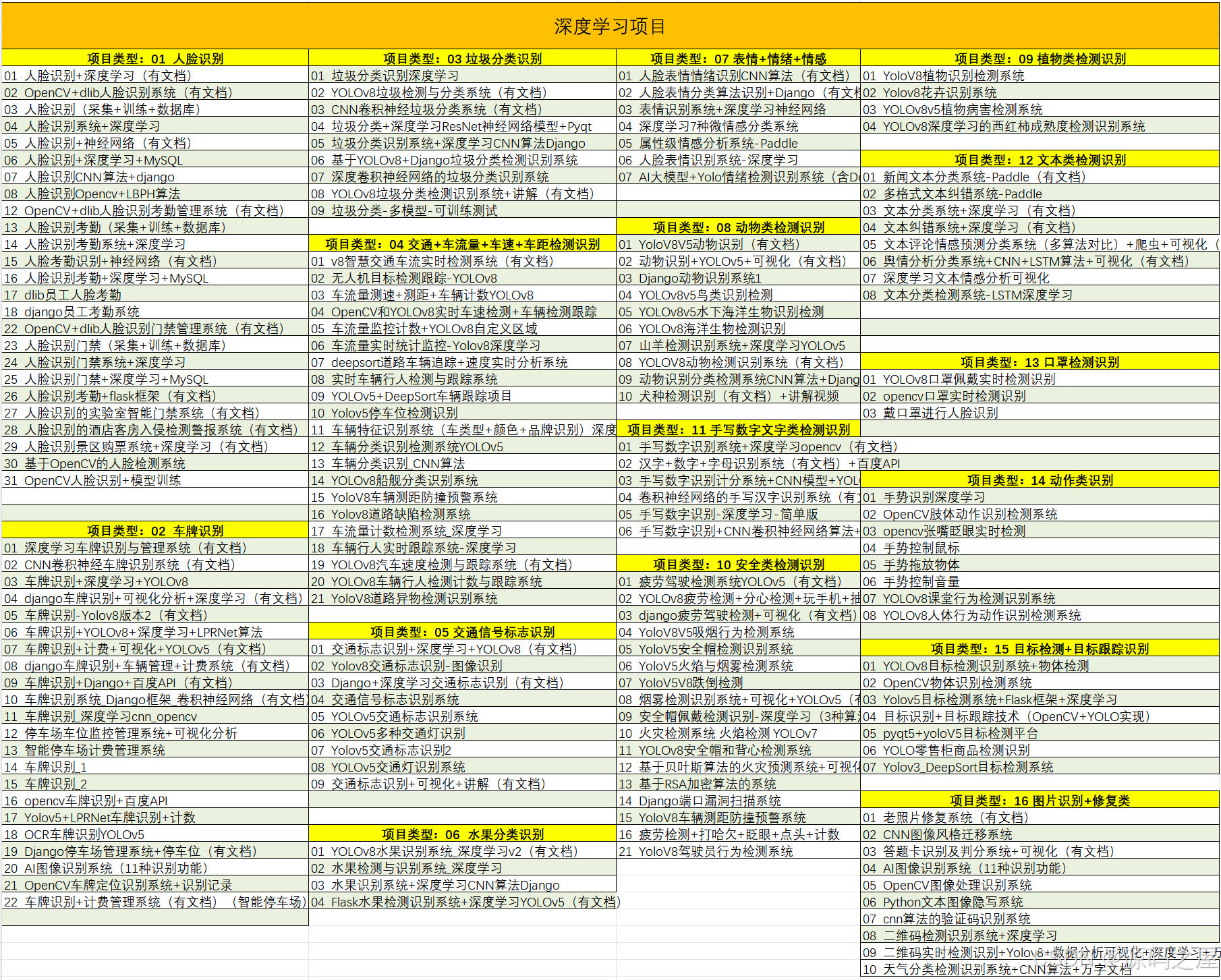

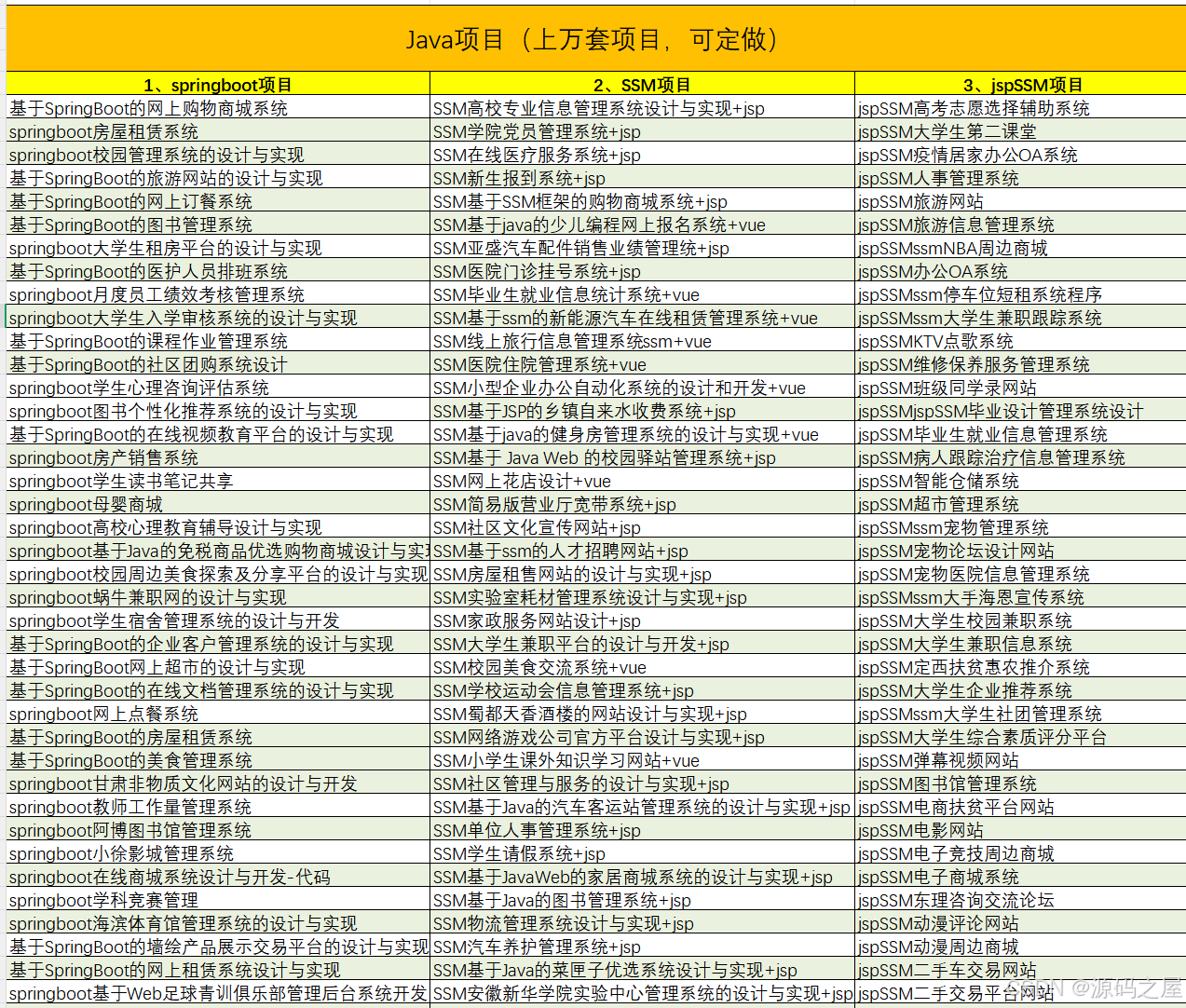

1、毕业设计:2026年计算机专业毕业设计选题汇总(建议收藏)✅

2、大数据毕业设计:2026年选题大全 深度学习 python语言 JAVA语言 hadoop和spark(建议收藏)✅

1、项目介绍

技术栈

采用 Python 语言开发,基于 Django 框架搭建 Web 应用程序,使用 MySQL 数据库进行数据存储,前端结合 Bootstrap 框架、CSS、JavaScript 和 HTML 构建界面,运用机器学习中的线性回归算法构建天气预测模型,通过爬虫技术从天气数据源获取数据。

功能模块

· 数据收集

· 数据存储

· 数据分析

· 数据可视化

· 用户管理

项目介绍

本系统基于 Django 框架构建天气数据爬虫可视化分析平台,利用爬虫技术从可靠数据源抓取实时天气数据,经处理后存入 MySQL 数据库。系统提供多种数据分析功能,包括统计不同地区的温度、湿度、降水量等指标变化趋势及城市间对比分析。通过图表、地图等可视化工具,以柱状图、折线图、饼状图等形式直观展示天气数据。用户可自定义时间范围和地区参数,系统支持多用户同时使用,每个用户可创建独立项目并设定访问权限。

2、项目界面

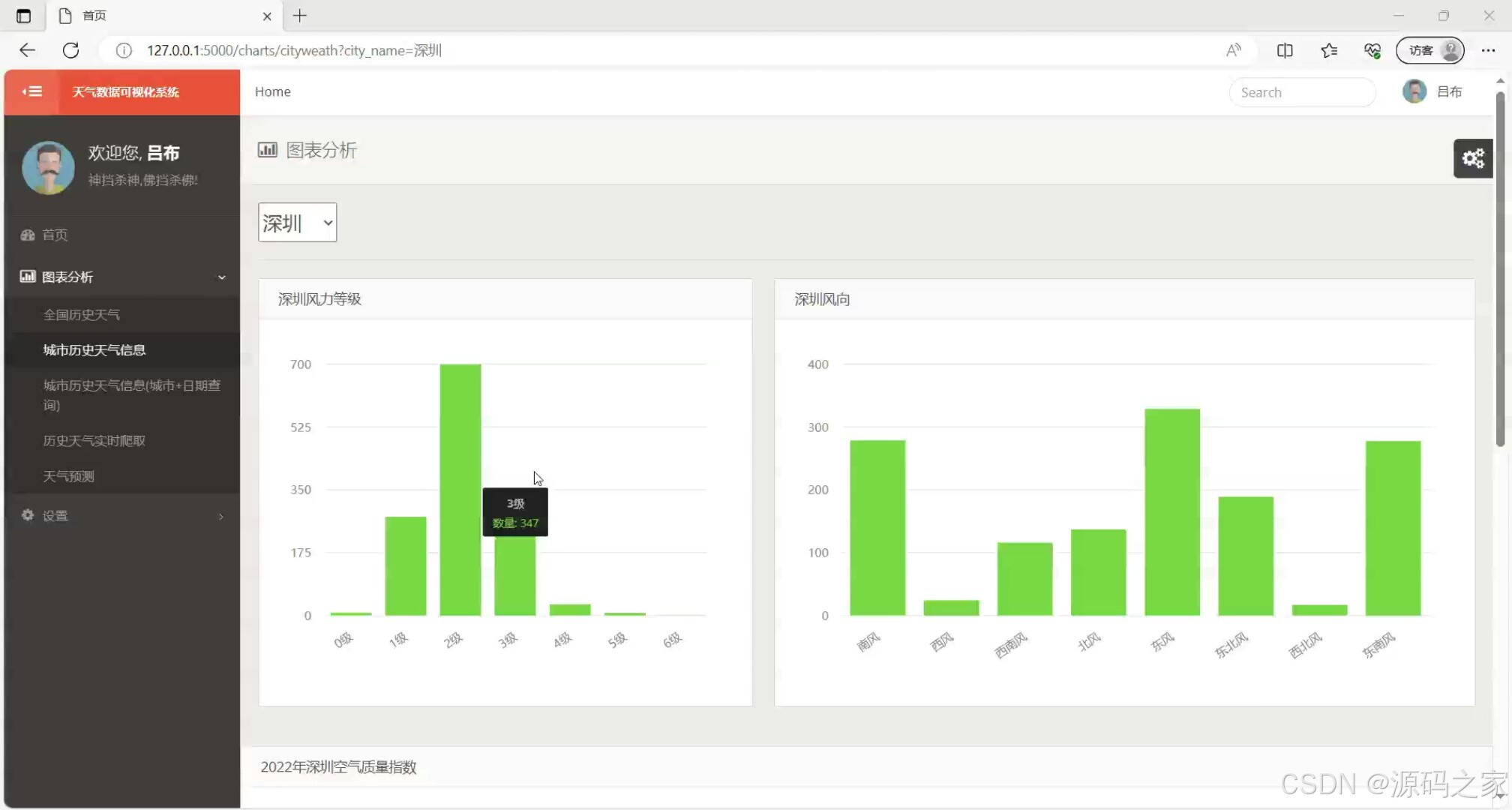

(1)系统首页

该页面为天气数据可视化系统的图表分析页,提供城市选择功能,展示深圳风力等级柱状图、深圳风向柱状图以及2022年深圳空气质量指数相关内容,呈现城市气象数据的可视化分析结果。

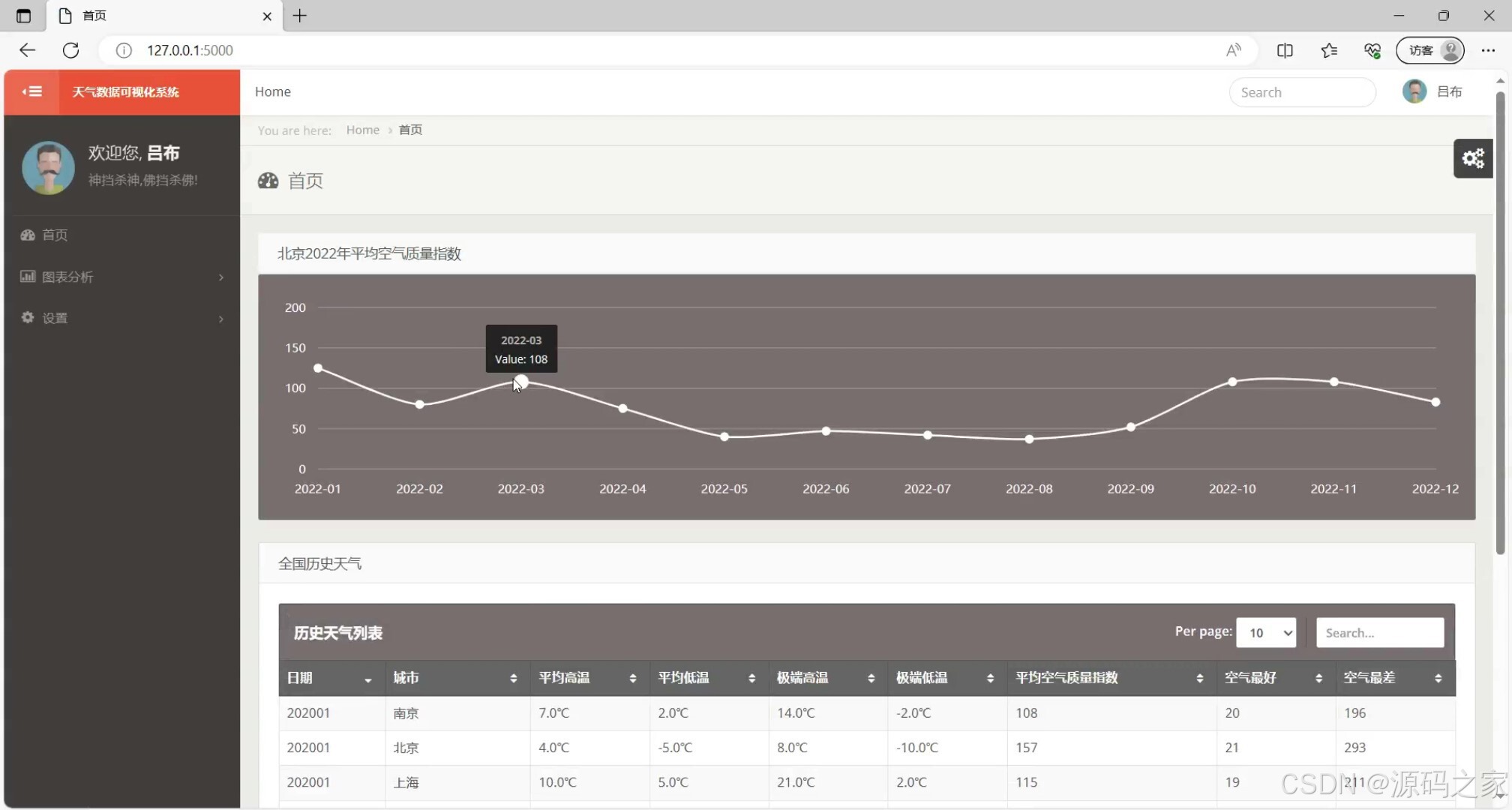

(2)空气质量指数曲线和全国历史天气数据查询

该页面是天气数据可视化系统,包含用户登录欢迎、图表分析、设置等功能模块,依托折线图呈现城市空气质量指数等气象指标变化趋势,搭配表格展示全国历史天气相关数据,实现气象数据的可视化呈现与管理交互。

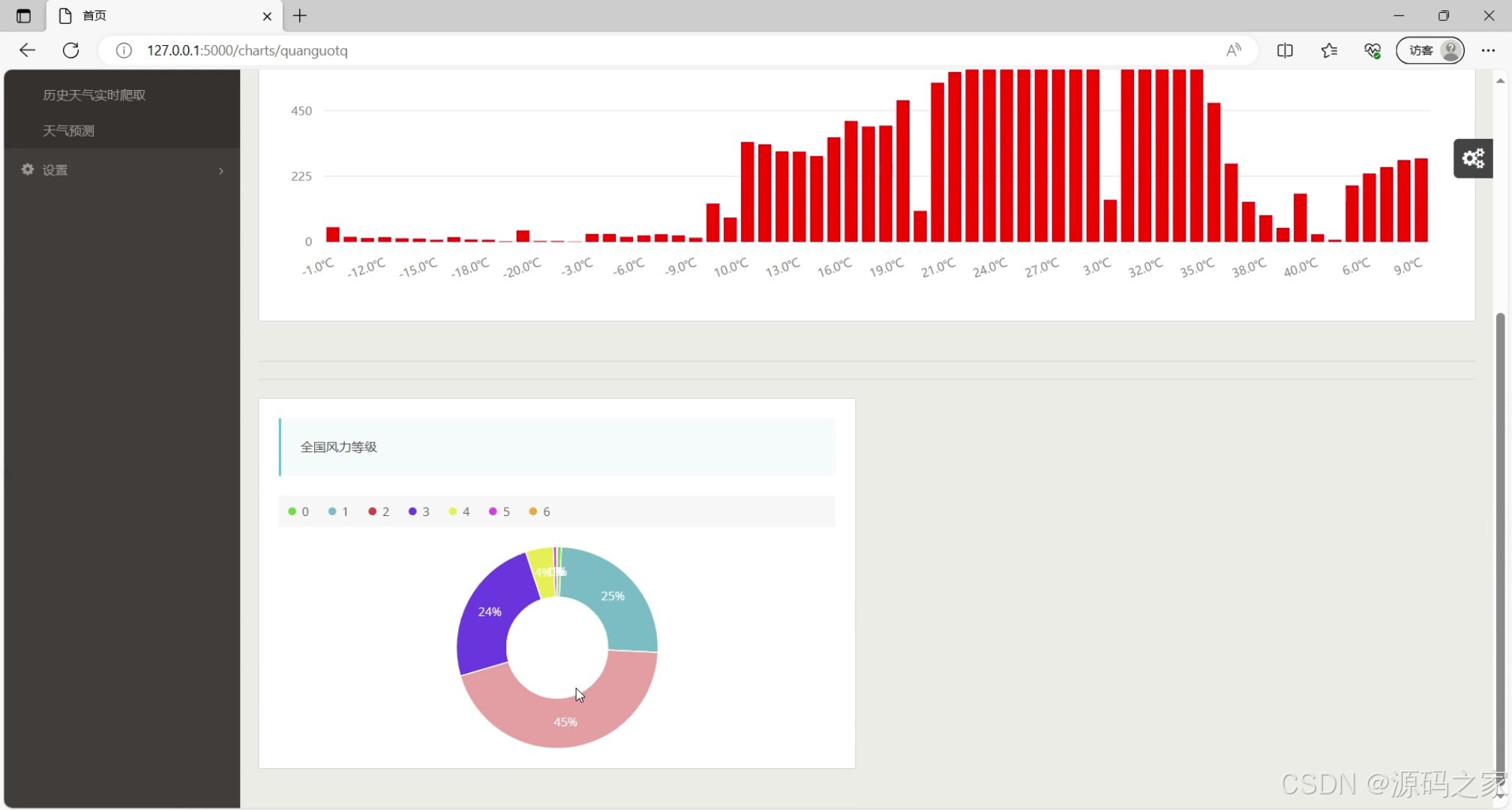

(3)全国风力等级饼状图

该页面为天气数据可视化系统的图表分析页,通过柱状图呈现全国气温分布情况,同时以环形图展示全国风力等级的占比分布,直观呈现全国气象数据的统计与可视化分析结果。

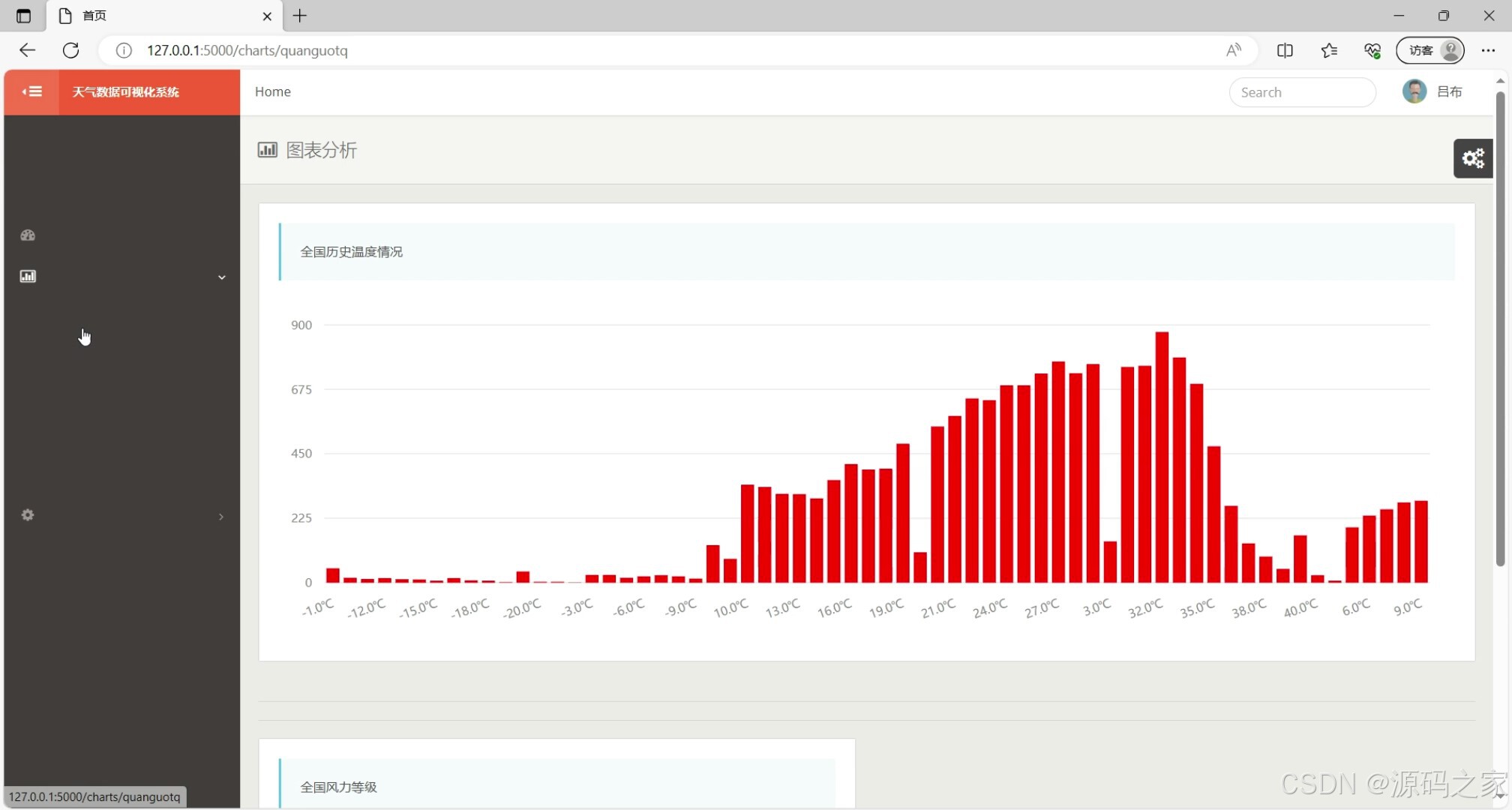

(4)全国历史温度情况柱状图

该页面为天气数据可视化系统的图表分析页,通过红色柱状图呈现全国历史温度情况的分布统计,直观展示不同温度区间的出现频次,实现全国历史气温数据的可视化分析。

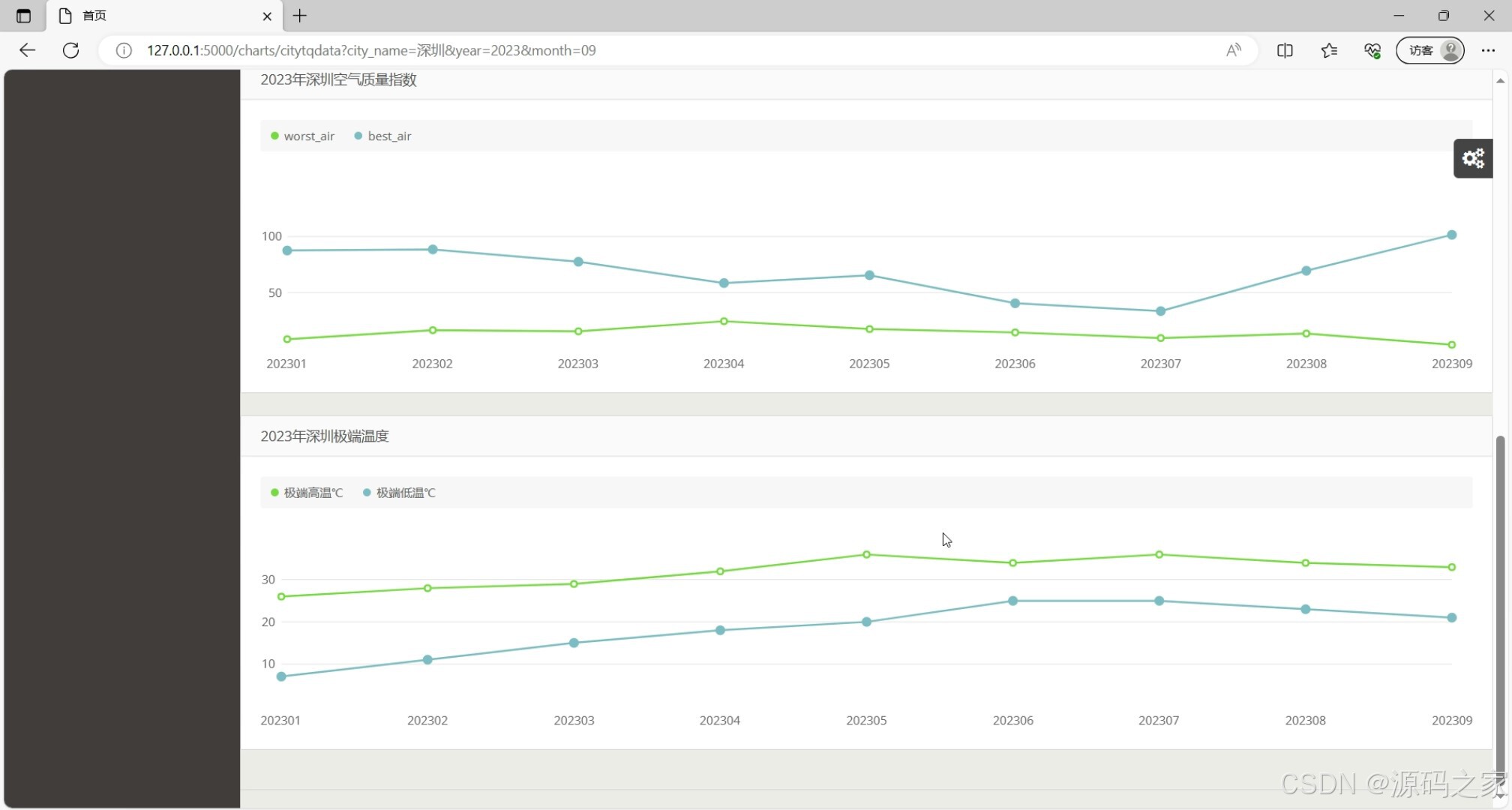

(5)空气质量指数和极端温度曲线图

该页面为天气数据可视化系统的图表分析页,通过双折线图分别呈现深圳年度空气质量指数的最优与最差值变化趋势,同时以另一组双折线图展示深圳年度极端高温与极端低温的月度变化情况,实现城市气象与空气质量数据的可视化分析。

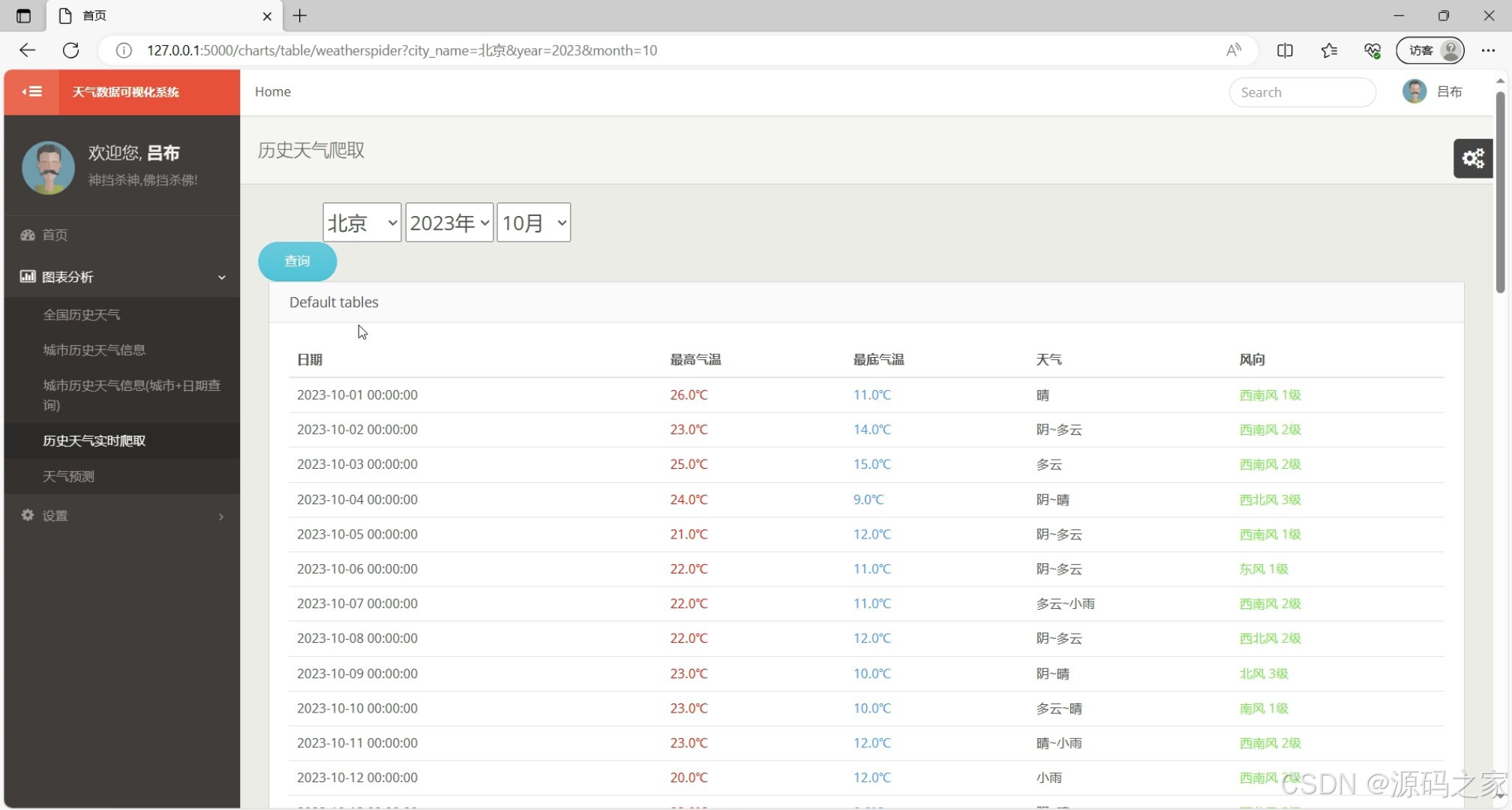

(6)历史天气数据实时爬取

该页面为天气数据可视化系统的历史天气实时爬取页,提供城市、年份、月份的筛选与查询功能,以表格形式展示对应时段的详细历史天气数据,包含气温、天气状况、风向等信息,实现历史天气数据的查询与管理。

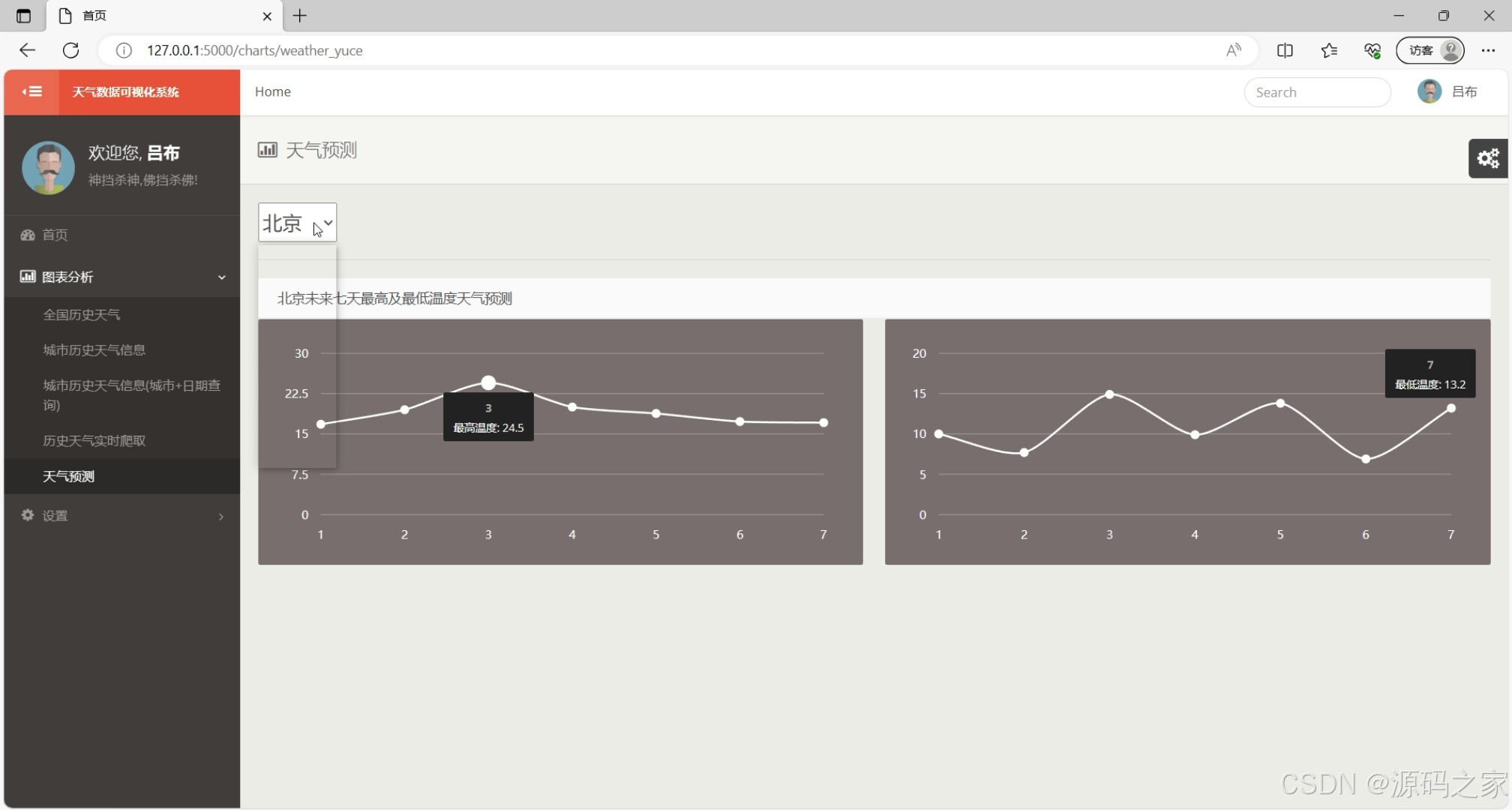

(7)天气预测-----机器学习预测算法

该页面为天气数据可视化系统的天气预测页,提供城市选择功能,通过两组折线图分别呈现所选城市未来七天的最高温度与最低温度变化趋势,直观展示未来天气的温度预测情况,为用户提供气象预报参考。

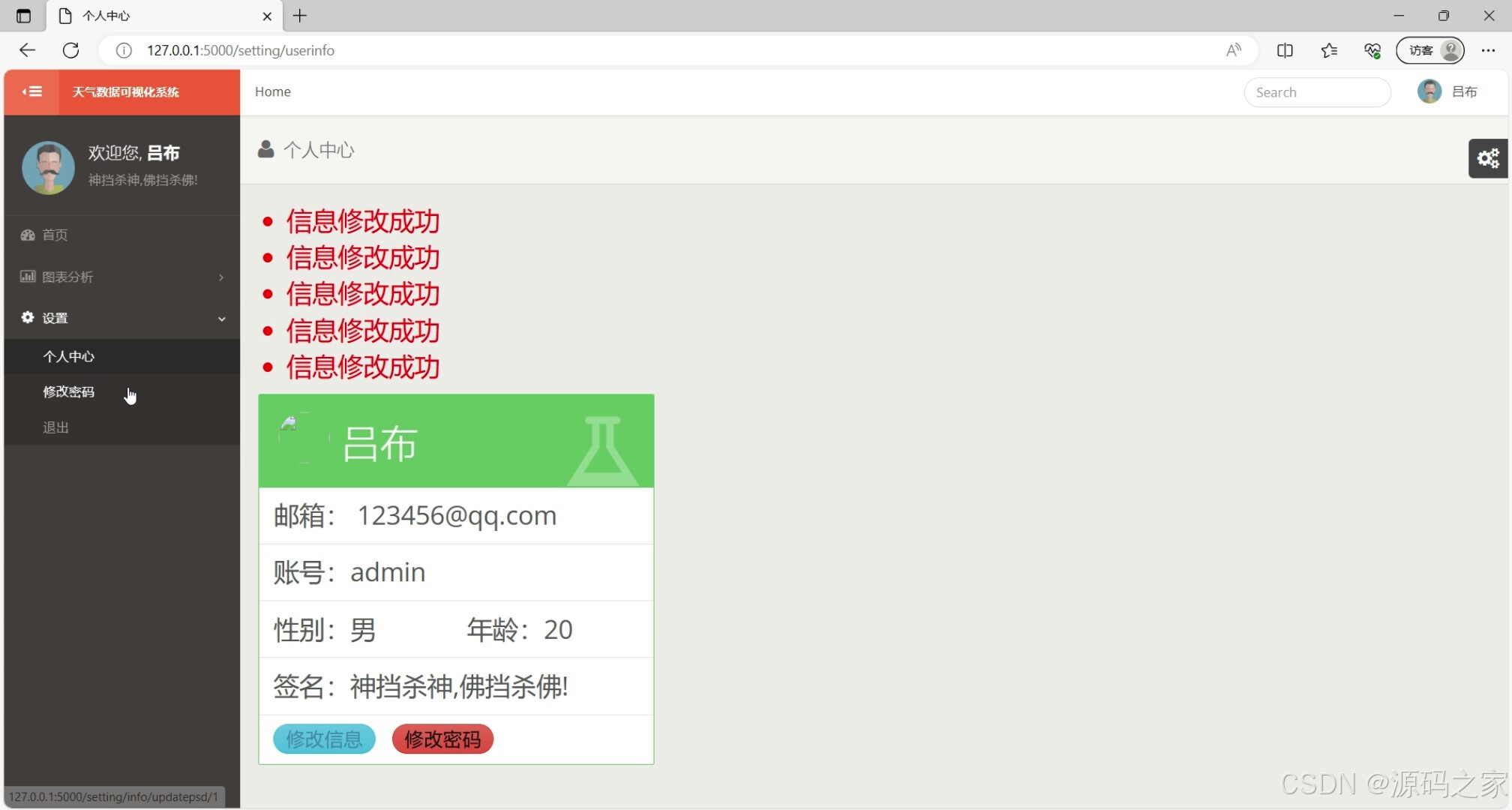

(8)个人信息

该页面为天气数据可视化系统的个人中心页,展示用户的账号、邮箱、个人信息等内容,提供修改信息和修改密码的操作入口,同时显示信息修改成功的提示,用于用户个人信息的管理与维护。

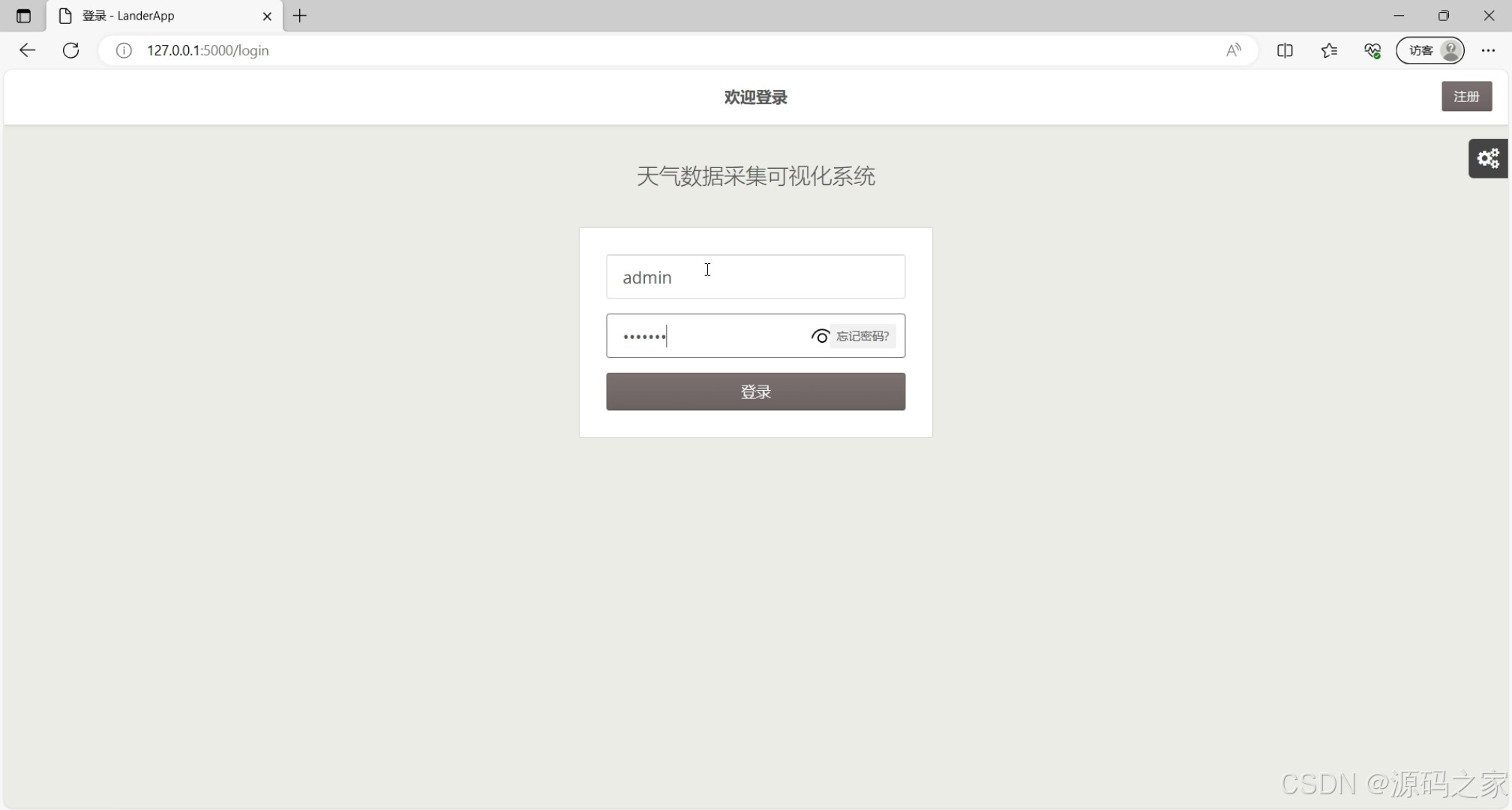

(9)注册登录界面

该页面为天气数据采集可视化系统的登录页,提供账号和密码的输入框,设有登录按钮、忘记密码入口与注册入口,用于验证用户身份,是进入系统的权限入口,保障系统访问安全。

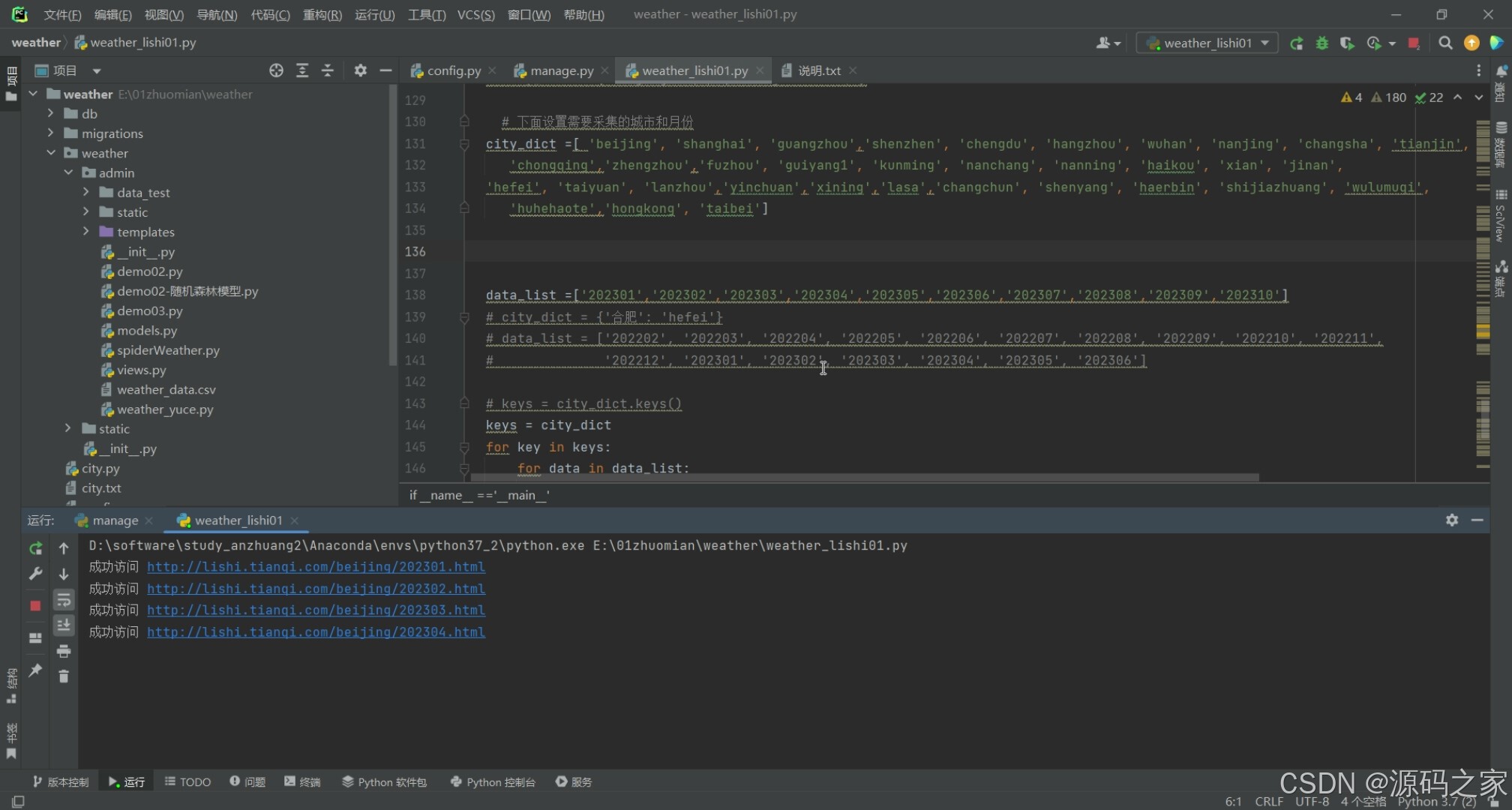

(10)数据爬取界面

该页面是PyCharm开发环境中的天气数据采集代码编辑界面,展示了用于批量爬取多城市历史天气数据的Python代码,可配置采集的城市与时间参数,控制台实时输出爬虫运行状态,实现天气数据的自动化采集与获取。

3、项目说明

一、技术栈简要说明

本系统采用 Python 语言开发,基于 Django 框架搭建 Web 应用程序,使用 MySQL 数据库进行数据存储,前端结合 Bootstrap 框架、CSS、JavaScript 和 HTML 构建界面,运用机器学习中的线性回归算法构建天气预测模型,通过爬虫技术从天气数据源获取数据。

二、功能模块详细介绍

· 数据收集

该模块利用爬虫技术从可靠的天气数据源抓取实时天气数据。数据爬取界面展示了用于批量爬取多城市历史天气数据的 Python 代码,可配置采集的城市与时间参数,控制台实时输出爬虫运行状态,实现天气数据的自动化采集与获取。通过配置不同的数据源,可以获取不同地区的天气数据。

· 数据存储

获取的天气数据经过清洗和处理后,存储到 MySQL 数据库中,以便后续的分析、查询和可视化展示。数据库设计支持存储城市、温度、湿度、降水量、风向、风力、空气质量指数等多维度气象指标。

· 数据分析

系统提供多种数据分析功能,包括统计不同地区的温度、湿度、降水量等天气指标的变化趋势,以及不同城市之间的对比分析。系统首页提供城市选择功能,展示深圳风力等级柱状图、深圳风向柱状图以及2022年深圳空气质量指数相关内容。全国风力等级饼状图通过柱状图呈现全国气温分布情况,同时以环形图展示全国风力等级的占比分布。全国历史温度情况柱状图展示不同温度区间的出现频次。空气质量指数和极端温度曲线图通过双折线图呈现深圳年度空气质量指数的最优与最差值变化趋势,以及极端高温与极端低温的月度变化情况。

· 数据可视化

通过使用图表、地图等可视化工具,将天气数据以直观的方式展示出来。用户可以通过选择不同的时间范围、地区等参数,定制自己感兴趣的数据展示方式。空气质量指数曲线和全国历史天气数据查询页面依托折线图呈现城市空气质量指数等气象指标变化趋势,搭配表格展示全国历史天气相关数据。用户可查看风力等级、风向、气温分布、空气质量指数、极端温度等多种可视化图表。

· 用户管理

系统支持多用户同时使用,每个用户可以创建自己的数据分析和展示项目,并设定对应的访问权限。注册登录界面提供账号和密码输入框,设有登录按钮、忘记密码入口与注册入口,用于验证用户身份,保障系统访问安全。个人信息页面展示用户的账号、邮箱、个人信息等内容,提供修改信息和修改密码的操作入口,用于用户个人信息的管理与维护。历史天气数据实时爬取页面提供城市、年份、月份的筛选与查询功能,以表格形式展示对应时段的详细历史天气数据。天气预测页面提供城市选择功能,通过两组折线图分别呈现所选城市未来七天的最高温度与最低温度变化趋势,为用户提供气象预报参考。

三、项目总结

本系统基于 Django 框架构建天气数据爬虫可视化分析平台,利用爬虫技术从可靠数据源抓取实时天气数据,经处理后存入 MySQL 数据库。系统提供多种数据分析功能,包括统计不同地区的温度、湿度、降水量等指标变化趋势及城市间对比分析。通过图表、地图等可视化工具,以柱状图、折线图、饼状图、环形图等形式直观展示天气数据,涵盖风力等级、风向、气温分布、空气质量指数、极端温度等维度。用户可自定义时间范围和地区参数,系统支持多用户同时使用,每个用户可创建独立项目并设定访问权限。基于线性回归算法的天气预测模块可为用户提供未来七天的温度变化趋势参考,为出行规划、农业生产、能源管理等场景提供决策支持。

4、核心代码

python

import requests

from bs4 import BeautifulSoup

import re

import pymysql

from datetime import datetime

import time,random

def getHTMLtext(url):

"""请求获得网页内容"""

try:

headers = {"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/109.0.0.0 Safari/537.36"}

r = requests.get(url, headers=headers,timeout = 30)

r.raise_for_status()

r.encoding = r.apparent_encoding

print("成功访问",url)

time.sleep(random.randint(1,4))

#保存到txt

# with open("output.txt", "w", encoding="utf-8") as f:

# f.write(r.text)

return r.text

except:

print("访问错误")

return "1111"

#处理数据

def get_content(html):

final_list =[]

final1 = [] # 初始化一个列表保存数据

bs = BeautifulSoup(html, "html.parser") # 创建BeautifulSoup对象

body = bs.body

tian_two = body.find_all('ul', {'class': 'tian_two'})

#print(tian_two)

#提取数据并插入到数据库中

high = tian_two[0].find_all('div', class_='tian_twoa')[0].text

low = tian_two[0].find_all('div', class_='tian_twoa')[1].text

extreme_high = tian_two[0].find_all('div', class_='tian_twoa')[2].text

extreme_low = tian_two[0].find_all('div', class_='tian_twoa')[3].text

average_air_index = tian_two[0].find_all('div', class_='tian_twoa')[4].text

best_air = tian_two[0].find_all('div', class_='tian_twoa')[5].text

worst_air = tian_two[0].find_all('div', class_='tian_twoa')[6].text

final1.append(float(re.findall(r'[-+]?\d+\.?\d*', high)[0])) #平均高温

final1.append(float(re.findall(r'[-+]?\d+\.?\d*', low)[0])) #平均低温

final1.append(float(re.findall(r'[-+]?\d+\.?\d*', extreme_high)[0])) #极端高温

try:

final1.append(float(re.findall(r'[-+]?\d+\.?\d*', extreme_low)[0])) #极端低温

except:

final1.append(0) #极端低温

final1.append(average_air_index) #平均空气质量指数

final1.append(best_air) #空气最好

final1.append(worst_air) #空气最差

#print(high,low,extreme_high,extreme_low,average_air_index,best_air,worst_air)

final_list.append(final1)

thrui = body.find_all('ul', {'class': 'thrui'})

for li in thrui[0].find_all('li'):

final2 = []

date = li.find('div', class_='th200').text.strip()

max_temperature = li.find_all('div', class_='th140')[0].text.strip()

min_temperature = li.find_all('div', class_='th140')[1].text.strip()

weather = li.find_all('div', class_='th140')[2].text.strip()

wind_direction = li.find_all('div', class_='th140')[3].text.strip()

wind_level = int(re.findall(r'\d+\.?\d*', wind_direction)[0])

#print(f'日期:{date.split(" ")[0]},最高气温:{max_temperature},最低气温:{min_temperature},天气:{weather},风向:{wind_direction},风力等级:{wind_level}')

final2.append(date.split(" ")[0])

try:

final2.append(float(re.findall(r'[-+]?\d+\.?\d*', max_temperature)[0]))

except:

final2.append(0)

try:

final2.append(float(re.findall(r'[-+]?\d+\.?\d*', min_temperature)[0]))

except:

final2.append(0)

try:

final2.append(weather)

except:

final2.append('无')

final2.append(wind_direction.split(" ")[0])

final2.append(wind_level)

final_list.append(final2)

return final_list

#数据保存

def saveDate(data_list,city,month):

#获取当前时间

current_time = datetime.now().strftime('%Y-%m-%d %H:%M:%S')

# 连接到MySQL数据库

conn = pymysql.connect(host='127.0.0.1', user='root', password='123456', db='flask_weather', charset='utf8')

cursor = conn.cursor()

for index, data in enumerate(data_list):

if index == 0:

cursor.execute('INSERT INTO t_monthcityweather (city_name, month_time, high_temperature, low_temperature, extreme_high_temperature, \

extreme_low_temperature, average_air_index,best_air,worst_air,add_date,pub_date) \

VALUES (%s,%s,%s, %s, %s, %s, %s, %s, %s, %s, %s)', (city,month,data[0], data[1], data[2], data[3], data[4], data[5], data[6],current_time,current_time))

else :

cursor.execute('INSERT INTO t_cityweather (city_name, date_time, max_temperature, main_temperature, weather_conditions, \

wind_direction, wind_level,add_date,pub_date) \

VALUES (%s, %s, %s, %s, %s, %s, %s, %s, %s)', (city,data[0], data[1], data[2], data[3], data[4],data[5],current_time,current_time))

# 提交事务并关闭连接

conn.commit()

cursor.close()

conn.close()

return '数据保存结束'5、项目列表

6、源码获取方式

🍅由于篇幅限制,获取完整文章或源码、代做项目的,查看我的【用户名】、【专栏名称】、【顶部选题链接】就可以找到我啦🍅

感兴趣的可以先收藏起来,点赞、关注不迷路,下方查看 👇🏻获取联系方式👇🏻