一、流程梳理

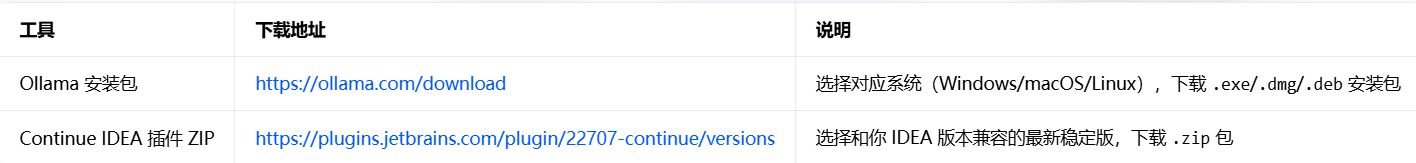

1、外网一次性下载清单(仅需这 1 次联网)

- 核心工具安装包

Ollama 安装包:https://ollama.com/download

Continue IDEA 插件 ZIP :https://plugins.jetbrains.com/plugin/22707-continue/versions

- 推荐模型下载(选 1 个即可)

模型下载命令需在外网环境执行,执行前确保 Ollama 已安装:

方案 A:中文首选(后端项目分析最优)

bash

# 通义千问2 7B 量化版,中文极强,代码理解好,4GB显存可跑

ollama pull qwen2:7b方案 B:代码专用(DeepSeek Coder)

bash

# DeepSeek Coder 6.7B 量化版,代码理解拉满,中文支持优秀

ollama pull deepseek-coder:6.7b方案 C:低配电脑(8G 内存可用)

bash

# Qwen2 1.5B 量化版,体积小,速度快,适合低配机器

ollama pull qwen2:1.5b- 下载完成验证

Ollama 安装包:文件大小约 200MB 左右

Continue 插件 ZIP:文件大小约 10-20MB

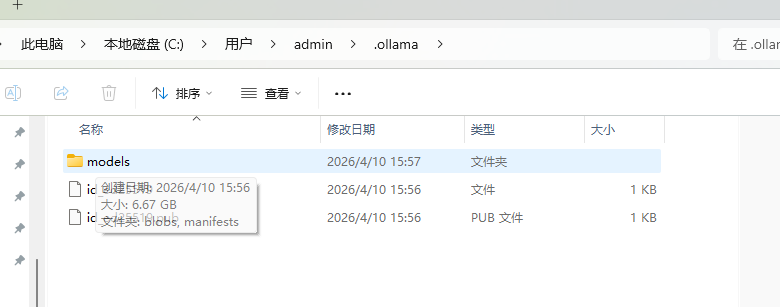

模型文件:默认存储在 C:\Users\你的用户名.ollama\models 目录,qwen2:7b 完整大小约 4.5GB,deepseek-coder:6.7b 约 4GB

2、内网断网环境 安装配置 一步一命令核对表

全程断网,所有操作均在本地完成,无任何外网请求

🔴 阶段 1:安装 Ollama 环境

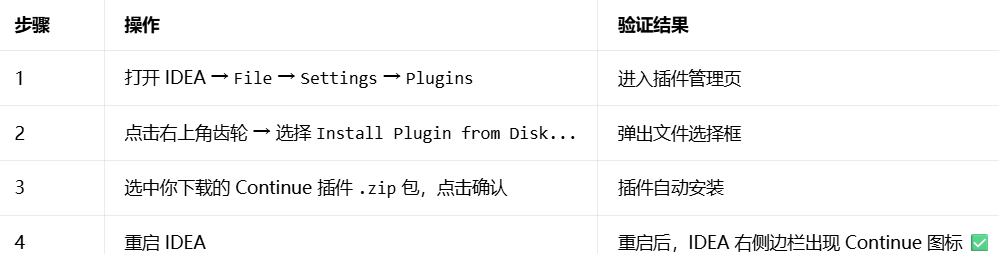

🟠 阶段 2:安装 Continue IDEA 插件

🟡 阶段 3:配置 Continue 连接本地模型(核心步骤)

以 Qwen2:7b 为例,DeepSeek 仅需修改模型名即可:

(1) 打开 IDEA 右侧 Continue 面板 → 点击右上角 ⚙️ 设置图标 → 选择 Open Settings;

(2)打开 config.json 配置文件,完全替换 models 数组为以下配置(直接复制):

bash

{"models": [{"title": "Local Qwen2 7B","provider": "openai","model": "qwen2:7b","apiBase": "http://localhost:11434/v1","apiKey": "ollama","contextWindow": 32768,"systemMessage": "你是一个专业的 Java 后端开发助手,全程用中文回答,只分析用户提供的项目代码,不生成通用原理。"}],"tabAutocompleteModel": {"title": "Local Qwen2 7B","provider": "openai","model": "qwen2:7b","apiBase": "http://localhost:11434/v1","apiKey": "ollama"}}(3)保存配置文件,重启 IDEA ,配置生效 ;

(4)启动本地模型服务:

打开CMD/终端,执行命令:ollama run qwen2:7b

✅ 成功:显示 >>> 提示符,保持窗口打开

🟢 阶段4:离线功能验证(确保万无一失)

(1)彻底断开网络(拔网线/关闭WiFi) , 确保电脑完全断网 ;

(2)在 Continue 聊天框输入测试指令:@Repo 用中文帮我分析这个项目的登录功能,告诉我核心代码位置和调用链;

(3)等待模型回答:

✅ 成功:模型正常读取项目代码,用中文精准定位功能、解释逻辑 ;

❌ 失败:检查 Ollama 服务是否启动、配置文件是否正确。

3、日常使用命令速查(内网环境)

1. 启动/停止模型服务

bash

# 启动 Qwen2 模型(保持窗口打开)

ollama run qwen2:7b

# 启动 DeepSeek 模型

ollama run deepseek-coder:6.7b

# 查看已安装模型

ollama list

# 停止模型服务(Windows 直接关闭CMD窗口即可)2、项目级中文提问模板(直接复制用)

bash

# 功能定位模板

@Repo 用中文详细说明这个项目中【XX功能】的实现逻辑、入口文件、涉及的类和方法、完整调用链,只讲我项目里的代码,不要通用原理。

# 代码分析模板

@Repo 帮我分析这个项目中【XX模块】的代码结构,用中文说明每个类的作用、方法之间的调用关系。

# 问题排查模板

@Repo 用中文帮我排查这个项目中【XX报错】的原因,定位相关代码并给出修复方案。二、大模型简单对比(程序员视角)

- deepseek-coder:6.7b

专门为代码训练,天生懂编程

写函数、补全逻辑、查 bug、解释代码、生成注释都很顺

支持多语言:Java、Python、Go、JS、C/C++、SQL 都不错

体量 ~4GB,本地跑压力小

缺点:通用聊天、写文案不如通用大模型 - qwen2:7b

阿里通用大模型,综合能力强

代码能写,但不是专精代码,复杂逻辑偶尔跑偏

适合:既要写代码,又要写文档、总结、翻译

大小 ~4.5GB,比 deepseek-coder 稍大

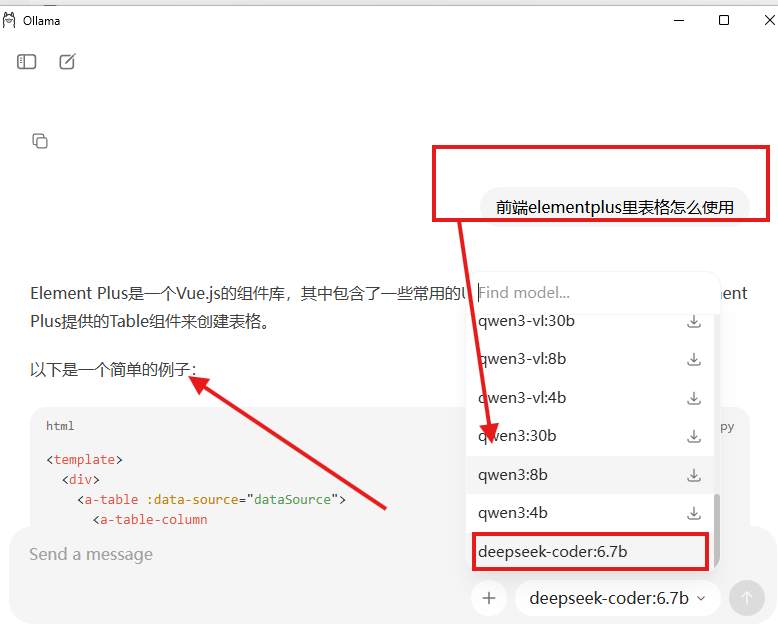

三、实际应用(方案 B: DeepSeek-Coder:6.7b + Ollama + Continue)

1、外网必须下载的 3 样

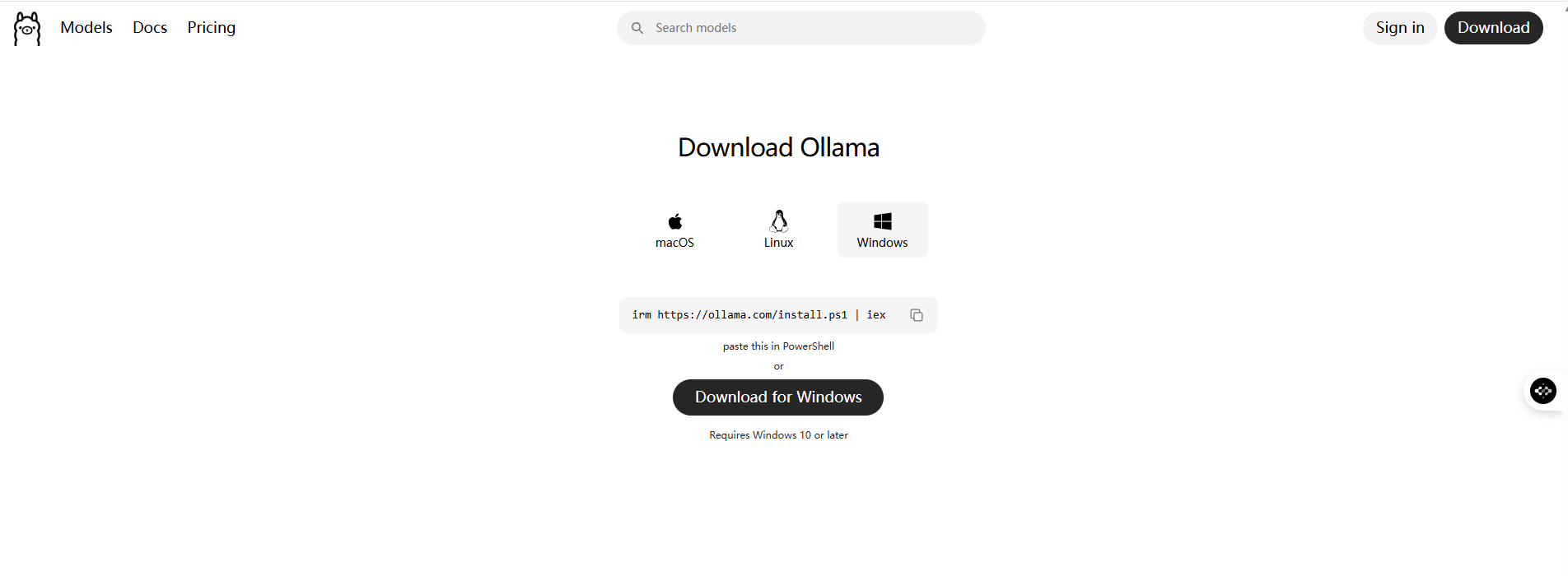

(1)Ollama 安装包

- 下载地址:https://ollama.com/download

- 文件名类似:OllamaSetup.exe

- 保存好,内网直接双击安装

点击后会下载一个 .exe 安装包(比如 OllamaSetup.exe),后续拷到内网笔记本上,双击安装,就能在离线环境用 Ollama 了。

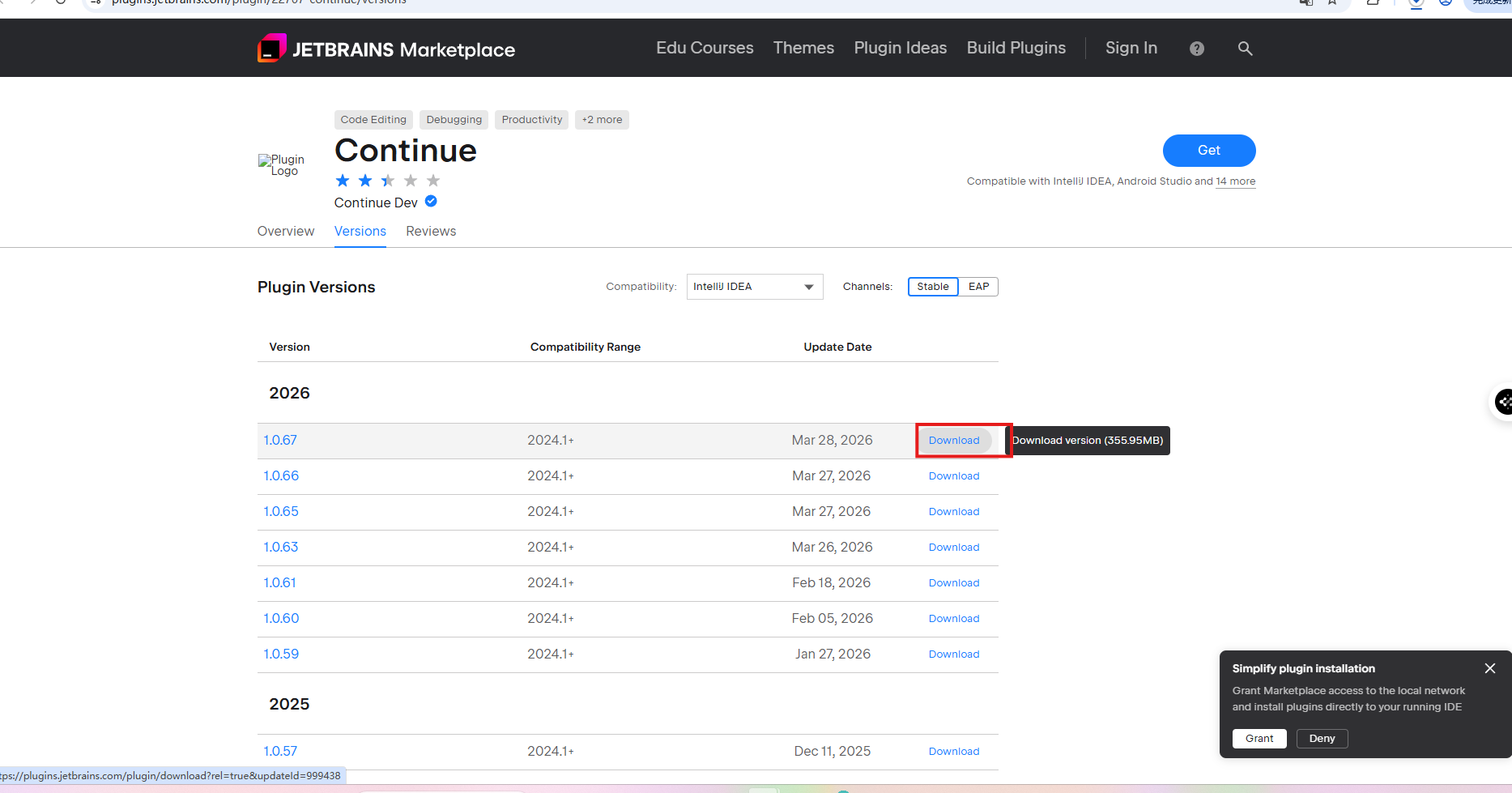

(2)Continue IDEA 插件 ZIP

- 下载地址:https://plugins.jetbrains.com/plugin/22707-continue/versions

- 下载对应你 IDEA 版本的 .zip

- 不要解压,直接保存

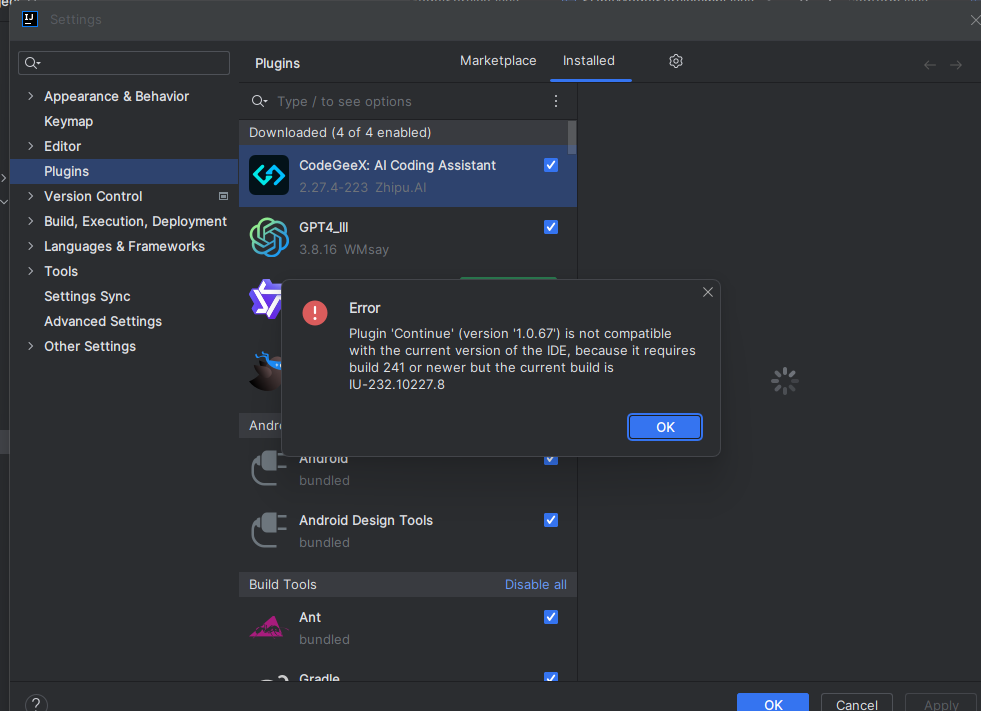

注意idea版本与插件适配:Continue 1.0.67 只支持 IDEA 2024.1 及以上版本,你的 IDEA 是 2023.2,版本太旧,装不上高版本插件。

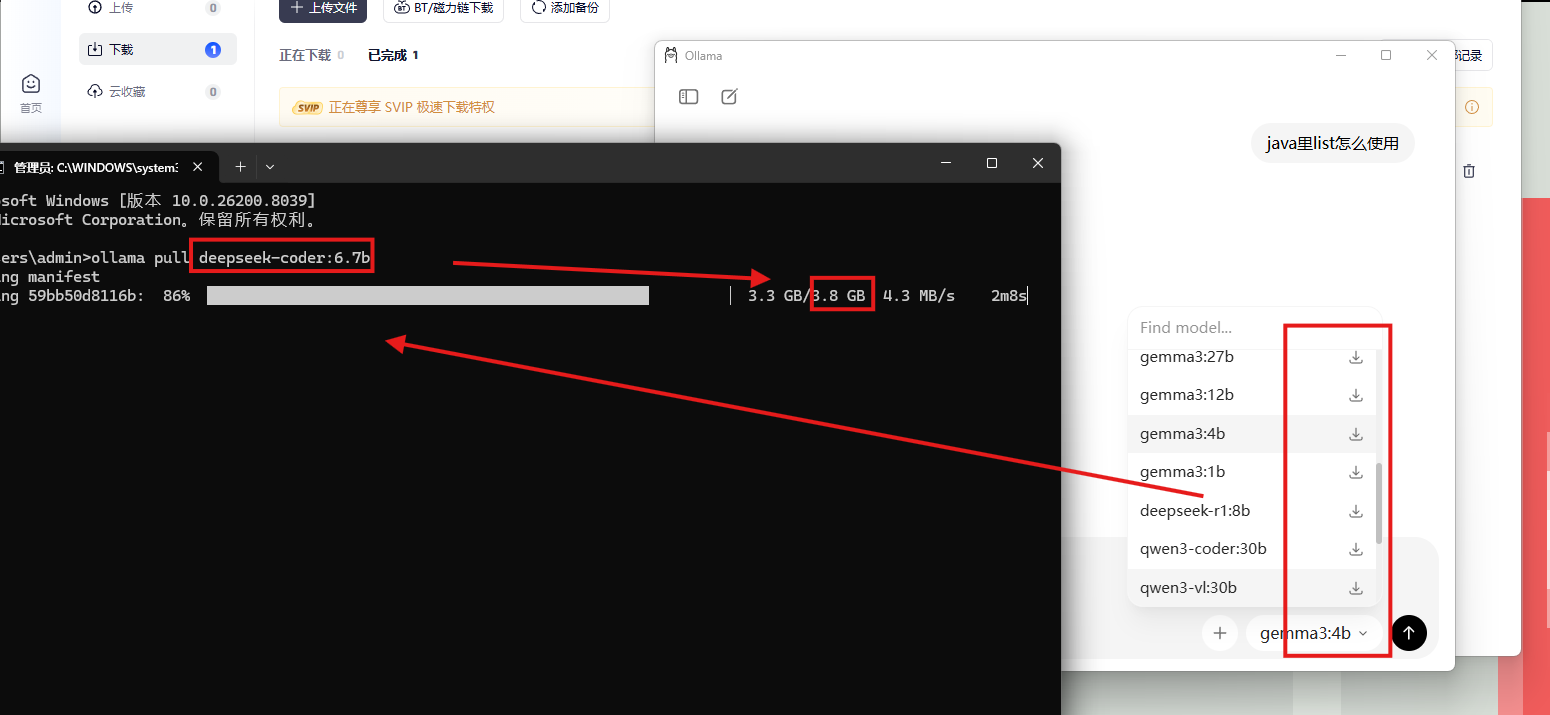

(3)下载 DeepSeek-Coder 模型(关键)

- 在外网电脑打开 CMD,执行(需要外网已安装ollama):

bash

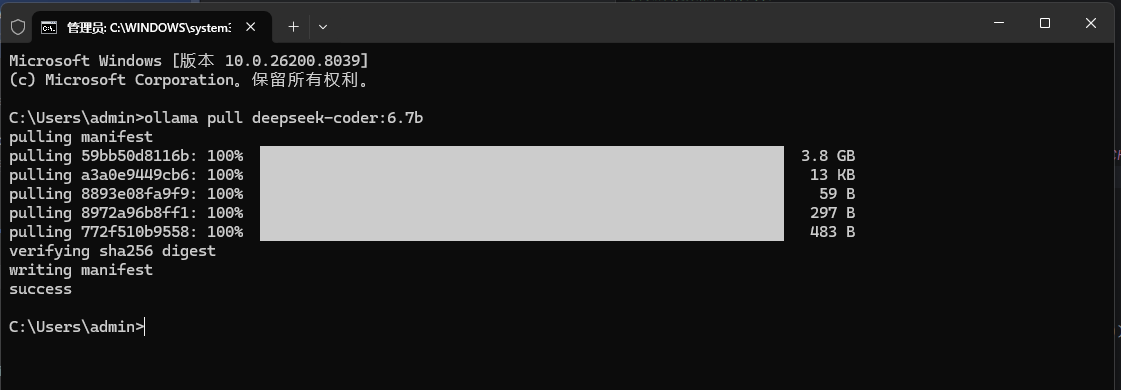

ollama pull deepseek-coder:6.7b- 等待显示 success 即可。

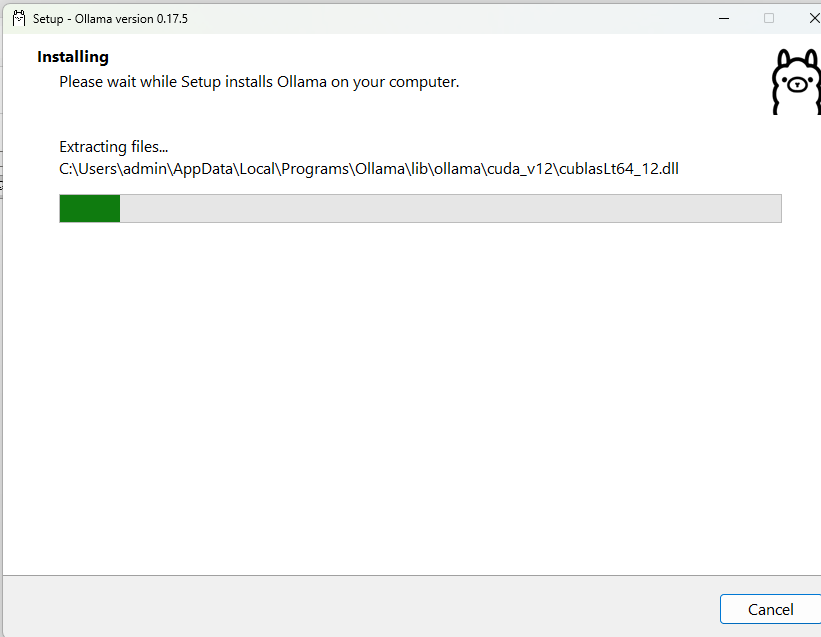

①双击安装OllamaSetup.exe(外网):

②打开 CMD,执行(外网):

bash

ollama pull deepseek-coder:6.7b等它下载完 → 出现 success

上一步下载的ollama里如果你提问它必须依据某个大模型才能回答,目前没有一个大模型列表里的都是需要联网下载的,我这里选择下载大模型 deepseek-coder:6.7b。

③然后把整个文件夹复制走:

bash

C:\Users\你的用户名\.ollama2、内网一步一命令安装配置(纯离线)

阶段 1:安装 Ollama

(1)双击 OllamaSetup.exe 安装

(2)打开新 CMD,输入:

bash

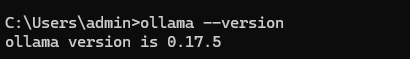

ollama --version

出现版本号 = 成功

(3)把从外网拷来的 .ollama 文件夹,覆盖到内网电脑:

bash

C:\Users\内网用户名\.ollama

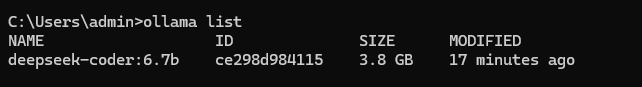

(4)查看模型是否存在:

bash

ollama list

可以发现,ollama基于大模型deepseek-coder:6.7b可以使用了:

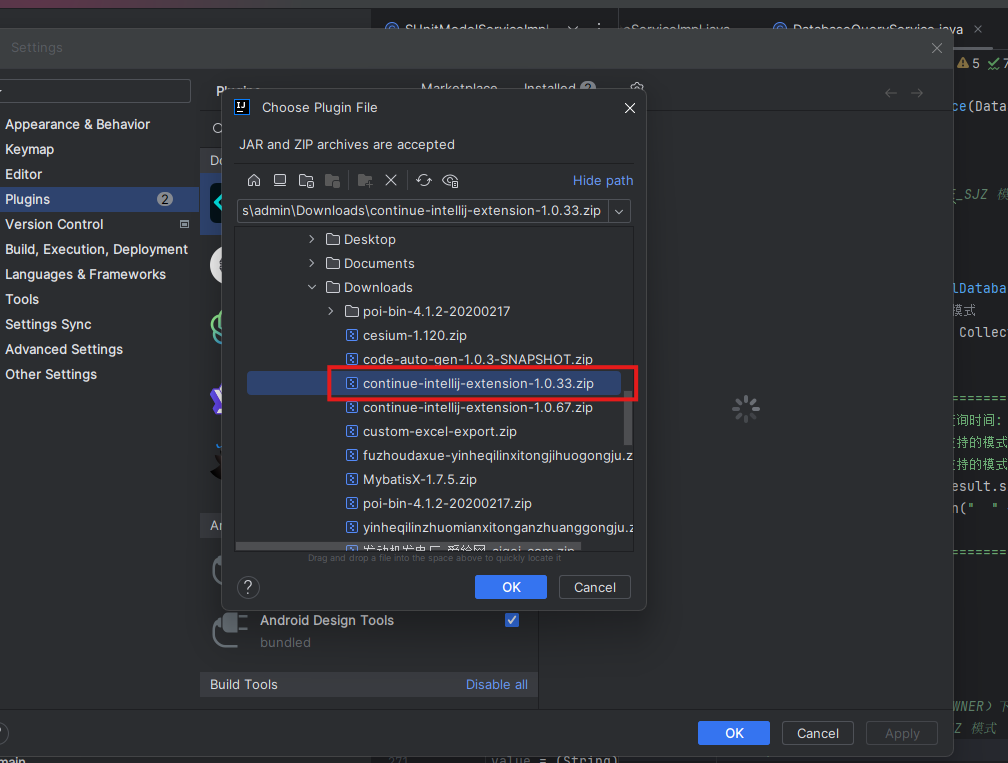

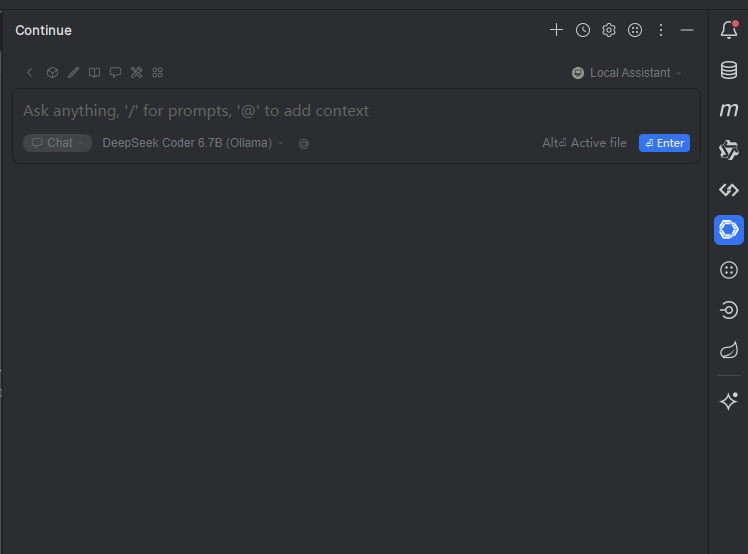

阶段 2:安装 Continue 插件(Idea里)

- IDEA → File → Settings → Plugins

- 点右上角齿轮 → Install Plugin from Disk...

- 选择你下载的 Continue-xxx.zip

- 重启 IDEA

双击导入continue插件;

阶段 3:配置 Continue(核心)

方法1:

打开 Continue 设置 → Open Settings把下面这段 完整复制粘贴 替换原有内容:

bash

{

"models": [

{

"title": "DeepSeek-Coder 6.7B (离线)",

"provider": "openai",

"model": "deepseek-coder:6.7b",

"apiBase": "http://localhost:11434/v1",

"apiKey": "ollama",

"contextWindow": 16384,

"systemMessage": "你是专业Java后端开发助手,只分析项目代码,全程用中文回答,简洁准确,不废话。"

}

]

}保存,重启 IDEA。

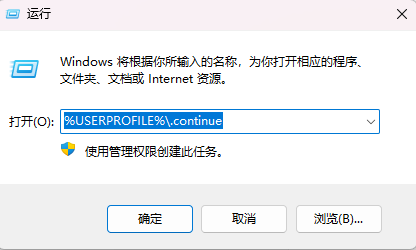

方法 2:手动打开文件(100% 成功,备用)

如果点击齿轮没反应,直接手动找到文件:

按 Win+R 打开「运行」,输入:%USERPROFILE%\.continue

回车后会直接跳转到 Continue 的配置文件夹

用 IDEA / 记事本打开里面的 config.json,替换成上面的配置,保存即可。

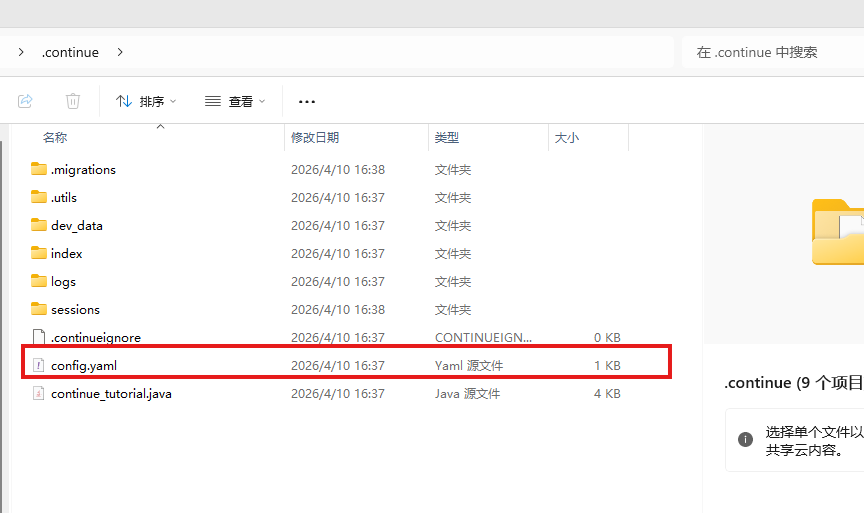

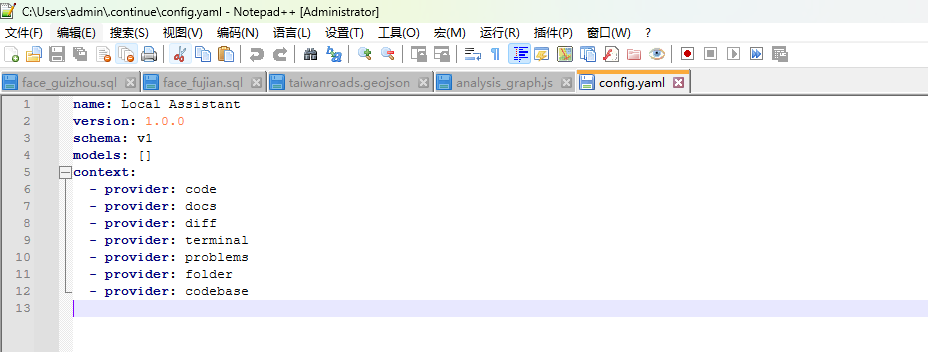

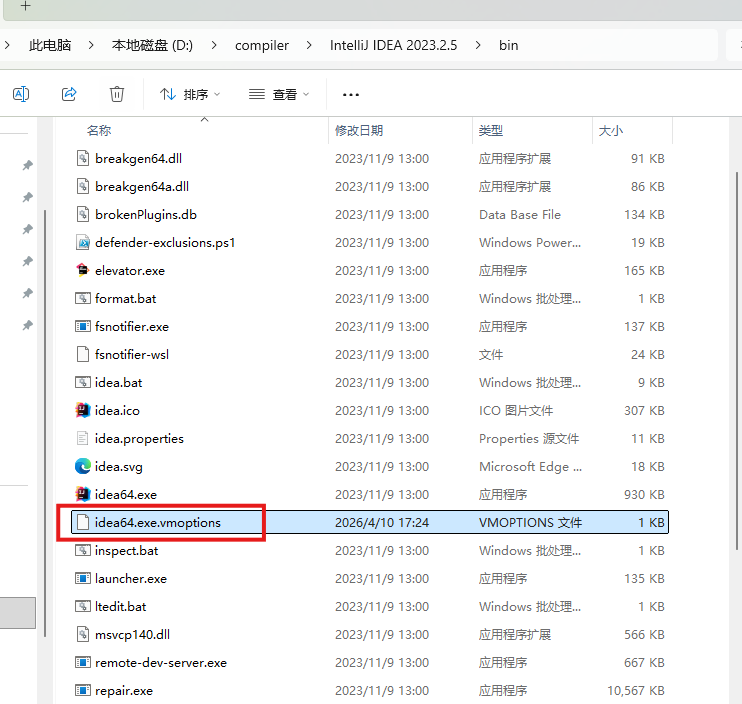

如果你只有 config.yaml(如图所示):

删除旧的 config.yaml,新建一个文件,命名为 config.json

把下面这段完整复制进去,保存:

yaml

{

"name": "Local Assistant",

"version": "1.0.0",

"schema": "v1",

"models": [

{

"title": "DeepSeek Coder 6.7B (Ollama)",

"model": "deepseek-coder:6.7b",

"apiBase": "http://localhost:11434",

"provider": "ollama",

"options": {

"temperature": 0.7,

"num_ctx": 4096

}

}

],

"tabAutocompleteModel": [

{

"title": "DeepSeek Coder 6.7B (Ollama)",

"model": "deepseek-coder:6.7b",

"apiBase": "http://localhost:11434",

"provider": "ollama",

"options": {

"temperature": 0.7,

"num_ctx": 4096

}

}

],

"contextProviders": [

{"name": "codebase"}

]

}

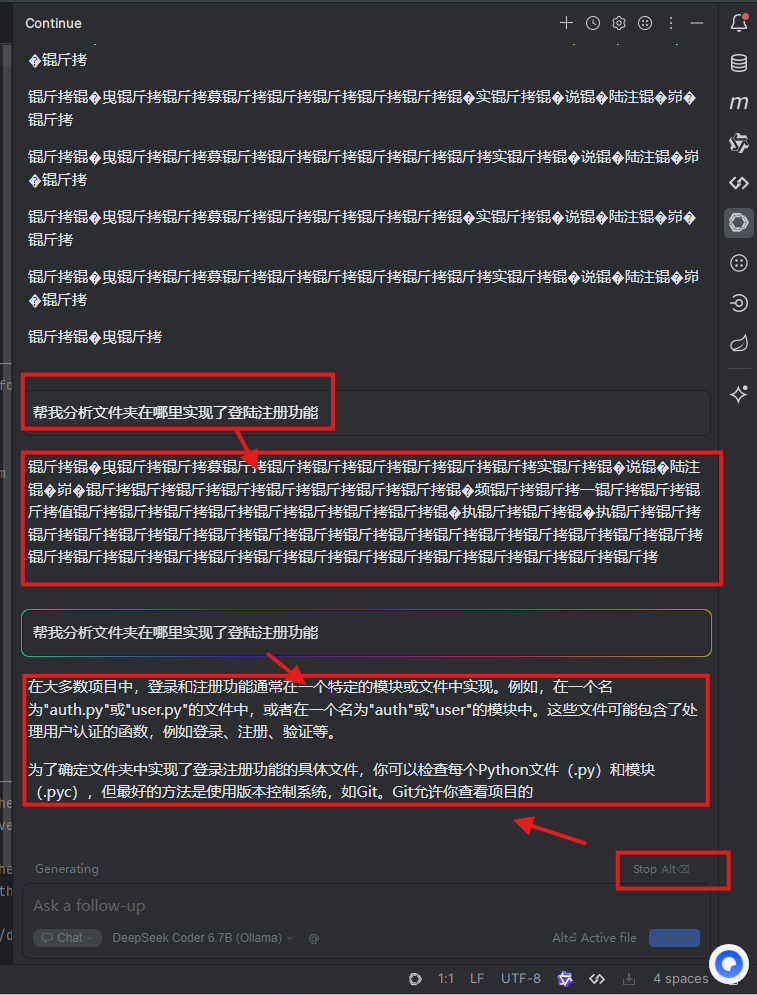

注意:乱码问题

解决方法;

1、打开 IDEA → File → Settings → Editor → File Encodings

把所有编码都改成 UTF-8:

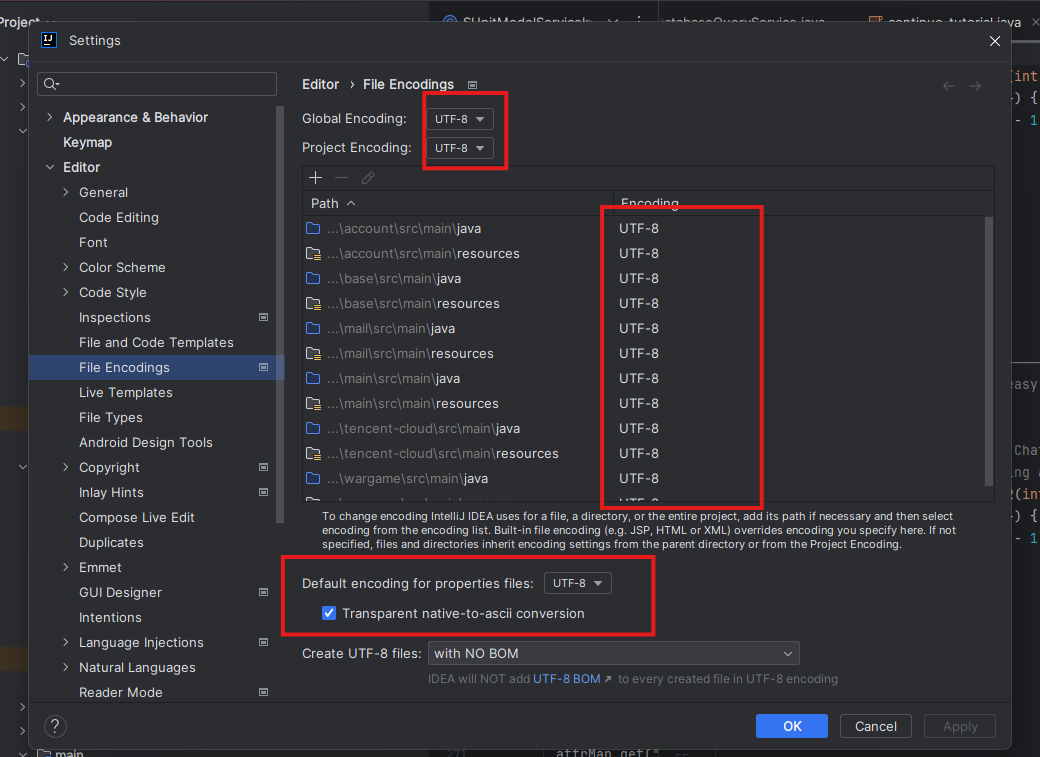

2、上面勾选后还是乱码的话,

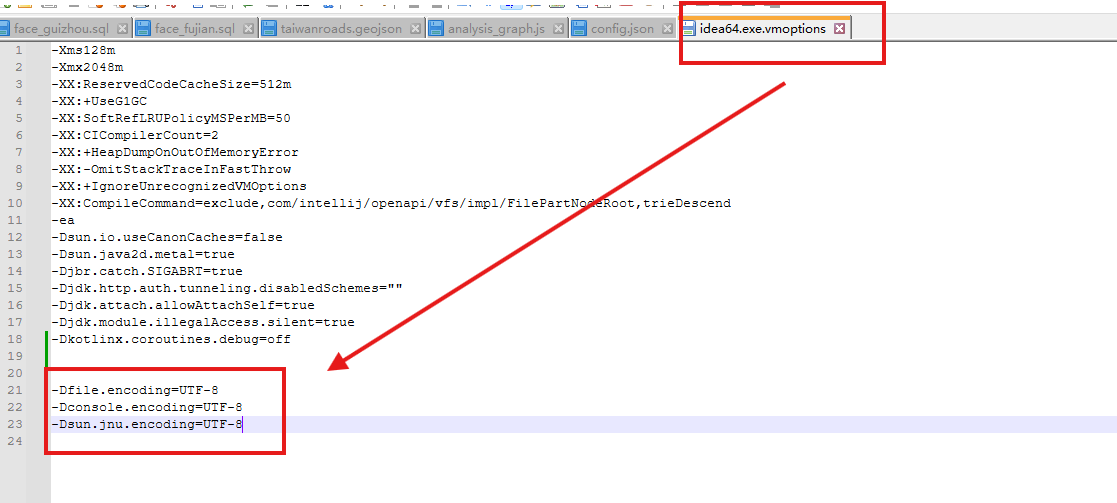

找到 IDEA 的安装目录,进入 bin 文件夹

用记事本 / Notepad++ 打开 idea64.exe.vmoptions(64 位系统)

在文件最末尾,添加这 3 行配置:

阶段 4:启动模型(不用也可以)

打开 CMD,运行:

bash

ollama run deepseek-coder:6.7b出现 >>> 就可以用了,窗口不要关。

阶段 5:离线使用(中文提问,不用也可以)

在 Continue 里直接发:

bash

@Repo 帮我找这个项目里登录功能在哪里实现,调用链是什么

bash

@Repo 这个接口的业务逻辑在哪个类哪个方法全部离线、中文、不联网。