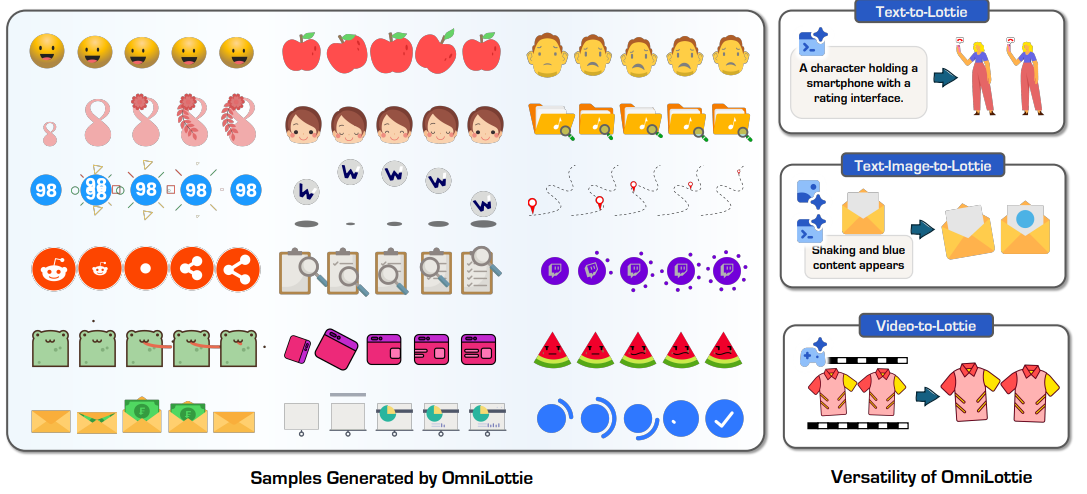

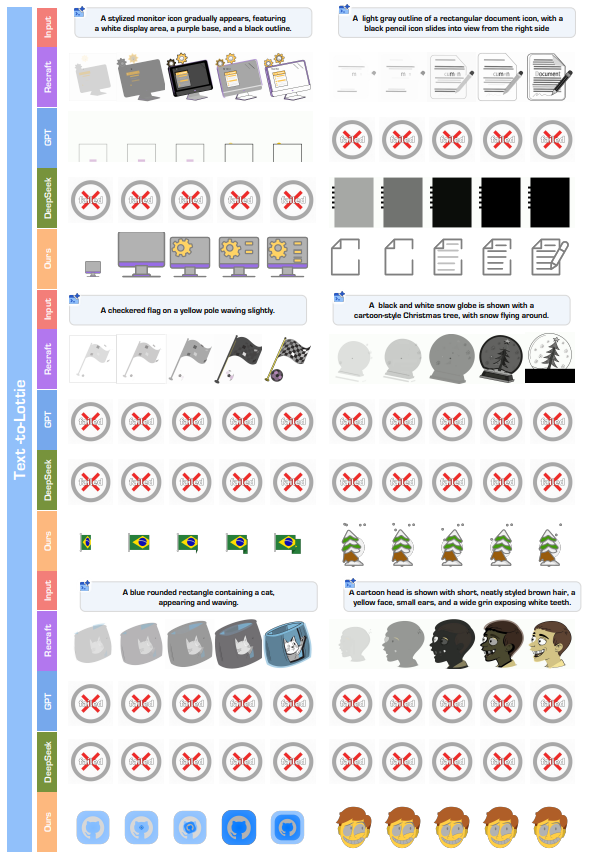

在UI/UX设计和前端开发领域,制作高质量的交互动画(Motion Design)一直是个痛点:设计师需要在After Effects中 painstakingly 绘制关键帧,开发人员则需要反复调整代码以还原效果,而最终的Lottie文件往往体积大、兼容性差。 由复旦OpenVGLab团队推出的OmniLottie提出了首个全能型多模态Lottie动画生成模型。它打破了传统工作流的壁垒,支持**"文本生成动画"、"图像生成动画"、"草图转动画"甚至"视频风格迁移为Lottie"**。OmniLottie 不仅能生成流畅的矢量动画,还能严格控制文件大小和代码结构,直接输出可用的 .json 文件。这意味着,未来你只需输入一句描述或上传一张静态图,就能立刻获得一个专业级的UI动效!

相关链接

-

数据集 (MMLottie-2M):https://huggingface.co/datasets/OmniLottie/MMLottie-2M

-

评测基准 (MMLottieBench):https://huggingface.co/datasets/OmniLottie/MMLottieBench

论文介绍

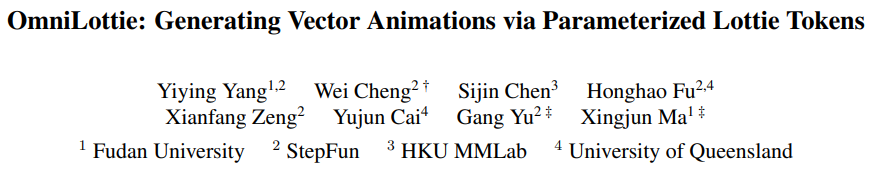

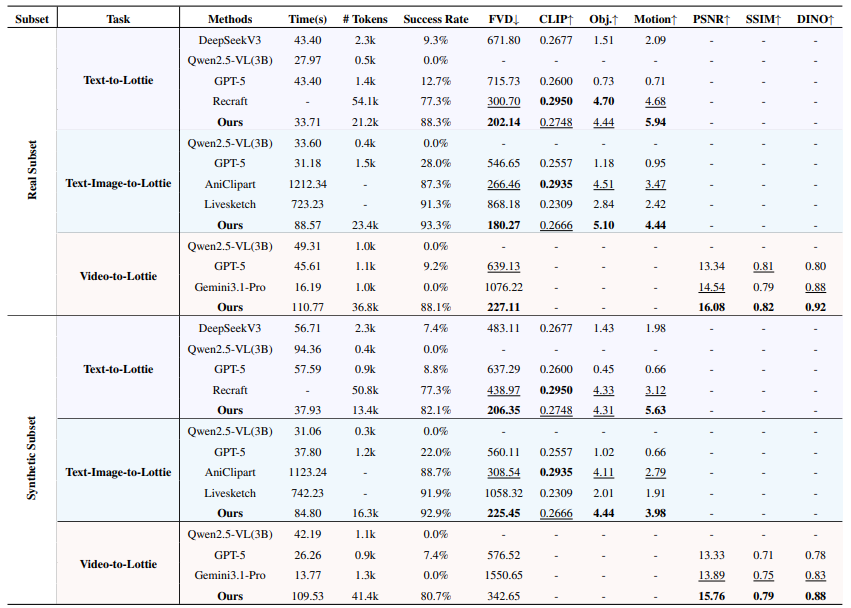

OmniLottie旨在解决AI动画生成领域的三大局限:文件体积大、无法无损缩放、难以编辑。通过引入Lottie Tokenizer,OmniLottie将Lottie JSON文件转化为结构化的命令和参数序列,实现了10倍的数据压缩比,显著降低了模型计算负担,同时确保了动画表征的零损耗与完整表达能力。此外,OmniLottie还开源了MMLottie-2M数据集,这是目前业界规模最大的200万量级多模态矢量动画数据集,为矢量动画生成领域的研究提供了坚实的数据支撑。

方法概述

Lottie Tokenizer设计

OmniLottie引入了精心设计的Lottie Tokenizer,将Lottie JSON文件中的形状、动画函数和控制参数转化为结构化的命令和参数序列。 通过参数化建模,实现了高效的数据压缩和模型计算负担的降低,同时确保了动画的完整表达能力。

多模态指令跟随

OmniLottie基于预训练的视觉语言模型(VLM),能够跟随多模态(文本、图像、视频)指令生成高质量的矢量动画。 通过引入任务token和显式指令解析机制,实现了对复杂多模态指令的准确理解和执行。

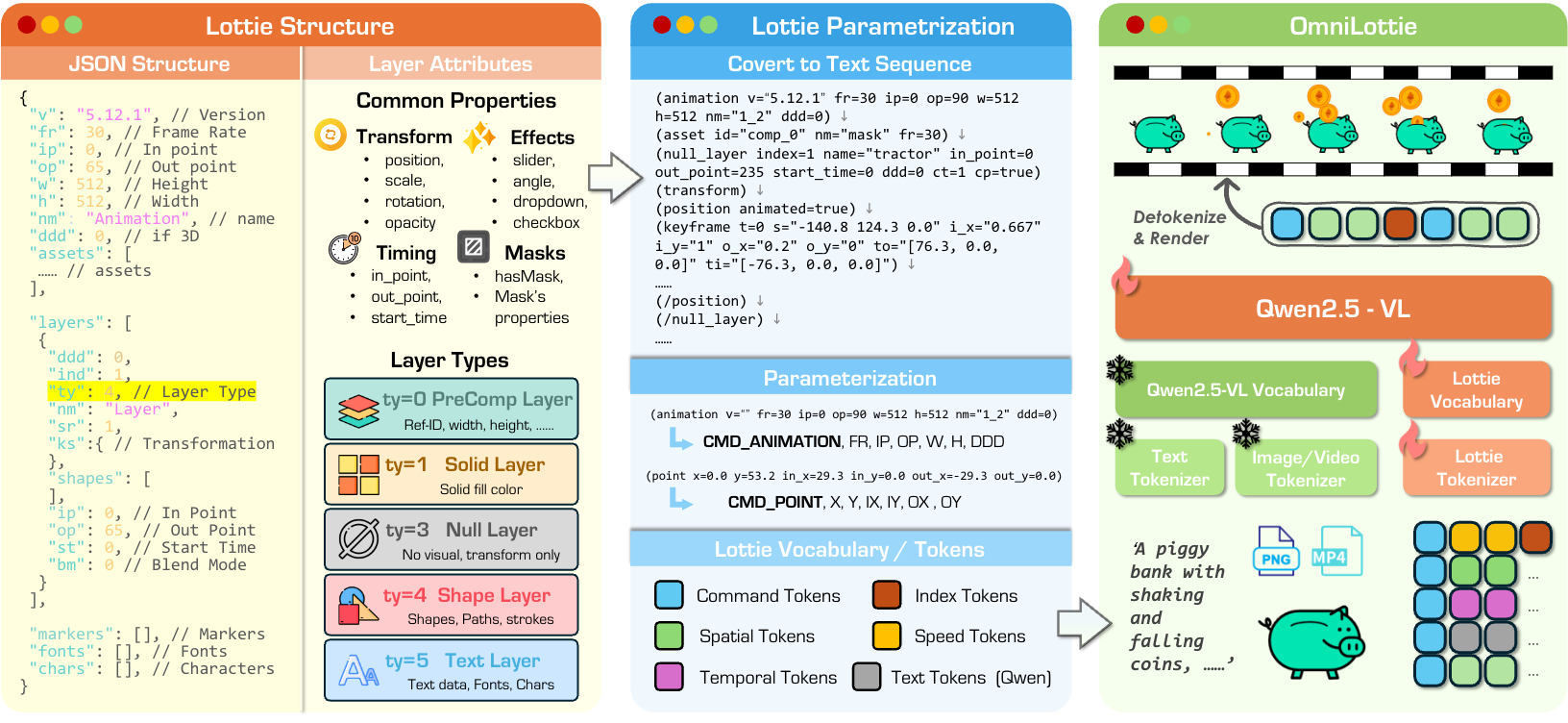

MMLottie-2M数据集构建

OmniLottie团队开源了MMLottie-2M数据集,包含200万量级的专业设计矢量动画,并配有文本和视觉注释。 该数据集通过统一的数据格式和评估标准,推动了矢量动画生成领域的标准化进程,为后续研究提供了丰富的资源。

高效训练与推理

OmniLottie通过大规模预训练和微调策略,实现了对多模态指令的高效跟随和动画生成。 在推理阶段,OmniLottie支持快速生成高质量矢量动画,满足了实时应用的需求。

实验

动画生成质量实验

OmniLottie在多个基准测试上展示了其生成高质量矢量动画的能力,生成的动画在视觉效果上逼真且语义对齐度高。 用户研究表明,OmniLottie生成的动画在创意性和实用性方面均获得了高度评价。

数据压缩与计算效率实验

Lottie Tokenizer实现了10倍的数据压缩比,显著降低了模型计算负担和存储需求。 在保持动画质量的同时,OmniLottie的推理速度比传统方法有了显著提升。

多模态指令跟随实验

-

OmniLottie能够准确理解并执行复杂的多模态指令,生成符合用户期望的矢量动画。

-

在文本、图像、视频等多种输入模态下,OmniLottie均展示了出色的指令跟随能力和动画生成效果。