论文地址:https://www.techrxiv.org/doi/pdf/10.36227/techrxiv.176539617.79044553/v1

论文git:https://github.com/ShanglinWu/LLM-MAS_Memory_Survey

目录

[1. Introduction(引言)](#1. Introduction(引言))

[1.1 研究背景与意义](#1.1 研究背景与意义)

[1.2 记忆对 LLM-MAS 的核心必要性](#1.2 记忆对 LLM-MAS 的核心必要性)

[1.3 LLM-MAS 记忆 vs 单智能体记忆(关键差异)](#1.3 LLM-MAS 记忆 vs 单智能体记忆(关键差异))

[2. Related Areas(相关领域)](#2. Related Areas(相关领域))

[2.1 LLM-based Multi-agent Systems(大模型多智能体系统)](#2.1 LLM-based Multi-agent Systems(大模型多智能体系统))

[2.2 Memory for LLM Agents(大模型智能体记忆)](#2.2 Memory for LLM Agents(大模型智能体记忆))

[3. Definitions and Terminologies(定义与术语)](#3. Definitions and Terminologies(定义与术语))

[3.1 LLM-MAS 记忆正式定义](#3.1 LLM-MAS 记忆正式定义)

[3.2 核心术语精确定义](#3.2 核心术语精确定义)

[3.3 完整案例:协同患者诊断](#3.3 完整案例:协同患者诊断)

[4. Memory Architecture: Topology and Placement(记忆架构:拓扑与部署)](#4. Memory Architecture: Topology and Placement(记忆架构:拓扑与部署))

[4.1 记忆拓扑(谁能读写)](#4.1 记忆拓扑(谁能读写))

[4.2 记忆部署位置(存在哪里)](#4.2 记忆部署位置(存在哪里))

[4.3 工程权衡(核心结论)](#4.3 工程权衡(核心结论))

[5. Memory Management and Operations(记忆管理与操作)](#5. Memory Management and Operations(记忆管理与操作))

[5.1 Read and Write Policies(读写策略)](#5.1 Read and Write Policies(读写策略))

[5.2 Consistency and Synchronization(一致性与同步)](#5.2 Consistency and Synchronization(一致性与同步))

[6. Memory-Enabled Capabilities(记忆赋能的核心能力)](#6. Memory-Enabled Capabilities(记忆赋能的核心能力))

[6.1 Collaboration and joint attention(协作与联合注意)](#6.1 Collaboration and joint attention(协作与联合注意))

[6.2 Long-horizon planning and knowledge reuse(长程规划与知识复用)](#6.2 Long-horizon planning and knowledge reuse(长程规划与知识复用))

[6.3 Social cognition and Theory of Mind(社会认知与心理理论)](#6.3 Social cognition and Theory of Mind(社会认知与心理理论))

[6.4 Lifelong team learning(团队终身学习)](#6.4 Lifelong team learning(团队终身学习))

[7. Benchmarking and Evaluation(基准与评估)](#7. Benchmarking and Evaluation(基准与评估))

[7.1 Task-Level Evaluation(任务级)](#7.1 Task-Level Evaluation(任务级))

[7.2 Memory-Specific Evaluation(记忆专项)](#7.2 Memory-Specific Evaluation(记忆专项))

[7.3 领域重大缺口](#7.3 领域重大缺口)

[8. Application of Memory in LLM-MAS Systems(落地应用)](#8. Application of Memory in LLM-MAS Systems(落地应用))

[8.1 Education(教育)](#8.1 Education(教育))

[8.2 Medicine & Healthcare(医疗健康)](#8.2 Medicine & Healthcare(医疗健康))

[8.3 Simulation & Environments(虚拟仿真)](#8.3 Simulation & Environments(虚拟仿真))

[8.4 Scientific Discovery(科学发现)](#8.4 Scientific Discovery(科学发现))

[8.5 Robotics(机器人)](#8.5 Robotics(机器人))

[9. Limitations and Future Directions(局限与未来方向)](#9. Limitations and Future Directions(局限与未来方向))

[9.1 核心局限](#9.1 核心局限)

[9.2 四大未来研究方向](#9.2 四大未来研究方向)

[10. Conclusion(结论)](#10. Conclusion(结论))

摘要

记忆在将基于大语言模型(LLM)的智能体从被动预测器转变为稳定、具备上下文感知能力的协作者方面发挥着核心作用。尽管基于大语言模型的单智能体记忆已得到广泛研究,但基于大语言模型的多智能体系统(LLM-MAS)中的记忆却缺乏系统的分类与综述。在多智能体场景中,记忆成为支撑集体智能、长期协作和团队进化的共享认知基础设施。本综述首次对大语言模型多智能体系统中的记忆展开全面梳理,综合了记忆架构、管理与运行、评估及应用等方面的研究,同时明确了关键定义并构建了该领域的设计空间。研究发现,大语言模型多智能体系统中的记忆并非单智能体记忆的简单延伸,而是一个全新的研究前沿------在同步性、访问控制、可扩展性、对齐性与安全性方面面临全新挑战。通过整合各类相关文献,本文旨在为未来构建智能、记忆增强型多智能体系统的研究奠定基础。为追踪该领域的最新研究成果,我们创建并维护了一个代码仓库,地址为 https://github.com/ShanglinWu/LLM-MAS_Memory_Survey.git。

1. Introduction(引言)

1.1 研究背景与意义

- 大模型智能体(LLM Agent)加入记忆模块 后,才能从 "被动响应" 变成有一致性、有上下文、能长期协作的真正智能体。

- 单智能体记忆研究已非常充分,但基于大模型的多智能体系统(LLM-MAS)的记忆 完全缺乏系统性分类、综述与设计框架。

- 在多智能体场景中,记忆不再是个体模块,而是支撑集体智能、长期协同、团队持续进化的共享认知基础设施。

- 该方向是通往AGI的关键一步:让智能体像人类团队一样协作、积累经验、共同演化。

1.2 记忆对 LLM-MAS 的核心必要性

- 让智能体记住历史子任务、交接流程、角色行为,不用每次从头开始。

- 解决多智能体最常见失败原因:系统设计差、智能体间对齐错误,用统一记忆提供公共知识与交互历史。

- 从认知科学角度:支撑分布式认知,模拟人类 "交互记忆系统"(知道谁知道什么),高效分配认知资源。

- 支撑心理理论(ToM):记住其他智能体行为与通信规则,预测对方动作、保持协作。

- 没有长期记忆,智能体无法形成专业能力与相互适应,无法像人类团队一样高效工作。

1.3 LLM-MAS 记忆 vs 单智能体记忆(关键差异)

- 目标不同 单智能体:扩展上下文窗口、自我学习;多智能体:实现集体智能,把个体知识变成团队知识库。

- 架构不同 单智能体:单体、本地存储;多智能体:集中式 / 分布式 / 混合,支持多层上下文(个体 / 团队 / 环境)。

- 挑战不同 单智能体:效率、可解释性;多智能体:信息不对称、一致性、同步、权限控制、多层上下文协同。

- 结论:多智能体记忆绝不是单智能体记忆的简单扩展,而是全新研究前沿。

2. Related Areas(相关领域)

2.1 LLM-based Multi-agent Systems(大模型多智能体系统)

- 已有大量综述:覆盖通信、角色、协作机制、软件工程、具身 AI、化工等。

- 共同问题:记忆只是被顺带提及,从未作为核心主线分析。

- 本文创新:以记忆为唯一核心视角,串联所有多智能体研究,填补空白。

2.2 Memory for LLM Agents(大模型智能体记忆)

- Zhang et al. (2025d) 发表了单智能体记忆综述,覆盖长短时记忆、检索、RAG 等。

- 但完全没有针对多智能体场景。

- 本文继承其部分概念(短时 / 长时、情节 / 语义),但完全重构为多智能体专用体系。

- 与传统方向关联:

- RAG:和检索增强部分重叠;

- 认知架构 / RL:借鉴情节 / 语义记忆,但不适应 LLM 自然语言交互模式。

- 结论:本文是首个专门面向 LLM-MAS 记忆的综述。

3. Definitions and Terminologies(定义与术语)

3.1 LLM-MAS 记忆正式定义

- 智能体从与环境交互、与其他智能体交互中保留的所有信息,用于指导未来行为。

- 数学表达:

- 系统记忆 = 所有智能体本地记忆 ∪ 共享记忆。

3.2 核心术语精确定义

- **Team(团队)**为共同 / 对抗目标协作的 N 个智能体集合。

- Local Memory(本地记忆)

- 单个智能体私有,仅自己可读写。

- 内容:环境交互历史、与其他智能体通信历史、外部知识。

- 内部包含:短时 / 长时记忆、情节记忆(具体事件)、语义记忆(规则 / 常识)。

- Shared Memory(共享记忆)

- 团队内多个智能体可访问的公共存储。

- 形式:向量数据库、知识图谱、文档、黑板。

- 作用:打破信息孤岛,形成团队全局心智。

- 可带权限策略,尤其适合竞争场景。

- Orchestrator(协调器)

- 负责调度、分配任务、合并信息、管理全局记忆的特殊智能体 / 模块。

- 持有高层策略,决定谁在何时行动。

- Blackboard(黑板)

- 经典去中心化求解架构,所有智能体可读写的共享工作区。

- 智能体不断发布信息,直到达成共识。

- 本质:带协调逻辑的共享记忆。

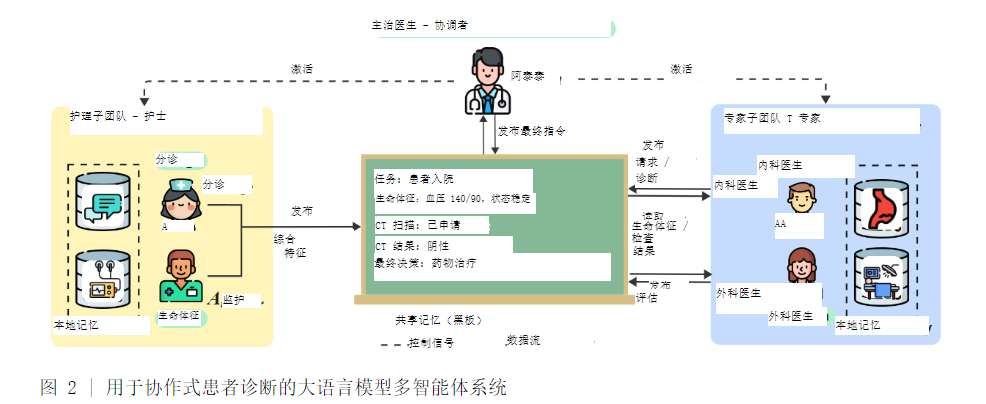

3.3 完整案例:协同患者诊断

- 团队:主治医生(协调器)、护理小组、专科小组。

- 共享记忆 = 电子病历黑板。

- 流程:

- 协调器读取初始患者信息,激活护理组;

- 护理组用本地记忆收集原始数据,只把摘要写入共享记忆;

- 协调器激活专科组(内科、外科);

- 专科组读取共享信息,结合本地领域知识给出诊断;

- 出现冲突时,协调器仲裁,最终方案写入共享记忆。

- 价值:本地隐私 + 全局同步,多智能体高效协同。

4. Memory Architecture: Topology and Placement(记忆架构:拓扑与部署)

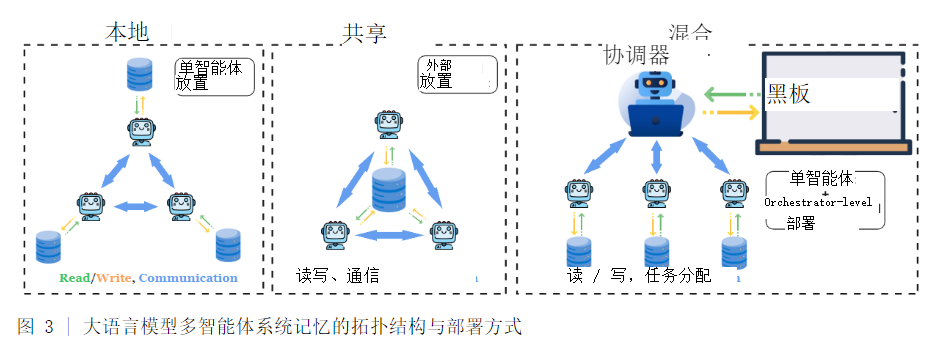

4.1 记忆拓扑(谁能读写)

(1)Local-Only Topology(纯本地)

- 每个智能体只维护私有记忆,靠通信交换信息。

- 代表:CAMEL、AutoGen、Chain-of-agents。

- 优点:隐私强、无干扰、鲁棒性高;

- 缺点:信息冗余、易不一致、通信开销 O (N²)。

(2)Shared Topology(纯共享)

- 全局统一记忆池,所有智能体可读写。

- 代表:Memory Sharing framework。

- 优点:协作强、联合注意、信息同步快;

- 缺点:噪声堆积、隐私差、无权限区分。

(3)Hybrid Topology(混合)

- 本地记忆 + 协调器全局记忆。

- 代表:LEGOMem、Anthropic 多智能体系统。

- 当前最主流、最实用架构。

优点:平衡隐私、效率、协作,减少全局信息混乱。

4.2 记忆部署位置(存在哪里)

- **Per-agent(智能体本地)**与智能体绑定,如本地对话日志、私有知识图谱。适合:本地隐私信息。

- **Orchestrator-level(协调器层)**中心节点汇总全局状态、任务进度。典型:黑板模式、PC-Agent。

- **External(外部存储)**独立数据库、知识图谱、文档。优点:容量大、持久、超上下文窗口;缺点:延迟高、需要并发控制。

4.3 工程权衡(核心结论)

- 可扩展性:分布式 > 中心化;

- 鲁棒性:分布式无单点故障,中心化需备份;

- 隐私:本地 > 共享,共享需权限控制;

- 协作效率:混合架构最优;

- 无万能架构:小团队用中心化,大规模系统用混合模块化。

5. Memory Management and Operations(记忆管理与操作)

5.1 Read and Write Policies(读写策略)

写入策略(Write)

- 角色分层摘要协调器:写高层计划、总结;执行智能体:写细粒度过程日志;评估智能体:写高权重观察结果。

- 冲突解决规则并发写入时,决定谁的信息优先。

- 多粒度存储同时保存:全局精简摘要 + 个体详细日志。

- 重要性过滤按任务权重决定是否存储。

读取策略(Read)

- 角色自适应检索协调器读全局状态,执行者读局部信息。

- 本地优先先读本地记忆,必要时再请求共享记忆。

- 并发控制加锁、版本号、协调器序列化,避免冲突。

- 学习型策略让智能体自主学习何时读、读多少、读多细。

5.2 Consistency and Synchronization(一致性与同步)

(1)同步机制

- 串行轮流执行智能体按顺序读写,无并发冲突。适合:对话、辩论系统。

- 任务级原子更新逻辑相关的修改一次性提交。

- 发布 - 订阅模式智能体订阅关心主题(如 "全局计划"),更新自动推送。解决:信息滞后、信念不一致。

(2)冲突解决

- 禁止简单 "后写覆盖"(不安全)。

- 采用:角色权重、置信度、投票、信任模型。

- 必须记录来源信息(Provenance):作者、时间、置信度、证据链。

- 价值:支持仲裁、可解释性、审计追溯。

6. Memory-Enabled Capabilities(记忆赋能的核心能力)

6.1 Collaboration and joint attention(协作与联合注意)

- 解决上下文碎片化:纯本地记忆无法持有全局状态,通信爆炸。

- 共享记忆 = 团队共同心智(Common Ground)。

- 混合架构实现选择性联合注意:只关注相关模块,不被全局信息淹没。

- 提升情境感知,减少信息不对称。

- 支持动态扩缩容:新智能体直接读共享记忆快速上线。

6.2 Long-horizon planning and knowledge reuse(长程规划与知识复用)

- 分层规划协调器维护高层计划图;智能体执行子任务;失败时触发重规划。

- 情节记忆 → 语义记忆沉淀把具体交互经历 → 抽象成规则、技能、流程。

- 知识复用价值:

- 更快:检索比重新生成便宜;

- 更稳:用过的方案更可靠;

- 复合创新:组合已有技能解决更难问题。

6.3 Social cognition and Theory of Mind(社会认知与心理理论)

- 用本地记忆建模其他智能体:知道对方知道什么、能做什么、是否可靠。

- 减少重复通信,避免 "消息风暴"。

- 仿真场景:记忆生成人格、社交关系、社会规范,形成虚拟文化。

- 竞争场景:支持对手建模、欺骗、策略博弈、双轨记忆(真实状态 / 公开表达)。

6.4 Lifelong team learning(团队终身学习)

- 目标:系统无限次交互后持续变强,形成团队文化。

- 机制:

- 不断把经验转为语义资产(SOP、领域词典、流程);

- 代际知识传递:新智能体读历史记忆快速上手;

- 模型升级不丢失知识:记忆独立于 LLM 权重。

- 系统进化四阶段:瞬态 → 情节 → 语义 → 终身反应式 → 可回溯 → 可复用 → 自优化

7. Benchmarking and Evaluation(基准与评估)

7.1 Task-Level Evaluation(任务级)

- 指标:成功率、推理准确率、轨迹效率(TES)。

- 基准:

- OfficeBench:办公自动化任务;

- MultiAgentBench:科研协作、建造、对抗游戏。

7.2 Memory-Specific Evaluation(记忆专项)

- 核心指标:

- 动态记忆召回概率

- 写入准确率

- 跨智能体知识一致性(IAKC)

- 效率、容量、延迟

- 代表性基准:MemoryAgentBench、LoCoMo、LongMemEval、MemTrack、MemBench。

7.3 领域重大缺口

- 没有专门面向 LLM-MAS 记忆的统一基准;

- 现有基准要么测单智能体,要么不关注记忆;

- 缺少:跨智能体一致性、长程同步、大规模并发压力测试。

8. Application of Memory in LLM-MAS Systems(落地应用)

8.1 Education(教育)

- 持久记忆追踪学习轨迹、错误、误解、参与度。

- 多智能体扮演教师 / 助教 / 学生,提供长期个性化辅导。

- 支持数学、生物、医学、法律等专业场景。

8.2 Medicine & Healthcare(医疗健康)

- 共享记忆 = 统一电子病历黑板。

- 多专科智能体(放射、内科、外科)协同诊断。

- 要求:一致性、可追溯、权限隔离、隐私安全。

8.3 Simulation & Environments(虚拟仿真)

- 记忆支撑智能体人格、关系、目标、社会规范长期演化。

- 代表:Generative Agents、AgentSociety、Artificial Leviathan。

- 构建逼真人类行为与社会模拟。

8.4 Scientific Discovery(科学发现)

- 共享记忆 = 团队实验笔记本。

- 智能体分工:文献、假设、实验、分析、审稿。

- 代表:Google AI Co-Scientist、ChemCrow、Coscientist。

8.5 Robotics(机器人)

- 混合记忆:本地感知 + 全局状态共享。

- 多机器人协同完成长程操作、规划、控制。

- 代表:MALMM、GenRobotics、Emos。

9. Limitations and Future Directions(局限与未来方向)

9.1 核心局限

- 绝大多数系统无持久记忆,或只用最简单共享存储;

- 记忆膨胀、检索慢、无剪枝、冗余严重;

- 无统一标准:表示、检索、权限、来源追踪各自为政;

- 隐私、安全、对齐机制严重缺失;

- 架构都是单点方案,未形成通用设计空间。

9.2 四大未来研究方向

- 跨智能体剪枝、压缩、协同遗忘去重、合并、自动丢弃噪声,降低存储与延迟。

- 成本与规模控制令牌高效、低延迟、动态粒度、自适应写入频率。

- 构建协同记忆专用基准测一致性、同步速度、检索精度、并发压力。

- 记忆驱动的对齐与安全 用共享记忆存储伦理规范、风险日志、安全约束,避免重复犯错。

10. Conclusion(结论)

- 记忆是将 LLM 智能体集合转变为连贯协作团队的核心基石;

- LLM-MAS 记忆不是单智能体记忆的简单扩展,而是独立研究前沿;

- 面临独特挑战:一致性、同步、权限、可扩展性、安全;

- 本文提供概念体系、分类框架、文献库、未来路线,支撑下一代记忆增强型多智能体系统。