ASI-Evolve: 让AI自己搞研究、自己做实验、自己迭代进化 -- 这事靠谱吗?

你有没有想过一个问题:我们每天都在用AI做各种事情,但AI研究本身------设计更好的模型架构、清洗更高质量的数据、发明新的训练算法------还是得靠人类研究者一行行写代码、一轮轮跑实验、一遍遍分析结果。

这个过程有多慢?一个博士生探索一种新的注意力机制,可能要花几周写代码调试,跑一轮实验等几天出结果,分析完再改设计又是一两周。而人脑能并行探索的假设空间极其有限------你同时能认真思考的方案也就两三个。

那如果让AI来做这件事呢?不是让AI帮你补全几行代码那种浅层辅助,而是让AI 完整地走完"提出假设 - 设计方案 - 跑实验 - 分析结果 - 再提新假设"这个闭环?

上海交通大学 GAIR-NLP 团队(Pengfei Liu组)最近放出了 ASI-Evolve,一个面向 AI-for-AI 研究的 Agent 框架。1773 轮架构探索,发现了 105 个超越 DeltaNet baseline 的线性注意力架构;数据清洗 pipeline 平均涨 3.96 分,MMLU 涨了 18.64 分;RL 算法设计上,AIME24 直接从 20.00 拉到 31.67。

看到这些数的时候我的反应是:如果这些结果是可复现的,那这个方向的意义可能比大多数人想的要大。但也有几个地方让我皱眉------后面会聊。

📖 论文信息

- 标题:ASI-Evolve: AI Accelerates AI

- 作者:Weixian Xu, Tiantian Mi, Yixiu Liu, Yang Nan, Zhimeng Zhou, Lyumanshan Ye, Lin Zhang, Yu Qiao, Pengfei Liu(通讯作者)

- 机构:上海交通大学 / 上海人工智能实验室 / GAIR-NLP

- 日期:2026年3月31日

- 链接 :arXiv:2603.29640 | GitHub

🎯 这篇论文在解决什么问题?

AI 研发有三大核心支柱:数据、架构、算法。每个方向的进步都依赖反复的"假设-实验-分析"循环。问题在于,这个循环几乎完全依赖人力:

- 假设空间受限:人脑能并行探索的方案数量很少

- 实验周期长:一个想法从构思到验证可能需要数周

- 知识难以沉淀:跨迭代的经验积累依赖个人直觉,很难系统化传承

之前的工作已经在不同层面尝试过让 AI 参与科研。DeepMind 的 FunSearch(2023, Nature)用 LLM + 进化方法在函数空间搜索,解决了组合优化问题;AlphaEvolve(2025)更进一步,能跨越数百行代码进化整个代码库,优化了 Google 数据中心调度、TPU 电路设计,还打破了矩阵乘法 56 年的记录。

但这些工作有一个共同特点:它们解决的是有明确评分函数的优化问题。给你一个函数,能自动算分,然后迭代改进。

ASI-Evolve 想做的事更"野"一点------它瞄准的是 AI 研发本身,涉及架构设计、数据清洗流程、强化学习算法这些反馈信号复杂、评估维度多元的问题。用论文的话说,是要实现"closed-loop AI research"。

外链图片转存中...(img-wu8KJJLU-1776169725357)

ASI-Evolve 的整体定位:以AI的三大核心组件(数据、架构、算法)为研究对象,通过 Agent 闭环实现自动化发现,并验证了向数学和生物医学领域的可迁移性。

🏗 框架设计:五个模块如何协作?

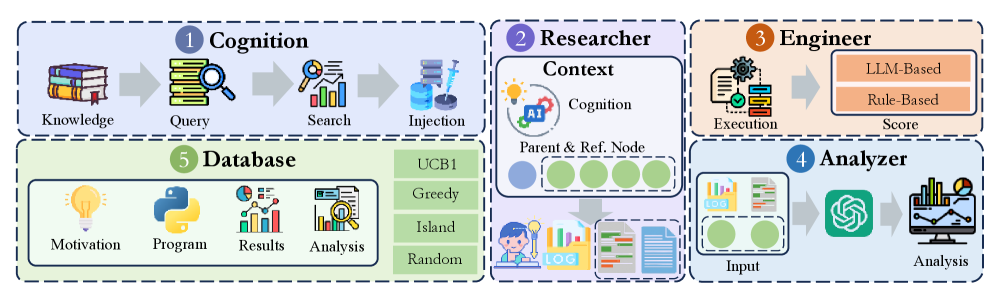

ASI-Evolve 的核心是一个 learn-design-experiment-analyze 循环,由五个模块组成:

框架的五个核心模块:Cognition 注入先验知识,Researcher 生成候选方案,Engineer 执行实验,Analyzer 提炼分析报告,Database 存储进化历史。

逐个来看:

Cognition Base(认知库) -- 这是系统的"知识基础"。把人类的先验知识(设计原则、文献中的启发式规则)编码进来,用 embedding 索引,在生成假设时检索相关知识。说到这个,FunSearch 和 AlphaEvolve 都没有显式的知识注入模块,它们主要靠 LLM 自身的隐式知识。ASI-Evolve 加这个模块的动机很直接:AI 研发的搜索空间太大了,纯靠随机探索效率太低,需要用人类知识来"暖启动"。

Researcher(研究者) -- 从数据库中采样已有方案节点,检索 Cognition 中的相关知识,然后生成完整的候选程序,附带自然语言的设计动机说明。采样策略支持 UCB1、Random、Greedy、MAP-Elites。

Engineer(工程师) -- 执行候选程序的实验,返回结构化指标。支持 early rejection(墙钟时间限制和快速测试)。这个模块还包含静态检查 agent、调试 agent 和新颖性检查(过滤重复方案)。

Analyzer(分析器) -- 这个模块我觉得是 ASI-Evolve 跟前置工作拉开差距的关键。它不是简单地把实验分数传回去,而是把多维度的实验信号(多个指标、日志、traces)蒸馏成紧凑的、面向决策的分析报告,存起来供后续检索。这解决了一个实际问题:AI 研发的反馈不像圆填充问题那样只有一个标量分数,你需要理解"为什么这个架构在 MMLU 上涨了但在 HellaSwag 上掉了"。

Database(数据库) -- 持久化存储进化过的解决方案,包括动机、代码、结果、分析和元数据。支持灵活的采样策略。

🧪 实验一:架构设计 -- 1773 轮探索,105 个超越 baseline 的架构

这是论文篇幅最大、也是我认为最有说服力的一组实验。

任务:在线性注意力架构空间中搜索,baseline 是 DeltaNet(一种结合了 delta rule 更新的线性注意力模型,在 sub-quadratic 架构中表现不错)。

多阶段评估流程:

- 探索阶段:~20M 参数,2000步训练,10 个核心 benchmark 各 500 样本

- 验证阶段:~340M 参数

- 大规模验证:~1.3B 参数,100B token 训练

1773 轮探索之后,系统发现了 105 个超越 DeltaNet 的架构。从中选了 5 个代表性架构做大规模验证:

| 架构 | 开发集平均 | 泛化集平均 | 核心创新 |

|---|---|---|---|

| DeltaNet (baseline) | 55.76% | 44.74% | 固定分配 |

| PathGateFusionNet | 56.42% | 44.99% | 层级路由,本地/上下文处理动态切换 |

| ContentSharpRouter | 57.28% | 45.19% | 内容感知路由 + 可学习温度参数 |

| FusionGatedFIRNet | 56.73% | 45.40% | 独立 sigmoid 门替换 softmax 路由 |

| HierGateNet | 56.31% | 45.09% | 两阶段门控 + 动态可学习 floor 值 |

| AdaMultiPathGateNet | 56.89% | 45.23% | token 级控制,BalancedSparseGate |

最好的架构涨了 +0.97 个点------论文说这是"近 3 倍于近期人类设计改进的增益"。

坦率讲,0.97 个点的绝对值不算炸裂,但考虑到这是在 1.3B 规模、100B token 训练下的结果,而且是自动发现 的,这个效率还是挺能打的。更值得关注的是这些架构收敛出来的设计模式------自适应、多尺度路由,根据输入内容动态调整计算预算。这不是人类已知的"最优做法",而是系统自己摸索出来的方向。

🧪 实验二:数据清洗 -- MMLU 涨了 18 个点

应用到 Nemotron-CC 数据集(覆盖 STEM 领域的 672B token),训练 3B 参数模型,500B token:

| 指标 | 原始数据 | ASI-Evolve 清洗后 | 提升 |

|---|---|---|---|

| 平均分 | 40.17 | 44.13 | +3.96 |

| MMLU | 27.49 | 46.13 | +18.64 |

| CSQA | 20.31 | 39.12 | +18.80 |

| MedQA | 26.77 | 40.25 | +13.48 |

说实话,MMLU 涨 18 个点这个数让我愣了一下。后来想想,这是跟原始未清洗数据比,而不是跟精心人工清洗的版本比,所以这个基线选得比较低。不过 +3.96 的平均提升还是实打实的。

有意思的是,系统自动发现的清洗策略收敛到了以清洗为主的方案:有针对性地去除 HTML 残留、重复内容、PII,加上格式标准化和领域感知的保留规则。这跟人类的经验基本一致------数据质量提升,清洗比增强更管用。

🧪 实验三:RL 算法设计 -- 300 轮进化出三个新算法

在 4B 和 14B 参数模型上,基于 GRPO 框架做 RL 算法进化。300 轮之后发现了 3 个表现优异的算法:

14B 验证阶段结果:

| 指标 | 基线 | 进化后最优 | 提升 |

|---|---|---|---|

| AMC32 | 67.5 | 80.0 | +12.5 |

| AIME24 | 20.00 | 31.67 | +11.67 |

| OlympiadBench | 45.92 | 50.96 | +5.04 |

三个算法的核心创新各有不同:

- Pairwise Asymmetric Optimization:用 tanh 归一化的成对奖励差异 + 非对称裁剪 + 高影响梯度 Dropout(防止关键词过拟合)

- Budget-Constrained Dynamic Radius:基于百分位数的归一化 + 全局更新预算,数学上保证策略更新幅度在预定义范围内

这些不是简单的超参微调,而是算法结构层面的创新。我觉得这是整篇论文最让人兴奋的部分------AIME24 从 20 涨到 31.67,这在数学推理任务上是相当可观的提升。

🔬 框架对比与消融实验

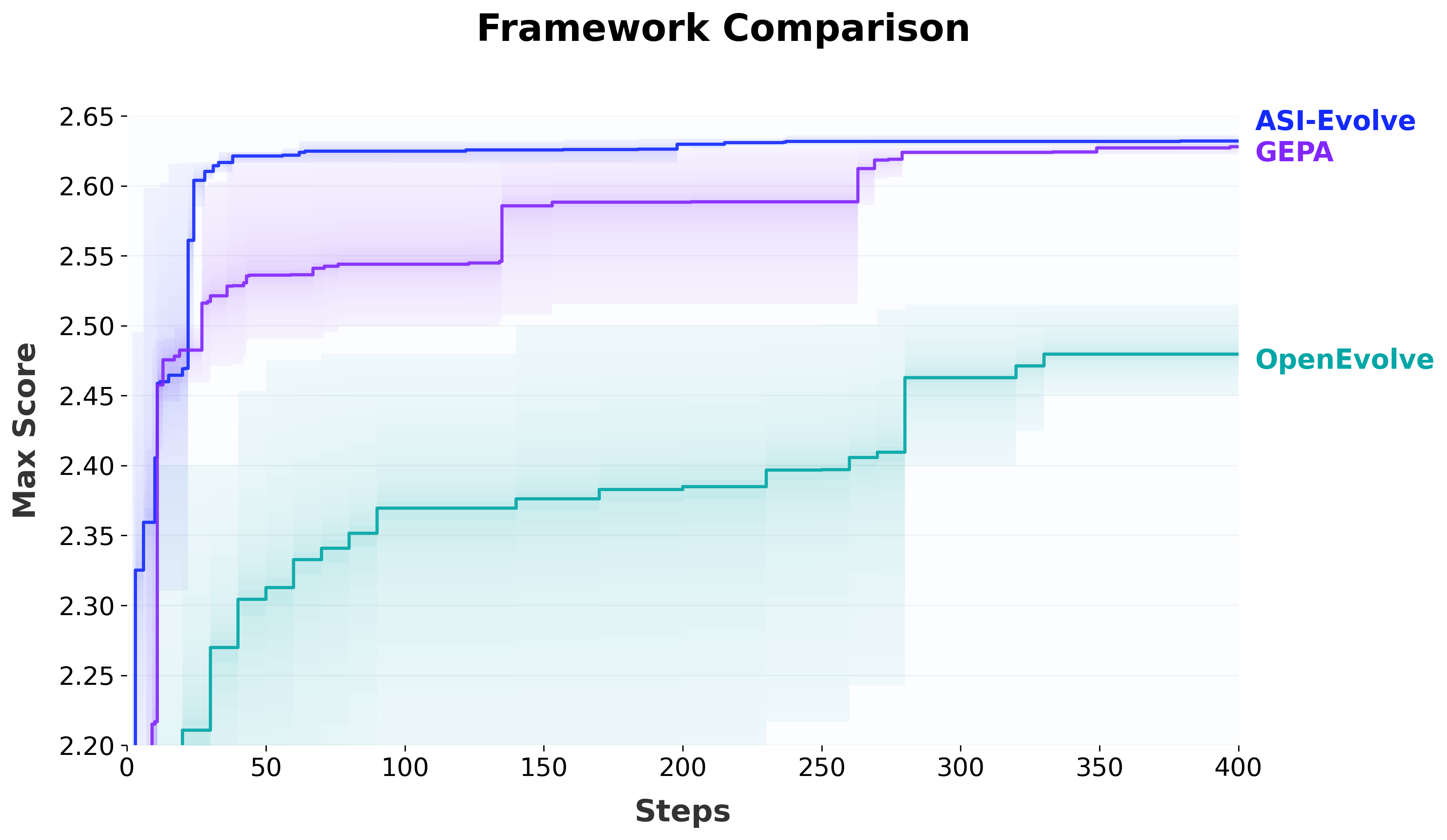

跟谁比?Circle Packing 任务

先看一个标准 benchmark------26 个圆在 1x1 正方形中的 circle packing 问题:

| 框架 | 最优得分 | 步数 | 底层模型 |

|---|---|---|---|

| AlphaEvolve | 2.6359 | - | Gemini |

| OpenEvolve | 2.6343 | 460 | - |

| LoongFlow | 2.6360 | - | - |

| SkyDiscover | 2.6360 | 89 | - |

| ASI-Evolve | 2.63597 | 17 | GPT-5-mini |

17 步就达到 SOTA 级别的分数,而 OpenEvolve 需要 460 步。效率差了一个数量级。

框架对比实验(Qwen3-32B):ASI-Evolve(蓝色)在前 50 步就冲到接近最优区域,GEPA(紫色)稍慢但最终接近,OpenEvolve(青色)明显落后且方差更大。

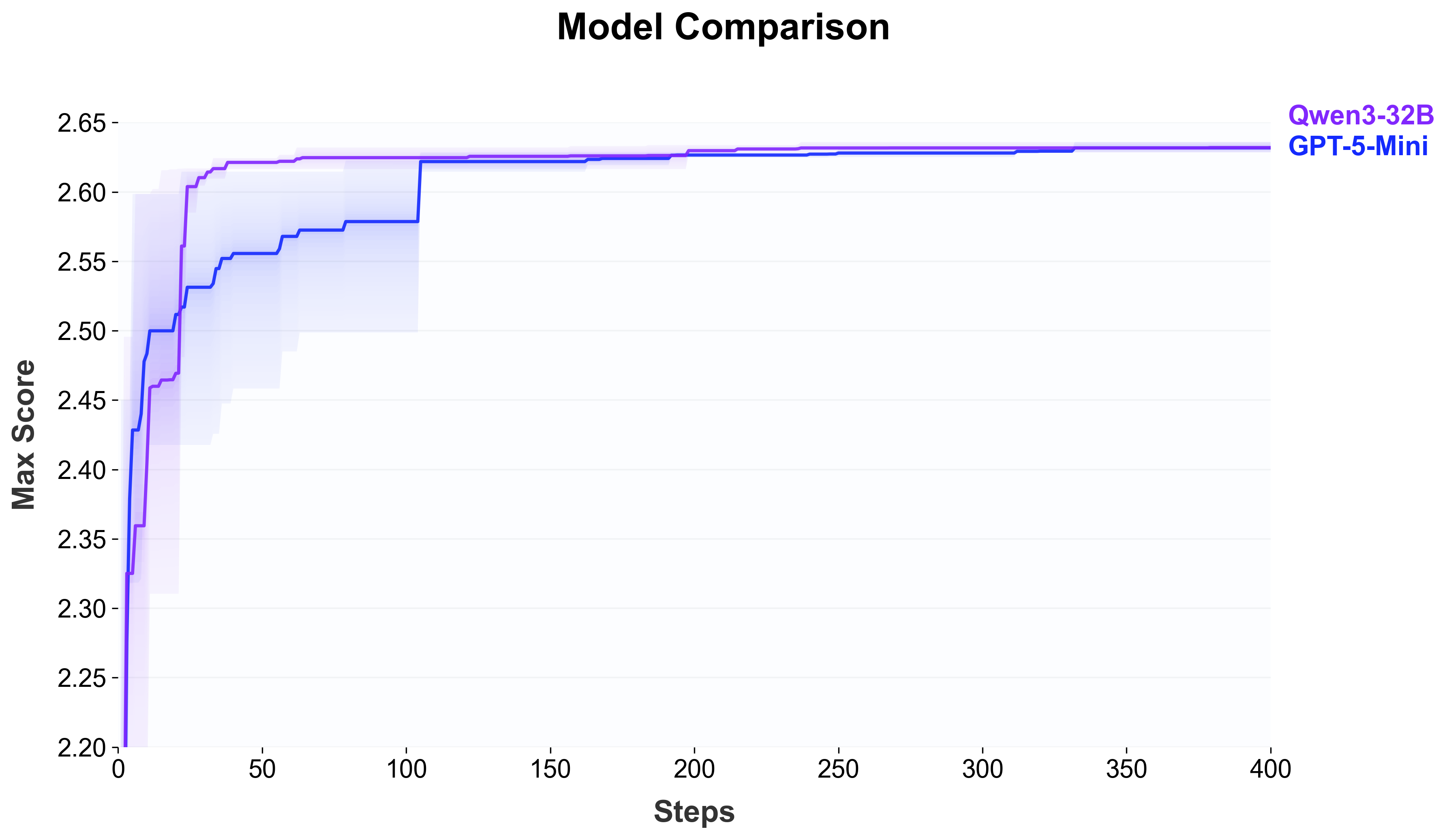

底层模型影响

Qwen3-32B 和 GPT-5-Mini 在中后期的进化趋势高度一致,说明框架设计比底层模型选择更重要。这个结论对实际部署很有参考价值------不一定非得用最强的闭源模型。

采样策略对比

UCB1 策略在有认知先验时表现最佳,能最快到达高分区域;Random 起步快但后劲不足;MAP-Elites 保持多样性但在强先验下反而更慢。

UCB1 + GPT-5-mini 的组合在 17 步就发现了 2.63597,而 MAP-Elites 需要 79 步。这说明在有好的先验知识注入时,exploration-exploitation 的权衡比纯粹的多样性保持更重要。

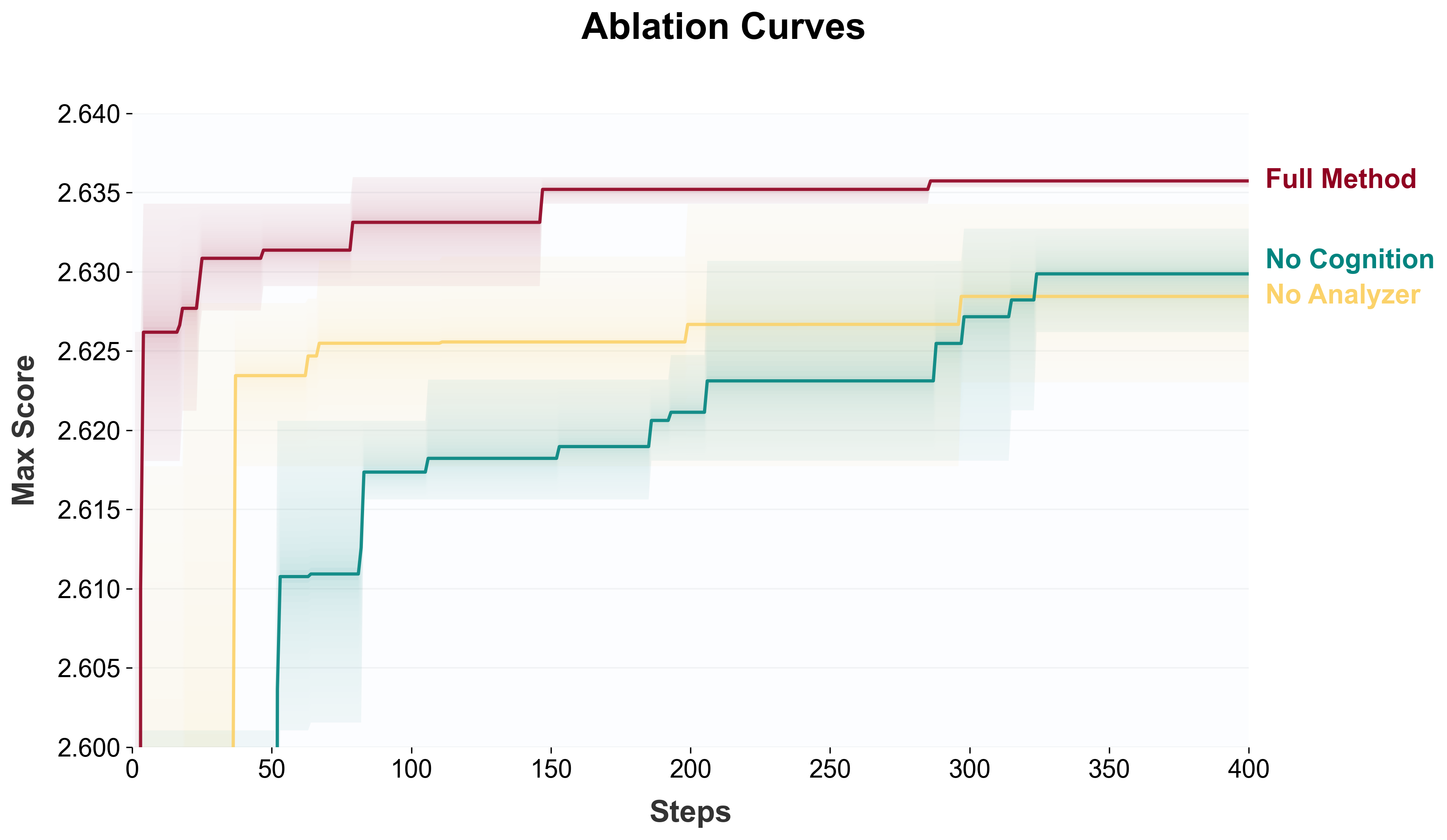

消融实验:Cognition 和 Analyzer 各管什么?

消融实验清晰地展示了两个核心模块的互补作用:Cognition 负责"快启动",Analyzer 负责"持续爬坡"。

这张图信息量很大:

去掉 Analyzer :系统靠 Cognition 能获得不错的初始分数,但之后进入长时间的平台期 ,改进幅度很小。这说明 Analyzer 的结构化反馈对于持续突破至关重要。

去掉 Cognition:起步更慢,早期改进不稳定,但系统通过自主试错最终还能爬上来。这说明系统的进化能力并不完全依赖人类先验------只是效率低很多。

两个组件的功能互补很清晰:Cognition 解决冷启动,Analyzer 解决持续进化。

🔬 跨领域迁移:药物-靶点相互作用预测

论文还做了一个有意思的验证------把架构搜索能力迁移到生物医学领域。从 DrugBAN(药物-靶点相互作用预测的 baseline)出发进化:

| 任务场景 | 指标 | DrugBAN | ASI-Evolve | 提升 |

|---|---|---|---|---|

| 域内(BindingDB) | AUROC | 94.15 | 96.06 | +1.91 |

| 域内(BindingDB) | F1 | 86.89 | 89.84 | +2.95 |

| 冷启动-未见药物 | AUROC | - | - | +6.94 |

| 冷启动-未见蛋白 | AUROC | - | - | +3.56 |

| 冷启动-两者都未见 | AUROC | - | - | +4.36 |

冷启动场景涨了 6.94 个点的 AUROC,这个提升幅度在生物医学领域是相当不错的。发现的最优架构引入了 Sinkhorn 注意力(基于最优传输的双随机约束)和 Top-k 稀疏门控------这些设计人类研究者不一定能想到,但从机制上看确实合理。

🤔 我的判断

亮点:

-

三条线同时验证,不是只在某个子任务上刷分。数据、架构、算法三个方向都跑通了,而且都有可观的提升。

-

Analyzer 模块的设计是真正有洞察的。之前的进化框架(包括 AlphaEvolve)主要靠标量分数做反馈,ASI-Evolve 把多维度实验信号压缩成决策导向的分析报告再反馈,这对于复杂的 AI 研发任务来说更合理。

-

底层模型可替换性好。Qwen3-32B 和 GPT-5-mini 最终效果接近,说明框架设计才是核心,不是靠堆最强模型。

-

消融做得扎实,两个核心组件的功能互补关系交代得很清楚。

让我皱眉的地方:

-

架构搜索的起点选择。用 DeltaNet 作为 baseline 然后搜索线性注意力空间------这个搜索空间的定义本身就包含了大量人类先验。系统并没有从零开始"发现"线性注意力这个方向,它是在人类已经框定好的空间里做局部优化。所谓"AI accelerates AI",准确说应该是"AI 在人类指定的方向上加速搜索"。

-

数据清洗实验的 baseline 问题 。跟原始未清洗数据 比涨 18 个点,但更有意义的对比应该是跟人类设计的清洗 pipeline 比。论文没给这个对比,这让数据的说服力打了折扣。

-

计算成本披露不足。1773 轮架构探索、300 轮 RL 算法进化------每轮需要多少 GPU 时间?总计花了多少 API 调用费?这些信息对于判断"AI 加速"是否真的比人类更高效至关重要,但论文里几乎没提。如果 1773 轮探索花了等价于一个团队半年的 GPU 预算,那"加速"的含金量就要重新评估了。

-

circle packing 任务的位置有点尴尬。这个任务更适合展示进化框架的基础能力,但跟"AI-for-AI"的核心叙事关系不大。用它跟 AlphaEvolve 比步数效率,我觉得有点取巧------因为 ASI-Evolve 有 Cognition 模块做知识注入,起点就比别人高,步数少不完全说明框架更好。

-

"closed-loop AI research"这个说法偏大。现在的系统还是在人类定义好的评测框架下做优化。真正的闭环 AI 研究需要 AI 能自己发现问题、定义研究方向、设计评测标准------这些 ASI-Evolve 都还做不到。

💡 工程启发

如果你也在做类似的 AI 自动化研发系统,这篇论文有几个设计决策值得参考:

-

知识注入和进化能力要分开设计。Cognition 管冷启动效率,Analyzer 管持续改进能力。消融实验证明两者缺一不可。

-

反馈信号要做"蒸馏",不要直接甩数字。多维度的实验结果需要经过分析提炼才能有效指导下一轮假设生成。这个思路在任何涉及复杂评估的自动化系统中都适用。

-

采样策略的选择取决于先验质量。先验强就用 UCB1(快速利用),先验弱就用 Random 或 MAP-Elites(广泛探索)。

-

多阶段评估是省计算的关键。20M -> 340M -> 1.3B 的三阶段筛选,大部分方案在小规模就被淘汰了,避免在大规模上浪费资源。

📝 总结

ASI-Evolve 给出了一个比较完整的 AI-for-AI 研究框架的设计范式,在架构、数据、算法三个方向都展示了可观的自动化发现能力。Cognition + Analyzer 的双模块设计是核心创新,消融实验验证了其有效性。

但"AI 加速 AI"这个叙事目前还是偏理想化的。系统依然需要大量人类先验来定义搜索空间和评测标准,计算成本也缺乏透明度。它更像是一个高效的自动化研发助手,而不是一个能独立做研究的 AI 科学家。

不过话说回来,从 FunSearch 到 AlphaEvolve 再到 ASI-Evolve,这条线的进展速度是肉眼可见的。如果你在做模型架构搜索、数据 pipeline 优化或者 RL 算法设计,这个框架的思路------特别是 Analyzer 的设计------值得认真看看。

觉得有启发的话,欢迎点赞、在看、转发。跟进最新AI前沿,关注我