作者:Wenxuan Fang , Junkai Fan , Yu Zheng , Jiangwei Weng1**, Ying Tai** , Jun Li

机构:School of Computer Science and Engineering, Nanjing University of Science and Technology, Nanjing, China,School of Intelligence Science and Technology, Nanjing University, Suzhou, China.

来源会议:The Thirty-Ninth AAAI Conference on Artificial Intelligence (AAAI-25)

会议时间与地点:2025 年 2 月 25 日至 3 月 4 日,Philadelphia, Pennsylvania, USA

1. 研究目标,过去以及本文使用的方法,优势及其创新点

1.1 研究目标

论文研究的是 真实场景图像去雾和去烟(real image dehazing)。目标是:给定一张受雾霾、烟尘影响而模糊、低对比度、颜色失真的图像,恢复出清晰、自然、细节丰富的无雾图像。

论文认为,真实去雾相比合成去雾更难,主要有两个痛点:

第一,仅在 RGB 空间中学习去雾映射不够稳定。雾会显著破坏 RGB 特征中的纹理,使网络很难从模糊的 RGB 表达中恢复细节。图1直观展示了:同样的雾图,YCbCr 空间中的特征纹理往往比 RGB 更清晰。

第二,真实世界缺少高质量、对齐良好的 hazy和clean 配对数据。已有数据集中,很多雾图与清晰图由于拍摄时间间隔长、拍摄视角变化、背景不一致等问题,不能很好用于监督学习。论文第 2 页图 2 就对比了 MRFID、BeDDE 与作者新数据集 RW²AH 的对齐效果。

1.2 过去的方法

论文把传统去雾方法大体分为两类。

(1)基于先验/物理模型的方法

经典做法基于 大气散射模型(ASM):

I(x)=J(x)t(x)+A(x)(1−t(x))

I(x):观测到的雾图

J(x):真实清晰图

A(x):大气光

t(x):透射率

这类方法的代表包括暗通道先验、颜色衰减先验等。它们通过估计透射图和大气光来反推清晰图。优点是有物理意义,缺点是依赖先验假设和参数估计精度,一旦真实场景复杂、雾分布不均匀、光照变化明显,效果容易下降。

(2)基于深度学习的映射方法

这类方法直接学习从 hazy 到 clean 的端到端映射。相比传统方法,它们在合成数据集上通常有更强表现。但在真实场景中,又面临两个限制:

多数方法主要在 RGB 空间建模,面对真实雾图时容易保留残余雾;

很多方法训练于 合成数据,与真实数据存在明显域差异。

论文还提到,一些真实去雾方法采用 GAN、非配对学习或手工先验引导,但这些方法要么容易生成伪影,要么仍受限于手工先验。

1.3 本文的方法

为解决上述问题,论文提出 SGDN,核心是:

1.同时使用 RGB 和 YCbCr 两种颜色空间;

2.用 YCbCr 中更清晰的结构或纹理信息去引导 RGB 特征恢复;

3.再用 YCbCr 的颜色信息来增强 RGB 的色彩表达;

4.并构建新的 RW²AH 真实配对去雾数据集支持监督训练。

SGDN 的两个关键模块是:

- BGB(Bi-Color Guidance Bridge)

作用:让 YCbCr 在频域和空间域同时引导 RGB 特征恢复。 - CEM(Color Enhancement Module)

作用:利用 YCbCr 的色差信息增强 RGB 的颜色感知能力,避免只恢复结构却丢失自然色彩。

1.4 优势与创新点

这篇论文的创新点很明确,可以概括为四点。

创新点 1:从单一 的RGB 去雾转变为RGB和YCbCr 协同去雾

过去多数深度去雾方法都默认RGB是唯一主工作空间,而本文指出:在真实雾天条件下,YCbCr 特征比 RGB 更不容易被雾破坏,能保留更清晰的纹理。这不是简单换颜色空间,而是让 YCbCr 成为 RGB 恢复的"引导源"。

创新点 2:提出 BGB,在频域和空间域双重引导

BGB不只是简单拼接两个颜色空间特征,而是包含两个设计:

PIM(Phase Integration Module):频域引导

IAM(Interactive Attention Module):空间域交互注意力

这说明作者不是粗糙地融合双分支,而是把"结构信息"和"注意力区域"都分开建模。

创新点 3:提出 CEM 强化颜色恢复

很多去雾模型容易出现两种问题:

去雾不彻底

去完雾后颜色不自然

CEM 就是专门解决第二个问题。它利用 YCbCr 的色彩通道信息增强 RGB 颜色感知,改善视觉自然度。

创新点 4:构建 RW²AH 数据集

作者提出了**RW²AH(Real-World Well-Aligned Haze),**包含 1758 对真实配对图像,训练集 1406 对,测试集 352 对。相比之前的 BeDDE 和 MRFID,RW²AH 具有:

数据量更大

场景更丰富

对齐更好

更适合监督学习

这是本文的重要工程贡献,也是实验效果强的重要基础。

2. 文中算法主要思想(重点解释原理和专业名词)

2.1 论文总体思路

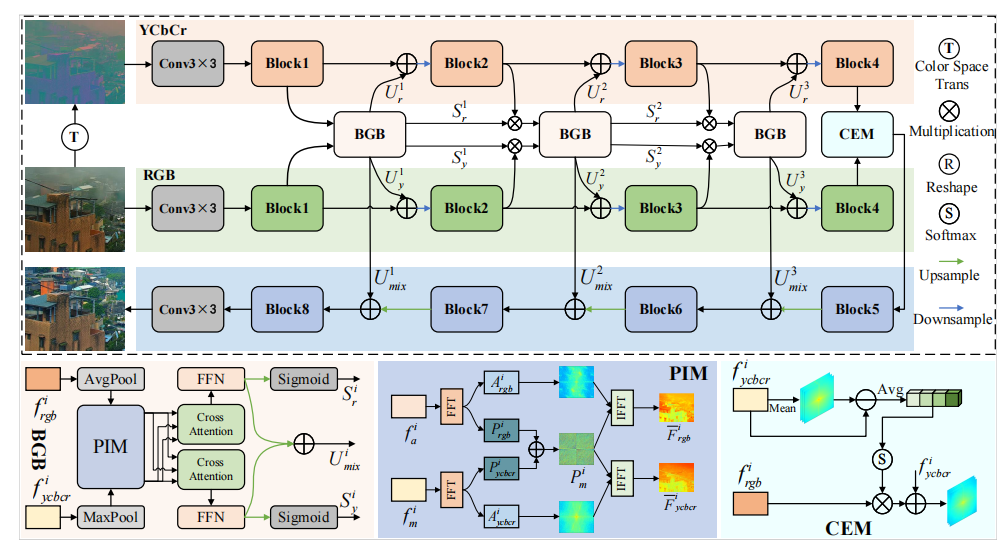

SGDN的整体架构(含提出的双色引导桥BGB和色彩增强模型CEM)

SGDN的整体架构(含提出的双色引导桥BGB和色彩增强模型CEM)

整体是一个非对称的编码器-解码器结构 ,并且RGB分支和 YCbCr 分支 共享编码器。大致流程为:

- 输入 hazy RGB 图像

- 把图像从 RGB 转换到 YCbCr

- 两个颜色空间分别提取特征

- 通过 BGB 用 YCbCr 引导 RGB 恢复更清晰的纹理

- 通过 CEM 用 YCbCr 增强 RGB 的色彩表达

- 解码输出最终去雾结果。

2.2 疑问,RGB 和 YCbCr的区别?

RGB 是什么

RGB 是最常见的颜色表示方式:R:红 G:绿 B:蓝

图像中的每个像素都由这三个通道共同表示。

优点是直观、通用。

缺点是:亮度、颜色、纹理信息混在一起。在雾天中,雾会同时污染三个通道,导致纹理和边缘都变模糊。

YCbCr 是什么

YCbCr 是一种把 亮度 和 色度 分离的颜色空间 Y:亮度 Cb:蓝色色差分量 Cr:红色色差分量

直观上可以理解为:Y 决定明暗 Cb/Cr 决定颜色的偏向

因为雾对场景的影响很多时候首先表现为亮度对比下降、颜色趋向中性,所以在 YCbCr 中,某些色度信息和局部结构反而更容易保留。论文因此发现:YCbCr 中的纹理在雾天里更清晰、更适合作为 RGB 去雾的引导信息。

疑问,文章为什么不直接在 YCbCr 中输出结果?

论文也指出,如果完全在YCbCr 中处理再转换回RGB,可能会带来颜色失真,因为颜色空间转换会引入误差,尤其在复杂网络中误差会放大。所以本文的策略不是用YCbCr替代RGB,而是:让 YCbCr 引导 RGB 恢复,但最终还是在 RGB 表达上输出更自然的结果。

2.3 BGB双颜色引导桥

BGB 是 SGDN 的核心模块,它的作用可以概括为:把 YCbCr 分支中更清晰的结构和颜色信息,逐步注入到 RGB 分支中,使 RGB 特征恢复出更清楚的纹理。

BGB 包含两个子模块:PIM(Phase Integration Module)

IAM(Interactive Attention Module)

2.4 PIM相位集成模块

(1)频域是什么

一张图像通常在空间域中表示,也就是我们直接看到的像素。但通过傅里叶变换(FFT),图像还能表示为频域信号。频域里常见两个概念:

幅度谱(Amplitude Spectrum)

相位谱(Phase Spectrum)

(2)相位谱和幅度谱有什么区别

简单理解:

幅度谱像是在描述某种频率成分有多强

相位谱像是在描述这些结构是怎么排列的

图像的 边缘、形状、结构轮廓 很大程度上由相位谱决定。

论文指出:清晰图和雾图在相位谱上的差异相对较小,但相位谱更能传递结构信息,也更抗对比度失真和噪声。 因此,相位比幅度更适合用来恢复纹理。

论文流程是:

- 对RGB特征做平均池化,得到更平滑的结构表示

- 对YCbCr 特征做最大池化,保留更强的细节和颜色响应

- 对二者做 FFT,分离出幅度谱和相位

- 用卷积处理相位谱,把 RGB 和 YCbCr 的相位信息融合,得到一个混合相位谱

- 再结合恢复后的幅度谱,用 IFFT 变回空间域特征

(4)为什么这样做有效

因为RGB的结构表达比较粗,但容易受雾污染;YCbCr 的结构细节更清晰。将两者相位融合后,相当于:保留 RGB 的整体图像组织,补充 YCbCr 的清晰纹理结构,因此 PIM 本质上是在频域层面做结构修复。

2.5 IAM交互注意力模块

如果说 PIM 主要处理频域结构,那么 IAM 主要处理空间域的重要区域。

什么是注意力机制

注意力机制可以理解为:让网络自动判断哪里更重要,然后对重要区域分配更高权重。

IAM 的工作方式

论文中,IAM 使用Cross-Attention 和 FFN(前馈网络)

做法是:

RGB 特征作为 query,从 YCbCr 特征里取 key或value

YCbCr 特征也反向从 RGB 中取信息

两个分支相互查询、相互增强

再把增强后的注意力特征上采样、经过 sigmoid 门控,去调制下一阶段的特征。

这一步的意义

它不是简单地把两个特征加起来,而是让网络学会:

哪些位置是 RGB 不可靠,需要 YCbCr 帮助的

哪些区域是细节边缘、纹理丰富区域,应该重点增强

因此 IAM 可以理解为在空间域中进行跨颜色空间的重点信息传递。

2.6 CEM颜色增强模块

PIM 和 IAM 更偏向结构恢复,但结构清晰不代表颜色自然。所以论文又设计了 CEM。

CEM 的核心想法

在 YCbCr 中:

Y 更多表示亮度

Cb Cr 反映颜色偏移

而雾会让颜色趋于灰白、中性。所以作者希望利用 YCbCr 的色度信息,来增强 RGB 的颜色感知。

具体机制

论文做了三步:

- 对 YCbCr 特征做通道均值处理,去掉全局光照/雾的影响,突出局部颜色变化;

- 用全局平均池化和 softmax 得到颜色分布权重;

- 用这个权重调制 RGB 特征,再加上 YCbCr 特征得到输出。

作用

CEM 的作用是:

增强颜色对比

保持色调自然

让去雾后的图像不只是清晰,而且"看起来真实"

2.7 训练损失

论文使用的是 多尺度损失(multi-scale loss),在三个尺度上监督输出:

1

0.5

0.25

每个尺度的损失由三部分组成:

L1 损失:约束像素级接近

SSIM 损失 :约束结构相似性

FFT 损失 :约束频域一致性

权重分别为:

L1:1.0

SSIM:0.5

FFT:0.1

这既关注像素恢复,也关注结构恢复,还关注频域特征一致性。

3. 实验结果

3.1 数据集

论文实验用了三个真实世界数据集。

(1)RW²AH(作者提出)

这是本文最重要的数据集。

总数:1758 对

训练集:1406 对

测试集:352 对

来源:来自全球在线固定摄像头

场景:山地、植被、建筑、道路等

地域:覆盖亚洲、欧洲、美洲 12 个国家

雾浓度分布:轻雾 40% 中雾 38% 重雾 22%

(2)RWS(Real-World Smoke)

由 I-HAZE、O-Haze、NH-Haze 组成:

总计 155 对

按论文设置:147 对训练 8 对测试

(3)RTTS

来自 RESIDE

4322 张

无 GT

只用于测试无参考指标。

3.2 评价指标

论文使用了四个指标:

(1)PSNR

峰值信噪比。衡量恢复图像和 GT 的像素接近程度。

越高越好。

(2)SSIM

结构相似性。衡量图像在亮度、对比度、结构上的相似性。

越高越好。

(3)FADE

无参考雾密度评价指标,用来衡量图像中雾的残留程度。

越低越好。

(4)NIQE

无参考自然图像质量评价指标。

越低越好。

数值越低说明图像越自然。

这些指标组合起来的好处是:

既有参考指标(PSNR/SSIM),也有无参考指标(FADE/NIQE),评价更全面。

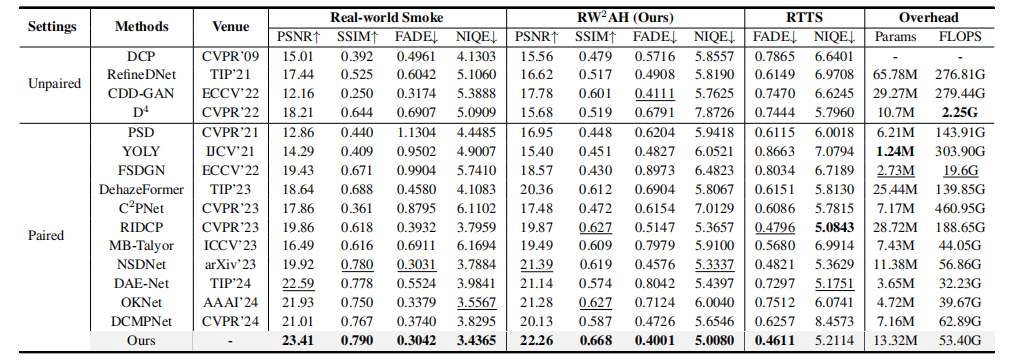

3.3 定量实验

真实世界雾霾数据集的定量研究

真实世界雾霾数据集的定量研究

论文给出了与多种 SOTA 方法的对比结果

(1)在 RWS 上的结果

SGDN 的结果为:

PSNR = 23.41

SSIM = 0.790

FADE = 0.3042

NIQE = 3.4365

这说明在真实烟雾场景中,SGDN 无论是去雾彻底程度还是图像自然度都更优。

(2)在 RW²AH 上的结果

SGDN 的结果为:

PSNR = 22.26

SSIM = 0.668

FADE = 0.4001

NIQE = 5.0080

从表 1 看,SGDN 在 RW²AH 上四项指标整体都很强,尤其在 PSNR、SSIM 和 FADE 上表现突出。

(3)在 RTTS 上的结果

SGDN 在 RTTS 上的结果为:

FADE = 0.4611

NIQE = 5.2114

由于RTTS无GT,所以只比较无参考指标。论文指出,SGDN 取得了最优的 FADE,说明去雾能力很强,NIQE 也具有竞争力。

3.4 定性实验

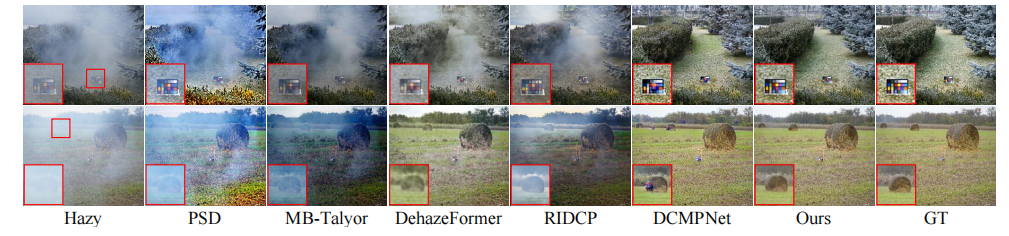

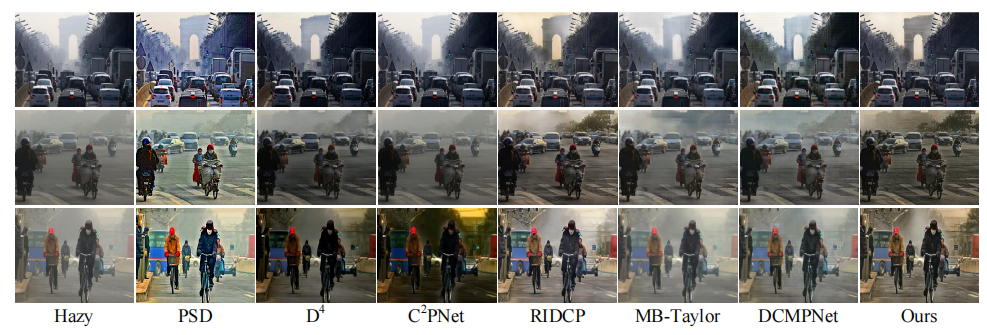

(1)RWS 视觉结果

真实世界烟雾数据集上的视觉对比结果

真实世界烟雾数据集上的视觉对比结果

第 6 页图 5 显示,在真实烟雾图像上:

PSD、MB-Taylor、DehazeFormer、RIDCP等方法在浓烟区域容易残留雾气

DCMPNet 在浓烟下更好,但有轻微色偏

SGDN去雾更充分,结果更接近GT

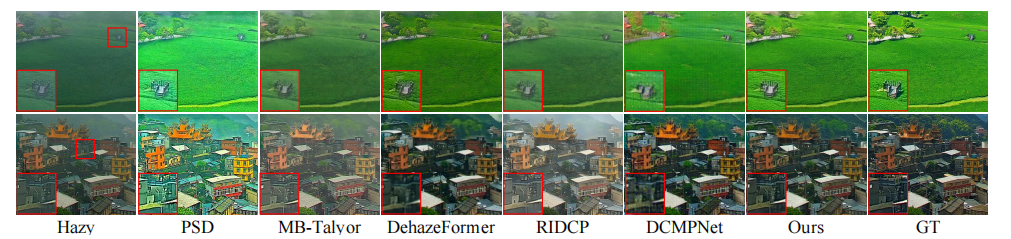

(2)RW²AH 视觉结果

基于我们RW2AH数据集的视觉比较结果

基于我们RW2AH数据集的视觉比较结果

PSD 提高了对比度,但没有彻底除雾

MB-Taylor、RIDCP仍有明显残雾

DehazeFormer、DCMPNet虽去雾较强,但细节和纹理保持不足

SGDN 在去雾程度和自然对比之间平衡最好

(3)RTTS 视觉结果

RTTS 数据集上的视觉比较结果

RTTS 数据集上的视觉比较结果

在真实街景浓雾条件下:

多数方法在重雾中仍表现吃力

SGDN 的整体可见度恢复最好,局部清晰度也更高。

3.5 消融实验

论文还做了两类重要消融。

(1)不同颜色空间的作用

Only RGB

Only YCbCr

RGB + HSV

RGB + YUV

Ours(RGB + YCbCr)

结果显示,本文方法在真实烟雾和 RW²AH 上都最好。

例如 RW²AH 上:

Only RGB:PSNR 18.44 / SSIM 0.417

Only YCbCr:19.02 / 0.472

RGB+HSV:21.17 / 0.593

RGB+YUV:21.49 / 0.608

Ours:22.26 / 0.668

说明 RGB+YCbCr 的组合最有效。

(2)BGB 和 CEM 的作用

Baseline:RW²AH 上 PSNR 19.10

+BGB:21.83

+CEM:21.36

+BGB+CEM:22.26

也就是说:

BGB 对性能提升更大,因为它直接改善结构和纹理恢复

CEM 对视觉质量和颜色自然度帮助明显

二者结合时性能最好

4. 结论

1.YCbCr 在真实雾图中保留了比 RGB 更稳定的纹理和颜色信息,因此可以作为 RGB 去雾的重要引导源。

2.提出的SGDN 通过BGB和CEM两个核心模块,实现了:

频域结构引导

间域交互注意力

感知增强

从而在真实去雾任务中兼顾了去雾强度、纹理恢复和颜色自然度

3.作者构建的RW²AH数据集弥补了真实监督去雾中"缺少高质量对齐配对数据"的不足,为后续研究提供了更可靠的基准

4.从实验上看,SGDN 在 RWS、RW²AH 和 RTTS 三个真实数据集上都取得了非常强的表现,证明该方法不仅有理论动机,也有很强的实际有效性