在视频生成领域,传统透视视频模型受限于视角和场景覆盖范围,难以实现高质量的长距离场景漫游。为了解决这一问题,加州大学尔湾分校、加州大学圣地亚哥分校及Adobe Research等机构的研究人员共同提出了OmniRoam,这是一种可控全景视频生成框架,通过利用全景表示的丰富单帧场景覆盖率和长期时空一致性,实现了高质量的长距离场景漫游。OmniRoam不仅在视觉质量、轨迹可控性和长期全局一致性方面表现出色,还拓展了实时生成和3D重建的应用边界。

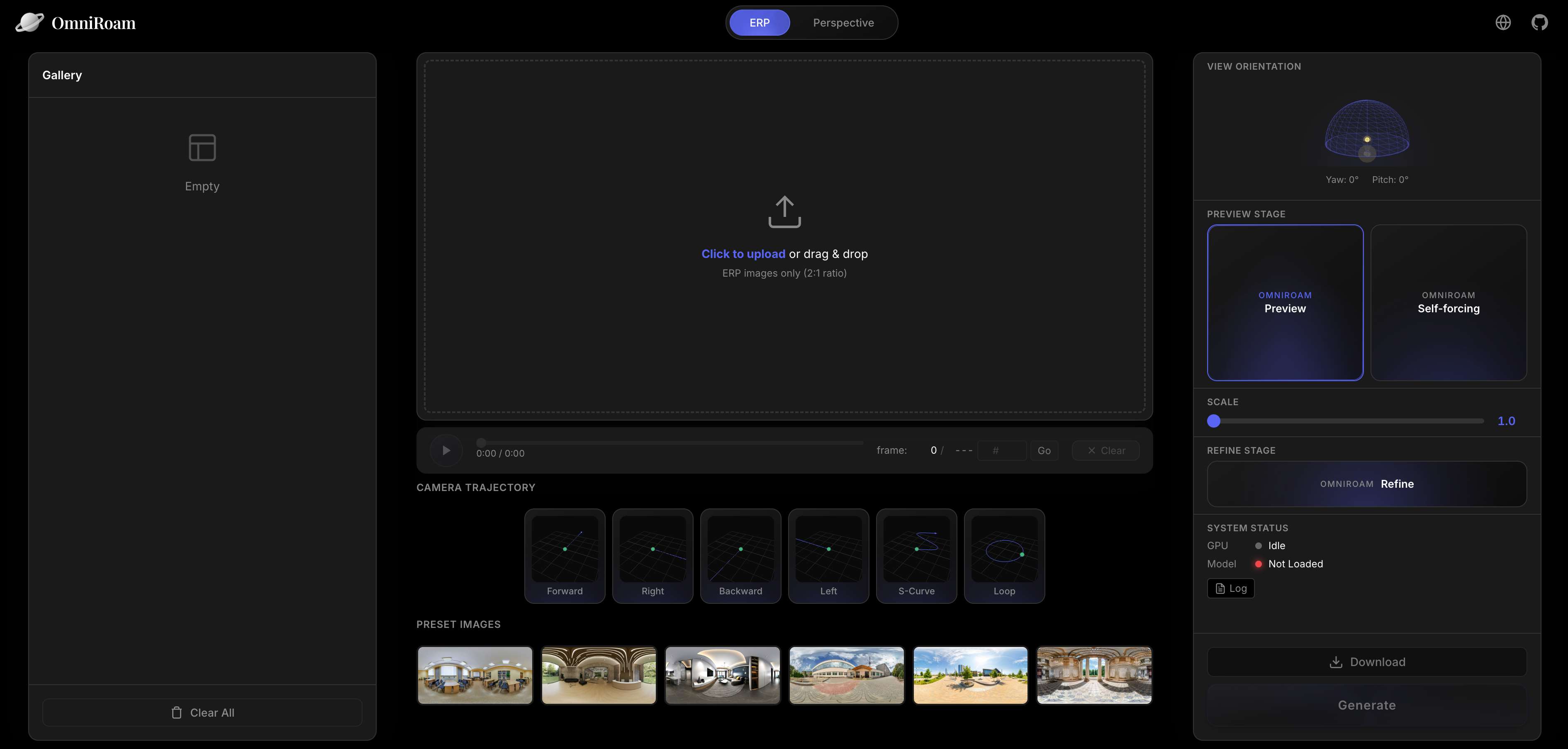

这是一个基于网络的交互式系统,用于使用 OmniRoam 模型生成全景视频。该系统为视频生成的预览、自动生成和优化阶段提供了用户友好的界面。

相关链接

论文介绍

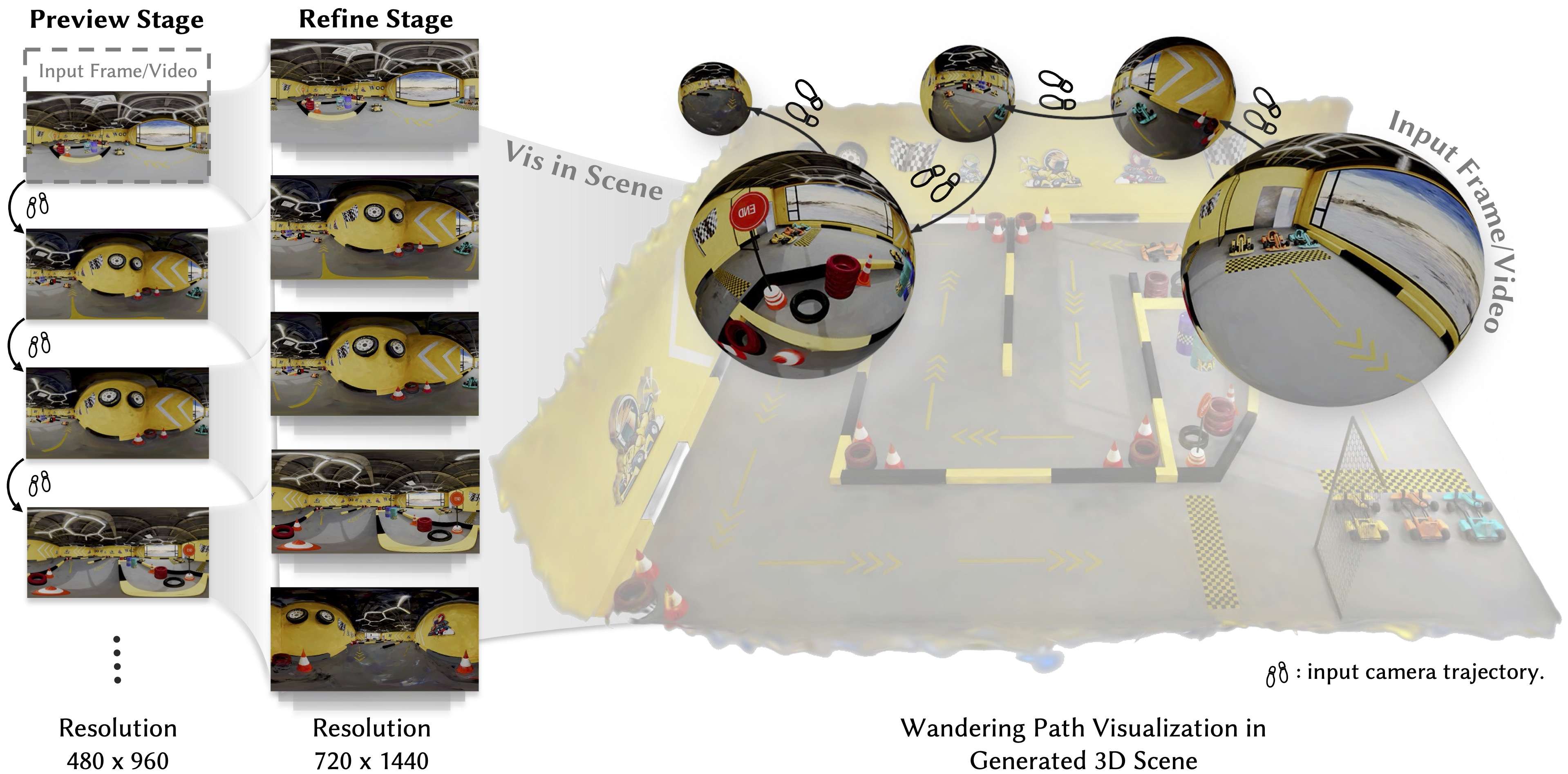

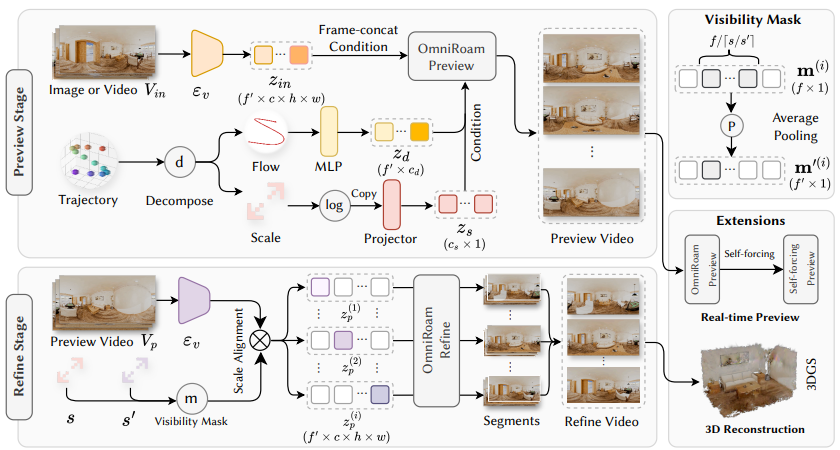

OmniRoam旨在解决透视视频模型在场景建模中的局限性,通过提出一种可控全景视频生成框架,实现了高质量的长距离场景漫游。该框架利用全景表示的丰富单帧场景覆盖率和长期时空一致性,通过预览和精修两个阶段,逐步生成高分辨率、长时间的全景视频。此外,OmniRoam还引入了闭环一致性评估指标,科学量化场景级视频生成中的长期全局一致性。

方法概述

OmniRoam 的技术架构巧妙结合了几何约束与扩散模型,主要包含三大核心模块:

-

球面潜在扩散模型 (Spherical Latent Diffusion Model, SLDM)

-

核心重构:摒弃传统的平面VAE,设计了专为360°全景图优化的球面变分自编码器。

-

优势:直接在球面潜空间中进行去噪生成,天然消除了经纬度映射带来的极点畸变和接缝问题,确保全景图的几何完整性。

-

-

长时一致性记忆机制 (Long-Horizon Consistency Memory) 突破难点:如何解决长距离漫游后的"遗忘"问题(即回到原点时场景是否一致)?

- 解决方案:引入全局场景记忆库,记录已生成区域的语义和几何特征。当相机漫游回已访问区域时,模型通过**循环一致性损失(Loop Consistency Loss)**强制当前生成结果与记忆库对齐。实验显示,其循环一致性得分是自回归基线方法的近两倍。

-

可控相机轨迹引导 (Controllable Camera Trajectory Guidance)

-

灵活交互:支持用户通过指定**相机路径(如前后移动、左右旋转、上下俯仰)**来控制视频内容。

-

技术细节:将相机位姿参数作为条件注入到扩散模型的注意力层中,使模型能够根据预设轨迹精准渲染对应视角的画面,实现"指哪打哪"的漫游体验。

-

实验

-

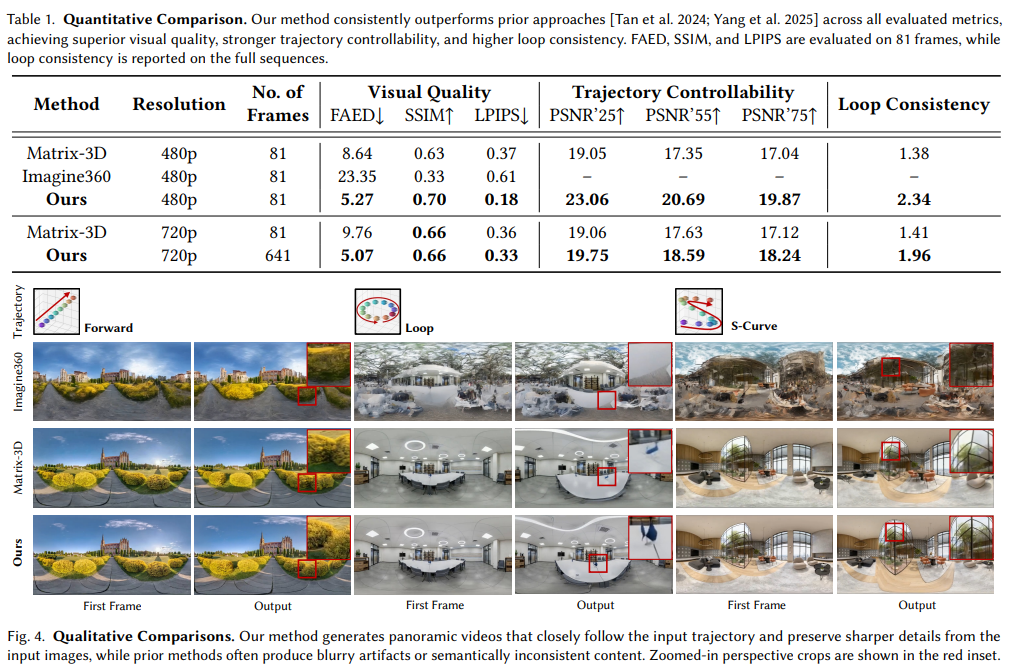

定量比较。该方法在所有评估指标上均优于先前的方法,实现了更优的视觉质量、更强的轨迹可控性和更高的循环一致性。FAED、SSIM 和 LPIPS 均基于 81 帧进行评估,而循环一致性则基于完整序列进行评估。

-

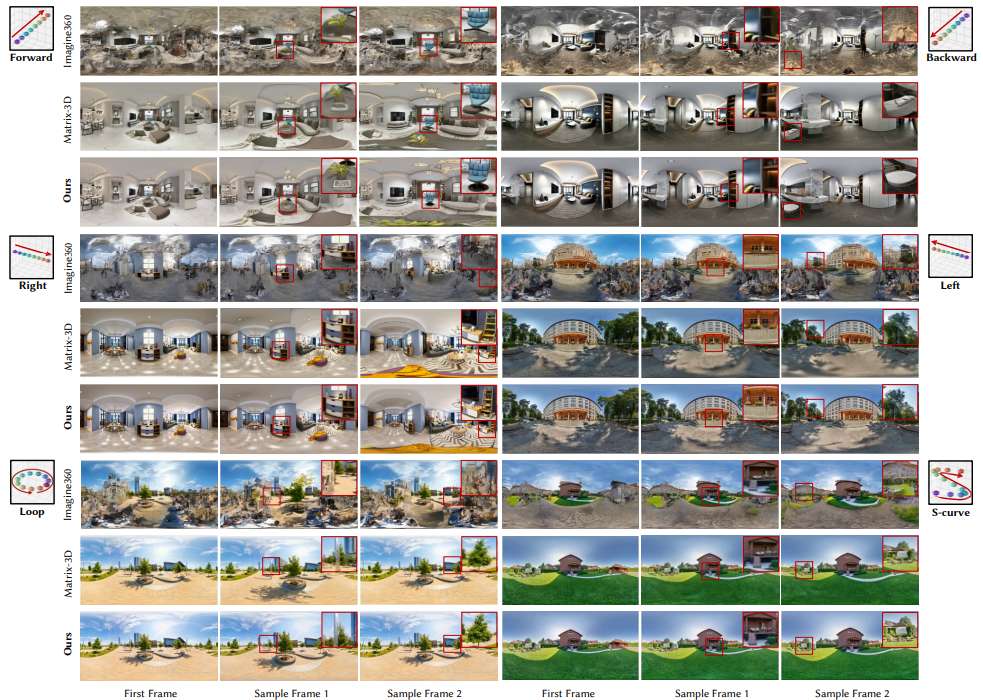

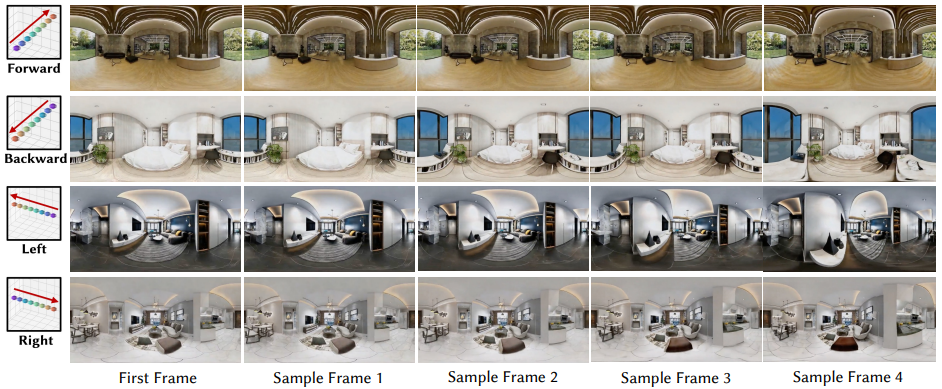

定性比较。该方法生成的全景视频能够紧密跟随输入轨迹,并保留输入图像中更清晰的细节,而以往的方法通常会产生模糊的伪影或语义不一致的内容。

结论

OmniRoam作为一种可控全景视频生成框架,通过全局到局部的生成策略、相机轨迹控制的解耦设计、混合数据集构建以及闭环一致性评估指标,实现了高质量的长距离场景漫游。其在视觉质量、轨迹可控性和长期全局一致性方面均表现出色,并拓展了实时生成和3D重建的应用边界。随着代码的正式开源,OmniRoam有望推动视频生成领域的发展,为沉浸式3D漫游、虚拟现实、增强现实等领域带来更加便捷和高效的视频生成工具。