文章目录

- 一、Ollama简介

-

- [1. 定义](#1. 定义)

- [2. 作用与功能](#2. 作用与功能)

- [3. 应用场景](#3. 应用场景)

- 二、Ollama下载与安装

-

- [1. 下载Ollama](#1. 下载Ollama)

- [2. 安装Ollama](#2. 安装Ollama)

- [3. 启动Ollama](#3. 启动Ollama)

- 三、下载模型

一、Ollama简介

1. 定义

Ollama 是一款开源轻量级本地大语言模型运行框架,基于Go语言开发,由Ollama公司推出,主打极简式本地部署大模型能力。它可以理解为本地AI大模型的统一运行引擎与模型管理工具,借鉴了容器化工具的操作逻辑,通过简洁的命令行指令,即可完成各类开源大模型的拉取、启动、运行与管理,无需手动配置复杂环境依赖、显卡驱动与模型编译,大幅降低普通开发者与研究者使用本地大模型的技术门槛。同时Ollama原生提供兼容OpenAI格式的API接口,能够无缝对接各类AI应用、AI Agent工作流与二次开发项目,是目前本地私有化部署大模型、搭建自主AI智能体的主流工具。

2. 作用与功能

- 一键拉取与运行开源大模型

内置海量主流开源模型仓库,涵盖Llama系列、通义千问、Mistral、Gemma、Phi等各类大模型,仅需单行命令即可自动下载模型权重并启动服务,无需手动处理模型文件、环境依赖。 - 本地私有化运行,数据安全可控

所有模型推理计算全程在本地电脑/服务器完成,数据不会上传至云端服务器,完美解决API调用的数据隐私泄露、内容审核、外网访问限制等问题,支持纯内网离线使用。 - 便捷化模型全生命周期管理

支持模型查看、删除、版本切换、自定义模型封装、模型微调定制,可自由管理本地所有大模型资源,灵活切换不同参数量、不同能力侧重的模型。 - 标准API服务对外调用

内置RESTful接口,接口格式完全兼容OpenAI官方调用规范,现有基于OpenAI开发的项目、AI Agent框架、前端对话页面可几乎零改造接入本地模型。 - 跨平台兼容适配

原生支持Windows、macOS、Linux多操作系统,同时适配普通CPU、NVIDIA显卡硬件,自动调用硬件算力进行推理加速,低配设备也可流畅运行小参数量模型。 - 支撑AI Agent开发与工作流搭建

作为本地模型底层运行底座,为LangChain、AutoGPT等AI Agent框架提供稳定模型服务,是构建私有化自主智能体、本地自动化智能工作流的核心底层组件。

3. 应用场景

- 个人本地AI助手搭建

普通用户无需调用云端付费API,在个人电脑搭建专属本地聊天助手,实现日常问答、文案创作、代码编写、知识解答、文档总结等日常AI使用需求,全程离线可用。 - 开发者模型学习与快速测试

AI开发人员快速验证不同开源模型的效果、推理速度、生成能力,低成本进行模型对比实验,无需搭建繁琐的大模型原生运行环境,适配大模型入门学习与技术研究。 - AI Agent智能体开发实践

作为本地底层模型引擎,对接各类Agent框架,构建私有化智能体,实现自动化任务处理、工具调用、多轮规划、本地知识库问答(RAG)等能力,契合本系列AI Agent专题的开发需求。 - 企业内网私有化部署场景

政企单位出于数据安全要求,无法使用公有云大模型接口,基于Ollama在内网服务器部署私有大模型,搭建内部智能问答、办公辅助、知识库系统,保障业务数据完全内网闭环。 - 二次开发与项目集成

开发者基于其兼容API,将本地大模型嵌入桌面应用、后端服务、自研网站、自动化脚本,低成本完成大模型能力赋能,无需采购云端模型接口服务。 - 自定义模型封装与轻量化微调

开发者基于基础开源模型,自定义系统提示词、模型参数、专属能力封装私有模型,结合本地数据进行轻量化微调,打造专属领域专用大模型。

二、Ollama下载与安装

1. 下载Ollama

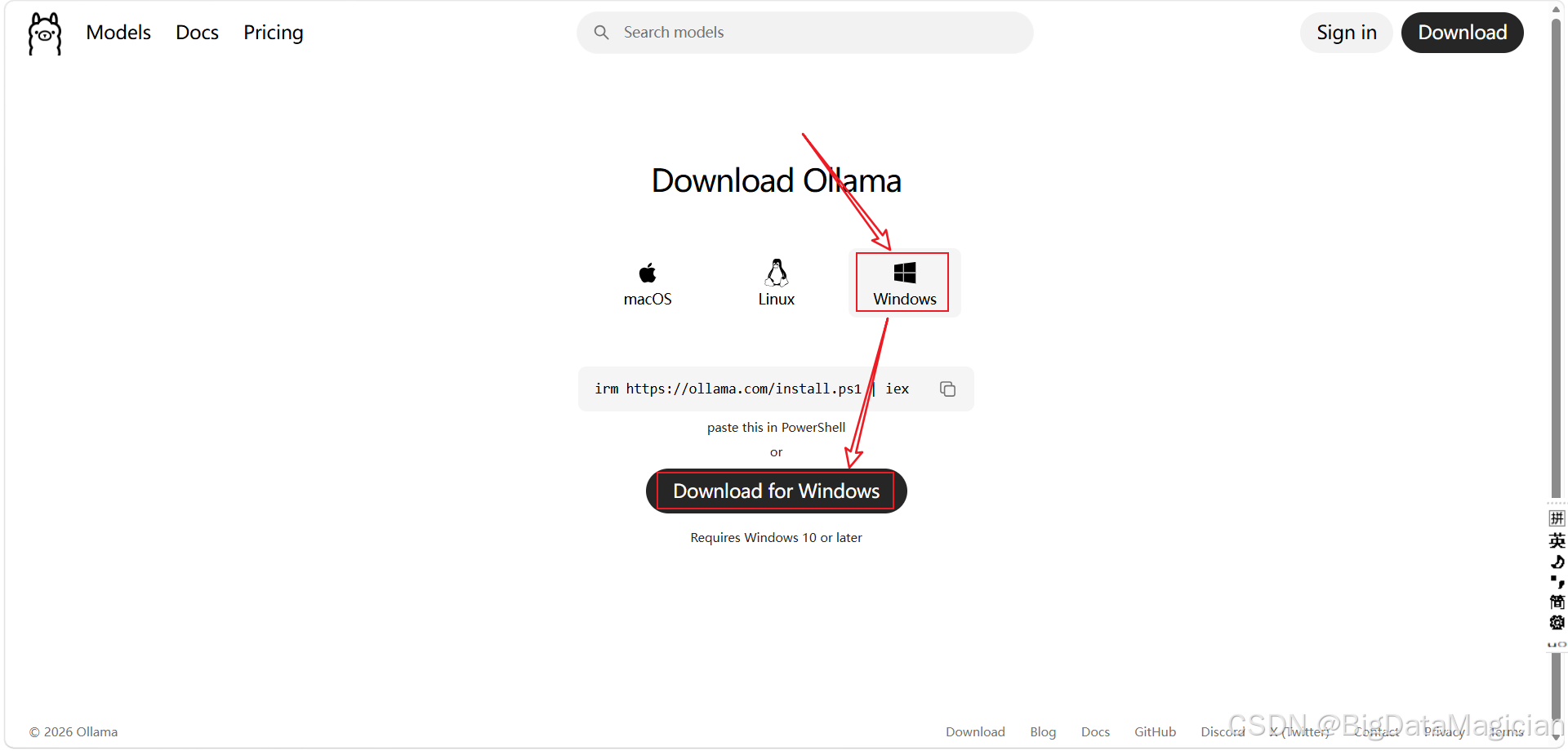

首先进入Ollama官方下载页面,官方下载地址:https://ollama.com/download

Ollama官方原生支持 macOS、Linux、Windows 三大操作系统,本教程以Windows系统环境为主进行安装演示。

在官方下载页面中,首先点击页面中的 Windows 图标,切换到Windows系统专属下载区域,随后点击下方的 Download for Windows 按钮,即可开始下载Windows平台的Ollama一键安装包。

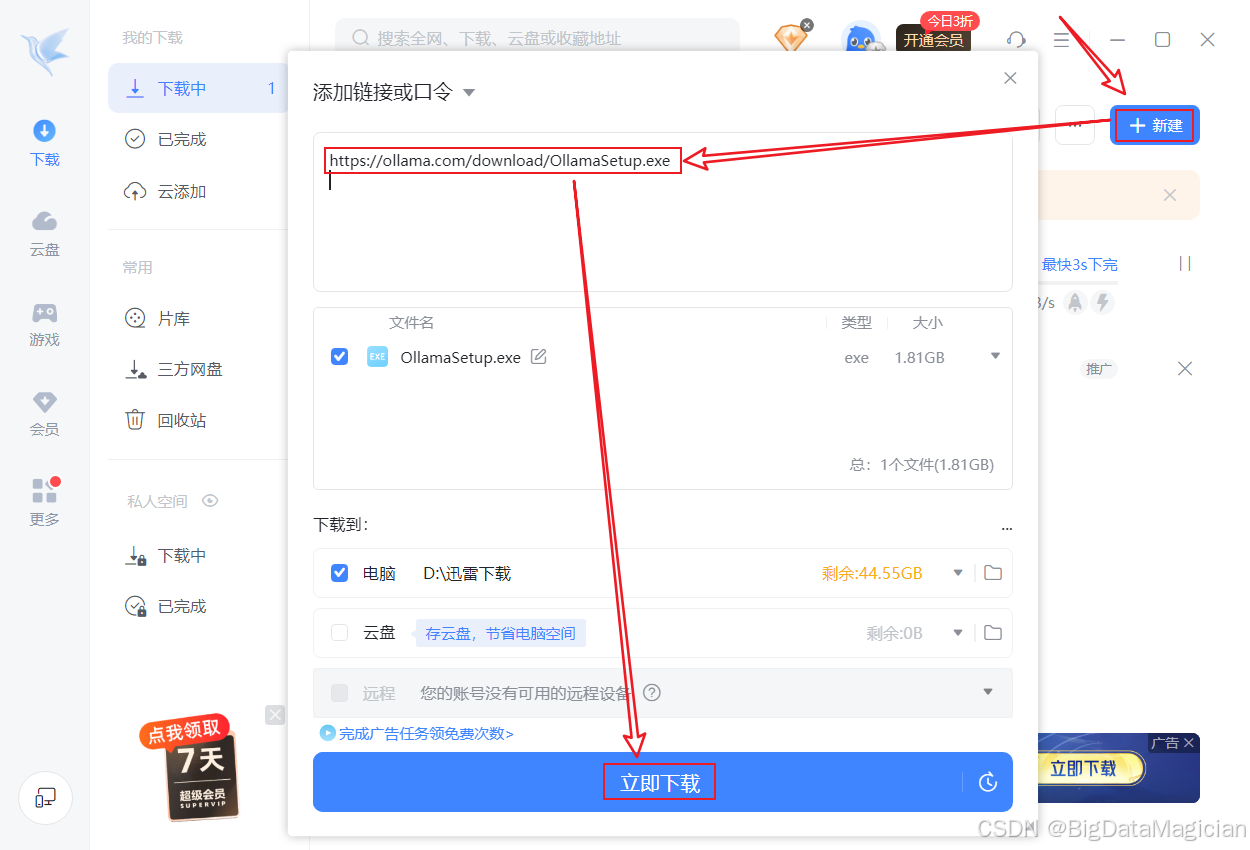

由于Ollama官方服务器位于境外,国内直连下载经常会出现速度极慢、下载中断、链接超时的问题。针对该情况,提供迅雷高速备用下载方案,操作步骤如下:

-

复制Windows版本专属直链地址:

https://ollama.com/download/OllamaSetup.exe -

打开迅雷软件,点击界面右上角 +新建 按钮,唤起新建下载任务窗口;

-

将上面复制好的安装包下载链接,粘贴到链接输入框中;

-

软件会自动识别安装包文件

OllamaSetup.exe(安装包大小1.81GB),选择本地文件保存路径后,点击底部 立即下载,即可借助迅雷多线程加速能力,高速完成安装包下载。

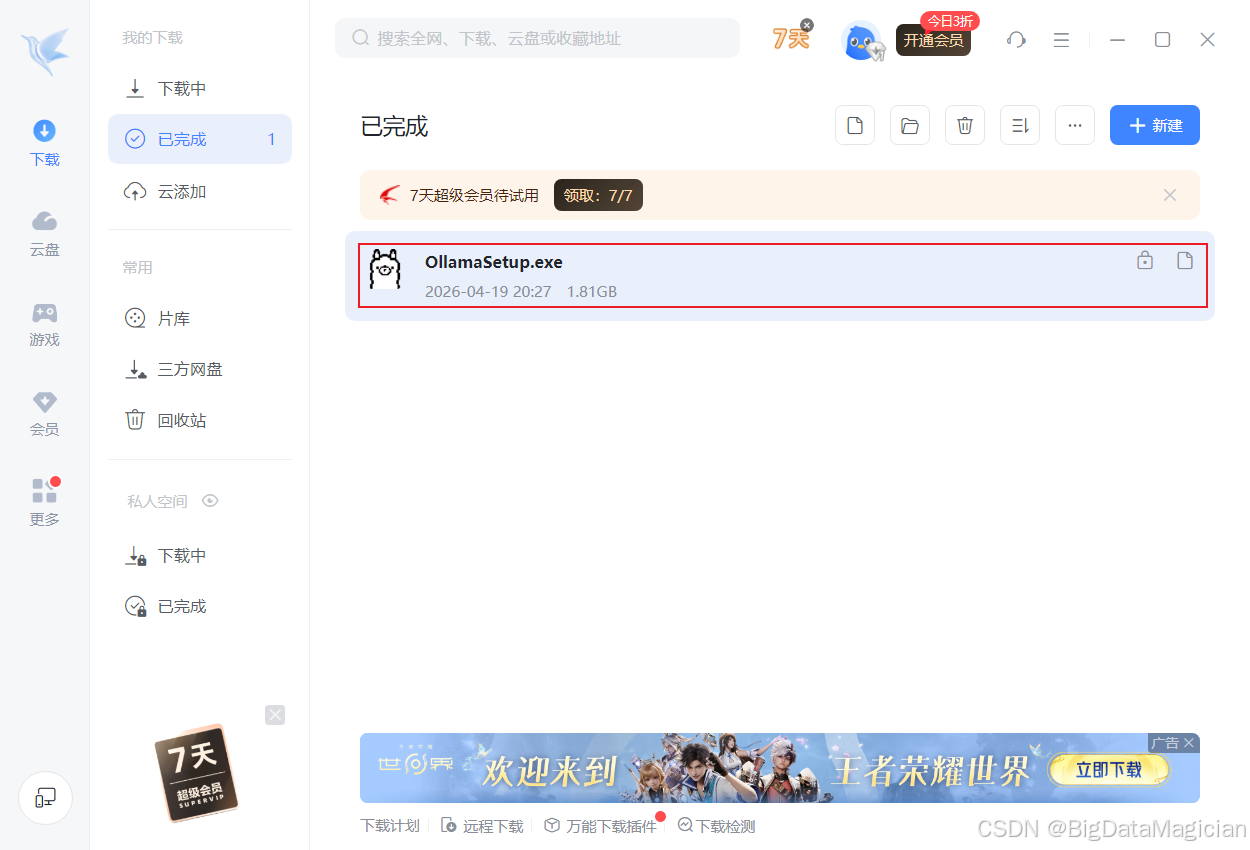

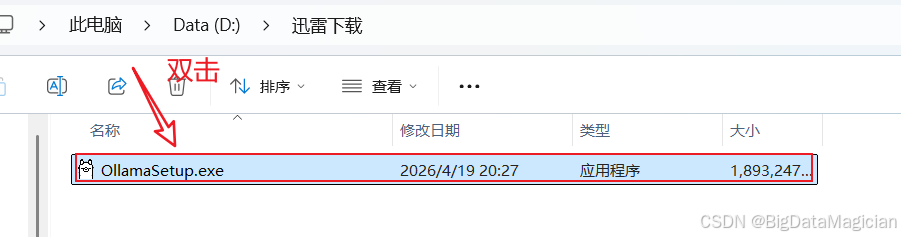

等待下载任务全部完成后,即可在迅雷「已完成」栏目中,获取到完整的Ollama Windows端安装程序 OllamaSetup.exe。从文件信息可以看到,本次安装包完整大小为 1.81GB,文件完整无缺失,接下来即可进行软件安装操作。

2. 安装Ollama

下载完成后,打开刚才迅雷下载对应的文件保存目录,找到安装程序文件 OllamaSetup.exe,双击该应用程序,启动Ollama的安装向导。

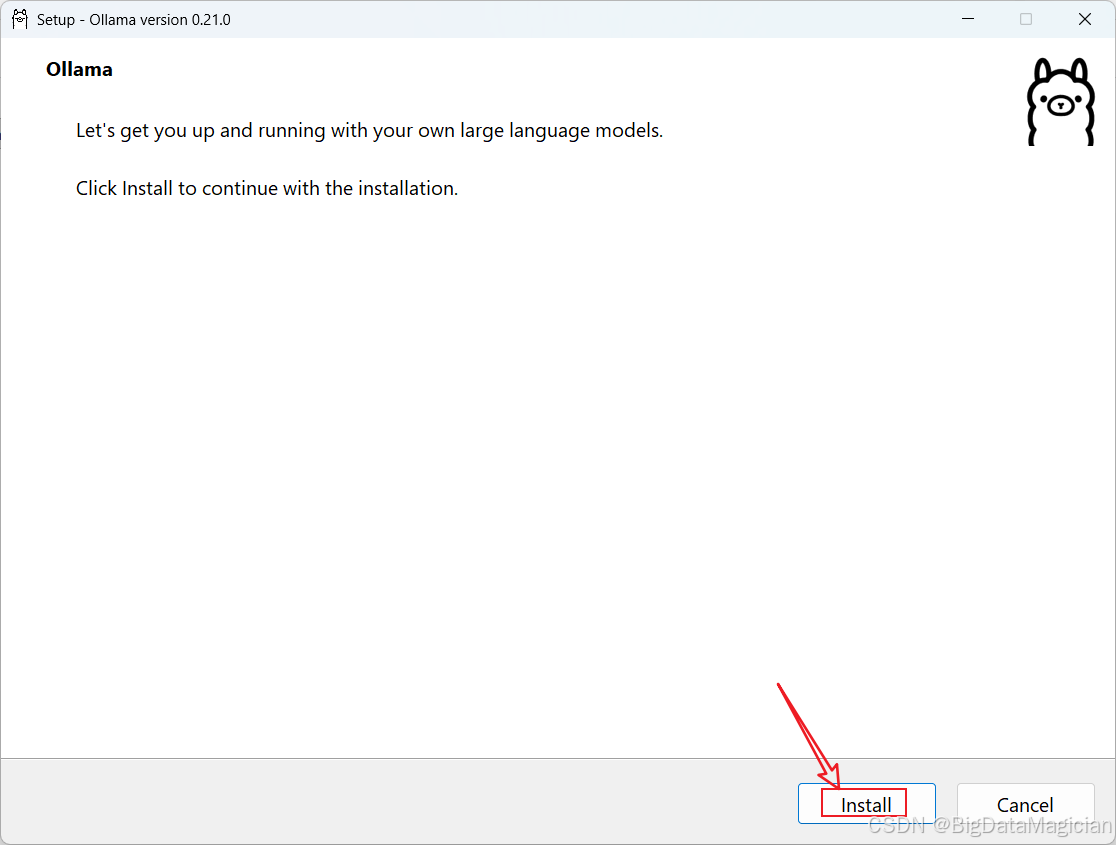

随后会弹出Ollama官方安装界面,本教程演示版本为 Ollama 0.21.0。该安装包为一键静默安装程序,无需繁琐的自定义配置、路径选择等步骤,直接点击界面右下角的 Install 按钮,即可自动开始全流程安装。

补充说明:Windows版本的Ollama安装程序全程自动化部署,会自动完成系统环境变量配置、后台服务注册、依赖组件部署,用户无需手动修改任何安装参数,等待安装进度走完即可。

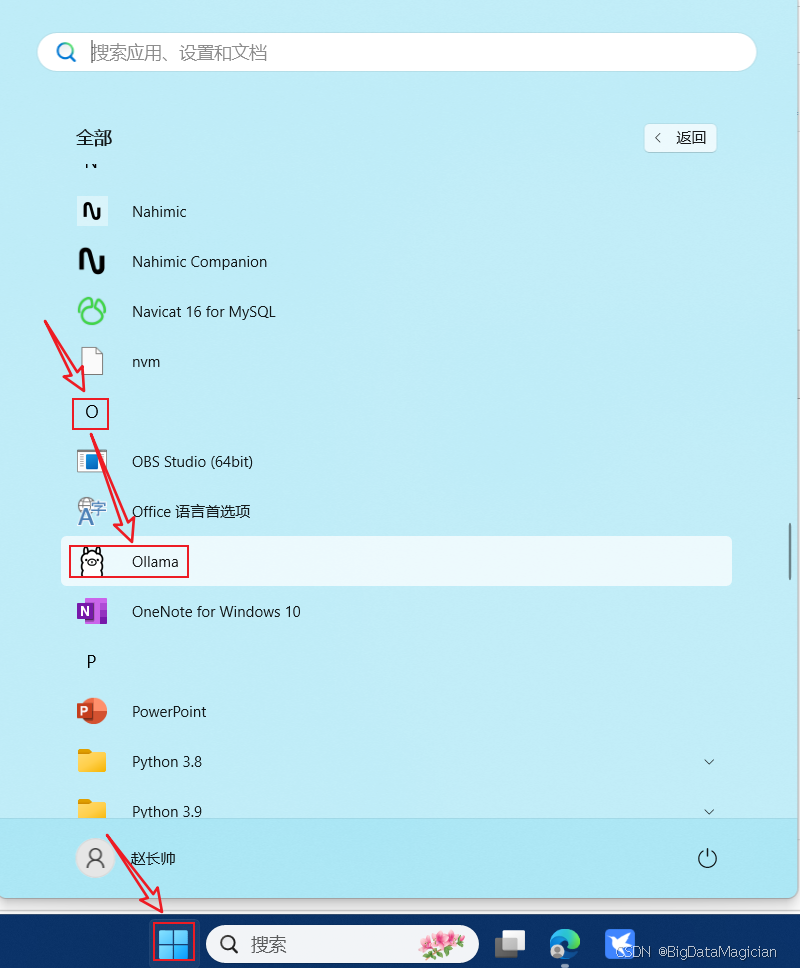

3. 启动Ollama

Ollama 安装完成后,会自动在系统中注册应用程序。我们可以通过两种常用方式启动它,本教程以开始菜单启动为例:

- 点击 Windows 系统桌面左下角的 开始菜单 图标(四格窗口样式);

- 在应用列表中,按字母顺序找到 Ollama 应用(图标为 Ollama 专属的卡通形象);

- 点击该选项,即可启动 Ollama 主程序。

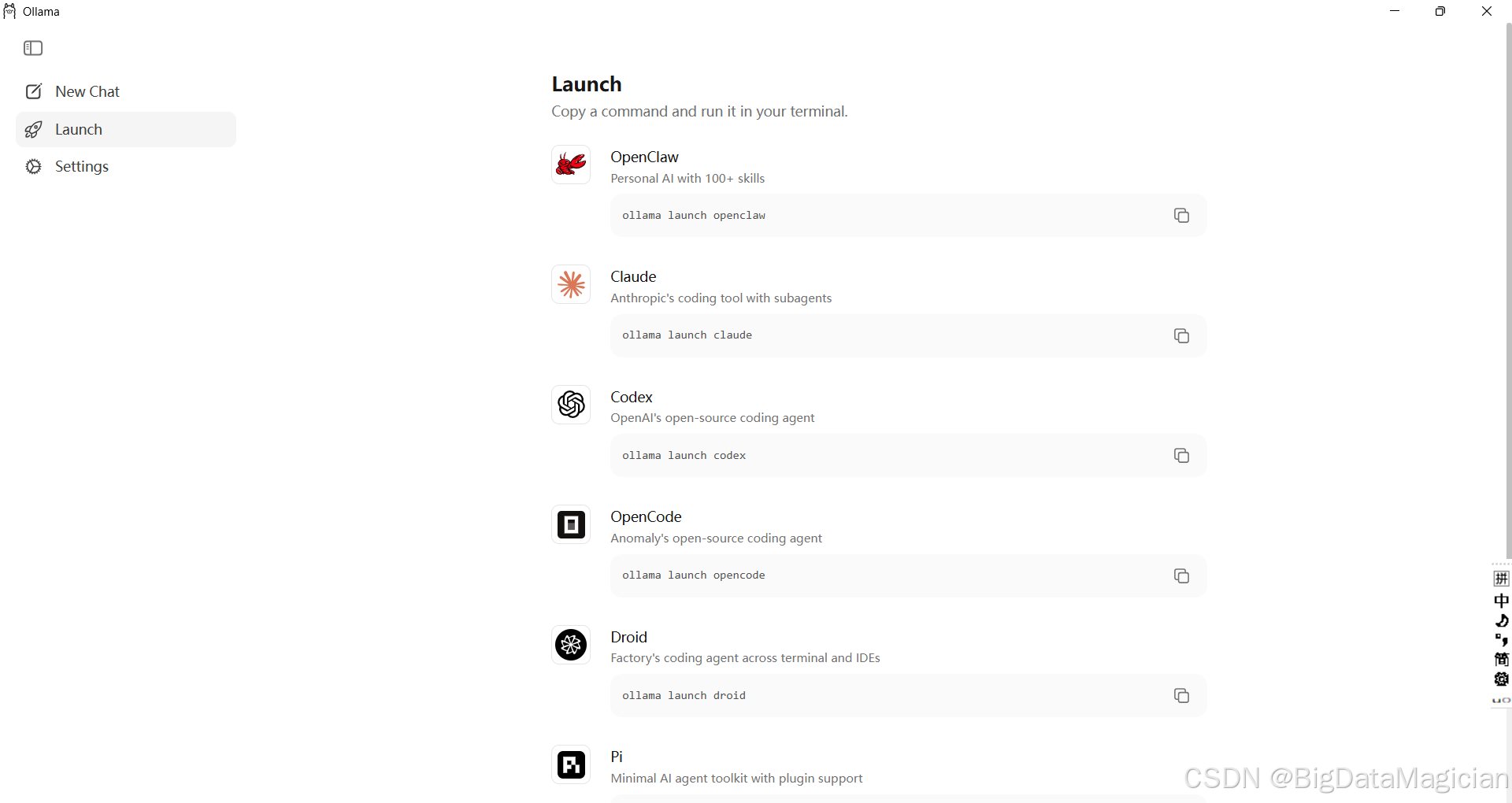

启动 Ollama 后,会弹出官方主界面,界面分为左侧功能栏与右侧操作区,核心功能如下:

左侧功能栏

- New Chat:新建对话会话,开启全新的模型交互任务;

- Launch:模型启动管理区,展示内置可一键启动的开源模型列表;

- Settings:系统设置入口,可配置模型存储路径、代理、日志等核心参数。

右侧 Launch 区

该区域展示了 Ollama 官方支持的多款开源模型,每款模型对应唯一的启动命令,例如:

- OpenClaw :通用个人 AI 助手,启动命令

ollama launch openclaw; - Claude :Anthropic 旗下模型工具,启动命令

ollama launch claude; - Codex :开源代码生成类模型,启动命令

ollama launch codes; - Droid :终端与 IDE 场景专用编码智能体,启动命令

ollama launch droid; - Pi :轻量级 AI 工具包,启动命令

ollama launch pi。

核心提示:点击任意模型右侧的复制图标,可快速获取启动命令;复制后打开终端(PowerShell/CMD),粘贴命令即可一键运行对应模型,无需手动输入复杂指令。

三、下载模型

Ollama 客户端安装启动完成后,本身仅为模型运行框架,不内置大模型权重文件,需要按需下载开源大模型,本章节选用通义千问 qwen2.5 国产开源大模型作为演示案例,该模型中文理解能力优秀、轻量化适配性强,非常适合本地AI Agent开发入门。

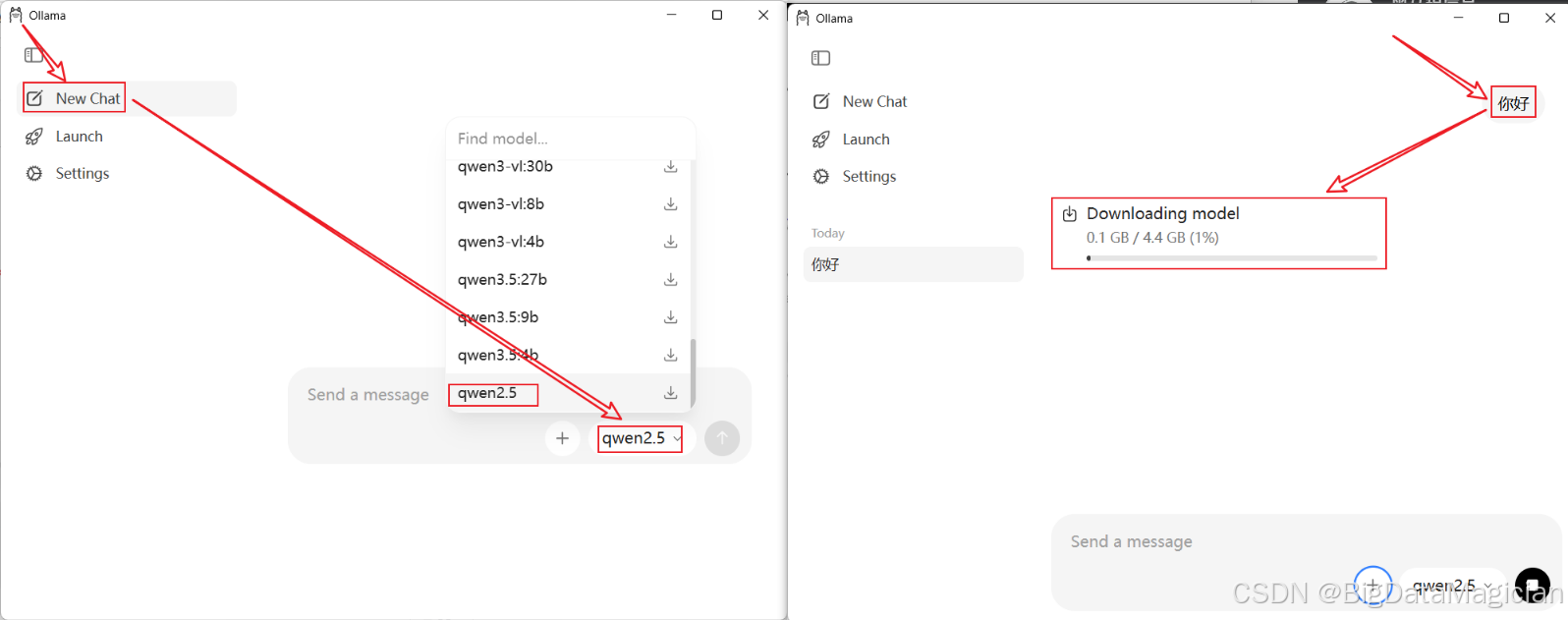

- 首先在Ollama主界面左侧菜单栏,点击 New Chat 选项,进入全新对话交互页面。

- 在页面下方的模型选择下拉框中,点击展开模型列表,Ollama官方仓库内置了海量开源模型,涵盖阿里通义、Llama、Mistral等全系列模型,本次选择 qwen2.5 模型。

- 模型选定后,在底部输入框发送任意消息(本次演示输入

你好),客户端会自动触发模型下载流程。 - 界面会弹出

Downloading model模型下载进度条,实时展示当前已下载大小、模型总大小与下载进度。本次演示的qwen2.5模型完整大小为4.4GB,全程后台自动下载,期间无需手动额外操作,耐心等待下载进度走完即可。

补充说明:

- Ollama 具备智能懒加载机制:只有首次调用模型时才会触发下载,后续再次使用无需重复下载,直接加载本地文件运行。

- 模型库内所有开源模型均可自由切换,不同参数量、不同能力侧重的模型,文件体积与硬件运行要求各不相同。

- 本次选用的qwen2.5为阿里通义官方开源模型,中文对话、逻辑推理、代码生成能力均衡,低配电脑CPU也可流畅运行,是本地私有化AI Agent搭建的首选入门模型。