基于 Transformer 的波形生成:从音频到量化交易的统一时序建模

近年来,Transformer 逐渐取代传统 RNN/CNN,成为时序建模的"万金油"。本文基于 nn.Transformer,总结一套可快速落地于音频生成、量化交易和通用时序预测的实践路径。

AudioZoom工程:见文末

一、快速起步:统一的训练/验证流程

- 训练入口 :始终使用

python train.py,Trainer 会自动构建数据集、模型、优化器与调度器。 - 模块自检 :

python dataset.py:验证数据切片与特征(waveform / STFT)是否匹配配置。python model.py:检查 Transformer 的输入输出维度、预测流程。python loss.py:验证自定义损失(默认 Cosine+MSE)。

- 日志与目录 :TensorBoard 输出固定在

logs/,checkpoints/、output/会在config.Config.__post_init__自动创建。

经验:修改配置后先跑 dataset/model 两个自检脚本,能提前发现 90% 的维度错误。

二、灵活的特征表示:Waveform vs STFT

| 场景 | 推荐表示 | 说明 |

|---|---|---|

| 高频音频生成 | spectrogram |

config.data.representation="spectrogram",模型输入维度由 n_fft 自动推导(如 1024 → 513 频率桶),无需手动改网络结构。 |

| 低维指标预测(如量化交易) | waveform 或直接数值序列 |

维度恒为 1,适合简化模型,聚焦时间依赖。 |

- STFT 参数(

n_fft/hop_length/win_length/center/log/normalize)全部来自config.data.*;修改后务必重新跑python dataset.py检查张量形状。 config.inference.input_sequence_length/output_sequence_length始终表示"时间步"。切换为频谱模式时不会自动换算 hop length,需人工确保时间窗长度正确。- 数据集默认 75% 重叠 (

stride = seq_len // 4);在长序列场景(如行情数据)若担心样本量爆炸,可调小segment_length或直接改_create_sequences的 stride。

三、模型与训练要点

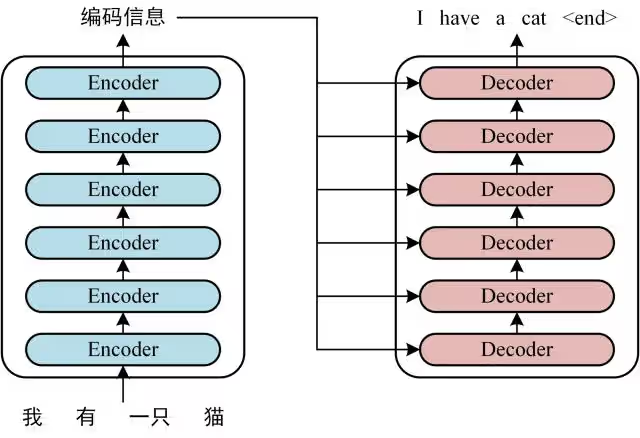

- 核心结构 :基于

torch.nn.Transformer(batch_first=True),禁止重复造轮子;更改层数、头数、FFN 维度等都通过config.model.*完成。 - 投影一致性 :输入与输出都经

input_projection映射到d_model,因此只要更新config.data.feature_dim(),model.input_dim就会在Config.__post_init__中自动同步。特征维度不匹配是最常见的训练崩溃原因。 - 损失与调度 :

- 默认

CombinedLoss = 0.7 * Cosine + 0.3 * MSE,在音频与金融时序中都能兼顾方向一致性和幅度误差。 - 学习率调度使用

CosineWarmupScheduler手动逐 step 更新;若换优化器或初始 LR,需确认_compute_lr逻辑仍合理。

- 默认

- 指标 :

calculate_precision实为相关系数(numpy 实现)。数据中若出现 NaN 会直接拖垮训练,应在特征层面先处理。

四、场景落地示例

1. 音频生成

- 选择

spectrogram表示,调大n_fft可捕获更细的频谱结构。 - 训练完成后,通过

model.predict自回归生成频谱,再逆 STFT。 - 可结合温度、top-k/top-p 采样控制音色多样性。

2. 量化交易

- 使用

waveform或直接把行情特征拼成多维"波形"。 segment_length可设为单日或单周 bars;inference.output_sequence_length表示需要预测的未来窗口。- 关注 overlap 带来的样本冗余,必要时降低

stride避免数据泄漏。

3. 通用时序预测(需求/气象/IoT)

representation取决于变量类型:连续信号可用 waveform,离散频域规律明显的可尝试 STFT。- 保持

combined loss,能兼顾整体趋势与短期误差。 - 如果需要多步预测,直接增大

output_sequence_length即可。

五、常见坑位与规避

- 音频文件缺失 :

train.wav必须在根目录,或者更新config.data.audio_path。 - 时间窗理解错误:切换 spectrogram 后记得按 hop length 换算帧数,否则覆盖时长会显著缩短。

- STFT 警告 :

python dataset.py会提示使用矩形窗造成 spectral leakage,若要消除请显式传入torch.hann_window(...)并写入配置。 - 无 CI 保障:提交前自行运行 dataset+model,自有保障后再启动短训验证 runtime。

六、推荐工作流

- 调整配置 → 更新

config.py(确保representation、序列长度、STFT 参数一致)。 - 自检 → 依次运行

python dataset.py、python model.py,确认形状与前向流程正确。 - 训练 →

python train.py;若换 GPU/CPU,直接设置CUDA_VISIBLE_DEVICES。 - 监控 →

tensorboard --logdir logs,观察 loss/precision/MAE/RMSE。 - 推理或场景验证 → 使用

model.predict或加载checkpoints/best_checkpoint.pth进一步评估。

七、CODE

结语

AudioZoom 提供了一个高度模块化的骨架:统一的配置、自动化的数据/模型装配、清晰的自检脚本,让我们能够在不同领域中快速迭代 Transformer 时序模型。

无论你在为新乐器合成音色、为量化策略预测未来行情,还是在建模任何多尺度时序信号,这套流程都能帮助你专注于特征设计与目标定义,把工程层的坑降到最低。