【感知·医学分割】当 YOLOv11 杀入医学赛道:先检测后分割的级联架构

标签 :前沿感知算法 / YOLOv11 / 医学图像 / 架构设计

首发:探物 AI

在医学图像算法的落地中,我们常常陷入一个思维定势:既然是分割任务,那就直接上 U-Net,或者无脑堆显存上最新最热的 Mamba 和大模型。

但现实往往很骨感:面对动辄超高分辨率的全景医疗影像(如全尺寸 CT 或高精度病理切片),直接进行全局像素级分割,不仅会让本地那点可怜的显存(比如常见的 12G 显存配置)瞬间 OOM,还会带来一个致命问题------居高不下的假阳性(False Positives)。

今天,我们跳出"纯分割"的固有框架,聊聊一种极其高效的降维打击策略:YOLOv11 领航的级联架构(Cascade Pipeline)。

01 痛点:为什么全局分割容易翻车?

医学影像有一个典型特征:病灶极小,背景极大。

如果你直接把一整张复杂的医学图像丢给分割网络,模型会不可避免地把大量注意力浪费在无关的背景组织上。长得像肿瘤的正常血管、质地类似病灶的健康阴影,都会被网络误判。

这就好比让一个人在整个足球场里寻找一粒特定的沙子,不仅极度消耗精力(算力冗余),还特别容易看花眼。

02 破局:让 YOLOv11 充当"领航员"

与其让沉重的分割网络去大海捞针,不如先派一个轻量、极速的侦察兵去锁定大体方位。这就轮到计算机视觉界的"卷王"------YOLO 系列出场了。

虽然 YOLOv11 是为目标检测而生,但它的全局感知能力和鲁棒性在医学影像中同样适用。

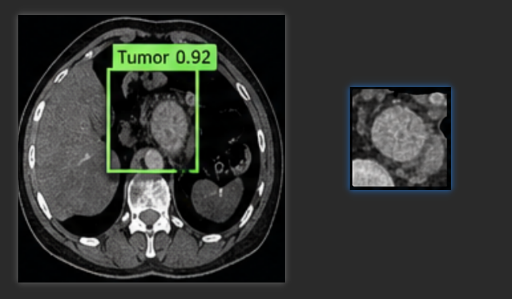

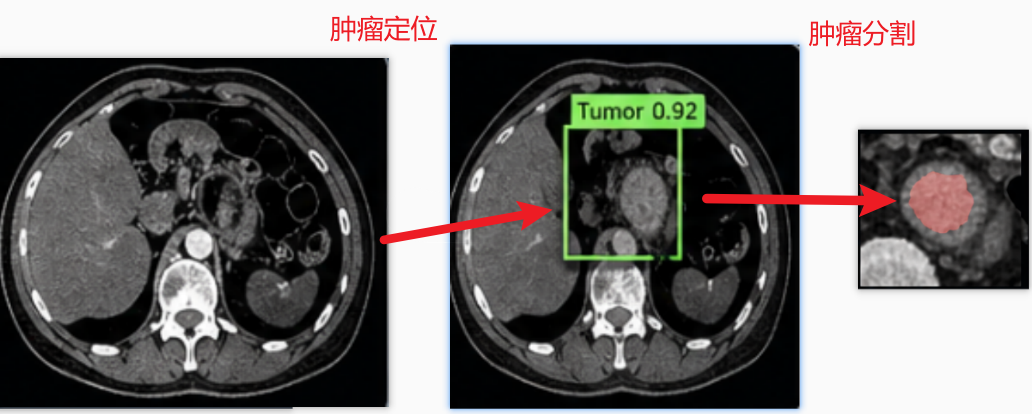

第一步:快速拉框(Bounding Box 定位)

我们将整张医学图像输入 YOLOv11。由于它只预测边界框而不是逐像素分类,推理速度极快,且对全局结构的把控非常精准。YOLOv11 能迅速在复杂的全景图中,用一个 Bounding Box 锁定"嫌疑病灶"的大致区域(ROI)。

03 收网:精细裁剪与局部精雕

有了 YOLOv11 划定的 ROI 区域,接下来的事情就变得极其优雅了。

第二步:ROI 裁剪与降维

我们根据 Bounding Box 的坐标,将这块小区域从原图中裁剪下来。原本 2048×2048 的庞然大物,瞬间变成了 256×256 甚至更小的局部切片。

第三步:局部精细分割

现在,把这个裁剪后的小切片送入高精度的分割网络(比如经典的 U-Net,或者拥有全局感受野的 Mamba 架构)。

因为此时所有的背景噪音都已经被 YOLOv11 物理隔绝在外,分割网络只需要专注处理这块巴掌大的地方。"假阳性"被直接从物理层面扼杀了。

04 级联架构的工程红利

这种"先检测,后分割"的粗到细(Coarse-to-fine)架构,带来了两个立竿见影的工程收益:

- 精度狂飙:排除了海量背景的干扰,分割网络能更专注地描绘病灶边缘,真正做到"好钢用在刀刃上"。

- 算力自由:这也是最迷人的一点。你不再需要动辄几万块的高端显卡来硬扛高分辨率数据的显存压力。由于送到分割网络的都是极小的裁剪图,普通的消费级单卡也能轻松跑起原本高不可攀的前沿大模型。

05 结语

真正的算法落地,不是盲目追求单一模型的复杂度,而是用工程化的智慧去组合工具。让 YOLO 去做它最擅长的全局定位,让 Mamba / U-Net 去做它们最擅长的像素精雕。

打破边界,各司其职,这才是感知算法最优雅的实战姿态。

欢迎关注【探物 AI】,分享最硬核、最落地的 AI 感知技术与前沿视野。