2026年4月,AI编程领域迎来了今年以来最密集的一轮模型更新。4月24日,OpenAI正式发布GPT-5.5,同步将Codex编程智能体全面整合至GPT-5.5架构,不再独立维护Codex产品线。4月16日,Anthropic发布Claude Opus 4.7,在高级软件工程能力和视觉理解方面实现显著提升。Gemini 3.1 Pro和Grok 4.3也在近期相继更新,分别在多模态推理和语音交互领域取得进展。

对于一线开发者而言,单一模型难以覆盖所有开发场景。本文将聚焦GPT-5.5与Claude Opus 4.7两大主力编程模型的最新基准表现与实战能力差异,同时分析Gemini 3.1 Pro和Grok 4.3的差异化定位,为开发者提供2026年4月时间节点上的多模型选型参考。

一、GPT-5.5:终端操控与自主编程能力 跃升

4月24日发布的GPT-5.5是OpenAI从零完整重训的基础模型,距上一代GPT-5.4仅7周。英伟达内部已有超过一万名员工通过Codex应用使用GPT-5.5,覆盖工程设计等多个部门。

在衡量模型独立处理命令行工作流能力的Terminal-Bench 2.0基准测试中,GPT-5.5跑出了82.7%的准确率,远超同期Claude Opus 4.7的69.4%,差距超过十三个百分点。在评估真实GitHub问题解决能力的SWE-Bench Pro测试中,得分达到58.6%;在内部长周期工程任务测试Expert-SWE中,更是达到了73.1%------该测试中位人类耗时约20小时。

更值得关注的是GPT-5.5在经济性上的表现。OpenAI总裁Greg Brockman强调,GPT-5.5通过大幅降低单任务Token消耗,实现了"更贵但更划算"的能效比。Codex同步升级了浏览器控制、Sheets/Docs处理、系统级语音和自动审查功能,GPT-5.5本质上是一个为Codex生态量身定制的模型。

在提示词使用范式上,GPT-5.5也带来了显著变化。OpenAI发布的官方指南建议开发者从精细化指令转向目标导向描述------仅提供目标产出、成功标准和必要约束,以充分发挥模型自主规划能力。这一转变对习惯了为GPT-5.4编写详细步骤指令的开发者来说,需要一段适应期。

二、Claude Opus 4.7:编程精度与视觉能力的双重突破

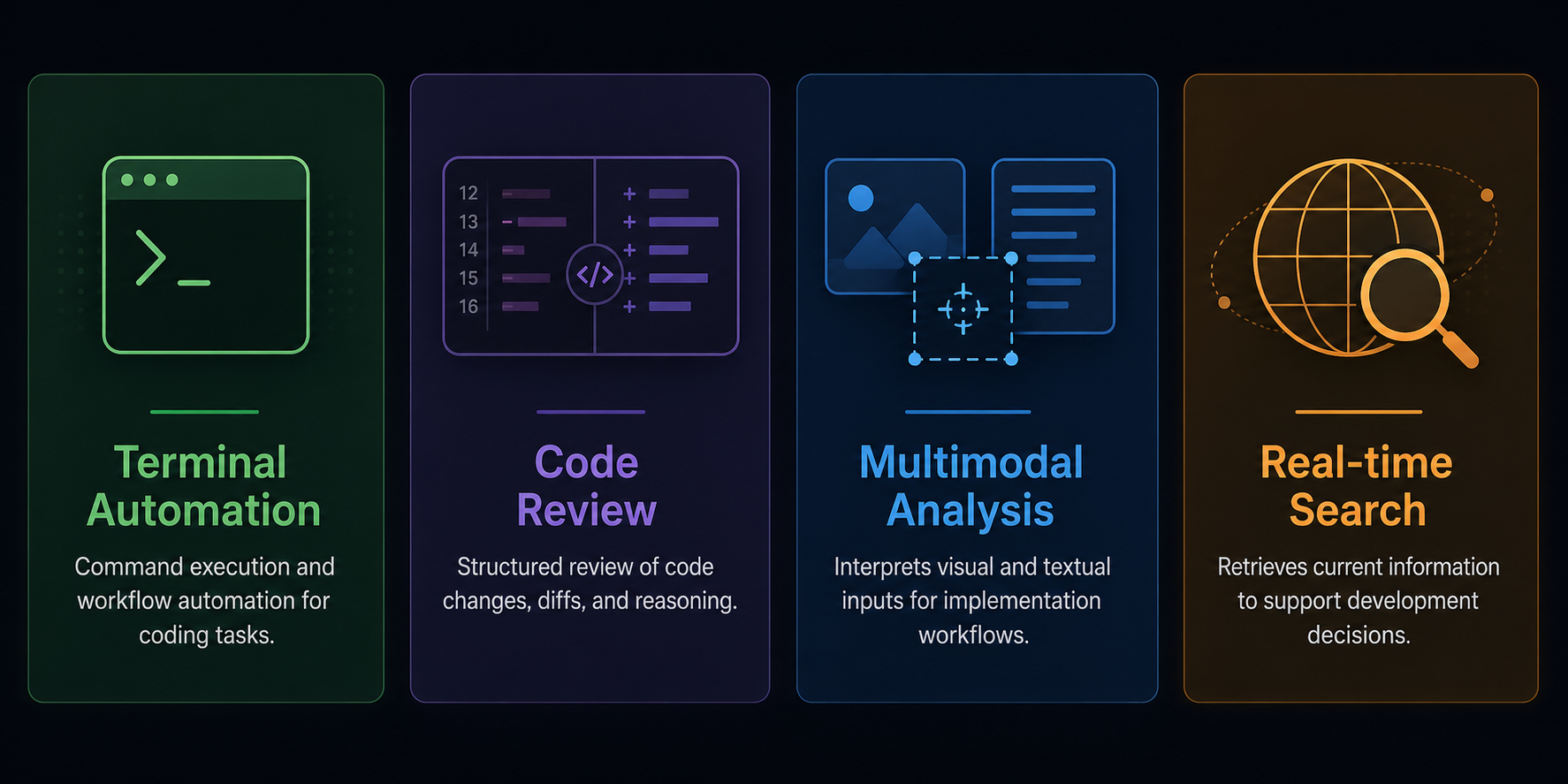

Anthropic于4月16日发布的Claude Opus 4.7,距离上一代仅间隔两个多月。在高级软件工程能力方面,Opus 4.7在SWE-bench Verified这一权威编程基准测试中的得分从上一代的80.8%升至87.6%,是目前公开模型中的第一名。在更难、更接近真实工作场景的SWE-bench Pro测试中,Opus 4.7从上代53.4%直接跳到64.3%,单代涨幅近11个百分点,横向对比超过了GPT-5.4的57.7%和Gemini 3.1 Pro的54.2%。

视觉能力是Opus 4.7另一大亮点。模型能够接收长边达2,576像素的图像,分辨率是过往Claude模型的三倍以上。这项升级让AI代理能够阅读密密麻麻的屏幕截图、从复杂图表中精准提取数据,甚至进行"像素级"的精确校对。在对UI设计稿进行代码级还原的场景中,这项能力尤为实用。

此外,Opus 4.7在指令遵循方面也做了重要调整------4.7不再过度解读用户意图,而是严格按照文本指令的字面意思去操作,工具调用错误率降低了三分之二,多步任务成功率提升14%。

三、Gemini 3.1 Pro与Grok 4.3的差异化定位

在两大主力模型之外,Gemini 3.1 Pro和Grok 4.3分别在各自优势领域持续深耕。

Gemini 3.1 Pro在ARC-AGI-2基准测试中获得了77.1%的验证分数,在推理表现上达到前代的两倍。在Humanity's Last Exam(跨学科专家级问题测试)中得分44.4%。其多模态理解能力支持文本、图像、音频和视频的原生处理,在处理设计稿转代码、图文混合内容分析等场景中相较其他模型有独特优势。

Grok 4.3方面,当前版本仍为0.5T参数的中间训练版本。马斯克已确认,真正的1T参数旗舰版本距离初始训练完成还需约5天时间。xAI计划下周推出Grok Build,正式进军智能体编程赛道,与Claude Code和OpenAI Codex竞争。Grok 4.3在语音交互领域表现突出,已率先在Starlink客服场景中实现70%的自主解决率,在实时信息检索方面也展现出极低幻觉率的优势。

四、四大模型基准测试速览

| 测试项 | GPT-5.5 | Claude Opus 4.7 | Gemini 3.1 Pro |

|---|---|---|---|

| Terminal-Bench 2.0 | 82.7% | 69.4% | 53.8% |

| SWE-Bench Verified | --- | 87.6% | 80.6% |

| SWE-Bench Pro | 58.6% | 64.3% | 54.2% |

| ARC-AGI-2 | --- | 68.8% | 77.1% |

| Humanity's Last Exam | --- | --- | 44.4% |

数据来源:各模型官方发布页及公开第三方评测。上表中GPT-5.5的部分测试指标使用不同基准工具,不可直接横向比较,已在对应单元格中用"---"标注。Grok 4.3当前为0.5T测试版,完整编程基准数据待1T版本发布后补齐。

五、按任务类型选择模型的实践思路

从上述基准数据和实战体验出发,不同开发场景下各模型的表现差异已经相当清晰:

-

终端自动化与命令行工作流:GPT-5.5在Terminal-Bench 2.0上82.7%的表现确立了其在该领域的领先地位。如果日常工作中涉及大量脚本编排、自动化运维或批量代码处理,GPT-5.5/Codex组合是当前的最优选择。

-

复杂代码重构与高精度工程任务:Claude Opus 4.7在SWE-bench Verified上87.6%的得分,以及在逐字执行精度和指令遵循方面的提升,使其在需要严苛逻辑一致性的长周期项目中保持明显优势。

-

多模态理解与跨文档分析:Gemini 3.1 Pro支持100万token上下文窗口,且原生支持多模态输入。对于需要处理设计稿、PDF文档、图表数据等混合内容的任务,Gemini是更匹配的选择。

-

实时信息检索与语音交互:Grok 4.3在语音领域的先发优势和实时联网检索的低幻觉率,使其成为需要快速查询最新技术文档或安全漏洞信息时的理想补充工具。

六、多模型环境下保障开发连续性的实践考量

在同时使用多个AI编程模型的日常开发中,确保各模型服务的稳定获取是持续开发的基本前提。不同国家或地区的网络环境、支付通道和账号管理策略存在差异,开发者需要提前规划好各模型的获取和续费路径。

有经验的开发团队通常会在技术栈中预留各模型的API接入接口,同时为关键模型准备备用方案。对于独立开发者而言,日常主力模型保持长期稳定使用,辅助模型在对应项目阶段按需获取,这种模式能在保障开发连续性的同时有效控制成本。

七、总结

2026年4月的AI编程模型格局呈现明显的能力分化趋势。没有一个模型能在所有维度上全面领先:GPT-5.5在终端操控和自主任务规划上确立了新标杆,Claude Opus 4.7在编程精度和指令遵循方面保持领先,Gemini 3.1 Pro在多模态推理领域独树一帜,Grok 4.3在语音和实时检索方面开辟了差异化赛道。

对于开发者而言,当前阶段的核心能力不再是"熟练掌握某个模型的使用",而是根据任务类型灵活选择最合适的模型,并建立起稳定高效的多模型工具链。在多模型协同逐渐成为主流的2026年,这将是每一位AI时代开发者的基础素养。