CVPR 2025顶级SLAM论文精读:MASt3R-SLAM如何用单目相机实现实时稠密三维重建?

文章标签

SLAM 单目视觉 三维重建 机器人视觉 MASt3R-SLAM CVPR2025 稠密建图

0. 写在前面

最近几年,SLAM 领域正在发生一个明显变化:

过去大家更多关注 特征点、光流、BA优化、回环检测 ;

现在越来越多工作开始把 三维重建大模型、视觉基础模型、稠密几何先验 引入 SLAM 系统。

今天分析的这篇论文就是一个非常典型的代表:

MASt3R-SLAM: Real-Time Dense SLAM with 3D Reconstruction Priors

这篇论文的核心思想可以概括为一句话:

不再只依赖传统特征点做 SLAM,而是利用 MASt3R 提供的三维重建先验,让单目 RGB 视频也能实现实时稠密建图。

1. 论文基本信息

| 项目 | 内容 |

|---|---|

| 论文名称 | MASt3R-SLAM: Real-Time Dense SLAM with 3D Reconstruction Priors |

| 中文理解 | 基于三维重建先验的实时稠密 SLAM 系统 |

| 会议 | CVPR 2025 |

| 研究方向 | 单目 SLAM、稠密三维重建、视觉定位、机器人感知 |

| 核心模型 | MASt3R |

| 关键词 | Pointmap、Ray、Loop Closure、Dense SLAM、Global Optimization |

2. 一句话看懂这篇论文

传统 SLAM 通常是:

text

图像 → 特征点提取 → 特征匹配 → 位姿估计 → 三角化建图 → 回环优化而 MASt3R-SLAM 更像是:

text

图像对 → MASt3R三维先验 → Pointmap点图 → 相机跟踪 → 局部融合 → 回环检测 → 全局优化也就是说,MASt3R-SLAM 不是简单地在传统 SLAM 后面加一个深度估计网络,而是把 三维重建先验 放到了整个系统的核心位置。

3. 为什么这篇论文值得关注?

SLAM 对机器人、AR、无人机、自动驾驶、AGV 小车都非常重要。

但是传统单目 SLAM 一直有几个痛点:

3.1 依赖相机标定

很多传统 SLAM 系统默认相机内参已知,比如焦距、主点、畸变参数等。

但真实工程中,经常会遇到:

text

相机型号更换

镜头焦距变化

工业现场安装角度偏差

历史视频没有标定参数

手机或网络视频相机参数未知这会导致传统 SLAM 的泛化能力受到限制。

3.2 稀疏地图不够用

ORB-SLAM 这类经典方法非常优秀,但是它主要构建的是稀疏特征点地图。

对于机器人来说,只有稀疏点是不够的。

例如 AGV 小车不仅要知道自己在哪里,还要知道:

text

前方是否有货架?

通道是否被遮挡?

地面是否连续?

障碍物的空间轮廓是什么?

环境结构是否发生变化?这些任务都更依赖稠密几何。

3.3 单目深度和尺度不稳定

单目相机天然缺少深度信息。

所以单目 SLAM 很容易出现:

text

尺度漂移

深度估计不准

长期轨迹漂移

局部地图断裂

场景几何不连续MASt3R-SLAM 要解决的就是这些问题。

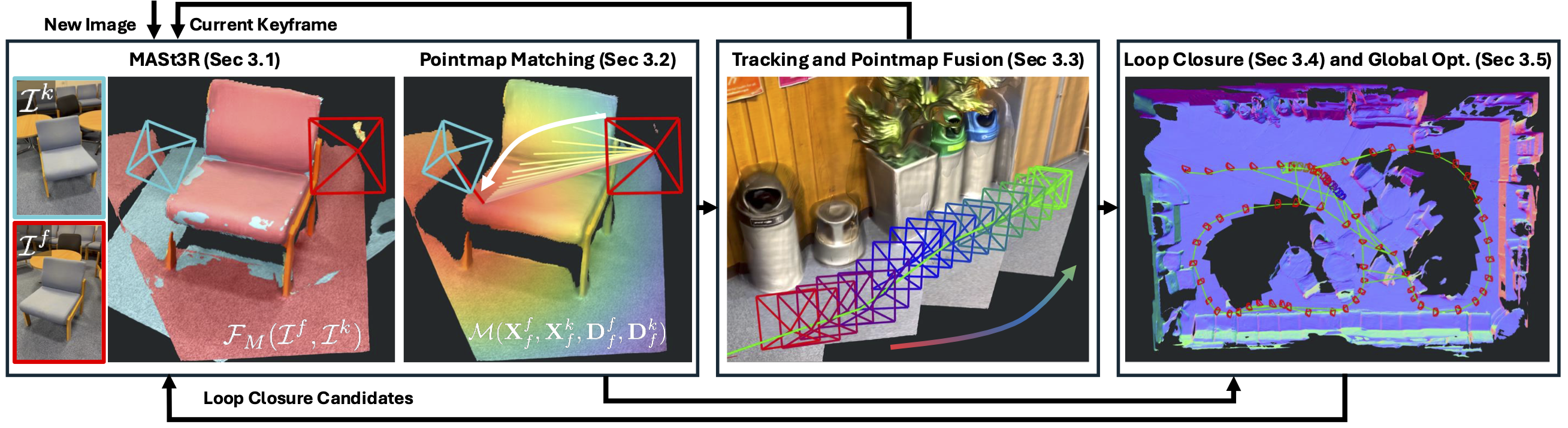

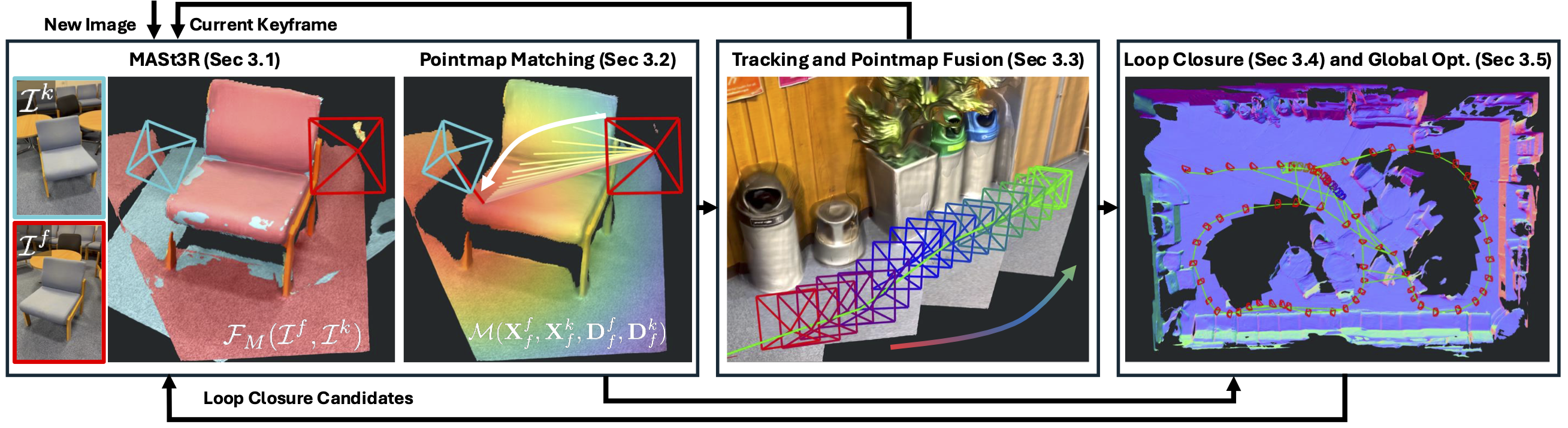

4. 方法总览:MASt3R-SLAM系统框架

从上面的系统图可以看出,MASt3R-SLAM 主要包含四个关键部分:

| 模块 | 作用 |

|---|---|

| MASt3R | 从图像对中预测三维 Pointmap |

| Pointmap Matching | 在点图之间建立匹配关系 |

| Tracking and Fusion | 完成相机跟踪和局部点图融合 |

| Loop Closure and Global Optimization | 进行回环检测和全局一致性优化 |

可以把整个流程理解成:

text

输入RGB视频

↓

关键帧选择

↓

MASt3R预测两帧之间的Pointmap

↓

Pointmap Matching完成几何匹配

↓

前端估计相机运动

↓

局部融合生成稳定地图

↓

回环检测发现历史位置

↓

全局优化修正轨迹和地图

↓

输出相机位姿 + 稠密三维结构5. 核心概念一:什么是 Pointmap?

Pointmap 可以理解为一种"像素级三维点图"。

普通 RGB 图像中,每个像素只有颜色信息:

text

像素 → RGB颜色而 Pointmap 中,每个像素对应一个三维点:

text

像素 → 三维坐标点 X, Y, Z也就是说,Pointmap 把二维图像和三维空间直接关联起来。

在 MASt3R-SLAM 中,MASt3R 网络可以从两张图像中预测出位于统一坐标系下的三维点图。

这就让系统不再完全依赖传统特征点匹配,而是可以直接利用更丰富的三维几何信息。

6. 核心概念二:为什么要从 Pointmap 转成 Ray?

MASt3R-SLAM 中还有一个很关键的设计:

它会把 Pointmap 归一化为 Ray,也就是光线方向。

为什么要这么做?

因为单目图像预测出来的三维点,深度可能不够准确。

如果直接优化三维点坐标误差,深度误差会产生较大影响。

而 Ray 更关注方向一致性,可以降低深度不准带来的影响。

可以简单理解为:

| 优化方式 | 特点 |

|---|---|

| 直接优化3D点 | 容易受深度误差影响 |

| 优化Ray方向 | 更关注视线方向,对深度误差更鲁棒 |

示意如下:

text

相机中心

|

| Ray方向

↓

空间三维点这种设计对于单目 SLAM 很重要,因为单目系统最容易不稳定的地方之一就是深度尺度。

7. 前端跟踪:用三维先验替代传统特征点依赖

传统 SLAM 前端通常做的是:

text

提取ORB/SIFT特征点

↓

特征匹配

↓

估计相机相对位姿MASt3R-SLAM 的前端则更偏向:

text

输入连续两帧图像

↓

MASt3R预测Pointmap

↓

Pointmap Matching

↓

根据三维几何一致性估计相机运动这样做的优势是:

系统能够利用更强的三维结构信息,而不是只依赖少量稀疏特征点。

尤其在以下场景中会更有潜力:

text

纹理较弱的室内场景

结构重复的走廊场景

相机参数未知的视频

需要稠密建图的机器人场景8. 局部融合:让地图更稳定

如果每一帧都单独预测一个 Pointmap,容易出现地图抖动。

例如:

text

第1帧预测的桌子在这里

第2帧预测的桌子稍微偏一点

第3帧预测的墙面又出现断裂所以 MASt3R-SLAM 需要进行局部融合。

局部融合的作用是把多个关键帧的信息整合起来,让局部地图更加稳定。

可以理解为:

text

单帧Pointmap:可能有噪声

多帧Pointmap融合:结构更稳定这一步对稠密 SLAM 很关键,因为稠密地图不仅要"看起来像",还要在多帧之间保持一致。

9. 回环检测:解决长期漂移问题

SLAM 系统运行时间越长,误差越容易累积。

比如机器人从起点出发,绕一圈又回到起点附近:

text

A → B → C → D → A如果没有回环检测,系统可能会认为最后的位置是一个新地方。

如果有回环检测,系统就会发现:

text

这里我之前来过然后通过全局优化把轨迹和地图拉回到一致状态。

MASt3R-SLAM 的回环检测也建立在 Pointmap Matching 和图优化基础上。

10. 后端优化:让轨迹和地图全局一致

MASt3R-SLAM 不只是做前端跟踪,它还有后端全局优化。

后端优化要解决的问题是:

text

如何让所有关键帧的相机位姿一致?

如何让不同关键帧预测的三维结构一致?

如何利用回环约束修正长期漂移?整体目标可以理解为:

text

最小化不同关键帧之间的几何不一致优化变量主要包括:

text

关键帧位姿

Pointmap几何结构

关键帧之间的匹配约束

回环约束这一点让 MASt3R-SLAM 不只是一个三维重建网络,而是一个完整的 SLAM 系统。

11. 和传统SLAM方法对比

| 方法 | 主要特点 | 优点 | 局限 |

|---|---|---|---|

| ORB-SLAM | 稀疏特征点SLAM | 速度快,工程成熟 | 稠密地图能力弱 |

| DROID-SLAM | 深度学习 + 可微优化 | 位姿精度强 | 稠密几何表达有限 |

| NeRF-SLAM类方法 | 神经隐式地图 | 渲染效果好 | 实时性和工程部署较难 |

| MASt3R-SLAM | 三维重建先验 + SLAM | 单目、稠密、鲁棒性强 | 计算资源要求较高 |

从对比可以看出,MASt3R-SLAM 的优势不是单纯位姿估计,而是:

text

同时兼顾相机跟踪和稠密三维建图12. 论文主要创新点总结

创新点一:把MASt3R三维重建先验引入实时SLAM

过去很多方法只是把深度估计网络当成辅助模块。

MASt3R-SLAM 则是把 MASt3R 作为整个 SLAM 系统的底层几何先验。

这意味着系统设计思路发生了变化:

text

传统SLAM:几何规则驱动

MASt3R-SLAM:三维先验 + 几何优化共同驱动创新点二:基于Pointmap进行跟踪和融合

Pointmap 不只是中间结果,而是贯穿了整个系统。

它参与:

text

相机跟踪

局部融合

回环检测

全局优化这让系统的几何表达更加统一。

创新点三:支持未知或变化相机模型

MASt3R-SLAM 不强依赖固定相机内参,而是通过 Pointmap 到 Ray 的转换,建立更通用的中心相机模型。

这对真实工程场景很有意义。

创新点四:稠密建图和实时性兼顾

很多稠密建图方法效果好,但是速度慢。

MASt3R-SLAM 的目标是实现实时单目稠密 SLAM。

也就是说,它不仅关注建图质量,也关注系统能否连续处理视频流。

13. 实验结果怎么理解?

论文在多个经典 SLAM 数据集上进行了测试,包括:

text

TUM RGB-D

7-Scenes

EuRoC

ETH3D-SLAM这些数据集覆盖了室内场景、机器人轨迹、相机定位和三维重建等任务。

从论文结果来看,MASt3R-SLAM 的核心优势主要体现在两个方面:

13.1 位姿估计稳定

MASt3R-SLAM 可以在单目 RGB 输入下估计稳定的相机轨迹。

这说明它不是只会做三维重建,而是具备完整 SLAM 系统所需的跟踪能力。

13.2 稠密重建效果更完整

相比传统稀疏 SLAM,MASt3R-SLAM 能输出更丰富的三维结构。

这对机器人来说非常有价值。

传统方法可能只能告诉你:

text

相机在哪里

哪些特征点被跟踪到了而 MASt3R-SLAM 更接近于告诉你:

text

相机在哪里

场景结构是什么样

墙面、地面、物体大致在哪里14. 工程复现:官方运行方式

官方代码支持视频输入,也支持 RGB 图像文件夹输入。

运行视频可以参考:

bash

python main.py --dataset <path/to/video>.mp4 --config config/base.yaml如果输入是图像文件夹,可以使用:

bash

python main.py --dataset <path/to/folder> --config config/base.yaml如果有已知相机内参,可以指定标定文件:

bash

python main.py --dataset <path/to/video>.mp4 --config config/base.yaml --calib config/intrinsics.yaml这说明 MASt3R-SLAM 既可以处理普通视频,也可以在有标定信息时进一步提升效果。

15. 对AGV和机器人视觉的启发

如果从 AGV、移动机器人和工业视觉角度看,这篇论文非常有启发。

15.1 SLAM正在从稀疏走向稠密

AGV 不仅需要知道自己的位置,还需要理解周围环境。

稠密地图可以帮助机器人判断:

text

障碍物形状

货架位置

通道结构

墙面边界

地面区域这比稀疏点地图更适合复杂工业场景。

15.2 三维视觉基础模型可能成为机器人感知底座

MASt3R-SLAM 说明,未来 SLAM 可能不再完全依赖人工设计的特征点,而是更多依赖通用三维视觉模型。

未来机器人视觉系统可能会变成:

text

视觉基础模型提供三维先验

SLAM系统负责实时跟踪和优化

规划模块利用稠密地图做决策15.3 对工业部署仍有挑战

虽然 MASt3R-SLAM 很强,但直接部署到 AGV 或嵌入式设备上仍然有难度。

主要挑战包括:

text

模型计算量大

GPU资源要求较高

实时性依赖硬件

工程环境复杂

与ROS系统集成需要适配如果要真正落地到 AGV 上,可能需要:

text

TensorRT加速

模型剪枝

半精度推理

关键帧策略优化

边缘端与服务器协同计算16. 不足与改进方向

MASt3R-SLAM 虽然很有创新性,但也有一些不足。

| 不足 | 说明 |

|---|---|

| 计算资源要求较高 | 依赖较强的三维重建网络 |

| 对先验模型依赖明显 | 如果 MASt3R 预测失败,后续 SLAM 也会受影响 |

| 极端场景仍可能不稳定 | 强反光、弱纹理、动态物体等场景仍有挑战 |

| 工程部署门槛较高 | 环境配置、显存、依赖库都需要考虑 |

未来可以考虑的改进方向包括:

text

轻量化MASt3R网络

结合IMU提升稳定性

引入语义分割过滤动态物体

部署到Jetson或工业GPU平台

与ROS/ROS2系统深度集成17. 个人总结

MASt3R-SLAM 是一篇非常值得关注的 SLAM 论文。

它最大的价值不是简单提升某一个指标,而是展示了一种新的 SLAM 设计范式:

text

传统SLAM:

特征点 + 几何优化 + 稀疏地图

MASt3R-SLAM:

三维重建先验 + Pointmap + 稠密地图 + 全局优化对于学术研究者来说,这篇论文值得学习它如何把三维视觉基础模型接入 SLAM 系统。

对于工程开发者来说,这篇论文提示我们:未来机器人视觉系统很可能会把深度学习三维先验、传统几何优化和实时工程部署结合起来。

一句话总结:

MASt3R-SLAM 不是简单地把深度网络塞进 SLAM,而是以三维重建先验为核心,重新设计了一套面向实时稠密建图的单目 SLAM 系统。

参考资料

1 Murai R, Dexheimer E, Davison A J. MASt3R-SLAM: Real-Time Dense SLAM with 3D Reconstruction Priors. CVPR 2025.

2 MASt3R-SLAM Project Page:

https://edexheim.github.io/mast3r-slam/

3 MASt3R-SLAM GitHub Repository:

https://github.com/rmurai0610/MASt3R-SLAM

4 MASt3R: Grounding Image Matching in 3D with MASt3R: