大家好,我是小肥肠。 这几天一直在考虑转型AI视频博主,打磨了几天口播稿,总觉得差一点,只能边更新边优化了。还考虑做小程序,把我的内容产品化,因为我意识到一点,如果继续写干货教程,那么我吸引的人永远是有技术背景的人,这类人同行居多。只有我面向特定人群做产品,才能真正打开市场。扯远了,今天给大家带来的是AI童装带货skill,感兴趣的可以看看。

1. 童装带货原来这么简单

我为什么这么跳脱开始研究AI童装带货了,起因是我朋友,她做的线下实体童装店,有一天她给我发了一个链接,是一个可爱小女孩跳舞的视频,视频左下角挂了商品链接。我点进博主了主页,数据不错,我又点进了几个做同赛道的博主橱窗。

可以看出来,这类赛道流量不错,转化也好,一句话来说就是很不错的赛道 。朋友问我能不能有个傻瓜式的操作?她说一句话就把视频做出来了。我研究了4.5天还真行,做了一个xfc-sell-goods,话不多说给大家看看使用方法和成品视频。

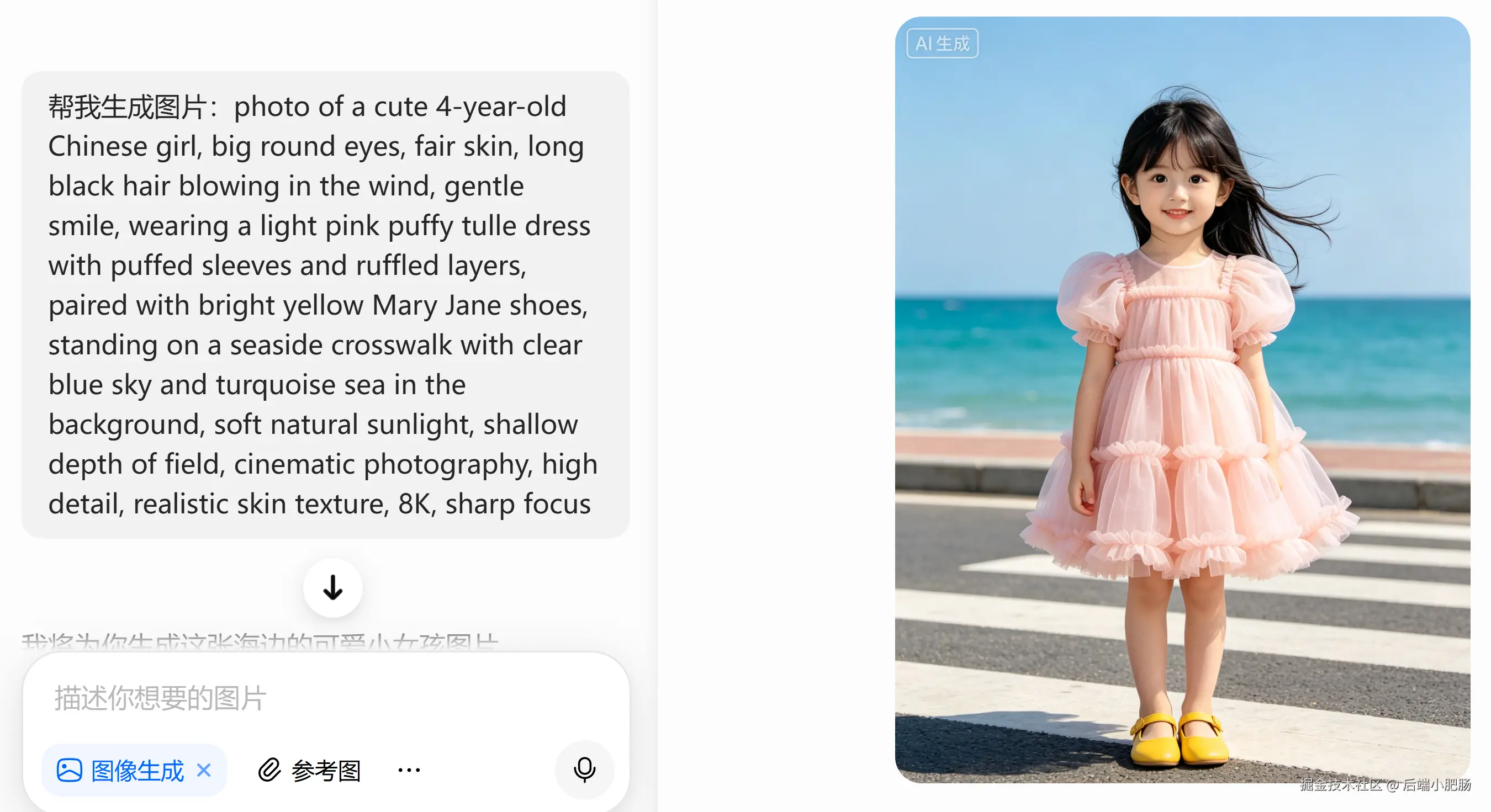

1. 基于豆包生成可爱模特照片

2.进行换装操作

将要带货的童装衣服替换给AI模特,提示词就是白话:把图1的小女孩换上图2的套装和裙子

3. 获取热门童装带货原视频(.mp4格式)

这块内容在我之前的教程有,但是核心mcp服务在阿里云百炼下架了,源代码还能用,可以自行部署mcp服务或者找其他工具:【n8n入门系列】输入抖音分享链接,3步自动提无水印视频 + 文案,小白也能上手!

4. 向已经集成了带货skill的小龙虾发送人物替换 指令

上传原视频和AI模特图,发送指令:替换小女孩

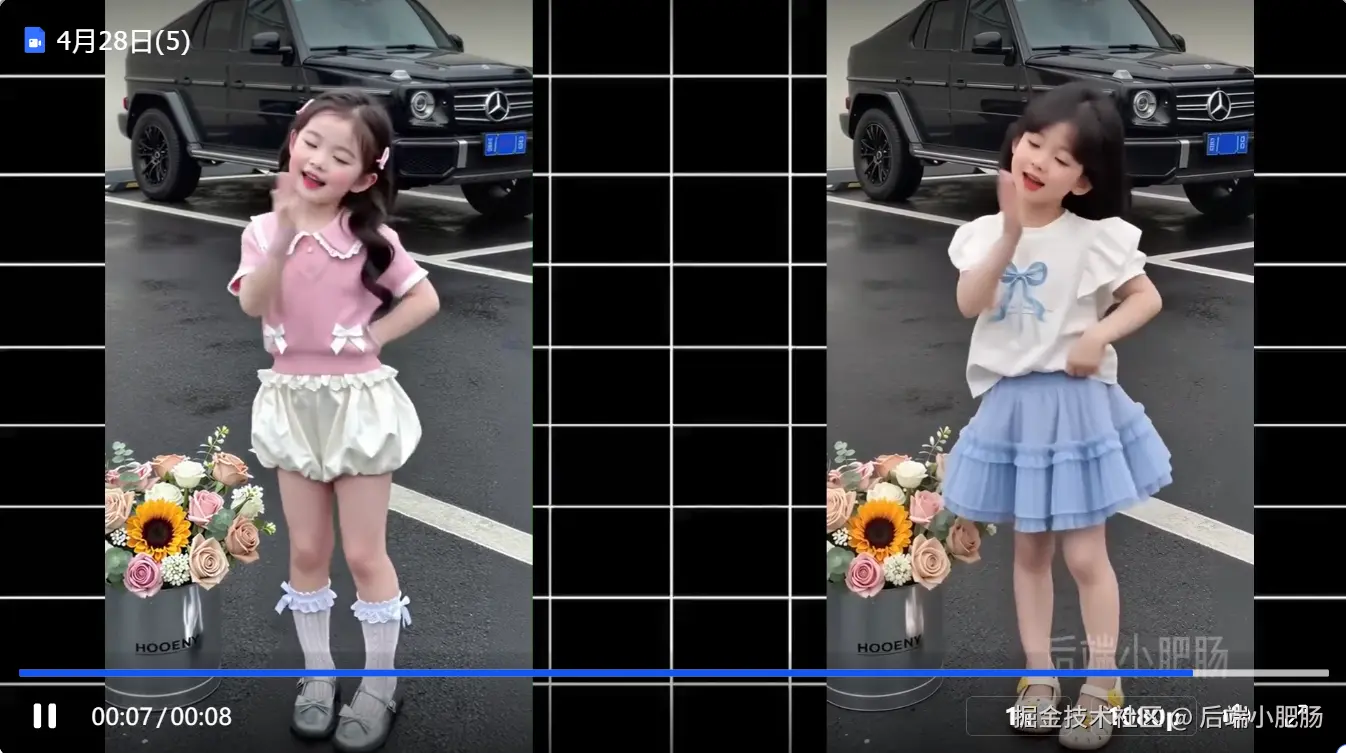

等待几分钟后成品视频就做好了,左边为原视频,右边是我做了人人物替换的视频

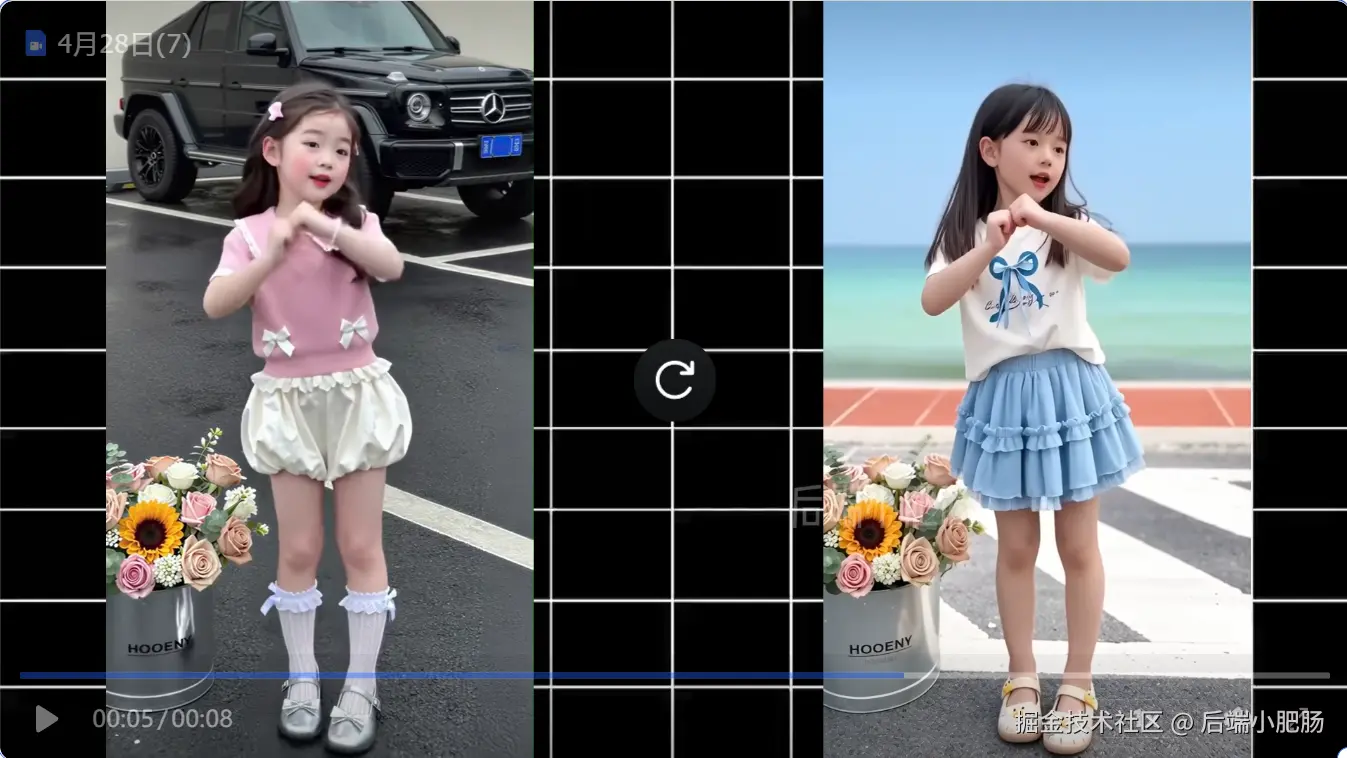

5. 向已经集成了带货skill的小龙虾发送动作模仿 指令

xfc-sell-goods不但能做人物替换,还能做动作模仿。这样可以基于我们自己的图片生成跳舞视频,规避同质化问题。

等待几分钟,动作替换视频就生成好了。

2. Skill的构思以及实现

2.1. 技术选型

1. Running Hub主体替换工作流

AI童装带货我开始想的是用RunningHub上面的主体替换工作流来做,找了半天才找到一个合适的工作流,我当时传的美女跳舞视频做主体替换,13秒的视频整整跑了20分钟...从时长上我直接把它pass了。

2. wan2.7-videoedit视频编辑模型

这是阿里的视频编辑模型,支持以自然语言指令编辑视频,可以参考图像替换视频元素。我的skill围绕这个模型的调用来做。

2.2. 技术实现概述

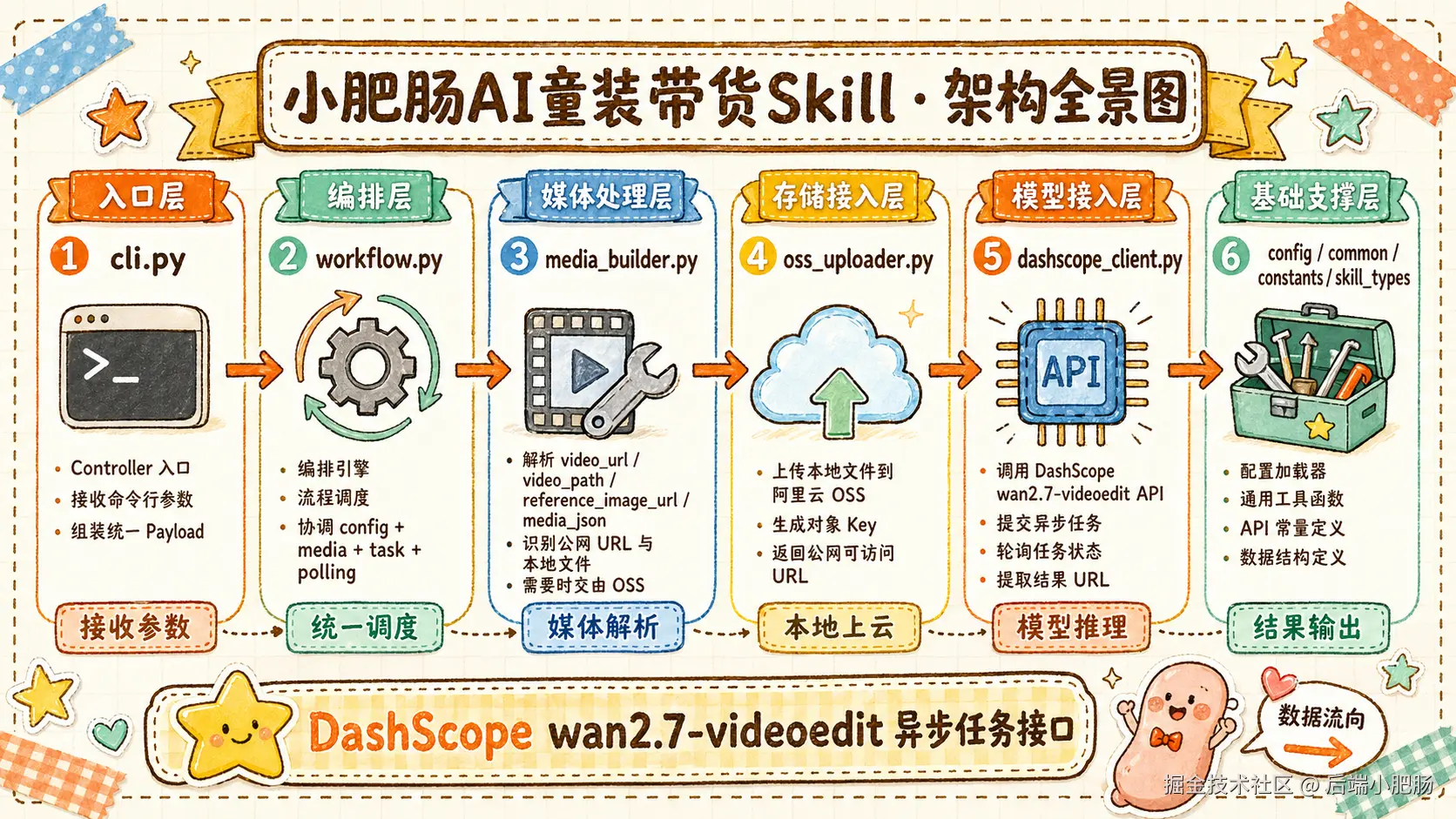

这个skill的制作原本我就想写一个代码文件调用一下wan2.7-videoedit就行。后来我规划了一下技路线,发现一个代码文件无法涵盖skill技术需求,于是我让CodeBuddy将skill做成了高内聚低耦合的结构:

上图为我skill的架构全景图,核心就是一套分层调用链当用户传入视频和图片,发送视频编辑指令:把视频里面的的女生换成图片里面的女生,背景不变,只变动人物,背景音乐也不准变。当skill接收到用户请求会做以下2件事:

1. 判断用户传入的tu和视频是在线地址还是本地的地址,如果是本地的地址,就把图片和视频线用oss_uploader.py上传到 oss 对象存储 桶中,这里有一个前置操作,提前买号oss以及把里面的桶设置为公共读。

2. 调用 wan2.7-videoedit进行视频编辑操作,这是一个异步的操作流程,异步的意思就是发送视频编辑请求和获取成品视频并不在一个步骤里面,要分两步来进行。

2.3. skill的集成调试

skill做完后,其实调用的方式有很多,可以集成到claude code、Openclaw、 hermes 等工具中,看你自己的调用习惯,小白的话推荐集成到workbuddy里面。其实常看我文章的读者应该能总结出来,AI智能体,我们要学的重心应该在skill编写上,而不是框架(claude code、Openclaw、hermes)的使用,好的skill能让你效率翻倍,框架如何选看你自己的使用习惯,写好skill也很简单,在AI编程工具如此易上手单的今天,我们完全可以用大白话来搭建自己的skill,这块内容应该会在我后续的视频教程更新。

到这里,我这次这个 AI 童装带货 skill 的思路和实现过程,基本就讲清楚了。上述skill已经被收录到了小肥陪跑群中,需要原件可以加入社群直接使用哦。

3. 结语

如果你也在关注 AI 带货、AI视频生成,或者也想把自己手上的工作流整理成 skill,希望我这次的分享能给你一点启发。

如本次分享对你有帮助,欢迎一键三连支持一下小肥肠,我们下期再见~