第一部分:什么是IPM?

IPM的核心目标只有一个:把"近大远小"的透视图像,变成"上帝视角"的俯视图。

为什么要这么做?

在驾驶员视角(透视视角)中,车道线是汇聚的,远处的车看起来很小。这对计算机算法来说很难计算距离和位置。而在鸟瞰图(俯视图)中,车道线是平行的,车辆大小一致,非常容易进行路径规划和距离测量。

IPM的关键假设

IPM有一个致命弱点:它假设地面是一个完美的平面。

- 对于地面: 变换是完美的。路面上的坑洼(如果不大)会被拉平。

- 对于障碍物(车、人): 因为车是立体的,不贴地,IPM会把车身"拍扁"在地上,产生拖影或变形(这就是图片中说的"视觉失真")。

第二部分:IPM的数学推导

数学上,IPM本质上是在求解一个单应性矩阵(Homography Matrix)。我们需要建立"图像像素坐标"与"真实世界地面坐标"之间的映射关系。

1. 定义两个坐标系

- 图像坐标系 ( u , v ):摄像头拍出来的照片,单位是像素。

- 世界坐标系( Xw , Yw ) :车前的真实地面,单位是米。注意,因为假设地面是平面,所以高度 Zw=0 。

2. 从世界坐标到相机坐标(刚体变换)

首先,世界坐标系中的点Pw =*Xw* ,*Yw* ,*Zw* ,1T 需要转换到相机坐标系 Pc =*Xc* ,*Yc* ,*Zc* ,1T 。

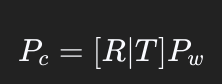

公式为:

其中 R 是旋转矩阵, T 是平移向量。

关键点 :由于我们只关心地面上的点,假设地面高度 Zw =0 。这会让矩阵运算简化,我们可以把 R 的第三列去掉(因为它乘以了0)。

3. 从相机坐标到图像坐标(透视投影)

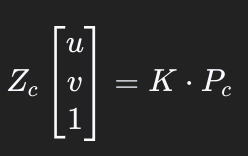

相机坐标系中的点投影到图像平面上,遵循小孔成像模型:

其中 K 是相机内参矩阵(包含焦距 f 和主点cx ,cy )。

4. 合并推导(核心数学步骤)

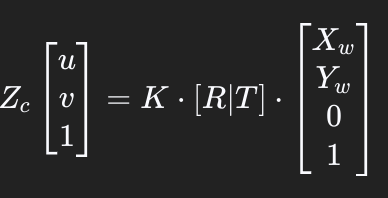

将第2步代入第3步,我们得到:

因为Zw =0 ,我们可以把 3×4 的外参矩阵 *R* ∣*T* 简化为一个 3×3 的矩阵,我们称之为单应性矩阵 H 。

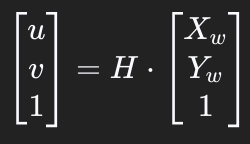

推导结果如下:

这里的 H 矩阵包含了相机的内参(焦距等)和外参(相机安装的高度和俯仰角)。

5. 逆变换(IPM的实现)

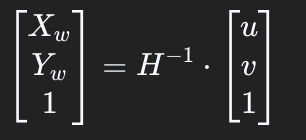

我们要做的IPM,是已知图像上的点 (u ,v ) ,求它在地面上的位置 (Xw ,Yw) 。

所以,我们需要求 H 的逆矩阵 H−1 :

这就是图片中提到的"利用透视变换矩阵(3x3单应性矩阵)...将图像像素坐标映射到世界坐标系"。

第三部分:总结

IPM的整个过程可以概括为:

标定 :先算出相机的内参 K 和外参(安装高度、角度)。

构建矩阵 :计算出从地面到图像的单应性矩阵 H 。

求逆 :计算 H−1 。

重映射 :遍历图像中的每一个像素,乘以 H−1 ,把它"贴"到俯视图的画布上。

局限性:

如果地面不平(有坡度),或者前方有悬空物体,由于 Zw=0 的假设不成立,计算出的位置就会有误差,表现为鸟瞰图中物体被拉长或扭曲。