一、云原生基石-K8s

1、什么是k8s

Kubernetes是谷歌开发的第三个容器管理系统,提供了资源调度、扩容缩容、服务发现、存储编排、自动部署和回滚,并且具有天生高可用、负载均衡、故障自动恢复等功能的"生态系统",目前已成为云原生领域的标准。

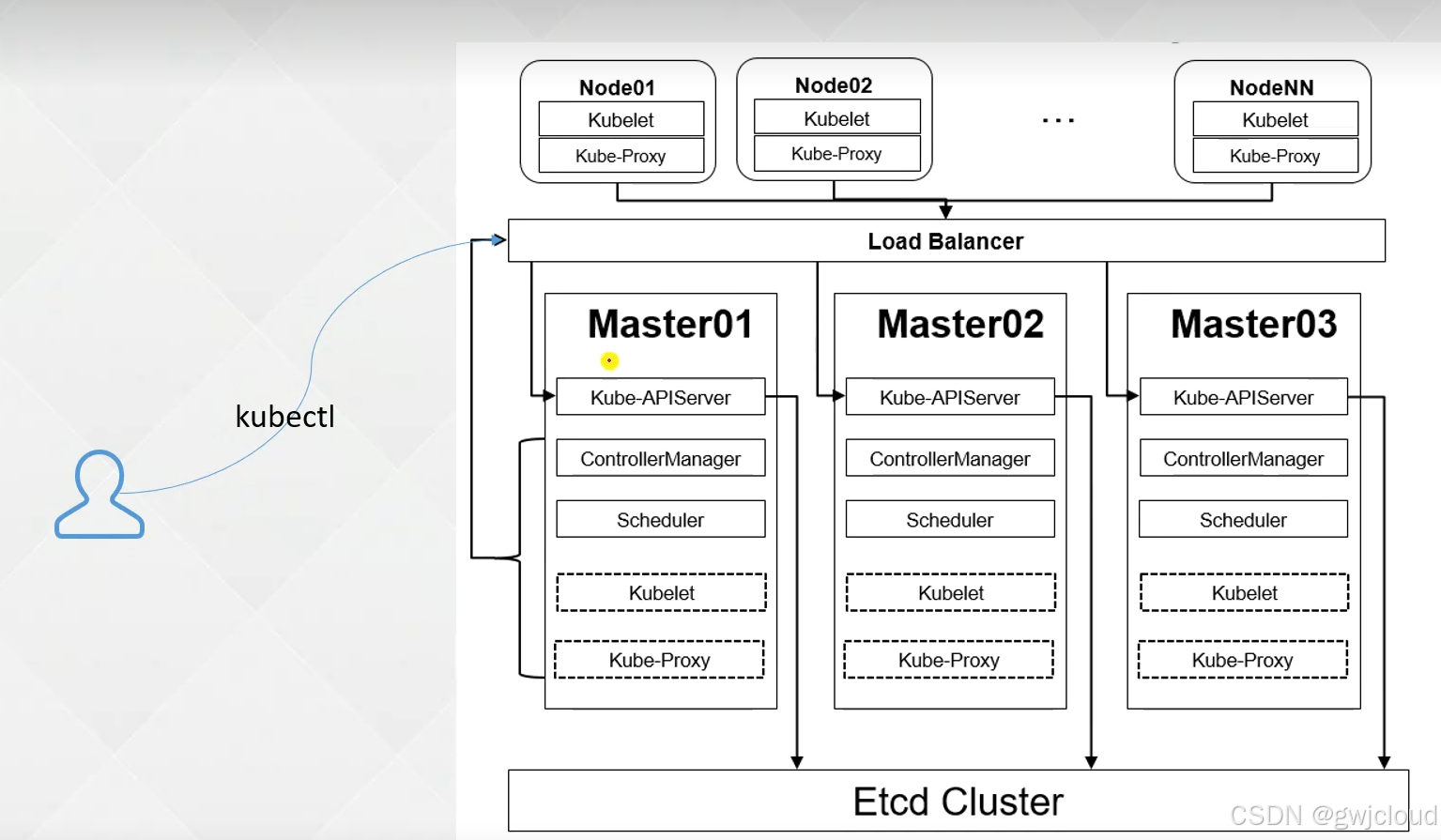

2、k8s的架构

ETCD 对硬盘性能有较高要求,因为其核心功能(如日志持久化、快照存储)依赖稳定的磁盘 I/O。以下是关键要求和建议:

磁盘类型

- SSD(推荐):必须使用 SSD,避免 HDD。ETCD 对延迟敏感,SSD 能提供稳定的低延迟和高吞吐量。

- NVMe SSD(高性能场景):对于高负载集群,NVMe SSD 可进一步提升性能。

性能指标

-

延迟 :写入延迟应低于 10ms,最佳实践为 1ms 以内。可通过

fio工具测试:bashfio --rw=write --ioengine=sync --fdatasync=1 --directory=test-data --size=22m --bs=2300 --name=sync-test -

吞吐量:单节点至少支持 50MB/s 的顺序写入速度。

文件系统与配置

-

文件系统 :推荐

ext4或XFS,并禁用atime更新以降低开销。bash# ext4 示例挂载选项 /dev/sdb /var/lib/etcd ext4 defaults,noatime,nodiratime 0 2 -

磁盘调度算法 :设置为

deadline或noop(SSD 适用),避免cfq。bashecho deadline > /sys/block/sdb/queue/scheduler

容量规划

- 最小空间:预留至少 2 倍于数据大小的空间(例如数据 8GB 则至少 16GB)。

- 监控与告警:设置磁盘使用率超过 80% 时触发告警,避免因空间不足导致集群不可用。

其他注意事项

- 避免共享磁盘:ETCD 磁盘不应与其他高 I/O 服务(如数据库)共享。

- RAID 配置:若使用 RAID,建议 RAID 10 而非 RAID 5/6,避免写入性能下降。

通过以上配置可确保 ETCD 在生产环境中稳定运行,避免因磁盘问题引发的性能瓶颈或数据丢失风险。

3、K8s组件解析

控制节点组件

- APIServer一APIServer是整个集群的控制中枢,提供集群中各个模块之间的数据交换,并将集群状态和信息存储到分布式键-值(key-value)存储系统Etcd集群中。同时它也是集群管理、资源配额、提供完备的集群安全机制的入口,为集群各类资源对象提供增删改查以及watch的RESTAPI接口。

- Scheduler一Scheduler是集群Pod的调度中心,主要是通过调度算法将Pod分配到最佳的Node节点,它通过APIServer监听所有Pod的状态,一旦发现新的未被调度到任何Node节点的Pod(PodSpec.NodeName为空),就会根据一系列策略选择最佳节点进行调度。

- Controller Manager一Controller Manager是集群状态管理器,以保证Pod或其他资源达到期望值。当集群中某个Pod的副本数或其他资源因故障和错误导致无法正常运行,没有达到设定的值时,Controller Manager会尝试自动修复并使其达到期望状态。

- Etcd一Etcd由coreOs开发,用于可靠地存储集群的配置数据,是一种持久性、轻量型、分布式的键-值(key-value)数据存储组件,作为Kubernetes集群的持久化存储系统。

其中Apiserver是无状态的:

Apiserver本身不任何数据,也不做只从选举,所有集群状态(pod,Deployment,Secret)全部存到etcd中

Scheduler和Controller Manager是有状态:

因为这两个组件必须进行选主(Leader),同一时间只能一个在工作,不然所有节点的Scheduler同时给一个Pod分配节点会冲突,同理Controller manager同时删副本、扩容是要混乱的

# 查询租约信息

[root@k8s-master01 ~]# kubectl get leases -n kube-system

NAME HOLDER AGE

apiserver-6z5gcnzqagv5p4h6bccr6hje2m apiserver-6z5gcnzqagv5p4h6bccr6hje2m_ceedf43b-3541-4105-a69d-5af62aa67275 4h34m

apiserver-hk4fzhyjdo2ayc5o2blltmf4pe apiserver-hk4fzhyjdo2ayc5o2blltmf4pe_94ba15e1-4e4f-4def-a6ad-78cb6546921e 2d1h

apiserver-l3o2wb47zcu4wv6xcvcptpja54 apiserver-l3o2wb47zcu4wv6xcvcptpja54_11a52805-fbb0-4969-8c65-d00efa458cda 4h34m

kube-controller-manager k8s-master01_a7d23801-f51c-4d3a-9c7c-67638bd79ae4 2d1h

kube-scheduler k8s-master03_b07bc7e8-97d3-4932-bed3-d689567d6143 2d1h

说明:

1. apiserver-xxx

Kubernetes APIServer 是多主并行运行的

它不需要选举 leader,所以每个 apiserver 都有自己的 lease

只代表心跳存活,不代表主从

2. kube-controller-manager

当前 leader 是:k8s-master01

同一时间只有一个节点在工作,其他节点待命

3. kube-scheduler

当前 leader 是:k8s-master03

调度器也必须选主,避免重复调度

# 查看详细租约信息(看谁是主、过期时间)

kubectl describe leases -n kube-system工作节点组件

- Kubelet:负责与Master通信协作,管理该节点上的Pod,对容器进行健康检查及监控,同时负责上报节点和节点上面Pod的状态。

- Kube-Proxy:负责各Pod之间的通信和负载均衡,将指定的流量分发到后端正确的机器上。

- Runtime:负责容器的管理。

必备的工具:

-

CoreDNS:用于Kubernetes集群内部Service的解析,可以让Pod把Service名称解析成Service的IP,然后通过Service的IP地址进行连接到对应的应用上。

-

Calico:符合CNI标准的一个网络插件,它负责给每个Pod分配一个不会重复的IP,并且把每个节点当做一各"路由器",这样一个节点的Pod就可以通过IP地址访问到其他节点的Pod。

K8s CoreDNS 运行示例说明

-

进入busybox容器查看DNS配置,可见容器DNS服务器指向10.96.0.10:

[root@k8s-master01 ~]# kubectl exec -it busybox -- sh

/ # cat /etc/resolv.conf

search default.svc.cluster.local svc.cluster.local cluster.local

nameserver 10.96.0.10

options ndots:5 -

查看kube-system命名空间下的Service,确认10.96.0.10对应名为kube-dns的ClusterIP Service:

[root@k8s-master01 ~]# kubectl get svc -n kube-system

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

kube-dns ClusterIP 10.96.0.10 <none> 53/UDP,53/TCP,9153/TCP 46h

metrics-server ClusterIP 10.96.41.20 <none> 443/TCP 46h

说明:K8s集群中,kube-dns是Service的兼容名称,实际提供DNS解析服务的是CoreDNS组件,上述示例表明CoreDNS运行正常,Pod可通过该DNS服务实现集群内部及外部域名解析。

-

二、深入pod

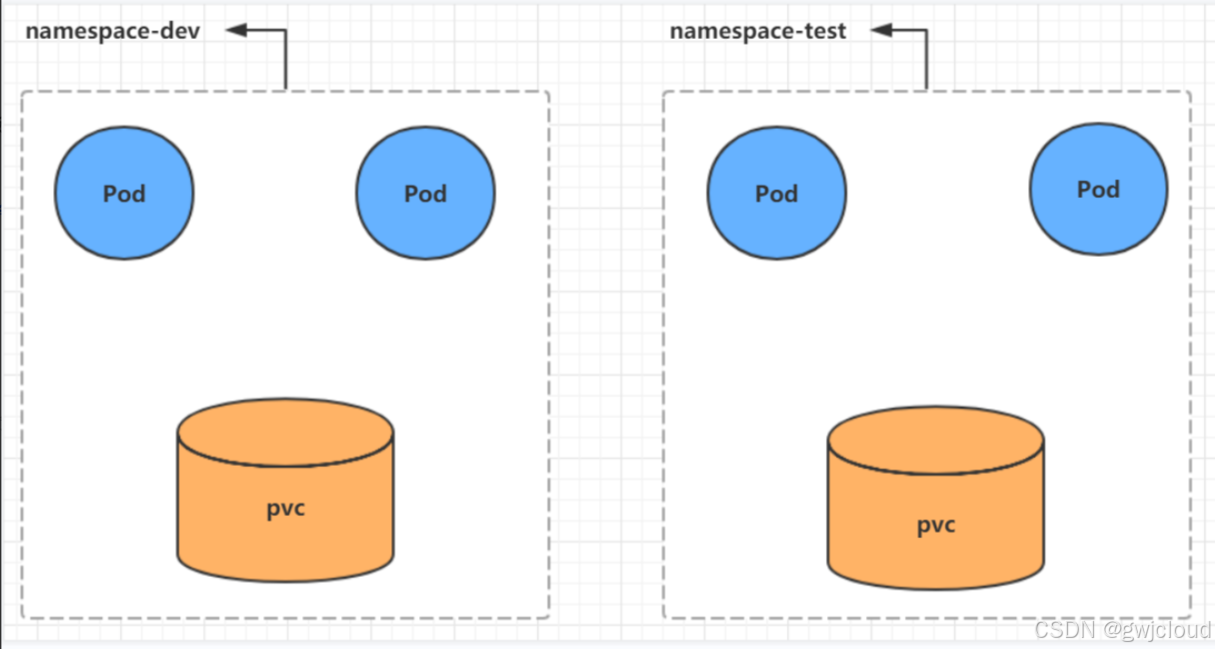

1)NameSpace(命名空间)

Namespace是kubernetes系统中的一种非常重要资源,它的主要作用是用来实现多套环境的资源隔离 或者多租户的资源隔离

默认情况下,kubernetes集群中的所有的Pod都是可以相互访问的。但是在实际中,可能不想让两个Pod之间进行互相的访问,那此时就可以将两个Pod划分到不同的namespace下。kubernetes通过将集群内部的资源分配到不同的Namespace中,可以形成逻辑上的"组",以方便不同的组的资源进行隔离使用和管理。

可以通过kubernetes的授权机制,将不同的namespace交给不同租户进行管理,这样就实现了多租户的资源隔离。此时还能结合kubernetes的资源配额机制,限定不同租户能占用的资源,例如CPU使用量、内存使用量等等,来实现租户可用资源的管理。

Kubernetes使用命名空间的概念帮助解决集群中在管理对象时的复杂性问题。命名空间允许将对象分组到一起,便于将它们作为一个单元进行筛选和控制。无论是应用自定义的访问控制策略,还是为了测试环境而分离所有组件,命名空间都是一个按照组来处理对象、强大且灵活的概念。

# Kubernetes在集群启动之后,会默认创建几个NameSpace

[root@k8s-master01 ~]# kubectl get ns

NAME STATUS AGE

default Active 2d2h

kube-node-lease Active 2d2h

kube-public Active 2d2h

kube-system Active 2d2h

说明:

default # 所有未指定Namespace的对象都会被分配在default命名空间

kube-node-lease # 集群节点之间的心跳维护,v1.13开始引入

kube-public # 此命名空间下的资源可以被所有人访问(包括未认证用户)

kube-system # 所有由Kubernetes系统创建的资源都处于这个命名空间

#查看指定的命名空间

kubectl get ns default

#查看所有命名空间的pod

kubectl get pod -A

#查看指定命名空间的指定格式(kubernetes支持的格式有很多,比较常见的是wide、json、yaml)

kubectl get ns default -o yaml

#查看命名空间的详细信息

[root@k8s-master01 ~]# kubectl describe ns default

Name: default

Labels: kubernetes.io/metadata.name=default

Annotations: <none>

Status: Active

No resource quota.

No LimitRange resource.

[root@k8s-master01 ~]# kubectl describe ns default

Name: default

Labels: kubernetes.io/metadata.name=default

Annotations: <none>

Status: Active

No resource quota.

No LimitRange resource.

说明:

# Active 命名空间正在使用中 Terminating 正在删除命名空间

# ResourceQuota 针对namespace做的资源限制

# LimitRange针对namespace中的每个组件做的资源限制

#创建命名空间

kubectl create ns ocloud

#删除命名空间

kubectl delete ns ocloud

注意:删除一个namespace会自动删除所有属于该namespace的资源。

default和kube-system命名空间不可删除。

#切换默认的命名空间

kubectl config set-context --current --namespace=kube-system

说明:切换命名空间后,kubectl get pods 如果不指定-n,查看的就是kube-system命名空间的资源了。

#查看那些资源属于命名空间级别的

kubectl api-resources --namespaced=true2)Label(标签)和Selector(标签选择器)

Label是kubernetes系统中的一个重要概念。它的作用就是在资源上添加标识,用来对它们进行区分和选择。

Label的特点:

- 一个Label会以key/value键值对的形式附加到各种对象上,如Node、Pod、Service等等

- 一个资源对象可以定义任意数量的Label ,同一个Label也可以被添加到任意数量的资源对象上去

- Label通常在资源对象定义时确定,当然也可以在对象创建后动态添加或者删除

可以通过Label实现资源的多维度分组,以便灵活、方便地进行资源分配、调度、配置、部署等管理工作。

一些常用的Label 示例如下:

- 版本标签:"version":"release", "version":"stable"......

- 环境标签:"environment":"dev","environment":"test","environment":"pro"

- 架构标签:"tier":"frontend","tier":"backend"

标签定义完毕之后,还要考虑到标签的选择,这就要使用到Label Selector ,即:

Label用于给某个资源对象定义标识

Label Selector用于查询和筛选拥有某些标签的资源对象

当前有两种Label Selector:

- 基于等式的Label Selectorname = slave: 选择所有包含Label中key="name"且value="slave"的对象env != production: 选择所有包括Label中的key="env"且value不等于"production"的对象

- 基于集合的Label Selectorname in (master, slave): 选择所有包含Label中的key="name"且value="master"或"slave"的对象name not in (frontend): 选择所有包含Label中的key="name"且value不等于"frontend"的对象

标签的选择条件可以使用多个,此时将多个Label Selector进行组合,使用逗号","进行分隔即可。例如:

name=slave,env!=production

name not in (frontend),env!=production

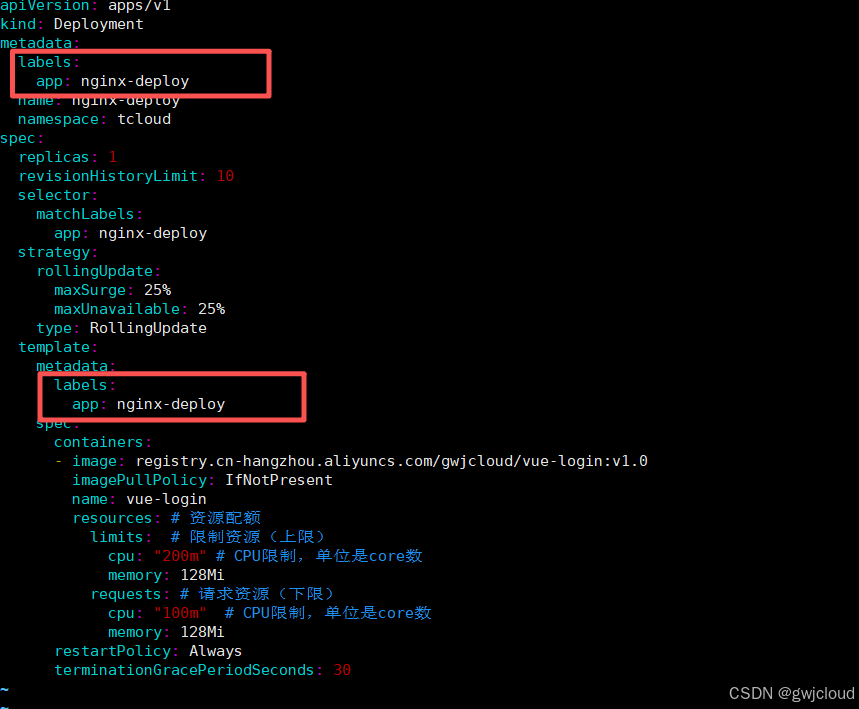

意思是:所有由这个 Deployment 创建的 Pod,都会带上 app: nginx-deploy 标签。

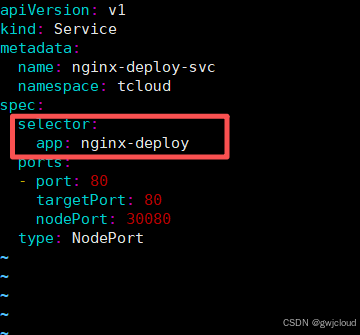

看service文件

意思是:Service 会自动找到集群中所有带 app: nginx-deploy 标签的 Pod,是pod而不是deployment,并把流量转发给它们。

#为pod资源打标签

[root@k8s-master01 ~]# kubectl label pod busybox version=1.

#查看pod资源的标签

[root@k8s-master01 ~]# kubectl get pod busybox --show-labels

NAME READY STATUS RESTARTS AGE LABELS

busybox 1/1 Running 9 (33m ago) 2d16h version=1.0

#更换pod资源的标签

[root@k8s-master01 ~]# kubectl label pod busybox version=2.0 --overwrite

#查看pod资源的标签

[root@k8s-master01 ~]# kubectl get pod busybox --show-labels

NAME READY STATUS RESTARTS AGE LABELS

busybox 1/1 Running 9 (34m ago) 2d16h version=2.0

#筛选标签

[root@k8s-master01 ~]# kubectl get pod -l version=2.0 --show-labels

NAME READY STATUS RESTARTS AGE LABELS

busybox 1/1 Running 9 (34m ago) 2d16h version=2.0

#删除标签

[root@k8s-master01 ~]# kubectl label pod busybox version-3)pod

什么是pod

Pod是Kubernetes中能够创建和部署的最小单元,是Kubernetes集群中的一个应用实例,总是部署在同一个节点node上。Pod中包含了一个或多个容器,还包括了存储、网络等各个容器共享的资源。Pod支持多种容器环境,Docker则是最流行的容器环境。

Pod并不提供保证正常运行的能力,因为可能遭受Node节点的物理故障、网络分区等等的影响,整体的高可用是Kubernetes集群通过在集群内调度Node来实现的。通常情况下我们不要直接创建Pod,一般都是通过Controller来进行管理,但是了解Pod对于我们熟悉控制器非常有好处。

pod资源清单

apiVersion: v1 #必选,版本号,例如v1

kind: Pod #必选,资源类型,例如 Pod

metadata: #必选,元数据

name: string #必选,Pod名称

namespace: string #Pod所属的命名空间,默认为"default"

labels: #自定义标签列表

- name: string

spec: #必选,Pod中容器的详细定义

containers: #必选,Pod中容器列表

- name: string #必选,容器名称

image: string #必选,容器的镜像名称

imagePullPolicy: [ Always|Never|IfNotPresent ] #获取镜像的策略

command: [string] #容器的启动命令列表,如不指定,使用打包时使用的启动命令

args: [string] #容器的启动命令参数列表

workingDir: string #容器的工作目录

volumeMounts: #挂载到容器内部的存储卷配置

- name: string #引用pod定义的共享存储卷的名称,需用volumes[]部分定义的的卷名

mountPath: string #存储卷在容器内mount的绝对路径,应少于512字符

readOnly: boolean #是否为只读模式

ports: #需要暴露的端口库号列表

- name: string #端口的名称

containerPort: int #容器需要监听的端口号

hostPort: int #容器所在主机需要监听的端口号,默认与Container相同

protocol: string #端口协议,支持TCP和UDP,默认TCP

env: #容器运行前需设置的环境变量列表

- name: string #环境变量名称

value: string #环境变量的值

resources: #资源限制和请求的设置

limits: #资源限制的设置

cpu: string #Cpu的限制,单位为core数,将用于docker run --cpu-shares参数

memory: string #内存限制,单位可以为Mib/Gib,将用于docker run --memory参数

requests: #资源请求的设置

cpu: string #Cpu请求,容器启动的初始可用数量

memory: string #内存请求,容器启动的初始可用数量

lifecycle: #生命周期钩子

postStart: #容器启动后立即执行此钩子,如果执行失败,会根据重启策略进行重启

preStop: #容器终止前执行此钩子,无论结果如何,容器都会终止

livenessProbe: #对Pod内各容器健康检查的设置,当探测无响应几次后将自动重启该容器

exec: #对Pod容器内检查方式设置为exec方式

command: [string] #exec方式需要制定的命令或脚本

httpGet: #对Pod内个容器健康检查方法设置为HttpGet,需要制定Path、port

path: string

port: number

host: string

scheme: string

HttpHeaders:

- name: string

value: string

tcpSocket: #对Pod内个容器健康检查方式设置为tcpSocket方式

port: number

initialDelaySeconds: 0 #容器启动完成后首次探测的时间,单位为秒

timeoutSeconds: 0 #对容器健康检查探测等待响应的超时时间,单位秒,默认1秒

periodSeconds: 0 #对容器监控检查的定期探测时间设置,单位秒,默认10秒一次

successThreshold: 0

failureThreshold: 0

securityContext:

privileged: false

restartPolicy: [Always | Never | OnFailure] #Pod的重启策略

nodeName: <string> #设置NodeName表示将该Pod调度到指定到名称的node节点上

nodeSelector: obeject #设置NodeSelector表示将该Pod调度到包含这个label的node上

imagePullSecrets: #Pull镜像时使用的secret名称,以key:secretkey格式指定

- name: string

hostNetwork: false #是否使用主机网络模式,默认为false,如果设置为true,表示使用宿主机网络

volumes: #在该pod上定义共享存储卷列表

- name: string #共享存储卷名称 (volumes类型有很多种)

emptyDir: {} #类型为emtyDir的存储卷,与Pod同生命周期的一个临时目录。为空值

hostPath: string #类型为hostPath的存储卷,表示挂载Pod所在宿主机的目录

path: string #Pod所在宿主机的目录,将被用于同期中mount的目录

secret: #类型为secret的存储卷,挂载集群与定义的secret对象到容器内部

scretname: string

items:

- key: string

path: string

configMap: #类型为configMap的存储卷,挂载预定义的configMap对象到容器内部

name: string

items:

- key: string

path: stringpod状态以及pod故障排查

| Pod 状态 | 中文含义 | 常见原因 | 快速排查命令 |

|---|---|---|---|

| Pending | 等待调度 | 1. 资源不足(CPU / 内存)2. 节点有污点没容忍3. PV/PVC 没准备好4. 节点下线 | kubectl describe pod <pod-name>看 Events 部分 |

| ContainerCreating | 容器创建中 | 1. 镜像拉取慢 / 失败2. 网络插件异常3. 存储挂载卡住 | kubectl describe pod <pod-name>``journalctl -u kubelet |

| ImagePullBackOff | 镜像拉取失败 | 1. 镜像地址错2. 私有仓库没认证3. 网络不通、镜像不存在 | kubectl describe pod <pod-name>检查镜像地址、权限、网络 |

| ErrImagePull | 拉镜像出错 | 同上,比 ImagePullBackOff 更早 | 同上 |

| Running | 正常运行 | 服务正常 | kubectl logs <pod-name>``kubectl exec -it <pod-name> -- sh |

| Completed | 正常退出 | 容器执行完命令退出(如脚本、job) | 正常状态,无需处理 |

| CrashLoopBackOff | 反复崩溃重启 | 1. 应用启动失败2. 配置错误3. 端口被占用4. 权限不足 | kubectl logs <pod-name>``kubectl logs <pod-name> --previous |

| Terminating | 正在删除 | 1. 容器无法优雅退出2. 挂载盘卡住3. 网络插件异常 | 等 30 秒 或 强制删除:kubectl delete pod <pod-name> --force --grace-period=0 |

| Unknown | 状态未知 | 1. 节点失联2. kubelet 挂了3. 网络不通 | 看节点状态:kubectl get nodes登录节点看 kubelet |

| Evicted | 被驱逐 | 节点磁盘 / 内存 / 资源满了 | 清理节点资源,重新调度 |

| OOMKilled | 内存溢出被杀 | 内存不足、程序内存泄漏 | kubectl describe pod <pod-name>加大内存限制 |

| Init:Error | Init 容器失败 | Init 容器执行错误 | kubectl logs <pod-name> -c <init容器名> |

| PodInitializing | 初始化中 | Init 容器还在运行 / 卡住 | kubectl describe pod <pod-name> |

pod镜像拉取策略

| 策略名称 | 含义 | 触发条件 / 默认规则 | 适用场景 |

|---|---|---|---|

| IfNotPresent | 节点本地已有镜像就不拉,本地没有才拉取 | • 默认规则 :镜像 tag 是具体版本号 (如 nginx:1.15.12)默认策略 = IfNotPresent |

・内网环境・私有仓库・稳定版本,不想每次都拉取 |

| Always | 每次创建 / 重启容器都重新拉取镜像,不管本地有没有 | • 默认规则 :镜像 tag 是 latest (如 nginx:latest)默认策略 = Always |

・测试环境・镜像经常更新・确保用最新版本 |

| Never | 永远不从仓库拉取镜像,只使用本地镜像 | 必须手动写明 | ・完全离线环境・禁止访问外部仓库 |

# 先用kubectl run命令生成一个简单的yaml文件

[root@k8s-master01 yaml]# kubectl run login-nginx --image=swr.cn-north-4.myhuaweicloud.com/ddn-k8s/docker.io/library/nginx:1.15.12 -o yaml --dry-run > nginx.yaml

# 创建tcloud命名空间

[root@k8s-master01 yaml]# kubectl create ns tcloud

[root@k8s-master01 yaml]# vim nginx.yaml

apiVersion: v1

kind: Pod

metadata:

labels:

run: login-nginx

name: login-nginx

namespace: tcloud

spec:

containers:

- image: swr.cn-north-4.myhuaweicloud.com/ddn-k8s/docker.io/library/nginx:latest

name: login-nginx

imagePullPolicy: IfNotPresent

# 部署pod

[root@k8s-master01 yaml]# kubectl apply -f nginx.yaml pod生命周期

pod对象从创建至终的这段时间范围称为pod的生命周期,它主要包含下面的过程:

- pod创建过程

- 运行初始化容器(init container)过程

- 运行主容器(main container)

- 容器启动后钩子(post start)、容器终止前钩子(pre stop)

- 容器的存活性探测(liveness probe)、就绪性探测(readiness probe)

- pod终止过程

在整个生命周期中,Pod会出现5种状态(相位),分别如下:

- 挂起(Pending):apiserver已经创建了pod资源对象,但它尚未被调度完成或者仍处于下载镜像的过程中

- 运行中(Running):pod已经被调度至某节点,并且所有容器都已经被kubelet创建完成

- 成功(Succeeded):pod中的所有容器都已经成功终止并且不会被重启

- 失败(Failed):所有容器都已经终止,但至少有一个容器终止失败,即容器返回了非0值的退出状态

- 未知(Unknown):apiserver无法正常获取到pod对象的状态信息,通常由网络通信失败所导致

创建和终止

pod创建过程:

1、用户通过kubectl或其他api客户端提交需要创建的pod信息给apiServer

2、apiServer开始生成pod对象的信息,并将信息存入etcd,然后返回确认信息至客户端

3、apiServer开始反映etcd中的pod对象的变化,其它组件使用watch机制来跟踪检查apiServer上的变动

4、scheduler发现有新的pod对象要创建,开始为Pod分配主机并将结果信息更新至apiServer

5、node节点上的kubelet发现有pod调度过来,尝试调用docker启动容器,并将结果回送至apiServer

6、apiServer将接收到的pod状态信息存入etcd中

pod的终止过程:

1、用户向apiServer发送删除pod对象的命令

2、apiServcer中的pod对象信息会随着时间的推移而更新,在宽限期内(默认30s),pod被视为dead

3、将pod标记为terminating状态

4、kubelet在监控到pod对象转为terminating状态的同时启动pod关闭过程

5、端点控制器监控到pod对象的关闭行为时将其从所有匹配到此端点的service资源的端点列表中移除

6、如果当前pod对象定义了preStop钩子处理器,则在其标记为terminating后即会以同步的方式启动执行

7、pod对象中的容器进程收到停止信号

8、宽限期结束后,若pod中还存在仍在运行的进程,那么pod对象会收到立即终止的信号

9、kubelet请求apiServer将此pod资源的宽限期设置为0从而完成删除操作,此时pod对于用户已不可见

pod钩子函数

| 钩子名称 | 执行时机 | 作用 | 特点 |

|---|---|---|---|

| postStart | 容器创建成功后、启动命令执行同时(不保证顺序) | 做初始化、预热、配置修改 | 执行失败会导致容器重启 |

| preStop | 容器收到删除 / 终止信号后、真正被杀前 | 优雅关闭、保存数据、注销服务、发通知 | 会阻塞删除,执行完才删容器 |

钩子函数有3种实现方式

| 实现方式 | 写法 | 作用 | 适用场景 |

|---|---|---|---|

| 1. exec 执行命令 | exec: |

在容器内部执行一条 Linux 命令 | 99% 场景都用这个(最常用) |

| 2. httpGet 请求 | httpGet: |

向容器发送一个 HTTP GET 请求 | 给应用发一个优雅关闭接口 |

| 3. tcpSocket | tcpSocket: |

尝试连接容器端口(极少用) | 几乎不用,了解即可 |

1、exec命令:在容器内执行一次命令

......

lifecycle:

postStart:

exec:

command:

- cat

- /tmp/healthy

......

2、TCPSocket:在当前容器尝试访问指定的socket

......

lifecycle:

postStart:

tcpSocket:

port: 8080

......

3、HTTPGet:在当前容器中向某url发起http请求

......

lifecycle:

postStart:

httpGet:

path: / #URI地址

port: 80 #端口号

host: 192.168.5.3 #主机地址

scheme: HTTP #支持的协议,http或者https

......使用案例

[root@k8s-master01 yaml]# vim nginx.yaml

apiVersion: v1

kind: Pod

metadata:

name: pod-hook-exec

namespace: tcloud

spec:

containers:

- name: main-container

image: swr.cn-north-4.myhuaweicloud.com/ddn-k8s/docker.io/library/nginx:latest

imagePullPolicy: IfNotPresent

ports:

- name: nginx-port

containerPort: 80

lifecycle:

postStart:

exec:

command: ["/bin/sh", "-c", "echo 'pod started by postStart hook' > /usr/share/nginx/html/index.html"]

preStop:

exec:

command:

- "/bin/sh"

- "-c"

- |

echo "开始执行优雅下线..." >> /var/log/stop.log

sleep 3 # 等待流量切走,避免5xx

nginx -s quit # 优雅停止 Nginx

echo "容器已正常停止" >> /var/log/stop.log

# 创建pod

[root@k8s-master01 yaml]# kubectl apply -f nginx.yaml

# 访问测试

[root@k8s-master01 ~]# curl 10.244.195.3

pod started by postStart hookpod重启策略

| 重启策略 | 说明 | 触发重启的场景 | 不会重启的场景 | 适用场景 | 默认值 |

| Always | 容器退出总是重启 | 容器正常退出 (exit 0)容器异常退出 (exit≠0)容器被 OOM 杀死 | 无,只要停止就会重启 | 长期运行服务:Nginx、Vue、Java、MySQL 等 | 默认值 |

| OnFailure | 只有异常退出才重启 | exit≠0、OOM、程序崩溃 | 正常退出 (exit 0) | 定时任务、脚本、批处理、Job | - |

| Never | 永远不重启 | 任何情况都不重启 | 所有退出场景 | 一次性任务、调试 Pod、不希望自动恢复 | - |

|---|

pod探针(健康检查)

容器探测用于检测容器中的应用实例是否正常工作,是保障业务可用性的一种传统机制。如果经过探测,实例的状态不符合预期,那么kubernetes就会把该问题实例" 摘除 ",不承担业务流量。kubernetes提供了三种探针来实现容器探测,分别是:

| 探针名称 | 英文 | 作用 | 检测时机 | 典型配置 |

|---|---|---|---|---|

| 就绪探针 | ReadinessProbe |

判断服务是否就绪未就绪:Service 不转发流量 | 容器运行全程,周期性检测 | httpGet、tcpSocket、exec |

| 存活探针 | LivenessProbe |

判断容器是否活着死了 / 卡死:kubelet 重启容器 | 容器运行全程,周期性检测 | httpGet、tcpSocket、exec |

| 启动探针 | StartupProbe |

判断应用是否启动完成启动失败:重启容器启动成功:才交给前两个探针 | 只在启动阶段检测 | httpGet、tcpSocket、exec |

这几种探针都有3种实现方式exec、httpGet、tcpSocket

# exec命令:在容器内执行一次命令,如果命令执行的退出码为0,则认为程序正常,否则不正常

......

livenessProbe:

exec:

command:

- cat

- /tmp/healthy

......

# TCPSocket:将会尝试访问一个用户容器的端口,如果能够建立这条连接,则认为程序正常,否则不正常

......

livenessProbe:

tcpSocket:

port: 8080

......

# HTTPGet:调用容器内Web应用的URL,如果返回的状态码在200和399之间,则认为程序正常,否则不正常

......

livenessProbe:

httpGet:

path: / #URI地址

port: 80 #端口号

host: 127.0.0.1 #主机地址

scheme: HTTP #支持的协议,http或者https

......startupProbe(启动探针)

# HTTPGet方式

[root@k8s-master01 yaml]# vim nginx.yaml

apiVersion: v1

kind: Pod

metadata:

name: nginx-demo

labels:

type: app

namespace: tcloud

spec:

containers:

- name: nginx

image: swr.cn-north-4.myhuaweicloud.com/ddn-k8s/docker.io/library/nginx:latest

imagePullPolicy: IfNotPresent

ports:

- name: http

containerPort: 80

protocol: TCP

startupProbe:

httpGet:

path: /index.html

port: 80

initialDelaySeconds: 0

timeoutSeconds: 5

periodSeconds: 10

successThreshold: 1

failureThreshold: 3

restartPolicy: OnFailure我们去用http的去访问index.html文件,但是生成环境不能这样去做,index.html只是一个静态文件,不能去真正代表服务存活

生产标准做法:必须用专门健康检查接口

Spring Boot → /actuator/health

Go/Python/Node → /health

微服务网关 → /health/check

# 构建pod

[root@k8s-master01 yaml]# kubectl apply -f nginx.yaml

# 查看详细信息

[root@k8s-master01 yaml]# kubectl describe pod nginx-demo -n tcloud

...

Startup: http-get http://:80/index.html delay=0s timeout=5s period=10s #success=1 #failure=3

说明:

方式:HTTP GET

地址:http://:80/index.html

延迟:0s

超时:5s

周期:10s

成功阈值:1

失败阈值:3

# TCPSocket方式

[root@k8s-master01 yaml]# vim nginx.yaml

apiVersion: v1

kind: Pod

metadata:

name: nginx-demo

labels:

type: app

namespace: tcloud

spec:

containers:

- name: nginx

image: swr.cn-north-4.myhuaweicloud.com/ddn-k8s/docker.io/library/nginx:latest

imagePullPolicy: IfNotPresent

ports:

- name: http

containerPort: 80

protocol: TCP

startupProbe:

tcpSocket:

port: 80

initialDelaySeconds: 0

timeoutSeconds: 5

periodSeconds: 10

successThreshold: 1

failureThreshold: 3

restartPolicy: OnFailure

# 构建pod

[root@k8s-master01 yaml]# kubectl apply -f nginx.yaml

# 查看详细信息

[root@k8s-master01 yaml]# kubectl describe pod nginx-demo -n tcloud

...

Startup: tcp-socket :80 delay=0s timeout=5s period=10s #success=1 #failure=3

# exec方式

[root@k8s-master01 yaml]# vim nginx.yaml

apiVersion: v1

kind: Pod

metadata:

name: nginx-demo

labels:

type: app

namespace: tcloud

spec:

containers:

- name: nginx

image: swr.cn-north-4.myhuaweicloud.com/ddn-k8s/docker.io/library/nginx:latest

imagePullPolicy: IfNotPresent

ports:

- name: http

containerPort: 80

protocol: TCP

startupProbe:

exec:

command:

- sh

- -c

- "echo success > /inited"

initialDelaySeconds: 0

timeoutSeconds: 5

periodSeconds: 10

successThreshold: 1

failureThreshold: 3

restartPolicy: OnFailure

# 构建pod

[root@k8s-master01 yaml]# kubectl apply -f nginx.yaml

# 查看详细信息

[root@k8s-master01 yaml]# kubectl describe pod nginx-demo -n tcloud

...

Startup: exec [sh -c echo success > /inited] delay=0s timeout=5s period=10s #success=1 #failure=3

[root@k8s-master01 yaml]# kubectl exec -it nginx-demo -n tcloud -- cat /inited

successLivenessProbe(存活探针)

[root@k8s-master01 yaml]# vim nginx.yaml

apiVersion: v1

kind: Pod

metadata:

name: nginx-demo

labels:

type: app

namespace: tcloud

spec:

containers:

- name: nginx

image: swr.cn-north-4.myhuaweicloud.com/ddn-k8s/docker.io/library/nginx:latest

imagePullPolicy: IfNotPresent

ports:

- name: http

containerPort: 80

protocol: TCP

startupProbe:

exec:

command:

- sh

- -c

- "echo success > /inited"

initialDelaySeconds: 0

timeoutSeconds: 5

periodSeconds: 10

successThreshold: 1

failureThreshold: 3

livenessProbe:

httpGet:

path: /index.html

port: 80

timeoutSeconds: 5

periodSeconds: 10

successThreshold: 1

failureThreshold: 3

restartPolicy: OnFailure

# 构建pod后看详细信息

[root@k8s-master01 yaml]# kubectl describe pod -n tcloud nginx-demo

...

Liveness: http-get http://:80/index.html delay=0s timeout=5s period=10s #success=1 #failure=3

Startup: exec [sh -c echo success > /inited] delay=0s timeout=5s period=10s #success=1 #failure=3

Environment: <none>ReadinessProbe(就绪探针)

[root@k8s-master01 yaml]# vim nginx.yaml

apiVersion: v1

kind: Pod

metadata:

name: nginx-demo

labels:

type: app

namespace: tcloud

spec:

containers:

- name: nginx

image: swr.cn-north-4.myhuaweicloud.com/ddn-k8s/docker.io/library/nginx:latest

imagePullPolicy: IfNotPresent

ports:

- name: http

containerPort: 80

protocol: TCP

startupProbe:

exec:

command:

- sh

- -c

- "echo success > /inited"

initialDelaySeconds: 0

timeoutSeconds: 5

periodSeconds: 10

successThreshold: 1

failureThreshold: 3

readinessProbe:

httpGet:

path: /index.html

port: 80

timeoutSeconds: 5

periodSeconds: 10

successThreshold: 1

failureThreshold: 3

restartPolicy: OnFailure

# 构建pod查看详细信息

[root@k8s-master01 yaml]# kubectl describe pod -n tcloud nginx-demo

...

Readiness: http-get http://:80/index.html delay=0s timeout=5s period=10s #success=1 #failure=3

Startup: exec [sh -c echo success > /inited] delay=0s timeout=5s period=10s #success=1 #failure=3三、资源调度

Pod是kubernetes的最小管理单元,在kubernetes中,按照pod的创建方式可以将其分为两类:

- 自主式pod:kubernetes直接创建出来的Pod,这种pod删除后就没有了,也不会重建

- 控制器创建的pod:kubernetes通过控制器创建的pod,这种pod删除了之后还会自动重建

什么是Pod控制器

Pod控制器是管理pod的中间层,使用Pod控制器之后,只需要告诉Pod控制器,想要多少个什么样的Pod就可以了,它会创建出满足条件的Pod并确保每一个Pod资源处于用户期望的目标状态。如果Pod资源在运行中出现故障,它会基于指定策略重新编排Pod。

在kubernetes中,有很多类型的pod控制器,每种都有自己的适合的场景,常见的有下面这些:

- ReplicationController:比较原始的pod控制器,已经被废弃,由ReplicaSet替代

- ReplicaSet:保证副本数量一直维持在期望值,并支持pod数量扩缩容,镜像版本升级

- Deployment:通过控制ReplicaSet来控制Pod,并支持滚动升级、回退版本

- Horizontal Pod Autoscaler:可以根据集群负载自动水平调整Pod的数量,实现削峰填谷

- DaemonSet:在集群中的指定Node上运行且仅运行一个副本,一般用于守护进程类的任务

- Job:它创建出来的pod只要完成任务就立即退出,不需要重启或重建,用于执行一次性任务

- Cronjob:它创建的Pod负责周期性任务控制,不需要持续后台运行

- StatefulSet:管理有状态应用

无状态:

无状态服务不会在本地存储持久化数据.多个服务实例对于同一个用户请求的响应结果是完全一致的.这种多服务实例之间是没有依赖关系,比如web应用,在k8s控制器 中动态启停无状态服务的pod并不会对其它的pod产生影响.有状态:

有状态服务需要在本地存储持久化数据,典型的是分布式数据库的应用,分布式节点实例之间有依赖的拓扑关系.比如,主从关系. 如果K8S停止分布式集群中任 一实例pod,就可能会导致数据丢失或者集群的crash.

1、ReplicaSet

ReplicaSet的主要作用是保证一定数量的pod正常运行,它会持续监听这些Pod的运行状态,一旦Pod发生故障,就会重启或重建。同时它还支持对pod数量的扩缩容和镜像版本的升降级。

ReplicaSet的资源清单文件:

apiVersion: apps/v1 # 版本号

kind: ReplicaSet # 类型

metadata: # 元数据

name: # rs名称

namespace: # 所属命名空间

labels: #标签

controller: rs

spec: # 详情描述

replicas: 3 # 副本数量

selector: # 选择器,通过它指定该控制器管理哪些pod

matchLabels: # Labels匹配规则

app: nginx-pod

matchExpressions: # Expressions匹配规则

- {key: app, operator: In, values: [nginx-pod]}

template: # 模板,当副本数量不足时,会根据下面的模板创建pod副本

metadata:

labels:

app: nginx-pod

spec:

containers:

- name: nginx

image: nginx:1.17.1

ports:

- containerPort: 80

# 编写创建RS控制器的yaml文件

[root@k8s-master01 yaml]# vim replicaset.yaml

apiVersion: apps/v1

kind: ReplicaSet

metadata:

name: rs-nginx

namespace: tcloud

spec:

replicas: 3

selector:

matchLabels:

app: nginx-pod

template:

metadata:

labels:

app: nginx-pod

spec:

containers:

- name: nginx

image: swr.cn-north-4.myhuaweicloud.com/ddn-k8s/docker.io/library/nginx:latest

imagePullPolicy: IfNotPresent

# 创建rs控制器

[root@k8s-master01 yaml]# kubectl apply -f replicaset.yaml

# 查看资源

[root@k8s-master01 yaml]# kubectl get replicasets -n tcloud

NAME DESIRED CURRENT READY AGE

rs-nginx 3 3 3 2m12s

# 查看RS控制器构建出来的pod

[root@k8s-master01 yaml]# kubectl get pod -n tcloud

NAME READY STATUS RESTARTS AGE

rs-nginx-254ln 1/1 Running 0 3m32s

rs-nginx-p8b4c 1/1 Running 0 3m32s

rs-nginx-vjsnm 1/1 Running 0 3m32s

[root@k8s-master01 yaml]#

# 扩容pod的副本数量

[root@k8s-master01 yaml]# kubectl edit rs rs-nginx -n tcloud

# 编辑rs的副本数量,修改spec:replicas: 6即可

# 查看pod的数量

[root@k8s-master01 yaml]# kubectl get pod -n tcloud

NAME READY STATUS RESTARTS AGE

rs-nginx-254ln 1/1 Running 0 5m34s

rs-nginx-c99vm 1/1 Running 0 24s

rs-nginx-hg7x7 1/1 Running 0 24s

rs-nginx-p8b4c 1/1 Running 0 5m34s

rs-nginx-r4g82 1/1 Running 0 24s

rs-nginx-vjsnm 1/1 Running 0 5m34s

# 也可以使用命令实现

[root@k8s-master01 ~]# kubectl scale rs rs-nginx -n tcloud --replicas=3

# 查看pod数量

[root@k8s-master01 ~]# kubectl get pod -n tcloud

NAME READY STATUS RESTARTS AGE

rs-nginx-254ln 1/1 Running 0 6m46s

rs-nginx-p8b4c 1/1 Running 0 6m46s

rs-nginx-vjsnm 1/1 Running 0 6m46s

# 删除其中一个pod数量

[root@k8s-master01 ~]# kubectl delete pod rs-nginx-254ln -n tcloud

# 继续查询pod数量

[root@k8s-master01 ~]# kubectl get pod -n tcloud

NAME READY STATUS RESTARTS AGE

rs-nginx-5fgc6 1/1 Running 0 6s

rs-nginx-p8b4c 1/1 Running 0 7m33s

rs-nginx-vjsnm 1/1 Running 0 7m33s

# 删除RS控制器

[root@k8s-master01 yaml]# kubectl delete -f replicaset.yaml

# 同理这里也可以做镜像的替换和升级。2、Deployment

为了更好的解决服务编排的问题,kubernetes在V1.2版本开始,引入了Deployment控制器。值得一提的是,这种控制器并不直接管理pod,而是通过管理ReplicaSet来简介管理Pod,即:Deployment管理ReplicaSet,ReplicaSet管理Pod。所以Deployment比ReplicaSet功能更加强大。

Deployment一般用于部署公司的无状态服务,这个也是最常用的控制器,因为企业内部现在都是以微服务为主,而微服务实现无状态化也是最佳实践,可以利用Deployment的高级功能做到无缝迁移、自动扩容缩容、自动灾难恢复、键回滚等功能。

创建Deployment

很多情况下我们不知道如何去写yaml文件,可以用命令创建一个deployment用yaml输出到yaml文件种

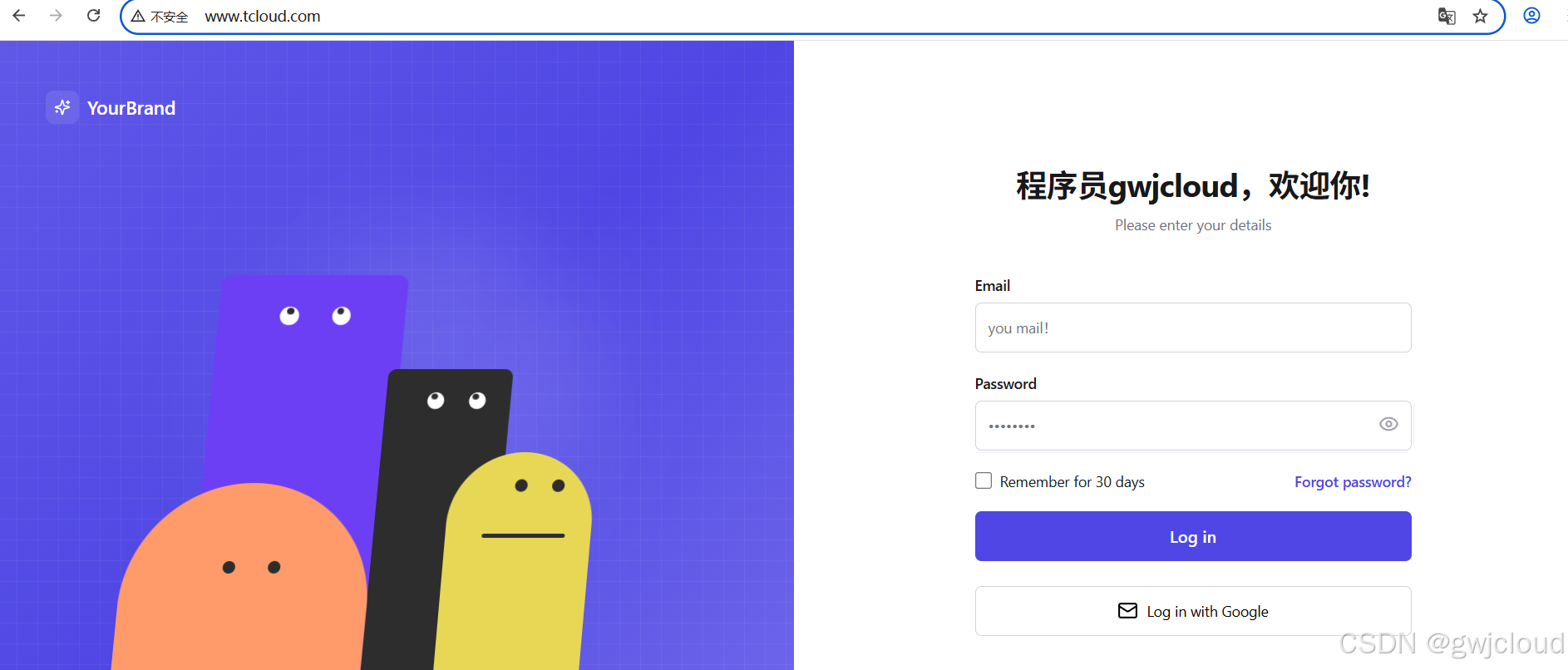

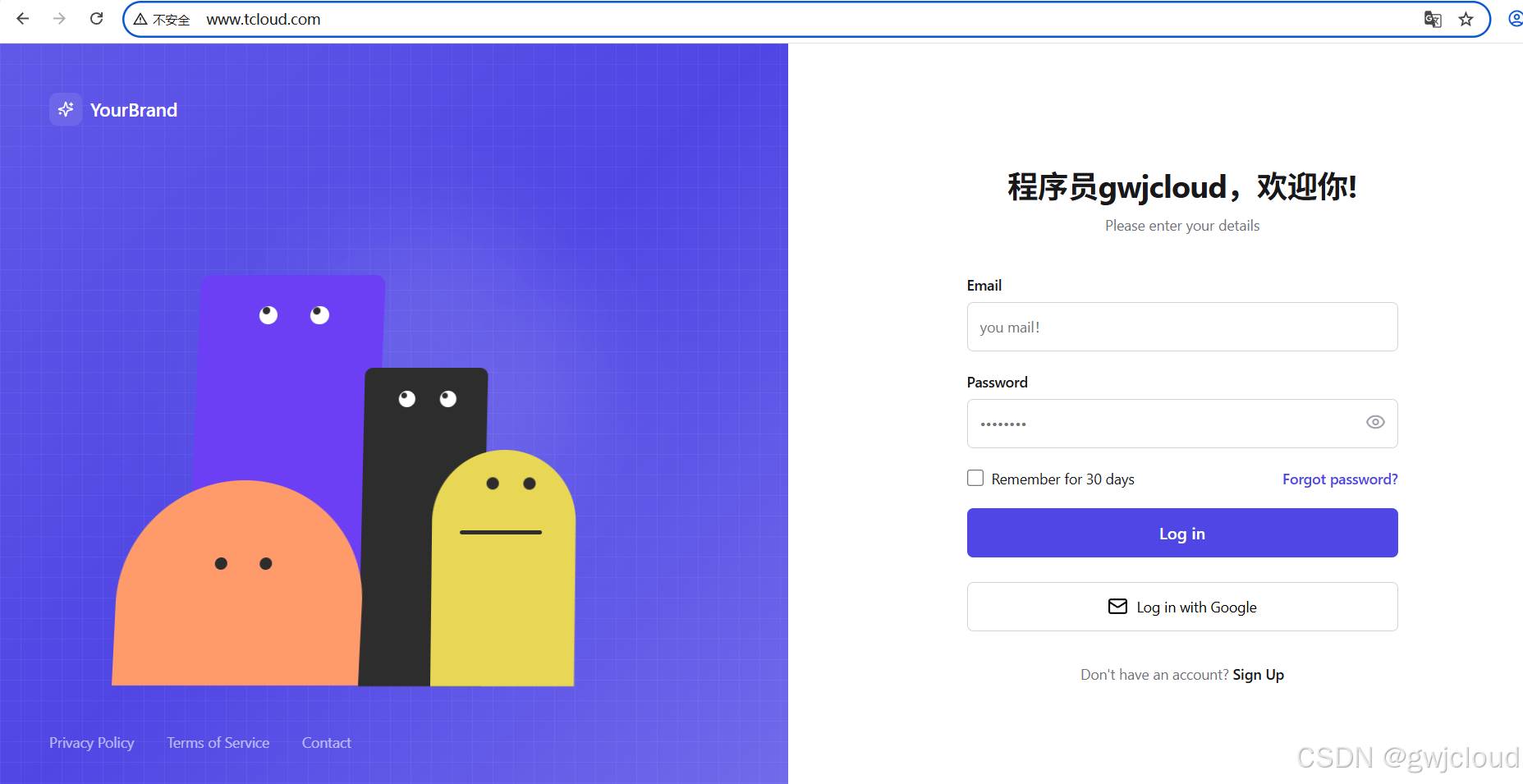

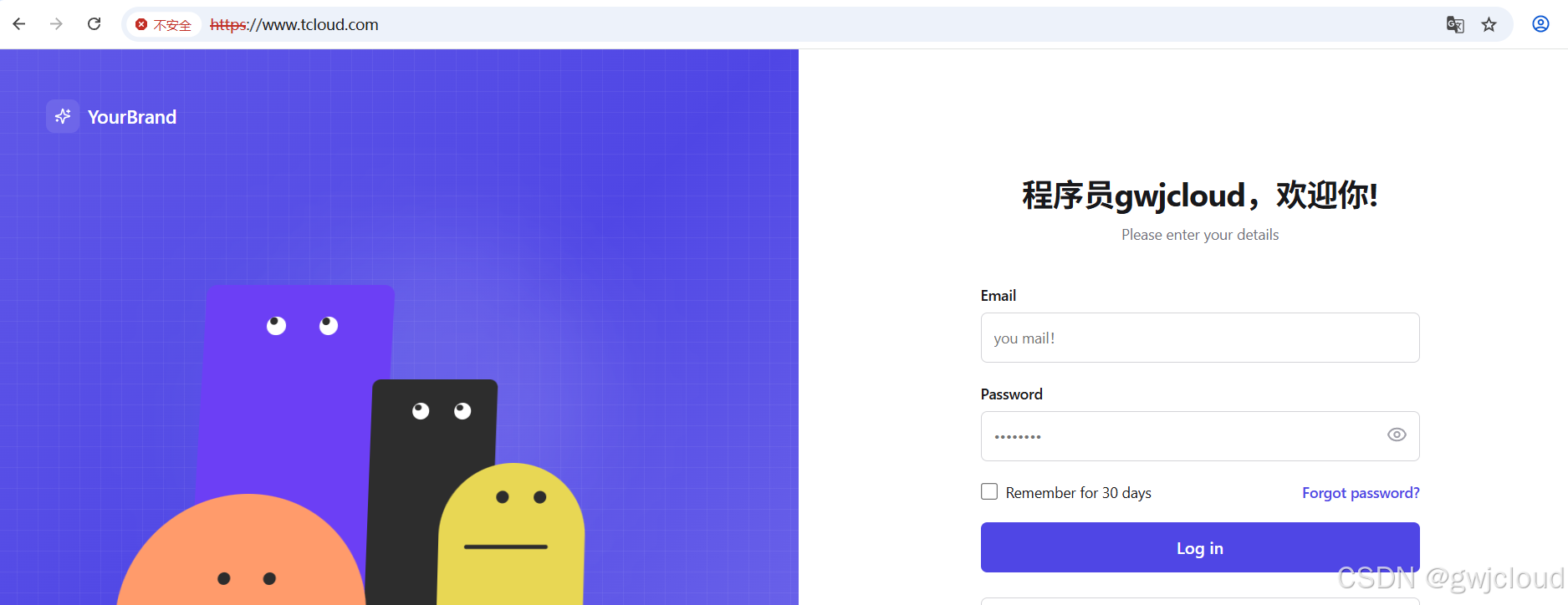

[root@k8s-master01 yaml]# kubectl create deployment nginx-deploy --image=registry.cn-hangzhou.aliyuncs.com/gwjcloud/vue-login:v1.0 -n tcloud

# 查看deploy输出到yaml文件

[root@k8s-master01 yaml]# kubectl get deployments -n tcloud -o yaml > deploy.yaml

# 编辑一下yaml文件,保留需要的配置

[root@k8s-master01 yaml]# vim deploy.yaml

apiVersion: apps/v1

kind: Deployment

metadata:

labels:

app: nginx-deploy

name: nginx-deploy

namespace: tcloud

spec:

replicas: 1

revisionHistoryLimit: 10

selector:

matchLabels:

app: nginx-deploy

strategy:

rollingUpdate:

maxSurge: 25%

maxUnavailable: 25%

type: RollingUpdate

template:

metadata:

labels:

app: nginx-deploy

spec:

containers:

- image: registry.cn-hangzhou.aliyuncs.com/gwjcloud/vue-login:v1.0

imagePullPolicy: IfNotPresent

name: vue-login

restartPolicy: Always

terminationGracePeriodSeconds: 30

apiVersion: apps/v1 # Deployment 资源使用的 API 版本

kind: Deployment # 资源类型:Deployment(用于管理应用 Pod)

metadata: # 资源元数据(名称、标签、命名空间)

labels: # 标签,用于识别和匹配

app: nginx-deploy # 标签键值对:app=nginx-deploy

name: nginx-deploy # Deployment 名称:nginx-deploy

namespace: tcloud # 部署在命名空间 tcloud 下

spec: # Deployment 期望状态配置

replicas: 1 # 运行 1 个 Pod 副本

revisionHistoryLimit: 10 # 保留 10 个历史版本,用于回滚

selector: # 标签选择器,用来找到要管理的 Pod

matchLabels: # 匹配下面的标签

app: nginx-deploy # 匹配标签 app=nginx-deploy

strategy: # 更新策略

rollingUpdate: # 滚动更新配置

maxSurge: 25% # 更新时最多额外启动 25% 副本

maxUnavailable: 25% # 更新时最多不可用 25% 副本

type: RollingUpdate # 更新类型:滚动更新(不停机)

template: # Pod 模板(创建 Pod 用的"模具")

metadata: # Pod 的元数据

labels: # Pod 自带的标签

app: nginx-deploy # Pod 标签 app=nginx-deploy(必须和上面 selector 匹配)

spec: # Pod 内部容器等配置

containers: # 容器列表

- image: registry.cn-hangzhou.aliyuncs.com/gwjcloud/vue-login:v1.0

# 容器使用的镜像(Vue 前端登录项目,不是 nginx)

imagePullPolicy: IfNotPresent

# 镜像拉取策略:本地有就不拉,没有才拉

name: vue-login # 容器名称:vue-login

restartPolicy: Always # Pod 异常退出时总是自动重启

terminationGracePeriodSeconds: 30

# 删除 Pod 时,优雅等待时间 30 秒

# 查看创建的资源

[root@k8s-master01 yaml]# kubectl get pod,rs,deploy -n tcloud --show-labels

NAME READY STATUS RESTARTS AGE LABELS

pod/nginx-deploy-795697b5bb-cd8cd 1/1 Running 0 8s app=nginx-deploy,pod-template-hash=795697b5bb

NAME DESIRED CURRENT READY AGE LABELS

replicaset.apps/nginx-deploy-795697b5bb 1 1 1 8s app=nginx-deploy,pod-template-hash=795697b5bb

NAME READY UP-TO-DATE AVAILABLE AGE LABELS

deployment.apps/nginx-deploy 1/1 1 1 8s app=nginx-deploy扩容Deployment

# 扩缩容变更副本数量为3个

[root@k8s-master01 yaml]# kubectl scale deploy -n tcloud nginx-deploy --replicas=3

# 查看pod

[root@k8s-master01 yaml]# kubectl get pod -n tcloud

NAME READY STATUS RESTARTS AGE

nginx-deploy-795697b5bb-8sfvn 1/1 Running 0 4m44s

nginx-deploy-795697b5bb-cd8cd 1/1 Running 0 13m

nginx-deploy-795697b5bb-f58xq 1/1 Running 0 4m44s

# 也可以使用edit来扩容

[root@k8s-master01 yaml]# kubectl edit deployments -n tcloud nginx-deploy

修改spec:replicas: 5即可

# 查看pod

NAME READY STATUS RESTARTS AGE

nginx-deploy-795697b5bb-8sfvn 1/1 Running 0 6m4s

nginx-deploy-795697b5bb-bssjd 1/1 Running 0 7s

nginx-deploy-795697b5bb-cd8cd 1/1 Running 0 14m

nginx-deploy-795697b5bb-f58xq 1/1 Running 0 6m4s

nginx-deploy-795697b5bb-kkvrc 1/1 Running 0 7s更新Deployment

只有修改了 .spec.template 下面的配置,才会触发 Pod 重建 → 触发 Deployment 更新。

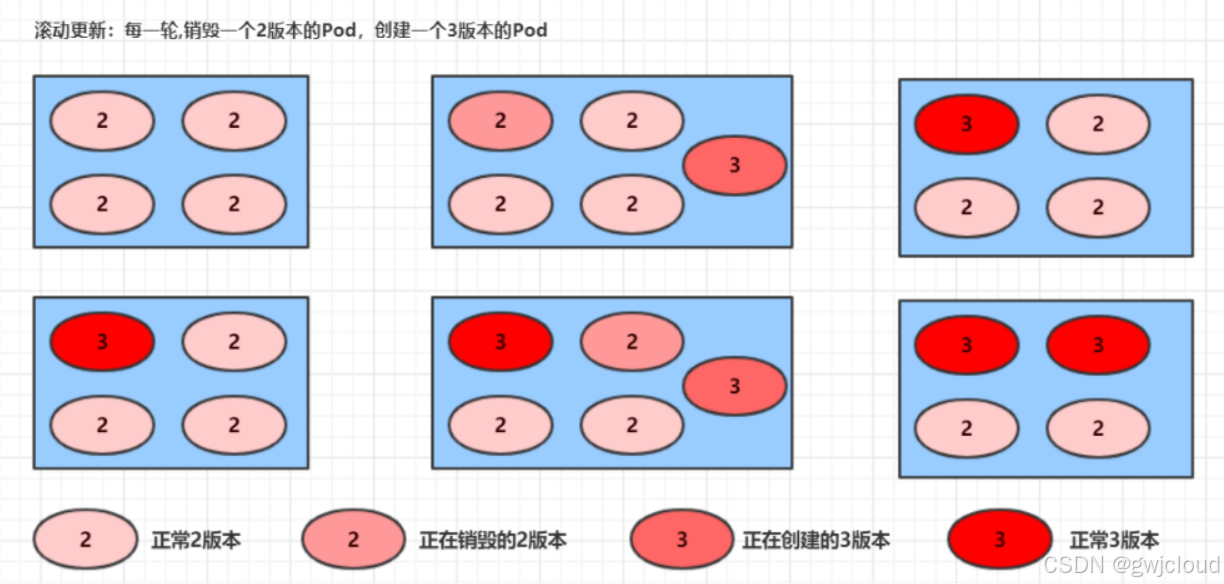

有两种更新方式

滚动更新(RollingUpdate)

- 逐批替换旧 Pod

- 先启动新 Pod → 再销毁旧 Pod

- 业务全程不中断

- 生产环境必须用这个

重建更新(Recreate)

- 停机更新

- 先杀光旧的 → 再起新的

- 会短暂业务不可用

- 适合测试环境、非关键业务

重建更新

# 编辑yaml文件修改为重建更新

[root@k8s-master01 yaml]# vim deploy.yaml

...

spec:

replicas: 3

revisionHistoryLimit: 10

selector:

matchLabels:

app: nginx-deploy

strategy:

#rollingUpdate:

# maxSurge: 25%

# maxUnavailable: 25%

type: Recreate

template:

metadata:

labels:

app: nginx-deploy

...

[root@k8s-master01 yaml]# kubectl apply -f deploy.yaml

# 变更镜像

[root@k8s-master01 yaml]# kubectl set image deployments -n tcloud nginx-deploy vue-login=swr.cn-north-4.myhuaweicloud.com/ddn-k8s/docker.io/library/nginx:latest

# 可以执行kubectl get pod -n dev -w查看升级过程

可以发现重建更新是先杀掉所有的旧的pod,在起新的pod,这样是停机更新,生成环境不能这样去做滚动更新

# 编辑yaml文件修改为重建更新

[root@k8s-master01 yaml]# vim deploy.yaml

...

strategy:

rollingUpdate:

maxSurge: 25%

maxUnavailable: 25%

type: RollingUpdate

template:

metadata:

labels:

...

[root@k8s-master01 yaml]# kubectl apply -f deploy.yaml

# 更改镜像

[root@k8s-master01 yaml]# kubectl set image deployments -n tcloud nginx-deploy vue-login=registry.cn-hangzhou.aliyuncs.com/gwjcloud/vue-login:v1.0

# 查看更新过程

[root@k8s-master01 yaml]# kubectl get pod -n tcloud -w

NAME READY STATUS RESTARTS AGE

nginx-deploy-bb6447776-6xfv8 1/1 Running 0 11s

nginx-deploy-bb6447776-cxvzp 1/1 Running 0 10s

nginx-deploy-bb6447776-qqg2s 1/1 Running 0 11s

nginx-deploy-795697b5bb-jz75d 0/1 Pending 0 0s

nginx-deploy-795697b5bb-jz75d 0/1 Pending 0 0s

nginx-deploy-795697b5bb-jz75d 0/1 ContainerCreating 0 0s

nginx-deploy-795697b5bb-jz75d 1/1 Running 0 1s

nginx-deploy-bb6447776-cxvzp 1/1 Terminating 0 16s

nginx-deploy-795697b5bb-pv5fp 0/1 Pending 0 0s

nginx-deploy-bb6447776-cxvzp 1/1 Terminating 0 16s

nginx-deploy-795697b5bb-pv5fp 0/1 Pending 0 0s

nginx-deploy-795697b5bb-pv5fp 0/1 ContainerCreating 0 0s

nginx-deploy-bb6447776-cxvzp 0/1 Completed 0 16s

nginx-deploy-bb6447776-cxvzp 0/1 Completed 0 17s

nginx-deploy-bb6447776-cxvzp 0/1 Completed 0 17s

nginx-deploy-795697b5bb-pv5fp 1/1 Running 0 1s

nginx-deploy-bb6447776-qqg2s 1/1 Terminating 0 18s

nginx-deploy-795697b5bb-8wbjs 0/1 Pending 0 0s

nginx-deploy-795697b5bb-8wbjs 0/1 Pending 0 0s

nginx-deploy-bb6447776-qqg2s 1/1 Terminating 0 18s

nginx-deploy-795697b5bb-8wbjs 0/1 ContainerCreating 0 0s

nginx-deploy-bb6447776-qqg2s 0/1 Completed 0 18s

nginx-deploy-bb6447776-qqg2s 0/1 Completed 0 19s

nginx-deploy-bb6447776-qqg2s 0/1 Completed 0 19s

nginx-deploy-795697b5bb-8wbjs 1/1 Running 0 2s

nginx-deploy-bb6447776-6xfv8 1/1 Terminating 0 20s

nginx-deploy-bb6447776-6xfv8 1/1 Terminating 0 20s

nginx-deploy-bb6447776-6xfv8 0/1 Completed 0 20s

nginx-deploy-bb6447776-6xfv8 0/1 Completed 0 21s

nginx-deploy-bb6447776-6xfv8 0/1 Completed 0 21s

可以看到是逐批替换旧Pod,我们也可以看详细信息

[root@k8s-master01 yaml]# kubectl describe deployments -n tcloud nginx-deploy

Events:

Type Reason Age From Message

---- ------ ---- ---- -------

Normal ScalingReplicaSet 36m deployment-controller Scaled up replica set nginx-deploy-795697b5bb from 1 to 3

Normal ScalingReplicaSet 30m (x2 over 32m) deployment-controller Scaled up replica set nginx-deploy-795697b5bb from 3 to 5

Normal ScalingReplicaSet 19m (x2 over 31m) deployment-controller Scaled down replica set nginx-deploy-795697b5bb from 5 to 3

Normal ScalingReplicaSet 14m deployment-controller Scaled down replica set nginx-deploy-795697b5bb from 3 to 0

Normal ScalingReplicaSet 14m deployment-controller Scaled up replica set nginx-deploy-7699c758d4 from 0 to 3

Normal ScalingReplicaSet 13m deployment-controller Scaled down replica set nginx-deploy-7699c758d4 from 3 to 0

Normal ScalingReplicaSet 13m deployment-controller Scaled up replica set nginx-deploy-bb6447776 from 0 to 3

Normal ScalingReplicaSet 10m deployment-controller Scaled down replica set nginx-deploy-bb6447776 from 3 to 2

Normal ScalingReplicaSet 3m (x3 over 44m) deployment-controller Scaled up replica set nginx-deploy-795697b5bb from 0 to 1

Normal ScalingReplicaSet 2m59s (x2 over 10m) deployment-controller Scaled up replica set nginx-deploy-795697b5bb from 1 to 2

Normal ScalingReplicaSet 2m58s (x2 over 10m) deployment-controller Scaled down replica set nginx-deploy-bb6447776 from 2 to 1

Normal ScalingReplicaSet 2m56s (x11 over 10m) deployment-controller (combined from similar events): Scaled down replica set nginx-deploy-bb6447776 from 1 to 0滚动更新的过程:

回滚Deployment

deployment支持版本升级过程中的暂停、继续功能以及版本回退等诸多功能,下面具体来看.

kubectl rollout: 版本升级相关功能,支持下面的选项:

-

status 显示当前升级状态

-

history 显示 升级历史记录

-

pause 暂停版本升级过程

-

resume 继续已经暂停的版本升级过程

-

restart 重启版本升级过程

-

undo 回滚到上一级版本(可以使用--to-revision回滚到指定版本)

查看当前deployment的升级状态

[root@k8s-master01 ~]# kubectl rollout status deployment nginx-deploy -n tcloud

deployment "nginx-deploy" successfully rolled out查看历史版本

[root@k8s-master01 ~]# kubectl rollout history deployment nginx-deploy -n tcloud

deployment.apps/nginx-deploy

REVISION CHANGE-CAUSE

2 <none>

5 <none>

6 <none>

说明:CHANGE-CAUSE=<none>的原因是在做升级镜像的操作后没有加--record这个参数(kubectl set image deployments -n tcloud nginx-deploy vue-login=registry.cn-hangzhou.aliyuncs.com/gwjcloud/vue-login:v1.0 --record)查看版本的详细信息

[root@k8s-master01 ~]# kubectl rollout history deployment -n tcloud nginx-deploy --revision=2

deployment.apps/nginx-deploy with revision #5

Pod Template:

Labels: app=nginx-deploy

pod-template-hash=7699c758d4

Containers:

vue-login:

Image: swr.cn-north-4.myhuaweicloud.com/ddn-k8s/docker.io/library/nginx:lates

Port: <none>

Host Port: <none>

Environment: <none>

Mounts: <none>

Volumes: <none>

Node-Selectors: <none>

Tolerations: <none>

...查看当前deployment使用的镜像

[root@k8s-master01 ~]# kubectl get deployments -n tcloud -o wide

NAME READY UP-TO-DATE AVAILABLE AGE CONTAINERS IMAGES SELECTOR

nginx-deploy 3/3 3 3 104m vue-login registry.cn-hangzhou.aliyuncs.com/gwjcloud/vue-login:v1.0 app=nginx-deploy回退版本

[root@k8s-master01 ~]# kubectl rollout undo deployment -n tcloud nginx-deploy --to-revision=5

查看当前deployment使用的版本

[root@k8s-master01 ~]# kubectl get deployments -n tcloud -o wide

NAME READY UP-TO-DATE AVAILABLE AGE CONTAINERS IMAGES SELECTOR

nginx-deploy 3/3 3 3 106m vue-login swr.cn-north-4.myhuaweicloud.com/ddn-k8s/docker.io/library/nginx:latest app=nginx-deploy

这里要注意是我们在配置文件种是定义了保存版本的数量,如果值为0,就不保存历史版本了,就不能实现回退功能。

spec:

replicas: 3

revisionHistoryLimit: 10 #保存历史版本的数量K8s 回滚 不是靠记忆 ,而是靠 旧版本的 ReplicaSet(RS)。

- 每一次更新 → 生成一个新 RS

- 每一次回滚 → 启用旧 RS,把 Pod 扩回去

你删除了旧 RS = 把历史版本的 "存档" 删了,就不能进行回滚

暂停和恢复Deployment

由于每次对pod template种的信息发生修改后,都会触发更新deployment操作,那么此时如果频繁修改信息,都会产生多次更新,而实际上只需要执行最后一次更新即可,就出现此类似情况可以暂停deployment的rollout。

# 暂停Deployment的更新

[root@k8s-master01 ~]# kubectl rollout pause deployment -n tcloud nginx-deploy

# 修改deploy的资源限制

[root@k8s-master01 ~]# kubectl set resources deployment -n tcloud nginx-deploy -c=vue-login --limits=cpu=200m,memory=256Mi --requests=cpu=100m,memory=128Mi

# 查看更新状态

[root@k8s-master01 ~]# kubectl rollout status deployment -n tcloud nginx-deploy

Waiting for deployment "nginx-deploy" rollout to finish: 0 out of 3 new replicas have been updated...

# 恢复更新

[root@k8s-master01 ~]# kubectl rollout resume deployment -n tcloud nginx-deploy

# 去观察pod

[root@k8s-master01 ~]# kubectl get pod -n tcloud

NAME READY STATUS RESTARTS AGE

nginx-deploy-795697b5bb-cczsd 1/1 Running 0 4s

nginx-deploy-795697b5bb-hvhcb 1/1 Running 0 5s

nginx-deploy-795697b5bb-ldt9g 1/1 Running 0 2s

# 删除deployment

[root@k8s-master01 ~]# kubectl delete -f yaml/deploy.yaml 3、StatefulSet

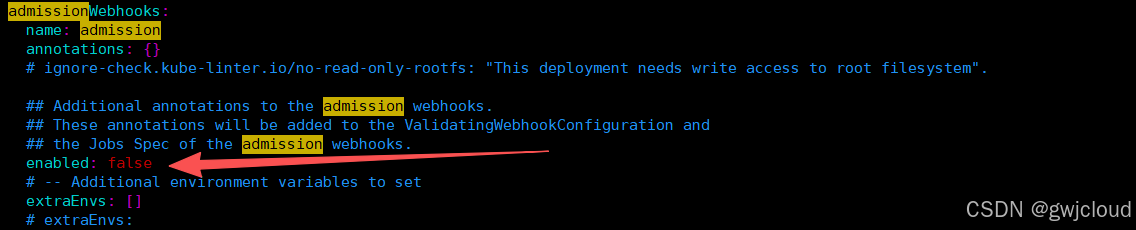

StatefulSet(有状态集,缩写为sts)常用于部署有状态的且需要有序启动的应用程序,比如在进行SpringCloud项目容器化时,Eureka的部署是比较适合用StatefulSet部署方式的,可以给每个Eureka实例创建一个唯一且固定的标识符,并且每个Eureka实例无需配置多余的service,其余SpringBoot应用可以直接通过Eureka的Headless Service即可进行注册。

什么是Headless:

和Deployment类似,一个StatefulSet也同样管理着基于相同容器规范的Pod。不同的是,StatefulSet为每个Pod维护了一个粘性标识。

而StatefulSet创建的Pod一般使用Headless Service(无头服务)进行Pod之前的通信,和普通的Service的区别在于Headless Service没有ClusterlP,它使用的是Endpoint进行互相通信,Headless一般的格式为:

statefulSetName-{0..N-1}.serviceName.namespace.svc.cluster.local

和普通Service的区别

| 特性 | 普通 Service (ClusterIP) | Headless Service (clusterIP: None) |

|---|---|---|

| 集群 IP | ✅ 分配一个固定 VIP | ❌ 无 IP |

| 负载均衡 | ✅ 自动轮询 / 随机转发 | ❌ 不负载均衡 |

| DNS 解析 | 返回 Service IP | 返回 所有匹配 Pod 的 IP 列表 |

| 访问方式 | service-name.namespace.svc |

直接访问单个 Pod :pod-name.service-name... |

| 适用场景 | 无状态应用(Deployment) | **有状态应用(StatefulSet)**Kubernetes |

创建StatefulSet

# 编辑创建StatefulSet的yaml文件

[root@k8s-master01 yaml]# vim statefulset.yaml

---

apiVersion: v1

kind: Service

metadata:

name: nginx

namespace: tcloud

labels:

app: nginx

spec:

ports:

- port: 80

name: web

clusterIP: None

selector:

app: nginx

---

apiVersion: apps/v1

kind: StatefulSet

metadata:

name: web

namespace: tcloud

spec:

serviceName: "nginx"

replicas: 3

selector:

matchLabels:

app: nginx

template:

metadata:

labels:

app: nginx

spec:

containers:

- name: nginx

image: registry.cn-hangzhou.aliyuncs.com/gwjcloud/vue-login:v1.0

imagePullPolicy: IfNotPresent

ports:

- containerPort: 80

name: web

# 创建StatefulSet

[root@k8s-master01 yaml]# kubectl apply -f statefulset.yaml

# 查看创建的StatefulSet

[root@k8s-master01 yaml]# kubectl get statefulsets -n tcloud

NAME READY AGE

web 3/3 85s

# 查看创建的svc,和pod

[root@k8s-master01 yaml]# kubectl get svc,pod -n tcloud

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

service/nginx ClusterIP None <none> 80/TCP 2m11s

NAME READY STATUS RESTARTS AGE

pod/web-0 1/1 Running 0 2m11s

pod/web-1 1/1 Running 0 2m10s

pod/web-2 1/1 Running 0 2m9s

# 测试pod访问StatefulSet创建的pod

[root@k8s-master01 ~]# kubectl run -it --image swr.cn-north-4.myhuaweicloud.com/ddn-k8s/docker.io/library/busybox:1.28 dns-test --restart=Never -n tcloud --rm /bin/sh

# 测试和pod是否可以通信 #web-0是pod名称,nginx是service名称

/ # ping web-0.nginx

PING web-0.nginx (10.244.195.17): 56 data bytes

64 bytes from 10.244.195.17: seq=0 ttl=62 time=1.441 ms

64 bytes from 10.244.195.17: seq=1 ttl=62 time=0.351 ms

--- web-0.nginx ping statistics ---

5 packets transmitted, 5 packets received, 0% packet loss

round-trip min/avg/max = 0.303/0.561/1.441 ms

/ # ping web-1.nginx

PING web-1.nginx (10.244.32.141): 56 data bytes

64 bytes from 10.244.32.141: seq=0 ttl=62 time=4.195 ms

--- web-1.nginx ping statistics ---

1 packets transmitted, 1 packets received, 0% packet loss

round-trip min/avg/max = 4.195/4.195/4.195 ms

/ # ping web-2.nginx

PING web-2.nginx (10.244.135.139): 56 data bytes

64 bytes from 10.244.135.139: seq=0 ttl=62 time=0.736 ms

--- web-2.nginx ping statistics ---

1 packets transmitted, 1 packets received, 0% packet loss

round-trip min/avg/max = 0.736/0.736/0.736 ms

# 测试pod映射的dns信息

/ # nslookup web-0.nginx

Server: 10.96.0.10

Address 1: 10.96.0.10 kube-dns.kube-system.svc.cluster.local

Name: web-0.nginx

Address 1: 10.244.195.17 web-0.nginx.tcloud.svc.cluster.local扩缩容StatefulSet

和 Deployment 类似,可以通过更新 replicas 字段扩容/缩容 StatefulSet,也可以使用kubectlscale、kubectl edit 和 kubectl patch 来扩/缩一个 StatefulSet.

# 把创建的StatefulSet的副本扩容为5个

[root@k8s-master01 ~]# kubectl scale sts -n tcloud web --replicas=5

# 查看pod部分数量

[root@k8s-master01 ~]# kubectl get pod -n tcloud

NAME READY STATUS RESTARTS AGE

web-0 1/1 Running 1 (4m59s ago) 16h

web-1 1/1 Running 1 (4m58s ago) 16h

web-2 1/1 Running 1 (4m51s ago) 16h

web-3 1/1 Running 0 22s

web-4 1/1 Running 0 21s

# 把创建statefulset副本缩容为3个

[root@k8s-master01 ~]# kubectl get pod -n tcloud

NAME READY STATUS RESTARTS AGE

web-0 1/1 Running 1 (6m9s ago) 16h

web-1 1/1 Running 1 (6m8s ago) 16h

web-2 1/1 Running 1 (6m1s ago) 16hStatefulSet更新策略

StatefulSet 提供两种更新策略:RollingUpdate(默认)与OnDelete ,核心区别在于是否自动有序更新 Pod,且 RollingUpdate 支持通过 partition 与 maxUnavailable 精细控制更新过程

RollingUpdate(金丝雀发布)

核心行为 :自动、有序、从高序号到低序号(如 web-2 → web-1 → web-0)更新,前一个 Pod 就绪后才更新下一个,确保稳定性。

例如我们有5个pod,如果当前partition设置为3,那么此时滚动更新时,只会更新那些序号>=3的pod

利用该机制,我们可以通过控制partition的值,来决定只更新其中一部分pod,确认没有问题后再主键增大更新的pod数量,最终实现全部pod更新

# 修改partition的数量

[root@k8s-master01 ~]# kubectl edit sts -n tcloud web

...

updateStrategy:

rollingUpdate:

partition: 2

type: RollingUpdate

# 这样我们更新的时候,只有pod名称大于2等于2的podvai进行更新

# 修改镜像

[root@k8s-master01 ~]# kubectl set image statefulset -n tcloud web nginx=swr.cn-north-4.myhuaweicloud.com/ddn-k8s/docker.io/library/nginx:latest

# 查看pod使用的镜像

[root@k8s-master01 ~]# kubectl get pods -n tcloud -o custom-columns=NAME:.metadata.name,IMAGE:.spec.containers[*].image

NAME IMAGE

web-0 registry.cn-hangzhou.aliyuncs.com/gwjcloud/vue-login:v1.0

web-1 registry.cn-hangzhou.aliyuncs.com/gwjcloud/vue-login:v1.0

web-2 swr.cn-north-4.myhuaweicloud.com/ddn-k8s/docker.io/library/nginx:latest

web-3 swr.cn-north-4.myhuaweicloud.com/ddn-k8s/docker.io/library/nginx:latest

web-4 swr.cn-north-4.myhuaweicloud.com/ddn-k8s/docker.io/library/nginx:latest

可以看到只有>=2的pod进行了镜像更新

# statefulset也支持版本回滚

[root@k8s-master01 ~]# kubectl rollout history statefulset -n tcloud

statefulset.apps/web

REVISION CHANGE-CAUSE

1 <none>

2 <none>

# 回退版本

[root@k8s-master01 ~]# kubectl rollout undo statefulset -n tcloud web --to-revision=1

# 查看pod的镜像

[root@k8s-master01 ~]# kubectl get pods -n tcloud -o custom-columns=NAME:.metadata.name,IMAGE:.spec.containers[*].image

NAME IMAGE

web-0 registry.cn-hangzhou.aliyuncs.com/gwjcloud/vue-login:v1.0

web-1 registry.cn-hangzhou.aliyuncs.com/gwjcloud/vue-login:v1.0

web-2 registry.cn-hangzhou.aliyuncs.com/gwjcloud/vue-login:v1.0

web-3 registry.cn-hangzhou.aliyuncs.com/gwjcloud/vue-login:v1.0

web-4 registry.cn-hangzhou.aliyuncs.com/gwjcloud/vue-login:v1.0OnDelete(手动触发)

核心行为 :不自动更新,仅在手动删除 Pod 时,才用新模板重建,完全由运维控制顺序与节奏

# 修改更新策略OnDelete

[root@k8s-master01 ~]# kubectl edit statefulset -n tcloud web

...

updateStrategy:

#rollingUpdate:

# partition: 2

type: OnDelete

# 修改StatefulSet的镜像

[root@k8s-master01 ~]# kubectl set image statefulset -n tcloud web nginx=swr.cn-north-4.myhuaweicloud.com/ddn-k8s/docker.io/library/nginx:latest

# 查看pod的镜像是否发生改变

[root@k8s-master01 ~]# kubectl get pods -n tcloud -o custom-columns=NAME:.metadata.name,IMAGE:.spec.containers[*].image

NAME IMAGE

web-0 registry.cn-hangzhou.aliyuncs.com/gwjcloud/vue-login:v1.0

web-1 registry.cn-hangzhou.aliyuncs.com/gwjcloud/vue-login:v1.0

web-2 registry.cn-hangzhou.aliyuncs.com/gwjcloud/vue-login:v1.0

web-3 registry.cn-hangzhou.aliyuncs.com/gwjcloud/vue-login:v1.0

web-4 registry.cn-hangzhou.aliyuncs.com/gwjcloud/vue-login:v1.0

# 删除其中一个pod

[root@k8s-master01 ~]# kubectl delete pod web-2 -n tcloud

# 查看pod的镜像,可以看到只有删除的pod做了更新操作

[root@k8s-master01 ~]# kubectl get pods -n tcloud -o custom-columns=NAME:.metadata.name,IMAGE:.spec.containers[*].image

NAME IMAGE

web-0 registry.cn-hangzhou.aliyuncs.com/gwjcloud/vue-login:v1.0

web-1 registry.cn-hangzhou.aliyuncs.com/gwjcloud/vue-login:v1.0

web-2 swr.cn-north-4.myhuaweicloud.com/ddn-k8s/docker.io/library/nginx:latest

web-3 registry.cn-hangzhou.aliyuncs.com/gwjcloud/vue-login:v1.0

web-4 registry.cn-hangzhou.aliyuncs.com/gwjcloud/vue-login:v1.0StatefulSet删除

级联删除

删除StaefulSet时,同时删除pod和service,但是pvc不能删除(重要数据不会丢失)

# 删除statefulSet和service

[root@k8s-master01 ~]# kubectl delete statefulset -n tcloud web

[root@k8s-master01 ~]# kubectl delete service -n tcloud nginx

# 查看pod,发现pod也同时删除了

[root@k8s-master01 ~]# kubectl get pod -n tcloud

No resources found in tcloud namespace.非级联删除

只删除StatefulSet本身,pod不会删除,还可以继续提供服务

# 重新创建出来

[root@k8s-master01 ~]# kubectl create -f yaml/statefulset.yaml

# 使用非级联删除,或者在kubectl delete命令后面加--cascade=orphan也是可以的

[root@k8s-master01 ~]# kubectl delete -f yaml/statefulset.yaml --cascade=orphan

service "nginx" deleted from tcloud namespace

statefulset.apps "web" deleted from tcloud namespace

# 查看statefulSet,service,pod

[root@k8s-master01 ~]# kubectl get statefulsets -n tcloud

No resources found in tcloud namespace.

[root@k8s-master01 ~]# kubectl get service -n tcloud

No resources found in tcloud namespace.

[root@k8s-master01 ~]# kubectl get pod -n tcloud

NAME READY STATUS RESTARTS AGE

web-0 1/1 Running 0 2m17s

web-1 1/1 Running 0 2m16s

web-2 1/1 Running 0 2m15s

web-3 1/1 Running 0 2m14s

web-4 1/1 Running 0 2m13s

可以看到pod还在继续提供服务

# 删除tcloud下的所有pod

[root@k8s-master01 ~]# kubectl delete pods -n tcloud --all

# 删除ControllerRevision(StatefulSet的快照版本),如果不删除这个这个快照就是一个残留垃圾

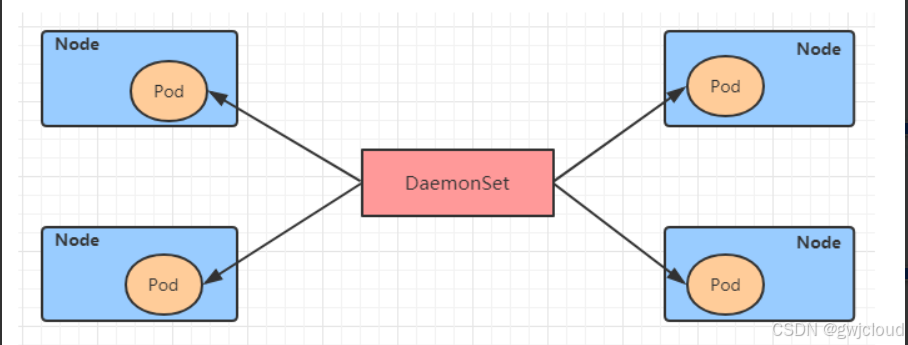

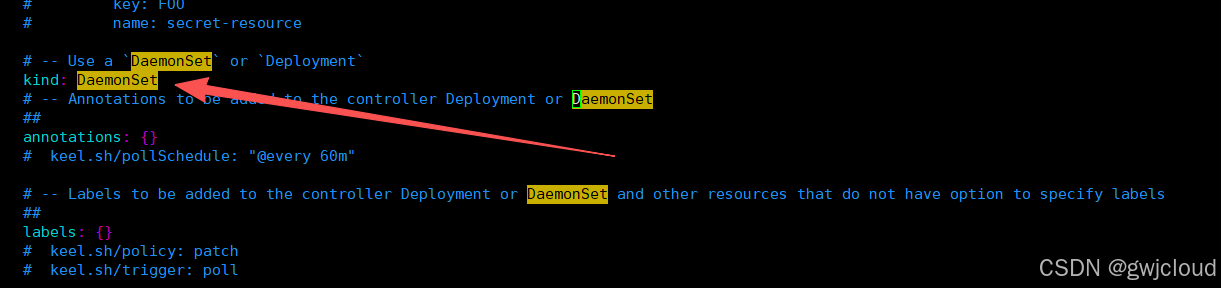

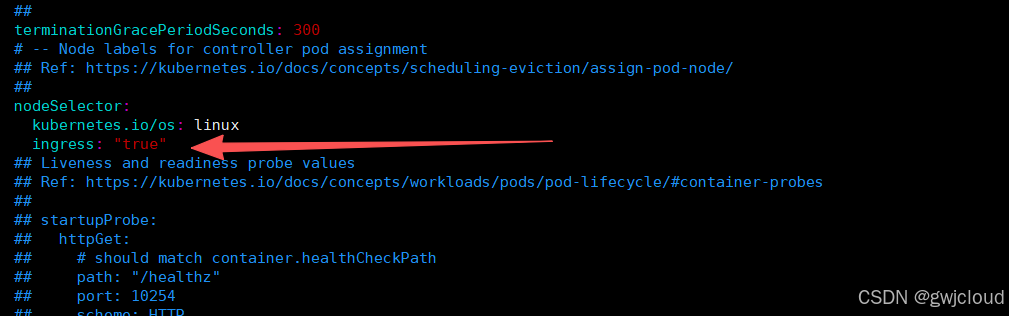

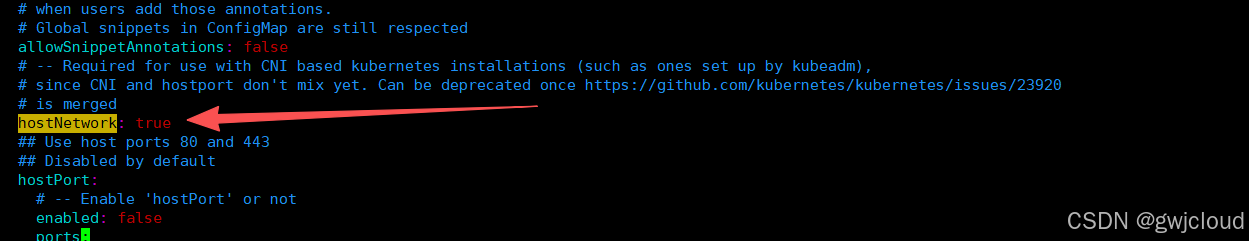

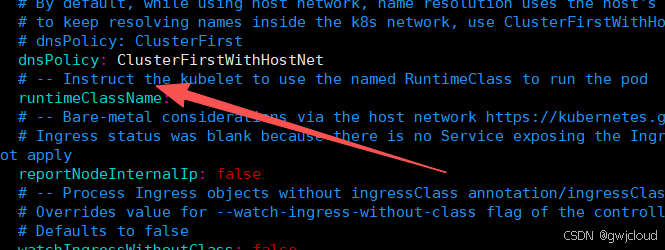

[root@k8s-master01 ~]# kubectl delete controllerrevision --all -n tcloud4、DaemonSet

DaemonSet类型的控制器可以保证在集群中的每一台(或指定)节点上都运行一个副本。一般适用于日志收集、节点监控等场景。也就是说,如果一个Pod提供的功能是节点级别的(每个节点都需要且只需要一个),那么这类Pod就适合使用DaemonSet类型的控制器创建。

DaemonSet控制器的特点:

- 每当向集群中添加一个节点时,指定的 Pod 副本也将添加到该节点上

- 当节点从集群中移除时,Pod 也就被垃圾回收了

典型使用场景:

-

节点日志收集:fluentd、filebeat

-

节点监控采集:prometheus-node-exporter

-

网络插件:Calico、Flannel、Cilium

-

安全 / 运维代理:节点级堡垒机、监控探针

-

存储客户端:每个节点挂载存储驱动

查看Calico网络的信息

[root@k8s-master01 ~]# kubectl get pod -n kube-system -o wide | grep calico-node

calico-node-8krq6 1/1 Running 4 (88m ago) 4d18h 192.168.1.13 k8s-node01 <none> <none>

calico-node-fs4zn 1/1 Running 4 (88m ago) 4d18h 192.168.1.10 k8s-master01 <none> <none>

calico-node-g6pr2 1/1 Running 4 (88m ago) 4d18h 192.168.1.11 k8s-master02 <none> <none>

calico-node-l9m8k 1/1 Running 4 (88m ago) 4d18h 192.168.1.15 k8s-node03 <none> <none>

calico-node-nj6jh 1/1 Running 4 (88m ago) 4d18h 192.168.1.14 k8s-node02 <none> <none>

calico-node-ps59q 1/1 Running 4 (88m ago) 4d18h 192.168.1.12 k8s-master03 <none> <none>

[root@k8s-master01 ~]# kubectl get daemonset -A

NAMESPACE NAME DESIRED CURRENT READY UP-TO-DATE AVAILABLE NODE SELECTOR AGE

kube-system calico-node 6 6 6 6 6 kubernetes.io/os=linux 4d18h

可以看到Calico网络插件是在每一个节点都有一个的

创建DaemonSet

# 编辑创建DaemonSet的yaml文件

[root@k8s-master01 yaml]# vim daemonset.yaml

apiVersion: apps/v1

kind: DaemonSet

metadata:

name: vue-login-ds

namespace: tcloud

spec:

selector:

matchLabels:

app: vue-login

template:

metadata:

labels:

app: vue-login

spec:

containers:

- name: vue-login

image: registry.cn-hangzhou.aliyuncs.com/gwjcloud/vue-login:v1.0

imagePullPolicy: IfNotPresent

# apply

[root@k8s-master01 yaml]# kubectl apply -f daemonset.yaml

# 查看pod,是在每一个不同的节点都运行了一个pod

[root@k8s-master01 yaml]# kubectl get pod -n tcloud -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

vue-login-ds-7vgdk 1/1 Running 0 2m24s 10.244.32.147 k8s-master01 <none> <none>

vue-login-ds-bbjff 1/1 Running 0 2m24s 10.244.85.210 k8s-node01 <none> <none>

vue-login-ds-hmfbh 1/1 Running 0 2m24s 10.244.122.135 k8s-master02 <none> <none>

vue-login-ds-kfcfz 1/1 Running 0 2m24s 10.244.58.211 k8s-node02 <none> <none>

vue-login-ds-lhdhg 1/1 Running 0 2m24s 10.244.195.26 k8s-master03 <none> <none>

vue-login-ds-p249q 1/1 Running 0 2m24s 10.244.135.147 k8s-node03 <none> <none>DaemonSet选择合适节点

# 给节点打标签,来指定Daemonset部署在匹配标签的节点上

[root@k8s-master01 yaml]# kubectl label nodes k8s-node02 k8s-node03 disktype=ssd

# 修改配置

[root@k8s-master01 yaml]# vim daemonset.yaml

apiVersion: apps/v1

kind: DaemonSet

metadata:

name: vue-login-ds

namespace: tcloud

spec:

selector:

matchLabels:

app: vue-login

template:

metadata:

labels:

app: vue-login

spec:

nodeSelector:

disktype: ssd

containers:

- name: vue-login

image: registry.cn-hangzhou.aliyuncs.com/gwjcloud/vue-login:v1.0

imagePullPolicy: IfNotPresent

# apply

[root@k8s-master01 yaml]# kubectl apply -f daemonset.yaml

# 查看pod部署的节点

[root@k8s-master01 yaml]# kubectl get pod -n tcloud -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

vue-login-ds-9pkch 1/1 Running 0 54s 10.244.58.212 k8s-node02 <none> <none>

vue-login-ds-mlwjh 1/1 Running 0 54s 10.244.135.148 k8s-node03 <none> <none>

可以看到是匹配到我们定义的标签部署的

# 现在给K8S-node01加上标签

[root@k8s-master01 yaml]# kubectl label nodes k8s-node01 disktype=ssd

# 查看pod节点

[root@k8s-master01 yaml]# kubectl get pod -n tcloud -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

vue-login-ds-9pkch 1/1 Running 0 2m55s 10.244.58.212 k8s-node02 <none> <none>

vue-login-ds-fdh9p 1/1 Running 0 6s 10.244.85.211 k8s-node01 <none> <none>

vue-login-ds-mlwjh 1/1 Running 0 2m55s 10.244.135.148 k8s-node03 <none> <none>

可以看到k8s-node01节点自动部署了一个pod上去DaemonSet的更新回滚

如果添加了新节点或修改了节点标签(Label),DaemonSet将立刻向新匹配上的节点添加Pod,同时删除不能匹配的节点上的Pod。

在Kubernetes 1.6以后的版本中,可以在 DaemonSet 上执行滚动更新,未来的Kubernetes 版本将支持节点的可控更新。

DaemonSet 滚动更新 参考: https://kubernetes.io/docs/tasks/manage-daemon/update-daemon-

set/

DaemonSet 更新策略和 StatefulSet 类似,也有 OnDelete 和 RollingUpdate两种方式。

建议DaemonSet使用OnDelete更新策略:

-

DaemonSet是跑在每一台节点上的底层组件(日志、网络、监控),不能自动乱更、不能批量滚动重启,必须手动、一台一台更新。

-

如果使用RollingUpdate(自动滚动更新):节点 1 重启 → 节点 2 重启 → 节点 3 重启,日志瞬间消失、网络瞬间闪断、监控瞬间丢失

查看创建的DaemonSet的默认更新策略

[root@k8s-master01 yaml]# kubectl get daemonsets -n tcloud -o yaml

...

updateStrategy:

rollingUpdate:

maxSurge: 0

maxUnavailable: 1

type: RollingUpdate # 默认是RollingUpdate更新镜像

[root@k8s-master01 yaml]# kubectl set image daemonset -n tcloud vue-login-ds vue-login=swr.cn-north-4.myhuaweicloud.com/ddn-k8s/docker.io/library/nginx:latest

查看历史版本,其实都是和Deployment和StatefulSet的一样

[root@k8s-master01 yaml]# kubectl rollout history daemonset -n tcloud vue-login-ds

daemonset.apps/vue-login-ds

REVISION CHANGE-CAUSE

1 <none>

2 <none>

3 <none>

4 <none>回退

[root@k8s-master01 yaml]# kubectl rollout undo daemonset -n tcloud vue-login-ds --to-revision=1

查看pod

[root@k8s-master01 yaml]# kubectl get pod -n tcloud

NAME READY STATUS RESTARTS AGE

vue-login-ds-87fkk 1/1 Running 0 12s

vue-login-ds-8qwcr 1/1 Running 0 12s

vue-login-ds-d2tst 1/1 Running 0 12s

vue-login-ds-hh65z 1/1 Running 0 12s

vue-login-ds-rt25j 1/1 Running 0 12s

vue-login-ds-smw9j 1/1 Running 0 12sDaemonSet的快照版本是保存到controllerrevisions里面的

[root@k8s-master01 yaml]# kubectl get controllerrevisions -n tcloud

NAME CONTROLLER REVISION AGE

vue-login-ds-549bd696c4 daemonset.apps/vue-login-ds 7 22m

vue-login-ds-588b567448 daemonset.apps/vue-login-ds 6 15m

vue-login-ds-59c4448d8b daemonset.apps/vue-login-ds 4 5m10s

vue-login-ds-5c8c5db5f6 daemonset.apps/vue-login-ds 5 14m删除DaemonSet相关的资源

[root@k8s-master01 yaml]# kubectl delete -f daemonset.yaml

删除标签

[root@k8s-master01 yaml]# kubectl label nodes k8s-node01 k8s-node02 k8s-node03 disktype-

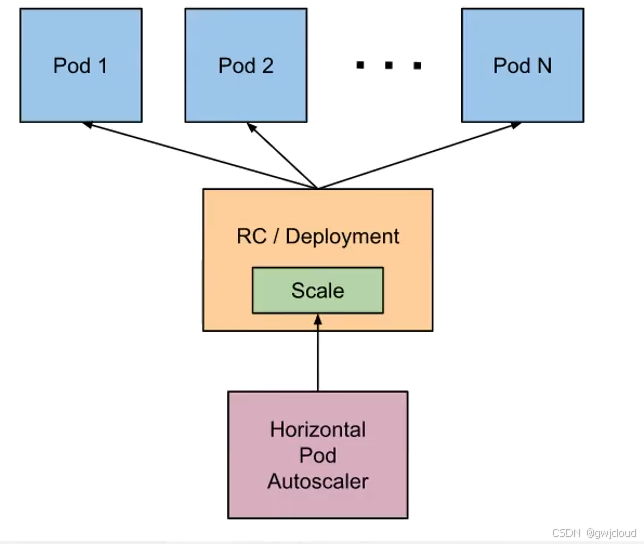

5、HPA

HPA:Horizontal Pod Autoscaler,pod水平自动扩缩容

- 水平:增加 / 减少pod数量(横向扩容)

- 垂直:升级CPU内存

- 作用:根据负载指标,自动调整Deployment,StatefulSet的副本数

支持管控对象:

- Deployment

- StatefulSet

常用监控指标

- cpu使用率(最常用)

- 内存使用率

- 自定义指标:QPS、连接数、列队长度等

工作原理

- HPA 定期(默认 15s)从 Metrics Server 采集指标

- 对比你设定的阈值

- 计算公式算出需要的副本数

- 调用控制器 API 修改 replicas

前提:集群必须安装了Metrics Server,否则HPA拿不到数据。

# 创建Deployment配置文件,副本数量为1

# 注意实现cpu或内存的监控,首先有个前提条件是该对象必须配置了

resources.requests.cpu

resources.requests.memory

才可以,可以配置当cpu/memory达到上述配置的百分比后进行扩容或缩

[root@k8s-master01 yaml]# vim deploy.yaml

apiVersion: apps/v1

kind: Deployment

metadata:

labels:

app: nginx-deploy

name: nginx-deploy

namespace: tcloud

spec:

replicas: 1

revisionHistoryLimit: 10

selector:

matchLabels:

app: nginx-deploy

strategy:

rollingUpdate:

maxSurge: 25%

maxUnavailable: 25%

type: RollingUpdate

template:

metadata:

labels:

app: nginx-deploy

spec:

containers:

- image: registry.cn-hangzhou.aliyuncs.com/gwjcloud/vue-login:v1.0

imagePullPolicy: IfNotPresent

name: vue-login

resources: # 资源配额

limits: # 限制资源(上限)

cpu: "200m" # CPU限制

memory: 128Mi

requests: # 请求资源(下限)

cpu: "100m" # CPU限制

memory: 128Mi

restartPolicy: Always

terminationGracePeriodSeconds: 30

# apply

[root@k8s-master01 yaml]# kubectl apply -f deploy.yaml

# 查看pod

[root@k8s-master01 yaml]# kubectl get pod -n tcloud

NAME READY STATUS RESTARTS AGE

nginx-deploy-795697b5bb-bhjtv 1/1 Running 0 6s

# 准备service文件,我们需要压力测试,所以要配置service

[root@k8s-master01 HPA]# vim service.yaml

apiVersion: v1

kind: Service

metadata:

name: nginx-deploy-svc

namespace: tcloud

spec:

selector:

app: nginx-deploy

ports:

- port: 80

targetPort: 80

nodePort: 30080

type: NodePort

[root@k8s-master01 HPA]# kubectl apply -f service.yaml

# 准备hpayaml文件

[root@k8s-master01 HPA]# vim hpa.yaml

apiVersion: autoscaling/v2

kind: HorizontalPodAutoscaler

metadata:

name: nginx-deploy-hpa

namespace: tcloud

spec:

scaleTargetRef:

apiVersion: apps/v1

kind: Deployment

name: nginx-deploy

minReplicas: 1

maxReplicas: 10

metrics:

- type: Resource

resource:

name: cpu

target:

type: Utilization

averageUtilization: 5

[root@k8s-master01 HPA]# kubectl apply -f hpa.yaml

说明:

minReplicas: 1 #最小pod数量

maxReplicas: 10 #最大pod数量

targetCPUUtilizationPercentage: 5 # CPU使用率指标,,如果cpu使用率达到5%就会进行扩容;为了测试方便,将这个数值调小一些

生成环境一般是70%~80%

HPA不是靠标签匹配对应的控制器!是靠 名字 + 类型 + 版本 匹配!

# 查看HPA的信息

[root@k8s-master01 HPA]# kubectl get hpa -n tcloud

NAME REFERENCE TARGETS MINPODS MAXPODS REPLICAS AGE

nginx-deploy-hpa Deployment/nginx-deploy cpu: 0%/5% 1 10 1 4m5s

# 使用webbench压力测试

[root@k8s-node03 ~]# wget http://home.tiscali.cz/~cz210552/distfiles/webbench-1.5.tar.gz

[root@k8s-node03 ~]# tar -zxvf webbench-1.5.tar.gz

[root@k8s-node03 ~]# mkdir -p /usr/local/man/man1

[root@k8s-node03 ~]# cd webbench-1.5/

[root@k8s-node03 webbench-1.5]# make install

# 只执行压力测试命令前,打开3个检测窗口查看hpa,deployment和pod的变化

[root@k8s-master01 HPA]# kubectl get pod -n tcloud -w

[root@k8s-master01 ~]# kubectl get hpa -n tcloud -w

[root@k8s-master01 ~]# kubectl get deployment -n tcloud -w

# 用500个并发用户,持续访问60s,压力测试

[root@k8s-node03 ~]# webbench -t 60 -c 500 http://192.168.1.100:30080/

# 可以看到pod在持续的增加

[root@k8s-master01 HPA]# kubectl get pod -n tcloud -w

NAME READY STATUS RESTARTS AGE

nginx-deploy-69c945b7dd-cqqqb 1/1 Running 0 15m

nginx-deploy-69c945b7dd-8ggxr 0/1 Pending 0 0s

nginx-deploy-69c945b7dd-5cjgz 0/1 Pending 0 0s

nginx-deploy-69c945b7dd-8ggxr 0/1 Pending 0 0s

nginx-deploy-69c945b7dd-gm64x 0/1 Pending 0 0s

nginx-deploy-69c945b7dd-5cjgz 0/1 Pending 0 0s

nginx-deploy-69c945b7dd-gm64x 0/1 Pending 0 0s

nginx-deploy-69c945b7dd-8ggxr 0/1 ContainerCreating 0 0s

nginx-deploy-69c945b7dd-5cjgz 0/1 ContainerCreating 0 0s

nginx-deploy-69c945b7dd-gm64x 0/1 ContainerCreating 0 0s

nginx-deploy-69c945b7dd-8ggxr 1/1 Running 0 1s

nginx-deploy-69c945b7dd-5cjgz 1/1 Running 0 1s

nginx-deploy-69c945b7dd-gm64x 1/1 Running 0 1s

# HPA的负载值也要持续的升高

[root@k8s-master01 ~]# kubectl get hpa -n tcloud -w

NAME REFERENCE TARGETS MINPODS MAXPODS REPLICAS AGE

nginx-deploy-hpa Deployment/nginx-deploy cpu: 0%/5% 1 10 1 12m

nginx-deploy-hpa Deployment/nginx-deploy cpu: 59%/5% 1 10 1 16m

nginx-deploy-hpa Deployment/nginx-deploy cpu: 0%/5% 1 10 4 16m

nginx-deploy-hpa Deployment/nginx-deploy cpu: 40%/5% 1 10 8 17m

nginx-deploy-hpa Deployment/nginx-deploy cpu: 29%/5% 1 10 10 17m

nginx-deploy-hpa Deployment/nginx-deploy cpu: 27%/5% 1 10 10 17m

# deployment的副本数也在持续的增加

[root@k8s-master01 ~]# kubectl get deployment -n tcloud -w

NAME READY UP-TO-DATE AVAILABLE AGE

nginx-deploy 1/1 1 1 15m

nginx-deploy 1/4 1 1 18m

nginx-deploy 1/4 1 1 18m

nginx-deploy 1/4 1 1 18m

nginx-deploy 1/4 4 1 18m

nginx-deploy 2/4 4 2 18m

nginx-deploy 3/4 4 3 18m

nginx-deploy 4/4 4 4 18m

nginx-deploy 4/8 4 4 19m

nginx-deploy 4/8 4 4 19m

nginx-deploy 4/8 4 4 19m

nginx-deploy 4/8 8 4 19m

nginx-deploy 5/8 8 5 19m

nginx-deploy 6/8 8 6 19m

nginx-deploy 7/8 8 7 19m

nginx-deploy 8/8 8 8 19m

nginx-deploy 8/10 8 8 19m

nginx-deploy 8/10 8 8 19m

nginx-deploy 8/10 8 8 19m

nginx-deploy 8/10 10 8 19m

nginx-deploy 9/10 10 9 19m

nginx-deploy 10/10 10 10 19m等待自动缩容

k8s的HPA有两个默认等待时间:扩容3分钟,缩容5分钟,即使CPU立刻降到0%,HPA也会等待5分钟才开始缩容,为了防止流量抖动

# 5分钟后我们查看pod 只剩下我们默认的1副本了

[root@k8s-master01 HPA]# kubectl get pod -n tcloud

NAME READY STATUS RESTARTS AGE

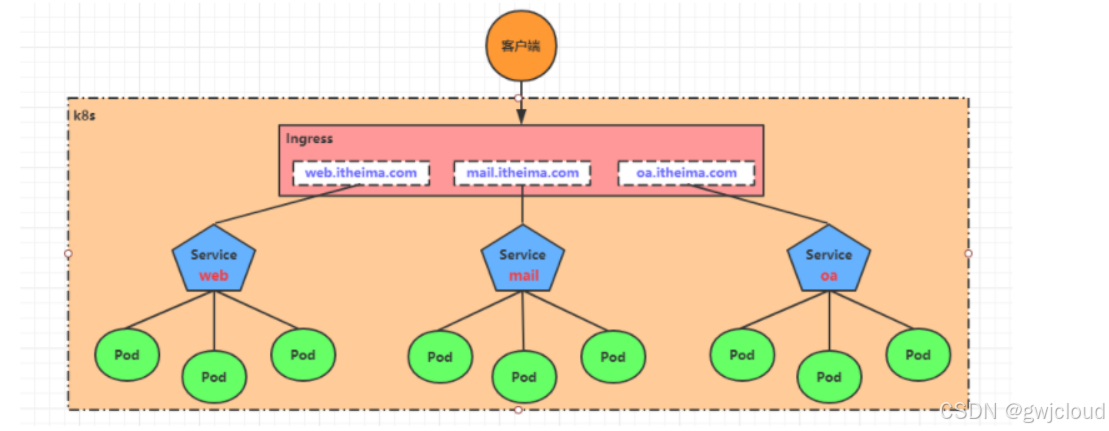

nginx-deploy-69c945b7dd-75m9v 1/1 Running 0 10m四、服务发布

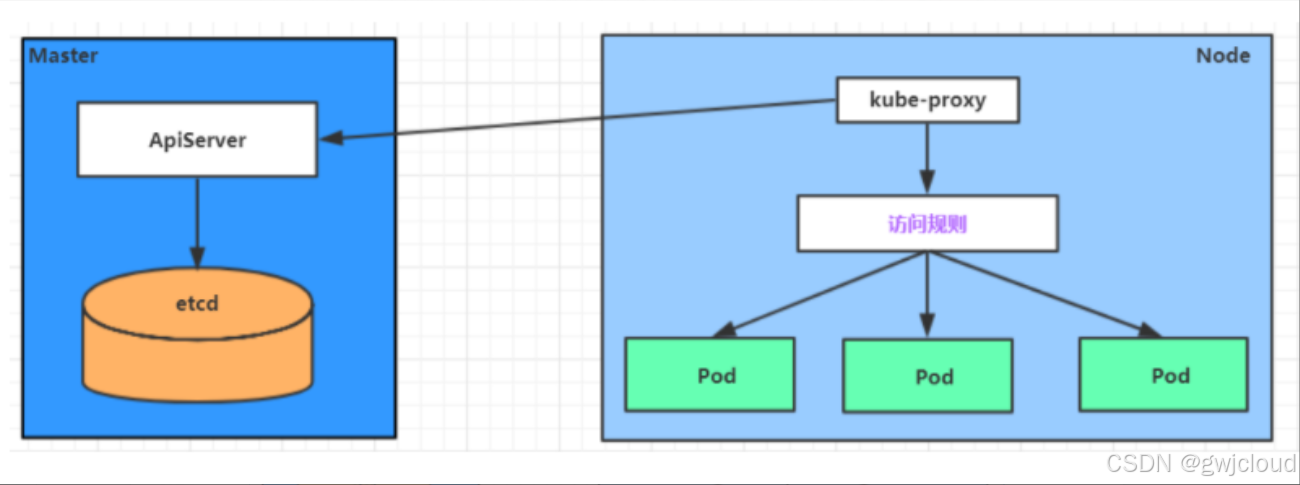

1、Servcie

1)service介绍

在kubernetes中,pod是应用程序的载体,我们可以通过pod的ip来访问应用程序,但是pod的ip地址不是固定的,这也就意味着不方便直接采用pod的ip对服务进行访问。

为了解决这个问题,kubernetes提供了Service资源,Service会对提供同一个服务的多个pod进行聚合,并且提供一个统一的入口地址。通过访问Service的入口地址就能访问到后面的pod服务。

Service在很多情况下只是一个概念,真正起作用的其实是kube-proxy服务进程,每个Node节点上都运行着一个kube-proxy服务进程。当创建Service的时候会通过api-server向etcd写入创建的service的信息,而kube-proxy会基于监听的机制发现这种Service的变动,然后它会将最新的Service信息转换成对应的访问规则。

kube-proxy目前支持三种工作模式:

userspace 模式

userspace模式下,kube-proxy会为每一个Service创建一个监听端口,发向Cluster IP的请求被Iptables规则重定向到kube-proxy监听的端口上,kube-proxy根据LB算法选择一个提供服务的Pod并和其建立链接,以将请求转发到Pod上。 该模式下,kube-proxy充当了一个四层负责均衡器的角色。由于kube-proxy运行在userspace中,在进行转发处理时会增加内核和用户空间之间的数据拷贝,虽然比较稳定,但是效率比较低。

iptables 模式

iptables模式下,kube-proxy为service后端的每个Pod创建对应的iptables规则,直接将发向Cluster IP的请求重定向到一个Pod IP。 该模式下kube-proxy不承担四层负责均衡器的角色,只负责创建iptables规则。该模式的优点是较userspace模式效率更高,但不能提供灵活的LB策略,当后端Pod不可用时也无法进行重试。

ipvs模式

ipvs模式和iptables类似,kube-proxy监控Pod的变化并创建相应的ipvs规则。ipvs相对iptables转发效率更高。除此以外,ipvs支持更多的LB算法。

此模式必须安装ipvs内核模块,否则会降级为iptables

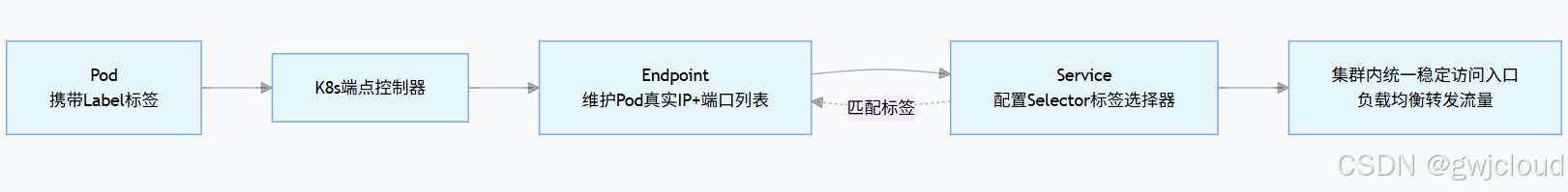

2)Service、pod、endpoint的关系

-

Service 定义筛选规则 Service 通过

spec.selector定义标签规则(比如app: nginx-pod),表示:"我要管理所有带这个标签的 Pod"。但 Service 本身不直接管理 Pod,它只负责提供访问入口。

-

Endpoint 自动匹配并记录 Pod 地址 Kubernetes 控制器会监听 Service 的

selector,自动:- 筛选出集群中所有匹配标签的 Pod

- 把这些 Pod 的

IP:容器端口记录到对应的 Endpoint 对象里这个过程是全自动 的,你不用手动创建或修改 Endpoint。(K8s 1.21+ 已默认用更高效的EndpointSlice替代传统Endpoint,但逻辑是一样的)

-

Service 通过 Endpoint 转发流量当你访问 Service 的 ClusterIP/NodePort/ 域名时:

- 集群内的 kube-proxy 会根据 Service 的配置,从对应的 Endpoint 列表里拿到所有健康的 Pod 地址

- 按负载均衡策略(轮询、随机等)把请求转发给其中一个 Pod

- 如果 Pod 挂了 / 重建了,Endpoint 会自动更新列表,Service 永远只会转发给健康的 Pod

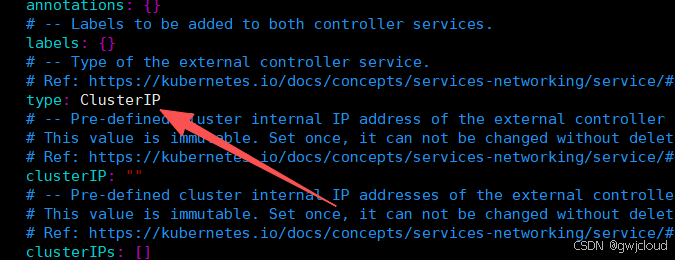

3)servcie类型

| 类型 | 作用 | 访问方式 | 适用场景 |

|---|---|---|---|

| ClusterIP(默认) | 集群内部 IP,仅集群内可访问 | ClusterIP:端口 |

内部服务间调用,比如后端服务、中间件 |

| NodePort | 节点上开端口,外部可访问 | 节点IP:NodePort |

开发 / 测试环境,快速对外暴露服务 |

| LoadBalancer | 云厂商提供的外部负载均衡器 | LB公网IP:端口 |

生产环境,云平台上对外提供服务 |

| ExternalName | 将服务映射到外部域名 | 集群内访问服务名 → 转发到外部域名 | 访问外部服务、第三方接口 |

| Headless(ClusterIP: None) | 无 ClusterIP,直接返回 Pod IP | DNS 解析返回所有 Pod IP | StatefulSet、数据库、有状态应用 |

# 首先创建一个deployment

[root@k8s-master01 Service]# vim deployment.yaml

apiVersion: apps/v1

kind: Deployment

metadata:

name: vue-login-pod

namespace: tcloud

spec:

replicas: 3

selector:

matchLabels:

app: nginx-pod

template:

metadata:

labels:

app: nginx-pod

spec:

containers:

- name: vue-login

image: registry.cn-hangzhou.aliyuncs.com/gwjcloud/vue-login:v1.0

imagePullPolicy: IfNotPresent

ports:

- containerPort: 80

# apply

[root@k8s-master01 Service]# kubectl apply -f deployment.yaml

# 写入测试数据

kubectl exec -it pod/vue-login-pod-775f6f875-2mg9r -n tcloud -- bash

echo "nginx1" > /usr/share/nginx/html/index.html

kubectl exec -it pod/vue-login-pod-775f6f875-77njk -n tcloud -- bash

echo "nginx2" > /usr/share/nginx/html/index.html

kubectl exec -it pod/vue-login-pod-775f6f875-h2b4m -n tcloud -- bash

echo "nginx3" > /usr/share/nginx/html/index.htmlClusterIP

ClusterIP 是 K8s Service 默认类型。

作用:给 Service 分配一个集群内部的固定虚拟 IP。

核心特点

-

仅集群内部可访问(其他 Pod、节点能通,外网 / 外部机器访问不了)

-

IP 永久固定,不会随 Pod 删除、重建、漂移而改变

-

自动关联 Endpoint,实现负载均衡,分发流量到后端多个 Pod

创建ClusterIP的yaml文件

[root@k8s-master01 Service]# vim service-clusterip.yaml

apiVersion: v1

kind: Service

metadata:

name: service-clusterip

namespace: tcloud

spec:

selector:

app: nginx-pod

clusterIP:

type: ClusterIP

ports:- port: 80 # Service端口

targetPort: 80 # pod端口

apply

[root@k8s-master01 Service]# kubectl apply -f service-clusterip.yaml

查看Service的信息

[root@k8s-master01 Service]# kubectl get svc -n tcloud

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

service-clusterip ClusterIP 10.96.231.74 <none> 80/TCP 104s查看Service的详细信息

在这里有一个Endpoints列表,里面就是当前service可以转发到的pod

[root@k8s-master01 Service]# kubectl describe svc service-clusterip -n tcloud

Name: service-clusterip

Namespace: tcloud

Labels: <none>

Annotations: <none>

Selector: app=nginx-pod

Type: ClusterIP

IP Family Policy: SingleStack

IP Families: IPv4

IP: 10.96.231.74

IPs: 10.96.231.74

Port: <unset> 80/TCP

TargetPort: 80/TCP

Endpoints: 10.244.195.31:80,10.244.135.157:80,10.244.58.220:80

Session Affinity: None

Internal Traffic Policy: Cluster

Events: <none>也创建了一个endpoint

[root@k8s-master01 Service]# kubectl get endpoints -n tcloud

Warning: v1 Endpoints is deprecated in v1.33+; use discovery.k8s.io/v1 EndpointSlice

NAME ENDPOINTS AGE

service-clusterip 10.244.135.157:80,10.244.195.31:80,10.244.58.220:80 6m12s查看ipvs的映射关系

[root@k8s-master01 Service]# ipvsadm -Ln

...

TCP 10.96.231.74:80 rr

-> 10.244.58.220:80 Masq 1 0 0

-> 10.244.135.157:80 Masq 1 0 0

-> 10.244.195.31:80 Masq 1 0 0

是我们的Service IP转发到3个pod上看到上面的规则是rr(轮询),访问测试

[root@k8s-master01 Service]# while true;do curl 10.96.231.74;sleep 2; done;

nginx3

nginx1

nginx2创建pod通过service name镜像访问,是pod来通信的方式

创建2个不同命名空间下的pod(busybox)

[root@k8s-master01 yaml]# kubectl get pods -l app=dnstest --all-namespaces

NAMESPACE NAME READY STATUS RESTARTS AGE

default busybox 1/1 Running 0 10m

tcloud busybox 1/1 Running 0 9m36s基于同命名空间下的访问

[root@k8s-master01 yaml]# kubectl exec -it busybox -n tcloud -- sh

/ # wget http://service-clusterip

Connecting to service-clusterip (10.96.231.74:80)

index.html 100% |****************************************************************************************************************************************************************| 7 0:00:00 ETA

/ # cat index.html

nginx3

/ # rm -rf index.html进入默认命名空间下的pod(busybox)

service-clusterip是Service的名字

[root@k8s-master01 yaml]# kubectl exec -it busybox -n default -- sh

/ # wget http://service-clusterip.tcloud

Connecting to service-clusterip.tcloud (10.96.231.74:80)

index.html 100% |****************************************************************************************************************************************************************| 7 0:00:00 ETA

/ # cat index.html

nginx3

/ # rm -rf index.html - port: 80 # Service端口

负载分发策略

对Service的访问被分发到了后端的Pod上去,目前kubernetes提供了两种负载分发策略:

- 如果不定义,默认使用kube-proxy的策略,比如随机、轮询

- 基于客户端地址的会话保持模式,即来自同一个客户端发起的所有请求都会转发到固定的一个Pod上

此模式可以使在spec中添加sessionAffinity:ClientIP选项

# 修改yaml文件配置基

[root@k8s-master01 Service]# vim service-clusterip.yaml

apiVersion: v1

kind: Service

metadata:

name: service-clusterip

namespace: tcloud

spec:

sessionAffinity: ClientIP

selector:

app: nginx-pod

clusterIP:

type: ClusterIP

ports:

- port: 80 # Service端口

targetPort: 80 # pod端口

# apply

[root@k8s-master01 Service]# kubectl apply -f service-clusterip.yaml

# 查看ipvs规则【persistent 代表持久】

[root@k8s-master01 Service]# ipvsadm -Ln

TCP 10.96.152.16:80 rr persistent 10800

-> 10.244.58.220:80 Masq 1 0 0

-> 10.244.135.157:80 Masq 1 0 0

-> 10.244.195.31:80 Masq 1 0 0

# 用不同的节点访问测试

[root@k8s-master01 Service]# while true;do curl 10.96.152.16:80; sleep 2; done;

nginx2

nginx2

[root@k8s-master02 ~]# while true;do curl 10.96.152.16:80; sleep 2; done;

nginx1

nginx1

# 删除service

[root@k8s-master01 Service]# kubectl delete -f service-clusterip.yaml HeadLiness

在某些场景中,开发人员可能不想使用Service提供的负载均衡功能,而希望自己来控制负载均衡策略,针对这种情况,kubernetes提供了HeadLiness Service,这类Service不会分配Cluster IP,如果想要访问service,只能通过service的域名进行查询。

[root@k8s-master01 Service]# vim service-headliness.yaml

apiVersion: v1

kind: Service

metadata:

name: service-headliness

namespace: tcloud

spec:

selector:

app: nginx-pod

clusterIP: None # 将clusterIP设置为None,即可创建headliness Service

type: ClusterIP

ports:

- port: 80

targetPort: 80

# apply

[root@k8s-master01 Service]# kubectl apply -f service-headliness.yaml

# 查看service信息

[root@k8s-master01 Service]# kubectl get svc -n tcloud

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

service-headliness ClusterIP None <none> 80/TCP 20s

[root@k8s-master01 Service]# kubectl describe svc service-headliness -n tcloud

Name: service-headliness

Namespace: tcloud

Labels: <none>

Annotations: <none>

Selector: app=nginx-pod

Type: ClusterIP

IP Family Policy: SingleStack

IP Families: IPv4

IP: None

IPs: None

Port: <unset> 80/TCP

TargetPort: 80/TCP

Endpoints: 10.244.195.31:80,10.244.135.157:80,10.244.58.220:80

Session Affinity: None

Internal Traffic Policy: Cluster

Events: <none>

# 进入pod测试访问

[root@k8s-master01 Service]# kubectl exec -it busybox -n tcloud -- sh

/ # nslookup service-headliness

Server: 10.96.0.10

Address 1: 10.96.0.10 kube-dns.kube-system.svc.cluster.local

Name: service-headliness

Address 1: 10.244.135.157 10-244-135-157.service-headliness.tcloud.svc.cluster.local

Address 2: 10.244.58.220 10-244-58-220.service-headliness.tcloud.svc.cluster.local

Address 3: 10.244.195.31 10-244-195-31.service-headliness.tcloud.svc.cluster.local

# 删除svc

[root@k8s-master01 Service]# kubectl delete -f service-headliness.yaml 注意:

核心:K8s 不做负载均衡

- 没有 ClusterIP

- kube-proxy 不转发、不轮询

- DNS 直接解析出全部后端 Pod 真实 IP(你刚才 nslookup 看到的 3 个 IP)

- 谁调用,谁自己决定连哪个 Pod(客户端自己选、自己做负载 / 轮询)

NodePort

在之前的样例中,创建的Service的ip地址只有集群内部才可以访问,如果希望将Service暴露给集群外部使用,那么就要使用到另外一种类型的Service,称为NodePort类型。NodePort的工作原理其实就是将service的端口映射到Node的一个端口上,然后就可以通过NodeIp:NodePort来访问service了。

# 创建NodePort的yaml文件

[root@k8s-master01 Service]# vim service-nodeport.yaml

apiVersion: v1

kind: Service

metadata:

name: service-nodeport

namespace: tcloud

spec:

selector:

app: nginx-pod

type: NodePort # service类型

ports:

- port: 80

nodePort: 30002 # 指定绑定的node的端口(默认的取值范围是:30000-32767), 如果不指定,会默认分配

targetPort: 80

# apply

[root@k8s-master01 Service]# kubectl apply -f service-nodeport.yaml

# 查看SVC信息

[root@k8s-master01 Service]# kubectl get svc -n tcloud

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

service-nodeport NodePort 10.96.82.157 <none> 80:30002/TCP 6s

[root@k8s-master01 Service]# kubectl describe svc -n tcloud service-nodeport

[root@k8s-master01 Service]# kubectl get endpoints -n tcloud

Warning: v1 Endpoints is deprecated in v1.33+; use discovery.k8s.io/v1 EndpointSlice

NAME ENDPOINTS AGE

service-nodeport 10.244.135.157:80,10.244.195.31:80,10.244.58.220:80 66s

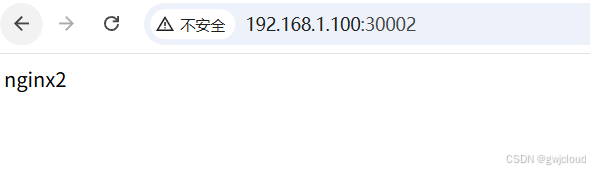

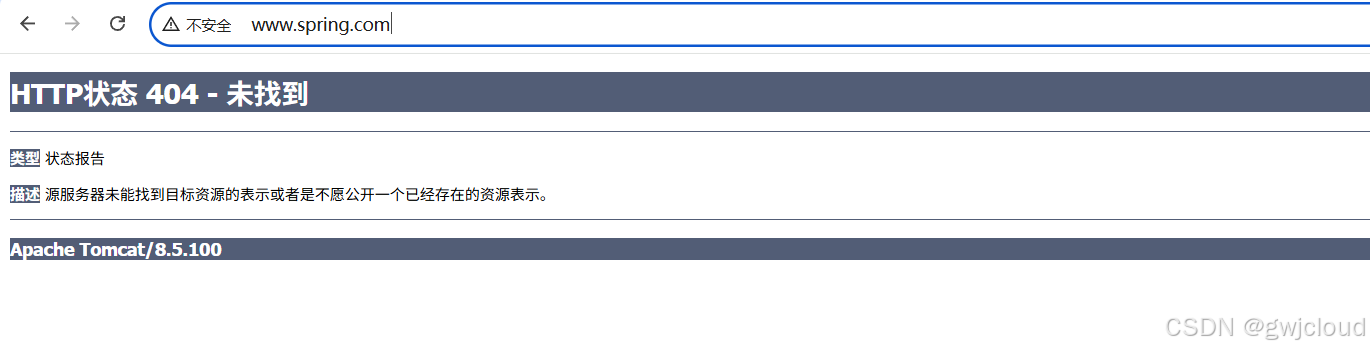

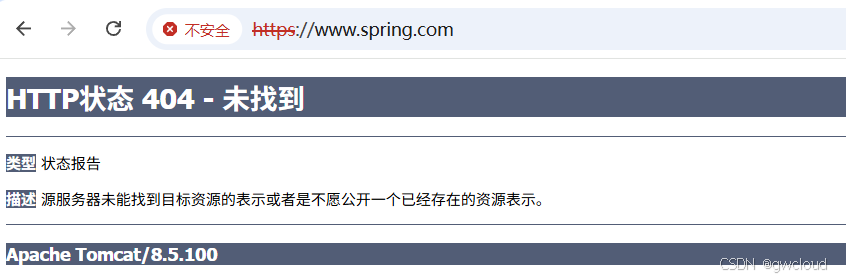

# 通过游览器访问或者某个节点访问,访问任何一个节点的ip加上端口都可以访问

[root@k8s-master01 Service]# while true;do curl 192.168.1.100:30002; sleep 2; done;

nginx1

nginx2

nginx3

注意:生成环境不推荐使用NodePort

核心原因:

- 端口范围受限NodePort 端口固定范围:30000--32767,端口号固定、不灵活。

- 安全风险高所有集群节点都会统一监听该端口,外网 / 内网只要能连通任意节点 IP + 端口,就能直接访问服务,暴露面太大。

- 性能一般、架构不优雅流量链路:外网IP → 节点NodePort → kube-proxy → Pod多层转发,不适合高并发生产。

- 无统一入口、不好维护集群多节点时,用户要记多个节点 IP,无法统一域名接入。

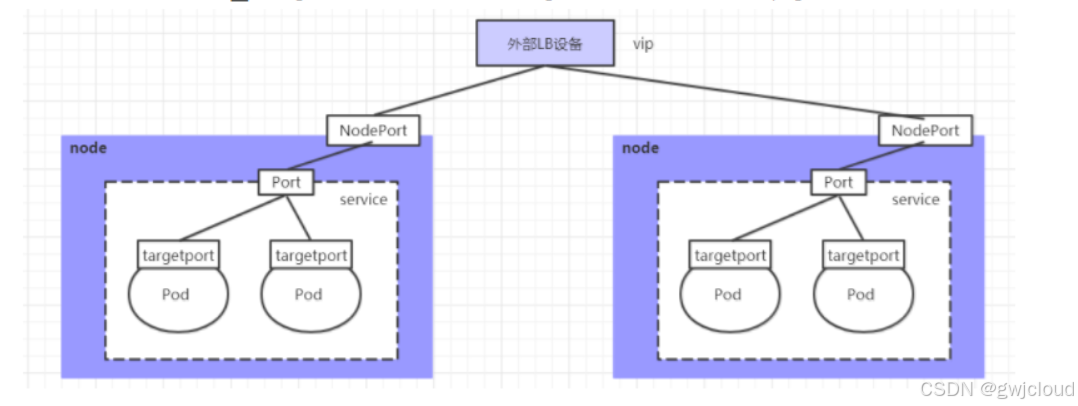

LoadBalancer

LoadBalancer和NodePort很相似,目的都是向外部暴露一个端口,区别在于LoadBalancer会在集群的外部再来做一个负载均衡设备,而这个设备需要外部环境支持的,外部服务发送到这个设备上的请求,会被设备负载之后转发到集群中。

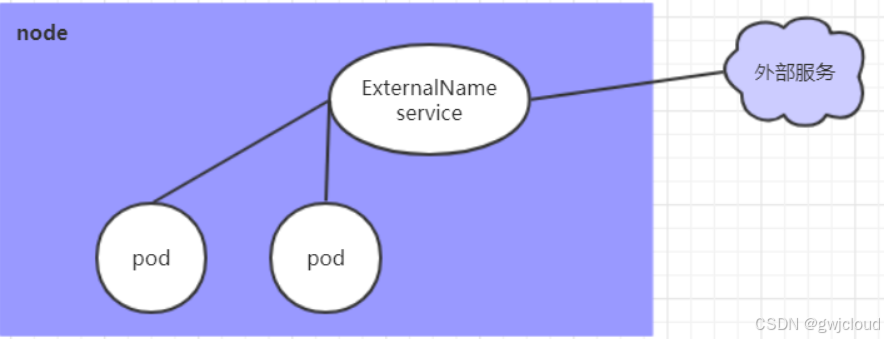

ExternalName

ExternalName类型的Service用于引入集群外部的服务,它通过externalName属性指定外部一个服务的地址,然后在集群内部访问此service就可以访问到外部的服务了。

代理外部域名

使用场景:

对方服务不在本集群、不在本命名空间,只有一个外网域名;内部统一用 k8s 内网域名访问,方便治理、权限收敛。

# 创建externalnam.yaml

[root@k8s-master01 Service]# vim externalnam.yaml

apiVersion: v1

kind: Service

metadata:

name: service-externalname

namespace: tcloud

spec:

type: ExternalName # service类型

externalName: www.baidu.com #改成ip地址也可以

# apply

[root@k8s-master01 Service]# kubectl apply -f externalnam.yaml

[root@k8s-master01 Service]# kubectl get svc -n tcloud

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

service-externalname ExternalName <none> www.baidu.com <none> 12s

# pod访问测试

[root@k8s-master01 Service]# kubectl exec -it busybox -n tcloud -- sh

/ # nslookup service-externalname

Server: 10.96.0.10

Address 1: 10.96.0.10 kube-dns.kube-system.svc.cluster.local

Name: service-externalname

Address 1: 240e:83:205:1cd:0:ff:b0b8:dee9

Address 2: 240e:83:205:381:0:ff:b00f:96a2

Address 3: 220.181.111.232

Address 4: 220.181.111.1

说明:

ExternalName 正常解析到 www.baidu.com 的真实 IP/IPv6;

K8s DNS 转发域名解析 一切正常;

/ # wget http://service-externalname

Connecting to service-externalname (220.181.111.1:80)

wget: server returned error: HTTP/1.1 403 Forbidden

说明:

映射成功这里403只是百度服务器做了限制,不允许IP方式访问

# 删除Service

[root@k8s-master01 Service]# kubectl delete -f externalnam.yaml 代理多个外部ip

只有一种情况,架构不规范,没做中间件高可用层,不然是由统一的服务入口的

场景 :K8s 内部要访问 2 台外部 MySQL(192.168.5.10、192.168.5.11) 通过 Service 统一入口 + 自动负载均衡

方案:无 selector 的 ClusterIP Service + 手动 Endpoint 写入多个外部 IP

# 创建service-mysql.yaml

[root@k8s-master01 Service]# vim service-mysql.yaml

apiVersion: v1

kind: Service

metadata:

name: mysql-external-svc

namespace: tcloud

spec:

type: ClusterIP # 默认类型,自带负载均衡

ports:

- port: 3306 # Service 访问端口

targetPort: 3306 # 外部真实端口

# 查看信息发现是没有创建endpoint的,因为没有selector去代理的pod

[root@k8s-master01 Service]# kubectl get svc -n tcloud

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

mysql-external-svc ClusterIP 10.96.243.240 <none> 3306/TCP 5s

[root@k8s-master01 Service]# kubectl get endpoints -n tcloud

Warning: v1 Endpoints is deprecated in v1.33+; use discovery.k8s.io/v1 EndpointSlice

No resources found in tcloud namespace.

# 看servcie的详细信息

[root@k8s-master01 Service]# kubectl describe svc -n tcloud mysql-external-svc

Name: mysql-external-svc

Namespace: tcloud

Labels: <none>

Annotations: <none>

Selector: <none>

Type: ClusterIP

IP Family Policy: SingleStack

IP Families: IPv4

IP: 10.96.243.240

IPs: 10.96.243.240

Port: <unset> 3306/TCP

TargetPort: 3306/TCP

Endpoints: <none>

Session Affinity: None

Internal Traffic Policy: Cluster

Events: <none>

发现Endpoints是空的

# 创建endpoint yaml文件

[root@k8s-master01 Service]# vim endpoint-mysql.yaml

apiVersion: v1

kind: Endpoints

metadata:

name: mysql-external-svc # 必须和 Service 名字一模一样

namespace: tcloud

subsets:

- addresses:

- ip: 192.168.5.10 # 外部MySQL 1

- ip: 192.168.5.11 # 外部MySQL 2

ports:

- port: 3306 # 端口必须一致

# apply

[root@k8s-master01 Service]# kubectl apply -f endpoint-mysql.yaml

# 查看ipvsadm规则

[root@k8s-master01 Service]# ipvsadm -Ln

TCP 10.96.243.240:3306 rr