第四章:破晓------深度学习革命(2006---2013)

!info

在第三章的结尾我们留下了一个问题:当数据、算力、算法三块拼图同时准备好,接下来又会发生哪些故事呢?

2006 年,Hinton 用深度信念网络发出了第一个复苏信号------但复苏信号并不等于爆发信号。大多数 AI 研究者仍然不相信神经网络会复活,那个时期 SVM 依然是主流,神经网络依然是那个被 Minsky 判过死刑的边缘研究方向。但在接下来的五六年时间里,是这三条平行的准备工作同时推进的发展时期:李飞飞在标注一个覆盖两万个类别的图像数据库,NVIDIA 在让 GPU 向科学计算敞开大门,Hinton 的团队在打磨能让深层网络真正训练起来的算法技巧。这三件事彼此没有协调,却在 2012 年前后同时到位了。

故事就在这时出现了转机,在一个被称为 ILSVRC 的图像识别竞赛现场,神经网络用实力证明了自己,沉默了三十年的历史,终于宣告了终结。

!question

2012 年 9 月,一个由两名学生和一位坚守了三十年信念的老教授组成的三人团队,以超过第二名 11 个百分点的悬殊差距赢得了全球最重要的图像识别竞赛------深度学习的革命爆发了。而背后那三块拼图,各自经历了怎样的准备,又是如何在同一时刻集体到位的?

4.1、2012 年 9 月:改变历史的竞赛

4.1.1 Hinton,64 岁,等到了

2012 年的那个秋天,Geoffrey Hinton 已经 64 岁了。

从 1980 年代起,他就在做一件大多数 AI 研究者认为没有前途的事:研究深度神经网络。他经历了 Minsky《感知机》判决书之后那场席卷整个领域的寒冬,熬过了 SVM 独霸排行榜的 1990 年代,在 2000 年代被反复问到"你为什么还在做神经网络"。他的部分学生,曾被别的导师私下劝告:"不要跟 Hinton,那条路没有出路。"

2006 年,他发表了深度信念网络的论文,算是发出了一个迟来的反击信号。但一篇论文不等于革命------统计学习社区并没有被说服,SIFT 和 SVM 依然是图像识别竞赛的主流工具,Hinton 的团队依然在边缘地带工作。

到了 2012 年夏天,他们的手里有了两样东西:一套能在 GPU 上高效训练卷积网络的代码(由学生 Alex Krizhevsky(克里泽夫斯基,1988-,乌克兰裔加拿大计算机科学家,AlexNet 第一作者)花数月编写,代号 cuda-convnet),以及两块 NVIDIA GTX 580 显卡。

9 月,他们把训练好的模型提交给了 ILSVRC 竞赛,然后等待。

Krizhevsky 后来在采访中描述过这段等待:"你知道自己做了一些真实的东西,但你不确定其他人是否准备好接受它。"三十年的漫长坚守,压缩进了成绩公布前的那几天。

在那个数字出现之前,还需要先理解另一件事:那个把一切都成为可能的"竞技场",是怎么被构建起来的。

4.1.2 ImageNet 的诞生

2006 年,李飞飞(Fei-Fei Li,1976-,美国斯坦福大学计算机科学教授,"AI 教母",ImageNet 创始人)刚刚加入普林斯顿大学任教不久。她在研究计算机视觉领域问题时,产生了一个困扰了她很久的疑问:机器学习模型的性能在持续提升,但所有的改进都建立在小得可怜的数据集上------常用的 Caltech-101 只有 101 个类别,每类约 40-800 张图;PASCAL VOC 也不过几千张图片。模型正在越来越好地"记住"训练集,但根本无法推广到真实世界。

李飞飞认为,根本原因不是算法不够好,而是数据太少、太窄了。

她的想法很激进:与其在小数据集上反复打磨算法,不如先造一个能覆盖人类视觉认知的大型数据库------收集互联网上尽可能多的图片,覆盖尽可能多的物体类别,再把每张图片都标注好。有了这个数据库,也许能真正测试一个模型"认识"多少东西。

这个项目,在当时几乎没有人认为值得做。

"大家都说,'你为什么要浪费时间收集数据?只要有好算法,数据是次要的。'"

------李飞飞,回忆 ImageNet 初期时的反应

2007 年,李飞飞和团队开始实施。他们用 WordNet(一个英文词汇语义网络)作为分类体系,计划覆盖其中的 80,000 个名词类别,每类收集至少 1000 张图片。数据来源是互联网------从 Flickr、Google Images、Bing 大量抓取图片。

每张图片都必须由人工确认:"这张图里确实有这个东西。"仅仅是这一步,如果用实验室人力来做,需要几十年。

解决方案来自一个当时刚刚出现的互联网产品:Amazon Mechanical Turk(亚马逊土耳其机器人),一个让用户完成微任务并获得少量报酬的众包平台。李飞飞的团队把标注任务拆分成每个只需要几秒钟的小问题("图里有猫吗?"),分发给全球 49,000 个众包工人。

整个项目历时两年半,跨越 167 个国家,最终完成了这项宏伟的计划,整个数据集包含:1,400 万张图片,21,841 个物体类别,而且每张图片都有人工确认的标注。

2009 年,ImageNet 数据集正式对外发布。

2010 年,以 ImageNet 的一个 1000 类子集为基础的竞赛正式开启------这就是 ILSVRC(ImageNet Large Scale Visual Recognition Challenge,ImageNet 大规模视觉识别挑战赛)。

4.1.3 特征工程的人力解放

ILSVRC 开赛后的前两年(2010、2011),竞赛的格局非常稳定,因为所有人都在用同一套工具箱。

这套工具箱来自统计学习时代:先用专家设计的算法从图片中提取特征,再把特征送进分类器。

特征提取的主力是 HOG (方向梯度直方图)和 SIFT (尺度不变特征变换)这类算法------它们是计算机视觉社区十几年研究经验的结晶,能有效捕捉图片里的边缘、角点、纹理等局部信息。提取出特征后,再用 SVM(支持向量机)做分类。

这套组合在很多场景下表现的相当出色,2010 年的冠军错误率为 28%,2011 年进步到 26%。

但这个数字背后,隐藏着一个越来越难以回避的事实:进步的速度正在逐渐放缓。

计算机视觉领域内部已经有人在私下谈论这个问题:HOG 和 SIFT 能捕捉的信息是有上限的,它们都是人设计出来的、基于特定先验假设的"特征提取规则"。一张图片里,人眼能感知到物体的材质、光照、形变、遮挡......而这些信息,没有人能用一套公式"穷举"表达出来。

换句话说,特征工程遇到了人类认知的天花板。手工设计的特征,终究只能达到设计者所能想象的复杂度。

ILSVRC 竞赛的组织者们之所以设计这个竞赛,正是为了量化这个天花板到底在哪里。2011 年,当冠军成绩从 28% 下降到 26%,仅提升 2 个百分点,很多人就已经开始在怀疑:这条路,是不是快走完了?

4.1.4 AlexNet:一个新的起点

2012 年的竞赛结果公布了。

图 4.1:2010 年和 2011 年 ImageNet 挑战赛的最佳成绩,与 2012 年所有参赛结果(包括AlexNet)的对比

第一名和第二名之间,有 11 个百分点的差距。

在任何竞赛中,11 个百分点都是巨大的差距。在 ImageNet 这种通常以 1-2 个百分点为胜负边界的竞赛里,这是一个具有绝对碾压级别的领先。

SuperVision 这个队伍------来自 Geoffrey Hinton 在多伦多大学的实验室,成员是 Hinton 本人、Alex Krizhevsky 和第三位学生 Ilya Sutskever (伊利亚·苏茨克维,1986-,俄裔加拿大计算机科学家,后成为 OpenAI 联合创始人)------他们采用的不是 HOG,不是 SIFT,不是 SVM。他们用的是一个深度卷积神经网络 ,后来被以第一作者命名,叫做 AlexNet。

消息传开之后,整个计算机视觉社区沸腾了:一方面是对结果的震惊,另一方面是一种更深的不安------这意味着我们过去十年做的所有工作,可能都是在一个错误的方向上努力。

Hinton 后来描述了竞赛结果公布时的场景。有人走过来问他:"你是怎么做到的?"他说:"我们用了 GPU。"对方一时语塞,因为那个年代,用 GPU 训练神经网络还不是常识。

这一年,成了 AI 历史的分水岭。后来的人称这个时刻为 "ImageNet Moment"------一个用来指代某个技术方向成熟并爆炸性突破的比喻短语,专门形容"那个一夜之间让所有人都不得不认真对待的时刻"。后来以 AlexNet 为代表的 CNN 家族网络,被广泛应用到医疗 AI、自动驾驶、语言模型等各个领域。

对于那些在会场里目睹这一切的计算机视觉研究者,2012 年的 ILSVRC 结果不只是一场竞赛的落幕,更是一种巨大的认知震荡:他们花了多年精心设计的 HOG 特征、SIFT 描述子、精细调参的 SVM------这一整套方法论,被一个由两个学生和一位坚持了三十年信念的老教授用两块显卡打败了。在震惊之外,是一个更深的问题:如果我们一直走错了路,那么正确的路,到底通向哪里?

4.2、AlexNet 里面有什么

在 3.8 章节中,我们就已经介绍了深度学习时代的三驾马车:数据、算力、算法。但在 AlexNet 这个具体的网络里,还有多个关键的技术决策------每一个单独看都不是新发明,但缺了任何一个,结果可能都会截然不同。

AlexNet 的每一个组件,其实都有前人的工作作为基础:卷积网络来自 LeCun 1989 年的工作,ReLU 来自 Nair 和 Hinton 2010 年的推广,Dropout 来自 Hinton 团队的早期研究,GPU 训练的可行性来自多年的基础设施准备,大规模标注数据来自李飞飞团队五年的工程努力。

AlexNet 的真正贡献,是把所有这些组件在工程上给拼在了一起,并在前所未有的规模上验证了它们的效力。

图 4.2:AlexNet 模型架构图

4.2.1 深度的力量以及特征可视化

早期的 LeNet(LeCun 1998 年)有 5 层(3 层卷积 + 2 层全连接)。AlexNet 则有 8 层(5 层卷积 + 3 层全连接)。

虽然只是加了 3 层,这 3 层的意义也不仅仅是"更多的计算",而是增加了不同层次的特征抽象。

深度网络有一个令人着迷的性质:不同层次的神经元,会自发地学习不同抽象程度的特征。

研究者在 2013 年前后开始系统地可视化 AlexNet 不同卷积层的特征(通过找到最大程度激活某个神经元的输入图片),发现了一个令人印象深刻的层次结构:

- 第一层:神经元响应边缘、颜色渐变、对角线------极其基础的视觉元素

- 第二层:神经元响应更复杂的纹理------格子、条纹、圆形

- 第三层:神经元开始响应部分形状------圆形轮廓、尖角、网格

- 第四层:神经元开始响应有语义含义的部件------眼睛、鼻子、轮子、毛皮

- 第五层:神经元响应整体目标------某种特定品种的狗、某个角度的汽车

这些特征没有人告诉网络该怎么去学。

这句话值得停下来认真想一想它意味着什么。

SIFT 特征描述子是 David Lowe 花了将近十年打磨出来的:能检测图像关键点、描述周围梯度方向的手工算法,2004 年才发表完整版本。HOG(方向梯度直方图)是 Dalal 和 Triggs 2005 年为行人检测专门设计的,背后是计算机视觉社区二十年对"什么样的图像特征有用"的经验积累。这些是领域顶级专家的心血结晶------明确的数学结构,针对特定视觉信息精心调校的参数,是人类能够写下来的关于"如何看图"的最好总结。

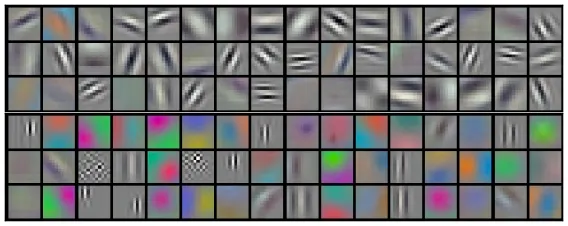

图 4.3:该图展示了第一卷积层所学习到的特征核。上方的 48 个特征点是在 GPU1 上学习得到的,下方的 48 个特征点则是在 GPU2 上学习得到的。该图表明,上方的 48 个特征点捕捉到了与颜色无关的图案,如形状、纹理和边缘等;而下方的 48 个特征点则捕捉到了与颜色相关的信息,如色彩信息。GPU1 与 GPU2 输出结果的差异是由于某些层的连接限制所导致的。

而 AlexNet 的第一层神经元,在没有任何人指导的情况下,自发学到了功能上几乎等价的东西:边缘检测器、颜色梯度提取器。这些特征,是 6000 万个参数在 120 万张图片上经历无数次梯度下降之后,从统计规律里自动凝结出来的。

2013 年,Matthew Zeiler (1985-,计算机视觉研究者,Clarifai 创始人)和 Rob Fergus (1979-,NYU 教授)发表了著名的特征可视化论文 《Visualizing and Understanding Convolutional Networks》,这篇论文实际上是 ILSVRC 2013 图像分类冠军 ZFNet 的载体,但它的夺冠成绩远不如其可视化开山之作的身份重要,它是 CNN 可解释性的起点。

需要注意的是,ZFNet 与 AlexNet 在网络结构上并没有什么本质区别,可以近似的称 ZFNet 为 AlexNet v1.1 版本。

在 ZFNet 中通过可视化手段,人们发现在 ZFNet 第四、五层,网络学到了人类从来没有显式定义过的特征层级------眼睛的形状、鼻子的轮廓、车轮的纹理、皮毛的质感,这些是任何手工特征工程方案都没有覆盖过的抽象层次。机器自己"发明"了一套比人类设计的更丰富、更有层次的视觉词汇。

图 4.4:ZFNet 网络第 4 层和第 5 层的可视化特征示例。

ZFNet 把这套层次结构系统地呈现给了整个社区。很多亲眼看到这些可视化结果的计算机视觉研究者,描述了一种难以名状的复杂感受:不只是"这个模型效果好"的惊讶,而是更深的认知震撼------

"我们花了二十年,把对视觉的理解编码成 SIFT 和 HOG 这样的算法。结果,一个梯度下降优化器在几天的训练里,自己找到了这些------还顺手发现了一些我们想都没想过的东西。"

这不只是深度学习相对于手工特征工程在效果上的改进。这是一种根本性的范式转变 :统计学习时代的核心瓶颈------"谁来决定哪些特征是有用的"------被彻底绕过了。特征由机器自己从数据中学习,不受人类先验知识的局限。

这个发现,用最简洁的方式回答了"深度学习为什么有效"这个问题:因为它让机器做了一件以前只有人类能做的事------用自己的眼光,从原始数据里发现有意义的模式。

4.2.2:ReLU------缓解梯度消失

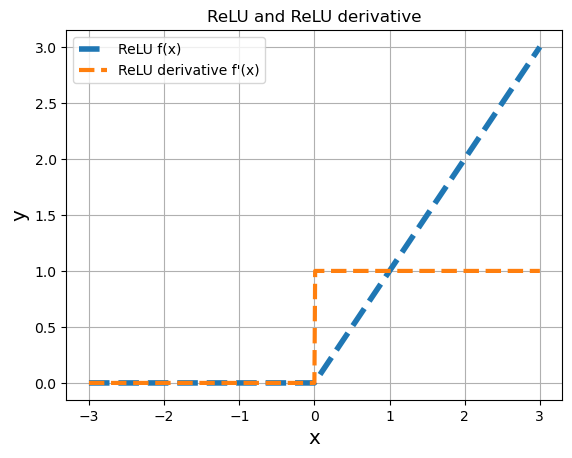

在第三章中,我们解释了梯度消失问题:Sigmoid 激活函数在 xxx 远离 0 时导数趋向 0,这会导致深层网络的前面几层几乎无法学习。

AlexNet 用 ReLU (Rectified Linear Unit)替换了 Sigmoid:

ReLU(x)=max(0,x)\text{ReLU}(x) = \max(0, x)ReLU(x)=max(0,x)

ReLU 的函数形状极其简单:xxx 为负时输出 0,xxx 为正时输出 xxx 本身。

它的导数同样简单:

- x<0x < 0x<0 时,导数 =0= 0=0

- x>0x > 0x>0 时,导数 =1= 1=1

图 4.5:ReLU 激活函数及其导数图像

这个"导数恒为 1"(在激活区域)的性质,从根本上缓解了梯度消失:通过 ReLU 激活的层,梯度可以无衰减地传播。无论网络有多深,网络前面几层收到的梯度信号,和后面网络层收到的信号一样强。

ReLU 还有一个意外的好处:稀疏激活 。当一个神经元的输入 x<0x < 0x<0 时,它的输出是 0------这个神经元对这个输入"不响应"。在一个大型网络里,在处理任意一个输入时,可能只有一小部分神经元处于激活状态。这种稀疏性有助于防止过拟合,也让计算更高效。

在 Krizhevsky 的原始论文里,有一个非常直接的比较:用 ReLU 的网络,在 CIFAR-10 数据集(比 ImageNet 小但类似的图像分类任务)上,达到 25% 训练误差需要的训练时间,是用 Sigmoid 的 4 倍。这意味着,用同样的训练时间,ReLU 网络可以训练到更好的效果。

4.2.3:Dropout------缓解网络过拟合

深度神经网络通常会有大量的参数。以 AlexNet 为例,就有约 6000 万个参数,而当时 ImageNet 训练集只有 120 万张图片。

模型参数数量远超训练样本的数量,这是过拟合的温床。一个有 6000 万参数的模型,如果不加约束,理论上可以完美地"记住"全部 120 万张训练图片------但这意味着它对新图片可能毫无泛化能力。

传统的正则化方法(L1/L2 正则化)在深度网络上效果有限,或者需要非常精细的调参。

在第三章中,我们已经介绍过 dropout 的技术方案,可为什么 dropout 的效果比较好,以下有几种不同的解释:

- 集成的效果。每次 Dropout 都得到一个不同的网络,训练结束后,预测时所有神经元都开启(权重乘以 0.5 来保持期望值不变),相当于对大量不同的子网络进行集成------类似随机森林的思路。

- 防止共同适应(Co-adaptation)。在没有 Dropout 的情况下,两个相邻神经元可能会"抱团"------A 学会了识别某个特征,B 则专门依赖 A 的输出来做判断,AB 形成一个固定的模式。这种共同适应让网络依赖特定的特征组合,而不是学习鲁棒的独立特征。Dropout 随机断开连接,迫使每个神经元学习独立的有用特征,而不能依赖其他特征"补位"。

- 噪声注入。随机关闭神经元本质上是在训练过程中注入噪声,让网络更难过拟合。

在实践中,Dropout 的效果非常显著。在 AlexNet 的原始论文中,仅仅加入 Dropout,就在 ImageNet 验证集上减少了约 2% 的错误率------在这个级别的竞赛里,这已经是不小的的改进了。

4.2.4:数据增强------扩展数据集

尽管 ImageNet 数据集中包含 120 万张图片,听起来很多,但对于一个 6000 万参数的模型来说,仍然不够。

Krizhevsky 用了一套系统性的数据增强(Data Augmentation)方法,在原始训练数据集的基础上做了很多操作,将数据集的量级"扩大"了很多倍,其中包括:

- 随机裁剪:从原始图片(256×256)随机裁出 224×224 的区域。每张图片可以这样产生大量略有不同的训练样本。

- 水平翻转:把图片左右镜像,产生新的训练样本(猫的镜像还是猫)。

- 色彩扰动(PCA 颜色增强):对图片的 RGB 值做微小的随机变化,模拟不同光照条件。

这些增强操作本质上并不改变图片的语义内容(翻转后的猫还是猫),但让模型看到了更多"略有不同"的图片,大大提高了模型对平移、翻转、光照变化的鲁棒性。

在测试阶段,他们使用同一张测试图片的 10 个不同裁剪位置的预测结果取平均(test-time augmentation),以达到进一步提升测试精度的目的。

数据增强的思想很简单,但它揭示了一个重要原则:当我们不能总是去寻找更多的原始数据时,有时候更好的方法是充分利用已有的数据------通过合理的变换,从有限的数据中提取更多的训练信号。这个方法在数据稀缺的领域(医学图像、卫星图像)尤其重要,至今仍然是深度学习工程实践的重要组成部分。

当然也需要注意这里的权衡,一般而言,数据集的质量远远高于数据集的数量要求,而数据增强手段只是当我们,无法短时间内获取更多高质量样本情况下的一种较为有效的手段。

4.2.5:GPU 与 CUDA------硬件加速器

这一点在学术文章里较少被提及,但在实际贡献上非常重要------而且它的背后也有自己的一段历史。

AlexNet 在训练阶段使用了两张 NVIDIA GTX 580 显卡,GTX 580 于 2010 年底发布,在整个 2011 年它都是 NVIDIA 消费级显卡的性能天花板。即使在 2012 年初,它依然是市面上能买到的、综合性能最强的单芯游戏显卡之一。

GTX 580 单张显卡的显存是 3 GB,而 AlexNet 最终的版本需要大约 3~4 GB 的显存来存储参数和中间激活值。因此,一张 GPU 恰好不够用。

Krizhevsky 的解决方案是把模型分散到两张 GTX 580 上,每张 GPU 负责一半的滤波器(Feature Map)。这个"模型并行"(Model Parallelism)的方案,需要仔细设计两张 GPU 之间的通信:每层的卷积运算,两张 GPU 各自处理自己的那一半;某些特定的层需要两张 GPU 交换信息。

这里值得一提的是,当时这本是对 3 GB 显存限制的工程性妥协回,可这也预示了一个的关键路径:可以把模型按结构切分,跨设备协同训练。这个思想后来在 LLM 时代演化为多维并行(数据并行、模型/张量并行、流水线并行、专家并行等)。尽管目前的显卡已经发展到单张具备几十 GB、上百 GB 的容量,但 LLM 的参数量却从千万发展到十亿、再到万亿的量级规模,如今的前沿 LLM 往往需要在成千上万张 GPU 上同时训练。

这里,还有一个更根本的问题值得回答:GPU 为什么天然适合训练神经网络?

在计算机中,CPU(中央处理器)的设计哲学是"少量极其强大的核心"------彼时的 Intel 处理器有 4-8 个核心,每个核心都可以执行复杂的指令序列,非常适合处理逻辑复杂、分支多的任务。

而 GPU 的设计哲学完全相反:它拥有大量并行的简单核心。NVIDIA 的 GTX 580 有 512 个 CUDA Cores,每个单元的能力远不如 CPU 核心,但它们可以同时并行地执行相同的计算操作。

这个并行性,与神经网络训练的计算结构完美契合。神经网络训练的核心操作是矩阵乘法:把一批输入数据(一个矩阵)乘以权重矩阵,得到激活值。矩阵乘法中每个元素的计算彼此独立------你不需要等某一行算完再算下一行。GPU 的数千个核心可以同时处理矩阵的不同部分,比 CPU 快 10-100 倍。

这扇门,是 2007 年 NVIDIA 发布 CUDA(Compute Unified Device Architecture,统一计算设备架构)打开的。

在 CUDA 之前,如果你想用 GPU 做通用计算,必须把问题"伪装"成图形渲染问题------因为 GPU 的编程接口只支持图形操作,非常繁琐。CUDA 让程序员可以用类似 C 语言的方式直接编写 GPU 程序。NVIDIA 当时的目标是工业仿真和科学计算,并没有特别针对神经网络------这对深度学习研究者来说是一个"意外的礼物"。

Krizhevsky 的 GPU 深度学习代码库(后来被称为 cuda-convnet)是最早被大规模使用的 GPU 深度学习实现之一。他在 AlexNet 论文中报告,在两张 GTX 580 上训练整个 AlexNet 需要 5-6 天;如果用等效性能的 CPU,估计需要数周。这 30-40 倍的速度差,在实践中意味着可以用同样的时间做 30-40 次不同的实验迭代------这直接加速了 AlexNet 的开发节奏。

需要说明的是,在当时并没有 cuDNN(2014 年才发布),也没有今天的主流高层框架,所以这背后的一切,并不是"调用库就行"的工程,更多是自研内核与系统级调度。因此,尽管 AlexNet 早已封存进了 AI 的历史长河之中,但当我们再次回顾这段历史的时候,依然能感触到当初这个团队,为了神经网络复兴而做出的努力与坚持。

4.3、从 AlexNet 到 "X"Net

4.3.1 VGG:深度就是力量

AlexNet 的成功立刻引发了一个问题:如果更深的网络效果更好,那么更更深的网络会怎样?

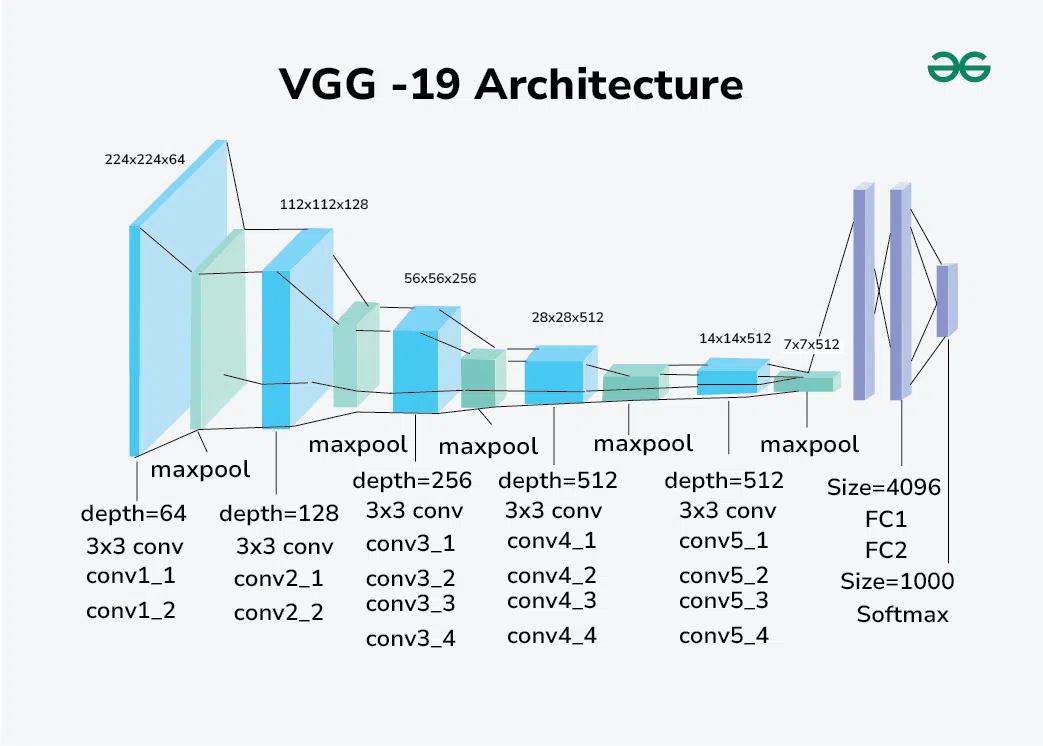

2014 年,牛津大学的 Karen Simonyan (1988-,英国计算机视觉研究者)和 Andrew Zisserman (1957-,英国计算机视觉教授,皇家学会院士)提出了 VGGNet(Visual Geometry Group Network),系统性地探索了网络深度的影响。

图 4.6:VGG 模型架构图

VGGNet 的设计原则非常简洁:

- 只用 3×3 的卷积核(而不是 AlexNet 混用的 11×11、5×5、3×3)

- 深度从 11 层增加到 19 层,每次加深 2-4 层,记录效果变化

关于为什么 VGG 只用 3×33×33×3 的卷积核?VGG 的论文给出了一个漂亮的数学论证:

以下涉及到的专业术语我们留在下一章中进行详细介绍。

两个连续的 3×33×33×3 卷积,感受野等价于一个 5×55×55×5 的卷积;而三个连续的 3×33×33×3 卷积,感受野等价于一个 7×77×77×7 卷积。但是,两个 3×33×33×3 卷积的参数数量是 2×32=182 \times 3^2 = 182×32=18,而一个 5×55×55×5 卷积的参数数量是 52=255^2 = 2552=25。三个 3×33×33×3 卷积的参数是 3×9=273 \times 9 = 273×9=27,而一个 7×77×77×7 的是 72=497^2 = 4972=49。

这意味着,用更多的小卷积核代替少数大卷积核,这样做的好处是:同样的感受野,可以用更少的参数表示,更多的层意味着可以有更多的非线性变换(因为每层都有 ReLU),这样的表达能力更强。

VGGNet 在 2014 年 ILSVRC 竞赛中拿到了分类第二名(第一名是 GoogLeNet),但它的架构因为简洁性和可解释性,成了此后数年里研究者最喜欢用的基准网络。VGG-16 和 VGG-19,至今仍然是很多任务上的可靠 baseline。

VGGNet 的实验也清楚地展示了一个结论:在一定范围内,更深的网络确实可以做到效果更好。从 11 层到 19 层,错误率持续下降。

为什么是在一定范围内?因为很快人们就发现,随着层数继续增加,一个新的问题出现了:更深的网络并不总是那么容易训练的。

4.3.2 GoogLeNet:与其选择,不如全要

同样是 2014 年,谷歌的团队提出了一个思路截然不同的网络:GoogLeNet(也称 Inception v1)。它赢得了 2014 年 ILSVRC 的分类冠军,VGGNet 是亚军。

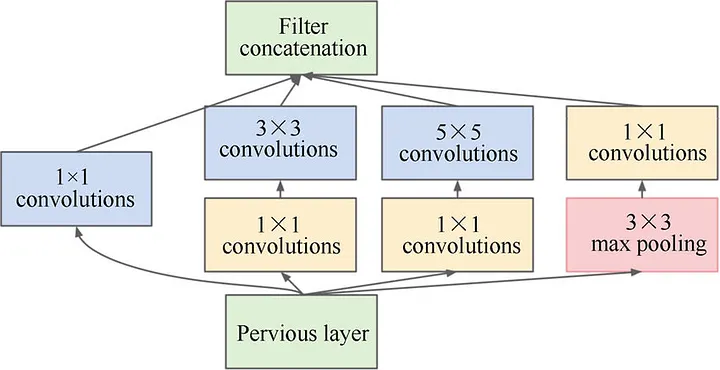

VGG 的逻辑是"往深走,统一用 3×33×33×3 卷积"。GoogLeNet 的团队则提出了一个不同的问题:卷积核的尺寸,到底应该选多大?

不同尺寸的卷积核有不同的感受野------小的卷积核(3×33×33×3)善于捕捉局部细节,大的卷积核(5×55×55×5)善于感知宏观模式。传统网络在每层选择固定尺寸,相当于人为预设"这一层应该关注这个尺度的特征",而这个预设未必正确。

GoogLeNet 的主创 Christian Szegedy (1977-,谷歌研究科学家,深度学习架构创新者)等人的回答是:不要选,全用上。

这就是 Inception 模块 的核心思想:在同一层,同时运行 1×11×11×1、3×33×33×3、5×55×55×5 的卷积,以及一个 Max Pooling 路径,然后把四条路径的输出在通道维度上拼接起来,让后面的网络自己决定哪个尺度的信息最有用。

图 4.7:GoogleNet 模型架构中的 Inception 模块示意图

这个"并行多尺度"的设计,带来了一个额外的工程难题:多条路径同时运行,计算量剧增。GoogLeNet 的解决方案是在 3×33×33×3 和 5×55×55×5 卷积前面各加一个 1×1 卷积 做"降维"------1×11×11×1 卷积乍看没有感受野上的意义,但它可以把特征图的通道数先压缩到更小的规模,再进行后续卷积,大幅减少计算量。这个"1×11×11×1 卷积先降维"的技巧,后来成了深度学习架构设计中广泛使用的工具。

GoogLeNet 整体只有约 6.8M 个参数(AlexNet 约 60M,VGG-16 约 138M),但 2014 年 ILSVRC 上的 Top-5 错误率达到 6.67%,优于 VGG-16 的 7.3%。更少的参数,更好的效果------这说明架构设计的智慧有时比堆砌规模更有价值。

4.3.3 ResNet:跨层连接的革命

2015 年,Kaiming He (何恺明,1985-,华裔计算机视觉研究者,ResNet 主创)、Xiangyu Zhang (张祥雨)和 Shaoqing Ren (任少卿)等人提出了 ResNet(残差网络)。

这个工作回答了一个看似简单的问题:为什么当网络层数超过一定深度(比如 50 层以上),训练误差不降反而会上升?

直觉上,更深的网络应该至少和浅层网络一样好------因为理论上深层网络可以把多余的层训练成"恒等映射"(直接把输入传递到输出,什么都不做),从而退化成浅层网络即可。

但在实践中,人们发现很难训练深层网络的某些层学习恒等映射。梯度消失(即使有 ReLU 也不能完全消除)问题、权重初始化的问题,让超深网络的训练变得很不稳定。

He 等人的洞察是:与其让层直接学习"什么样的输出最好",不如让层学习"输出应该在输入的基础上改变什么"。

这就是残差连接(Residual Connection)的思想:

图 4.8:残差块连接示意图

在每个残差块里,除了正常的卷积路径,还添加一条跳跃连接(Skip Connection):直接把输入加到卷积路径的输出上。

输出=F(x)+x\text{输出} = F(x) + x输出=F(x)+x

其中 F(x)F(x)F(x) 是这个块需要"学习的残差"(输入和理想输出之间的差值),xxx 是输入。

接下来我们可以从不同的视角看待这个非凡的残差结构:

- 从优化的角度 :如果最优解接近恒等映射(这个层基本不需要做什么),那么 F(x)F(x)F(x) 学习趋向于 0 就好了------而学习"接近 0"比学习"恒等变换"容易得多。

- 从梯度的角度 :残差连接提供了一条梯度的"高速公路"。即使 F(x)F(x)F(x) 这条路的梯度很小,跳跃连接这条路的梯度是 1(对 xxx 的偏导数是 1),梯度可以直接流回前面的层,完全绕过了梯度消失的问题。

ResNet 的比赛结果是惊人的。ResNet-152(152 层)在 2015 年 ILSVRC 上取得了 3.57% 的 Top-5 错误率------首次低于人类在同样任务上的估计错误率(约 5%)。

150 层的网络,比人类识别图像更准确(在这个特定的任务设定下)。

而且,训练 150 层网络,比训练 VGG-19 还更容易------因为残差连接解决了超深网络的训练难题。何恺明在那篇论文里还展示了 1000 层的网络,训练也能收敛,这在 ResNet 之前是完全不可想象的。

ResNet 获得了 2015 年 ILSVRC 所有子任务(分类、检测、定位)的冠军。何恺明也因为这项工作,获得了 CVPR 2016 最佳论文奖。

残差连接思想具有极其深远的影响,以至于后来发展的 Transformer (第八章)架构,以及以 Transformer 为核心的现代 LLM 模型架构中,ResNet 这种残差连接架构无处不在,毫不夸张的说,这已经是现代神经网络架构中必不可缺的一个重要组件。

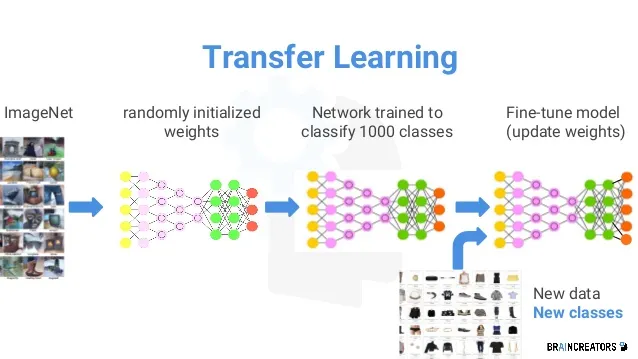

4.4、迁移学习范式

AlexNet 成功后,研究者们很快发现了一件令人意外的事:在 ImageNet 上预训练的网络,模型学到的特征在其他视觉任务上也很有帮助。 这在 2013-2014 年期间,有几篇论文展示了这个发现。

例如我们可以下载已经在 ImageNet 数据集上训练好的 AlexNet 模型,将网络中最后的分类层参数去掉,然后重新接入新的分类层,并将其"移植"到一个完全不同的任务------比如识别医学图像中的病变、识别卫星图像中的建筑物、识别显微镜图像中的细胞类型等等场景。

结果这个组合的模型在新任务上的表现令人吃惊:即使这个新任务和 ImageNet 的 1000 类猫狗完全没有关系,ImageNet 预训练的参数值也往往是一个非常好的起点,远比从随机初始化开始训练效果更好------而且往往只需要更少的新数据就能达到很好的效果。

这是为什么呢?

记得我们说过,深度网络的前几层会自发地学习边缘、纹理、形状这样的基础视觉特征。这些基础特征是领域无关的------无论是猫、医学图像还是卫星图像,都由边缘、纹理、形状构成。因此在 ImageNet 上学到的这些基础特征,可以作为任何视觉任务的通用起点。换句话说,网络除了最后几层与具体任务强相关,前面的网络层可以作为通用特征提取器使用。

这就是迁移学习(Transfer Learning)的核心思想:

先在大规模数据上学习通用的特征(预训练),然后将其移植到新任务的小数据上调整(微调)。

这个发现,解决了统计学习时代的一个根本瓶颈:跨领域迁移能力的缺失。

因此,那从一刻开始,当我们需要解决新的视觉问题,通常我们不需要再为每个新任务从零收集大量的标注数据,也不再需要为每个领域重新设计特征。而是选择:

- 直接用 ImageNet 预训练好的特征作为基础

- 然后在具体的新任务上用少量领域内数据进行微调

这个范式在 2013-2016 年迅速扩展到了医疗影像、遥感卫星、工业质检等几乎所有视觉相关领域,彻底改变了 AI 应用开发的工作方式。

因此迁移学习也改变了构建 AI 系统的经济学。

在手工特征时代,若想在医疗影像上做肿瘤检测任务,通常需要以下几个繁琐步骤:招募有医学背景的工程师进行相关的设计特征;由行业积累并标注几万张 CT 图像;工程师需要从零开始训练整个模型。这是大医院或顶级科研机构才能负担的起点门槛。

有了 ImageNet 预训练模型,一个普通的工程团队可以做到如下几个简易步骤:下载公开的预训练权重;从相关行业收集几百张带有标注的 X 光片;工程师只需要简单的嫁接操作,即可在预训练模型上微调。2013-2014 年,多项研究展示,这样的做法在医学图像识别上,效果甚至优于从零训练的专用模型。

这个改变对后来的 AI 发展产生了极其深远的影响。在此之前,AI 系统的开发是资源密集型的,只有少数拥有大量数据和算力的机构才有能力玩得起。迁移学习第一次让这扇门向更多人打开。一个创业公司,一个资源有限的医院,甚至一个勤奋的研究生,都可以站在 ImageNet 预训练的肩膀上,去解决自己领域的具体问题。

从更长远的视角看,迁移学习还埋下了一颗重要的种子------"先在大规模数据上预训练,再针对具体任务微调"这个思路,在 2018 年的 BERT 和 GPT(第九章)时代,会在语言领域得到规模上的全面放大,彻底改变整个 AI 行业的开发模式。迁移学习是这个范式在视觉领域的第一次完整实验。

图 4.9:迁移学习的工作流程

4.5、深度学习如何席卷其他领域

深度学习在 2012 年的冲击,并不只局限在图像领域,由于其在视觉任务结果上的大幅度领先,以及其高效的特征抽取模式,深度学习很快便席卷到其他如语音识别、自然语言处理、强化学习等众多领域中。

4.5.1 语音识别:声音也是一种模式

在介绍深度学习如何应用于语音识别领域之前,我们需要先了解,在这之前的语音识别是怎么工作的。

语音识别领域在 2012 年之前,被一套叫做 HMM+GMM 的组合统治了将近三十年:隐马尔可夫模型 (Hidden Markov Model)负责对语音序列的时间结构建模,高斯混合模型(Gaussian Mixture Model)负责对每个音素的声学特征建模。这套框架经过无数研究者的打磨,已经极度复杂和精细,任何改进都需要对整个系统的各个模块有深入理解才能下手。

它的核心局限和手工视觉特征类似:HMM+GMM 对语音特征的建模,也依赖于人工设计的声学假设,而这些假设在面对自然语音的复杂变化时(不同口音、环境噪声、说话速度)显得格外脆弱。

2012 年晚些时候,Hinton 和他的学生 George Dahl 与微软研究院合作,将深度神经网络(DNN)应用于语音识别中的声学模型部分,直接替换掉了 GMM。他们在工业级语音识别基准上展示的效果,远超 HMM+GMM 组合,将语音识别的错误率降低了 30% 以上。

消息传到谷歌时,谷歌语音团队迅速行动:在几周内复现了结果,把深度神经网络整合进了谷歌的语音输入系统。到 2012 年底,谷歌的语音识别错误率下降了约 20%。这是数亿用户能感知到的改变------Siri、谷歌语音搜索的识别准确率,在那段时间出现了明显的跳升。

语音识别社区的反应,和视觉社区高度相似:最初的否认,然后是复现、震惊,最后是数年之内整个领域的转向。HMM+GMM 框架积累的大量研究成果,在几年内基本被束之高阁,DNN 成为新的标准。

4.5.2 自然语言处理:词向量的建模

2013 年,深度学习进入了自然语言处理领域,带来了一个改变整个 NLP 研究方式的工具:Word2Vec。

Tomas Mikolov(1984-,捷克计算机科学家,Word2Vec 发明者)和他的团队,提出了一个看起来有些奇怪的训练任务:给定一个词,预测它周围的词(Skip-gram 模式);或者反过来,给定周围的词,预测中间的词(CBOW 模式)。

训练这个任务本身并不是目的------Mikolov 真正关心的是模型在内部学到的词的向量表示(Word Embedding):每个词被编码成一个高维空间中的一个点(通常是 100-300 维向量)。

这些向量揭示了一件令人惊讶的事情:意思相近的词,它们在向量空间里距离也相近。

这听起来不算惊人,因为你可以想象手工做一个这样的词典。真正惊人的是更进一步的发现------向量之间的方向关系 编码了词义关系:

国王⃗−男人⃗+女人⃗≈王后⃗\vec{\text{国王}} - \vec{\text{男人}} + \vec{\text{女人}} \approx \vec{\text{王后}}国王 −男人 +女人 ≈王后

这说明 Word2Vec 学到的不是词语的表面形式,而是词语背后的关系结构------这些关系没有被任何人显式地告诉模型,而是从海量文本的统计规律中自发涌现出来的。

Word2Vec 的影响立竿见影。在它发布之前,NLP 模型处理词语的方式通常是"独热编码"(One-hot Encoding):词表里有 10 万个词,每个词就是一个 10 万维的稀疏向量,只有对应位置是 1,其他全是 0。这种表示完全没有捕捉词之间的语义关系。Word2Vec 为 NLP 研究者提供了有效的一种稠密的、有语义含义的词表示,直接提升了机器翻译、情感分析、问答系统等下游任务的基础性能。

更重要的是,它揭示了一个深层原理:"预测下一个词"这类自监督的任务,可以迫使模型去学习语言的语义结构,而不需要任何人工标注的语义知识。 这个原理,在五年后的 BERT 和 GPT 时代会被推到极致(第九章)。

图 4.10:Word2Vec 的词向量语义空间

4.5.3 强化学习:从手工规则到自我博弈

在与深度学习结合之前,强化学习还是一个比较小众的研究领域,这是因为传统的强化学习在解决现实问题时,面临着一个根本性的瓶颈:它只能处理状态空间较小、可以手工设计特征的小问题。

传统强化学习的工作方式,需要研究者把环境状态------例如棋盘局面、游戏画面------手工转化成一个紧凑的特征向量,再在这个向量上运行诸如 Q-learning 等算法。这和统计机器学习时代的手工特征工程如出一辙:你首先需要告诉机器"什么是重要的信息",它才能学习。而对于围棋或 Atari 电子游戏这类高维问题------一帧游戏画面就有数万个像素------传统方法根本无从下手。

2013 年,DeepMind 的研究团队提出了 DQN(Deep Q-Network):用卷积神经网络直接从游戏的原始像素图像中提取特征,再用 Q-learning 在这些特征上学习"哪个动作能带来最多长期收益"。训练信号只有游戏得分------不需要任何人工设计的规则或特征。

其结果令整个 AI 界瞠目。DQN 在 49 款 Atari 经典游戏上达到了超越人类的表现,而它看到的只是和普通玩家完全相同的游戏画面。对于乒乓球、太空侵略者等游戏,DQN 甚至找到了人类从未想到过的策略。这篇论文 2015 年发表于《Nature》,是深度学习进入强化学习领域的标志性成果。

深度神经网络是万能函数逼近器 。它可以将高维的原始输入(如像素)映射到低维的抽象特征,并泛化到相似但未见过的情况。而这正是传统 RL 最欠缺的能力。

更大的震撼在三年后到来。2016 年,DeepMind 的 AlphaGo 结合了深度强化学习(策略网络与价值网络)和蒙特卡洛树搜索,击败了围棋世界冠军李世石 (이세돌,1983-,韩国职业棋手)。围棋的状态空间约为 1017010^{170}10170,远超国际象棋,被许多人视为人类智慧最复杂的棋盘游戏。AI 在此的突破早于几乎所有人的预判,也宣告了深度强化学习从"实验室玩具"走向真实复杂问题的临界点。

深度强化学习与本书后续有一条重要的叙事线索:第十二章要讨论的 RLHF(基于人类反馈的强化学习),正是借用了强化学习的框架来"训练"大语言模型的价值取向------让模型学习什么样的回答是人类满意的,而不只是什么词的预测概率最高。

4.6、为什么深度学习这么有效

4.6.1 端到端学习

在统计学习时代,一个典型的 AI 系统通常有很多独立的模块,每个模块负责整个流程中的一部分,例如以图像识别任务为例,通常的流程是:

图像 → [预处理] → [特征提取(HOG/SIFT)] → [降维(PCA)] → [分类器(SVM)] → 输出每个模块都需要单独设计、单独优化。这些模块之间的"接口"是固定的------单纯优化特征提取,不一定对后面的分类器有帮助;单纯优化分类器,反过来也不能改变特征提取的方式。

这种架构有一个根本性的问题:各个模块的优化目标不完全对齐。特征提取器被优化为"提取出有区分度的特征",分类器被优化为"在给定特征上分类准确",但二者合在一起,不一定能在最终任务上取得最好的效果。

而深度学习则采用一个统一的网络,端到端地从原始输入直接到最终输出:

图像 → [深度网络,整体优化] → 输出在这个端到端的优化框架里,所有层的参数都针对同一个损失函数一起调整。前面层提取什么特征,完全由"这些特征对最终分类是否有用"来决定,而不是由工程师的先验来决定。

一个直观的类比:传统 AI 系统像一个由不同科室构成的医院,挂号、诊断、化验、治疗各自独立优化自己的流程,整体效率未必最优;深度学习更像一个经过整体训练的全科医生,每一步都服务于同一个目标。

端到端学习的本质,是把人类难以表达的知识("什么样的特征对这个任务有用"),转化成了可以被数据驱动优化的计算过程。

4.6.2 层次化表示

深度网络学习的是层次化的特征表示(Hierarchical Representation)。

不同层次的神经元响应不同抽象层次的模式:边缘 → 纹理 → 形状 → 部件 → 整体。

这种层次化的结构,和人类视觉皮层的组织有一定的相似性(尽管这只是类比,深度学习并不是生物仿真工程)。

更重要的是,这种层次化表示是可复用的------例如,视觉网络学到的低层特征(边缘、纹理)是任何视觉任务都需要的,所以可以被很好的迁移到不同的任务上。这是迁移学习有效的根本原因。

4.6.3 参数共享与归纳偏置

深度学习网络并不是简单地堆砌参数。通常,好的网络架构,会对问题的结构做出合理的假设(归纳偏置,Inductive Bias),从而大幅减少所需的参数数量和数据量。

例如,在视觉任务中,卷积网络的假设是:同一种特征在图像不同位置上的识别方式是一样的(平移等变性)。因此,同一个卷积滤波器可以被用到图像的所有位置------这就是"权重共享"。

这个假设让卷积网络的参数数量,比同等感受野的全连接网络少了几个数量级。一个 11×11×311×11×311×11×3 的卷积滤波器(363 个参数)被应用到 224×224224×224224×224 的图像的每个位置,而如果用全连接层做同样的事,需要 224×224×3×96≈1440224 \times 224 \times 3 \times 96 \approx 1440224×224×3×96≈1440 万个参数(AlexNet 第一层的 96 个滤波器)。

归纳偏置的选择,是深度学习架构设计中最核心的工程判断。选对了偏置,模型就能高效学习;选错了偏置,模型效果很差或者需要大量数据才能弥补。

这个原理解释了为什么深度学习不是"一个可以解决所有问题的神奇算法":不同数据结构需要不同的归纳偏置。图像数据有空间局部性(相邻像素相关),卷积是正确的归纳偏置;语音数据有时间序列性,RNN 是自然选择;文本数据有长程语义依赖,后来的 Transformer 用注意力机制来表达。这些本质上,都是研究者在某类数据上找到的更合适的归纳偏置。

4.6.4 量变到质变

深度学习在 2012 年的成功,不只是算法上的进步,也是规模上的飞跃。AlexNet 有 6000 万参数,比 LeNet-5(约 6 万参数)多了 1000 倍;ImageNet 有 120 万张训练图片,比 MNIST 多了 17 倍;双 GPU 训练的算力,是十年前单台服务器的几个数量级倍数。

这里有一个关键的现象,在这个时代已经开始被研究者隐约察觉:深度学习里,规模往往不只是让效果"稍微好一点",而是让某些新能力涌现出来。

AlexNet 的特征可视化实验就是一个例子:前几层自发地学到了颜色边缘和纹理,中间层学到了部件,高层学到了物体类别------这种层次化的语义特征,从来没有人告诉网络应该学,而是从 120 万张图片的训练中自发涌现出来的。这种"自发涌现"在规模更小的网络上是看不到的:你需要足够的参数、足够的数据、足够的训练,才能让这种结构性学习发生。

这和统计学习时代的经验形成了鲜明对比:在 SVM、决策树、朴素贝叶斯的时代,更多的数据通常带来性能的平滑提升,但规模的增加不会带来质变;而在深度学习时代,研究者开始注意到,越过某个规模门槛,模型的行为可能发生质的改变。

这个直觉性的观察,将在 2020 年的规模定律 (Scaling Laws,第十章)研究里得到系统性的量化,并在大语言模型时代引发出"规模就是智能"这个极具争议的命题。但它的种子,在 AlexNet 和 ResNet 的时代,已经以一种感性的方式植入了研究者的思维------当你把规模推到够大,模型会开始做一些它之前做不到的事情。这个原理也有一层朴素的工程含义:也许我们并不需要总是去寻找更精妙的算法,有时候最直接的提升,是更多数据加上更多算力。

4.7、深度学习的边界与局限

4.7.1 数据饥渴

深度神经网络的训练时需要大量的标注数据。ImageNet 的成功建立在 1400 万张标注图片上,这背后是数年的人工标注工作。

在数据丰富的领域(互联网图像、语音、文本),这不是大问题。但在数据稀缺的领域(罕见疾病的医学图像、航天器故障数据、高价值工业缺陷),深度学习的效果仍然受到严重限制。

即使有了迁移学习,当目标领域和预训练领域差异很大时(比如用 ImageNet 预训练的特征来做显微镜图像分析),迁移的效果也是有限的。

如何让深度学习在小数据场景下工作良好------少样本学习(Few-shot Learning)、零样本学习(Zero-shot Learning)、自监督学习(Self-supervised Learning)------成了 2016 年之后 AI 研究的重要方向。

数据饥渴的问题还有一个容易被忽视的维度:标注成本。ImageNet 的 1400 万张图片,标注本身就耗费了数年时间和大量人力。在医疗领域,给一张 CT 图像打标注,需要有执照的放射科医生,每张图的标注成本可能是几十到几百元人民币。收集 10 万张有标注的医学影像,意味着数百万元的标注费用,这对绝大多数医疗机构和研究团队来说根本不现实。数据饥渴不只是"数据量不够",更是"有标注的数据太贵"。

4.7.2 黑盒与可解释性

深度网络尽管可以做出了一个很不错的预测结果,但它通常无法告诉你为什么。

在医疗、法律、金融等高风险决策领域,"黑盒"是一个严重的问题。监管机构要求可解释性,临床医生需要知道模型关注的是什么,用户有权利知道自动化决策的依据。

在 2013-2016 年期间,有大量研究人员对此进行了深入地可解释性研究:Saliency Map(显著性图)、Grad-CAM(梯度加权激活映射)、LIME(局部可解释模型无关解释)......这些方法试图"打开黑盒",展示网络在做预测时关注的是图像的哪个区域。

但这些方法都是事后解释(Post-hoc Explanation),而不是模型本身的内置可解释性。真正让模型在做决定时"说清楚自己在想什么",仍然是一个开放问题,在大语言模型时代变得更加重要。

可解释性的困难还体现在另一个层面:即使你用 Grad-CAM 看到了模型"在看图片的哪个区域",也不代表你真正理解了模型的决策逻辑。模型可能出于完全错误的理由做出了正确的预测------比如识别出"哈士奇"是因为图片背景有雪,而不是因为认出了哈士奇的特征。这种"捷径学习"(Shortcut Learning)在需要高可靠性的场景下是致命的,它让模型在分布内数据上表现优秀,在分布偏移时一败涂地。

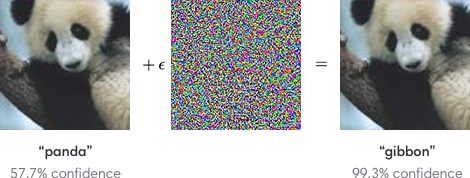

4.7.3 对抗性样本:令人不安的脆弱性

2014 年,Christian Szegedy 等人发现了一个令人不安的现象:

在图像上添加人眼完全无法察觉的微小扰动,就可以让深度网络做出完全错误的判断------而且往往是以极高的置信度。

图 4.11:对抗样本示例

例如,在上图中,一张被 GoogLeNet 以 57.7% 置信度识别为"熊猫"的图片,在每个像素上加上幅度极小的特定扰动之后,模型会以 99.3% 的置信度认为它是一只"长臂猿"------但人眼根本看不出这种扰动前后的差异。

这类被精心构造来欺骗神经网络的图片,被称为对抗性样本(Adversarial Examples)。

对抗样本的存在,揭示了一件深层的事情:深度网络所学到的分类规则,和人类视觉系统的工作方式存在根本性的偏离。人眼识别一只熊猫,靠的是整体轮廓、黑白配色、毛发质感等高度冗余的综合线索;而深度网络实际上在高维像素空间里学到了一种数学边界,这个边界在人类完全看不见的"方向"上极度脆弱------攻击者只需要沿着这个脆弱方向施加微小的扰动,就能把模型"推"过边界,让它做出荒谬的判断。

更令人不安的是,这种脆弱性并不是某一具体网络模型特有的弱点,而是被后续研究证明是深度学习的普遍性质------甚至包括后来的 Transformer 无一幸免。而且构造对抗样本并不需要很高的计算成本,2014 年 Goodfellow 等人提出了一种仅需一步梯度计算的高效攻击方法(FGSM,Fast Gradient Sign Method),让对抗攻击的门槛大幅降低。

在实际应用中,对抗样本是一个严重的安全威胁:自动驾驶的感知系统可能被特制的路标贴纸欺骗,人脸识别系统可能被特制图案的眼镜欺骗,医疗图像分析系统可能被微小的像素干扰误导诊断------而这些攻击在肉眼下完全无法发现。

研究者为此提出了各种防御手段:对抗训练(把对抗样本加入训练集)、认证防御(从数学上证明模型在一定扰动范围内的稳健性)......但每种防御都被随后发现了新的绕过方法。对抗鲁棒性(Adversarial Robustness)至今仍是深度学习安全研究中最棘手的开放问题之一,它不是一个工程 bug,而是揭示了当前深度学习范式的某种根本局限。

4.7.4 超参数调优:深度学习的工程黑暗面

深度学习的成功,往往在论文里只表现为干净的架构图和亮眼的实验数字。但这些结果背后,隐藏着一个鲜少被系统讨论的工程现实:超参数调优在这个时代,是一场高度依赖直觉和耐心的拉锯战。

一个 AlexNet 规模的网络,需要同时调整的超参数包括:学习率(太高则训练发散,太低则收敛极慢)、学习率衰减策略(什么时候降、按什么速率降)、权重衰减系数(L2 正则化的强度)、Dropout 比例(0.3?0.5?不同层用不同比例?)、批次大小(大 batch 训练快但泛化可能变差)、权重初始化方案。这些超参数之间有复杂的交互效应:学习率和批次大小耦合------batch size 翻倍时,学习率通常也需要相应调整;Dropout 和权重衰减有时一个就够,有时两个都需要。

更棘手的是:每次实验,意味着等待五六天。训练 AlexNet 在两张 GTX 580 上需要约一周,改一个超参数就要重等一周看结果。研究者实际能进行的实验迭代极其有限,而统计学习时代的网格搜索------跑几百种超参组合只需要几小时------在深度学习尤其早期时代根本做不到。

这个"等待成本",直接塑造了深度学习这个时代的研究文化:靠直觉判断大方向,靠经验选起始点,靠运气碰到好的组合。很多 2012-2016 年的论文里,有这样的表述:"我们通过大量实验发现...""经过广泛的超参数搜索..."------这些措辞背后,是无数次等待了将近一周才拿到结果的实验。

这也是早期深度学习复现性差的根本原因:两个团队用同一篇论文描述的架构,因为随机种子不同、初始化细节有差异、硬件型号不一致,往往会得到差异悬殊的结果。ICLR 2016 有一篇被引用广泛的论文专门研究过这个问题,它发现相同架构在不同实现下性能差距可以超过 5 个百分点------这在 ImageNet 竞赛级别的精度争夺中是决定性的差距。

系统性解决超参数调优问题,需要等到更快的硬件(2016 年之后 NVIDIA Tesla 系列的大幅提速)、自动化调参工具(贝叶斯优化、Population-Based Training 等方法在 2016 年后逐渐成熟),以及云计算使并行实验变得可行。但在深度学习革命的头几年,这种痛苦是真实的工程现实,它深深地刻在了这一代 AI 研究者的工作习惯里。如果你今天和一个 2012-2015 年入行的深度学习工程师聊天,大概率能听到他们对"超参调优的手感"的执着------因为在那个没有自动化工具的年代,手感就是生产力。

4.8、2013 年:产业界的入场

4.8.1 科技巨头的押注

2012 年 AlexNet 的论文并没有立刻引起业界的关注。毕竟它只是一篇学术论文,在一个图像识别竞赛上取得了好成绩。

但 Hinton 和他的学生们很清楚这意味着什么。2012 年底,Hinton 做了一个在学术圈颇为罕见的决定:他把即将毕业的博士生------包括 Ilya Sutskever(后来的 OpenAI 联合创始人)------组成了一家公司,叫做 DNN Research,然后把这家公司放在网上拍卖。

谷歌、微软、百度都表现出了浓厚的兴趣。

拍卖在 2013 年 3 月结束:谷歌以 4400 万美元收购了 DNN Research,以及 Hinton 和他的两个学生。

同年,谷歌还收购了 DeepMind(以约 4 亿美元)。脸书(Facebook)则聘请了 Yann LeCun,让他在纽约建立了 Facebook AI Research(FAIR)实验室。百度在同年宣布,吸引 Andrew Ng 加入,组建了百度硅谷 AI 实验室,开始押注深度学习在搜索和语音识别上的应用。

在短短几个月内,全球最大的几家科技公司,都用真金白银表达了他们对深度学习的判断。

这不只是学术界的革命,而是整个 AI 产业的重新洗牌。

研究者的价值,在一夜之间重新被定义。懂深度学习的博士,从一个"学了一个冷门方向"的尴尬角色,变成了硅谷争抢的顶级人才。这种人才价值的变化,在接下来的十年里持续发酵,推高了整个 AI 领域研究人员的薪资,也加速了 AI 人才从学术界向产业界的流动。

值得一提的是 Hinton 创立 DNN Research 并拍卖公司的方式------这在学术圈是极为罕见的操作,这也反映了 Hinton 对自己研究成果商业价值的清醒判断。据报道,谷歌、微软、百度在竞拍中相互抬价,出价从最初的几百万美元迅速升至 4400 万美元。这场拍卖本身,象征着 AI 学术成果向商业价值转化方式的根本性转变------过去是公司去研究所合作,现在是巨头争抢人,而且是在拍卖会上用现金的方式抢人。Andrew Ng 加入百度这件事,也意味着全球 AI 人才争夺的战场扩展到了中国,拉开了中国科技巨头在 AI 领域大规模投入的序幕。

4.8.2 深度学习框架的诞生

产业界的入场,推动了另一个重要的基础设施建设:深度学习框架。

早期的深度学习研究,每个实验室都有自己的代码库,互相不兼容。要复现一篇论文的结果,往往需要从头重新实现整个训练流程。这种状态显然无法支撑产业化的需求。

2012-2015 年,有多个深度学习框架先后诞生:

- Theano(蒙特利尔大学,2010 年,是第一个被广泛使用的深度学习框架)

- Caffe(UCBerkeley,2013 年,以速度和易用性著称,在工业界早期广泛使用)

- Torch(Facebook,2002 年原始版,2013 年前后被 LeCun 团队在工业深度学习中大量使用)

- TensorFlow(谷歌,2015 年开源)

- PyTorch(Facebook,2016 年,以动态计算图和 Python 友好著称)

今天,PyTorch 和 TensorFlow 是最主流的两个深度学习框架,几乎所有的 AI 研究和产品开发都在它们之上完成。两个框架最终走向了不同的市场定位:TensorFlow 的静态计算图设计更适合生产部署,被谷歌的工程团队大规模使用;PyTorch 的动态计算图让调试和实验更方便,逐渐赢得了学术研究者的青睐。一篇论文用哪个框架,在很长时间里几乎成了判断作者来自工业界还是学术界的隐形标签。

这种"工具的民主化",让更多的工程师和研究者能够进入 AI 领域,大大加速了整个领域的发展速度。框架的出现,把深度学习从"少数能写 CUDA 代码的人才能玩"变成了"有 Python 基础就能入门"------一个在校学生,不再需要从头手写反向传播,只需要用 PyTorch 定义几行代码,就能复现顶会论文的核心结果。这是深度学习能在短短几年内扩散到几乎每个领域的重要基础设施原因之一。

4.9、知识自检

读完本章,你应该能做到:

- 描述 2012 年 ILSVRC 竞赛的结果,解释为什么 11 个百分点的差距是"地震级别"的

- 用"三块拼图"框架解释深度学习为何在 2012 年爆发,而不是 2009 年或 2015 年------三块各自是什么,为何缺一不可

- 分析 AlexNet 成功的五个关键组件(深度、ReLU、Dropout、数据增强、GPU/CUDA),说明每个组件解决了什么具体问题

- 解释 GPU 为什么天然适合神经网络训练,CUDA 在这里扮演了什么角色

- 解释为什么深度网络会自发地在不同层次学习不同抽象程度的特征

- 用"归纳偏置"的概念解释卷积网络比全连接网络更适合图像处理的原因

- 描述 ResNet 的残差连接解决了什么问题,以及为什么它让超过 100 层的网络变得可训练

- 解释 GoogLeNet 的 Inception 模块的核心思想,以及 1×1 卷积在其中的作用

- 解释迁移学习的工作方式,以及为什么 ImageNet 预训练的特征可以迁移到完全不同的任务

- 说出深度学习的三个主要局限(数据饥渴、黑盒可解释性、对抗样本),并解释每个局限的本质

- 解释为什么 2012-2015 年的深度学习超参数调优主要靠直觉,而统计学习时代可以系统地做网格搜索

- 用"规模改变本质"这个原理,解释 AlexNet 的特征可视化现象,以及它如何预示了后来的规模定律

4.10、常见误解

❌ "深度学习的突破主要靠算法创新,数据只是燃料"

✅ 实际上:2012 年的深度学习革命,是"数据 × 算力 × 算法"三者同时成熟的结果,缺一不可。ImageNet 的 1400 万张标注图片和李飞飞五年的工程努力,与 AlexNet 的算法改进同等重要------没有足够大的标注数据集,ReLU 和 Dropout 只是让一个在小数据集上容易过拟合的大网络稍微好训练一点。此后大规模数据集的收集和质量,成了 AI 竞争最核心的战场之一,绝非偶然。

❌ "AlexNet 是深度学习的发明,之前没有深度神经网络"✅ 实际上:深度神经网络的概念可以追溯到 1980 年代,LeNet(1989 年)已经是一个成熟的深度卷积网络。AlexNet 的贡献是:在前所未有的规模(ImageNet 数据集、双 GPU)上验证了深度卷积网络的有效性,并集成了 ReLU、Dropout、数据增强等关键改进,使大规模训练变得可行。它是"临界点",不是"起点"。

❌ "深度学习之所以有效,是因为它模拟了大脑的工作方式"✅ 实际上:深度学习的成功建立在数学优化和大数据之上。深度网络的层次化特征学习,与视觉皮层的组织有一定的表面相似性,但这是类比,不是因果关系。真正让深度学习有效的是:端到端的梯度优化、合理的归纳偏置(如卷积的平移等变性),以及大规模数据和算力的同时成熟。

❌ "Dropout 在测试时也随机关闭神经元"✅ 实际上:Dropout 只在训练时使用,测试时所有神经元都开启,但权重会相应地缩放(乘以保留概率)以保持期望输出不变。现代深度学习框架会自动处理这个转换,调用

model.eval()即可切换到测试模式。

❌ "ResNet 越深越好,越多层越强"✅ 实际上:ResNet 让超深网络变得可训练,但可训练不等于一定更好。网络深度有边际效益递减,而且更深的网络训练成本更高、推理更慢。实际上最常用的是 ResNet-50(50层)和 ResNet-101(101层),而不是 ResNet-1000。深度是一个需要权衡的超参数。

❌ "深度学习已经解决了计算机视觉问题"✅ 实际上:深度学习在标准基准测试(如 ImageNet)上超越了人类,但这个"人类水平"是在特定条件下测量的(1000类、单帧图像、有限干扰)。在真实世界的复杂场景下------长尾分布、对抗攻击、光照变化、遮挡------深度视觉系统仍然远不如人类鲁棒。自动驾驶的感知系统至今仍在处理各种边缘案例,这就是最好的证明。

❌ "深度学习调超参数,随便试试就行,影响不大"✅ 实际上:超参数调优在深度学习早期是极其痛苦的工程挑战。学习率差一个数量级,训练可能根本不收敛;Dropout 比例选错,过拟合和欠拟合之间差距可达 10 个百分点;批次大小和学习率之间有耦合关系。2012-2015 年,每次实验需要 5-6 天,研究者只能靠直觉和经验,这也是早期深度学习复现性差的核心原因。今天的 Adam 优化器、自动化调参工具和更快的硬件,极大地缓解了这个问题,但"超参数调优"依然是深度学习工程中最需要经验判断的环节之一。

本章关键词

| 词汇 | 简明定义 |

|---|---|

| AlexNet | 2012年 Krizhevsky 等人提出的深度卷积网络,在 ILSVRC 以大幅领先成绩引爆深度学习革命 |

| Top-5 错误率 | 模型给出 5 个预测,只要正确答案在其中就算对的评估指标 |

| ReLU(整流线性单元) | max(0,x)\max(0,x)max(0,x),正区间导数恒为1,解决梯度消失,是现代深度网络的标准激活函数 |

| Dropout | 训练时随机关闭一定比例神经元的正则化技术,有效防止过拟合 |

| 数据增强(Data Augmentation) | 通过随机翻转、裁剪、色彩扰动等变换人工扩大训练集 |

| CUDA | NVIDIA 2007年发布的通用 GPU 编程框架,使神经网络的 GPU 加速成为可能 |

| VGGNet | 2014年牛津大学提出,证明了小卷积核(3×3)堆叠深度是提升性能的有效策略 |

| GoogLeNet / Inception 模块 | 2014年谷歌提出,在同一层并行运行多种尺寸卷积核,以多尺度特征融合赢得 ILSVRC 冠军 |

| ResNet(残差网络) | 2015年 He 等人提出,通过残差连接使超深网络(150层+)可训练,首次超越人类水平 |

| 残差连接(Residual Connection) | 输出=F(x)+x输出 = F(x) + x输出=F(x)+x,为梯度提供高速通路,使超深网络的训练成为可能 |

| 迁移学习(Transfer Learning) | 将大规模数据预训练的特征迁移到新任务,用少量数据微调 |

| 归纳偏置(Inductive Bias) | 模型对问题结构的先验假设,如卷积的平移等变性,决定学习效率 |

| 对抗样本(Adversarial Examples) | 微小的、人眼不可察觉的扰动,使深度网络以高置信度做出错误判断 |

| Word2Vec | Mikolov 2013年提出的词向量模型,学习出能进行语义运算的词表示 |

延伸阅读

- 必读 :Krizhevsky, A., Sutskever, I., & Hinton, G.(2012). "ImageNet Classification with Deep Convolutional Neural Networks." NeurIPS 2012. 深度学习革命的起点,摘要和结论都值得仔细阅读

- 必读 :LeCun, Y., Bengio, Y., & Hinton, G.(2015). "Deep Learning." Nature, 521, 436-444. 三位深度学习奠基人共同撰写的综述,是最权威的入门读物

- 推荐 :He, K., Zhang, X., Ren, S., & Sun, J.(2016). "Deep Residual Learning for Image Recognition." CVPR 2016 Best Paper. ResNet 原始论文,近年引用次数最多的 AI 论文之一

- 推荐 :Zeiler, M.D., & Fergus, R.(2014). "Visualizing and Understanding Convolutional Networks." ECCV 2014. 展示深度网络不同层学到什么特征的经典可视化工作,帮助建立直觉

- 深入 :Szegedy, C. et al.(2015). "Going Deeper with Convolutions." CVPR 2015. GoogLeNet 原始论文,Inception 模块的设计思路值得仔细品读

- 深入 :Goodfellow, I., Shlens, J., & Szegedy, C.(2015). "Explaining and Harnessing Adversarial Examples." ICLR 2015. 系统阐述对抗样本的经典论文

!tip

下一章预告:AlexNet 的模型征服了图像,靠的是卷积这个专为空间数据设计的结构。在本文中我们也已经多次提到了卷积神经网络,那么到底什么是卷积,它为何能有效解决视觉领域的常见任务,它的内部又有哪些重要的组件呢?下一章:机器之眼------卷积神经网络与图像的秘密。