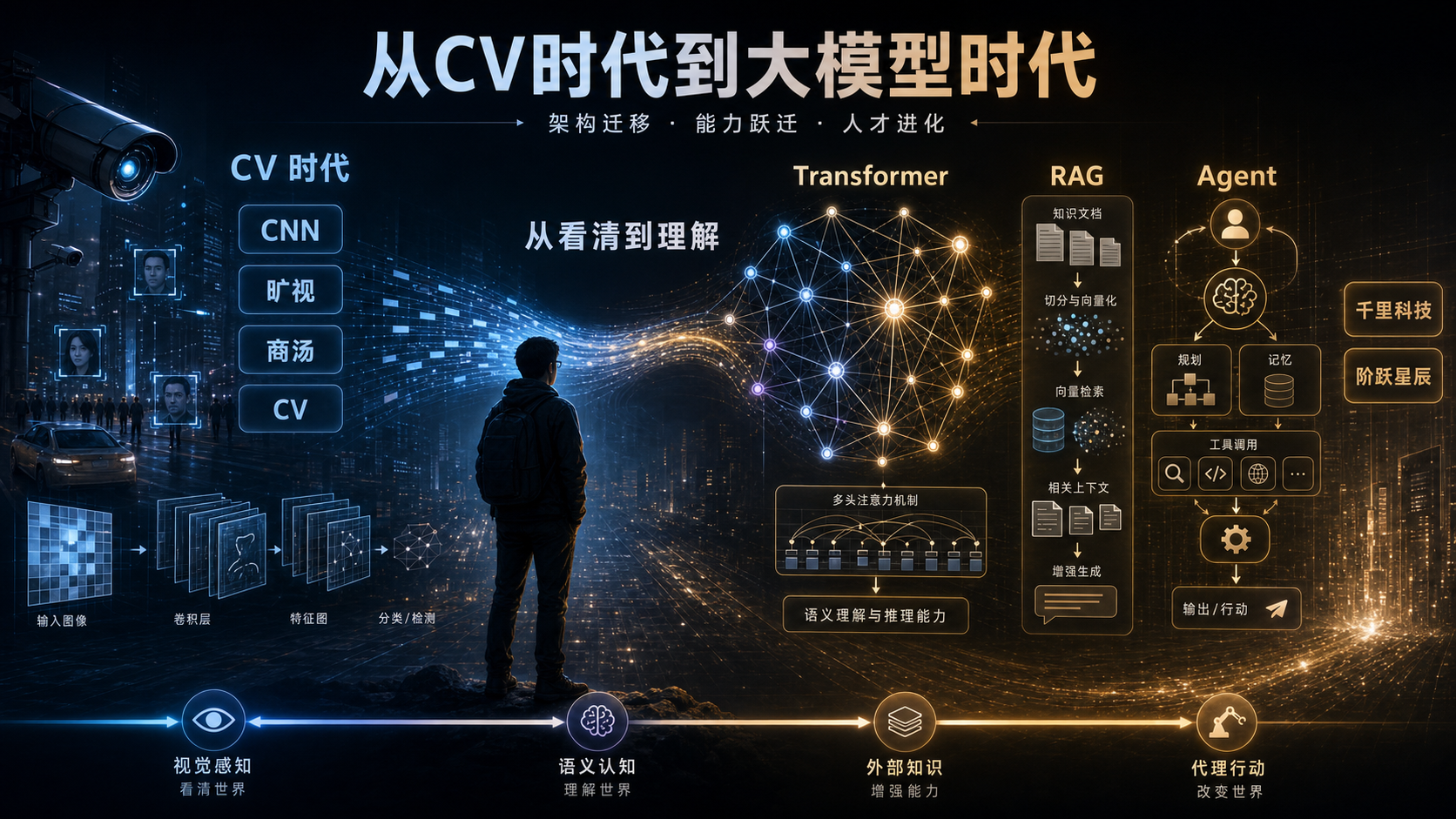

从看清到理解:CNN、Transformer 与 RAG 背后的 AI 架构迁徙

一个 CV 旧人眼中的模型范式迁移:从视觉识别、语义建模,到外部知识与 Agent 系统。

1. 引言:为什么 RAG 不等于向量数据库

今天很多人一提 RAG,就直接想到向量数据库。这个联想并不奇怪,因为向量数据库确实是 RAG 最常见的基础设施之一。

但从架构本质上看,RAG 不是一个数据库产品,而是一种系统策略:先从外部知识源中检索相关证据,再把这些证据组织进模型上下文,最后由大模型生成回答。

换句话说,向量数据库解决的是"怎么找",而 RAG 解决的是"如何让模型带着证据回答"。

如果只把 RAG 理解成"向量数据库 + LLM",就会漏掉更关键的部分:检索前的文档切分、metadata 设计、权限过滤、rerank、上下文构建、引用溯源,以及回答后的评测与追踪。

真正的 RAG,不是把资料塞给模型这么简单,而是让模型在生成之前有证据,在生成之后可追溯。

2. 从 CNN 到 Transformer:不是淘汰,而是重心迁移

如果把 AI 系统看成一个不断进化的架构,CNN、RNN、Transformer 分别代表了不同阶段的问题意识。

| 架构 | 更擅长的问题 | 历史位置 |

|---|---|---|

| RNN | 序列建模、时间依赖 | 曾经是 NLP 主流,但受限于并行效率和长程依赖 |

| CNN | 局部特征提取、视觉模式识别 | CV 商业化时代的核心架构之一 |

| Transformer | 全局关联、语义建模、上下文推理 | 当前大模型时代的基础结构 |

RNN 的问题在于,它天然依赖时间步推进。处理长序列时,信息需要一步一步传递,训练效率和长程依赖都会遇到瓶颈。

Transformer 的突破不只是"效果更好",而是改变了计算组织方式。自注意力机制让模型可以在同一层中建立全局关联,也让大规模并行训练成为可能。

这意味着 AI 的重心开始从"识别一个局部模式"转向"在更大的上下文中理解关系"。

但这并不意味着 CNN 被 Transformer 简单取代。更准确的说法是:AI 系统的重心发生了迁移,CNN 代表的高效感知能力仍然存在,只是它不再独自定义整个 AI 时代的叙事。

3. 看清与理解:视觉 AI 的二层分工

在视觉 AI 时代,CNN 解决了一个极其重要的问题:让机器能够稳定地从图像中提取特征。

边缘、纹理、轮廓、局部形状、空间模式,这些能力支撑了人脸识别、目标检测、工业质检、安防和城市视觉等大量场景。

所以我并不认为 CNN 是被抛弃的旧技术。更准确地说,CNN 代表的是一种高效的感知器官。

而 Transformer 带来的变化,是把这些感知结果放进更大的关系网络里。它关心的不只是"图里有什么",还包括"这些东西之间是什么关系""当前场景意味着什么""下一步可能发生什么"。

这里的"看清"和"理解"不是严格的技术边界,而是一个架构隐喻:

- CNN 更像感知层,负责高效捕捉局部特征。

- Transformer 更像认知层,负责建立全局关联和语义关系。

在很多真实系统里,这两者不是对立关系,而是协作关系。感知层需要足够高效、稳定、低延迟;认知层需要把这些信号放到更大的上下文中解释。

自动驾驶、多模态理解、机器人和具身智能,都会遇到类似问题:系统既要看得清,也要理解场景,还要能预测和行动。

4. 旷视、印奇与 CV 时代的转场

对我来说,旷视不是一个新闻里的公司名。它代表过一个时代:那个时代里,计算机视觉是 AI 商业化最锋利、最清晰的一把刀。

人脸识别、安防、城市视觉、工业检测,这些场景让"AI 可以落地"第一次变得具体。那时的核心问题是:机器能不能看得准、看得快、看得稳。

这也是 CV 时代最迷人的地方。它不像今天的大模型叙事那样宏大,却非常扎实。一个模型效果的提升,可能就意味着一个摄像头、一条产线、一个城市治理场景里的真实改进。

但大模型时代到来后,行业叙事的中心变了。

过去的问题是"机器能不能看清",现在的问题变成了"机器能不能理解、推理、协作,并连接真实世界"。

印奇从旷视,到千里科技,再到阶跃星辰的角色变化,在我看来不只是个人履历的变化,也像是一个时代重心迁移的缩影:从视觉识别,到物理世界智能,再到通用认知模型。

这并不意味着旧时代没有价值。相反,正是 CV 时代积累的工程能力、场景经验和商业化路径,构成了今天多模态与具身智能的一部分底座。

只是,AI 的主战场变了。

曾经最重要的问题是"看见";现在越来越重要的问题是"理解之后能做什么"。

5. RAG:大模型时代的外部知识层

Transformer 让模型具备了强大的语义建模能力,但它并没有解决所有问题。

模型参数里的知识有几个天然限制:

- 可能过期。

- 不包含企业内部私有知识。

- 很难精确追溯来源。

- 很难保证回答完全基于事实。

- 更新成本高。

RAG 的出现,就是为了解决这些问题。

它给大模型接入了一个外部知识层:

失败样本

用户问题

问题理解

检索相关知识

权限与 metadata 过滤

重排序 rerank

上下文构建

大模型生成回答

引用溯源

评测与追踪

向量数据库只是这个链路中的一环。真正重要的是整个闭环:检索、过滤、排序、上下文构建、生成、引用和评测。

所以,与其说 RAG 是"向量数据库 + LLM",不如说它是大模型时代的一种知识接入架构。

它让模型从"只依赖参数中的知识"变成"可以查询外部世界"。这一步非常关键,因为真实企业系统里的知识不是静止的,也不是都能被训练进模型参数。

代码库、产品文档、工单、CRM、会议纪要、历史决策、团队规范,这些都需要通过外部知识层接入模型。

这也是为什么 RAG 和 Agent 会天然走到一起:RAG 负责提供证据,Agent 负责基于证据做决策、调用工具、推进任务。

举一个 coding agent 的例子:用户让 agent 修改一个项目功能时,系统不应该只把用户需求丢给模型。更合理的链路是先检索当前项目的架构说明、编码规范、相似实现和历史决策,再把这些上下文组装给模型,最后让 agent 在受控范围内修改代码、运行测试并记录 trace。

在这个过程中,向量数据库只是"找相关材料"的一部分;真正决定系统质量的,是检索结果是否属于正确项目、是否过期、是否有权限、是否能被引用,以及失败后能不能复盘。

6. 新的智能系统分层

如果把这次架构迁徙总结成一个系统框架,我会把它分成四层:

| 层级 | 代表技术 | 解决的问题 |

|---|---|---|

| 感知层 | CNN、视觉模型、传感器、端侧模型 | 看见世界,提取物理特征 |

| 认知层 | Transformer、多模态大模型 | 理解语义、关系与上下文 |

| 知识层 | RAG、向量库、知识库、Memory | 接入外部知识与长期信息 |

| 行动层 | Agent、Tool Calling、Workflow | 调用工具,执行任务,改变系统状态 |

这也是为什么我认为未来的 AI 架构师,不能只理解单个模型。真正重要的是理解这些层之间如何协作。

CNN 不会消失,它会继续作为高效感知层存在。

Transformer 也不是终点,它需要外部知识、工具系统和工作流来完成真实任务。

RAG 更不是向量数据库的代名词,而是智能系统接入现实知识的一种方式。

Agent 则是在这个基础上,把"回答问题"推进到"完成任务"。

从这个角度看,今天的 AI 架构已经不再是一个模型单打独斗,而是一个分层协作系统:

任务反馈与新状态

外部上下文

行动层

Agent / Tool Calling / Workflow

知识层

RAG / 知识库 / Memory

认知层

Transformer / 多模态大模型

感知层

CNN / 视觉模型 / 传感器

这套分层并不意味着每个系统都要完整实现四层。一个客服 Agent 可能更依赖知识层和行动层,一个自动驾驶系统可能更强调感知层和认知层,一个 coding agent 则会把代码库知识、项目上下文、工具调用和评测闭环结合得更紧。

但无论具体形态如何,趋势是清楚的:AI 正在从单点模型能力,走向系统级智能。

7. 结语:从看见世界,到理解世界,再到参与世界

AI 的演进不是简单的新技术替代旧技术,而是系统能力的层层叠加。

CNN 让机器看见世界。

Transformer 让机器理解上下文。

RAG 让机器连接外部知识。

Agent 让机器开始参与任务执行。

从这个角度看,所谓 AI 架构迁徙,并不是某个模型家族的胜利,而是智能系统从单点能力走向分层协作。

对于经历过 CV 时代的人来说,这种迁移难免带着一点复杂情绪。我们见证过视觉识别如何把 AI 带入现实世界,也正在见证大模型如何把 AI 推向更广阔的认知与行动空间。

旧时代没有消失,它只是变成了新系统的一层。