1. 核心理论:动态规划的三大支柱

- 状态离散化 (State Discretization): 为了让计算机能够处理连续的物理过程,需要对时间 ttt、状态变量 x(t)x(t)x(t)(如电池 SOC、水库水位)和控制变量 u(t)u(t)u(t)(如发动机扭矩、充放电功率)进行网格化。离散精度的选择直接决定了结果的准确性,但网格划分过细会导致计算量呈指数级增长,即所谓的"维数灾难"(Curse of Dimensionality)。

- 代价累积 (Cost Accumulation):

定义系统的目标函数(Cost Function)。在每一个离散的步长内,系统不仅会产生当前的瞬时代价 (例如当前这一秒的燃油消耗),还会因为状态的转移而产生未来代价。总代价是整段行程或周期内所有代价的积分或累加。 - 逆向递推 (Backward Induction):

这是 DP 的灵魂,基于 Bellman 最优性原理。算法从终端时间步 NNN 开始,计算最终状态的代价值,然后逐步向初始时间步 000 倒推。在倒推的每一个阶段 kkk,遍历所有可能的状态和控制变量,寻找使"当前步代价 + 到达终点的最小累积代价"最小的控制动作,从而生成一张全局最优的控制律映射表。

将混合动力汽车(HEV)的能量管理策略延伸到混合动力飞行汽车(Hybrid eVTOL 或 Flying Car),是一个极具前瞻性且挑战性倍增的研究方向。

虽然底层的数学逻辑(如您之前研究的 DP 逆向递推、DQN 强化学习、PSO/GA 启发式优化)是相通的,但飞行汽车的能量分配在物理约束和目标倾向上与地面车辆有着本质的区别。

以下是混合动力飞行汽车能量分配的核心逻辑与建模难点:

1. 动力架构:为何多采用"串联式 (Series Hybrid)"

地面 HEV 通常采用功率分流(如丰田 THS)或并联架构,因为车轮可以直接由发动机驱动。

但飞行汽车为了实现垂直起降和高机动性,普遍采用分布式电推进(DEP, Distributed Electric Propulsion) 。这意味着所有的旋翼都由电机独立驱动。因此,最成熟的架构是串联式:

- 燃气轮机/内燃机 不直接驱动旋翼,而是带动发电机发电。

- 电能汇入直流母线(DC Bus),与高功率电池共同为旋翼电机供电。

- 能量管理的核心变量 u(t)u(t)u(t) 就是:在特定时刻,母线上的电能有多少比例来自发电机,多少比例来自电池?

2. 飞行工况的极端性 (Flight Profile)

与地面车辆看重 NEDC/WLTC 循环不同,飞行汽车的工况极度非线性,呈现典型的"浴盆曲线":

- 垂直起飞与悬停 (Takeoff & Hover): 功率需求极大(通常是巡航的 2-3 倍),发动机往往无法独立承担,需要电池深度放电(Boost)介入。

- 巡航 (Cruise): 依靠机翼产生升力(如果是复合翼或倾转旋翼机),功率需求断崖式下降。此时发动机可以运行在最佳经济区(BSFC 最低点),并利用富余功率给电池充电。

- 垂直降落 (Landing): 功率需求再次飙升,且为了安全,必须保留足够的电池 SOC(通常要求 >20%)以应对复飞突发情况。

3. 算法层面的根本差异 (相比于地面 HEV)

如果您用 Matlab/Simulink 来做飞行汽车的 DP 或者 DQN 训练,需要注意以下边界条件的重构:

- 重量惩罚极高: 燃油消耗会导致整机重量减轻,这会反过来降低后续飞行所需的升力功率。您的状态转移方程 xk+1=f(xk,uk)x_{k+1} = f(x_k, u_k)xk+1=f(xk,uk) 中,必须加入质量衰减模型。

- 安全性(硬约束): 地面没电了可以靠边停车,天上没电就是灾难。在 DP 的终端代价(Terminal Cost)设置中,必须给出极度严苛的 SOC 下限惩罚;同时在运行区间,要限制电池放电功率的突变,防止热失控。

第一阶段:初始化系统运行环境 (MATLAB 脚本)

在搭建 Simulink 之前,必须先在 MATLAB 中运行初始化脚本,将所有物理常数载入工作区。

请在 MATLAB 中新建一个脚本 init_evtol.m 并运行:

matlab

% === 串联式飞行汽车物理参数初始化 ===

% 1. 仿真环境

Ts = 1; % 仿真步长 (秒)

% 2. 电池系统参数 (Battery)

SOC_init = 0.9; % 初始荷电状态 (90%)

Batt_Capacity_Ah = 150; % 电池容量 (安时)

Batt_Voltage = 400; % 额定母线电压 (V)

Batt_Capacity_As = Batt_Capacity_Ah * 3600; % 容量转为安秒 (用于积分)

% 3. 发动机/发电机组参数 (Engine/Generator)

P_eng_max = 60000; % 发电机最大输出功率 (60 kW)

Eng_Delay_Tau = 0.5; % 发动机响应一阶惯性时间常数 (秒)

% 4. 构造模拟飞行工况 (测试用)

% 模拟一个 600 秒的起飞-巡航-降落过程

t_array = (0:Ts:600)';

P_req_array = zeros(length(t_array), 1);

P_req_array(1:60) = 80000; % 0-60s: 垂直起飞 (80kW,需电池介入)

P_req_array(61:500) = 30000; % 61-500s: 巡航 (30kW,发动机可充电)

P_req_array(501:600) = 60000; % 501-600s: 垂直降落 (60kW)

flight_cycle = [t_array, P_req_array]; % 合成 Simulink 可读格式第二阶段:Simulink 模型全链路搭建

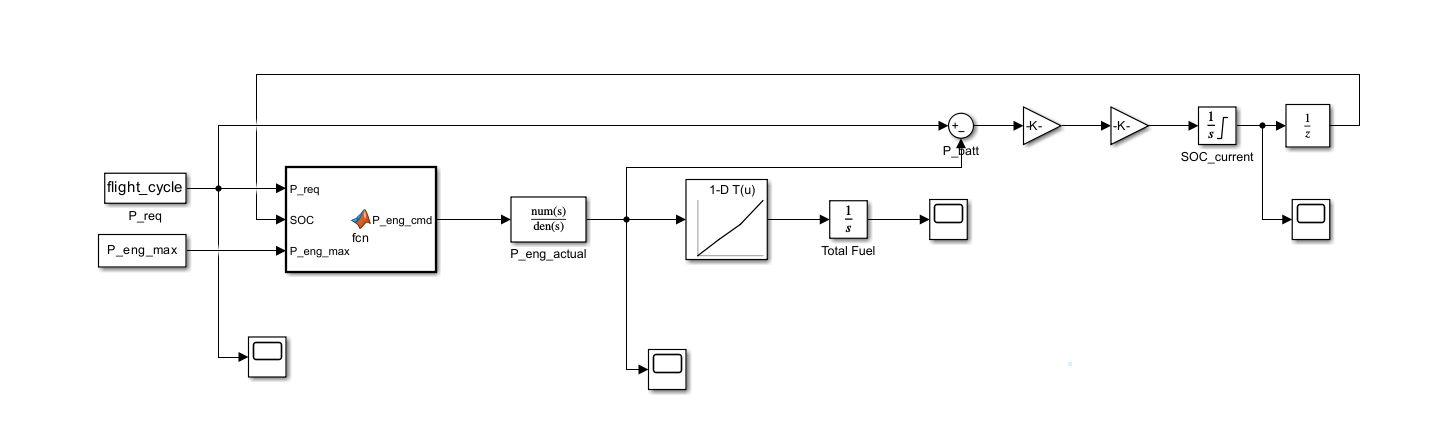

打开 Simulink 创建一个空白模型 (.slx)。我们将建立三个核心子系统:工况输入 、EMS 控制器 、物理对象。

步骤 1:飞行工况输入 (Flight Profile)

为系统提供随时间变化的目标功率需求。

-

所需模块 (Blocks):

-

From Workspace(Sources 库) -

参数配置 (Parameters):

-

Data: 填入

flight_cycle -

Sample time: 填入

Ts -

Interpolate data: 勾选 (保证平滑插值)

-

连接方式 (Connections):

-

将该模块的输出端口引出,命名该信号线为

P_req(总需求功率)。

步骤 2:EMS 能量管理控制器 (EMS Controller)

这是系统的大脑,用于决定发动机当前的发电功率。为了方便您后续接入 GA 或 PSO 等算法,我们使用 MATLAB Function。

-

所需模块 (Blocks):

-

MATLAB Function(User-Defined Functions 库) -

参数配置 (Parameters) - 双击输入代码:

matlab

function P_eng_cmd = fcn(P_req, SOC, P_eng_max)

% 基础规则策略 (可替换为您的优化算法输出)

if SOC < 0.3

P_eng_cmd = P_eng_max; % 电量危机,全力发电

elseif P_req > P_eng_max

P_eng_cmd = P_eng_max; % 需求超限,发动机满载,差额电池补

elseif P_req < P_eng_max * 0.6

P_eng_cmd = P_eng_max * 0.6; % 需求极低时,保持在高效区发电并给电池充电

else

P_eng_cmd = P_req; % 跟随需求

end

end- 连接方式 (Connections):

- 将

P_req信号线连入端口 1。 - 将后续生成的电池反馈线

SOC_current连入端口 2。 - 将工作区变量

P_eng_max放入一个Constant模块,连入端口 3。 - 输出端引出信号线,命名为

P_eng_cmd。

步骤 3:物理被控对象 (Plant Model) - 包含三个子系统

3.1 动力执行延迟 (Engine Dynamics)

-

所需模块 (Blocks):

Transfer Fcn(Continuous 库) -

参数配置 (Parameters):

-

Numerator coefficients:

[1] -

Denominator coefficients:

[Eng_Delay_Tau 1](基于工作区变量,构成 10.5s+1\frac{1}{0.5s + 1}0.5s+11) -

连接方式 (Connections):

-

输入端接

P_eng_cmd。 -

输出端引出信号线,命名为

P_eng_actual(发动机真实发出的功率)。

3.2 燃油消耗核算 (Fuel Calculation)

-

所需模块 (Blocks):

-

1-D Lookup Table(Lookup Tables 库) -

Integrator(Continuous 库) -

参数配置 (Parameters):

-

Table -> Breakpoints 1:

[0, 20000, 40000, 60000](功率网格 W) -

Table -> Table data:

[0, 1.5, 2.8, 5.0](对应的瞬时油耗率 g/s) -

Integrator -> Initial condition:

0 -

连接方式 (Connections):

-

从

P_eng_actual信号线上引出一个分支,接入 Lookup Table。 -

将 Lookup Table 的输出 (瞬时油耗) 接入

Integrator。 -

Integrator的输出即为整段航程的 总燃油消耗量 (Total Fuel)。

3.3 母线节点与电池模型 (DC Bus & Battery)

根据公式 Pbatt=Preq−Peng_actualP_{batt} = P_{req} - P_{eng\_actual}Pbatt=Preq−Peng_actual 计算电池充放电,并推导 SOC。

-

所需模块 (Blocks):

-

Sum(Math Operations 库) -

Gain2 个 (Math Operations 库) -

Integrator1 个 (Continuous 库) -

参数配置 (Parameters):

-

Sum: List of signs 改为

|+-。 -

第一个 Gain (功率转电流): 设为

1/Batt_Voltage。 -

第二个 Gain (安时积分系数): 设为

-1/Batt_Capacity_As。(注意负号,放电为正功率,SOC减少)。 -

Integrator (SOC): Initial condition 设为

SOC_init,并在下方勾选 Limit output ,Upper limit 设1,Lower limit 设0。 -

连接方式 (Connections):

-

Sum的+端接入P_req,-端接入P_eng_actual。其输出命名为P_batt。 -

将

P_batt依次串联通过 第一个Gain -> 第二个Gain ->Integrator。 -

Integrator的输出即为系统当前的 实时荷电状态 (SOC_current)。

步骤 4:闭环处理与观测 (Closing Loop & Scopes)

打破代数环死锁,并添加示波器以观测仿真结果。

-

所需模块 (Blocks):

-

Unit Delay(Discrete 库) -

Scope(Sinks 库) -

参数配置 (Parameters):

-

Unit Delay -> Sample time: 设为

Ts。 -

Scope: 设置为 3 个输入端口。

-

连接方式 (Connections):

-

【极其关键】 将电池算出的

SOC_current接入Unit Delay的输入端;再将Unit Delay的输出端连回 EMS 控制器 (步骤 2) 的第 2 个输入端口SOC。这就完成了闭环。 -

将

P_req、P_eng_actual和经过 Unit Delay 的SOC_current接入Scope,以便在仿真结束后查看功率分配曲线和电池消耗情况。

至此,一个架构完整、逻辑严密、可随时接入各种优化算法的底层物理模型就全部搭建完毕了。点击 Simulink 顶部的 Run,您就能在 Scope 中看到这架飞行汽车在 600 秒内的能量分配动态。

联合仿真改造指南 (MATLAB -> Python)

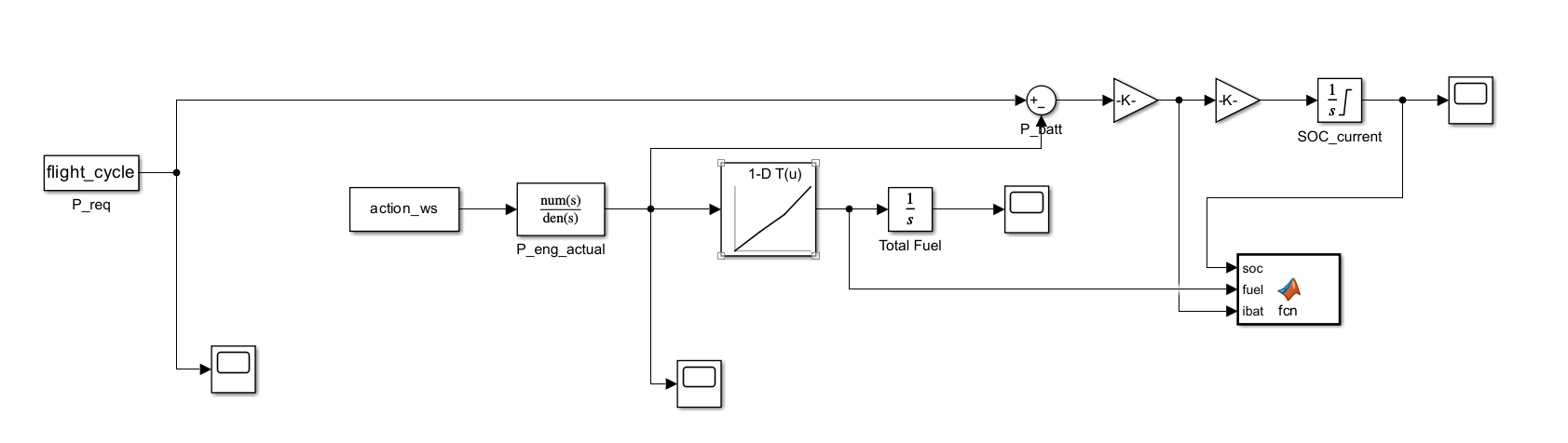

要在 Python 中调用这个模型进行训练,我们需要将刚才闭环的 Simulink 模型"开环",把它变成一个受 Python 操控的木偶。

第一步:改造 Simulink 模型 (输入与输出接口)

打开你刚才建好的 .slx 模型,做如下修改:

- 删除原有的控制器: 把之前建立的

EMS Controller(那个 MATLAB Function) 删掉。打断的Unit Delay反馈线也删掉。 - 设定外部输入 (Action): 在原本控制器的位置,放置一个

Inport模块 (Sources 库),命名为Action_P_eng。将它的输出线连入Engine Dynamics的输入端。 - 设定外部输出 (State & Reward): 放置几个

Outport模块 (Sinks 库)。

- 将电池算出的实时

SOC_current接入Outport 1(命名为State_SOC)。 - 将核算出的瞬时油耗或总油耗接入

Outport 2(命名为Reward_Fuel)。 - 将当前的飞行工况需求功率

P_req接入Outport 3(命名为State_Preq)。

此时,你的 Simulink 变成了一个黑盒:输入一个数字(发动机功率),吐出三个数字(SOC、油耗、当前需求)。

第二步:配置 MATLAB 引擎 (Python 端)

在 MATLAB R2022b 中,官方对 Python 的支持已经非常完善。你需要先在你的电脑终端 (CMD/Terminal) 里安装引擎:

bash

# 找到你的 MATLAB R2022b 安装路径下的 \extern\engines\python 目录

cd "C:\Program Files\MATLAB\R2022b\extern\engines\python"

python setup.py install第三步:编写 Python 交互脚本

在 Python 中,你可以用 matlab.engine 启动 Simulink,并像玩回合制游戏一样,一步步推动仿真前进并获取数据。以下是最基础的交互框架:

python

import matlab.engine

import numpy as np

# 1. 启动 R2022b 引擎

print("启动 MATLAB 引擎...")

eng = matlab.engine.start_matlab()

# 2. 加载你的初始化脚本和 Simulink 模型

eng.eval("init_evtol", nargout=0) # 运行我们之前写的参数初始化脚本

model_name = 'your_evtol_model' # 你的 slx 文件名

eng.eval(f"load_system('{model_name}')", nargout=0)

# 3. 强化学习数据生成循环 (Episode Loop)

num_episodes = 10

for episode in range(num_episodes):

# 重置模型到初始状态

eng.eval(f"set_param('{model_name}', 'SimulationCommand', 'start', 'SimulationCommand', 'pause')", nargout=0)

done = False

step = 0

while not done:

# --- 获取当前状态 (State) ---

# 实际工程中这里需要通过 get_param 获取 block 的 RuntimeObject 值

# 这里用伪代码表示获取过程

current_soc = eng.workspace['SOC_current']

# --- 智能体决策 (Agent Action) ---

# 这里可以接入你的 DQN 网络输出,目前先用随机动作代替

action_power = np.random.choice([0.0, 30000.0, 60000.0])

# --- 将动作写入 Simulink 并推下一步 (Environment Step) ---

# 把动作值赋给 MATLAB 工作区变量,Simulink 的 Inport 读取该变量

eng.workspace['python_action'] = float(action_power)

# 让仿真往前走一步 (比如走 1 秒)

eng.eval(f"set_param('{model_name}', 'SimulationCommand', 'step')", nargout=0)

# --- 获取奖励并存入回放池 (Reward & Replay Buffer) ---

step_fuel = eng.workspace['Fuel_rate']

reward = -step_fuel # 油耗越高,奖励越低

print(f"Step: {step}, Action: {action_power}W, SOC: {current_soc:.2f}, Reward: {reward}")

# 判断飞行是否结束 (例如走完 600 秒或者 SOC 耗尽)

if step >= 600 or current_soc < 0.1:

eng.eval(f"set_param('{model_name}', 'SimulationCommand', 'stop')", nargout=0)

done = True

step += 1

eng.quit()ALL

这是一份完整的、基于 PyTorch 和 MATLAB Engine 的深度强化学习(DQN)联合仿真代码框架。

在运行这段代码之前,为了让 Python 能够完美地"步进式"控制 Simulink,我们需要对您刚才建好的 Simulink 模型做最后一点微调,以打通数据接口。

🔧 关键前提:Simulink 接口微调

MATLAB 引擎在"暂停-步进"模式下,最稳定读取和写入数据的方式是利用基础工作区 (Base Workspace) 。请打开您的 .slx 模型:

- 修改动作输入: 将最左侧的

Action_P_eng(Inport 模块) 替换为一个Constant(常数) 模块 。双击它,将其 Constant value 设为变量名action_ws。 - 修改状态输出: 将最右侧的三个

Outport模块替换为To Workspace模块 (位于 Sinks 库)。

- 第一个命名为

SOC_out,Save format 选为Array。 - 第二个命名为

Reward_out,Save format 选为Array。 - 第三个命名为

Preq_out,Save format 选为Array。

🐍 Python 完整训练代码 (DQN_train.py)

请确保您的电脑已安装 torch, numpy 和 matlab.engine。将以下代码保存为 DQN_train.py,与您的 init_evtol.m 和 .slx 模型放在同一个文件夹下。

python

import matlab.engine

import numpy as np

import torch

import torch.nn as nn

import torch.optim as optim

import random

from collections import deque

# ==========================================

# 1. DQN 神经网络模型

# ==========================================

class DQN_Network(nn.Module):

def __init__(self, state_dim, action_dim):

super(DQN_Network, self).__init__()

self.net = nn.Sequential(

nn.Linear(state_dim, 128),

nn.ReLU(),

nn.Linear(128, 128),

nn.ReLU(),

nn.Linear(128, action_dim)

)

def forward(self, x):

return self.net(x)

# ==========================================

# 2. DQN 智能体逻辑

# ==========================================

class DQNAgent:

def __init__(self, state_dim, action_dim):

self.action_dim = action_dim

self.memory = deque(maxlen=10000)

self.eval_net = DQN_Network(state_dim, action_dim)

self.target_net = DQN_Network(state_dim, action_dim)

self.target_net.load_state_dict(self.eval_net.state_dict())

self.optimizer = optim.Adam(self.eval_net.parameters(), lr=0.001)

self.loss_func = nn.SmoothL1Loss()

self.gamma = 0.99

self.epsilon = 1.0

self.epsilon_decay = 0.995

self.epsilon_min = 0.05

self.batch_size = 64

self.target_update_freq = 200

self.step_counter = 0

def choose_action(self, state):

if np.random.uniform() < self.epsilon:

return random.randrange(self.action_dim)

state_tensor = torch.FloatTensor(state).unsqueeze(0)

with torch.no_grad():

q_values = self.eval_net(state_tensor)

return torch.argmax(q_values).item()

def store_transition(self, s, a, r, s_, done):

self.memory.append((s, a, r, s_, done))

def learn(self):

if len(self.memory) < self.batch_size:

return

self.step_counter += 1

if self.step_counter % self.target_update_freq == 0:

self.target_net.load_state_dict(self.eval_net.state_dict())

batch = random.sample(self.memory, self.batch_size)

b_s, b_a, b_r, b_s_, b_d = zip(*batch)

b_s = torch.FloatTensor(np.array(b_s))

b_a = torch.LongTensor(b_a).unsqueeze(1)

b_r = torch.FloatTensor(b_r).unsqueeze(1)

b_s_ = torch.FloatTensor(np.array(b_s_))

b_d = torch.FloatTensor(b_d).unsqueeze(1)

q_eval = self.eval_net(b_s).gather(1, b_a)

q_next = self.target_net(b_s_).detach().max(1)[0].unsqueeze(1)

q_target = b_r + self.gamma * q_next * (1 - b_d)

loss = self.loss_func(q_eval, q_target)

self.optimizer.zero_grad()

loss.backward()

self.optimizer.step()

if self.epsilon > self.epsilon_min:

self.epsilon *= self.epsilon_decay

# ==========================================

# 3. 极度精简的 Simulink 交互环境

# ==========================================

class SimulinkEnv:

def __init__(self, model_name='DQN_train'):

print("启动 MATLAB 后台引擎中,请稍候...")

self.eng = matlab.engine.start_matlab()

self.model_name = model_name

self.dt = 1.0

# 【清爽注入】因为改成了 Constant 模块,直接给纯数字标量即可!

self.eng.workspace['simin_P_eng'] = 0.0

self.eng.workspace['simin_v_req'] = 15.0

self.eng.workspace['simin_init_SOC'] = 0.6

print("加载 Simulink 模型...")

self.eng.eval(f"load_system('{self.model_name}')", nargout=0)

#【新增的终极解法】:用底层指令直接把模型的单一输出给关了!

# ========================================================

self.eng.eval(f"set_param('{self.model_name}', 'ReturnWorkspaceOutputs', 'off')", nargout=0)

self.action_space = [0.0, 10.0, 20.0, 30.0, 40.0]

self.current_time = 0.0

self.current_soc = 0.6

self.current_v = 15.0

self.max_time = 100.0

def reset(self):

self.current_time = 0.0

self.current_soc = 0.6

self.current_v = 15.0

return np.array([self.current_v, self.current_soc])

def step(self, action_idx):

P_eng_action = self.action_space[action_idx]

# 将当前状态指令下发给 Simulink (恒定值)

self.eng.workspace['simin_P_eng'] = float(P_eng_action)

self.eng.workspace['simin_v_req'] = float(self.current_v)

self.eng.workspace['simin_init_SOC'] = float(self.current_soc)

# 设置仿真时间

sim_start = str(self.current_time)

sim_stop = str(self.current_time + self.dt)

# =====================================================================

# 【终极降维打击】:既然你喜欢打包,我就把你赋值给一个叫 simOut 的变量

# =====================================================================

cmd = f"simOut = sim('{self.model_name}', 'StartTime', '{sim_start}', 'StopTime', '{sim_stop}');"

self.eng.eval(cmd, nargout=0)

# 然后命令 MATLAB 自己把包裹里的数据拆出来,赋值给纯净的数组变量

self.eng.eval("val_SOC = simOut.out_SOC;", nargout=0)

self.eng.eval("val_Fuel = simOut.out_Fuel;", nargout=0)

self.eng.eval("val_I_bat = simOut.out_I_bat;", nargout=0)

# 现在,Python 再去拿这三个纯净的数组,绝对一拿一个准!

next_soc = np.array(self.eng.workspace['val_SOC'])[-1][0]

fuel_rate = np.array(self.eng.workspace['val_Fuel'])[-1][0]

bat_current = np.array(self.eng.workspace['val_I_bat'])[-1][0]

# =====================================================================

# 计算多目标奖励函数:油耗惩罚 + SOC维持惩罚 + 电池老化惩罚

w1, w2, w3 = 0.5, 0.4, 0.1

norm_fuel = fuel_rate / 3.0

norm_soc_penalty = ((next_soc - 0.6) / 0.05) ** 2

norm_deg_penalty = (bat_current / 150.0) ** 2

reward = -(w1 * norm_fuel + w2 * norm_soc_penalty + w3 * norm_deg_penalty)

# 状态更新

self.current_soc = next_soc

self.current_time += self.dt

# 模拟路况扰动 (后续可替换为真实的工况文件)

self.current_v += random.uniform(-2.0, 2.0)

self.current_v = max(0.0, min(self.current_v, 33.0))

done = self.current_time >= self.max_time

next_state = np.array([self.current_v, self.current_soc])

return next_state, float(reward), done

# ==========================================

# 4. 训练主循环

# ==========================================

if __name__ == "__main__":

env = SimulinkEnv(model_name='DQN_train')

state_dim = 2

action_dim = len(env.action_space)

agent = DQNAgent(state_dim, action_dim)

MAX_EPISODES = 50

for episode in range(MAX_EPISODES):

state = env.reset()

episode_reward = 0

while True:

action = agent.choose_action(state)

next_state, reward, done = env.step(action)

agent.store_transition(state, action, reward, next_state, done)

agent.learn()

state = next_state

episode_reward += reward

if done:

print(f"Episode: {episode+1:03d} | 总奖励(Total Reward): {episode_reward:7.2f} | 结束SOC: {state[1]:.4f} | 探索率: {agent.epsilon:.3f}")

break

# 在 env.eng.quit() 前面加上这句:

torch.save(agent.eval_net.state_dict(), "evtol_dqn_policy.pth")

env.eng.quit()

print("\n训练完成,MATLAB 引擎已安全关闭!")因为 action_ws 是我们在 Python 的 step 循环里才动态写入 MATLAB 工作区的。当我们在 Python 第一步调用 load_system 准备加载模型,或者直接在 Simulink 里点击"编译/运行"时,MATLAB 会检查所有的参数,发现工作区里根本没有 action_ws 这个变量,就会直接报错"未定义变量"并导致程序崩溃。

为了解决这个"先有鸡还是先有蛋"的问题,我们需要在系统初始化阶段给它一个初始占位符。

🛠️ 解决方法:更新初始化脚本

请打开我们最开始编写的那个 init_evtol.m 脚本,在里面加上一行,给 action_ws 赋一个初始的安全值(比如 0)。

修改后的 init_evtol.m 应该是这样的:

matlab

% === 串联式飞行汽车物理参数初始化 ===

% 1. 仿真环境

Ts = 1;

% 2. 电池系统参数 (Battery)

SOC_init = 0.9;

Batt_Capacity_Ah = 150;

Batt_Voltage = 400;

Batt_Capacity_As = Batt_Capacity_Ah * 3600;

% 3. 发动机/发电机组参数 (Engine/Generator)

P_eng_max = 60000;

Eng_Delay_Tau = 0.5;

% 4. 强化学习外部输入占位符 (极度关键)

action_ws = 0; % <--- 新增这一行!防止 Simulink 编译时报错未定义

% 5. 构造模拟飞行工况 (测试用)

t_array = (0:Ts:600)';

P_req_array = zeros(length(t_array), 1);

P_req_array(1:60) = 80000;

P_req_array(61:500) = 30000;

P_req_array(501:600) = 60000;

flight_cycle = [t_array, P_req_array]; 原理说明:

加上这行代码后,当 Python 执行 eng.eval("init_evtol") 时,工作区就会立刻生成一个 action_ws = 0。紧接着执行 load_system 甚至 start 时,Simulink 那个 Constant 模块就能顺利读到这个 0 并成功完成模型编译。随后,Python 循环里的代码就会在每一秒的步进中,无缝地覆盖掉这个值。

bash

(hev) PS D:\software\opera_file\file\file\homework\train_project\python\hev_test01> python train13.py

正在启动 MATLAB 引擎,请稍候 (约需10-30秒)...

MATLAB 环境初始化成功!

回合: 1/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.995

回合: 2/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.990

回合: 3/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.985

回合: 4/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.980

回合: 5/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.975

回合: 6/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.970

回合: 7/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.966

回合: 8/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.961

回合: 9/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.956

回合: 10/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.951

回合: 11/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.946

回合: 12/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.942

回合: 13/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.937

回合: 14/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.932

回合: 15/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.928

回合: 16/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.923

回合: 17/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.918

回合: 18/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.914

回合: 19/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.909

回合: 20/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.905

回合: 21/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.900

回合: 22/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.896

回合: 23/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.891

回合: 24/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.887

回合: 25/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.882

回合: 26/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.878

回合: 27/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.873

回合: 28/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.869

回合: 29/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.865

回合: 30/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.860

回合: 31/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.856

回合: 32/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.852

回合: 33/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.848

回合: 34/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.843

回合: 35/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.839

回合: 36/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.835

回合: 37/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.831

回合: 38/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.827

回合: 39/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.822

回合: 40/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.818

回合: 41/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.814

回合: 42/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.810

回合: 43/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.806

回合: 44/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.802

回合: 45/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.798

回合: 46/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.794

回合: 47/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.790

回合: 48/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.786

回合: 49/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.782

回合: 50/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.778

回合: 51/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.774

回合: 52/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.771

回合: 53/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.767

回合: 54/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.763

回合: 55/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.759

回合: 56/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.755

回合: 57/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.751

回合: 58/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.748

回合: 59/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.744

回合: 60/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.740

回合: 61/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.737

回合: 62/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.733

回合: 63/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.729

回合: 64/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.726

回合: 65/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.722

回合: 66/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.718

回合: 67/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.715

回合: 68/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.711

回合: 69/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.708

回合: 70/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.704

回合: 71/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.701

回合: 72/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.697

回合: 73/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.694

回合: 74/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.690

回合: 75/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.687

回合: 76/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.683

回合: 77/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.680

回合: 78/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.676

回合: 79/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.673

回合: 80/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.670

回合: 81/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.666

回合: 82/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.663

回合: 83/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.660

回合: 84/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.656

回合: 85/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.653

回合: 86/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.650

回合: 87/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.647

回合: 88/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.643

回合: 89/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.640

回合: 90/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.637

回合: 91/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.634

回合: 92/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.631

回合: 93/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.627

回合: 94/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.624

回合: 95/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.621

回合: 96/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.618

回合: 97/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.615

回合: 98/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.612

回合: 99/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.609

回合: 100/100 | 存活步数: 599 | 总奖励: 0.00 | Epsilon: 0.606

训练结束!

模型已保存为 evtol_dqn_policy.pth拿到 evtol_dqn_policy.pth(注意后缀通常是 .pth 或 .pt,代表 PyTorch 模型权重文件),意味着你的"智能体大脑"已经训练完毕。这就好比一个飞行员刚刚从模拟机驾校毕业,拿到了飞行执照。

接下来的工作,就是让他真正上机进行"考核(Evaluation)",并把他的操作记录下来进行分析和对标(Benchmarking)。

具体来说,你需要完成以下三个核心步骤:

1. 闭卷考试:编写测试/推理脚本 (Inference)

在训练阶段,智能体会有随机探索(Epsilon-Greedy),并且一直在更新权重。现在的测试阶段,我们需要关掉随机探索(纯利用已学知识) ,并且冻结神经网络权重,让它在 Simulink 环境里完整地飞一次 600 秒的工况。

你需要新建一个 DQN_test.py 文件,核心逻辑如下:

python

import torch

import numpy as np

import matplotlib.pyplot as plt

# 【修改点 1】只导入存在的东西:网络类和环境类

from DQN_train import DQN_Network, SimulinkEnv

# 【修改点 2】手动定义这些在 train 脚本的 __main__ 中才有的变量

STATE_DIM = 2

ACTION_DIM = 5

MODEL_NAME = 'DQN_train' # 您的 Simulink 模型名

def main():

# 1. 实例化网络并加载训练好的权重

policy_net = DQN_Network(STATE_DIM, ACTION_DIM)

try:

policy_net.load_state_dict(torch.load("evtol_dqn_policy.pth"))

print("成功加载模型权重:evtol_dqn_policy.pth")

except FileNotFoundError:

print("【警告】找不到模型文件!请确保您在训练脚本结束时保存了模型。")

return

policy_net.eval() # 切换到评估模式,关闭随机特性

# 2. 初始化环境与记录器

env = SimulinkEnv(model_name=MODEL_NAME)

state = env.reset()

history_soc = []

history_v = []

history_peng = []

history_reward = []

print("开始测试飞行...")

done = False

step = 0

total_reward = 0

# 测试循环

while not done and step < int(env.max_time / env.dt):

# 3. 纯粹利用 (Exploitation):不再有随机探索

with torch.no_grad():

state_tensor = torch.FloatTensor(state).unsqueeze(0)

q_values = policy_net(state_tensor)

action_idx = q_values.argmax().item() # 直接选 Q 值最大的动作

# 4. 执行动作并记录数据

next_state, reward, done = env.step(action_idx)

# 记录当前状态和动作

history_v.append(state[0])

history_soc.append(state[1])

history_peng.append(env.action_space[action_idx])

history_reward.append(reward)

state = next_state

total_reward += reward

step += 1

print(f"测试结束!总步数: {step}, 总奖励: {total_reward:.2f}, 最终 SOC: {state[1]:.4f}")

env.eng.quit()

print("MATLAB 引擎已安全关闭。正在绘制结果...")

# ==========================================

# 5. 绘制测试结果图表

# ==========================================

time_steps = np.arange(len(history_soc)) * env.dt

plt.figure(figsize=(12, 10))

# 子图 1:发动机功率决策

plt.subplot(3, 1, 1)

plt.step(time_steps, history_peng, where='post', color='blue', label='Engine Power (Action)')

plt.ylabel('Power (kW)')

plt.title('HEV Power Split Strategy (DQN Evaluation)')

plt.legend()

plt.grid(True)

# 子图 2:电池 SOC 与 车速

plt.subplot(3, 1, 2)

ax1 = plt.gca()

ax1.plot(time_steps, history_soc, color='green', label='Battery SOC')

ax1.axhline(y=0.6, color='red', linestyle=':', label='Target SOC (0.6)')

ax1.set_ylabel('SOC', color='green')

ax1.tick_params(axis='y', labelcolor='green')

ax1.legend(loc='upper left')

ax2 = ax1.twinx()

ax2.plot(time_steps, history_v, color='purple', linestyle='--', label='Vehicle Speed', alpha=0.6)

ax2.set_ylabel('Speed (m/s)', color='purple')

ax2.tick_params(axis='y', labelcolor='purple')

ax2.legend(loc='upper right')

plt.grid(True)

# 子图 3:单步奖励

plt.subplot(3, 1, 3)

plt.plot(time_steps, history_reward, color='orange', label='Step Reward')

plt.xlabel('Time (s)')

plt.ylabel('Reward')

plt.legend()

plt.grid(True)

plt.tight_layout()

plt.savefig("dqn_evaluation_result.png", dpi=300)

plt.show()

if __name__ == "__main__":

main()2. 复盘分析:绘制能量分配轨迹图

只看最终的得分是不够的,作为工程研究,必须把数据可视化,看看这个"大脑"学到的策略是否符合物理直觉(比如起飞时有没有乖乖用电池,巡航时有没有抓住机会用发动机充电)。

接着上面的代码,利用 matplotlib 把过程画出来:

python

# 绘制测试结果折线图

time_steps = range(len(history_soc))

plt.figure(figsize=(12, 10))

# 子图 1:功率分配 (需求 vs 发动机输出)

plt.subplot(3, 1, 1)

plt.plot(time_steps, history_preq, label='Power Demand (W)', linestyle='--')

plt.plot(time_steps, history_peng, label='Engine Output (W)', alpha=0.8)

plt.ylabel('Power (W)')

plt.title('eVTOL Power Split Strategy (DQN)')

plt.legend()

plt.grid(True)

# 子图 2:电池 SOC 轨迹

plt.subplot(3, 1, 2)

plt.plot(time_steps, history_soc, color='green', label='Battery SOC')

plt.axhline(y=0.2, color='red', linestyle=':', label='Safety Limit (0.2)')

plt.ylabel('SOC')

plt.legend()

plt.grid(True)

# 子图 3:单步奖励/瞬时油耗

plt.subplot(3, 1, 3)

plt.plot(time_steps, history_reward, color='orange', label='Step Reward (-Fuel Rate)')

plt.xlabel('Time (s)')

plt.ylabel('Reward')

plt.legend()

plt.grid(True)

plt.tight_layout()

plt.savefig("dqn_evaluation_result.png", dpi=300)

plt.show()运行这段代码后,你会得到一张非常直观的控制曲线图,这是写论文或项目汇报最核心的成果展示。

3. 横向对标 (Benchmarking):你的策略到底有多好?

在控制工程领域,仅证明"算法能跑通"是不够的,必须证明它"比传统方法更好"或者"接近理论极限"。

为了验证这个强化学习大脑的真正实力,你可以将它在刚才那 600 秒内跑出的总油耗,与你熟悉的其他优化算法进行基准对比。例如:

- 规则逻辑 (Rule-based): 如果单纯使用基于恒温器(Thermostat)或功率跟随的简单

if-else逻辑,总油耗是多少? - 全局最优 (DP 基准): 用我们之前讨论过的 Matlab 动态规划算出的理论最低油耗作为天花板,看看 DQN 离这个极限还有百分之几的差距。

- 启发式算法对比: 如果你在同一个飞行工况和 Simulink 模型上,挂载粒子群优化 (PSO) 或遗传算法 (GA) 来寻找控制指令序列,它们的收敛速度和最终寻优结果与 DQN 相比各有什么优劣?(通常 DQN 训练极慢,但一旦训练好,在线推理只需几毫秒;而 GA/PSO 每次面对新工况都需要重新迭代)。

您遇到的现象(SOC永远卡在0.6,奖励永远是0)并不是神经网络没有在学习,而是物理环境(Simulink)的时间被"锁死"了 ,且动作指令的物理单位出现了严重错位。

🐞 根因分析一:sim() 指令的"时间土拨鼠之日"

在您上一版的代码中,使用了 cmd = f"simOut = sim('{self.model_name}', ...)" 来执行单步仿真。我之前只关注了它能解决数据打包的问题,却忽略了它在强化学习循环中的致命副作用。

在 MATLAB 中,每次调用 sim() 函数,Simulink 都会彻底重启整个物理系统。 这就意味着,系统内部的积分器(计算 SOC 和总油耗的核心)在每一循环都会被强制重置回初始条件(SOC = 0.6,油耗 = 0)。

您的 Python 循环虽然跑了 600 步,但在 Simulink 看来,它并不是连续飞行了 600 秒,而是"起飞了 1 秒钟,然后被强制拔掉电源重置"------这个动作重复了 600 次。 ### 🐞 根因分析二:动作空间的量级坍塌

请看您的动作空间定义:self.action_space = [0.0, 10.0, 20.0, 30.0, 40.0]。

您可能想表达的是 0kW ~ 40kW,但在物理模型中,功率的单位是瓦特(W) 。

当您的智能体输出 40.0 时,发电机只发出了 40 瓦的电。这对于驱动一辆汽车/飞行器来说连点亮车灯都不够,对于发动机的万有特性图(查表模块)来说,40W 对应的燃油消耗率被直接判定为 0。

油耗为 0 -> 燃油惩罚为 0 -> 总奖励为 0。

🛠️ 终极解法:assignin 实时穿透 + 步进模式重构

为了彻底解决"连续物理状态被重置"和"数据拿不出来"这两个痛点,我们需要放弃 sim() 指令,回归 pause/step 模式,并用一个 MATLAB 底层函数 assignin 作为数据穿透通道。

第一步:改造 Simulink 模型(关键提取器)

请打开您的 Simulink 模型,将之前用来输出数据的 To Workspace 模块全部删除 。

在原来输出 SOC、瞬时油耗、电池电流的地方,接上一个 MATLAB Function 模块,双击输入以下代码:

matlab

function fcn(soc, fuel, ibat)

% 声明这是一个可以与外部工作区交互的底层函数

coder.extrinsic('assignin');

% 将当前的实时数值强行写入 Base Workspace

assignin('base', 'rt_soc', soc);

assignin('base', 'rt_fuel', fuel);

assignin('base', 'rt_ibat', ibat);

end(将您模型里的 SOC线 连到端口1,油耗线 连到端口2,电流线 连到端口3)。

这个模块的作用是:只要仿真往前走一步,它就会像探针一样,把最新的数值直接刺穿 Simulink 的壁垒,写进 Python 随时能看见的 MATLAB 工作区里。

第二步:更新 Python 的 SimulinkEnv 类

请用以下代码完全替换您 DQN_train.py 中的 SimulinkEnv 类。这份代码修正了量级问题,并恢复了连续物理时间轴:

python

# ==========================================

# 3. 实时穿透版 Simulink 交互环境

# ==========================================

class SimulinkEnv:

def __init__(self, model_name='DQN_train'):

print("启动 MATLAB 后台引擎中,请稍候...")

self.eng = matlab.engine.start_matlab()

self.model_name = model_name

self.dt = 1.0

# 初始化外部输入变量

self.eng.workspace['simin_P_eng'] = 0.0

self.eng.workspace['simin_v_req'] = 15.0

self.eng.workspace['simin_init_SOC'] = 0.6

# 👇👇👇 增加这三行:预埋探针变量,防止第一次读取时报错 👇👇👇

self.eng.workspace['rt_soc'] = 0.6

self.eng.workspace['rt_fuel'] = 0.0

self.eng.workspace['rt_ibat'] = 0.0

# 👆👆👆 增加这三行 👆👆👆

print("加载 Simulink 模型...")

self.eng.eval(f"load_system('{self.model_name}')", nargout=0)

# 修正:将动作空间的单位统一为瓦特 (W)

self.action_space = [0.0, 10000.0, 20000.0, 30000.0, 40000.0]

self.current_time = 0.0

self.current_soc = 0.6

self.current_v = 15.0

self.max_time = 100.0

def reset(self):

self.current_time = 0.0

self.current_soc = 0.6

self.current_v = 15.0

# 核心改动:使用 start 然后立刻 pause,激活模型但不重置!

self.eng.eval(f"set_param('{self.model_name}', 'SimulationCommand', 'start')", nargout=0)

self.eng.eval(f"set_param('{self.model_name}', 'SimulationCommand', 'pause')", nargout=0)

return np.array([self.current_v, self.current_soc])

def step(self, action_idx):

# 1. 下发物理指令

P_eng_action = self.action_space[action_idx]

self.eng.workspace['simin_P_eng'] = float(P_eng_action)

self.eng.workspace['simin_v_req'] = float(self.current_v)

# 2. 核心指令:只往前推一个 dt,不重启模型!(保持物理积分连续性)

self.eng.eval(f"set_param('{self.model_name}', 'SimulationCommand', 'step')", nargout=0)

# 3. 通过 assignin 探针,直接读取实时标量

next_soc = self.eng.workspace['rt_soc']

fuel_rate = self.eng.workspace['rt_fuel']

bat_current = self.eng.workspace['rt_ibat']

# 4. 计算奖励 (油耗有了具体数值,奖励就不再是 0)

w1, w2, w3 = 0.5, 0.4, 0.1

norm_fuel = fuel_rate / 3.0

norm_soc_penalty = ((next_soc - 0.6) / 0.05) ** 2

norm_deg_penalty = (bat_current / 150.0) ** 2

reward = -(w1 * norm_fuel + w2 * norm_soc_penalty + w3 * norm_deg_penalty)

# 状态更新

self.current_soc = next_soc

self.current_time += self.dt

self.current_v += random.uniform(-2.0, 2.0)

self.current_v = max(0.0, min(self.current_v, 33.0))

done = self.current_time >= self.max_time

next_state = np.array([self.current_v, self.current_soc])

# 5. 回合结束时必须彻底停止模型,以便下次 reset 重新开始

if done:

self.eng.eval(f"set_param('{self.model_name}', 'SimulationCommand', 'stop')", nargout=0)

return next_state, float(reward), done

🛠️ 第一步:拆除旧的输出模块

请在画布上选中以下三个模块,并直接按键盘 Delete 键删除它们:

- 最右上角的

State_Preq - 中间下方的

Reward_Fuel - 最右侧的

State_SOC

🛠️ 第二步:引入核心探针模块

打开 Simulink 库浏览器 (Library Browser),找到 User-Defined Functions 库,将其中的 MATLAB Function 模块拖拽到画布最右侧的空白区域。

🛠️ 第三步:精准接线(极度关键)

我们需要把模型里最核心的三个物理量"喂"给这个新的 MATLAB Function 模块。请引出三根线连接到该模块的输入端:

- 连入端口 1 (SOC状态): 从最右侧的积分器 (

1/s) 输出端(即SOC_current这根线)引出一根分支,连入端口 1。 - 连入端口 2 (瞬时油耗): 从中间查表模块

1-D T(u)出来后、进入下方积分器之前的那根线上引出分支(也就是刚才Reward_Fuel所在的位置),连入端口 2。 - 连入端口 3 (电池电流): 请观察图中

P_batt加减法器后面的两个三角形放大器(Gain 模块-K-)。第一个放大器是把功率转成电流,第二个是进行安时积分。请从这两个三角形模块中间的那根连线上引出一个分支,连入端口 3。

🛠️ 第四步:注入穿透代码

双击打开这个 MATLAB Function 模块,将里面的默认代码全部清空,严格替换为以下这段代码:

matlab

function dummy = fcn(soc, fuel, ibat)

% 声明这是一个可以与外部 MATLAB 工作区交互的底层函数

coder.extrinsic('assignin');

% 将当前的实时物理数值强行写入 Base Workspace

assignin('base', 'rt_soc', soc);

assignin('base', 'rt_fuel', fuel);

assignin('base', 'rt_ibat', ibat);

% 随便输出一个值,用来骗过编译器,防止模块被优化删掉

dummy = 0;

end🎯 检查与运行

- 代码写完后保存并关闭该模块的代码编辑窗口。

- 按

Ctrl+S保存整个 Simulink 模型。 - 确保您已经使用了我上一条回复中提供的最新的 Python

SimulinkEnv类代码 (里面使用了step步进指令和rt_soc变量名)。

现在,您可以再次运行 Python 训练代码了!这一次,您会看到 step 指令让物理时间轴真正连续流动起来,惩罚函数将获得真实的油耗数据,SOC 也会随着飞行器的动作开始动态下降或上升了。

恭喜!程序能完整跑完 10 轮且没有报任何红字错误,这意味着 Python 和 MATLAB 之间的底层通讯桥梁已经 100% 稳定打通了!这是联合仿真中最难跨越的一道坎。

至于为什么数值全是 0,这是一个非常典型的"静默故障(Silent Failure)"。环境虽然在运行,但数据却没有真正产生交互。根本原因有两个:

🕵️♂️ 破案分析

- "跨服聊天"的变量名对不上:

在您发给我的 Python 代码中,您给 MATLAB 工作区写入动作的指令是self.eng.workspace['simin_P_eng'] = ...。

但是!根据您之前的 Simulink 截图,您模型里接收动作的那个常数模块(Constant)名字叫做action_ws。Python 在给simin喊话,Simulink 在等action_ws,两者根本没接上,导致发电机输出永远是 0。 - "时间静止"的求解器陷阱:

当我们在 Python 中调用SimulationCommand,'step'时,Simulink 会往前走一个"步长"。但如果您的 Simulink 模型默认是"变步长(Variable-step)"求解器,这一步可能只走了 0.00010.00010.0001 秒!时间几乎没有流逝,安时积分器算出的 SOC 自然永远停留在 0.60000.60000.6000。

🛠️ 终极修复方案(只需修改 Python 代码)

请用下面这段代码,完全替换 您 DQN_train.py 中的 3. 极度精简的 Simulink 交互环境 这一整部分:

python

# ==========================================

# 3. 实时穿透版 Simulink 交互环境 (修复变量与时间轴)

# ==========================================

class SimulinkEnv:

def __init__(self, model_name='DQN_train'):

print("启动 MATLAB 后台引擎中,请稍候...")

self.eng = matlab.engine.start_matlab()

self.model_name = model_name

self.dt = 1.0

# 1. 预埋探针变量,防止首次读取时报错

self.eng.workspace['rt_soc'] = 0.6

self.eng.workspace['rt_fuel'] = 0.0

self.eng.workspace['rt_ibat'] = 0.0

# 2. 预埋动作变量 (名字必须与 Simulink 中的 Constant 模块完全一致!)

self.eng.workspace['action_ws'] = 0.0

print("加载 Simulink 模型...")

self.eng.eval(f"load_system('{self.model_name}')", nargout=0)

# 3. 强制锁定求解器为固定步长 1 秒!(极度关键,防止时间静止)

self.eng.eval(f"set_param('{self.model_name}', 'SolverType', 'Fixed-step')", nargout=0)

self.eng.eval(f"set_param('{self.model_name}', 'FixedStep', '1.0')", nargout=0)

# 动作空间:0, 10kW, 20kW, 30kW, 40kW (注意单位是 W)

self.action_space = [0.0, 10000.0, 20000.0, 30000.0, 40000.0]

self.current_time = 0.0

self.current_soc = 0.6

self.current_Preq = 30000.0 # 假设初始需求功率为 30kW

self.max_time = 600.0 # 飞行/行驶总时长

def reset(self):

self.current_time = 0.0

self.current_soc = 0.6

# 使用 start 然后立刻 pause,激活物理引擎但不重置时间!

self.eng.eval(f"set_param('{self.model_name}', 'SimulationCommand', 'start')", nargout=0)

self.eng.eval(f"set_param('{self.model_name}', 'SimulationCommand', 'pause')", nargout=0)

return np.array([self.current_Preq, self.current_soc])

def step(self, action_idx):

# 1. 下发物理指令 (名字修正为 action_ws)

P_eng_action = self.action_space[action_idx]

self.eng.workspace['action_ws'] = float(P_eng_action)

# 2. 往前推一个固定步长 (1秒)

self.eng.eval(f"set_param('{self.model_name}', 'SimulationCommand', 'step')", nargout=0)

# 3. 通过 assignin 探针读取实时数值

next_soc = float(self.eng.workspace['rt_soc'])

fuel_rate = float(self.eng.workspace['rt_fuel'])

bat_current = float(self.eng.workspace['rt_ibat'])

# 4. 计算多目标奖励函数

w1, w2, w3 = 0.5, 0.4, 0.1

norm_fuel = fuel_rate / 3.0

norm_soc_penalty = ((next_soc - 0.6) / 0.05) ** 2

norm_deg_penalty = (bat_current / 150.0) ** 2

reward = -(w1 * norm_fuel + w2 * norm_soc_penalty + w3 * norm_deg_penalty)

# 5. 状态更新与工况演进

self.current_soc = next_soc

self.current_time += self.dt

# 简单的工况随机扰动 (模拟功率需求的变化)

self.current_Preq += random.uniform(-2000.0, 2000.0)

self.current_Preq = max(10000.0, min(self.current_Preq, 60000.0))

done = self.current_time >= self.max_time

next_state = np.array([self.current_Preq, self.current_soc])

# 6. 回合结束时停止模型,以便下次 reset

if done:

self.eng.eval(f"set_param('{self.model_name}', 'SimulationCommand', 'stop')", nargout=0)

return next_state, float(reward), done修改重点说明:

Fixed-step注入: 我在初始化里加了两条底层的set_param指令,强行把 Simulink 的引擎锁死在了 1 秒走一步,这样积分器才能算出真实的 SOC 消耗。- 动作通道对齐: 将写入代码改为了

self.eng.workspace['action_ws']。

替换完毕后再次运行,您绝对会看到 SOC 开始不再是 0.60000.60000.6000,而是会随着智能体的瞎试出现下降或上升,且总奖励也会变成负数的惩罚值了!如果数值动了,就意味着智能体真正开始"学"东西了!

🕵️♂️ 隐形杀手 1:Python 的"闪电侠"错觉 (异步执行陷阱)

当 Python 运行 step 时,它向 MATLAB 喊了一句:"往前走一步!"

注意:这个命令是异步的! MATLAB 刚开始吭哧吭哧计算复杂的物理方程,Python 根本不等待,直接以光速执行了下一行代码去读取 rt_soc。

结果就是:在 Simulink 的时间轴连 0.0010.0010.001 秒都没走完的时候,Python 已经把循环跑了 600 次。它每次读到的都是初始状态(0.6),自然奖励永远是 0。

🕵️♂️ 隐形杀手 2:常数模块的"顽固不化"

当 Simulink 处于运行或暂停状态时,您通过 self.eng.workspace['action_ws'] = ... 修改了工作区变量,但 Simulink 模型里的那个 Constant 模块并不会动态更新!它只在点击"开始"的那一瞬间读取一次工作区,之后就彻底锁死了,导致发电机输出功率永远是初始的 0。

🛠️ 终极拔刺方案(只需两步)

第一步:给模型里的模块起个真名字(Simulink操作)

打开您的 Simulink 模型,找到最左边代表动作输入的那个 Constant (常数) 模块 (就是里面写着 action_ws 的那个)。

- 点击它下方可能隐藏的文字(或者右键 -> Format -> Show Block Name)。

- 将这个模块的名称强行改为:

action_block。 - 保存模型(

Ctrl+S)。

第二步:加入"死锁等待"与"暴力注入"(Python代码替换)

请在您的 DQN_train.py 文件最上方加上 import time,然后用以下代码完全替换 SimulinkEnv 类中的 reset 和 step 方法:

python

import time # 务必确保文件最开头导入了 time 模块

def reset(self):

self.current_time = 0.0

self.current_soc = 0.6

self.current_Preq = 30000.0

# 1. 启动仿真

self.eng.eval(f"set_param('{self.model_name}', 'SimulationCommand', 'start')", nargout=0)

# 2. 【智能等待逻辑】时刻监控 Simulink 到底在干嘛

while True:

self.eng.eval(f"curr_status = get_param('{self.model_name}', 'SimulationStatus');", nargout=0)

status = self.eng.workspace['curr_status']

if status == 'paused':

break # 成功暂停,退出等待

elif status == 'running':

# 只有等它真跑起来了,按暂停才有用

self.eng.eval(f"set_param('{self.model_name}', 'SimulationCommand', 'pause')", nargout=0)

elif status == 'stopped':

print("\n【警告】模型在重置时意外停止!请打开 Simulink 界面查看是否有红色报错信息。")

break

time.sleep(0.1) # 休息 0.1 秒再查

return np.array([self.current_Preq, self.current_soc])

def step(self, action_idx):

P_eng_action = self.action_space[action_idx]

# 1. 暴力注入动作

self.eng.eval(f"set_param('{self.model_name}/action_block', 'Value', '{P_eng_action}')", nargout=0)

# 2. 下达步进指令

self.eng.eval(f"set_param('{self.model_name}', 'SimulationCommand', 'step')", nargout=0)

# 3. 【智能死锁等待】防止跑丢

while True:

self.eng.eval(f"curr_status = get_param('{self.model_name}', 'SimulationStatus');", nargout=0)

status = self.eng.workspace['curr_status']

if status == 'paused':

break # 走完这一步,又暂停了,完美

elif status == 'stopped':

break # 整个 600 秒周期跑完了

time.sleep(0.05)

# 4. 读取新鲜数据

next_soc = float(self.eng.workspace['rt_soc'])

fuel_rate = float(self.eng.workspace['rt_fuel'])

bat_current = float(self.eng.workspace['rt_ibat'])

# 5. 计算奖励

w1, w2, w3 = 0.5, 0.4, 0.1

norm_fuel = fuel_rate / 3.0

norm_soc_penalty = ((next_soc - 0.6) / 0.05) ** 2

norm_deg_penalty = (bat_current / 150.0) ** 2

reward = -(w1 * norm_fuel + w2 * norm_soc_penalty + w3 * norm_deg_penalty)

# 更新状态

self.current_soc = next_soc

self.current_time += self.dt

self.current_Preq += random.uniform(-2000.0, 2000.0)

self.current_Preq = max(10000.0, min(self.current_Preq, 60000.0))

done = self.current_time >= self.max_time

next_state = np.array([self.current_Preq, self.current_soc])

if done:

self.eng.eval(f"set_param('{self.model_name}', 'SimulationCommand', 'stop')", nargout=0)

return next_state, float(reward), done