中山大学和联想研究院提出AutoStudio: 是一种无需训练的多代理框架,用于多轮交互式图像生成,能够在生成多样化图像的同时保持主体一致性。

AutoStudio 采用三个基于 LLM 的智能体来解释人类意图并为 SD 模型生成适当的布局指导。此外,还引入了一种新颖的 P-UNet 架构和一种主题初始化生成方法,以增强具有主题感知特征的 SD 模型,最终有助于生成具有多主题一致性的高质量图像。大量实验验证了 AutoStudio 在各种任务中的卓越性能,为先进且用户友好的 T2I 应用程序开辟了新的可能性。

相关链接

项目地址:https://howe183.github.io/AutoStudio.io/

论文地址:https://arxiv.org/pdf/2406.01388

代码链接:https://github.com/donahowe/AutoStudio

论文阅读

AutoStudio:在多轮交互式图像生成中制作一致的主题

摘要

由于尖端的文本转图像 (T2I) 生成模型已经擅长生成出色的单幅图像,因此一项更具挑战性的任务,即多轮交互式图像生成,开始引起相关研究界的关注。此任务要求模型与用户进行多轮交互以生成连贯的图像序列。但是,由于用户可能频繁切换主题,因此当前的努力很难在生成多样化图像的同时保持主题一致性。为了解决这个问题,我们引入了一个无需训练的多智能体框架,称为 AutoStudio。

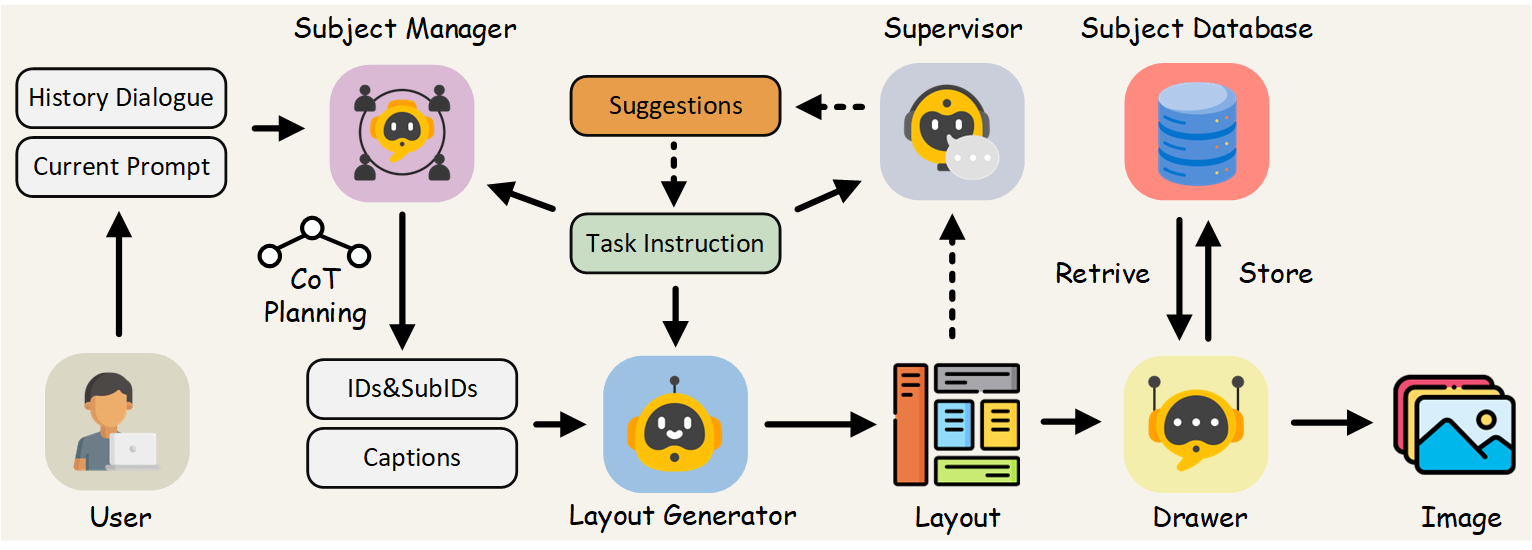

AutoStudio 使用三个基于大型语言模型 (LLM) 的智能体来处理交互,以及一个基于稳定扩散 (SD) 的智能体来生成高质量图像。具体来说,AutoStudio 包括

-

一个主题管理器,用于解释交互对话并管理每个主题的上下文;

-

一个布局生成器,用于生成细粒度的边界框以控制主题位置;

-

一个主管,用于提供布局改进建议;

-

一个抽屉,用于完成图像生成。

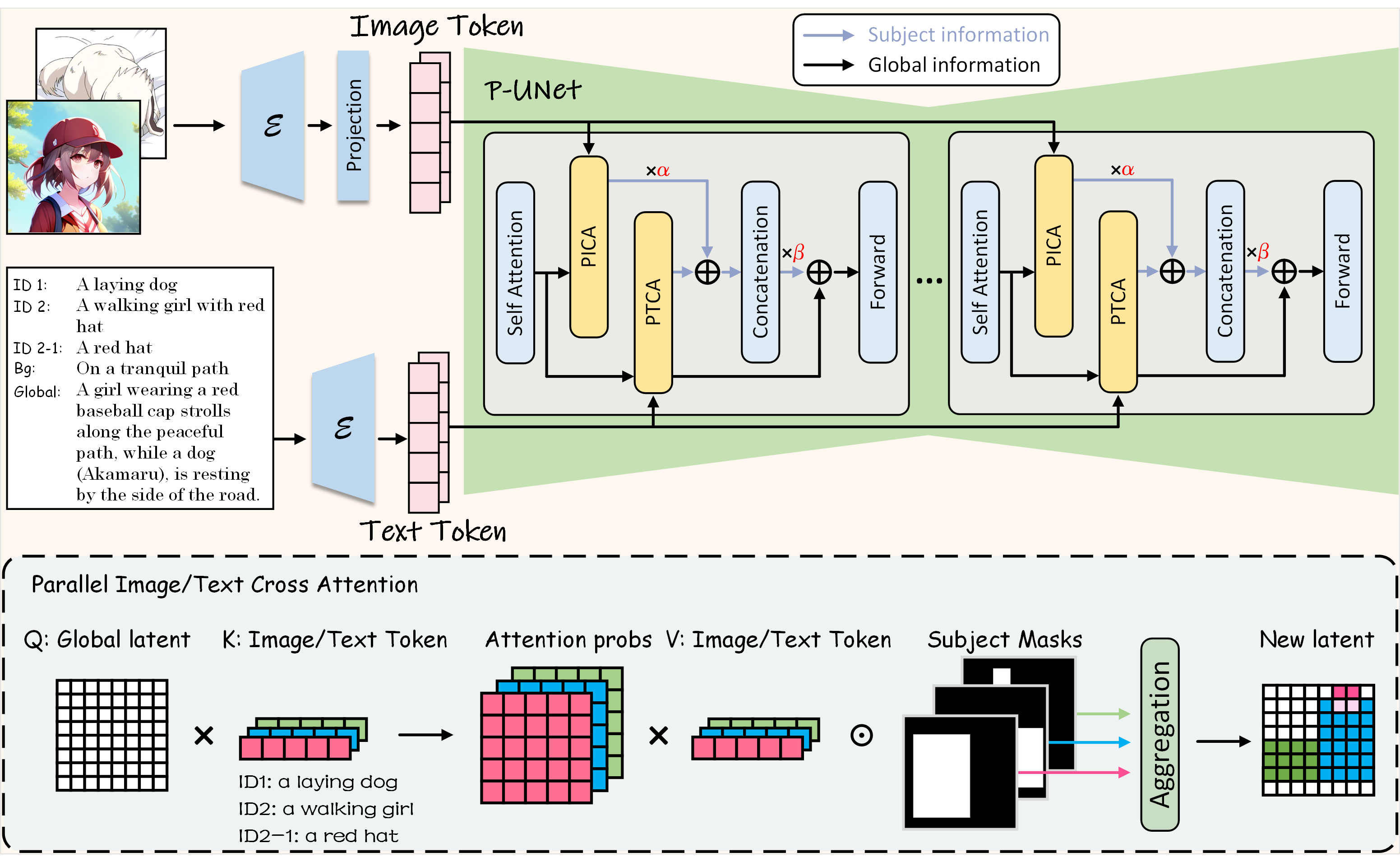

此外,我们引入了 Parallel-UNet 来替换抽屉中的原始 UNet,它采用两个并行的交叉注意模块来利用主题感知特征。我们还引入了一种主题初始化生成方法来更好地保留小主题。我们的 AutoStudio 可以以交互和一致的方式生成一系列多主题图像。在公开的 CMIGBench 基准和人类评估上进行的大量实验表明,AutoStudio 在多个回合中保持了良好的多主题一致性,并且它还将平均 Frechet 初始距离和平均字符-字符相似度的当前最佳性能提高了 13.65%,提高了 2.83%。

方法

AutoStudio 的总体结构。AutoStudio 利用四个代理和一个主题数据库来完成多轮多主题交互式图像生成:

-

主题管理器解释用户对话;

-

布局生成器提供布局;

-

主管提供布局细化建议;

-

绘图员根据细化的布局和主题数据库生成图像。

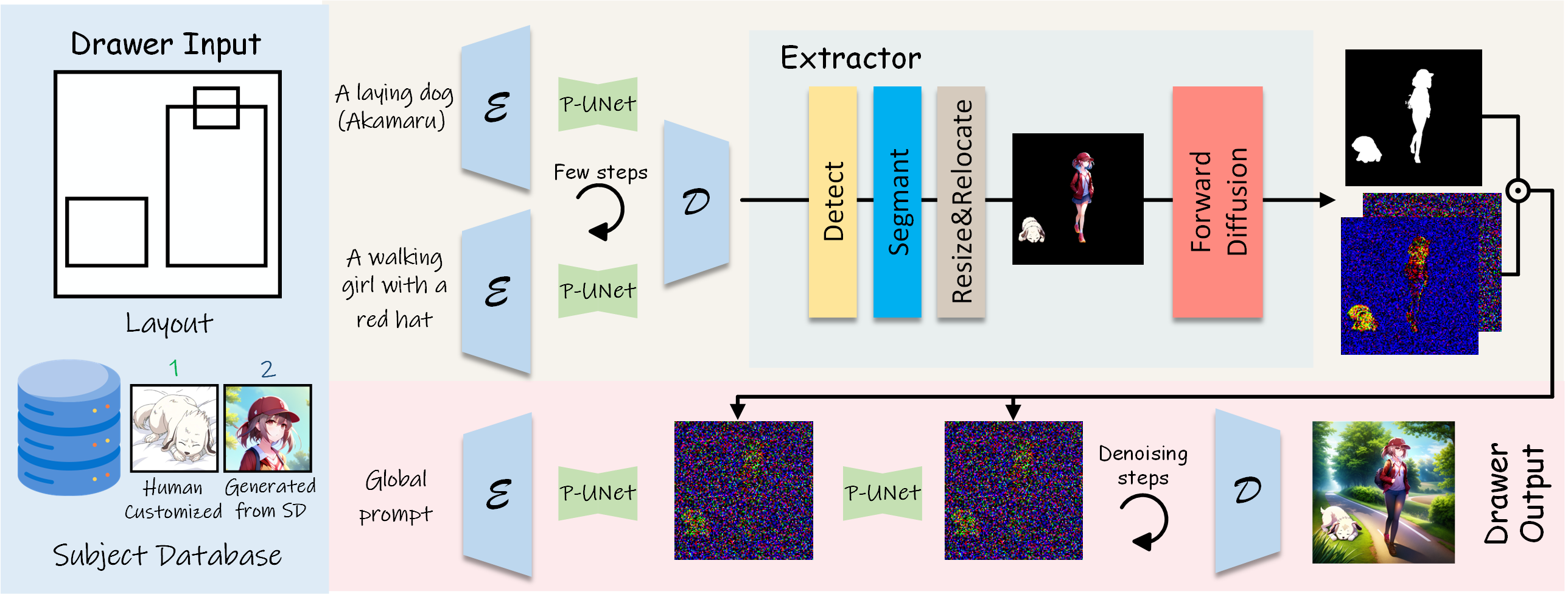

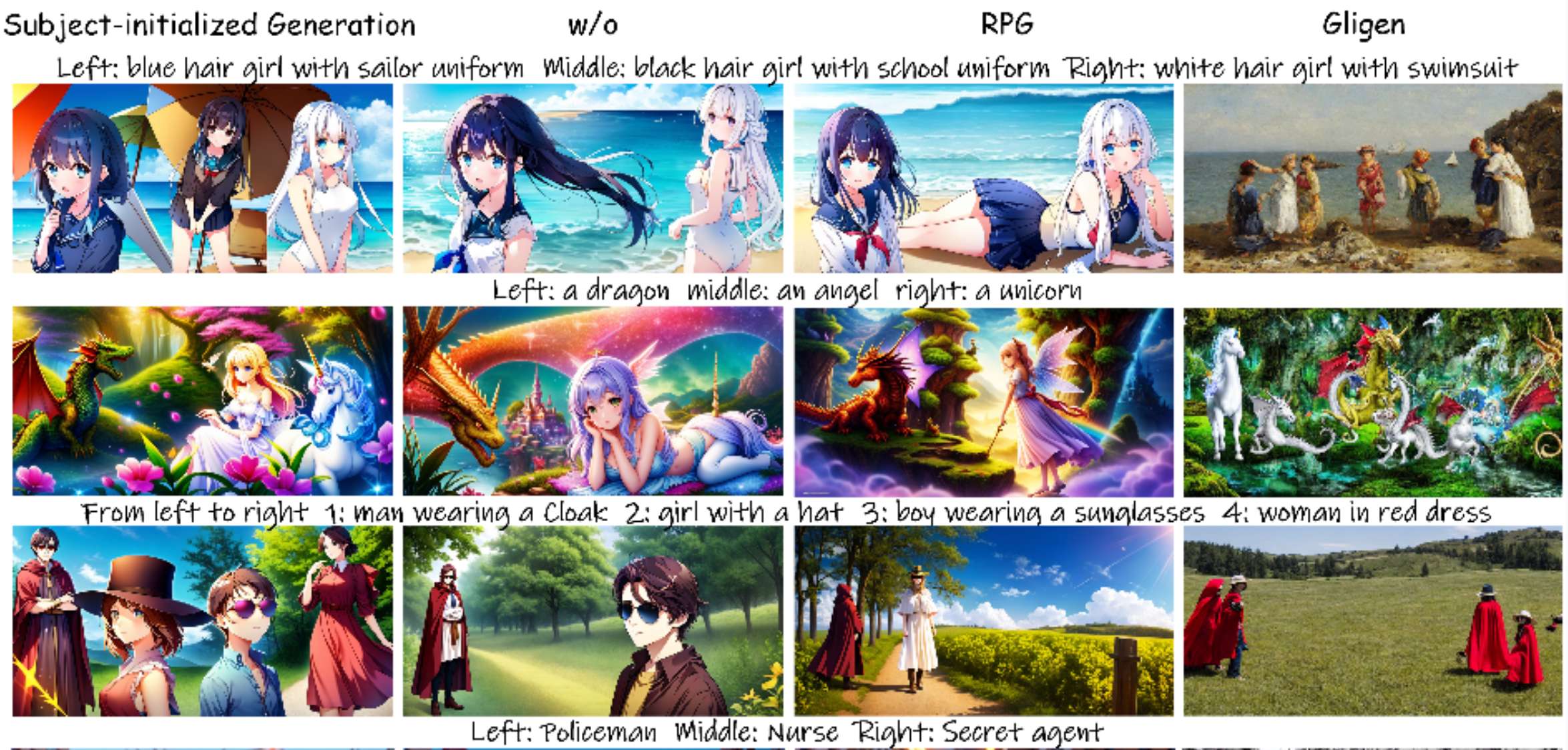

主题初始化生成方法的总体结构。

P-UNet的整体结构,其中核心组件是并行的文本和图像交叉注意模块。

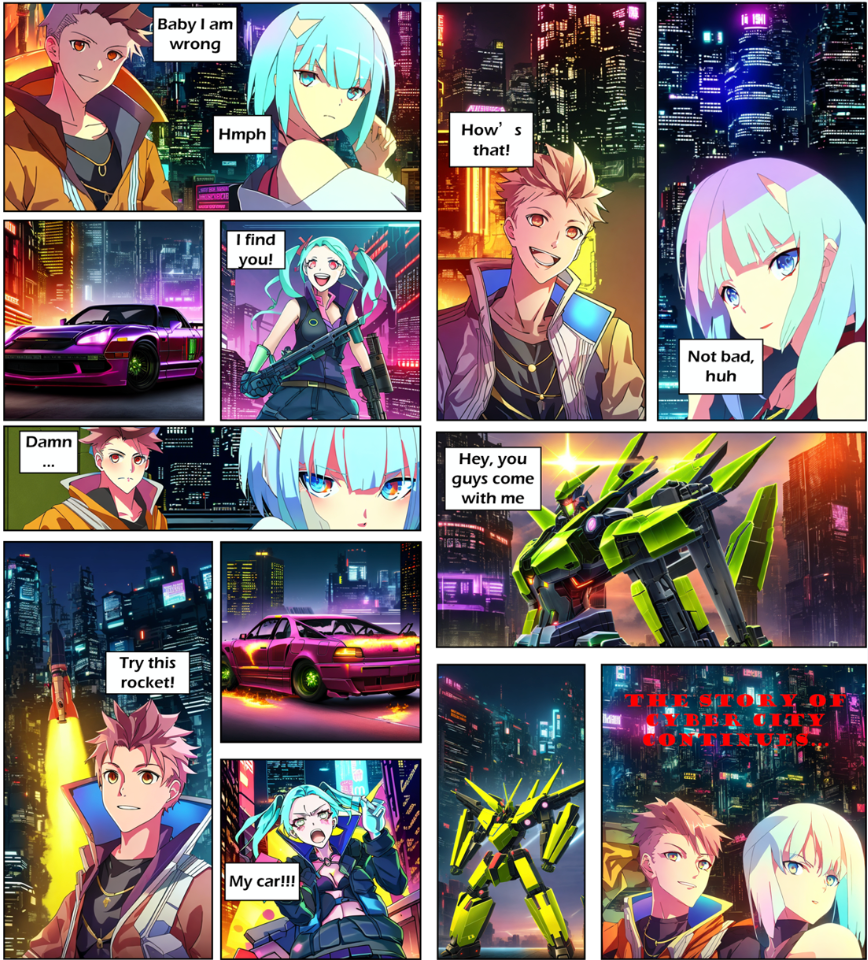

效果展示

连续对话

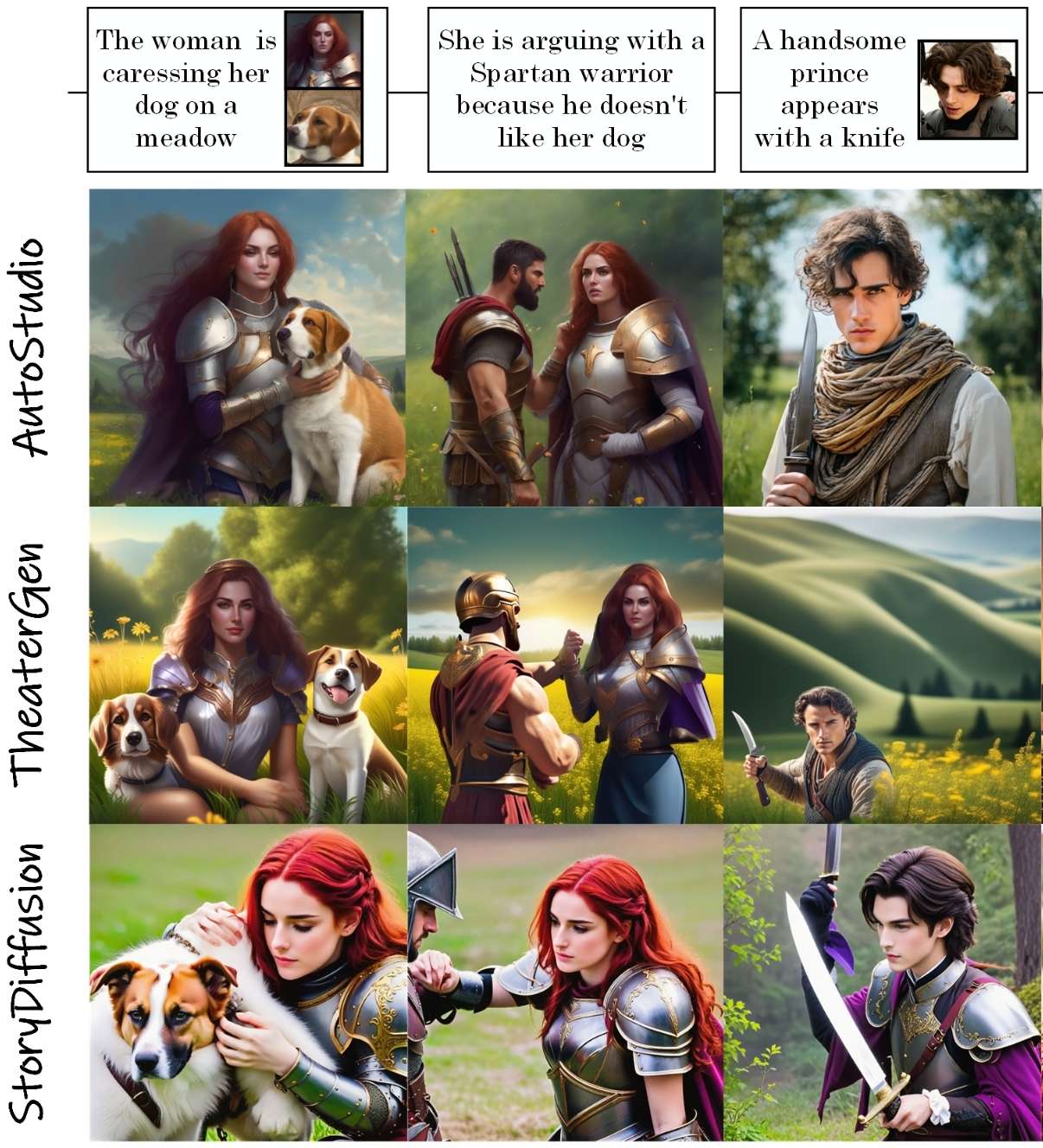

多轮交互式图像生成

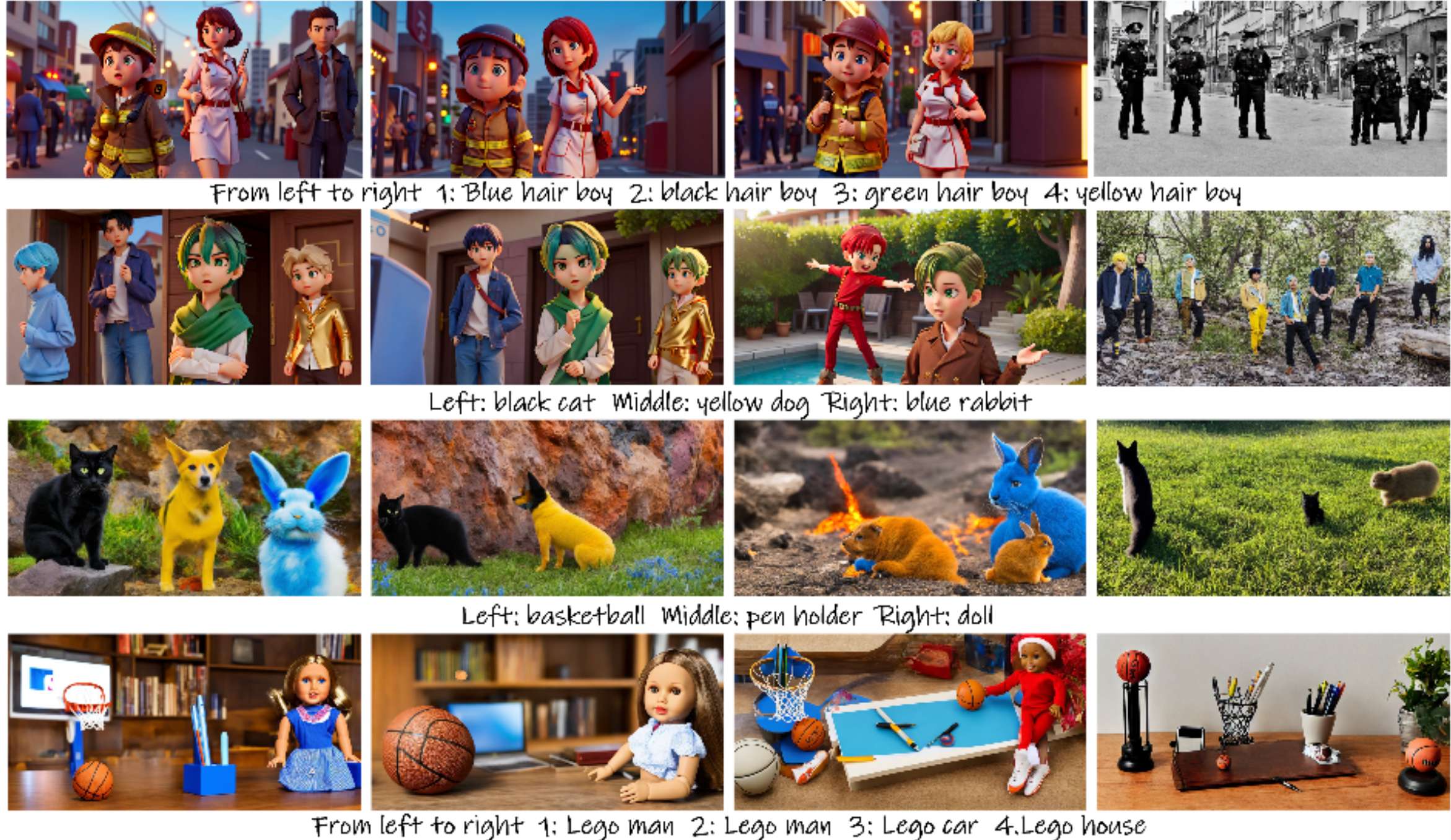

多功能绑定

结论

本文介绍了 AutoStudio,这是一种新型的无需训练的多智能体框架,可成功解决多轮交互式图像生成问题。AutoStudio 采用三个基于 LLM 的智能体来解释人类意图并为 SD 模型生成适当的布局指导。此外,还引入了一种新颖的 P-UNet 架构和一种主题初始化生成方法,以增强具有主题感知特征的 SD 模型,最终有助于生成具有多主题一致性的高质量图像。大量实验验证了 AutoStudio 在各种任务中的卓越性能,为先进且用户友好的 T2I 应用程序开辟了新的可能性。