11天 本节学习到BERT全称是来自变换器的双向编码器表征量,它是Google于2018年末开发并发布的一种新型语言模型。BERT模型的主要创新点都在pre-train方法上,即用了Masked Language Model和Next Sentence Prediction两种方法分别捕捉词语和句子级别的representation。通过一个文本情感分类任务为例子来学习了BERT模型的整个应用过程。

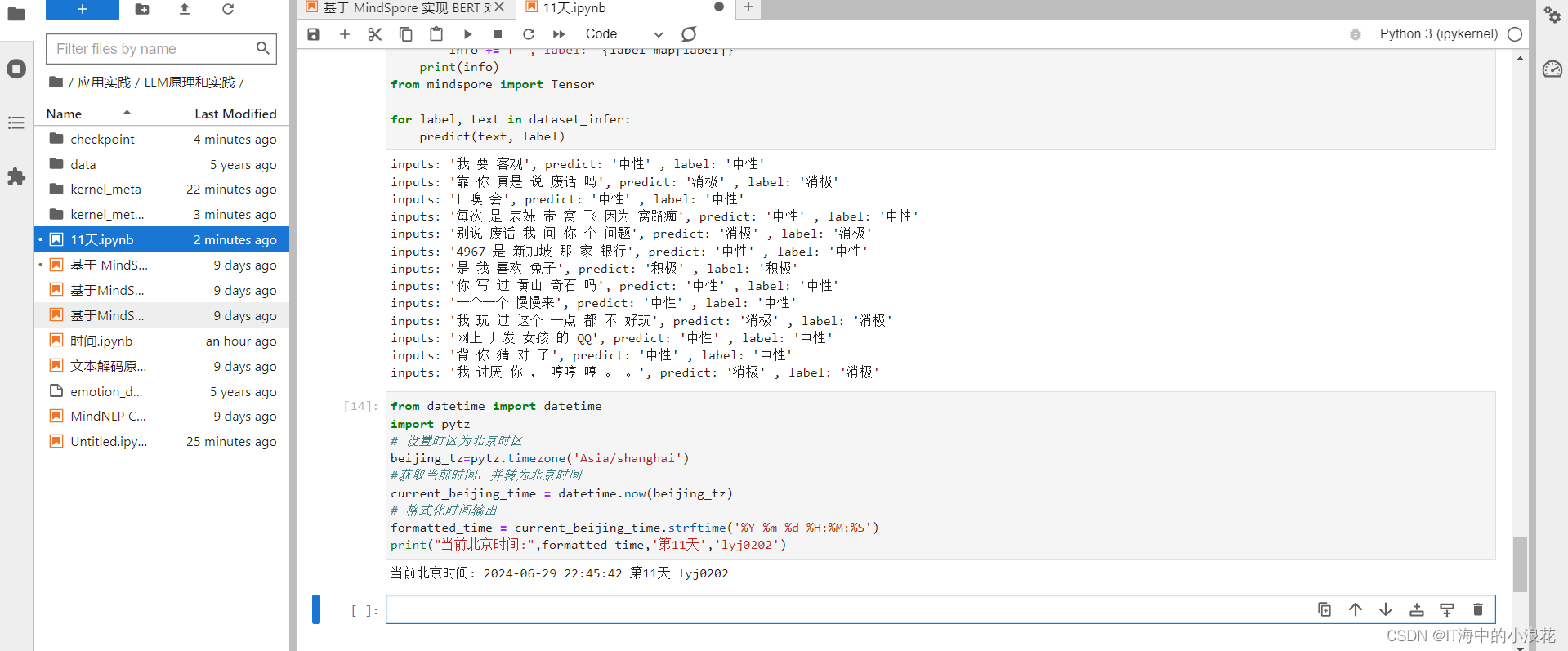

本节学习到BERT全称是来自变换器的双向编码器表征量,它是Google于2018年末开发并发布的一种新型语言模型。BERT模型的主要创新点都在pre-train方法上,即用了Masked Language Model和Next Sentence Prediction两种方法分别捕捉词语和句子级别的representation。通过一个文本情感分类任务为例子来学习了BERT模型的整个应用过程。

《昇思25天学习打卡营第11天 | 昇思MindSpore基于 MindSpore 实现 BERT 对话情绪识别》

IT海中的小浪花2024-07-03 14:11

相关推荐

极客老王说Agent14 小时前

屏幕理解能力是下一代自动化的关键吗?2026年自动化范式演进深度解析YueJoy.AI14 小时前

低算力场景下中小企业接入大模型的商业化路径星恒随风14 小时前

Python 基础语法详解(一):从表达式、变量到数据类型smart199814 小时前

U.2 NVMe全闪磁盘阵列让AI, ML, HPC业务运行稳性高效懷淰メ14 小时前

【AI加持】基于PyQt+YOLO+DeepSeek的疟原虫检测系统(详细介绍)Black蜡笔小新14 小时前

自动化AI算法训练服务器DLTM训推一体化平台助力农业生产管理实现安全智能化米小虾14 小时前

Claude Code、Codex、Cursor三分天下:2026年AI编程Agent生态全景剖析ZHW_AI课题组15 小时前

腾讯云调用IP定位Wch1G0z8A15 小时前

Google 开源了啥,让 AI Agent 碰数据库不再是定时炸弹