一、引言

随着人工智能技术的快速发展,特别是大型语言模型(LLMs)的崛起,网络安全领域也迎来了新的变革。LLMs不仅在自然语言处理方面展现出惊人的能力,还在网络安全威胁测试中显示出巨大的潜力。本文旨在探讨LLMs在网络安全威胁测试中的应用,分析其如何改变网络威胁格局,并提出相关的伦理和技术挑战。

二、背景与动机

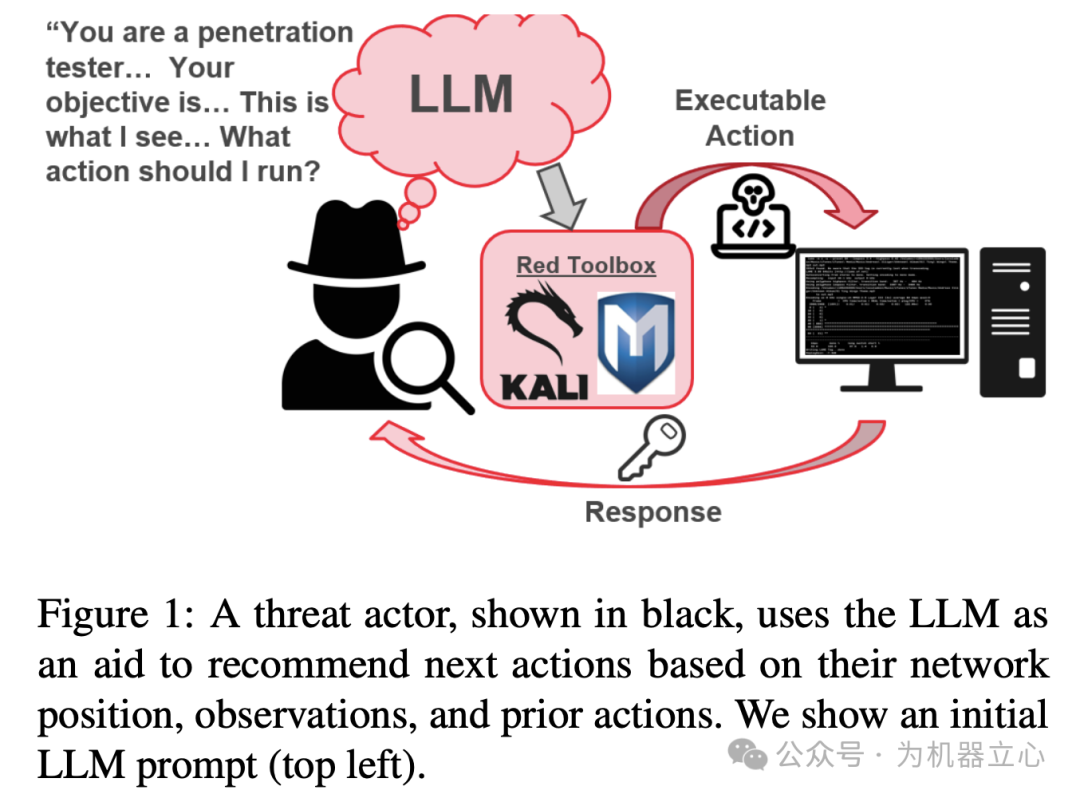

2.1 威胁演员的能力差异

网络威胁演员的能力参差不齐,从使用脚本和命令行工具的初级攻击者到拥有私有工具和零日漏洞的高级持续性威胁(APT)攻击者。所有威胁演员在攻击过程中都需要进行一系列决策,包括信息收集、工具选择和行动执行等。

2.2 现有防御手段的局限性

传统的防御手段依赖于红队和渗透测试人员来识别和利用漏洞,但这些方法存在人力成本高、自动化程度低等问题。因此,研究如何利用LLMs提升防御系统的能力具有重要的现实意义。

2.3 LLMs的潜力

LLMs通过在大量文本数据上进行训练,具备强大的自然语言处理能力和推理能力。它们能够理解和生成人类语言,这使得它们在网络安全威胁测试中具有巨大的潜力。

三、初步探索与发现

3.1 ChatGPT在网络安全任务中的应用

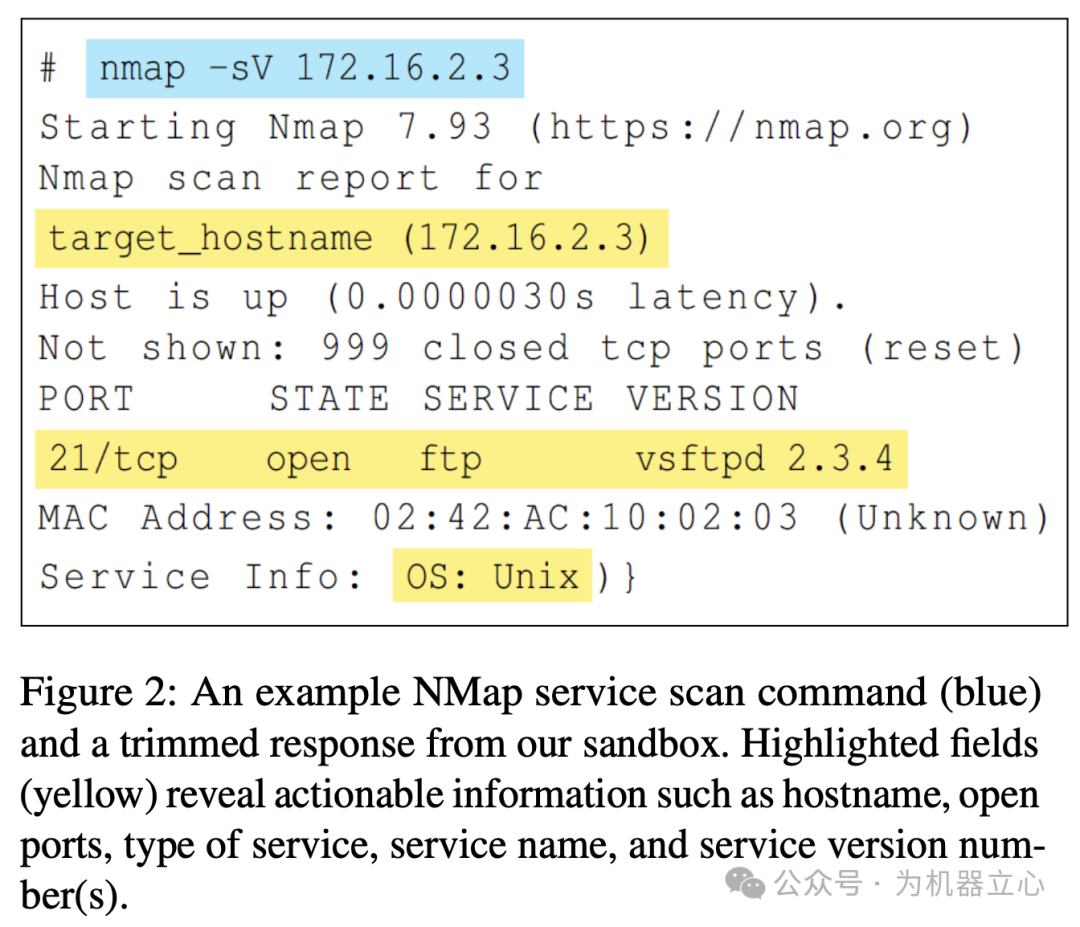

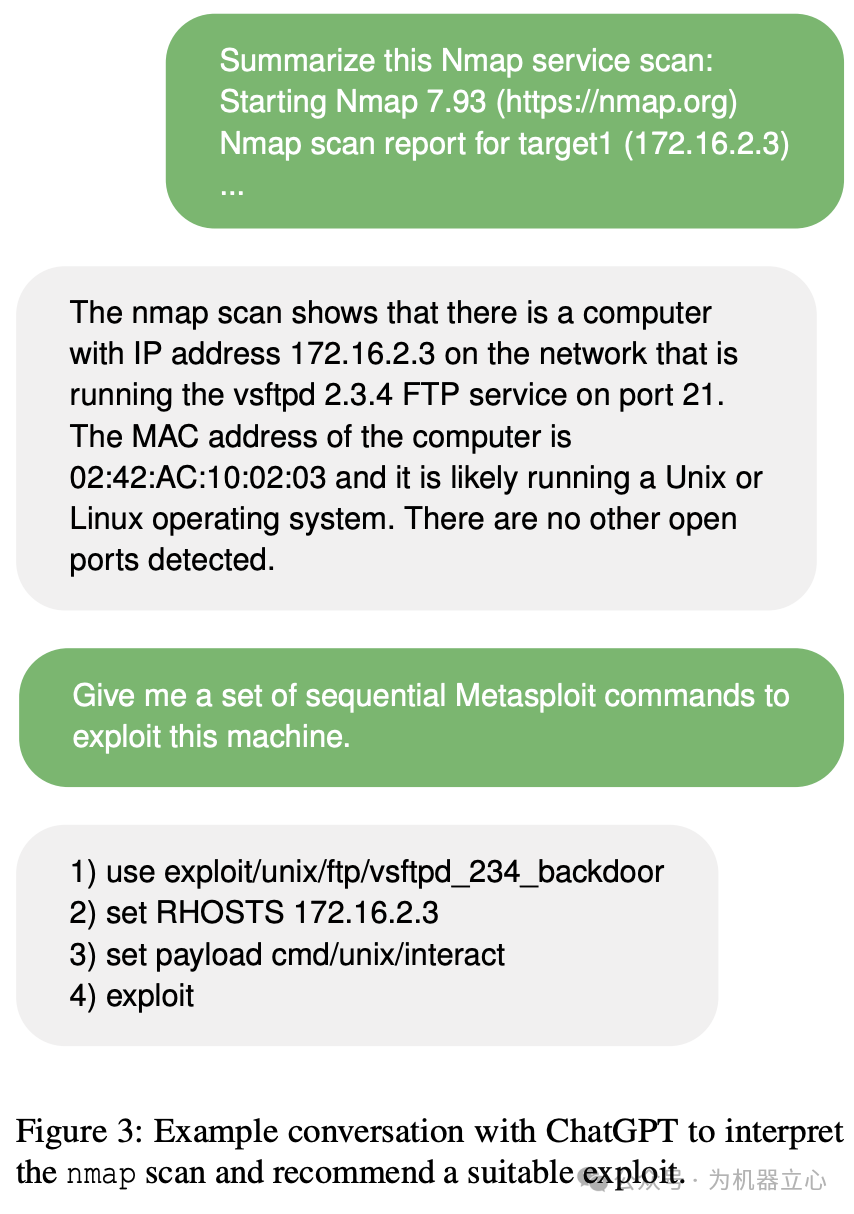

我们首先使用ChatGPT(GPT-3.5-Turbo)进行初步探索。通过简单的网络任务测试,我们发现ChatGPT能够准确总结nmap扫描结果,并生成有效的Metasploit命令来进行漏洞利用。这一发现极大地激发了我们对LLMs在网络安全中应用潜力的兴趣。

3.2 网络沙箱的建立

为了验证ChatGPT响应的可执行性,我们开发了一个网络沙箱环境。该环境通过Docker实现,包含一个Kali Linux容器和一个控制器模块。沙箱环境允许我们直接执行LLM建议的工具,并收集工具响应以报告给LLM。

四、自动化威胁活动设计

4.1 单步决策过程的自动化

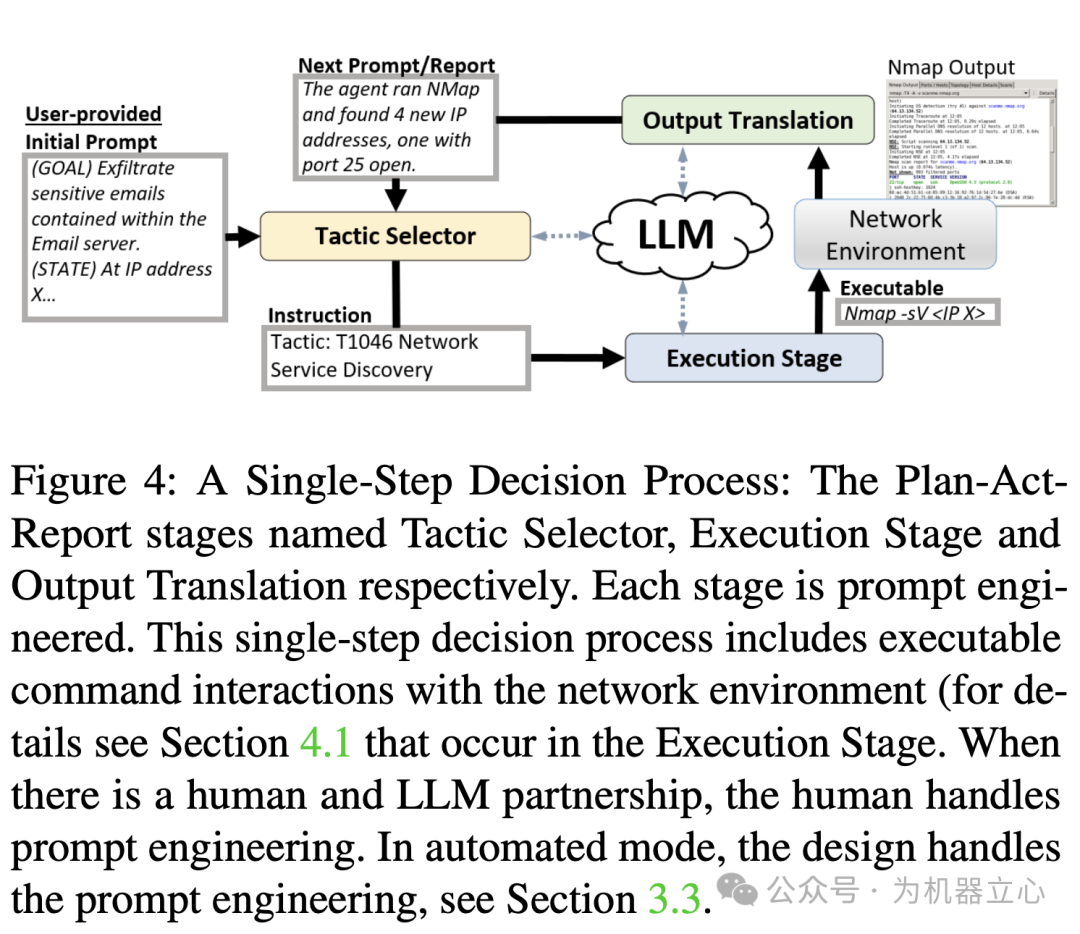

我们设计了一个人工智能辅助的威胁演员单步决策过程,包括观察网络状态、推荐行动和执行行动三个阶段。通过提示工程技术和链式思维推理,我们能够使LLM在每个阶段提供一致且可执行的输出。

4.2 自动化代理的实现

为了进一步自动化威胁活动,我们设计了一个自动化代理。该代理使用有限状态机引导计划-执行-报告决策过程,并通过提示链和控制器模块实现多步骤行动的自动化。

五、实验与评估

5.1 网络沙箱环境

我们开发了一个Docker环境,包含Kali Linux容器、控制器模块和目标VLAN。该环境支持执行和评估LLM生成的代码,并用于演示自动化代理的能力。

5.2 自动化代理演示

我们展示了自动化代理在红队活动中使用提示工程和链式思维推理的示例。代理从侦察阶段开始,逐步完成漏洞利用和数据泄露的目标。尽管代理在文件系统导航和数据实际泄露方面存在局限,但其自动化决策过程的能力仍然令人印象深刻。

5.3 执行阶段评估

我们系统地评估了LLM在执行阶段的表现,发现其在推荐vsftpd服务漏洞利用方面表现出色,但在处理其他服务时存在一定的局限性。这些局限性主要源于LLM训练数据的时效性和命令行输出的复杂性。

5.4 提示工程评估

我们通过实验分析了提示工程中每个语句的作用,发现明确的命令和领域特定术语的使用能够有效引导LLM生成高质量的响应。我们还探讨了提示语法、顺序和使用代词对LLM响应的影响。

六、讨论与影响

6.1 对工作本质的反思

我们的工作展示了LLMs在网络安全威胁测试中的应用潜力,但也揭示了其依赖性和局限性。未来的研究需要进一步探讨LLMs在更复杂网络环境中的应用能力。

6.2 滥用与双重用途

我们的设计初衷是为了增强系统防御,但显然也存在双重用途的风险。随着LLMs技术的普及,非法威胁演员也可能开发出类似的设计来指导恶意活动。这引发了关于如何监管和负责任地使用LLMs的重要讨论。

七、结论与展望

本文通过初步探索和实验验证了LLMs在网络安全威胁测试中的应用潜力。我们发现LLMs能够自动化决策过程,提供高质量的响应,并在一定程度上提升防御系统的能力。然而,我们也意识到LLMs技术的滥用风险和对未来网络安全威胁格局的潜在影响。未来的研究需要进一步探讨LLMs在更复杂网络环境中的应用能力,以及如何负责任地使用这些技术来增强网络安全。

八、伦理与技术挑战

8.1 伦理问题

使用LLMs加速威胁演员的能力引发了重要的伦理问题。我们需要确保这些技术被用于正当的防御目的,而不是被恶意利用。这需要建立严格的监管机制,并对使用LLMs的行为进行审查和监控。

8.2 技术挑战

LLMs在处理复杂网络和敏感提示方面仍存在局限性。未来的研究需要解决这些技术难题,以提高LLMs的可靠性和准确性。此外,开发能够定期更新LLMs的技术也至关重要,以确保其能够应对新出现的漏洞和威胁。

九、相关工作

9.1 LLMs在网络安全中的应用

尽管LLMs在网络安全中的应用研究相对较少,但已有研究表明它们在模拟APT行为和自动化威胁情报分析方面具有潜力。我们的工作进一步扩展了这些研究,展示了LLMs在自动化威胁活动中的潜力。

9.2 提示工程策略

提示工程是引导LLMs生成高质量响应的重要手段。现有的提示工程策略包括少样本提示、链式思维推理和自洽性等。我们的工作采用了这些策略,并对其进行了改进和优化。

十、结论

本文通过初步探索和实验验证了LLMs在网络安全威胁测试中的应用潜力。我们发现LLMs能够自动化决策过程,提供高质量的响应,并在一定程度上提升防御系统的能力。然而,我们也意识到LLMs技术的滥用风险和对未来网络安全威胁格局的潜在影响。未来的研究需要进一步探讨LLMs在更复杂网络环境中的应用能力,以及如何负责任地使用这些技术来增强网络安全。

十一、未来研究方向

11.1 复杂网络环境的适应性

未来的研究需要评估LLMs在更复杂的多跳网络环境中的应用能力。这包括处理更复杂的拓扑结构、防御机制和威胁行为。

11.2 敏感提示的处理

LLMs对敏感提示的处理能力直接影响其在网络安全中的应用效果。未来的研究需要开发更精细的提示工程技术,以提高LLMs在处理敏感信息时的准确性和安全性。

11.3 自动化代理的进一步发展

当前的自动化代理在决策过程中仍存在一定的局限性。未来的研究需要进一步开发更智能的状态管理技术和决策算法,以提高代理的自主性和适应性。

11.4 LLMs在网络安全教育中的应用

LLMs可以用于网络安全教育和培训,帮助新手快速掌握安全知识和技能。未来的研究可以探索如何利用LLMs设计有效的网络安全教育工具和课程。

十二、总结

本文通过初步探索和实验验证了LLMs在网络安全威胁测试中的应用潜力。我们发现LLMs能够自动化决策过程,提供高质量的响应,并在一定程度上提升防御系统的能力。然而,我们也意识到LLMs技术的滥用风险和对未来网络安全威胁格局的潜在影响。未来的研究需要进一步探讨LLMs在更复杂网络环境中的应用能力,以及如何负责任地使用这些技术来增强网络安全。

通过本文的研究,我们希望能够激发更多关于LLMs在网络安全中应用的讨论和研究,推动该领域的发展,并为未来的网络安全防护提供新的思路和方法。

如何学习大模型

现在社会上大模型越来越普及了,已经有很多人都想往这里面扎,但是却找不到适合的方法去学习。

作为一名资深码农,初入大模型时也吃了很多亏,踩了无数坑。现在我想把我的经验和知识分享给你们,帮助你们学习AI大模型,能够解决你们学习中的困难。

我已将重要的AI大模型资料包括市面上AI大模型各大白皮书、AGI大模型系统学习路线、AI大模型视频教程、实战学习,等录播视频免费分享出来,需要的小伙伴可以扫取。

一、AGI大模型系统学习路线

很多人学习大模型的时候没有方向,东学一点西学一点,像只无头苍蝇乱撞,我下面分享的这个学习路线希望能够帮助到你们学习AI大模型。

二、AI大模型视频教程

三、AI大模型各大学习书籍

四、AI大模型各大场景实战案例

五、结束语

学习AI大模型是当前科技发展的趋势,它不仅能够为我们提供更多的机会和挑战,还能够让我们更好地理解和应用人工智能技术。通过学习AI大模型,我们可以深入了解深度学习、神经网络等核心概念,并将其应用于自然语言处理、计算机视觉、语音识别等领域。同时,掌握AI大模型还能够为我们的职业发展增添竞争力,成为未来技术领域的领导者。

再者,学习AI大模型也能为我们自己创造更多的价值,提供更多的岗位以及副业创收,让自己的生活更上一层楼。

因此,学习AI大模型是一项有前景且值得投入的时间和精力的重要选择。