8月6日,我们发布并开源了CogVideoX-2B模型,受到广大开发者的欢迎。

为了促进社区的自主使用和开放式创新,我们现决定将参数规模更大、性能更强的产品级模型 CogVideoX-5B 开源,同时 CogVideoX-2B 的开源协议调整为更加开放的Apache 2.0协议。

CogVideoX-2B 升级

自8月6日发布以来,CogVideoX-2B 在推理设备门槛上已有显著优化:

-

支持多种推理精度,包括 FP16、BF16、FP32、INT8 等;

-

在 INT8 精度下,推理显存需求仅为 7.8GB,即使用 1080 Ti 显卡也可以完成推理;

-

在 FP16/BF16 精度,Step=50 的设定下,单卡 A100 仅需 90 秒完成推理,单卡 H100 仅需 45 秒;

-

LoRA 微调显存需求为 47GB,SFT 微调为 62GB,单卡 A100(80GB)即可满足微调需求。

CogVideoX-5B 开源

CogVideoX-5B 模型相较于 CogVideoX-2B 拥有更高的视频生成质量,并在工程优化上保持了一致的高标准:

-

同样支持多种推理精度;

-

推理显存需求最低仅为 11.4GB,即单张 3060 显卡即可完成推理;

-

LoRA 微调显存需求为 63GB,SFT 微调为 75GB,单卡 A100(80GB)同样可以完成微调任务。

为进一步支持开源社区的广泛使用与开发,我们已将 CogVideoX-2B 的协议调整为 Apache 2.0,任何企业与个人均可自由使用。

同时,我们推出了在线体验,并将其源代码开源,涵盖了插帧、超分辨率等先进功能,均采用开源技术方案,实现全流程开源。

**代码仓库:**https://github.com/THUDM/CogVideo

**模型论文:**https://arxiv.org/abs/2408.06072

模型下载:

-

Huggingface:https://huggingface.co/THUDM/CogVideoX-5b

在线体验:

-

Huggingface:https://huggingface.co/spaces/THUDM/CogVideoX-5B-Space

-

魔搭社区:https://modelscope.cn/studios/ZhipuAI/CogVideoX-5b-demo

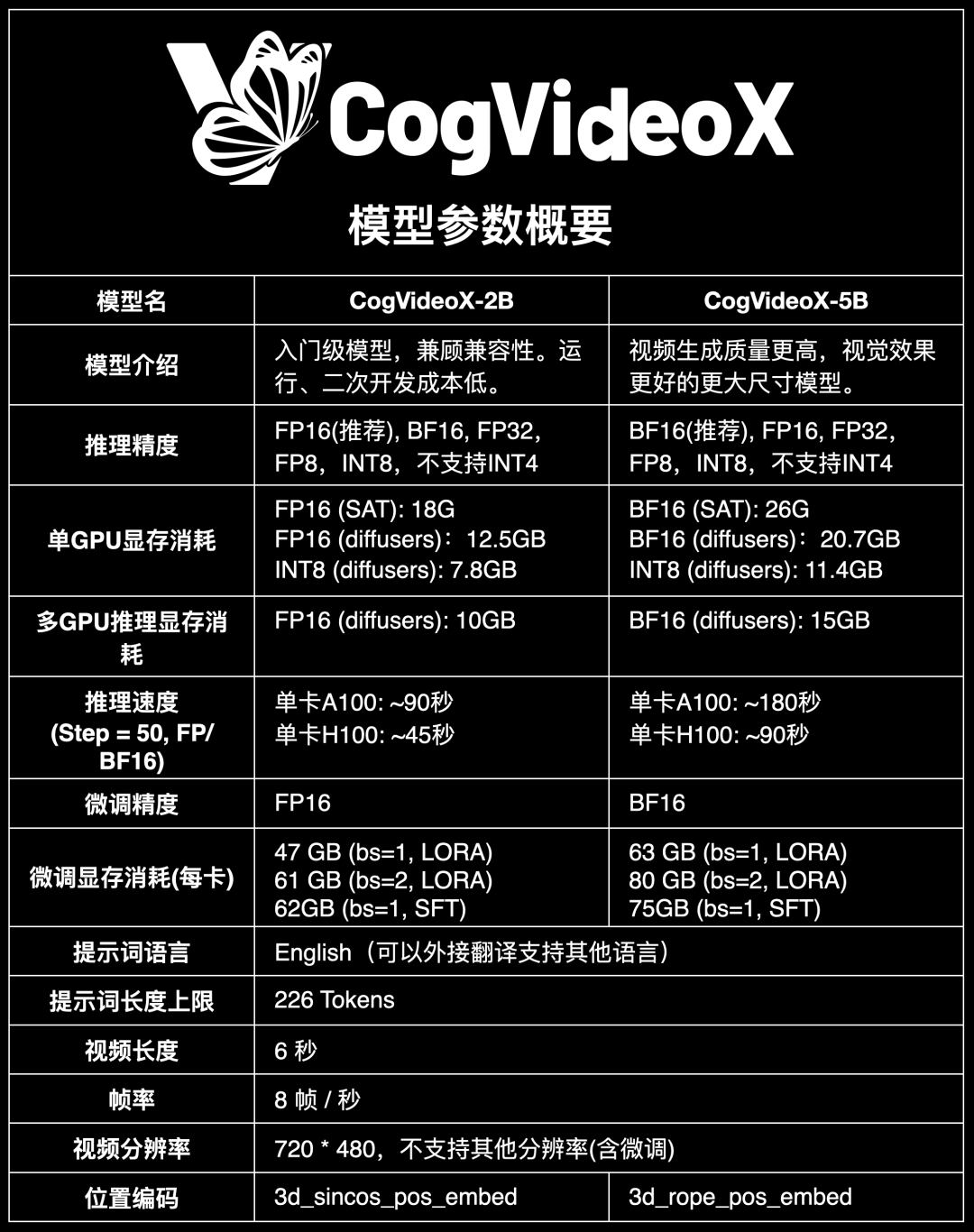

下面为模型参数概要:

Demo

Promt:A lone boy, clad in a rugged oilskin jacket and boots, stands bravely atop a tiny, bobbing boat amidst a tumultuous sea, its waves crashing and foam swirling as a fierce storm rages around him. In the distance, an enormous, fearsome whale emerges, its gargantuan mouth agape, threatening to engulf the boy and his vessel. Undeterred, the boy grips his trusty weapon tightly, a look of fierce determination etched upon his face, and prepares to strike back at the monstrous creature, the salty wind whipping through his hair as he readies for the confrontation.