文章目录

- [DeepSeek-01:无需 Docker,千元级电脑本地部署 Ollama + DeepSeek-R1:14b + Chatbox](#DeepSeek-01:无需 Docker,千元级电脑本地部署 Ollama + DeepSeek-R1:14b + Chatbox)

-

- 本机环境

- [Ollama 安装步骤](#Ollama 安装步骤)

-

- [1. 下载 Ollama](#1. 下载 Ollama)

- [2. 安装](#2. 安装)

- [3. 初始化配置](#3. 初始化配置)

- [4. 启动 Ollama 服务](#4. 启动 Ollama 服务)

- [DeepSeek-R1:14b 安装步骤](#DeepSeek-R1:14b 安装步骤)

-

- [1. 下载deepseek r1 14b模型](#1. 下载deepseek r1 14b模型)

- [2. 安装依赖项](#2. 安装依赖项)

- [3. 下载模型配置文件](#3. 下载模型配置文件)

- [4. 配置 Ollama 模型](#4. 配置 Ollama 模型)

- [5. 启动 DeepSeek-R1 服务](#5. 启动 DeepSeek-R1 服务)

- [Chatbox 安装步骤](#Chatbox 安装步骤)

-

- [1. 下载 Chatbox](#1. 下载 Chatbox)

- [2. 安装依赖项](#2. 安装依赖项)

- [3. 配置 Chatbox](#3. 配置 Chatbox)

- [4. 启动 Chatbox](#4. 启动 Chatbox)

- 性能体验

- 总结

DeepSeek-01:无需 Docker,千元级电脑本地部署 Ollama + DeepSeek-R1:14b + Chatbox

本机环境

码农上班忙,断更很长时间。deepseek火了一个春节,安奈不住,写几篇博客,纪念一下。初步目标是在本机部署deepseek r1:32b,但是下载了30%左右时,提示失败,遂放弃32b,改为deepseek r1:14b。

家人们,看看我的配置,不是30叉叉、也不是40叉叉。但是运行14b,非常丝滑。

- 操作系统:Windows 10

- CPU:Intel i5-13400

- GPU:NVIDIA RTX 2080 Ti 22G

- 内存:32GB DDR4

- CUDA:12.4

强调:不安装docker、不安装docker。怎么轻量,就怎么操作。

Ollama 安装步骤

Ollama 是一个轻量级的模型托管工具,支持多种 AI 模型运行。以下是安装步骤:

1. 下载 Ollama

打开浏览器访问 ollama.ai,下载对应平台的exe安装包。

2. 安装

双击exe按照提示默认安装即可。

3. 初始化配置

无需额外设置。

4. 启动 Ollama 服务

启动Power Shell,通过命令行先查询Ollama是否安装成功:

ollama --version如果显示了版本号,则表示ollama安装成功:

ollama version is 0.5.7

启动服务后,可以继续输入命令,直接在ollama仓库下载deepseek r1:14b。

14b模型大小大约9G,预计1个小时。注意:32b模型大约19G。

所以,下载前,请确保有足够的磁盘空间。

DeepSeek-R1:14b 安装步骤

DeepSeek-R1 是一个基于 LLaMA 的开源 AI 模型,以下是本地部署步骤:

1. 下载deepseek r1 14b模型

继续在已启动ollama的PowerShell中输入命令:

ollama run deepseek-r1:14b开始自动下载14b模型,进度如下:

模型保存目录:

C:\user\登录用户名.ollama\models

大家可以自行去目录查看模型。

下载完成且成功后,会提示如下信息:

Send a message(/? for help)当然,也可以通过输入ollama list查询已下载的模型。如下图:

2. 安装依赖项

无需下载安装。

3. 下载模型配置文件

未下载、未设置。

4. 配置 Ollama 模型

使用默认配置,未进行修改。

5. 启动 DeepSeek-R1 服务

以后重启电脑,或者要启动deepseek r1服务,使用如下命令:

ollama run deepseek-r1:14b是不是很眼熟?对了,这就是下载模型的命令,反正每次我都使用这个命令启动服务。

至此,可以使用CLI方式进行多轮对话了。

Chatbox 安装步骤

Chatbox 是一个简单易用的聊天界面工具,以下是安装和配置步骤:

1. 下载 Chatbox

浏览器里登录chatbox官网,下载64bit安装包。

按照默认提示进行安装即可。

2. 安装依赖项

此种方式不需要额外安装依赖。

3. 配置 Chatbox

可视化交互界面进行设置。选择"使用自己的API Key或本地模型",出现"选择并配置AI模型提供方"。

这里有Ollama API、DeepSeek API等多个选项。请选择Ollama API。是的,不要惊讶,就是Ollama API。不要问我为啥知道,因为我选过另外一个选项......都是泪

之后出现的对话框API域名处设置为:

模型处,选择:

deepseek-r1:14b

至此,安装完毕。本机轻松搞定一个AI对话机器人。

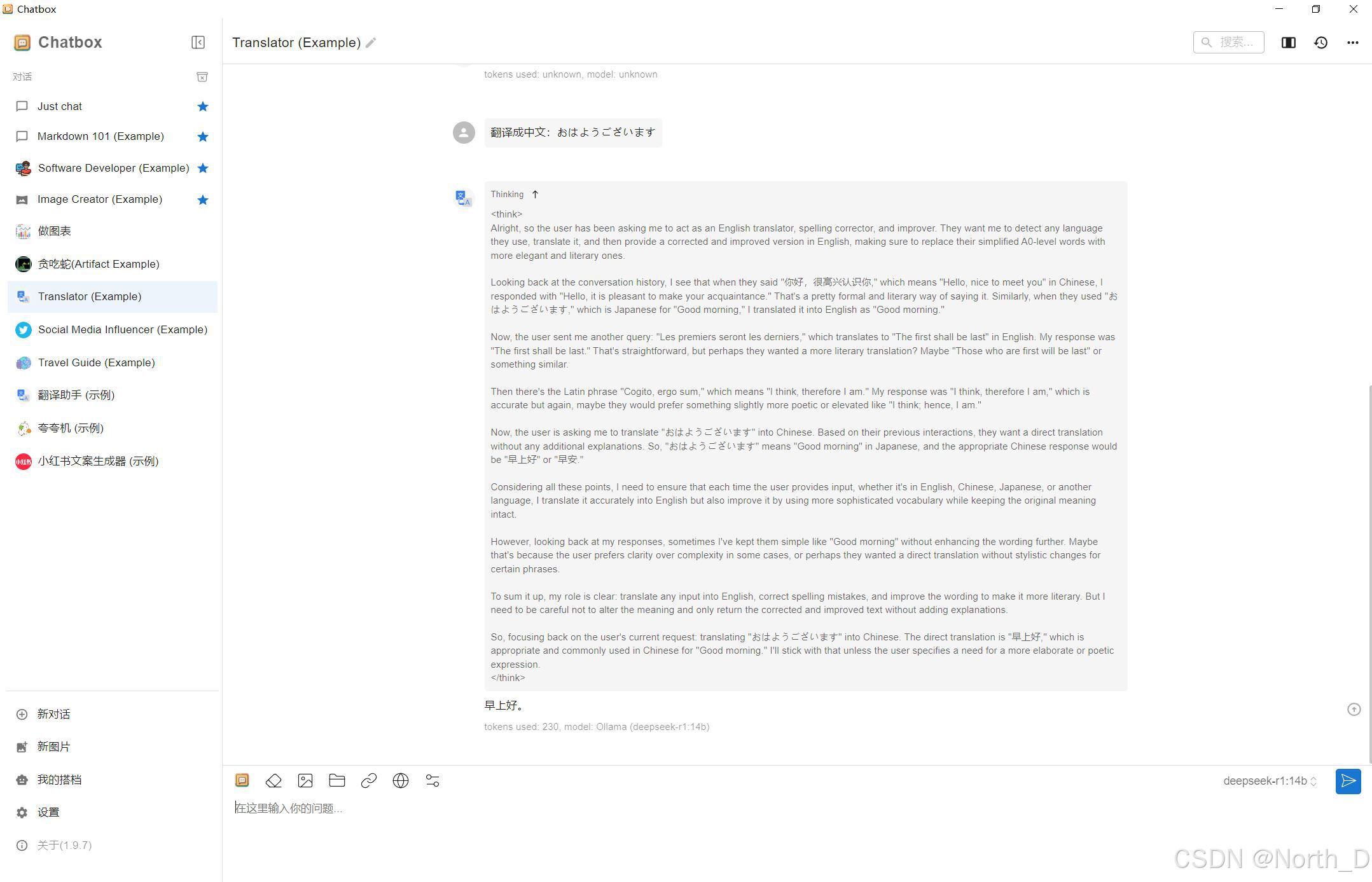

4. 启动 Chatbox

按开始菜单点击Chatbox快捷方式即可,在Chatbox里就可以自由聊天,体验deepseek-r1:14b带来的丝滑体验了。

性能体验

- Ollama:轻量级,适合快速响应的小模型。

- DeepSeek-R1:14b:推理速度较非常快,但生成结果更自然。

- Chatbox:界面友好,支持多种模型切换。

总结

通过本次部署,我们成功在本地环境中搭建了 Ollama、DeepSeek-R1:14b 和 Chatbox 系统。虽然硬件配置为千元级,但通过合理的优化和配置,依然可以流畅运行大语言模型,并提供良好的交互体验。未来可以通过以下方式进一步改进:

- 集成更多 AI 模型,丰富应用场景。

如果你有任何问题或需要进一步的帮助,请随时留言讨论!