一、为什么需要卷积

若参数过多,则内存装不下

比如图像大小1000*1000,那么输入层神经元的数目就是10的6次方,全连接层的参数就是10的12次方,一层就是1万亿个参数。

二、卷积是怎么做的

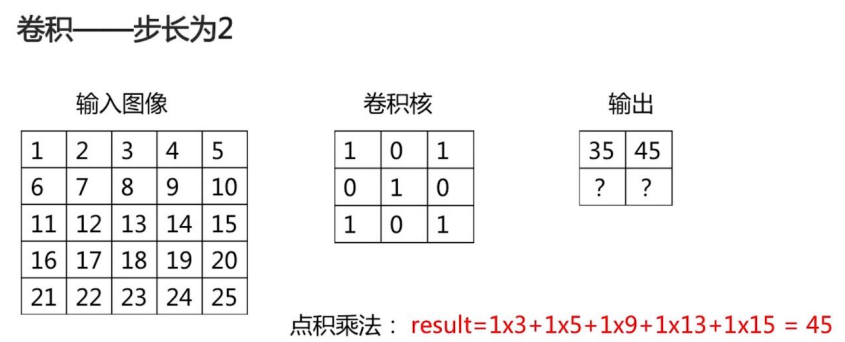

把卷积核的每一个参数和图像中的位置进行相乘再求和得到输出。

图像具有区域性,这个连接就叫局部连接,这也是卷积的特点和优势,经过一层卷积之后提取了图像的高层特征。同时卷积时有参数共享的特性,图片具有位置不变性,比如汽车翻车照样可以识别,图像特征与位置无关,左边是脸右边也是脸。

步长变大,输出变小。

如果使用了padding,在最外面一圈加0,那么假设步长为1,那么输出的size不变。加几圈的padding和卷积核大小有关,如果是5*5那么就要加两圈: