HBase作为Apache顶级项目,凭借其高效的分布式存储和检索能力,在大数据领域广泛应用。然而,随着业务需求的复杂化,单纯的数据存储功能已无法满足所有场景。此时,HBase协处理器(Coprocessor)便成为了一个关键的扩展工具。本文将深入探讨协处理器的原理、实现方法、应用场景及注意事项,帮助开发者高效利用这一特性。

1.协处理器的核心价值

1.1 为什么需要协处理器?

HBase的设计目标是提供高性能的存储与快速读写能力,但其本身并不支持复杂的计算逻辑。协处理器的出现填补了这一空白,允许用户在数据存储节点(RegionServer)直接执行自定义逻辑,从而:

-

减少网络开销:计算在数据存储端完成,避免将海量数据传输到客户端。

-

提升效率:利用分布式节点并行处理,加速聚合操作(如统计、过滤)。

-

增强功能:支持触发器、自定义索引、实时审计等高级功能。

1.2 协处理器的两大类型

协处理器分为 Observer 和 Endpoint 两类,分别用于不同的场景:

| 类型 | 用途 | 触发方式 |

|---|---|---|

| Endpoint | 允许客户端直接调用RegionServer上的自定义计算逻辑,返回结果 | 客户端显式调用 |

| Observer | 在特定事件发生时执行逻辑(如插入、删除数据前后的操作) | 事件驱动(如prePut、postDelete) |

2.Observer协处理器详解

2.1 工作原理

Observer通过继承RegionObserver或TableObserver接口,覆盖特定事件钩子(Hook)方法。这些钩子在HBase执行操作时被触发,允许用户插入自定义逻辑。 常见Hook方法:

| 方法名称 | 触发时机 | 典型用途 |

|---|---|---|

| prePut | 数据插入前 | 权限验证、数据校验 |

| postPut | 数据插入后 | 操作日志记录 |

| preDelete | 数据删除前 | 权限检查、数据备份 |

| postDelete | 数据删除后 | 清理关联索引 |

| preGet | 数据查询前 | 加密解密、动态过滤 |

2.2 实现步骤与示例

示例:记录数据插入日志

public class AuditObserver extends BaseRegionObserver {

@Override

public void prePut(ObserverContext<RegionCoprocessorEnvironment> c, Put put, WALEdit edit, Durability durability) throws IOException {

// 记录操作日志

LOG.info("Inserting data into table: " + put.getRow());

// 执行其他验证逻辑

}

}配置步骤:

-

编译打包:将Observer类编译为JAR包。

-

部署到集群:将JAR上传至HBase的lib目录或HDFS。

-

配置表级加载:

hbase> ALTER 'my_table', METHOD => 'table_att', CONFIGURATION => {'coprocessor'=>'hdfs://path/to/audit-observer.jar|com.example.AuditObserver|1'

1 表示加载顺序(多个协处理器时使用)

3.Endpoint协处理器详解

3.1 工作原理

Endpoint通过定义RPC接口,在RegionServer端暴露自定义服务。客户端可通过HBase的CoprocessorRpcChannel调用这些接口。 实现步骤:

-

定义接口:继承CoprocessorService接口。

-

实现逻辑:编写接口的具体实现类。

-

注册服务:在协处理器初始化时注册该服务。 示例:计算某一列的总和

// 接口定义

@InterfaceAudience.Public

@InterfaceStability.Evolving

public interface SumService extends CoprocessorService {

rpc void computeSum(ColumnName column, returns SumResult);

}// 实现类

public class SumEndpoint extends SumService implements Coprocessor {

@Override

public void start(CoprocessorEnvironment env) {

// 注册服务

env.getRpcServices().addService(SumService.newReflectiveService(this));

}@Override public void computeSum(ColumnName column, rpc controller) { // 扫描当前Region中的数据,计算指定列的总和 // 返回结果 }}

客户端调用:

Table table = connection.getTable(TableName.valueOf("my_table"));

List<RegionLocation> regions = table.getRegionLocations();

for (RegionLocation region : regions) {

CoprocessorRpcChannel channel = table.coprocessorService(region.getRegionInfo().getRegionName());

SumService.BlockingInterface service = SumService.newBlockingStub(channel);

SumResult result = service.computeSum(controller, column);

// 聚合结果

}4.协处理器的配置与部署

4.1 配置方式

协处理器可通过以下方式加载:

-

表级配置(推荐):

ALTER 'table_name', 'coprocessor'=>'hdfs://path/to/coprocessor.jar|ClassName|priority'

-

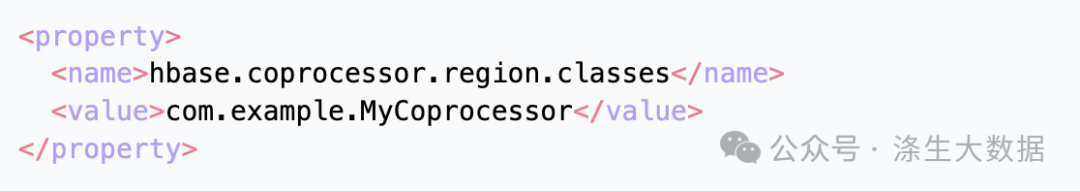

集群级配置:修改hbase-site.xml,添加:

-

动态加载:通过HBase Shell命令实时添加协处理器(需重启RegionServer生效)。

4.2 注意事项

-

版本兼容性:协处理器需与HBase版本严格匹配。

-

JAR包依赖:确保协处理器依赖的JAR已部署到所有RegionServer节点。

-

权限控制:敏感操作需通过HBase的访问控制(如ACL)限制权限。

5.典型应用场景

5.1 实时审计与监控

通过Observer在postPut或postDelete钩子中记录操作日志,实现数据变更的实时监控。

5.2 跨Region聚合

Endpoint协处理器可并行计算每个Region的数据,再由客户端汇总结果,例如统计全表某列的总和。

5.3 自定义索引

在prePut钩子中维护自定义索引(如全文索引),并在查询时通过Endpoint加速检索。

5.4 权限验证

在preGet或prePut钩子中实现细粒度权限控制,避免直接依赖HBase内置的ACL。

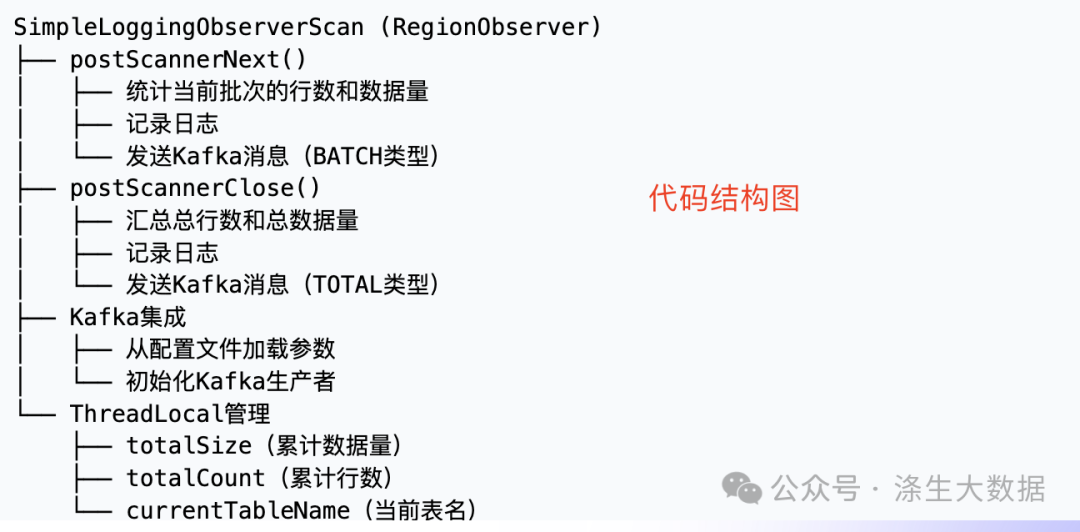

6.最佳实践案例统计scan 的大小

6.1 功能介绍

具体是一个 RegionObserver 类型的协处理器,用于在HBase的 Scan操作 过程中实时收集扫描性能数据,并通过 Kafka 将统计信息发送到外部系统。

6.2 核心代码实现

package com.ds;

import com.ds.kafkatools.KafkaConfig;

import com.ds.kafkatools.KafkaMessage;

import com.ds.kafkatools.KafkaProducerUtil;

import org.apache.hadoop.hbase.CellUtil;

import org.apache.hadoop.hbase.TableName;

import org.apache.hadoop.hbase.client.*;

import org.apache.hadoop.hbase.coprocessor.ObserverContext;

import org.apache.hadoop.hbase.coprocessor.RegionCoprocessor;

import org.apache.hadoop.hbase.coprocessor.RegionCoprocessorEnvironment;

import org.apache.hadoop.hbase.coprocessor.RegionObserver;

import org.apache.hadoop.hbase.regionserver.InternalScanner;

import org.apache.hadoop.hbase.regionserver.Region;

import org.slf4j.Logger;

import org.slf4j.LoggerFactory;

import java.io.IOException;

import java.io.InputStream;

import java.time.Instant;

import java.util.List;

import java.util.Optional;

import java.util.Properties;

import static com.ds.kafkatools.LogFlag.Flag.BATCH;

import static com.ds.kafkatools.LogFlag.Flag.TOTAL;

public class SimpleLoggingObserverScan implements RegionObserver, RegionCoprocessor {

private static final Logger LOG = LoggerFactory.getLogger(SimpleLoggingObserverScan.class);

// 使用ThreadLocal保存每个线程的统计信息

private static final ThreadLocal<Long> totalSize = new ThreadLocal<>();

private static final ThreadLocal<Long> totalCount = new ThreadLocal<>();

private static final ThreadLocal<String> currentTableName = new ThreadLocal<>();

// Kafka 配置(从配置文件加载)

private static final KafkaProducerUtil kafkaProducer = initKafkaProducer();

// 初始化 Kafka 生产者

private static KafkaProducerUtil initKafkaProducer() {

try {

Properties props = loadKafkaConfig();

//初始化 kafka 配置

KafkaConfig config = new KafkaConfig(

props.getProperty("kafka.bootstrap.servers"),

props.getProperty("kafka.topic"),

props.getProperty("kafka.acks"),

props.getProperty("kafka.retries"),

props.getProperty("kafka.compression.type"),

props.getProperty("kafka.linger.ms")

);

return KafkaProducerUtil.getInstance(config);

} catch (Exception e) {

LOG.error("Failed to initialize Kafka producer", e);

return null;

}

}

// 从 classpath 加载配置文件

private static Properties loadKafkaConfig() throws Exception {

Properties props = new Properties();

try (InputStream input = SimpleLoggingObserverScan.class.getClassLoader()

.getResourceAsStream("META-INF/conf.properties")) {

if (input == null) {

throw new IllegalStateException("conf.properties not found!");

}

props.load(input);

}

return props;

}

@Override

public boolean postScannerNext(ObserverContext<RegionCoprocessorEnvironment> c, InternalScanner s, List<Result> results, int limit, boolean hasNext) throws IOException {

// 获取当前表名

RegionCoprocessorEnvironment env = c.getEnvironment();

Region region = env.getRegion();

RegionInfo regionInfo = region.getRegionInfo();

TableName tableName = regionInfo.getTable();

String tableNameStr = tableName.getNameAsString();

currentTableName.set(tableNameStr); // 记录表名到ThreadLocal

// 初始化线程变量(如果未初始化)

if (totalSize.get() == null) {

totalSize.set(0L);

}

if (totalCount.get() == null) {

totalCount.set(0L);

}

// 统计当前批次信息

long currentBatchCount = results.size();

long batchSizeBytes = results.stream()

.flatMap(result -> result.listCells().stream())

.mapToLong(cell -> CellUtil.estimatedSerializedSizeOf(cell))

.sum();

// 累加统计值

totalSize.set(totalSize.get() + batchSizeBytes);

totalCount.set(totalCount.get() + currentBatchCount);

// 获取当前时间戳

long timestamp = System.currentTimeMillis();

String isoTime = Instant.ofEpochMilli(timestamp).toString();

// 1.输出日志

LOG.info("表名:{},当前批次扫描条数: {} row(s),大小: {} Bytes, 时间:{}",

tableName, currentBatchCount, batchSizeBytes,isoTime);

// 2.输出日志到 kafka

if (kafkaProducer != null) {

KafkaMessage message = new KafkaMessage(tableNameStr, currentBatchCount, batchSizeBytes, BATCH.getName(),timestamp);

kafkaProducer.sendMessage(message);

}

return hasNext;

}

@Override

public void postScannerClose(ObserverContext<RegionCoprocessorEnvironment> c, InternalScanner scanner) throws IOException {

// 获取统计信息和表名

String tableName = currentTableName.get();

Long totalRows = totalCount.get();

Long totalBytes = totalSize.get();

// 获取当前时间戳

long timestamp = System.currentTimeMillis();

String isoTime = Instant.ofEpochMilli(timestamp).toString();

if (totalBytes != null && totalRows != null && tableName != null) {

LOG.info("表名:{},总条数: {} rows,Scan总结果大小: {} Bytes, 时间:{}",

tableName, totalRows, totalBytes,isoTime);

}

if (kafkaProducer != null) {

KafkaMessage message = new KafkaMessage(tableName, totalRows, totalBytes,TOTAL.getName(),timestamp);

kafkaProducer.sendMessage(message);

}

// 清理ThreadLocal数据

totalSize.remove();

totalCount.remove();

currentTableName.remove();

}

@Override

public Optional<RegionObserver> getRegionObserver() {

return Optional.of(this);

}

}

6.3 部署使用

# 将JAR上传到HBase节点的lib目录或HDFS

hdfs dfs -put ds_hbase_coprocessor-1.0-SNAPSHOT-jar-with-dependencies.jar /tmp/test4/

# 为特定表启用协处理器

hbase shell

hbase> alter 'my_table', METHOD => 'table_att', 'coprocessor' => 'hdfs:///tmp/test4/ds_hbase_coprocessor-1.0-SNAPSHOT-jar-with-dependencies.jar|com.ds.SimpleLoggingObserverScan|1001'6.4 效果展示

regionserver 日志中打印的内容

2025-04-07 16:05:38,924 INFO com.ds.SimpleLoggingObserverScan: 表名:my_table,当前批次扫描条数: 100 row(s),大小: 4501 Bytes, 时间:2025-04-07T08:05:38.924Z

2025-04-07 16:05:38,929 INFO com.ds.SimpleLoggingObserverScan: 表名:my_table,总条数: 100 rows,Scan总结果大小: 4501 Bytes, 时间:2025-04-07T08:05:38.929Zkafka 中的数据内容

{"tableName":"my_table","scanrows":100,"scanSizeBytes":4501,"scanflag":"batch_scan","timestamp":1744013138952}

{"tableName":"my_table","scanrows":100,"scanSizeBytes":4501,"scanflag":"total_scan","timestamp":1744013138957}后续就可以基于这个数据做一些监控和问题的排查。

7.总结

HBase协处理器通过灵活的扩展机制,显著提升了系统的功能与性能。开发者可通过Observer实现事件驱动的逻辑增强,通过Endpoint实现分布式计算,从而应对复杂业务场景。然而,协处理器的使用需谨慎设计,避免因不当实现导致性能下降或系统不稳定。掌握其原理与最佳实践,将成为高效利用HBase的关键技能。

为什么选择涤生大数据?

-

1.跟随行业专家学习:我们的导师不是传统的讲师,而是实际的行业专家。他们都是来自国内一线大厂的资深开发,大数据技术专家等。

-

2.跟企业在职开发一起学习:涤生的社招学员目前60%+是企业在职进阶学员,基本各大厂的都有,他们的薪资从10k,15k,20k,25k,30k,35k,40k。所以你会跟很多企业在职人员一起交流学习。

-

3.定制化课程设计:结合每位学员的进行定制化教学,学习规划,让你的学习更有重点;结合每个学员的时间规划学习进度,督促考核,让学习变得更加灵活。

-

4.专业教学和平台:术业有专攻,企业怎么用,面试怎么面,我们就怎么学,涤生让大数据学习不迷惘。目前涤生采购7台服务器,自研提供一站式大数据平台供学习使用,拒绝虚拟机。

-

5.专业的简历面试辅导:涤生内部所有同学简历面试辅导都包含在内,从学习到入职试用期全流程提供保障服务。2024年截止当前涤生到简历面试7级群的学员就业率98%+,2024年上岸200+同学,60+入职一线中大厂。当然也有不少培训找不到工作的同学,以及裁员的同学,空窗期太久,最终跟着我们搞顺利上岸。

-

6.不错的口碑:在涤生这,只要你不摆烂,我们不抛弃不放弃,校招上岸率几乎100%。目前涤生的学员大概有25%是老学员推荐和转化。

-

7.专业化校招团队辅导和丰富的校招题库:涤生大数据校招25秋招学员是第5届校招学员,有丰富的校招专项辅导经验和知识题沉淀,目前题库包含了主流一线中大厂。其次校招辅导除社招老师之外,还有四个专项校招辅导老师,他们来自字节,美团快手等公司985/211硕士;

上岸同学分享