深度剖析 GpuGeek 实例:GpuGeek/Qwen3-32B 模型 API 调用实践与性能测试洞察

前言

GpuGeek专注于人工智能与高性能计算领域的云计算平台,致力于为开发者、科研机构及企业提供灵活、高效、低成本的GPU算力资源。平台通过整合全球分布式数据中心资源,结合先进的虚拟化技术和智能调度系统,满足深度学习训练、大规模并行计算、科学模拟等场景的算力需求。

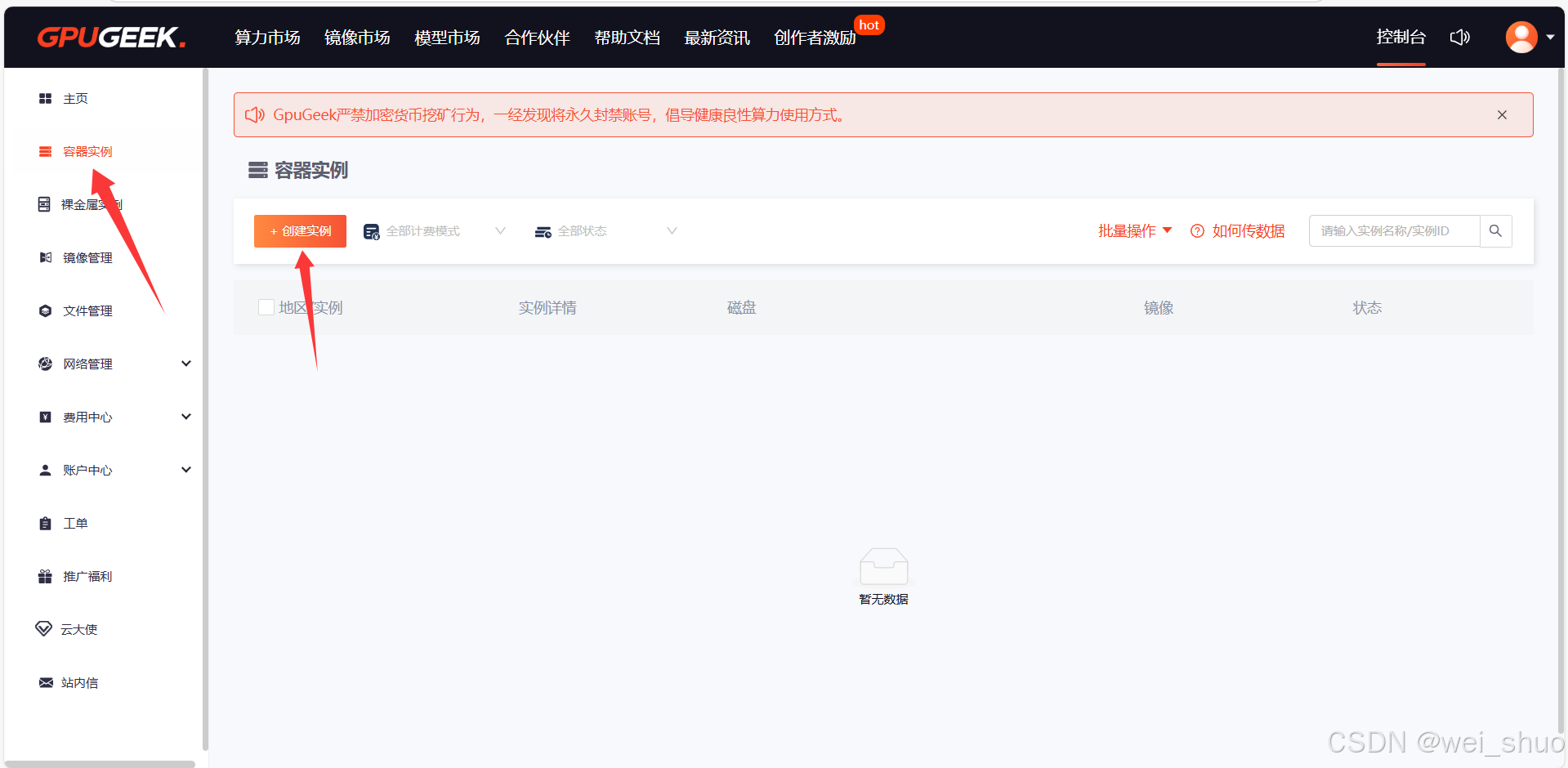

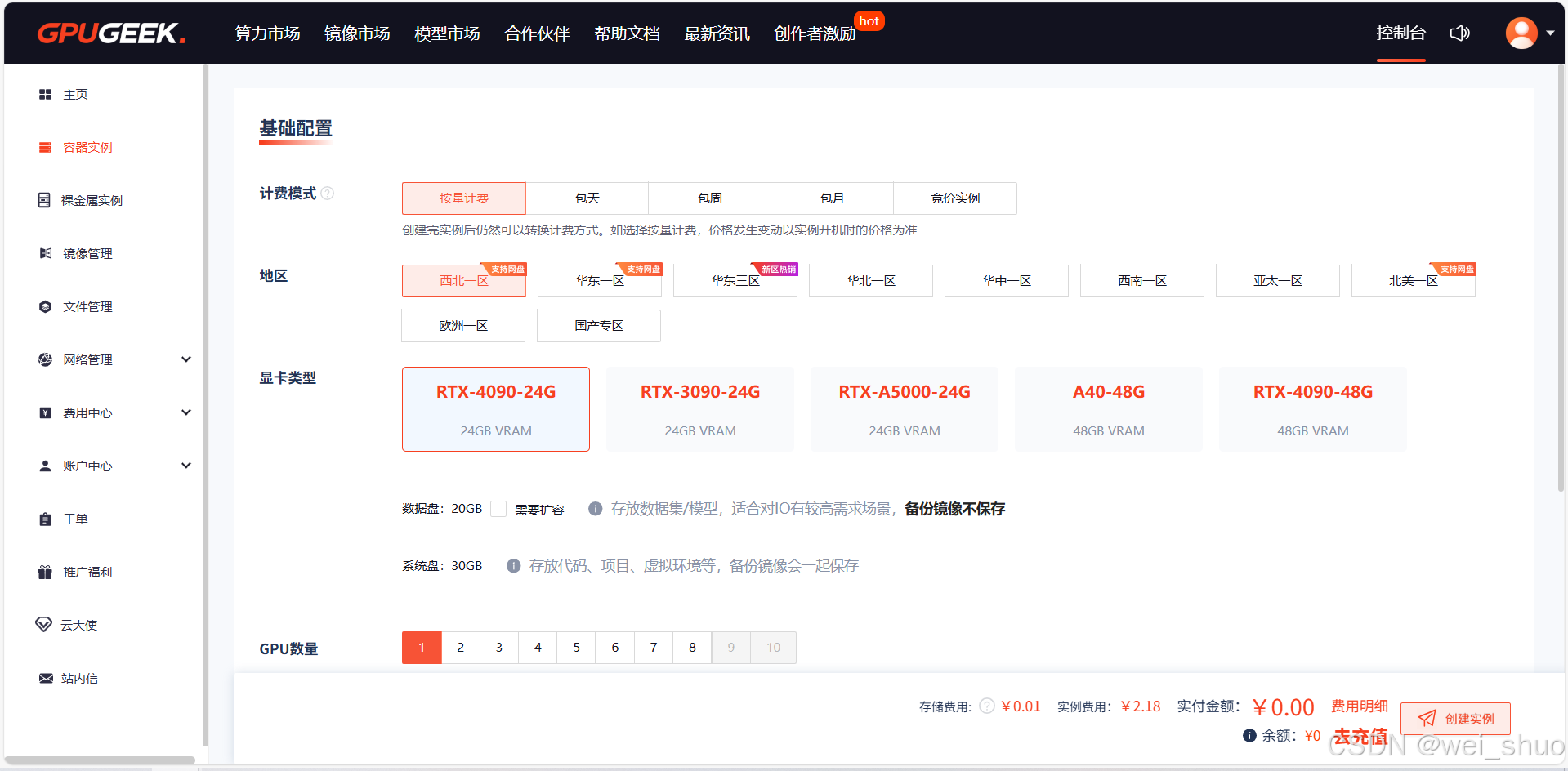

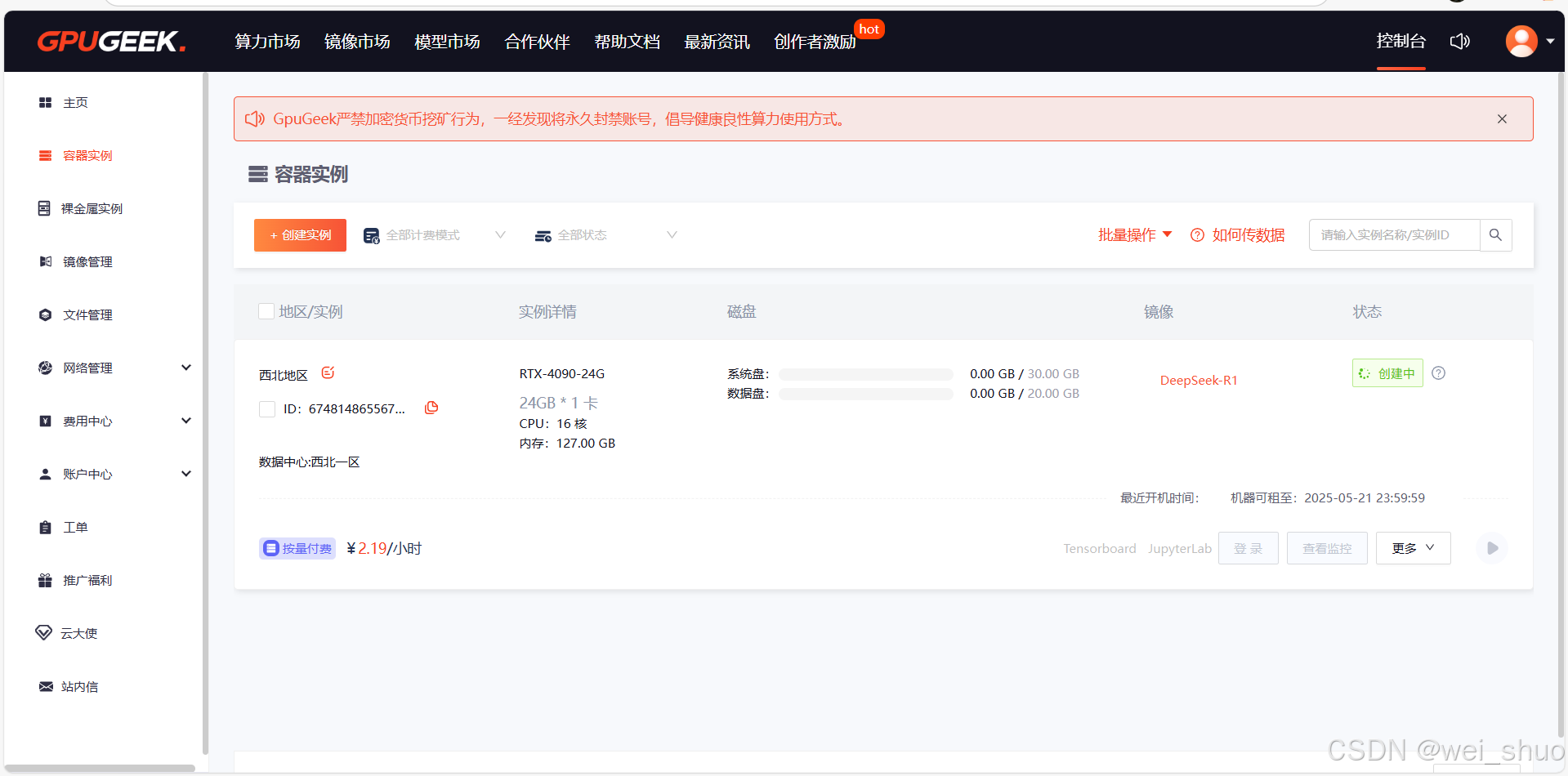

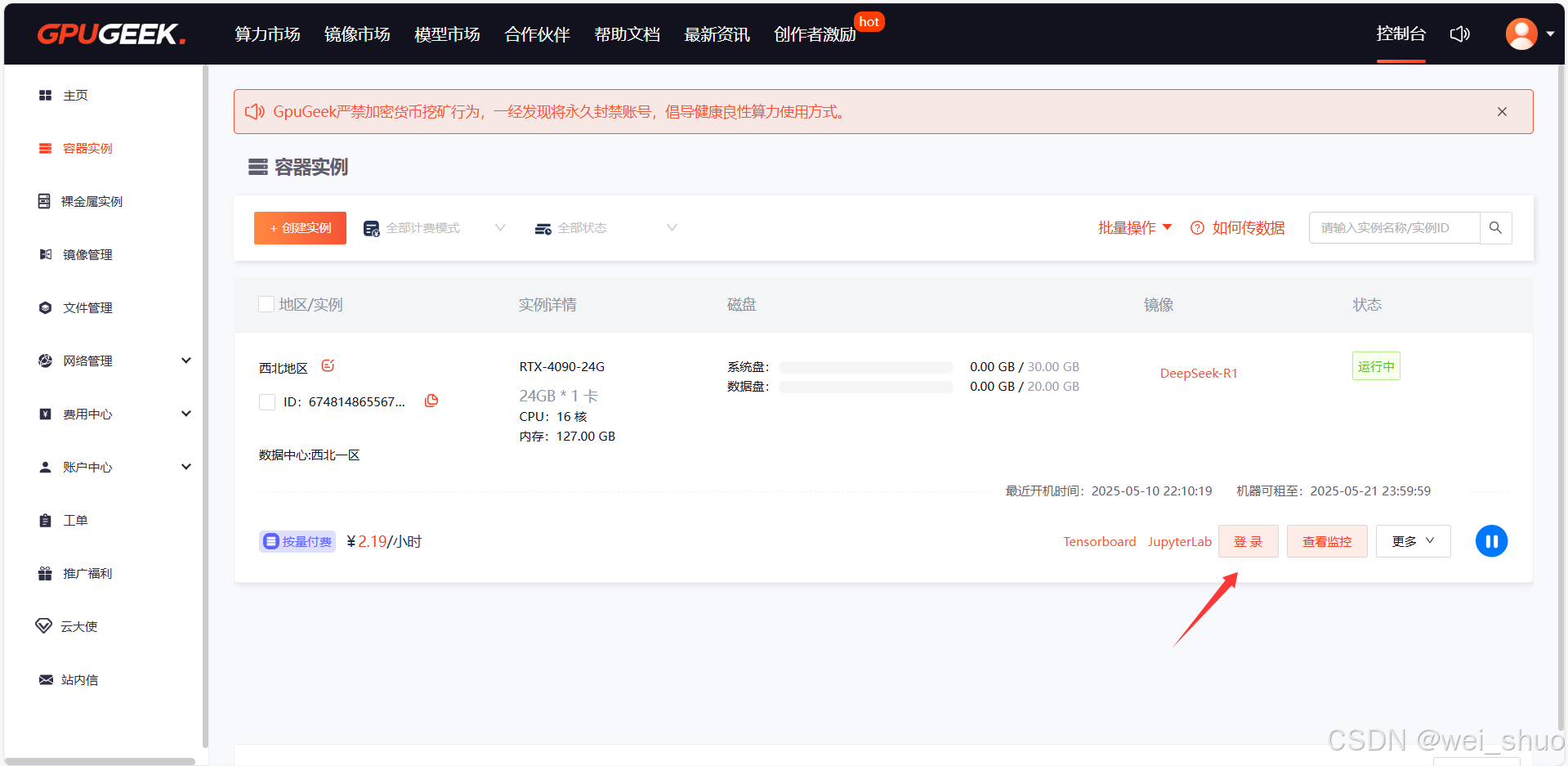

GpuGeek实例创建JupyterLab登录

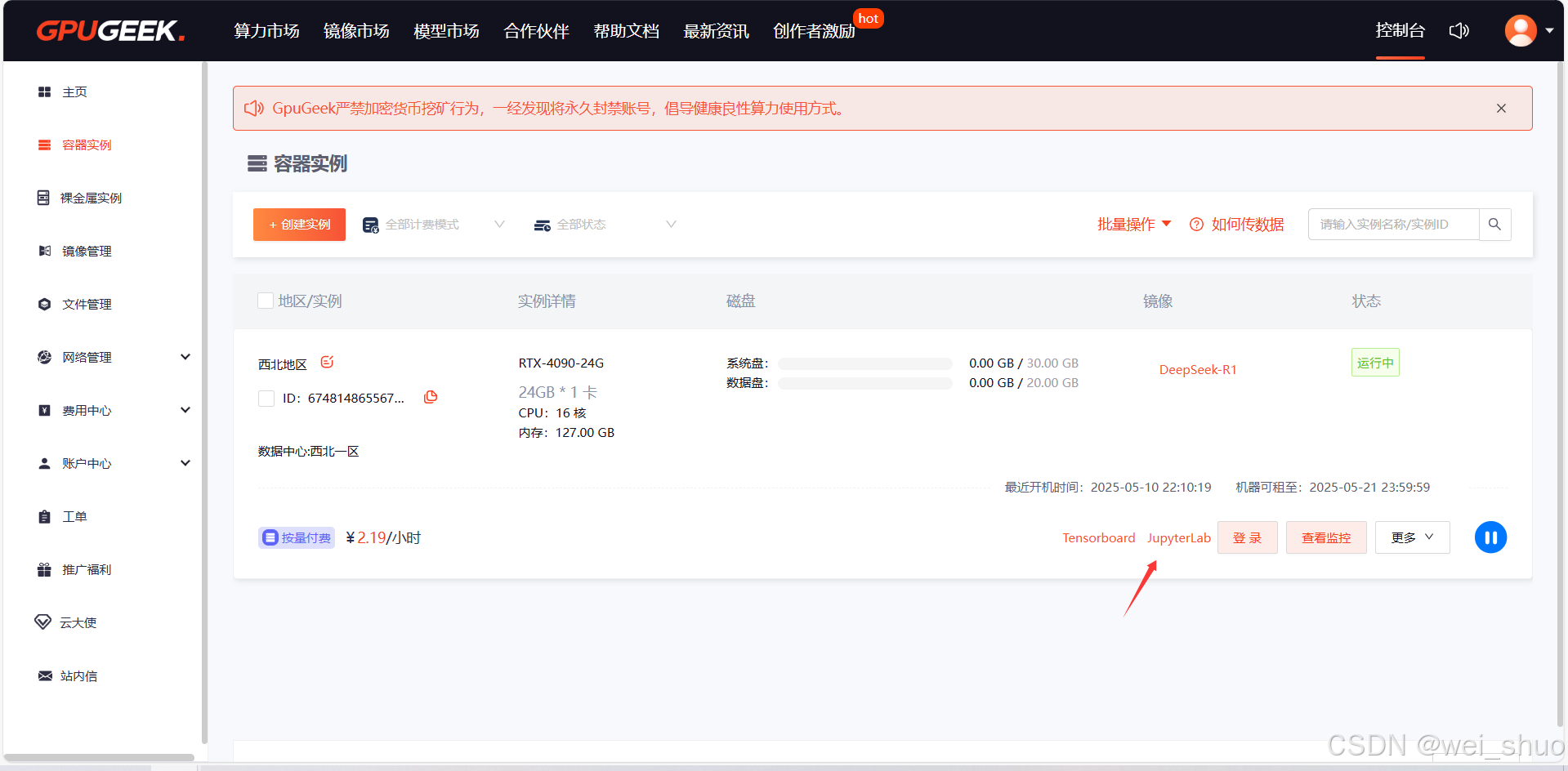

1、创建实例

2、选择配置(建议选择按量计费,新人有福利赠送代金卷所以是不需要费用的)

3、等待实例创建成功(非官方镜像首次加载预计耗时较长,创建过程中不会计费。实例创建完成后,手动关机可不计费)

4、登录实例

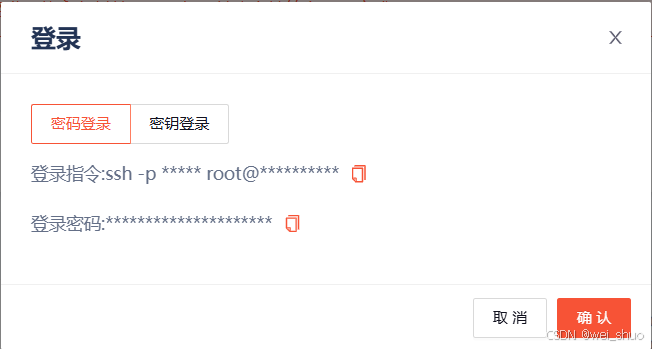

5、复制自己的登录指令和登录密码

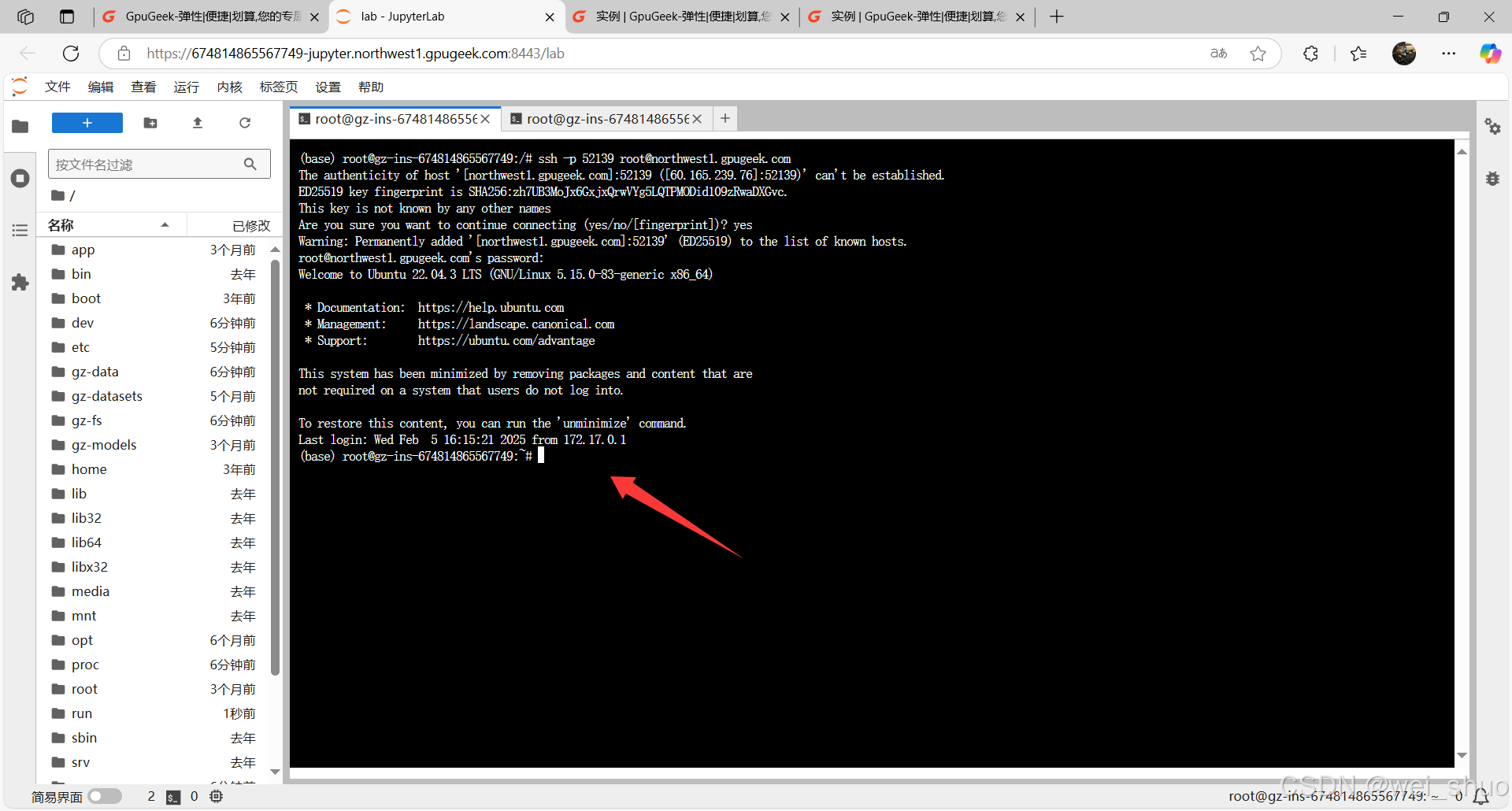

6、JupyterLab登录连接

7、JupyterLab输入登录指令,并且输入登录密码

GpuGeek/Qwen3-32B 模型 JupyterLab 实现API调用

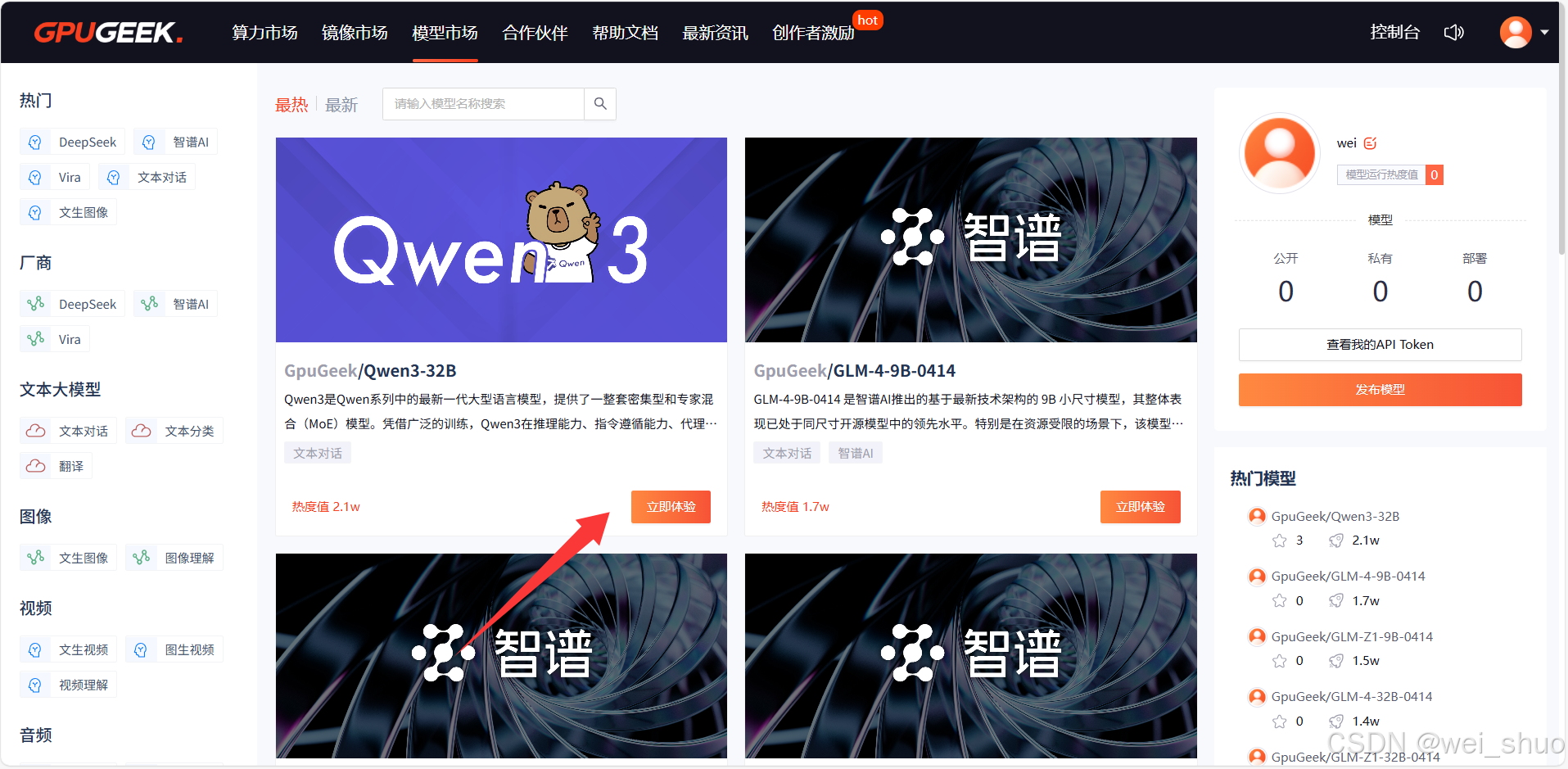

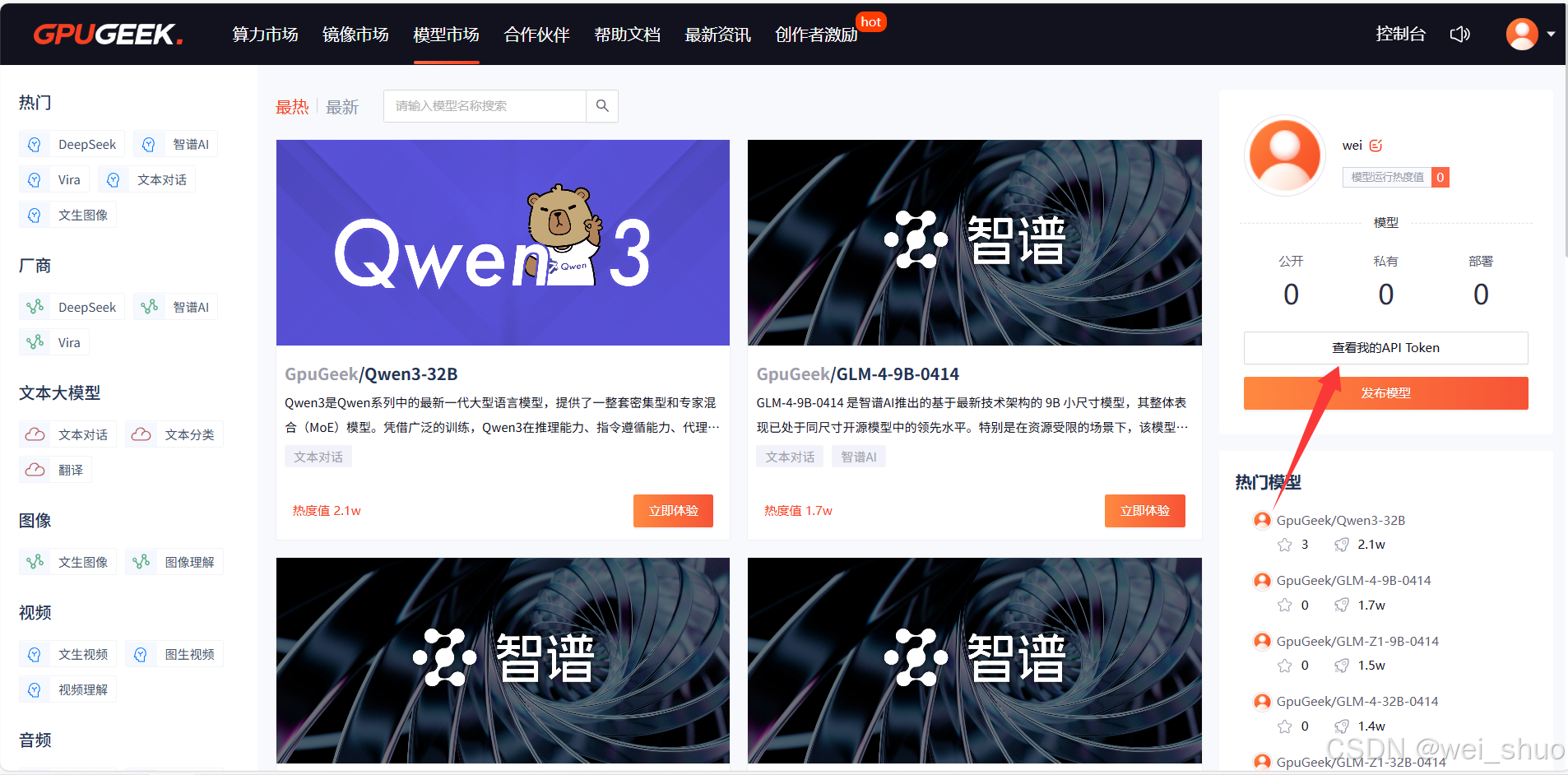

1、GpuGeek/Qwen3-32B 模型选择

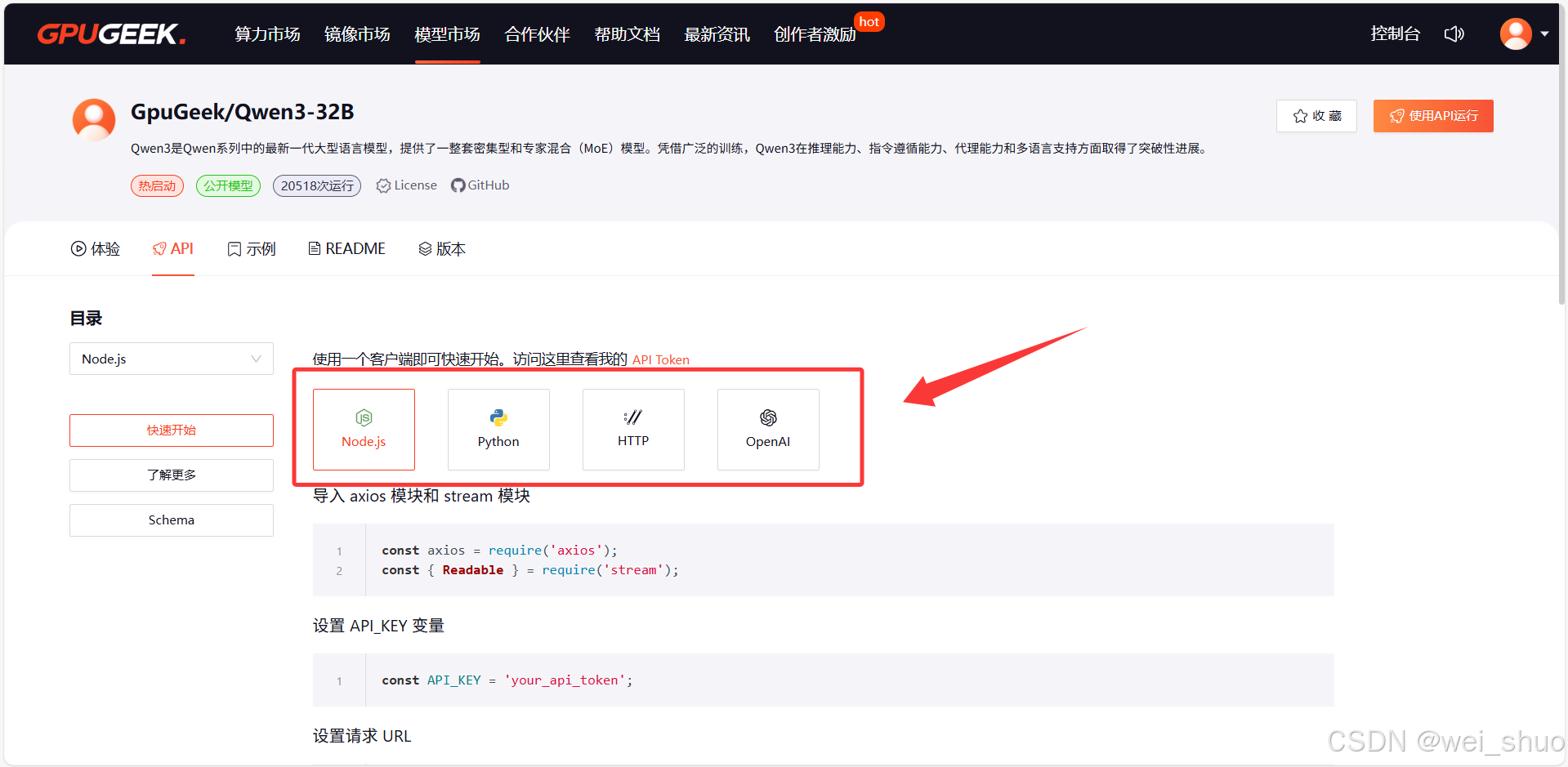

2、查看API调用示例

3、GpuGeek平台提供了GpuGeek/Qwen3-32B的四种调用方式Node.js、Python、HTTP、OpenAI,但是并没有提供示例代码,只是介绍了调用的方法流程

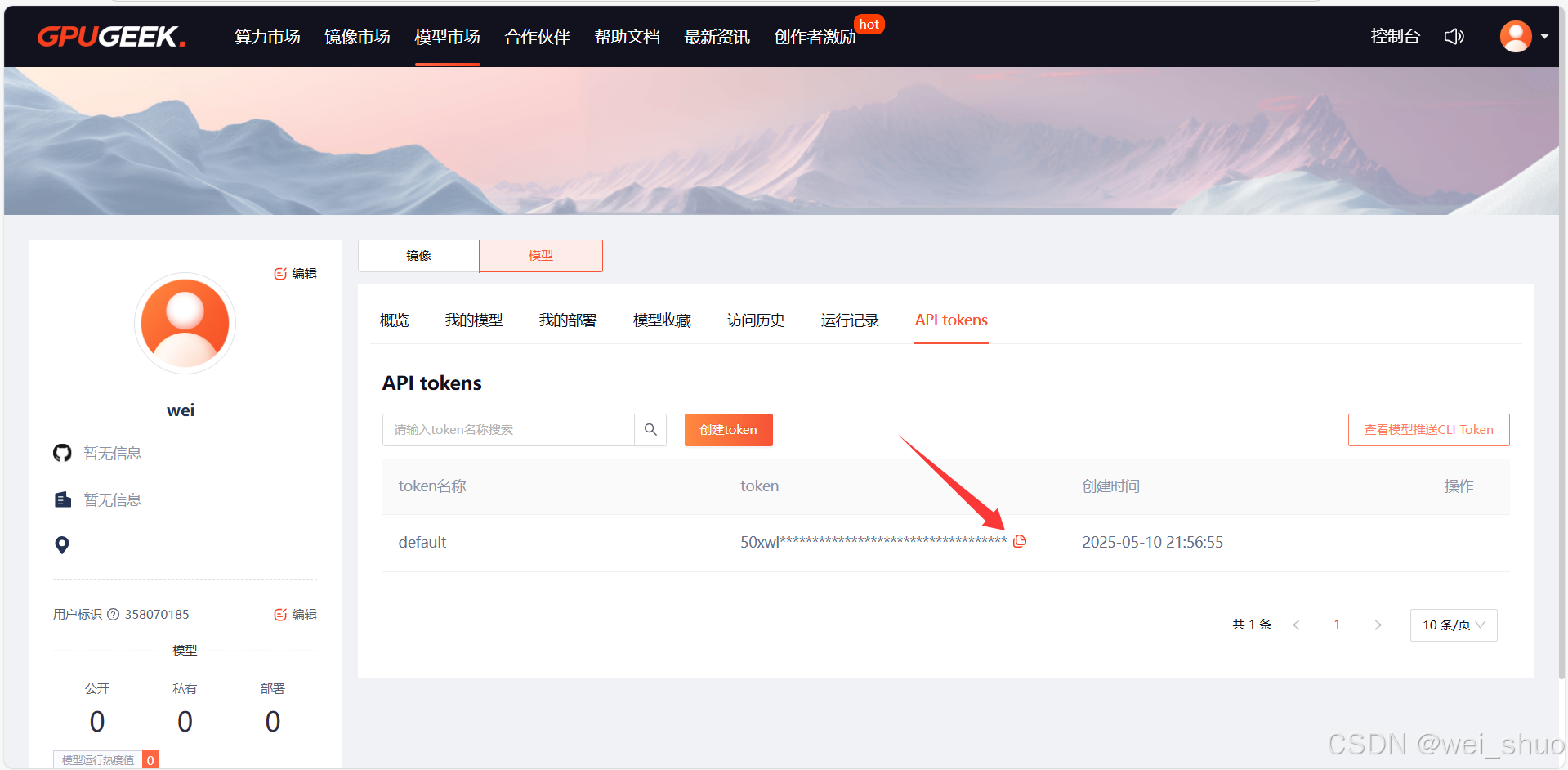

4、获取自己的API Token

5、复制并报错后续API调用的时候需要用到

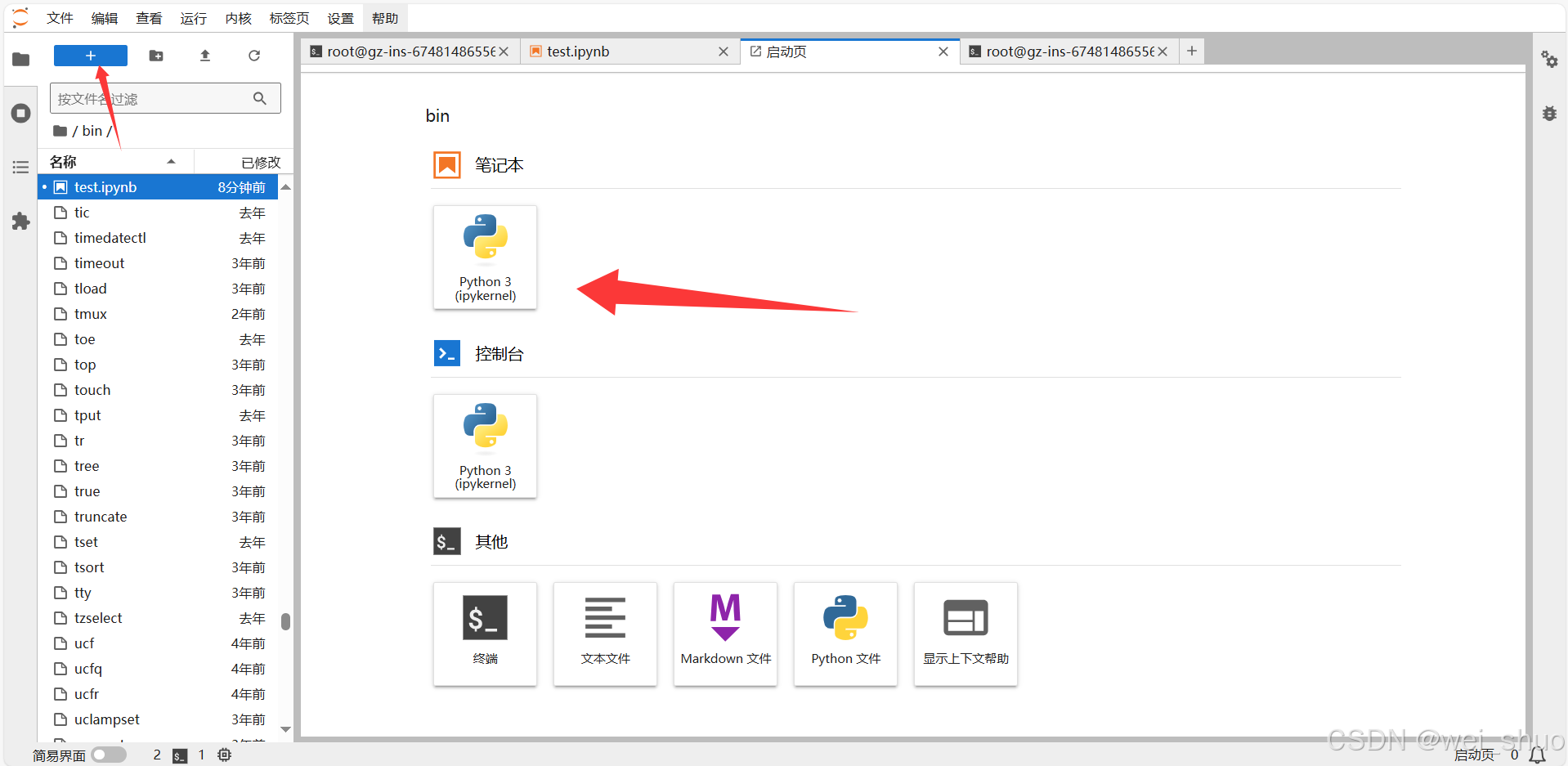

5、 JupyterLab登录示例并且创建python文件(点击+,并且选择笔记本Python3)

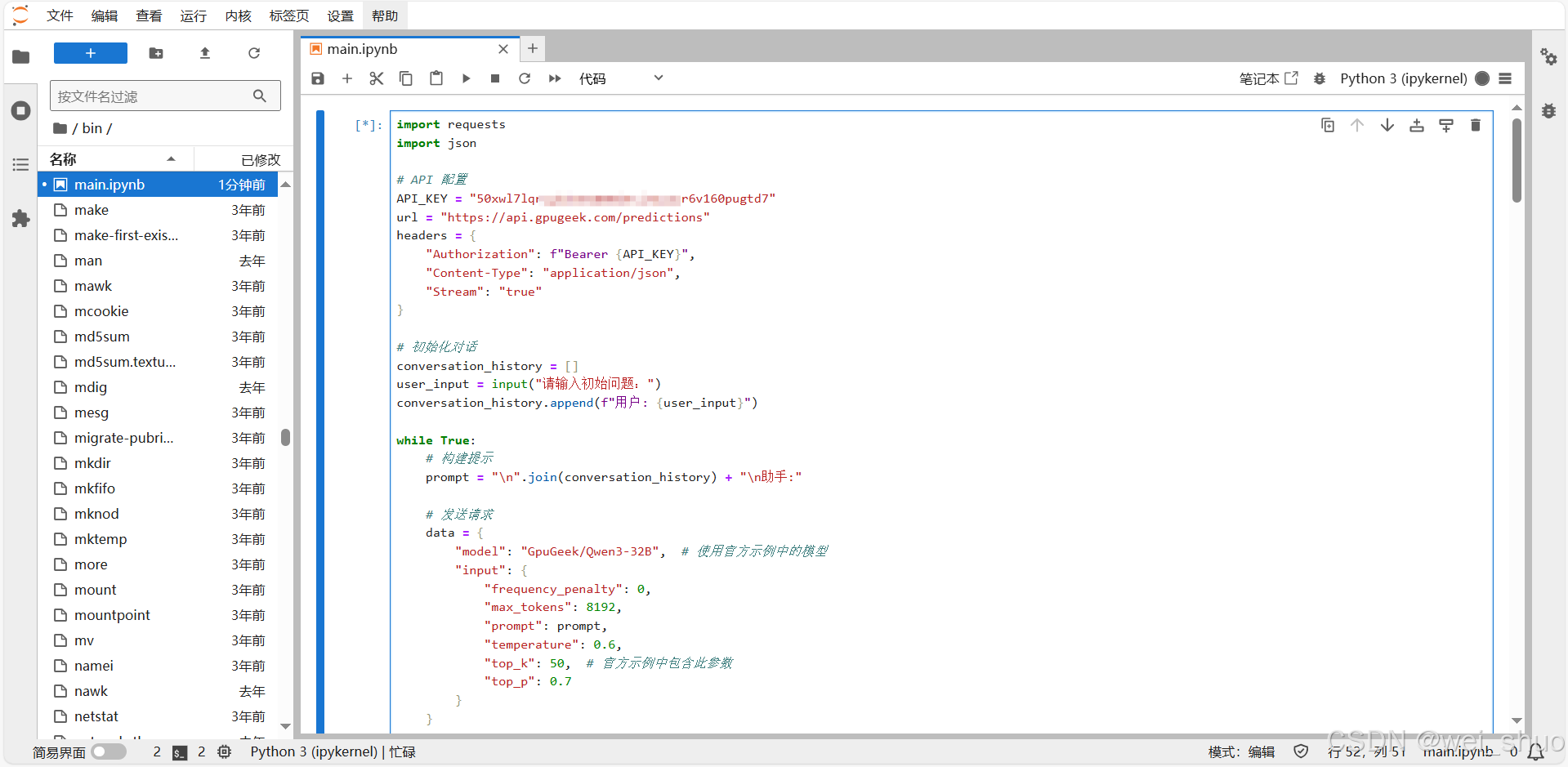

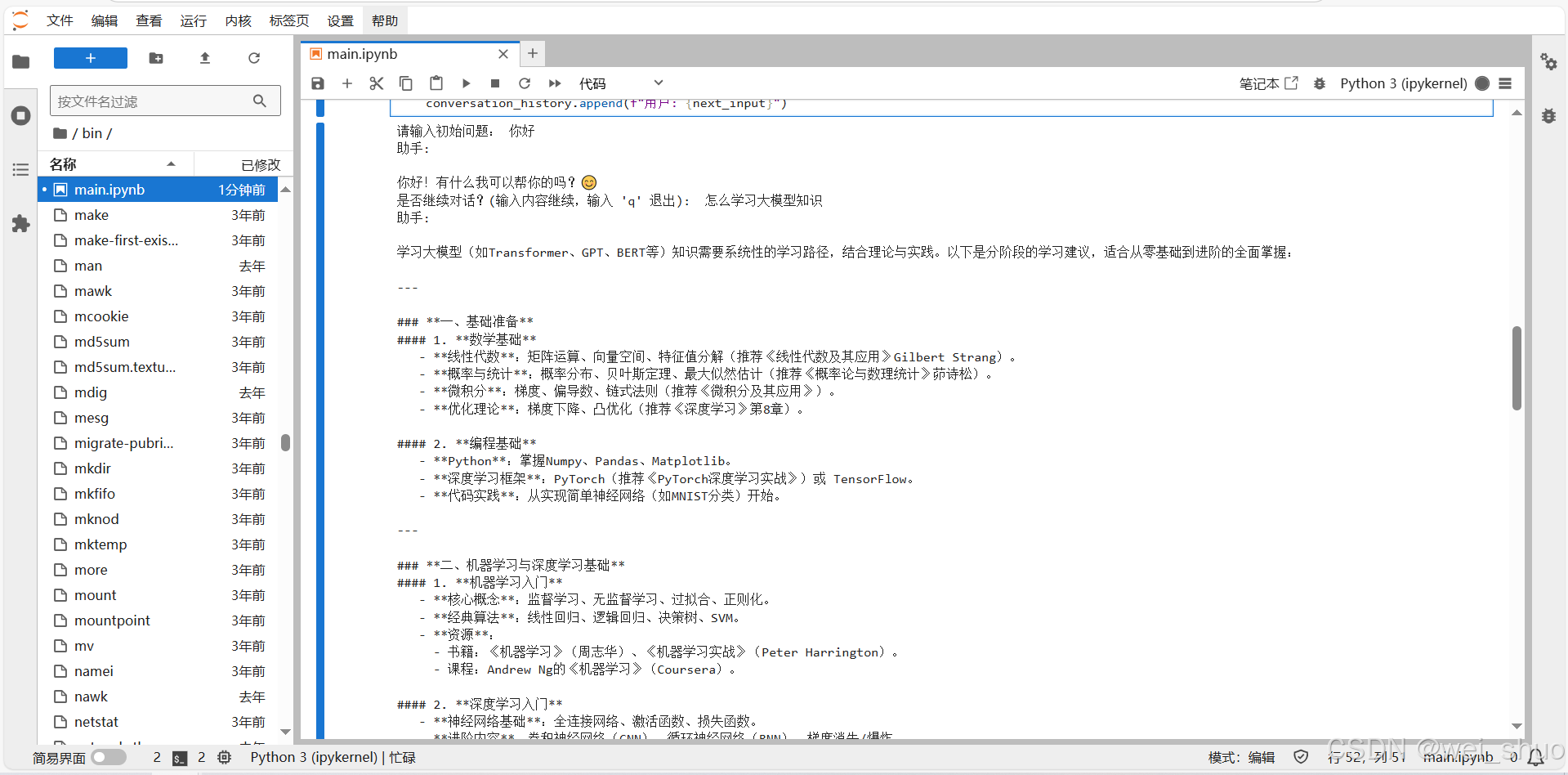

6、博主自己写了一段实现持续交流的API调用python代码(需要将下面代码的API_KEY替换为你的实际API_Token)

pythonimport requests import json # API 配置 API_KEY = "API_Token" #替换为自己的 API_Token url = "https://api.gpugeek.com/predictions" headers = { "Authorization": f"Bearer {API_KEY}", "Content-Type": "application/json", "Stream": "true" } # 初始化对话 conversation_history = [] user_input = input("请输入初始问题:") conversation_history.append(f"用户: {user_input}") while True: # 构建提示 prompt = "\n".join(conversation_history) + "\n助手:" # 发送请求 data = { "model": "GpuGeek/Qwen3-32B", # 替换为自己的模型名称 "input": { "frequency_penalty": 0, "max_tokens": 8192, "prompt": prompt, "temperature": 0.6, "top_k": 50, # 官方示例中包含此参数 "top_p": 0.7 } } try: # 发送请求并使用流式处理 response = requests.post(url, headers=headers, json=data, stream=True) # 检查响应状态码 if response.status_code != 200: print(f"请求失败,状态码: {response.status_code}") print(f"错误内容: {response.text}") break # 处理流式响应(按官方示例) full_reply = "" for line in response.iter_lines(): if line: try: # 解码并解析JSON json_line = line.decode("utf-8") result = json.loads(json_line) # 提取回复内容 if "output" in result: output = result["output"] if isinstance(output, list): full_reply += "".join(output) elif isinstance(output, str): full_reply += output except json.JSONDecodeError as e: print(f"解析JSON行时出错: {e}") print(f"行内容: {json_line}") # 打印完整回复 if full_reply: print(f"助手: {full_reply}") conversation_history.append(f"助手: {full_reply}") else: print("助手未返回有效回复") except requests.exceptions.RequestException as e: print(f"请求异常: {e}") break # 询问用户是否继续 next_input = input("是否继续对话?(输入内容继续,输入 'q' 退出): ") if next_input.lower() == 'q': break conversation_history.append(f"用户: {next_input}")

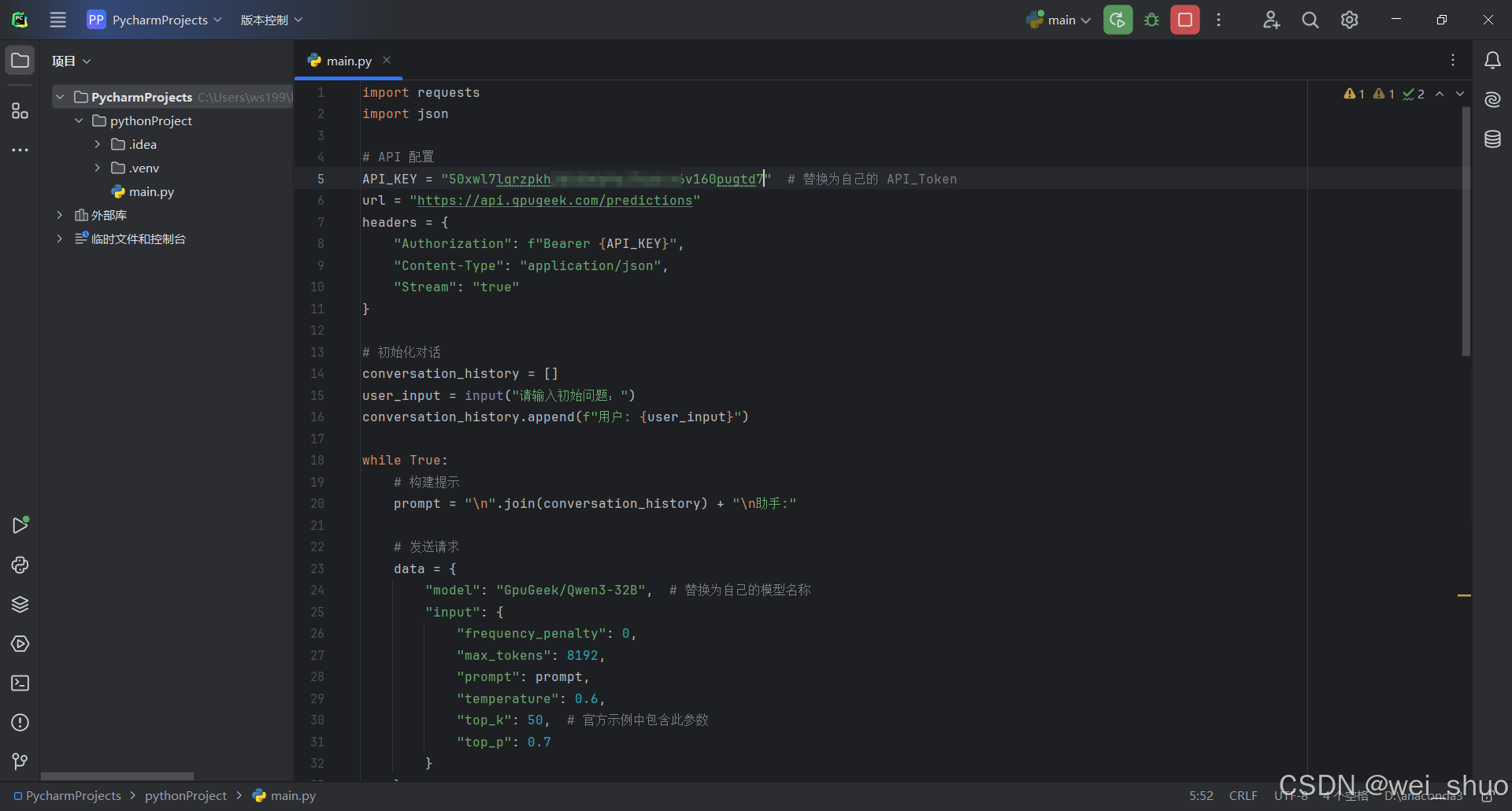

GpuGeek/Qwen3-32B 模型 Windows本地Pycharm部署

Windows本地部署,pycharm执行上述代码效果是一样的

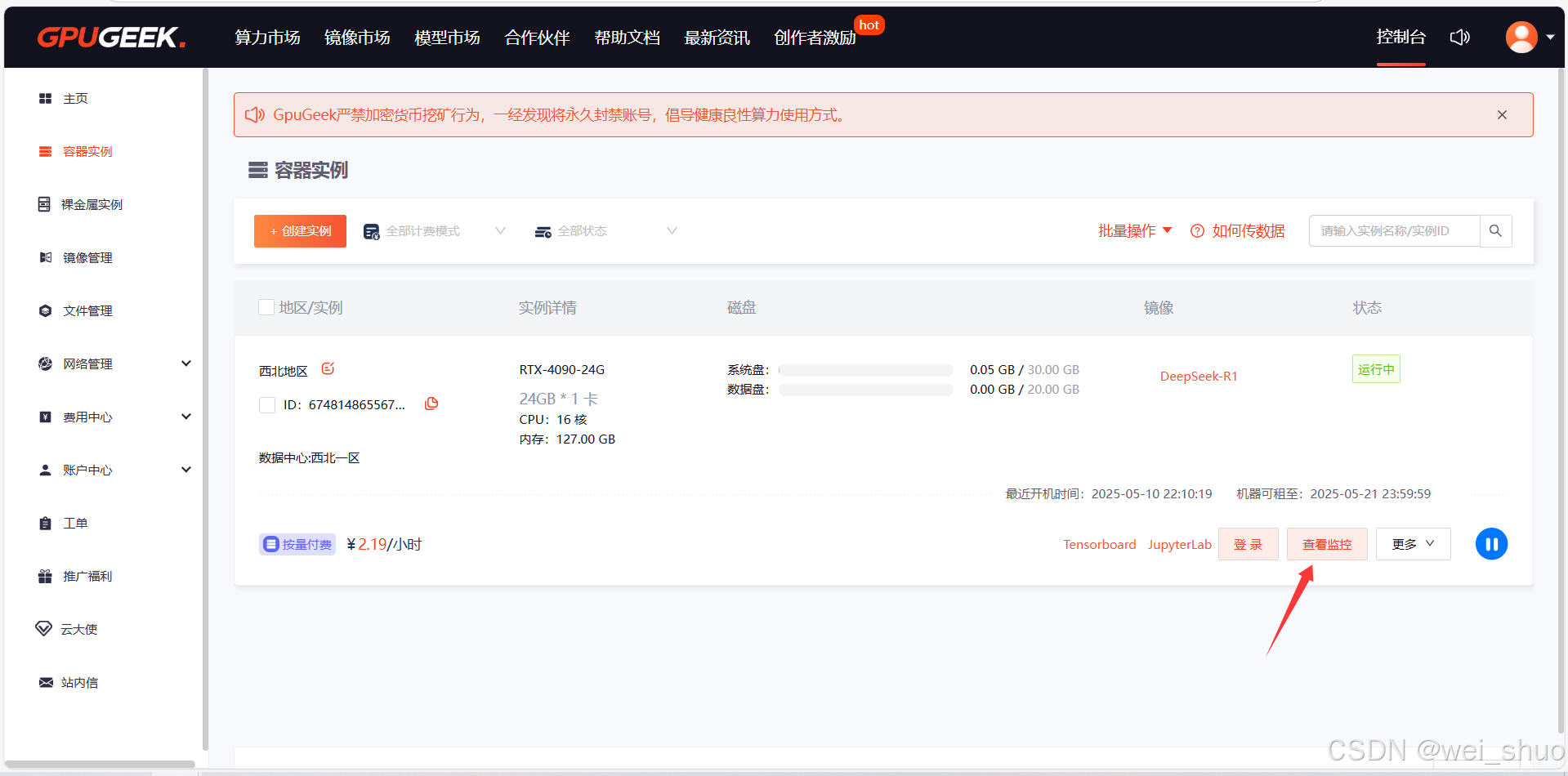

GpuGeek实例性能测试

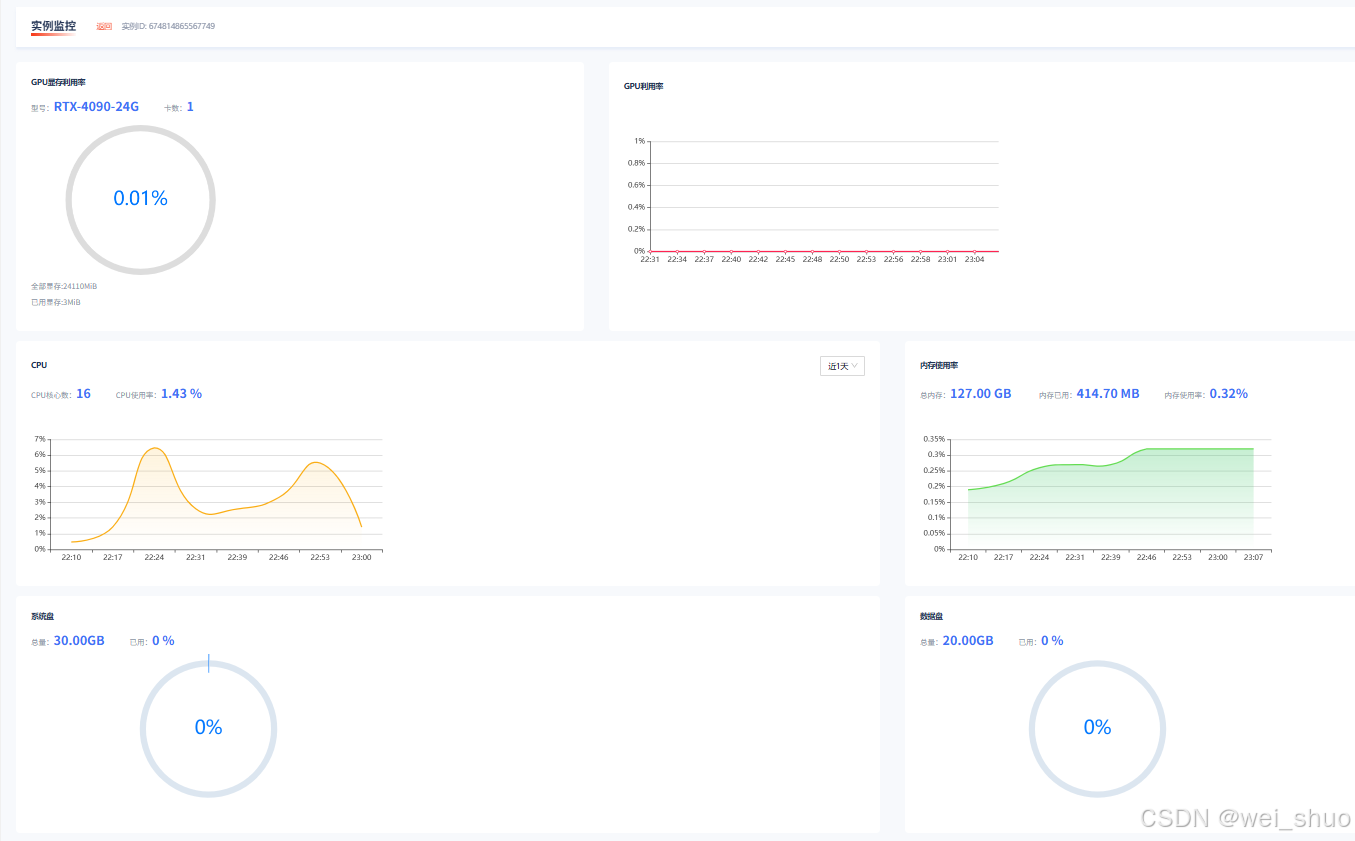

1、GpuGeek实例性能不需要自己测试,平台提供了性能图形化监控,可以查看任意时间段示例的性能GPU显存利用率、GPU利用率、CPU、内存使用率、系统盘、数据盘等,可视化界面非常便捷

2、如下可以看到其性能表现十分优异,16 核的 CPU 当前使用率仅 1.43%,近 1 天虽有波动但始终处于低位,大量计算资源闲置。内存方面,127.00 GB 总内存仅使用了 414.70 MB,利用率低至 0.32% ,且使用率曲线平稳缓慢上升。这意味着该实例在当前工作负载下,无论是 CPU 还是内存资源都极为充裕,能轻松应对现有任务,即便业务量有所增长,也有足够的性能余量来保障系统稳定运行。

GpuGeek平台优势

GPU资源池多样化:GpuGeek平台拥有丰富的GPU资源池,支持多种主流GPU型号,包括NVIDIA A100、H100及RTX系列等,全面覆盖从消费级到企业级的算力需求,为用户提供灵活的选择空间。

部署模式灵活:平台提供单卡、多卡集群及裸金属服务器等多种部署模式,用户可根据具体任务需求进行弹性扩展,实现算力资源的动态调整与高效利用。

智能调度优化效率:基于AI算法的动态调度系统,可实时监控资源使用情况,自动分配最优算力节点,显著减少任务排队时间。同时,平台支持多任务并行处理,特别适合大规模分布式训练场景,提升整体计算效率。

网络与存储低延迟:GpuGeek拥有全球分布式数据中心节点,通过高速专用网络互联,有效降低跨区域数据传输延迟。此外,平台提供高性能分布式存储(如NVMe SSD集群),满足大规模数据集的快速读写需求,确保数据处理的流畅性。

计费模式灵活经济:平台提供按需计费、包年包月及竞价实例等多种计费模式,用户可根据任务性质选择最经济的计费方式。按秒/小时计费适合短期或实验性任务,包年包月模式则适合长期稳定业务需求,竞价实例则以超低价提供算力资源,适合对价格敏感的离线任务。

安全合规保障:GpuGeek注重用户数据的安全与合规性,采用数据加密传输与存储技术,支持VPC隔离、安全组策略等企业级安全功能。同时,平台符合GDPR、ISO 27001等国际数据安全标准,为敏感数据场景提供可靠的安全保障。

总结

GpuGeek 作为行业领先的算力服务平台,拥有海量且丰富的 GPU 资源,算力适配方面,能够精准满足不同用户的多样化算力需求,全球超 30 个节点布局,为世界各地的用户提供了便捷的接入点,用户可以从数十种 GPU 型号中按需挑选,背后更有多达数万张 GPU 卡随时待命,为用户的项目全力赋能。

AI 开发生态上,GpuGeek 展现出强大的兼容性,全面支持多框架 AI 开发,无论是 TensorFlow、PyTorch 还是其他主流框架,均可无缝对接。同时,平台秉持灵活的服务理念,用户能够根据自身项目的实际需求,弹性选择所需的 GPU 资源,并按照使用量进行灵活计费,真正做到资源利用最大化,成本投入最优化 。