大模型量化,剪枝

量化有助于减少显存使用并加速推理

GPTQ 等后训练量化方法(Post Training Quantization)是一种在训练后对预训练模型进行量化的方法。

bash

### model

model_name_or_path: meta-llama/Meta-Llama-3-8B-Instruct

template: llama3

### export

export_dir: models/llama3_gptq

export_quantization_bit: 4

export_quantization_dataset: data/c4_demo.json

export_size: 2

export_device: cpu

export_legacy_format: falseQLoRA 是一种在 4-bit 量化模型基础上使用 LoRA 方法进行训练的技术。它在极大地保持了模型性能的同时大幅减少了显存占用和推理时间。

bash

### model

model_name_or_path: meta-llama/Meta-Llama-3-8B-Instruct

adapter_name_or_path: saves/llama3-8b/lora/sft

template: llama3

finetuning_type: lora

### export

export_dir: models/llama3_lora_sft

export_size: 2

export_device: cpu

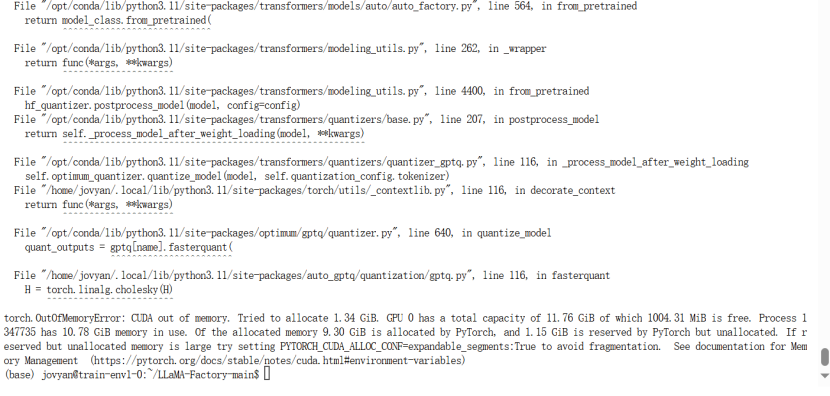

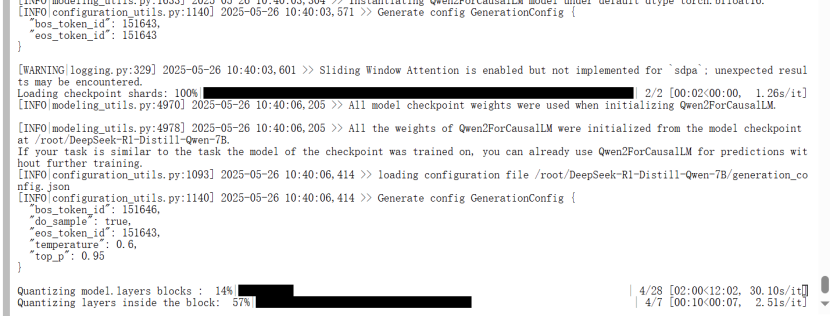

export_legacy_format: false量化7B模型,12GB显存不够用

增大至24G显存就够了

量化加载的参数更多,所以对显存的需求更大

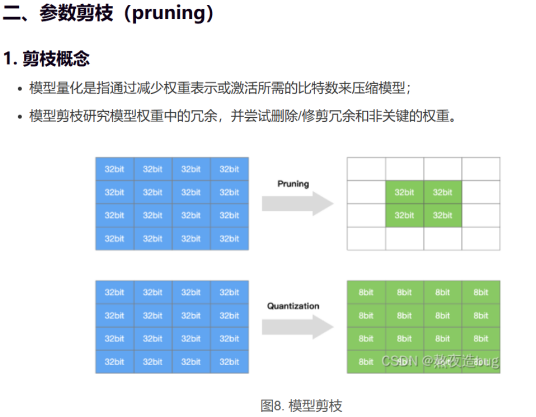

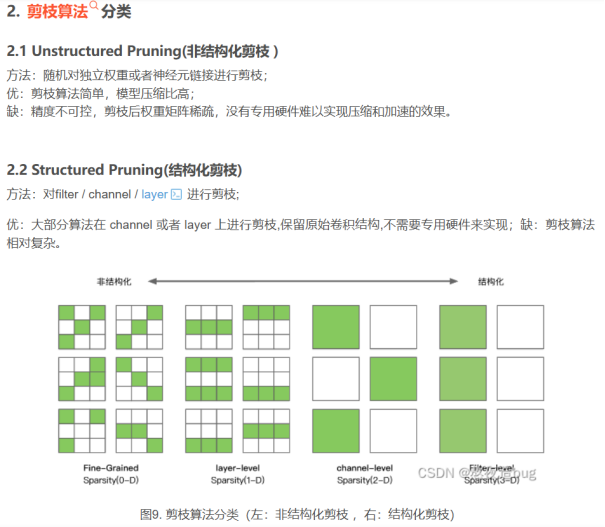

剪枝