0 序言

本文聚焦AI领域核心概念 Agent、Prompt、Function Calling、MCP ,解析其定义、关联及运作逻辑,还原智能体系统如何协作解决任务的完整流程。

读完后应掌握以下三点:① 明白各组件的角色与价值 ;② 理解从用户提问到结果输出的全链路机制 ;③ 清楚技术演进中问题-解决方案的迭代关系。

全文架构:先分别介绍Prompt、Function Calling、MCP,接着在阐述其工作流程,最后在文章总结前用最眼见意骇的方式解释清楚这几者之前的关系。

1. Prompt:AI交互的"指令基石"

1.1 User Prompt

- 定义:用户向AI模型发送的问题或指令(如"查询今日天气如何?")。

- 作用:作为AI生成回复的直接依据,决定交互的核心目标。

- 特点:聚焦具体任务,与模型能力直接关联(如要求"生成报告"需模型支持文本创作)。

1.2 System Prompt

- 定义:包含AI角色设定、语气、背景的提示词(如"你是专业财经分析师,回复需用数据支撑"),与User Prompt分离。

- 作用:赋予AI"人设",规范回复风格(如让客服对话更亲和),提升交互体验。

- 特点 :

- 部分场景由系统预设(如网页聊天机器人),支持用户自定义;

- 作为"上下文描述",间接影响AI输出方向(如限定回复长度、格式)。

2. AI Agent:任务调度的"中枢神经"

2.1 核心定义与作用

- 定义:连接用户、AI模型、工具的中间程序。

- 作用 :

- 接收用户请求(User Prompt);

- 协调AI模型与工具的交互(如决定何时调用"网页浏览"工具);

- 封装并呈现最终结果。

2.2 早期实现的问题与挑战

问题1:工具复用性差

早期开发中,每个Agent需内置工具函数(如网页浏览、文件管理),重复代码冗余(比如说每个agent在调用时都要给它封装好一个MCP协议,这样子很不方便)。

问题2:格式兼容性低

AI模型返回的工具调用指令可能格式错误,导致Agent需重试,降低效率。

3. Function Calling:工具交互"标准化"

3.1 核心思想与价值

- 定义:大模型厂商推出的标准化协议,统一AI模型与工具的交互格式。

- 核心目标:降低开发难度(避免重复造工具)、减少资源消耗(统一格式无需反复调试)。

3.2 实现方式

- 工具定义:用JSON描述工具,包含名称(name)、功能说明(description)、参数(parameters)。

- 格式分离:将工具描述从System Prompt中独立,单独存储管理。

- 规范约束 :规定AI模型调用工具时的返回格式(如必须包含

tool_name和result字段)。

3.3 优缺点分析

- 优点 :

- 降低用户端开发成本(复用标准化工具);

- 减少Token消耗(无需在Prompt中重复写工具描述);

- 服务端自动校验格式,纠正模型错误回复。

- 缺点 :

- 无统一行业标准,厂商API定义差异大(如百度文心与OpenAI的Function Calling格式不同);

- 部分开源模型暂不支持该功能。

4. MCP:工具协作的"通信协议"

4.1 定义与核心价值

- 定义:Modular Computation Protocol,规范AI Agent与Tool服务交互的通信协议。

- 解决的问题 :

- 突破工具"私有性",实现统一托管(如把"网页浏览"工具做成公共服务,供所有Agent调用);

- 让Agent动态获取工具信息(如从MCP Server查询"有哪些工具可用")。

4.2 组件与接口

- 组成部分 :

- MCP Server :承载工具服务的端,支持三类能力:

- 管理工具列表(含功能描述、参数格式);

- 提供数据资源(如文件读写、知识库访问);

- 内置提示词模板(如生成"会议纪要"的Prompt)。

- MCP Client:调用MCP Server的Agent(即用户交互的入口)。

- MCP Server :承载工具服务的端,支持三类能力:

- 通信方式 :

- 同机部署:Agent与MCP Server在同一机器,通过标准输入输出通信;

- 网络部署:MCP Server部署在远端,通过HTTP协议通信。

4.3 特点与意义

- 解耦AI模型与工具:MCP仅负责工具管理、资源调度,与具体AI模型无关;

- 实现工具共享:避免重复开发,提升系统扩展性(新增工具只需在Server端部署)。

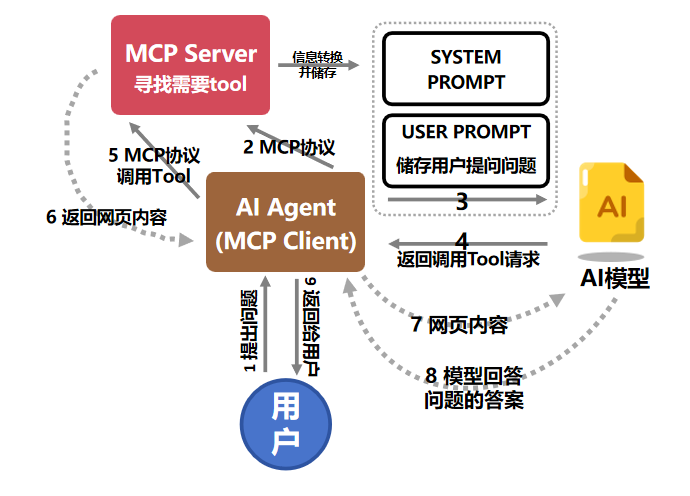

5. 智能体系统全流程:从用户提问到结果输出

5.1 交互步骤拆解

- 用户发起请求:向AI Agent(MCP Client)提出问题(如"分析A股今日走势")。

- Agent获取工具信息:通过MCP协议访问MCP Server,查询可用工具(如"网页浏览""财经数据接口")。

- Prompt组装与发送 :

- Agent将工具信息转化为 System Prompt (如"可调用网页浏览工具获取实时行情")或 Function Calling格式(如JSON描述工具参数);

- 与User Prompt打包,发送给AI大模型。

- 模型决策与工具调用 :

- AI模型解析Prompt,决定调用"网页浏览"工具,向Agent发送调用请求。

- 工具执行与结果回传 :

- Agent通过MCP协议调用Server端的网页浏览工具,获取A股行情数据;

- Tool将结果返回给Agent。

- 最终结果生成 :

- Agent转发工具结果给AI模型,模型结合自身知识(如财经分析逻辑)生成最终答案。

- 结果呈现:Agent将答案展示给用户。

6 快速梳理核心逻辑

把AI协作想象成 "虚拟团队" :用户是需求方,大模型是智囊团(也就是提主意的人),Agent是"项目经理" 统筹任务,工具是"外包团队"提供能力,MCP是"工具共享平台" 统一管理外包,Function Calling是"外包对接规范" ,Prompt是"给智囊团的任务说明" 。

任务启动时,User Prompt 明说"做什么"(如"查A股走势"),System Prompt 暗定"怎么做"(如"当专业分析师,用数据说话"),让大模型既知目标又懂风格。Agent接下需求后,通过 MCP协议 从平台找工具(如网页浏览),把工具信息包装成System Prompt或Function Calling格式(用JSON规范描述工具名、参数),和User Prompt一起发给大模型。若大模型判断需调用工具,Agent就通过MCP启动外包,等工具返回结果再转发给大模型生成答案。

具体直接看下面流程图:

针对图中的四个概念,可以这么理解:

- Prompt 解决

说清楚需求 - Agent 解决

协调资源 - Function Calling 解决

规范沟通 - MCP 解决

工具复用

7 小结

从 Prompt(定义交互规则) 到 Agent(中枢调度) ,再到 Function Calling(标准化交互) 和 MCP(工具共享) ,整个体系围绕 "解决任务协作的效率与复用问题" 迭代:

早期Agent因工具私有性重复开发→Function Calling通过标准化降低成本→MCP进一步实现工具统一托管,提升扩展性。

这些概念并非替代关系,而是形成 "指令定义→中枢调度→交互标准化→资源共享" 的协作闭环,支撑AI系统从单纯聊天向高效执行复杂任务进化。只有理解其逻辑,才能更清晰地洞察智能体技术的发展脉络与落地路径。