Redis 集群(Redis Cluster)是 Redis 官方提供的分布式解决方案,用于解决单节点 Redis 内存限制、并发瓶颈和单点故障问题,支持数据分片存储和自动故障转移,可扩展性强

1.基本概念

哨兵 模式, 提⾼了系统的可⽤性. 但是真正⽤来存储数据的还是 master 和 slave 节点. 所有的数据都需要存储在单个 master 和 slave 节点中.

如果数据量很⼤, 接近超出了 master / slave 所在机器的物理内存, 就可能出现严重问题了.

如何获取更⼤的空间? 加机器即可! 所谓 "⼤数据" 的核⼼, 其实就是⼀台机器搞不定了, ⽤多台机器来搞.

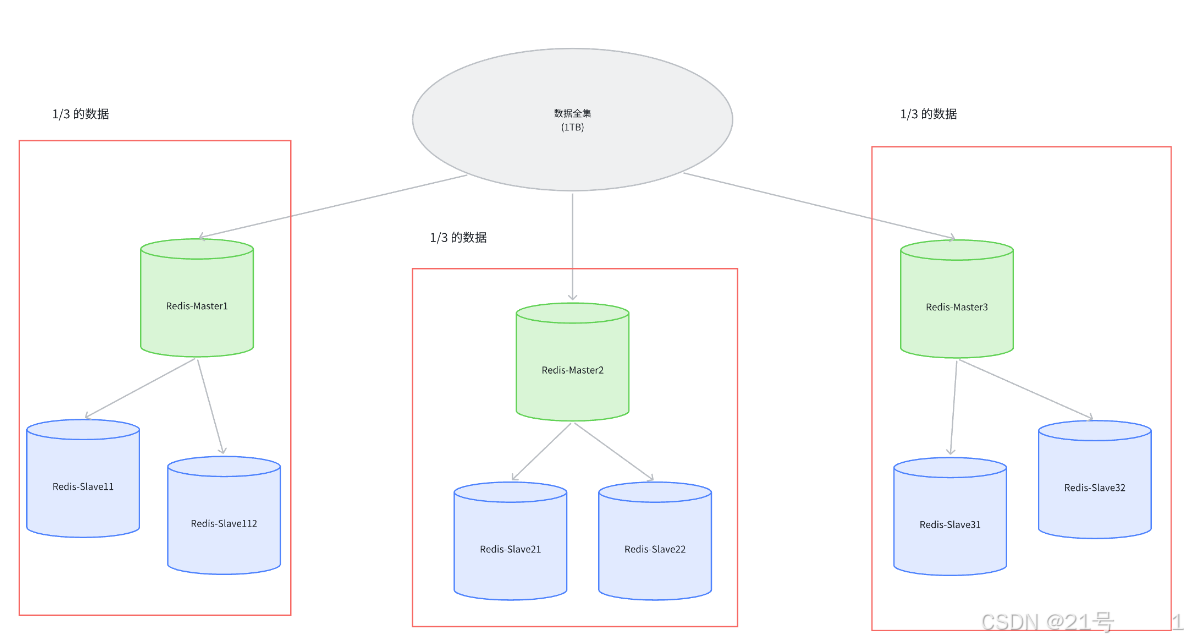

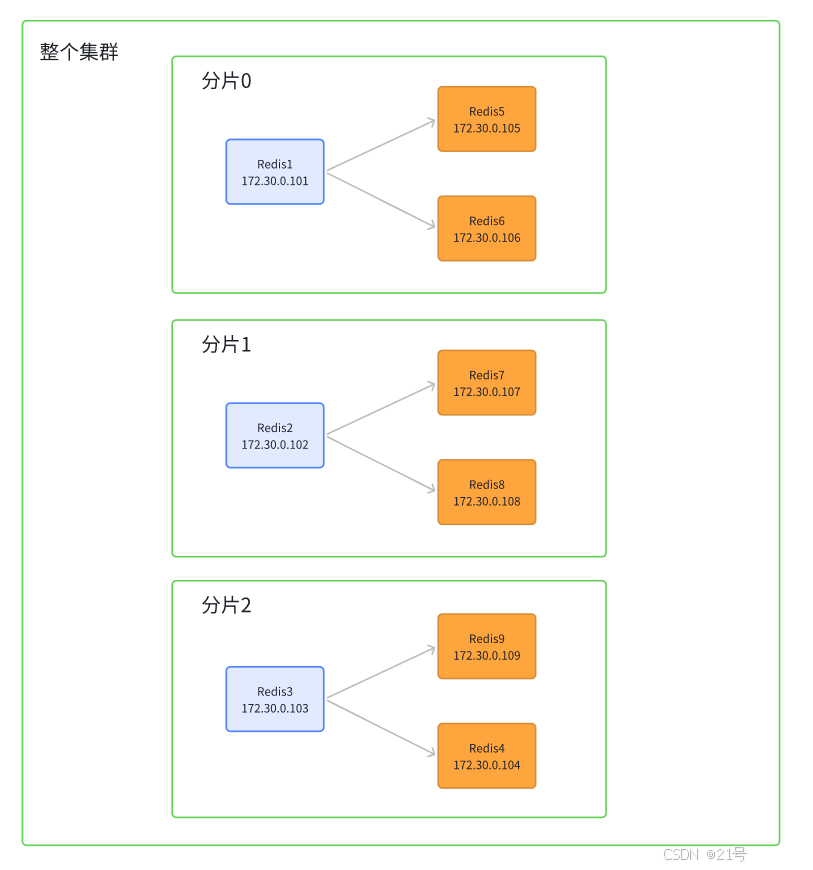

Redis 的集群就是在上述的思路之下, 引⼊多组 Master / Slave , 每⼀组 Master / Slave 存储数据全集的⼀部分, 从⽽构成⼀个更⼤的整体, 称为 Redis 集群 (Cluster).

假定整个数据全集是 1 TB, 引⼊三组 Master / Slave 来存储. 那么每⼀组机器只需要存储整个数据全集的 1/3 即可.

sql

Master1 和 Slave11 和 Slave12 保存的是同样的数据. 占总数据的 1/3

Master2 和 Slave21 和 Slave22 保存的是同样的数据. 占总数据的 1/3

Master3 和 Slave31 和 Slave32 保存的是同样的数据. 占总数据的 1/3

每个 Slave 都是对应 Master 的备份(当 Master 挂了, 对应的 Slave 会补位成 Master).

每个红框部分都可以称为是⼀个 分⽚ (Sharding).

如果全量数据进⼀步增加, 只要再增加更多的分⽚, 即可解决.2.数据分片算法

Redis cluster 的核⼼思路是⽤多组机器来存数据的每个部分. 那么接下来的核⼼问题就是, 给定⼀个数据 (⼀个具体的 key), 那么这个数据应该存储在哪个分⽚上? 读取的时候⼜应该去哪个分⽚读取?

1.哈希求余

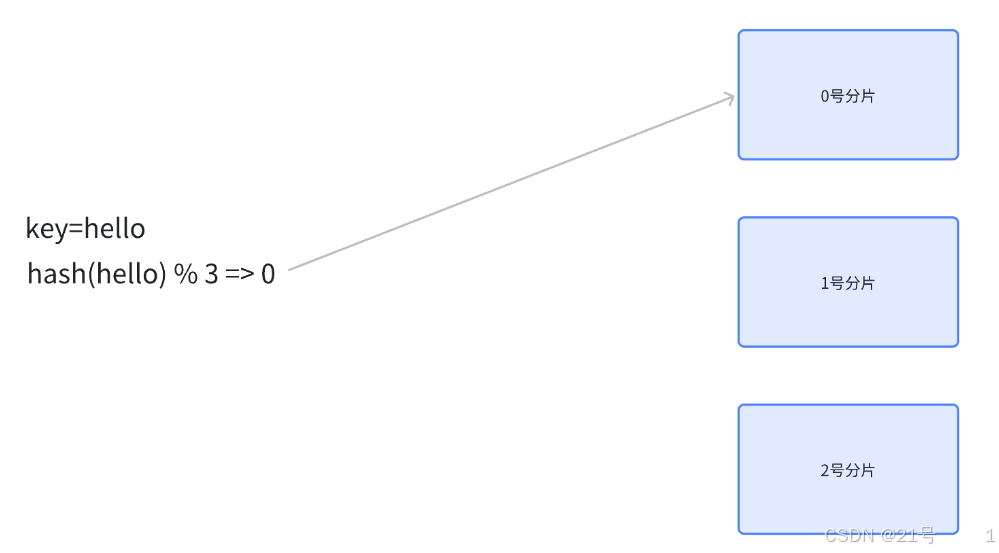

设有 N 个分⽚, 使⽤ [0, N-1] 这样序号进⾏编号.

针对某个给定的 key, 先计算 hash 值, 再把得到的结果 % N, 得到的结果即为分片编号

sql

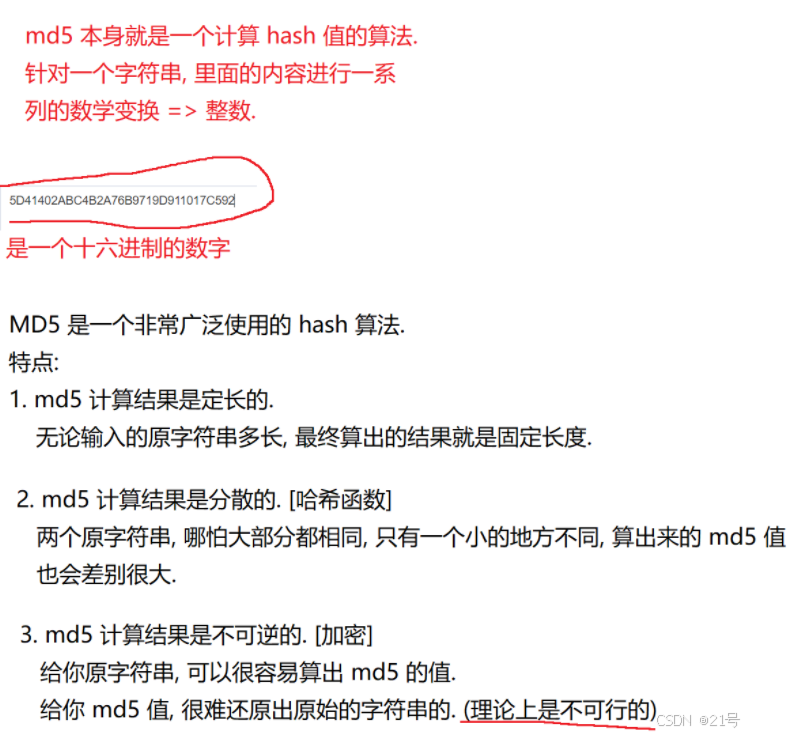

例如, N 为 3. 给定 key 为 hello, 对 hello 计算 hash 值(⽐如使⽤ md5 算法), 得到的结果为

bc4b2a76b9719d91 , 再把这个结果 % 3, 结果为 0, 那么就把 hello 这个 key 放到 0 号分⽚上.

当然, 实际⼯作中涉及到的系统, 计算 hash 的⽅式不⼀定是 md5, 但是思想是⼀致的.

**优点:**简单⾼效, 数据分配均匀.

缺点: ⼀旦需要进⾏扩容, N 改变了, 原有的映射规则被破坏, 就需要让节点之间的数据相互传输, 重新排列, 以满⾜新的映射规则. 此时需要搬运的数据量是⽐较多的, 开销较⼤

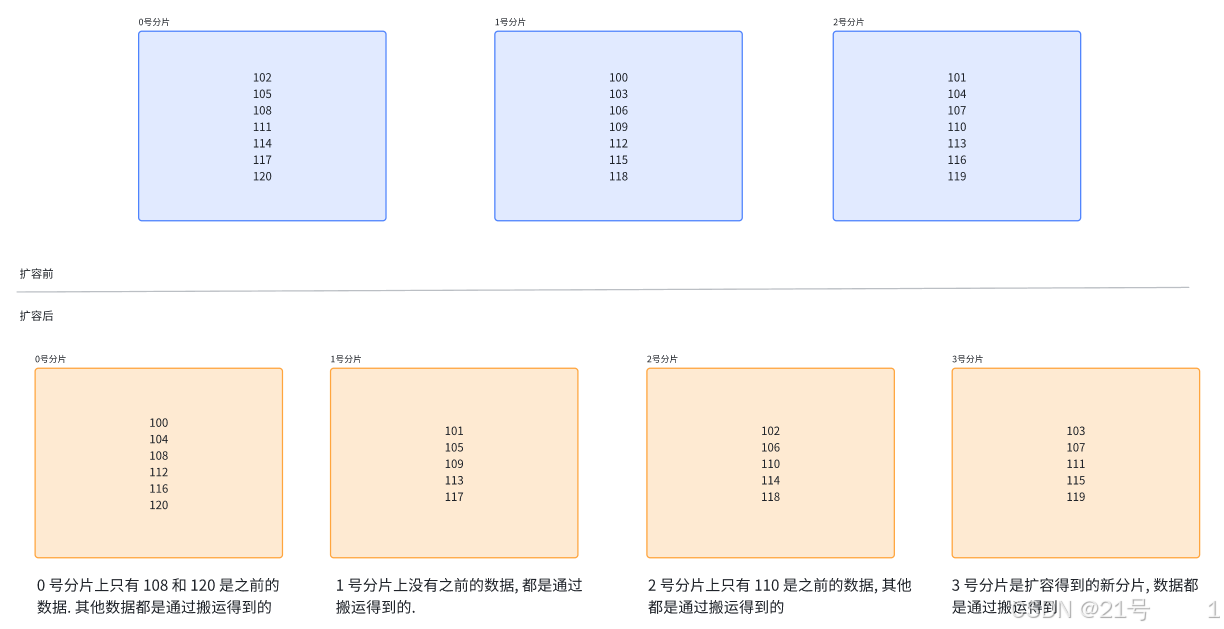

N 为 3 的时候, [100, 120] 这 21 个 hash 值的分布 (此处假定计算出的 hash 值是⼀个简单的整数, ⽅便⾁眼观察)

当引⼊⼀个新的分⽚, N 从 3 => 4 时, ⼤量的 key 都需要重新映射. (某个key % 3 和 % 4 的结果不⼀样, 就映射到不同机器上了).

如上图可以看到, 整个扩容⼀共 21 个 key, 只有 3 个 key 没有经过搬运, 其他的 key 都是搬运过的.

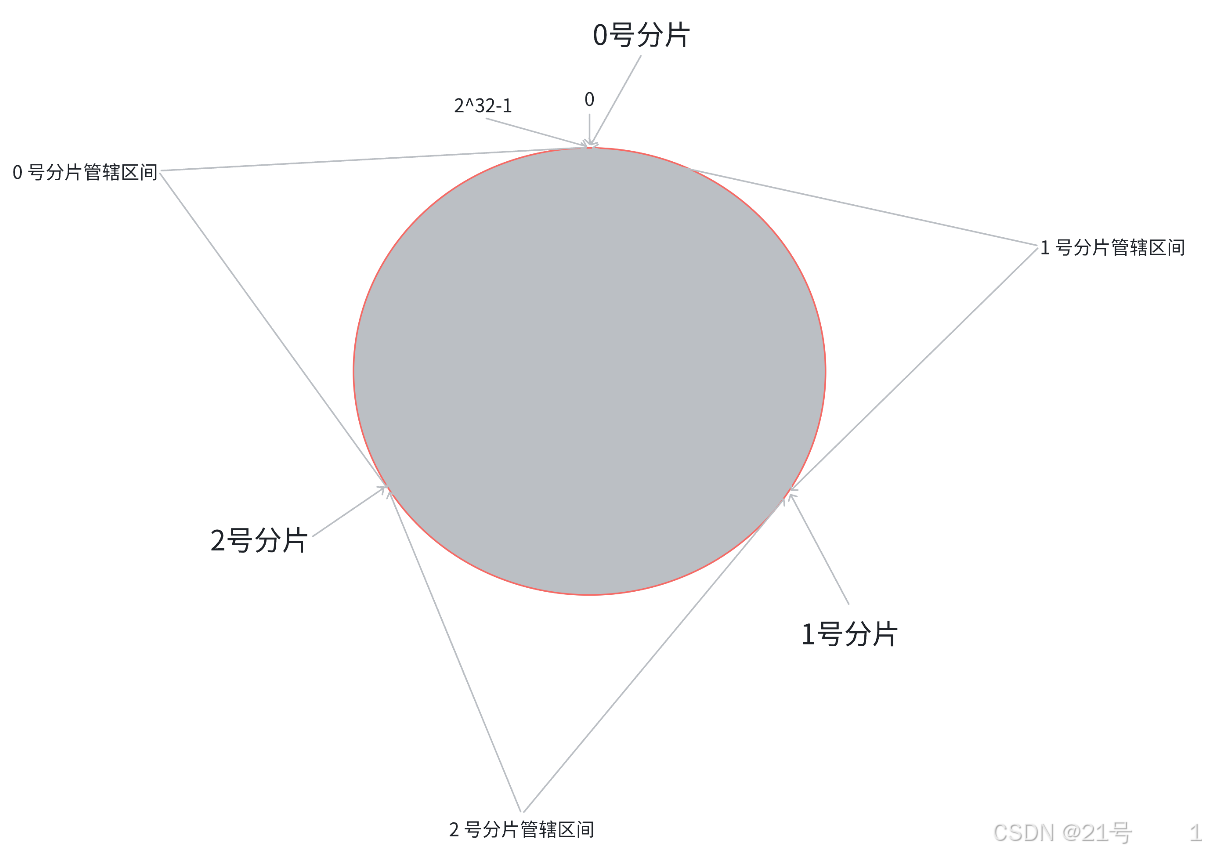

2.一致性哈希算法

为了降低上述的搬运开销, 能够更⾼效扩容, 业界提出了 "⼀致性哈希算法".

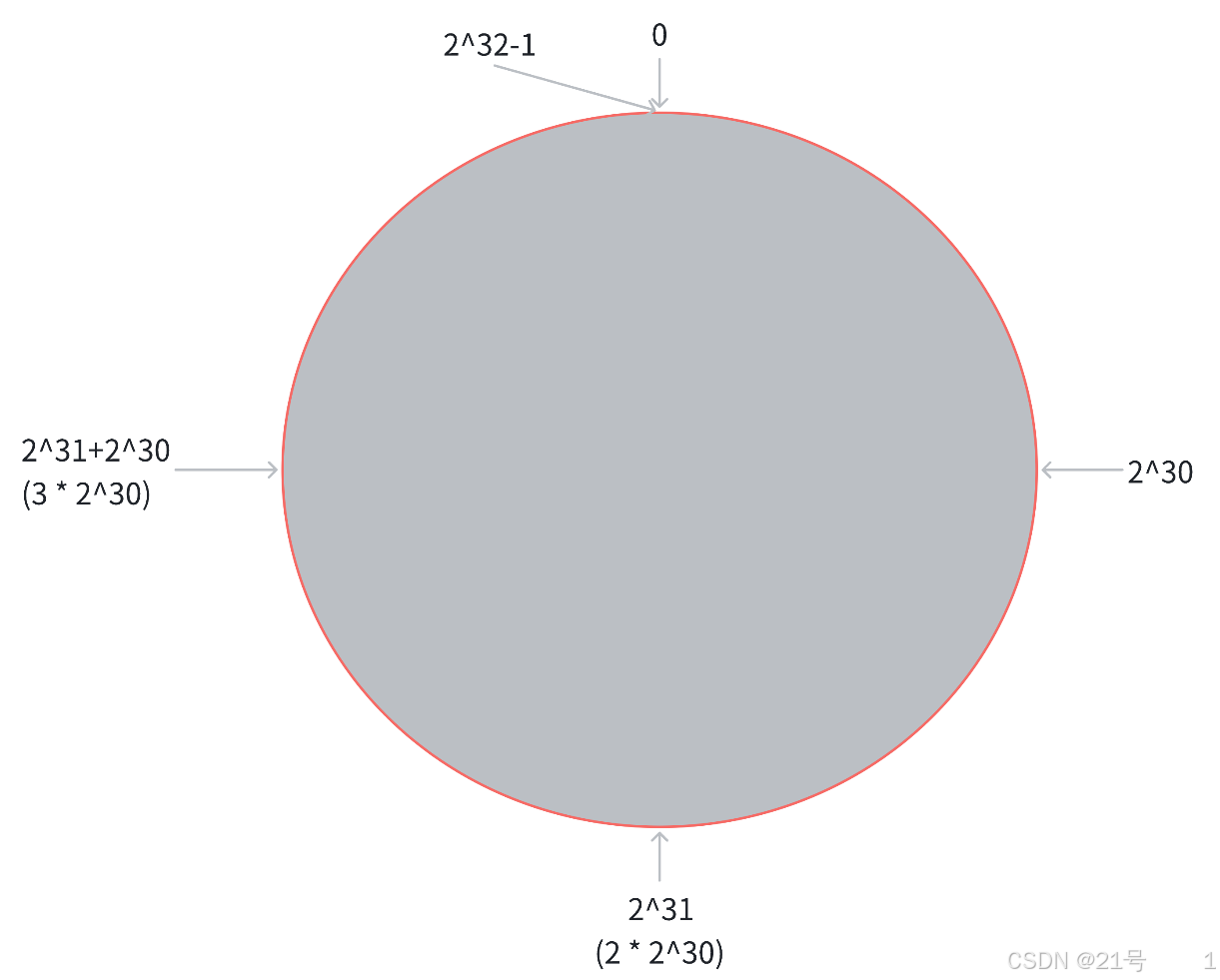

key 映射到分⽚序号的过程不再是简单求余了, ⽽是改成以下过程:

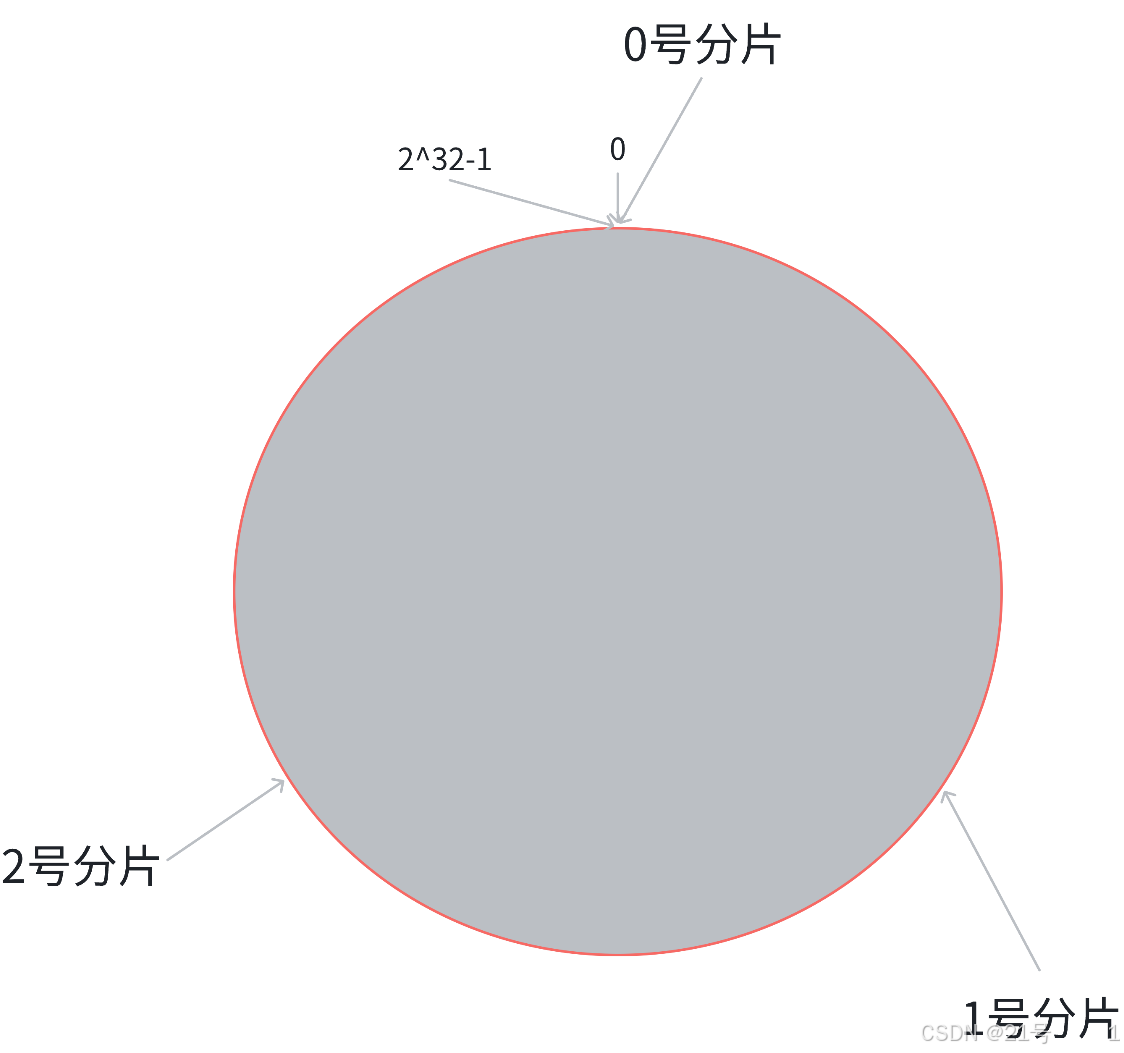

第⼀步, 把 0 -> 2^32-1 这个数据空间, 映射到⼀个圆环上. 数据按照顺时针方向增长

第二步, 假设当前存在三个分片, 就把分片放到圆环的某个位置上.

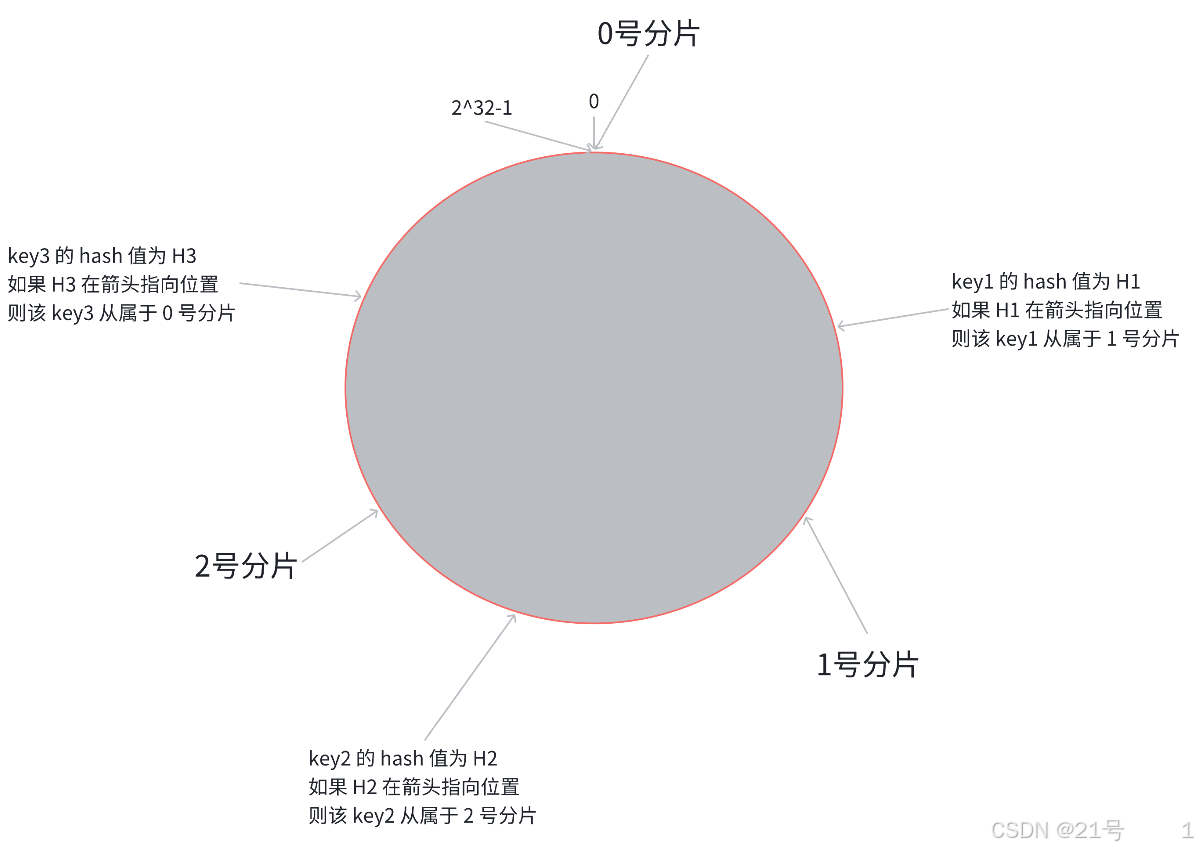

第三步, 假定有⼀个 key, 计算得到 hash 值 H, 那么这个 key 映射到哪个分片呢? 规则很简单, 就是从 H 所在位置, 顺时针往下找, 找到的第⼀个分片, 即为该 key 所从属的分片.

这就相当于, N 个分⽚的位置, 把整个圆环分成了 N 个管辖区间. Key 的 hash 值落在某个区间内, 就归对应区间管理.

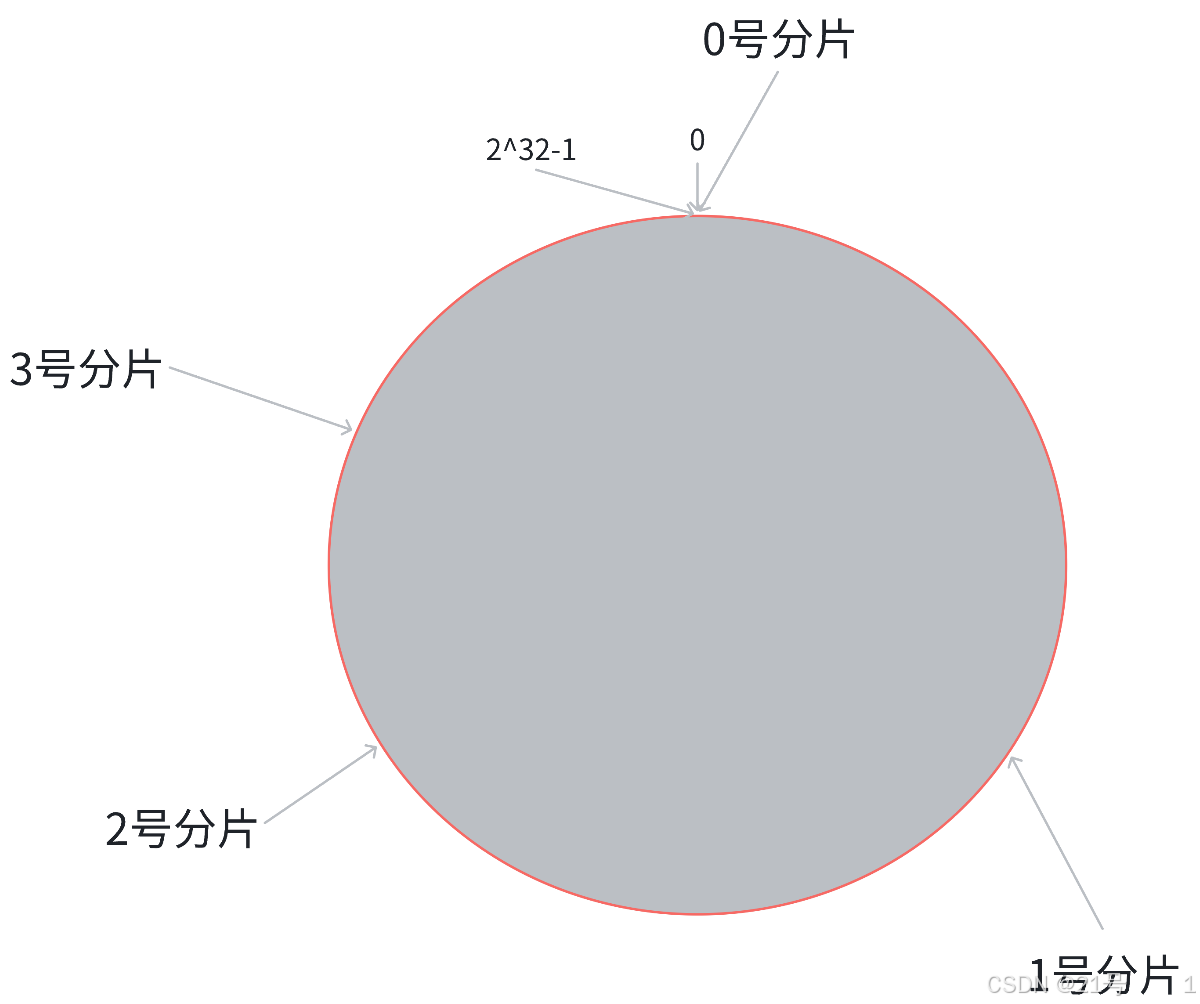

如果扩容⼀个分片, 如何处理呢?

原有分片在环上的位置不动, 只要在环上新安排⼀个分片位置即可.

此时, 只需要把 0 号分⽚上的部分数据, 搬运给 3 号分⽚即可. 1 号分⽚和 2 号分⽚管理的区间都是不变的.

优点: 大大降低了扩容时数据搬运的规模, 提高了扩容操作的效率.

缺点: 数据分配不均匀 (有的多有的少, 数据倾斜).

3.哈希槽分区算法(Redis 使用)

为了解决上述问题 (搬运成本⾼ 和 数据分配不均匀), Redis cluster 引⼊了哈希槽 (hash slots) 算法.

sql

hash_slot = crc16(key) % 16384

其中 crc16 也是⼀种 hash 算法.

16384 其实是 16 * 1024, 也就是 2^14.相当于是把整个哈希值, 映射到 16384 个槽位上, 也就是 [0, 16383].

然后再把这些槽位比较均匀的分配给每个分片. 每个分片的节点都需要记录自己持有哪些分片.

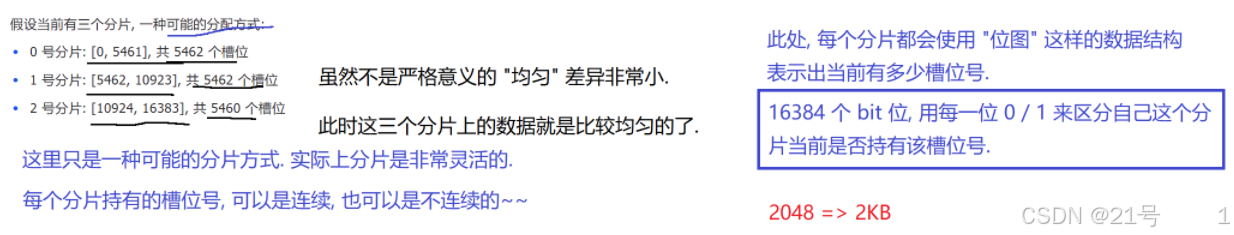

假设当前有三个分⽚, ⼀种可能的分配⽅式:

• 0 号分⽚: [0, 5461], 共 5462 个槽位

• 1 号分⽚: [5462, 10923], 共 5462 个槽位

• 2 号分⽚: [10924, 16383], 共 5460 个槽位

这里的分片规则是很灵活的. 每个分片持有的槽位也不⼀定连续.

每个分⽚的节点使⽤ 位图 来表⽰⾃⼰持有哪些槽位. 对于 16384 个槽位来说, 需要 2048 个字

节**(2KB)** ⼤⼩的内存空间表⽰.

如果需要进⾏扩容, ⽐如新增⼀个 3 号分⽚, 就可以针对原有的槽位进⾏重新分配.

比如可以把之前每个分片持有的槽位, 各拿出⼀点, 分给新分片.

⼀种可能的分配⽅式:

• 0 号分⽚: [0, 4095], 共 4096 个槽位

• 1 号分⽚: [5462, 9557], 共 4096 个槽位

• 2 号分⽚: [10924, 15019], 共 4096 个槽位

• 3 号分⽚: [4096, 5461] + [9558, 10923] + [15019, 16383], 共 4096 个槽位

问题1:Redis 集群是最多有 16384 个分片吗?

并⾮如此. 如果⼀个分⽚只有⼀个槽位, 这对于集群的数据均匀其实是难以保证的.

实际上 Redis 的作者建议集群分⽚数不应该超过 1000

⽽且, 16000 这么⼤规模的集群, 本⾝的可⽤性也是⼀个⼤问题. ⼀个系统越复杂, 出现故障的概率是越⾼的.

问题2:为什么是 16384 个槽位?

1.节点之间通过⼼跳包通信. ⼼跳包中包含了该节点持有哪些 slots. 这个是使⽤位图这样的数据结构表⽰的. 表⽰ 16384 (16k) 个 slots, 需要的位图⼤⼩是 2KB. 如果给定的 slots 数更多了, ⽐如 65536 个了, 此时就需要消耗更多的空间, 8 KB 位图表⽰了. 8 KB, 对于内存来说不算什么, 但是在频繁的网络心跳包中, 还是⼀个不⼩的开销的.

2.另⼀⽅⾯, Redis 集群⼀般不建议超过 1000 个分⽚. 所以 16k 对于最⼤ 1000 个分⽚来说是⾜够⽤的, 同时也会使对应的槽位配置位图体积不⾄于很⼤

3.集群搭建(基于 docker)

接下来基于 docker, 搭建⼀个集群. 每个节点都是⼀个容器.

一定要记得,把之前启动 redis 容器,给停止掉。

拓扑结构如下:

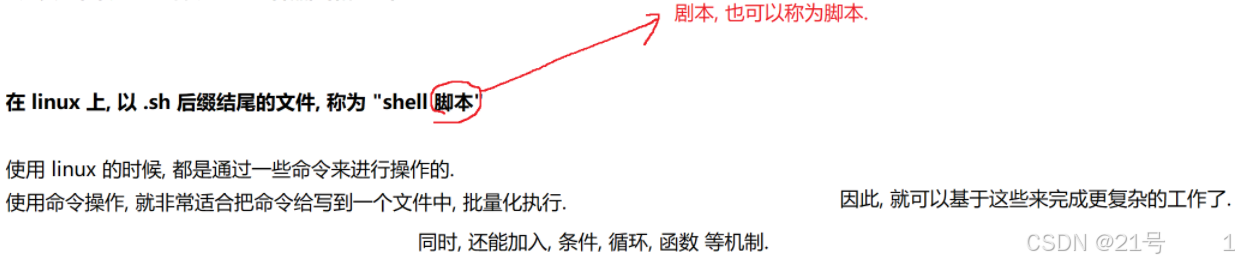

1.创建目录和配置

创建 redis-cluster 目录。内部创建两个文件

sql

redis-cluster/

├── docker-compose.yml

└── generate.sh

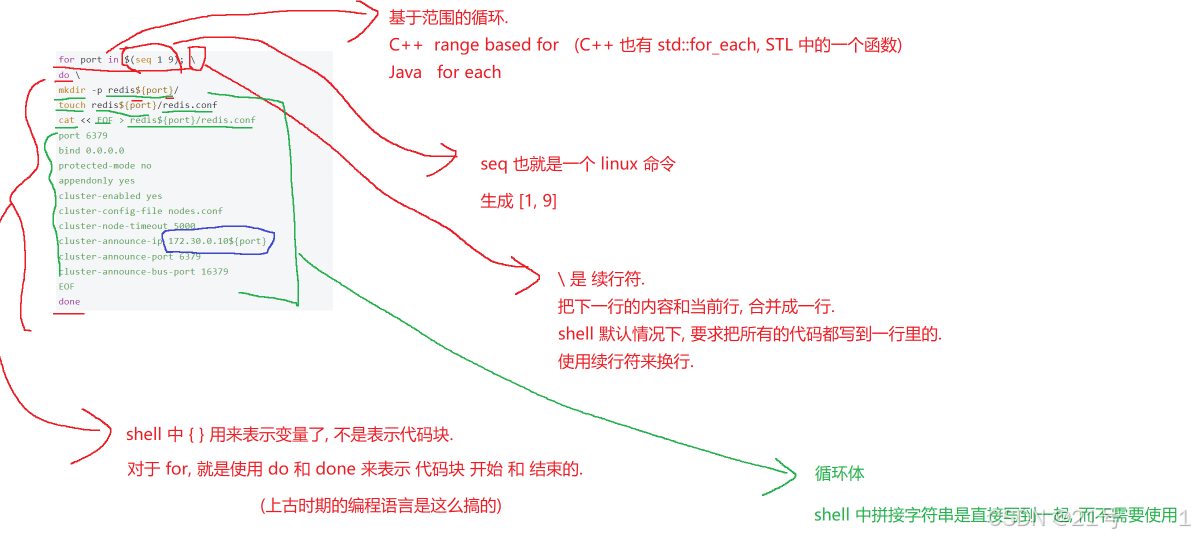

generate.sh 内容如下

sql

for port in $(seq 1 9); \

do \

mkdir -p redis${port}/

touch redis${port}/redis.conf

cat << EOF > redis${port}/redis.conf

port 6379

bind 0.0.0.0

protected-mode no

appendonly yes

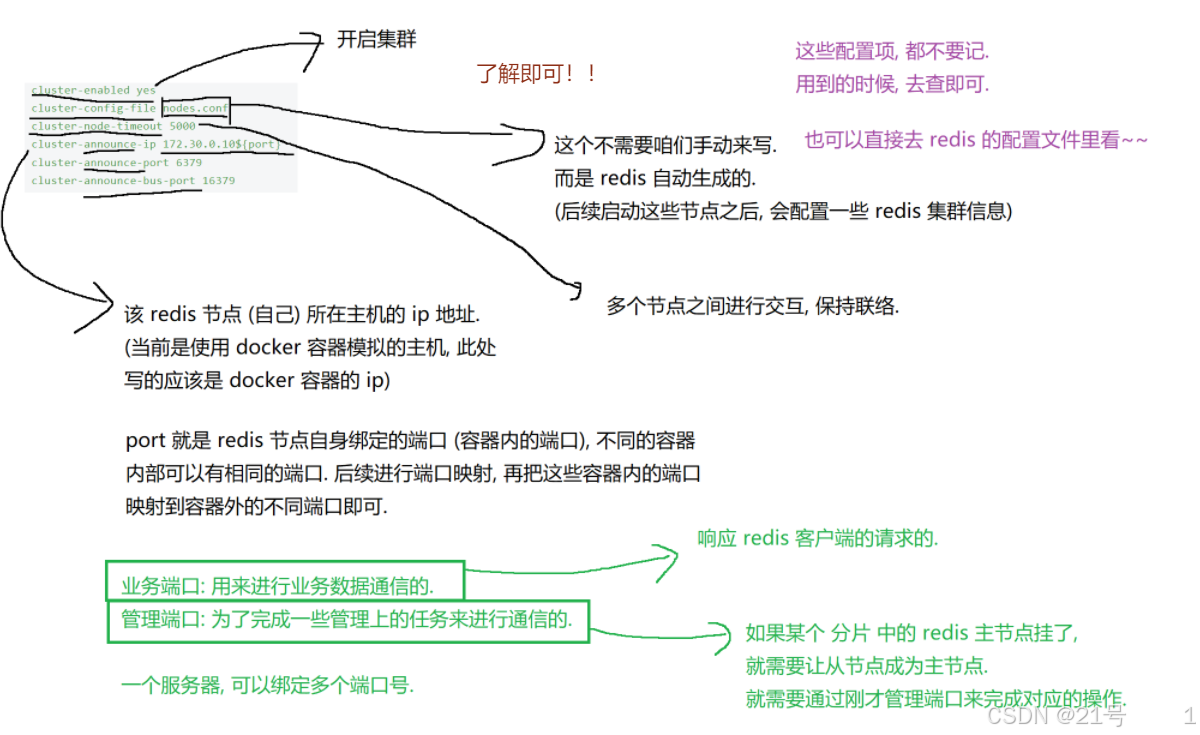

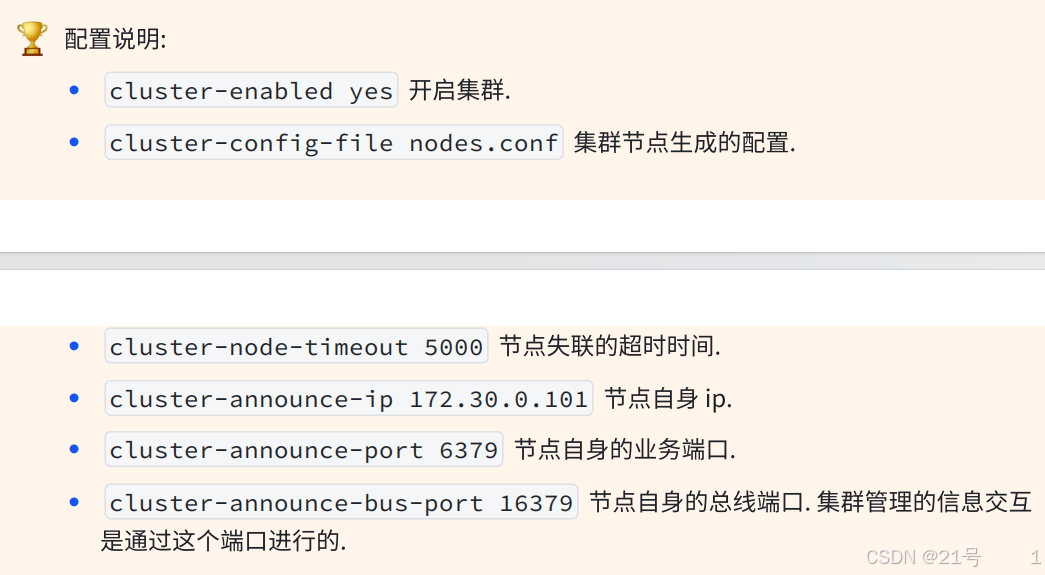

cluster-enabled yes

cluster-config-file nodes.conf

cluster-node-timeout 5000

cluster-announce-ip 172.30.0.10${port}

cluster-announce-port 6379

cluster-announce-bus-port 16379

EOF

done

# 注意 cluster-announce-ip 的值有变化.

for port in $(seq 10 11); \

do \

mkdir -p redis${port}/

touch redis${port}/redis.conf

cat << EOF > redis${port}/redis.conf

port 6379

bind 0.0.0.0

protected-mode no

appendonly yes

cluster-enabled yes

cluster-config-file nodes.conf

cluster-node-timeout 5000

cluster-announce-ip 172.30.0.1${port}

cluster-announce-port 6379

cluster-announce-bus-port 16379

EOF

done

执行命令

sql

bash generate.sh生成目录如下:

sql

redis-cluster/

├── docker-compose.yml

├── generate.sh

├── redis1

│ └── redis.conf

├── redis10

│ └── redis.conf

├── redis11

│ └── redis.conf

├── redis2

│ └── redis.conf

├── redis3

│ └── redis.conf

├── redis4

│ └── redis.conf

├── redis5

│ └── redis.conf

├── redis6

│ └── redis.conf

├── redis7

│ └── redis.conf

├── redis8

│ └── redis.conf

└── redis9

└── redis.conf

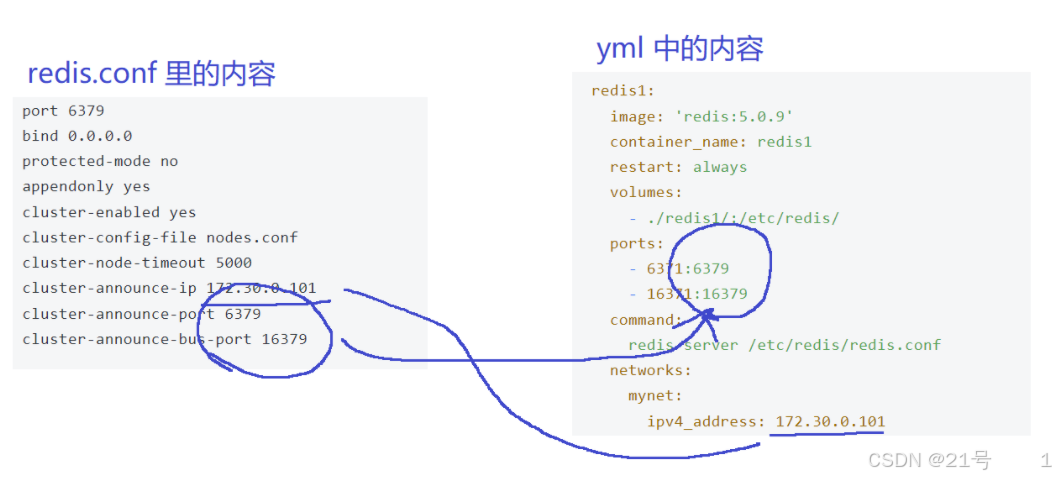

其中 redis.conf 每个都不同. 以 redis1 为例:

区别在于每个配置中配置的 cluster-announce-ip 是不同的, 其他部分都相同.

port 6379

bind 0.0.0.0

protected-mode no

appendonly yes

cluster-enabled yes

cluster-config-file nodes.conf

cluster-node-timeout 5000

cluster-announce-ip 172.30.0.101

cluster-announce-port 6379

cluster-announce-bus-port 16379

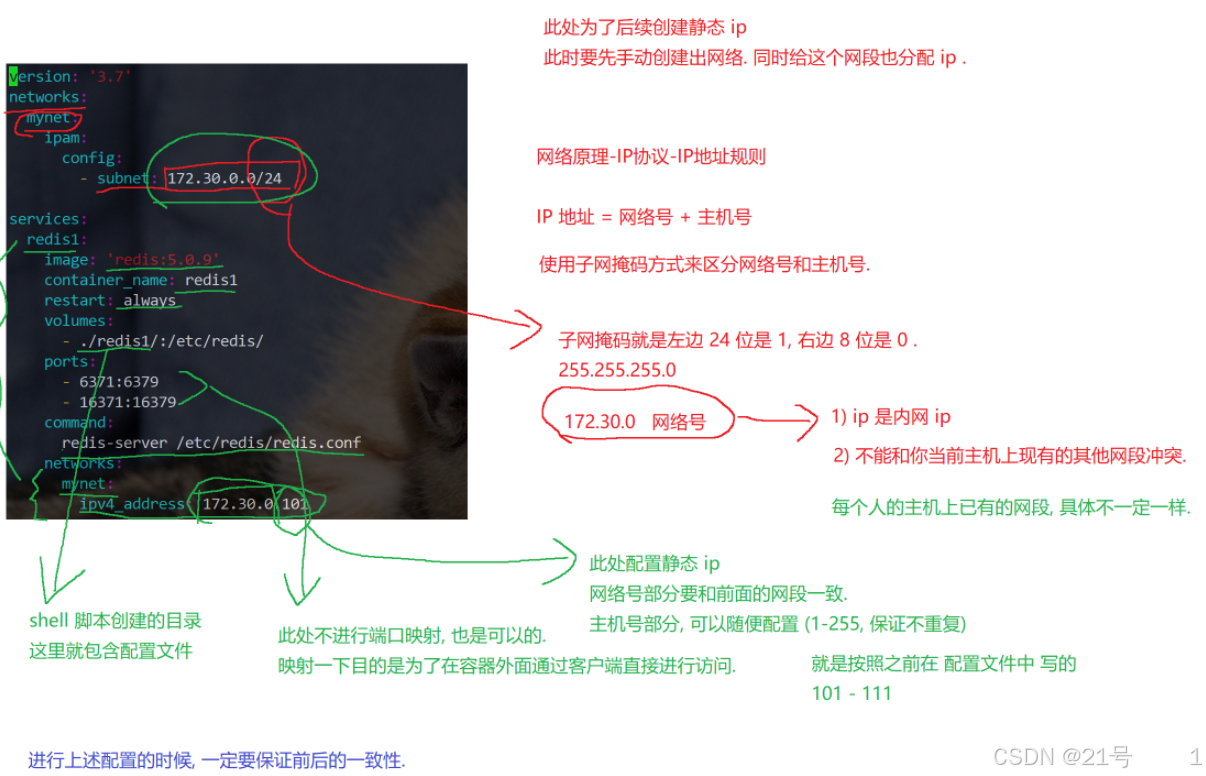

2.编写 docker-compose.yml

1.先创建 networks, 并分配⽹段为 172.30.0.0/24

2.配置每个节点. 注意配置⽂件映射, 端⼝映射, 以及容器的 ip 地址. 设定成固定 ip ⽅便后续的观察和操作.

此处的端⼝映射不配置也可以, 配置的⽬的是为了可以通过宿主机 ip + 映射的端⼝进⾏访问. 通过 容器⾃⾝ ip:6379 的⽅式也可以访问

sql

version: '3.7'

networks:

mynet:

ipam:

config:

- subnet: 172.30.0.0/24

services:

redis1:

image: 'redis:5.0.9'

container_name: redis1

restart: always

volumes:

- ./redis1/:/etc/redis/

ports:

- 6371:6379

- 16371:16379

command:

redis-server /etc/redis/redis.conf

networks:

mynet:

ipv4_address: 172.30.0.101

等等等等3.启动容器

启动之前,一定要把之前已经运行的 redis 啥的都干掉!!

否则就可能因为端口冲突等原因,导致现在的启动失败!!

sql

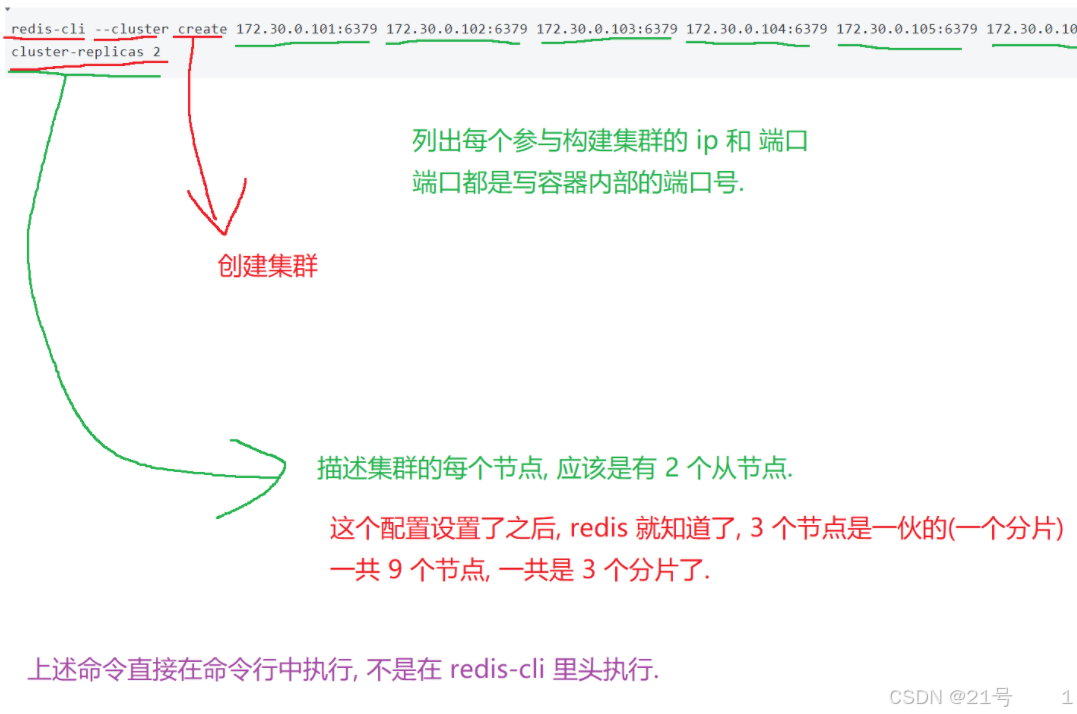

docker-compose up -d4.构建集群

启动⼀个 docker 客⼾端

sql

redis-cli --cluster create 172.30.0.101:6379 172.30.0.102:6379

172.30.0.103:6379 172.30.0.104:6379 172.30.0.105:6379 172.30.0.106:6379

172.30.0.107:6379 172.30.0.108:6379 172.30.0.109:6379 --cluster-replicas 2

-cluster create 表⽰建⽴集群. 后⾯填写每个节点的 ip 和地址.

-cluster-replicas 2 表⽰每个主节点需要两个从节点备份

执⾏之后, 容器之间会进⾏加⼊集群操作,日志中会描述那些是主节点,哪些从节点跟随哪个主节点。

sql

>>> Performing hash slots allocation on 9 nodes...

Master[0] -> Slots 0 - 5460

Master[1] -> Slots 5461 - 10922

Master[2] -> Slots 10923 - 16383

Adding replica 172.30.0.105:6379 to 172.30.0.101:6379

Adding replica 172.30.0.106:6379 to 172.30.0.101:6379

Adding replica 172.30.0.107:6379 to 172.30.0.102:6379

Adding replica 172.30.0.108:6379 to 172.30.0.102:6379

..........

[OK] All nodes agree about slots configuration.

>>> Check for open slots...

>>> Check slots coverage...

[OK] All 16384 slots covered.

此时, 使⽤客⼾端连上集群中的任何⼀个节点, 都相当于连上了整个集群.

• 客⼾端后⾯要加上 -c 选项, 否则如果 key 没有落到当前节点上, 是不能操作的. -c 会⾃动把请求

重定向到对应节点.

• 使⽤ cluster nodes 可以查看到整个集群的情况

# redis-cli -h 172.30.0.101 -p 6379 -c

172.30.0.101:6379> CLUSTER nodes

5f71983ad52cc7077ce8874ae1c4f9c23d9f502c 172.30.0.102:6379@16379 master - 0

1682595474000 2 connected 5461-10922

2e5dc211288784ba55d554a377b87bfe2b5398db 172.30.0.105:6379@16379 slave

e4f37f8f0ea0dafc584349999795716613910e51 0 1682595475158 5 connected

0a889103b35db2a6e82e8c09904bbef310cff3b1 172.30.0.108:6379@16379 slave

5f71983ad52cc7077ce8874ae1c4f9c23d9f502c 0 1682595475560 8 connected

3584840ac704c3ee016f3bdcca3f7ebe6f6e8e80 172.30.0.107:6379@16379 slave

5f71983ad52cc7077ce8874ae1c4f9c23d9f502c 0 1682595474656 7 connected

85025819223f12615046c54d89f510e9cd0444a1 172.30.0.104:6379@16379 slave

b3c0a96f6a206088ecea639147b6fcf903afe872 0 1682595475560 4 connected

e4f37f8f0ea0dafc584349999795716613910e51 172.30.0.101:6379@16379 myself,master

- 0 1682595475000 1 connected 0-5460

00ba82bed6abeb015116d51d1af7fcb1609d03ad 172.30.0.109:6379@16379 slave

b3c0a96f6a206088ecea639147b6fcf903afe872 0 1682595475000 9 connected

29f05d98982bd3df05d0222091e4b8ef9569f424 172.30.0.106:6379@16379 slave

e4f37f8f0ea0dafc584349999795716613910e51 0 1682595474000 6 connected

b3c0a96f6a206088ecea639147b6fcf903afe872 172.30.0.103:6379@16379 master - 0

1682595475659 3 connected 10923-16383

172.30.0.101:6379> set k1 1

-> Redirected to slot [12706] located at 172.30.0.103:6379

OK

172.30.0.103:6379> get k1

"1"4.主节点宕机

⼿动停⽌⼀个 master 节点, 观察效果.

⽐如上述拓扑结构中, 可以看到 redis1 redis2 redis3 是主节点, 随便挑⼀个停掉

连上 redis2 , 观察结果

可以看到, 101 已经提⽰ fail, 然后 原本是 slave 的 105 成了新的 master

如果重新启动 redis1

sql

docker start redis1再次观察结果. 可以看到 101 启动了, 仍然是 slave.

sql

172.30.0.102:6379> CLUSTER NODES

e4f37f8f0ea0dafc584349999795716613910e51 172.30.0.101:6379@16379 slave

2e5dc211288784ba55d554a377b87bfe2b5398db 0 1682603944000 10 connected

0a889103b35db2a6e82e8c09904bbef310cff3b1 172.30.0.108:6379@16379 slave

5f71983ad52cc7077ce8874ae1c4f9c23d9f502c 0 1682603944628 8 connected

29f05d98982bd3df05d0222091e4b8ef9569f424 172.30.0.106:6379@16379 slave

2e5dc211288784ba55d554a377b87bfe2b5398db 0 1682603943625 10 connected

00ba82bed6abeb015116d51d1af7fcb1609d03ad 172.30.0.109:6379@16379 slave

b3c0a96f6a206088ecea639147b6fcf903afe872 0 1682603944126 9 connected

5f71983ad52cc7077ce8874ae1c4f9c23d9f502c 172.30.0.102:6379@16379 myself,master

- 0 1682603944000 2 connected 5461-10922

b3c0a96f6a206088ecea639147b6fcf903afe872 172.30.0.103:6379@16379 master - 0

1682603945030 3 connected 10923-16383

2e5dc211288784ba55d554a377b87bfe2b5398db 172.30.0.105:6379@16379 master - 0

1682603944025 10 connected 0-5460

3584840ac704c3ee016f3bdcca3f7ebe6f6e8e80 172.30.0.107:6379@16379 slave

5f71983ad52cc7077ce8874ae1c4f9c23d9f502c 0 1682603945131 7 connected

85025819223f12615046c54d89f510e9cd0444a1 172.30.0.104:6379@16379 slave

b3c0a96f6a206088ecea639147b6fcf903afe872 0 1682603944628 4 connected

可以使⽤ cluster failover 进⾏集群恢复. 也就是把 101 重新设定成 master. (登录到 101 上执⾏)处理流程

1.故障判定

集群中的所有节点, 都会周期性的使用心跳包进行通信

1.节点 A 给 节点 B 发送 ping 包, B 就会给 A 返回⼀个 pong 包. ping 和 pong 除了 message type

属性之外, 其他部分都是⼀样的. 这⾥包含了集群的配置信息(该节点的id, 该节点从属于哪个分⽚,

是主节点还是从节点, 从属于谁, 持有哪些 slots 的位图...).

2.每个节点, 每秒钟, 都会给⼀些随机的节点发起 ping 包, ⽽不是全发⼀遍. 这样设定是为了避免在节点很多的时候, ⼼跳包也⾮常多(⽐如有 9 个节点, 如果全发, 就是 9 * 8 有 72 组⼼跳了, ⽽且这是按照 N^2 这样的级别增⻓的).

3.当节点 A 给节点 B 发起 ping 包, B 不能如期回应的时候, 此时 A 就会尝试重置和 B 的 tcp 连接, 看能否连接成功. 如果仍然连接失败, A 就会把 B 设为 PFAIL 状态(相当于主观下线)

4.A 判定 B 为 PFAIL 之后, 会通过 redis 内置的 Gossip 协议, 和其他节点进⾏沟通, 向其他节点确认 B 的状态. (每个节点都会维护⼀个⾃⼰的 "下线列表", 由于视⻆不同, 每个节点的下线列表也不⼀定相同).

5.此时 A 发现其他很多节点, 也认为 B 为 PFAIL, 并且数⽬超过总集群个数的⼀半, 那么 A 就会把 B 标记成 FAIL (相当于客观下线), 并且把这个消息同步给其他节点(其他节点收到之后, 也会把 B 标记成FAIL).

至此, B 就彻底被判定为故障节点了.

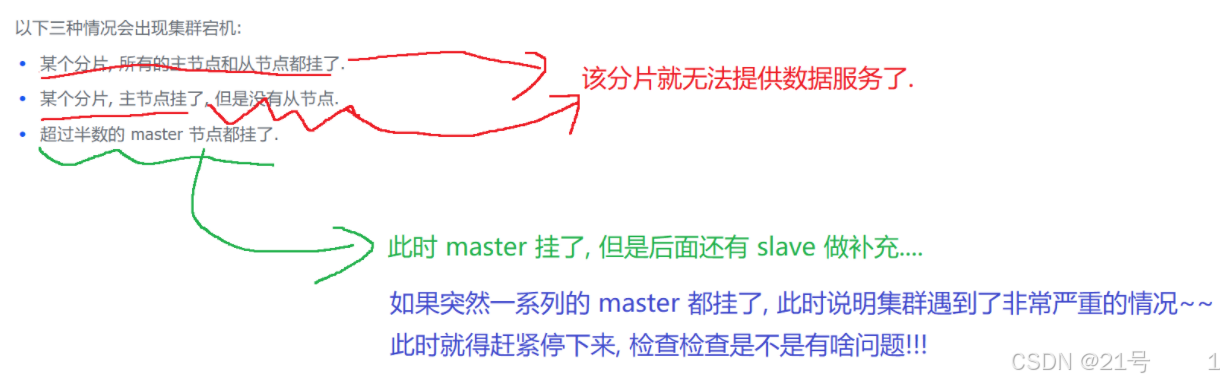

某个或者某些节点宕机,有时会引起整个集群都宕机(称为 fail 状态)

sql

核⼼原则是保证每个 slots 都能正常⼯作(存取数据)

2.故障迁移

上述例⼦中, B 故障, 并且 A 把 B FAIL 的消息告知集群中的其他节点.

• 如果 B 是从节点, 那么不需要进⾏故障迁移.

• 如果 B 是主节点, 那么就会由 B 的从节点 (⽐如 C 和 D) 触发故障迁移了.

所谓故障迁移, 就是指把从节点提拔成主节点, 继续给整个 redis 集群提供⽀持

具体流程如下:

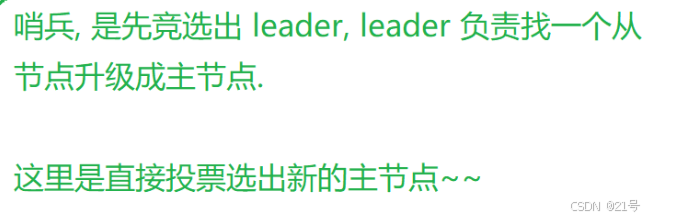

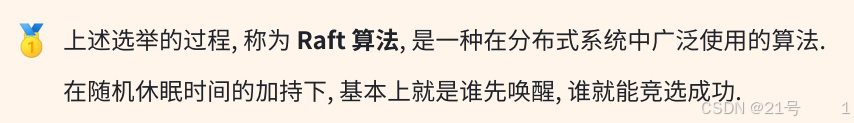

1.从节点判定⾃⼰是否具有参选资格. 如果从节点和主节点已经太久没通信(此时认为从节点的数据和主节点差异太⼤了), 时间超过阈值, 就失去竞选资格.

2.具有资格的节点, ⽐如 C 和 D, 就会先休眠⼀定时间. 休眠时间 = 500ms 基础时间 + [0, 500ms] 随机时间 + 排名 * 1000ms. offset 的值越⼤, 则排名越靠前(越⼩).

3.⽐如 C 的休眠时间到了, C 就会给其他所有集群中的节点, 进⾏拉票操作. 但是只有主节点才有投票资格.

4.主节点就会把⾃⼰的票投给 C (每个主节点只有 1 票). 当 C 收到的票数超过主节点数⽬的⼀半, C 就会晋升成主节点. (C ⾃⼰负责执⾏ slaveof no one, 并且让 D 执⾏ slaveof C).

5.同时, C 还会把⾃⼰成为主节点的消息, 同步给其他集群的节点. ⼤家也都会更新⾃⼰保存的集群结构信息.

5.集群扩容

扩容是⼀个在开发中⽐较常遇到的场景.

随着业务的发展, 现有集群很可能⽆法容纳⽇益增⻓的数据. 此时给集群中加⼊更多新的机器, 就可以使存储的空间更⼤了

所谓分布式的本质,就是使用更多的机器,引入更多的硬件资源

1.把新的主节点加入到集群

上⾯已经把 redis1 - redis9 重新构成了集群. 接下来把 redis10 和 redis11 也加⼊集群

此处我们把 redis10 作为主机, redis11 作为从机

sql

redis-cli --cluster add-node 172.30.0.110:6379 172.30.0.101:6379

此处会先打印出当前集群每个机器的情况,并且要求用户输入要移动多少个 slots

add-node 后的第⼀组地址是新节点的地址. 第⼆组地址是集群中的任意节点地址

执⾏结果

>>> Adding node 172.30.0.110:6379 to cluster 172.30.0.101:6379

>>> Performing Cluster Check (using node 172.30.0.101:6379)

M: 00d319e23ef76a4d51e74600c42ee2a371ae81f6 172.30.0.101:6379

slots:[0-5460] (5461 slots) master

2 additional replica(s)

S: e34911c57d7605903de84ec05b3deac611aaef7e 172.30.0.105:6379

slots: (0 slots) slave

replicates 00d319e23ef76a4d51e74600c42ee2a371ae81f6

S: 6cf48cc11d0171b6ab1b418808473167acd7986e 172.30.0.106:6379

slots: (0 slots) slave

replicates 00d319e23ef76a4d51e74600c42ee2a371ae81f6

S: fd18c7f164b09ec563f4573ec9d6466e6769221e 172.30.0.108:6379

slots: (0 slots) slave

replicates b3f2ba758318f4bd54031c98c01d7a6155ff43d3

M: 579282abe81b3f20ffd17d5a1956cdca3b0e71b0 172.30.0.103:6379

slots:[10923-16383] (5461 slots) master

2 additional replica(s)

S: e9ea79b1326ea5a75a1701d5c12a0f6081c1d043 172.30.0.109:6379

slots: (0 slots) slave

replicates 579282abe81b3f20ffd17d5a1956cdca3b0e71b0

S: 628d1ec9ceef6760b9038c4fbc83ee92430062ac 172.30.0.107:6379

slots: (0 slots) slave

replicates b3f2ba758318f4bd54031c98c01d7a6155ff43d3

M: b3f2ba758318f4bd54031c98c01d7a6155ff43d3 172.30.0.102:6379

slots:[5461-10922] (5462 slots) master

2 additional replica(s)

S: 2a248acb47f0036655397897f9800c70ea22514f 172.30.0.104:6379

slots: (0 slots) slave

replicates 579282abe81b3f20ffd17d5a1956cdca3b0e71b0

[OK] All nodes agree about slots configuration.

>>> Check for open slots...

>>> Check slots coverage...

[OK] All 16384 slots covered.

>>> Send CLUSTER MEET to node 172.30.0.110:6379 to make it join the cluster.

[OK] New node added correctly2.重新分配 slots(槽位)

sql

redis-cli --cluster reshard 172.30.0.101:6379

reshard 后的地址是集群中的任意节点地址.

另外, 注意单词拼写, 是 reshard (重新切分), 不是 reshared (重新分享) , 不要多写个 e

执⾏之后, 会进⼊交互式操作, redis 会提⽰⽤⼾输⼊以下内容:

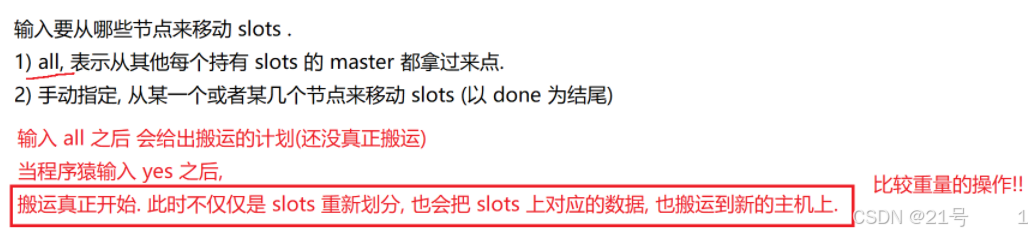

• 多少个 slots 要进⾏ reshard ? (此处我们填写 4096)

• 哪个节点来接收这些 slots ? (此处我们填写 172.30.0.110 这个节点的集群节点 id)

• 这些 slots 从哪些节点搬运过来? (此处我们填写 all, 表⽰从其他所有的节点都进⾏搬运)

执⾏结果如下

How many slots do you want to move (from 1 to 16384)? 4096

What is the receiving node ID? 522a1bd88a1a9084e6919fa88f4bf1c3655ad837

Please enter all the source node IDs.

Type 'all' to use all the nodes as source nodes for the hash slots.

Type 'done' once you entered all the source nodes IDs.

Source node #1: all

确定之后, 会初步打印出搬运⽅案, 让⽤⼾确认.

之后就会进⾏集群的 key 搬运⼯作. 这个过程涉及到数据搬运. 可能需要消耗⼀定的时间.

在搬运 key 的过程中, 对于那些不需要搬运的 key, 访问的时候是没有任何问题的. 但是对于需

要搬运的 key, 进⾏访问可能会出现短暂的访问错误 (key 的位置出现了变化).

随着搬运完成, 这样的错误⾃然就恢复了.

3.给新的主节点添加从节点

光有主节点了, 此时扩容的⽬标已经初步达成. 但是为了保证集群可⽤性, 还需要给这个新的主节点添加从节点, 保证该主节点宕机之后, 有从节点能够顶上

sql

redis-cli --cluster add-node 172.30.0.111:6379 172.30.0.101:6379

--clusterslave --cluster-master-id [172.30.1.110 节点的 nodeId]6.集群缩容(了解)

扩容是⽐较常⻅的, 但是缩容其实⾮常少见

1.删除从节点

此处删除的节点 nodeId 是 111 节点的 id.

sql

# redis-cli --cluster del-node [集群中任⼀节点ip:port] [要删除的从机节点 nodeId]

redis-cli --cluster del-node 172.30.0.101:6379

03f4a97806a0d3de2299cc16e6a3559f0c832bc1

>>> Removing node 03f4a97806a0d3de2299cc16e6a3559f0c832bc1 from cluster

172.30.0.101:6379

>>> Sending CLUSTER FORGET messages to the cluster...

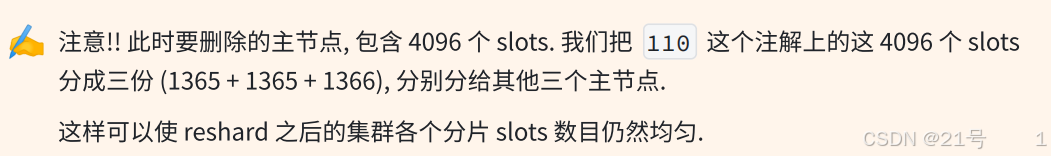

>>> SHUTDOWN the node.2.重新分配 slots

sql

redis-cli --cluster reshard 172.30.0.101:6379

执⾏后仍然进⼊交互式操作

sql

第⼀次重分配: 分配给 101 1365 个 slots

接收 slots 的 nodeId 填写 101 的 nodeId. Source Node 填写 110 的 nodeId

How many slots do you want to move (from 1 to 16384)? 1365

What is the receiving node ID? 3397c6364b43dd8a8d49057ad37be57760d3a81f

Please enter all the source node IDs.

Type 'all' to use all the nodes as source nodes for the hash slots.

Type 'done' once you entered all the source nodes IDs.

Source node #1: 7c343b7e3f82f2e601ac6b9eba9f846b3065c600

Source node #2: done

第⼆次重分配: 分配给 102 1365 个 slots 同上

第三次重分配: 分配给 103 1366 个 slots 同上

接收 slots 的 nodeId 填写 103 的 nodeId. Source Node 填写 110 的 nodeId

此时查看集群状态, 可以看到 110 节点已经不再持有 slots 了.

127.0.0.1:6379> CLUSTER NODES

26e98f947b99b3a2a5da5a7c3ed3875ae9cf366c 172.30.0.103:6379@16379 master - 0

1683187990000 13 connected 6826 10923-16383

ee283a923b77fda2e370ff4463cbb22047f261f7 172.30.0.108:6379@16379 slave

98736357a53c85aaebb31fa5ad286ab36b862426 0 1683187991544 12 connected

98736357a53c85aaebb31fa5ad286ab36b862426 172.30.0.102:6379@16379 master - 0

1683187991544 12 connected 5461-6825 6827-10922

b951da5c3573eec5db2926e022302188a8b686a6 172.30.0.107:6379@16379 slave

98736357a53c85aaebb31fa5ad286ab36b862426 0 1683187991645 12 connected

df193127f99c59999e14518ff7235faeb7b7e8e7 172.30.0.104:6379@16379 slave

26e98f947b99b3a2a5da5a7c3ed3875ae9cf366c 0 1683187990000 13 connected

7c343b7e3f82f2e601ac6b9eba9f846b3065c600 172.30.0.110:6379@16379 master - 0

1683187991000 10 connected

3d148089278f9022a62a5936022e9c086fb7a062 172.30.0.105:6379@16379 slave

3397c6364b43dd8a8d49057ad37be57760d3a81f 0 1683187990540 11 connected

6de544df01337d4bbdb2f4f69f4c408314761392 172.30.0.109:6379@16379 myself,slave

26e98f947b99b3a2a5da5a7c3ed3875ae9cf366c 0 1683187990000 9 connected

3397c6364b43dd8a8d49057ad37be57760d3a81f 172.30.0.101:6379@16379 master - 0

1683187990640 11 connected 0-5460

3b47ebc9868bbda018d8a5b926256861bb800cdc 172.30.0.106:6379@16379 slave

26e98f947b99b3a2a5da5a7c3ed3875ae9cf366c 0 1683187991544 13 connected3.删除主节点

把 110 节点从集群中删除

sql

# redis-cli --cluster del-node [集群中任⼀节点ip:port] [要删除的从机节点 nodeId]

redis-cli --cluster del-node 172.30.0.101:6379

7c343b7e3f82f2e601ac6b9eba9f846b3065c600

>>> Removing node 7c343b7e3f82f2e601ac6b9eba9f846b3065c600 from cluster

172.30.0.101:6379

>>> Sending CLUSTER FORGET messages to the cluster...

>>> SHUTDOWN the node.再次查看集群节点信息, 110 节点已经不在集群中了 CLUSTER nodes