无需改变架构,仅通过创新训练策略,就让视觉语言模型具备了与专业视觉模型相媲美的三维感知能力

无需改变架构,仅通过创新训练策略,就让视觉语言模型具备了与专业视觉模型相媲美的三维感知能力

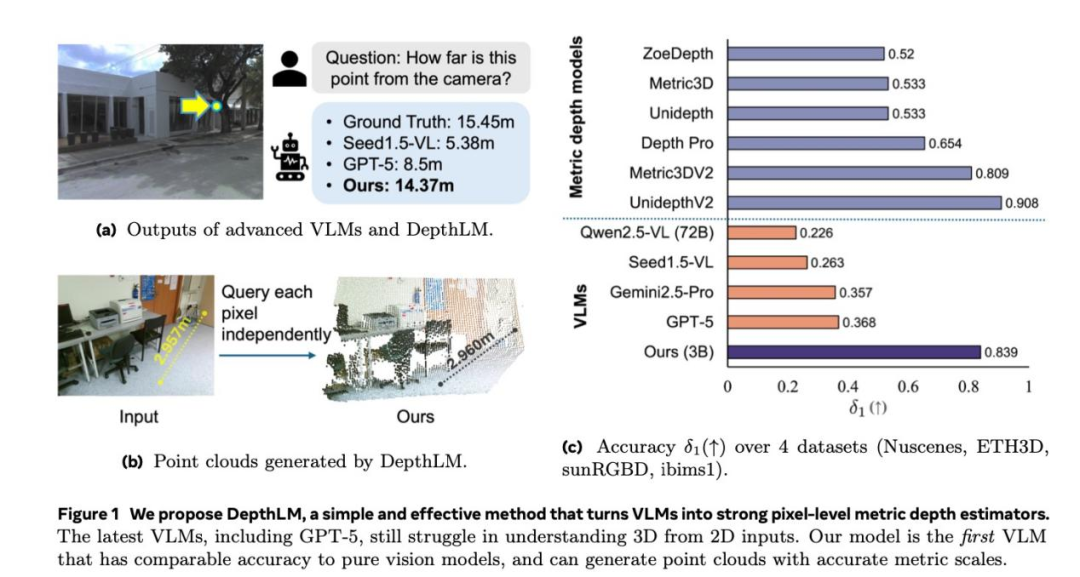

在多模态人工智能蓬勃发展的今天,一项突破性研究正悄然改写我们对视觉语言模型的认知边界。Meta公司高级研究员蔡志鹏及其团队近日发布的全新研究成果------DepthLM,首次证明了视觉语言模型无需改变标准架构,即可在三维空间理解任务上达到与专门纯视觉模型相媲美的水平。

这项研究标志着视觉语言模型迈出了通向真实空间理解的重要一步,为多模态AI发展开辟了全新路径。

论文 链接 :

https://arxiv.org/abs/2509.25413

代码仓库 :

一、三维理解:VLM的长期困境

视觉语言模型近年来在语义理解、视觉问答等任务上展现出惊人能力,能够通过"看图+文字交互"处理多种复杂任务。然而,当涉及从二维图像理解三维空间结构时,即使是目前最先进的VLM,在绝对深度估计等任务上的表现也远远落后于专门设计的纯视觉模型。

这一瓶颈长期困扰着研究界:是否VLM在架构上就注定了其在三维理解方面的局限性?是否必须通过修改模型架构或损失函数才能突破这一限制?

二、DepthLM的突破:不改架构,也能理解三维

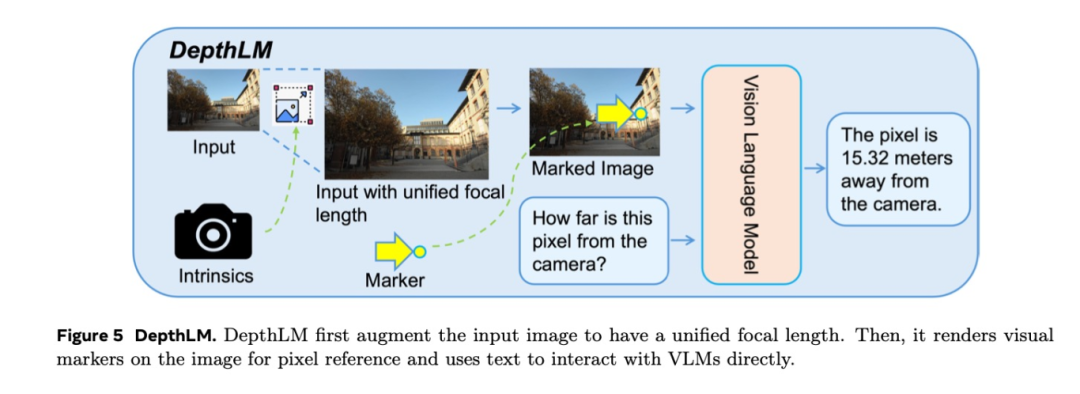

DepthLM的出现彻底改写了这一格局。蔡志鹏团队发现,VLM并非缺乏深度能力,而是缺少合适的空间提示与统一的视觉尺度。通过在训练和提示阶段引入极小的修改,他们证明了标准VLM同样可以学习精确的三维关系。

这一突破的核心在于三项关键技术:

-

**视觉提示:**在图像上直接标注目标像素位置的小标记,使模型能够"看见"而非"阅读"坐标,极大提升了空间定位精度

-

**内参归一化增强:**统一相机内参,消除焦距差异带来的尺度偏移,确保模型在不同设备采集的图像上都能保持稳定的性能

-

**稀疏监督:**每张图仅需1-2个像素标注,仍能训练出高精度深度模型,大幅降低数据成本,使技术落地更加可行

在这些策略下,DepthLM无需额外的密集预测头或复杂损失设计,就能自然地获得像素级深度估计能力。这不仅首次证明了传统视觉模型依赖的密集预测头、复杂损失和专门架构均非实现空间感知的必要条件,也使得DepthLM能够自然支持灵活的基于语言的多任务训练。

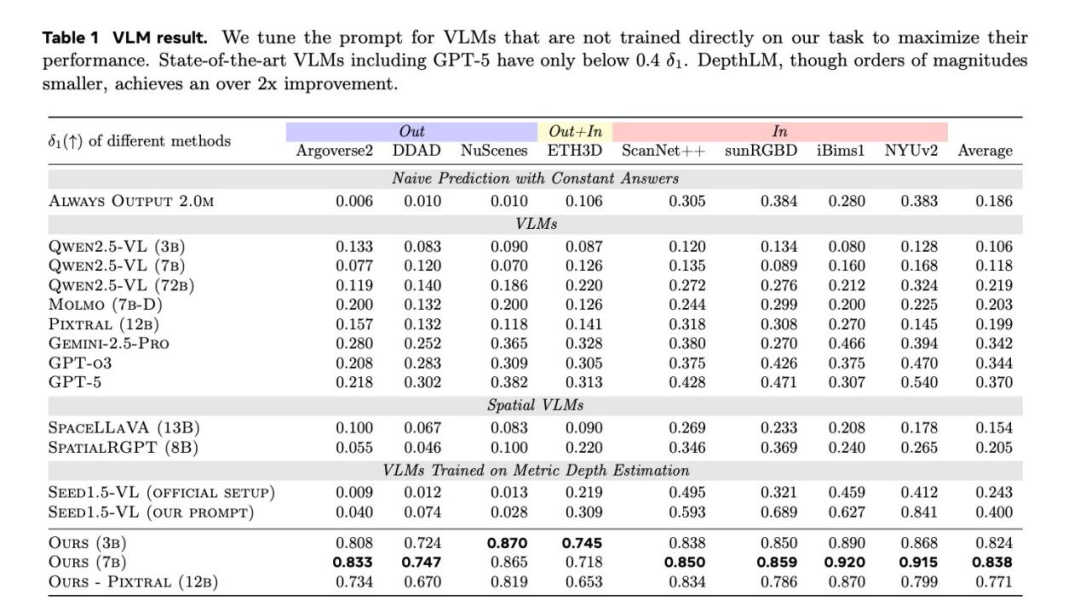

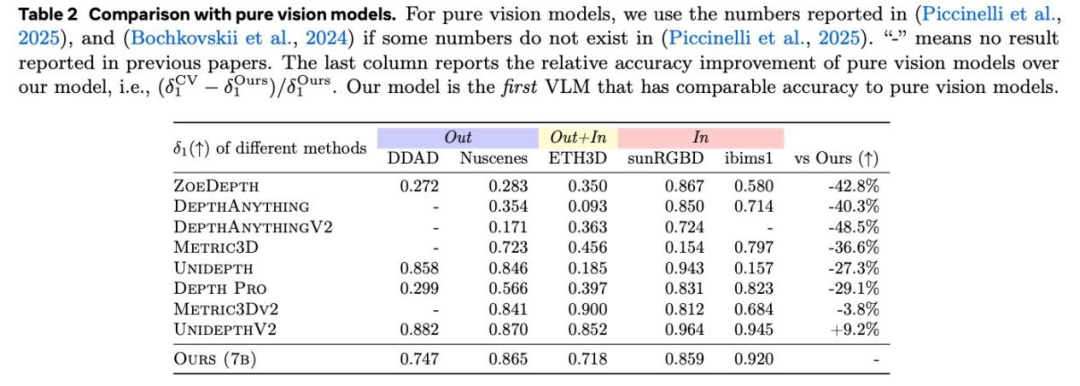

三、性能表现:首次让VLM逼近纯视觉专家模型

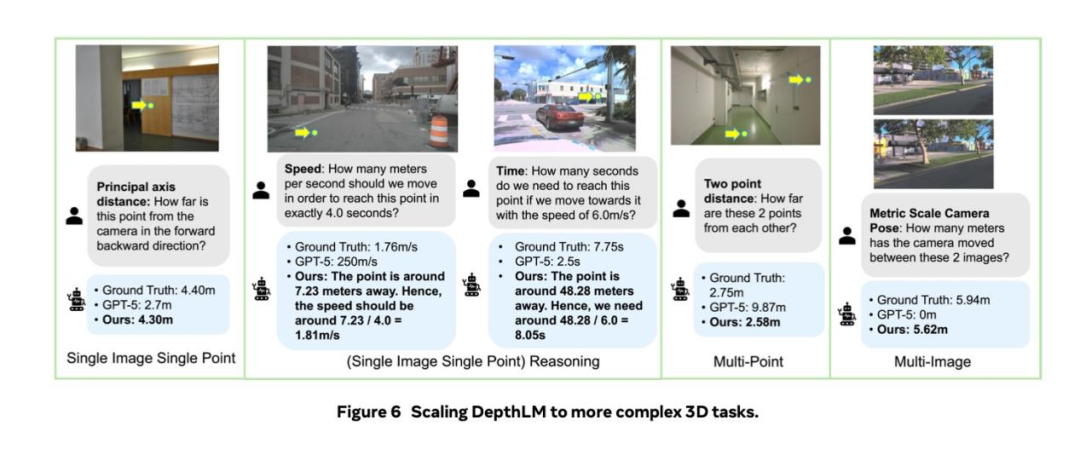

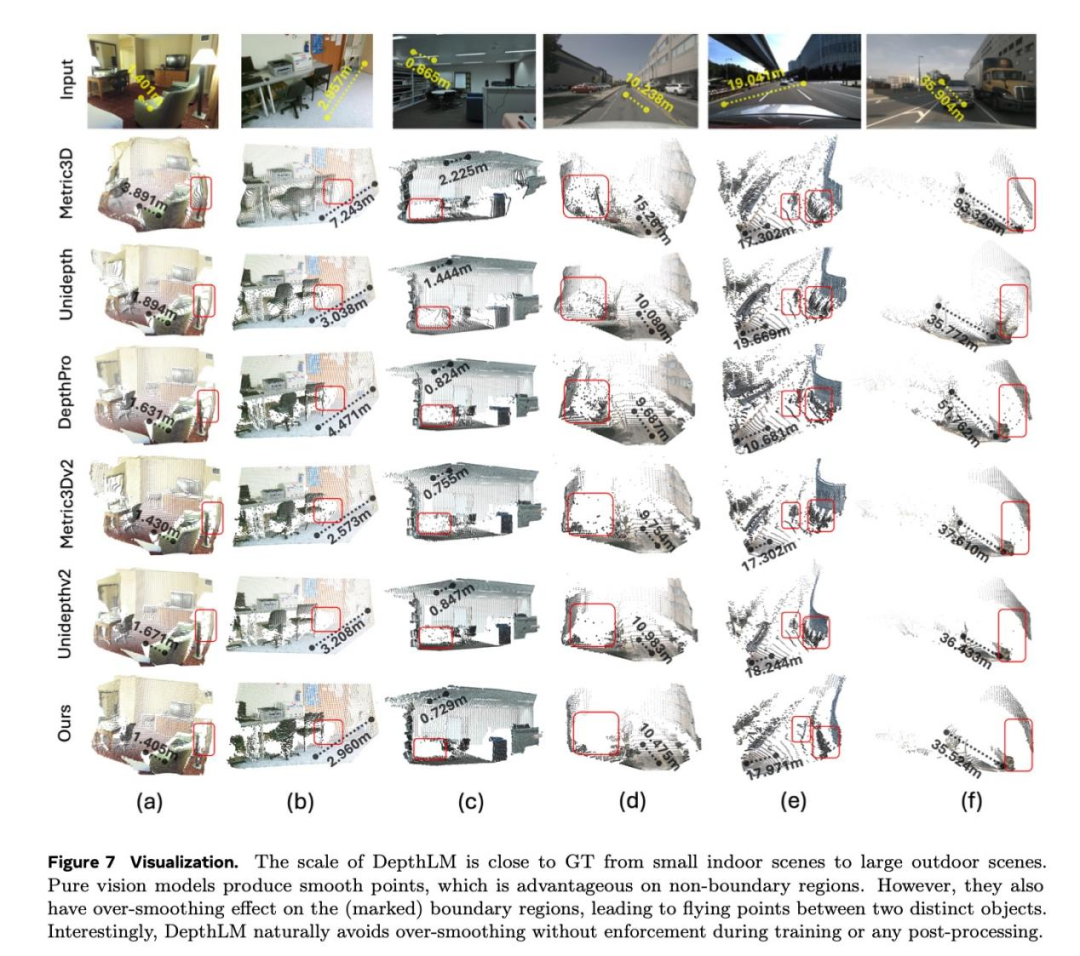

实验结果显示,DepthLM在多个标准数据集上的绝对深度估计任务中,达到了与专门训练的纯视觉模型相当的精度水平,在某些指标上甚至表现出优势。

更令人惊讶的是,在未使用任何正则化或后处理的情况下,DepthLM生成的深度图更"干净":在边缘处的"飞点"数量明显少于传统模型,显示出自然的几何一致性。

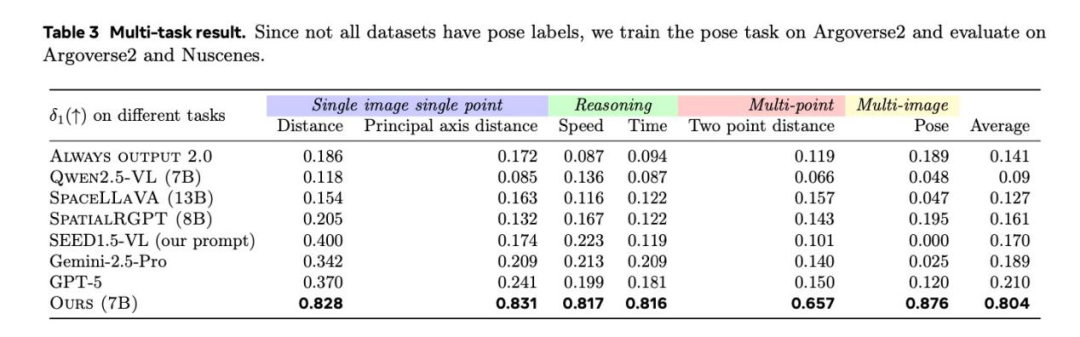

此外,DepthLM还扩展到五类典型三维任务(如速度、时间、相机姿态估计等),同样表现出卓越的泛化能力。研究团队同步推出了一个名为DepthLMBench的综合基准,用于系统评估VLM的三维能力。

四、应用前景:从自动驾驶到机器人技术的变革潜力

DepthLM的突破为多个前沿领域带来了革命性前景:

-

**自动驾驶:**能够同时理解场景语义和三维结构的模型,可以更准确地判断障碍物距离和道路几何,提升行车安全

-

**机器人技术:**具备丰富空间认知能力的系统可以更自然地进行物体抓取和导航任务,实现更精准的人机协作

-

**AR/VR领域:**精准的深度感知能力可以大幅提升虚拟与现实融合的自然度和沉浸感

与传统纯视觉模型相比,DepthLM的最大优势在于其多模态融合能力。它不仅能"看到"深度,还能理解场景中的物体含义、相互关系,并将这些信息用于复杂的决策过程,这更接近人类的空间认知方式。

五、开源的意义:推动多模态AI进程

Meta已全面开源DepthLM模型,包括论文、代码和预训练模型,这一举措将加速整个行业在多模态AI领域的创新步伐。研究人员和开发者可以在其基础上进一步探索VLM在三维理解、空间推理等方面的潜力,推动技术向更通用、更智能的方向发展。

这一开源决定也体现了对开放科学精神的承诺,有助于防止前沿技术被少数公司垄断,促进健康、共赢的AI研发生态。

六、未来展望:通向通用人工智能的重要一步

DepthLM的成功验证了一个重要假设:通过恰当的训练方法,现有模型架构可能蕴含着远超出我们当前认知的潜力。这为多模态AI的未来发展提供了新思路------与其不断设计更复杂的专用模型,不如深入挖掘现有架构的潜在能力。

这项研究为未来的多模态AI提供了新的方向:更低的标注成本、更强的任务通用性和更广的落地潜力。随着DepthLM开创的这一路径被进一步探索,我们有理由相信,视觉语言模型将在更多传统上被认为需要专门架构的任务上实现突破,向真正的通用人工智能迈出坚实步伐。

这场三维理解革命才刚刚开始,但它已经为我们揭示了多模态AI令人兴奋的未来图景:一个模型,多种能力,无限可能。