苹果在大模型和大模型应用上总是慢人一步。

Apple Intelligence 发布也已经一年多了,除去其仍未能在国行设备上提供服务外,功能上也很难称得上有多好用。

就拿视觉生成类功能举例子,苹果的图像生成大概是这个画风:

但在开放研究领域里,苹果似乎一整个脱胎换骨,在纯粹的研究中经常会有一些出彩的工作。

但这次苹果发布的研究成果的确出人意料:

他们用谷歌的 Nano-banana 模型做个了视觉编辑领域的 ImageNet。

对于苹果用纳米香蕉和 Gemini 的事情,引发了网友遐想:

在文本引导的图像编辑的工作中,GPT4-o 和谷歌 Nano-banana 都能够实现令人惊艳的编辑效果,保留原图像的特征,实现高质量的新图像的生成。尤其是 Nano-banana,真正能被成为图像编辑的里程碑和新标杆。

但目前在研究界仍然缺乏针对图像编辑的,来自真实图像的大规模,高质量的开放数据集。

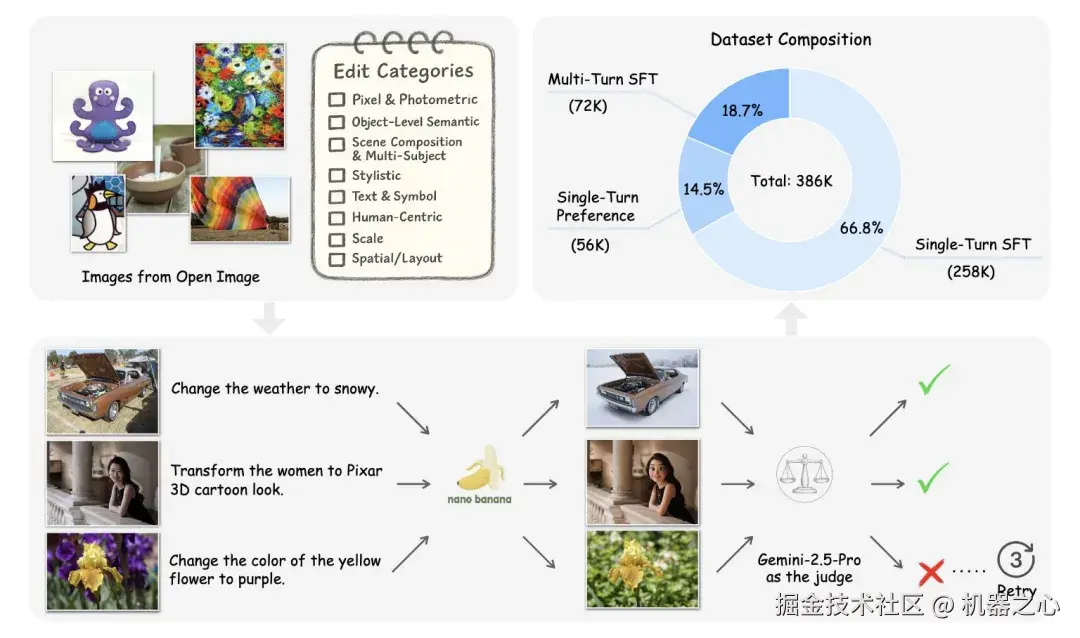

为此,来自苹果的研究团队提出 Pico-Banana-400K,一个包含 40 万张图像的基于指令的图像编辑综合数据集。

-

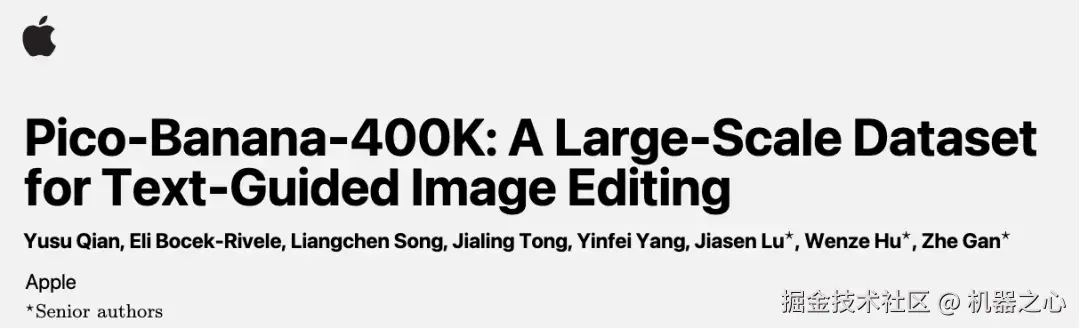

论文标题:Pico-Banana-400K: A Large-Scale Dataset for Text-Guided Image Editing

该数据集通过利用 Nano-Banana 在 OpenImages 实拍照片上生成多样化的编辑对构建而成。

与以往的合成数据集不同,Pico-Banana-400K 的独特之处在于对质量与多样性的系统化设计。苹果的研究团队采用精细的图像编辑分类体系,以确保编辑类型的全面覆盖;并通过基于多模态大模型的质量评分与人工精筛,实现内容一致性与指令忠实性的平衡。

数据集构成

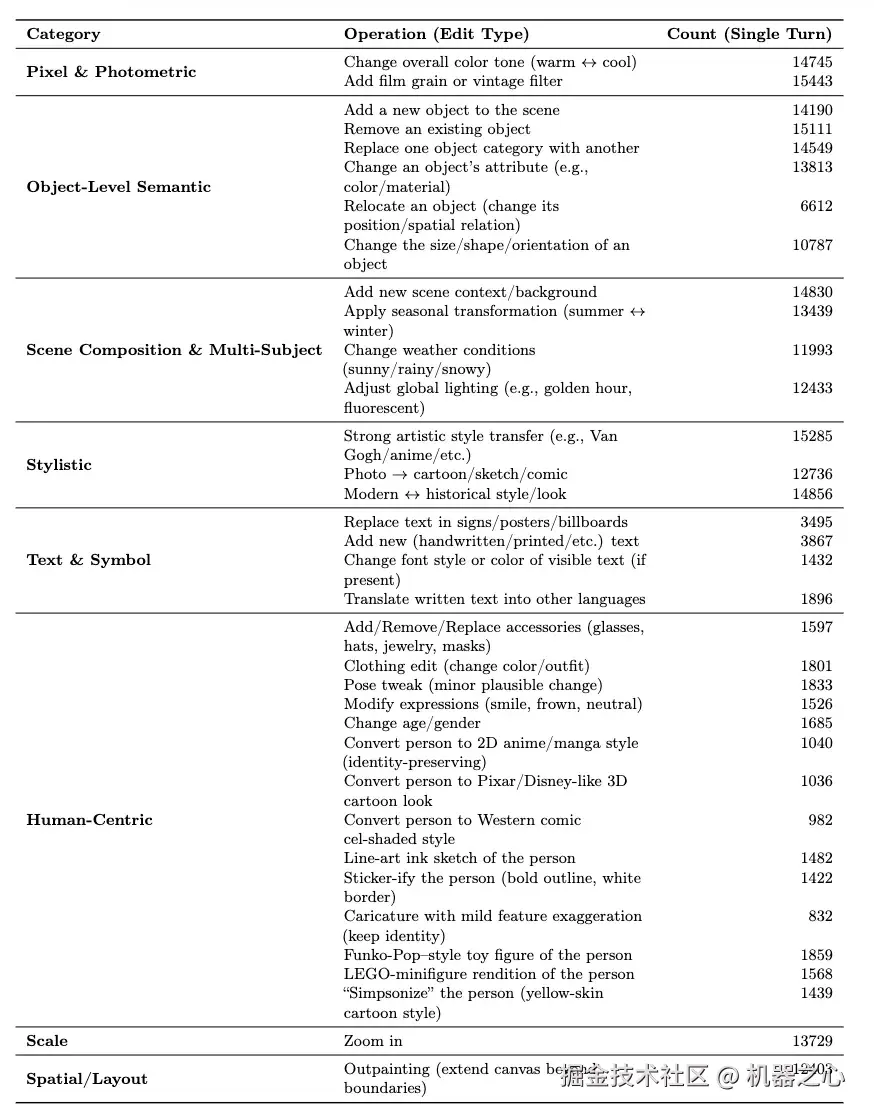

单轮监督微调 (SFT) 子集包含 25.8 万个成功的单轮图像编辑示例,作为遵循指令的图像编辑模型的核心训练数据。此子集涵盖了 35 种编辑分类法的全部范围,并为模型训练提供强大的监督信号。

除了单轮编辑外,Pico-Banana-400K 还支持复杂的多轮编辑研究。数据集包含三个专门子集:

72K 多轮编辑集 ------ 用于研究连续修改中的顺序编辑、推理与规划;

多轮 SFT 子集包含 7.2 万个按顺序进行的编辑交互示例,序列长度从 2 到 5 轮不等。对于每张采样的图像,随机选择 1-4 种额外的编辑类型以形成连贯的编辑序列。Gemini-2.5-Pro 为每一轮生成上下文感知指令,鼓励使用指代性语言以保持语篇连续性。该子集支持对迭代细化、上下文相关编辑以及跨多个编辑步骤的复杂推理进行研究。

56K 偏好集 ------ 用于对齐研究与奖励模型训练;

偏好子集包含 5.6 万个示例,由原始图像、指令、成功编辑和失败编辑组成的三联体。这种独特的资源专为对齐研究而设计,可用于训练奖励模型和应用直接偏好优化(DPO)等对齐技术。这解决了现有数据集的一个关键空白,因为现有数据集通常只提供成功的编辑,而缺乏对比性的低质量编辑示例。

长短指令配对集 ------ 用于发展指令重写与摘要能力。

通过提供这一大规模、高质量且任务丰富的资源,Pico-Banana-400K 为训练和评测新一代文本引导图像编辑模型奠定了坚实基础。

苹果不仅发布了一个数据集,还构建了一个能够自我编辑和评估的完整流程:

纳米香蕉负责进行编辑。Gemini 2.5 Pro 负责评判结果,失败会自动重试,直到通过。该流程真正实现端到端运行,全程无需人工干预。

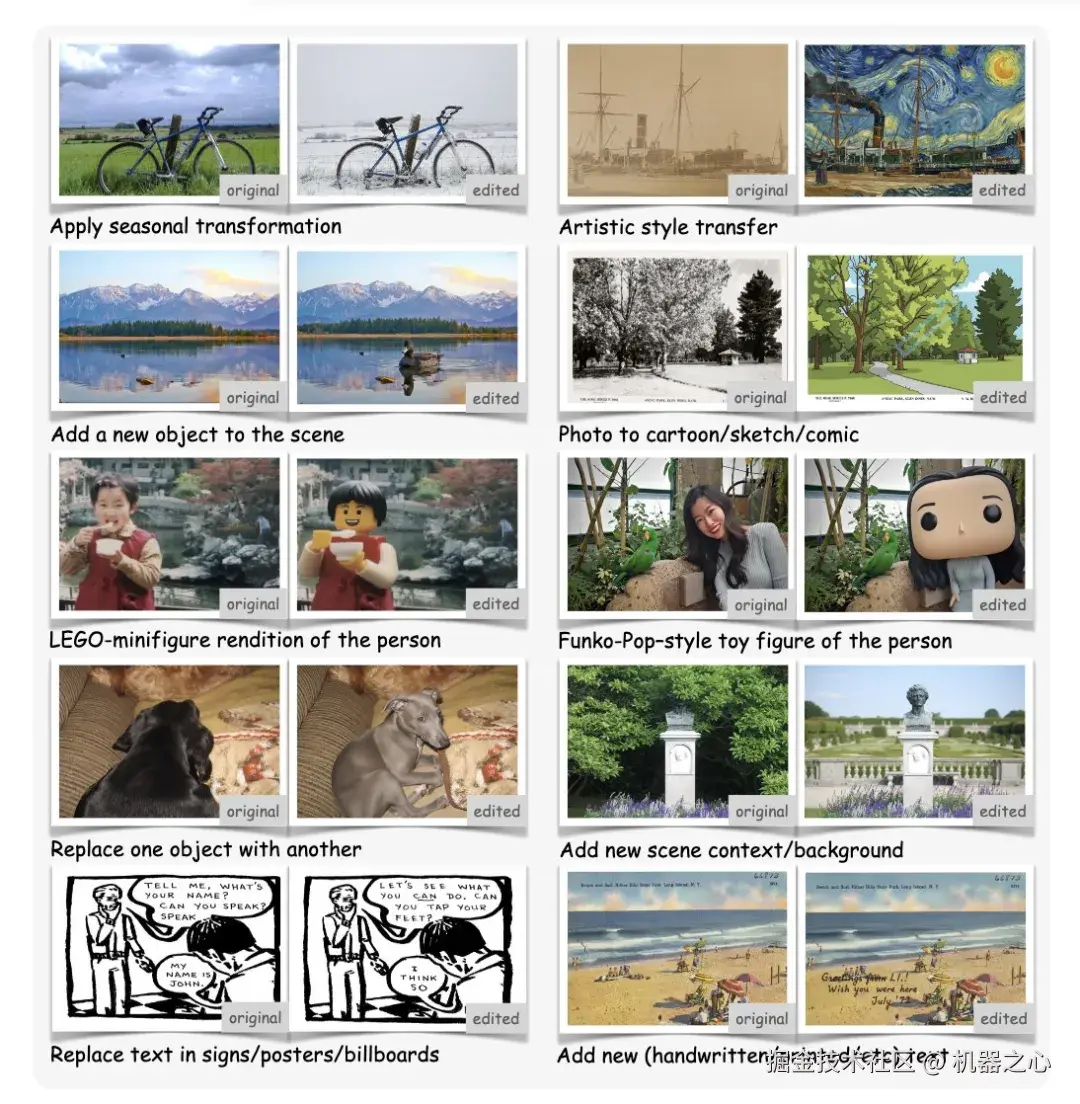

来自 Pico-Banana-400K 数据集的单轮文本引导图像编辑示例。每一对图像展示了编辑结果(右)及其对应的原始图像(左)。该数据集涵盖多种编辑类型,包括光度调整、物体级操作、风格化变换以及场景或光照修改等。

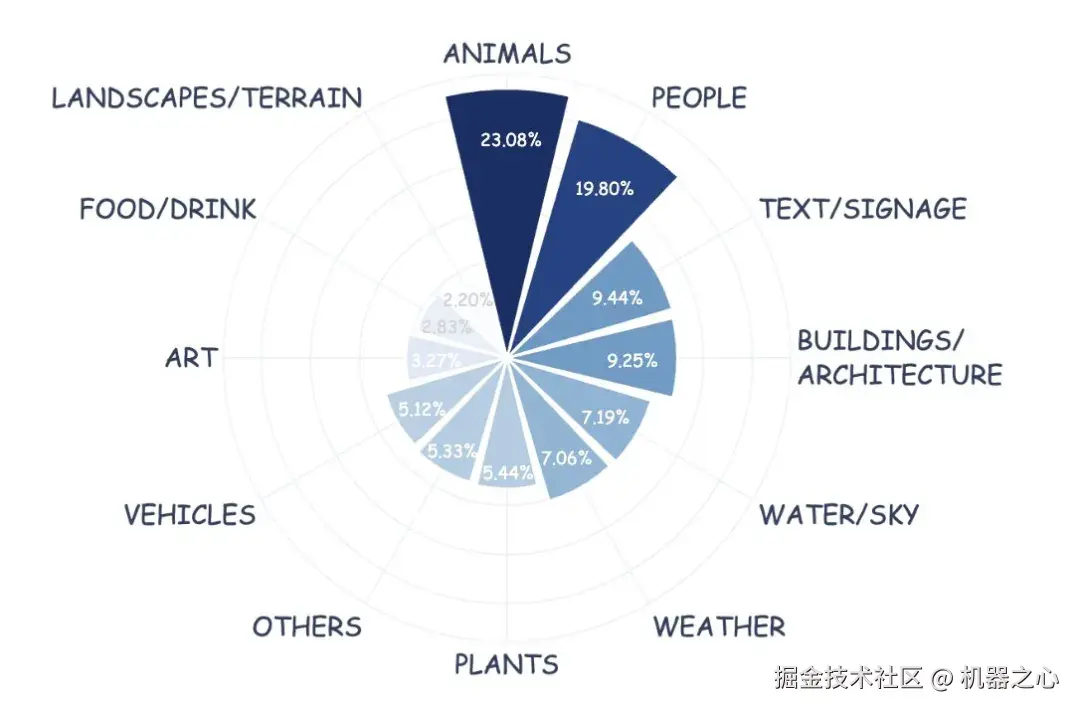

图像编辑指令内容的分布情况

该数据集系统地映射为 35 种现实世界的编辑类型,涵盖了从全局色调变化到人类风格化和物体重新定位等所有方面。这就像向人工智能传授所有存在的 Photoshop 技能一样。

图像编辑分类。

如上表所示,每种操作都归属于其对应的类别。Count 表示在单轮编辑子集中,经 Gemini-2.5-Pro 评估器判定(符合指令且具备视觉质量)并在最多三次尝试内成功的样本数量。

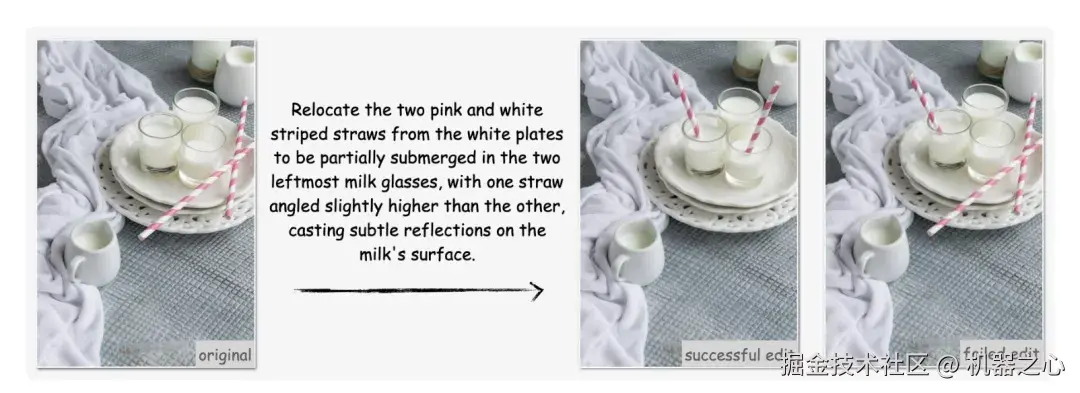

若某个(图像,指令)对在三次生成尝试中全部失败,则被视为失败案例,并从公开数据集中剔除。若在获得成功结果前经历了一到两次失败尝试,则这些失败的编辑结果也会被保留下来,用于构建偏好数据(preference data)。

这里是一个很巧妙的地方,苹果保留了失败的编辑结果。

每个失败的编辑都与成功的编辑配对。因此,在该数据集上,不再只是训练模型「做得更好」,而是训练它们知道「更好」是什么样的。这是一种在多模态系统中构建判断力的方法。

偏好三元组示例。 从左至右依次为:原始图像、中间面板中的自然语言指令(要求将粉白色吸管移动到最左边的玻璃杯中),以及模型生成的两种结果:一种是成功的编辑,准确完成了指令并保持了场景一致性;另一种是失败的编辑,未正确执行指令(位置或几何关系错误)。

偏好子集是该领域中一项极具价值的贡献。通过系统地收集成功与失败的编辑尝试,该数据集为人类对齐与偏好学习研究提供了可能。

失败的编辑通常表现出一些常见的失误类型,例如未能完整遵循指令、出现视觉伪影或与原图内容融合不佳。这些数据可用于训练能够理解人类编辑质量判断的奖励模型,或用于应用 DPO 等技术,从而提升模型与人类偏好的对齐程度。

数据分析

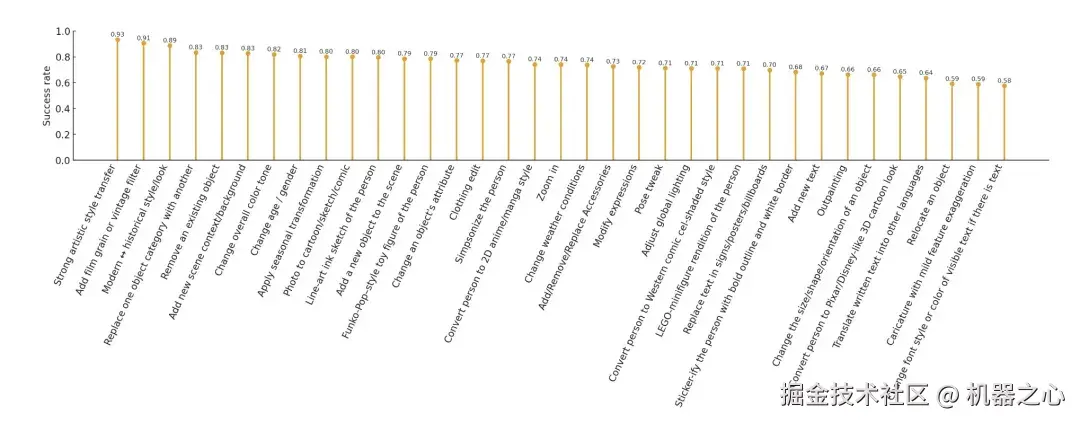

各编辑类型的成功率

研究团队评估了数据集中不同编辑类型的成功率。如图所示,呈现出一致的规律:全局外观和风格编辑较为容易,而需要精细空间控制、布局或符号一致性的编辑仍然具有挑战性。

容易:全局编辑与风格化

全局编辑的可靠性最高。强艺术风格迁移的成功率为 0.9340,胶片颗粒 / 复古效果为 0.9068,现代↔历史风格互转为 0.8875。这些操作主要调整全局纹理、色彩统计和色调,对空间推理或显式目标协调的需求较低。

中等:对象语义与场景上下文

语义上有针对性但较粗粒度的编辑总体表现稳健。移除物体的成功率为 0.8328,替换类别为 0.8348。场景级修改(如季节变换 0.8015、照片→卡通 / 素描 0.8006)表现相似。典型失败案例源于仅文本条件下定位不准确(例如误改相邻区域)或轻微的颜色 / 纹理漂移。

困难:精确几何、布局与文字编辑

需要精细空间控制或符号正确性的编辑可靠性最低。移动物体最为困难,成功率仅 0.5923;改变尺寸 / 形状 / 方向为 0.6627,常出现透视不一致或拓扑断裂。外延绘制(outpainting) 的成功率为 0.6634,常在边界连续性上出现问题。

文字编辑尤为脆弱:更改字体 / 样式的成功率最低,仅 0.5759;而翻译、替换或添加文本也不稳定,反映出在真实感图像中保持字形完整性、对齐和对比度的困难。

在人类风格化编辑中,皮克斯 / 迪士尼式 3D 风格(0.6463)和漫画夸张风格(0.5884)往往出现身份漂移或阴影伪影,尤其在形变较大时更明显。

排版仍然是多模态人工智能迄今为止最难的问题。

总结

该论文的主要贡献有:

-

大规模可共享数据集:发布了 Pico-Banana-400K,包含约 40 万个基于真实图像构建的高质量图像编辑示例。数据集依据 35 类编辑类型分类体系 进行系统组织,并通过自动化评分与人工核验实施严格的质量控制。

-

多目标训练支持:除 25.8 万个单轮监督微调样本外,还提供 5.6 万对偏好样本(成功编辑 vs. 失败编辑),用于 DPO 和 奖励建模等对齐方法的研究,从而支持模型在鲁棒性与偏好学习方面的探索。

-

复杂编辑场景:收录了 7.2 万组多轮编辑序列,每个会话包含 2--5 次连续编辑,便于研究迭代式优化、上下文感知编辑与编辑规划等问题。所有样本均包含详细版与简洁版指令,以支持研究提示粒度对模型表现的影响。

Pico-Banana-400K 不仅仅是一个数据集,它是证明人工智能现在可以大规模生成和验证自己的训练数据,并且精确无误,无需人工监督。

苹果公司悄无声息地奠定了未来十年多模态学习的基础。