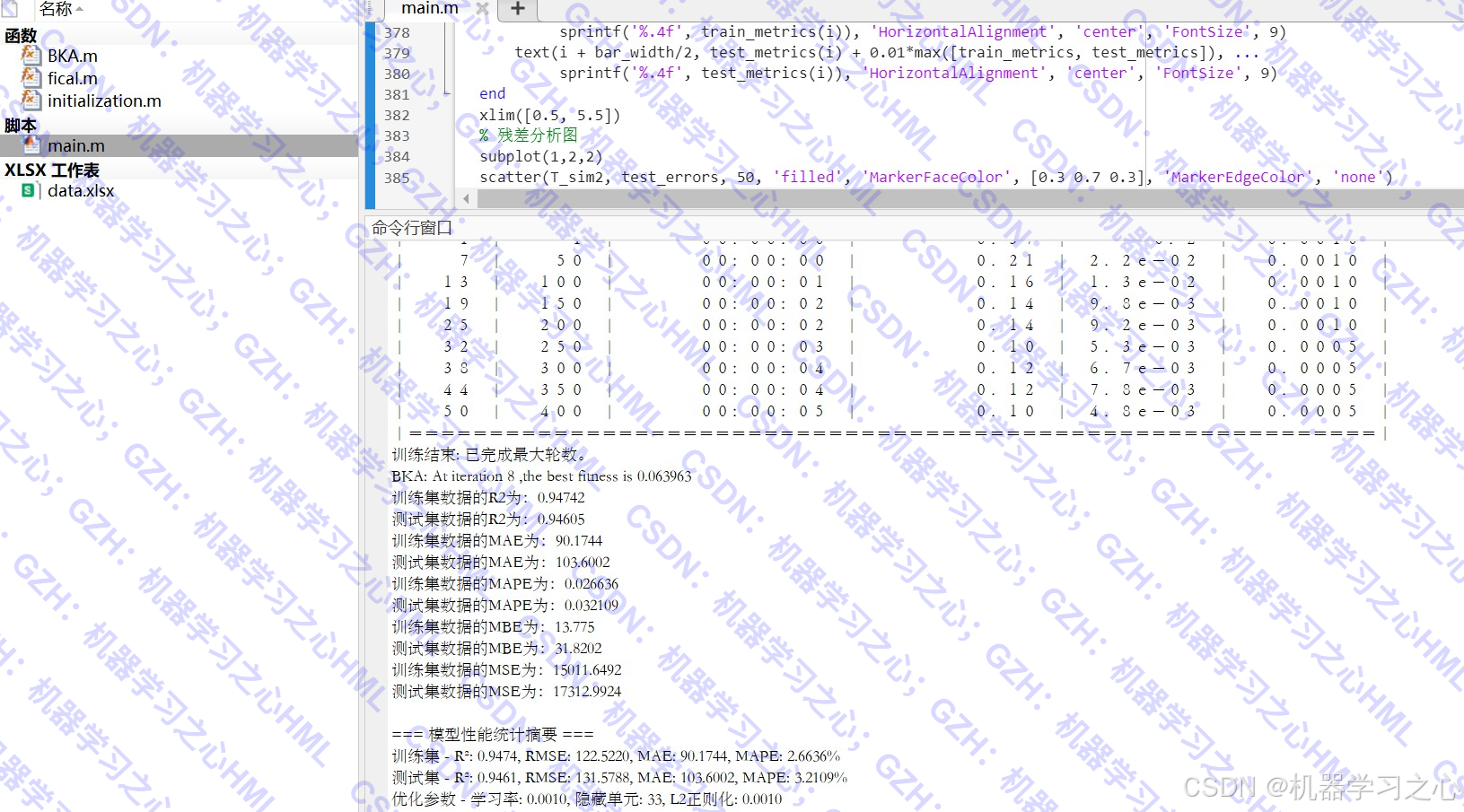

代码功能

这是一个基于BKA优化的Transformer-LSTM混合神经网络的时间序列预测模型。

主要功能包括:

- 数据预处理:时间序列重构、数据集划分、归一化处理

- 参数优化:使用BKA算法优化学习率、隐藏层单元数、L2正则化系数

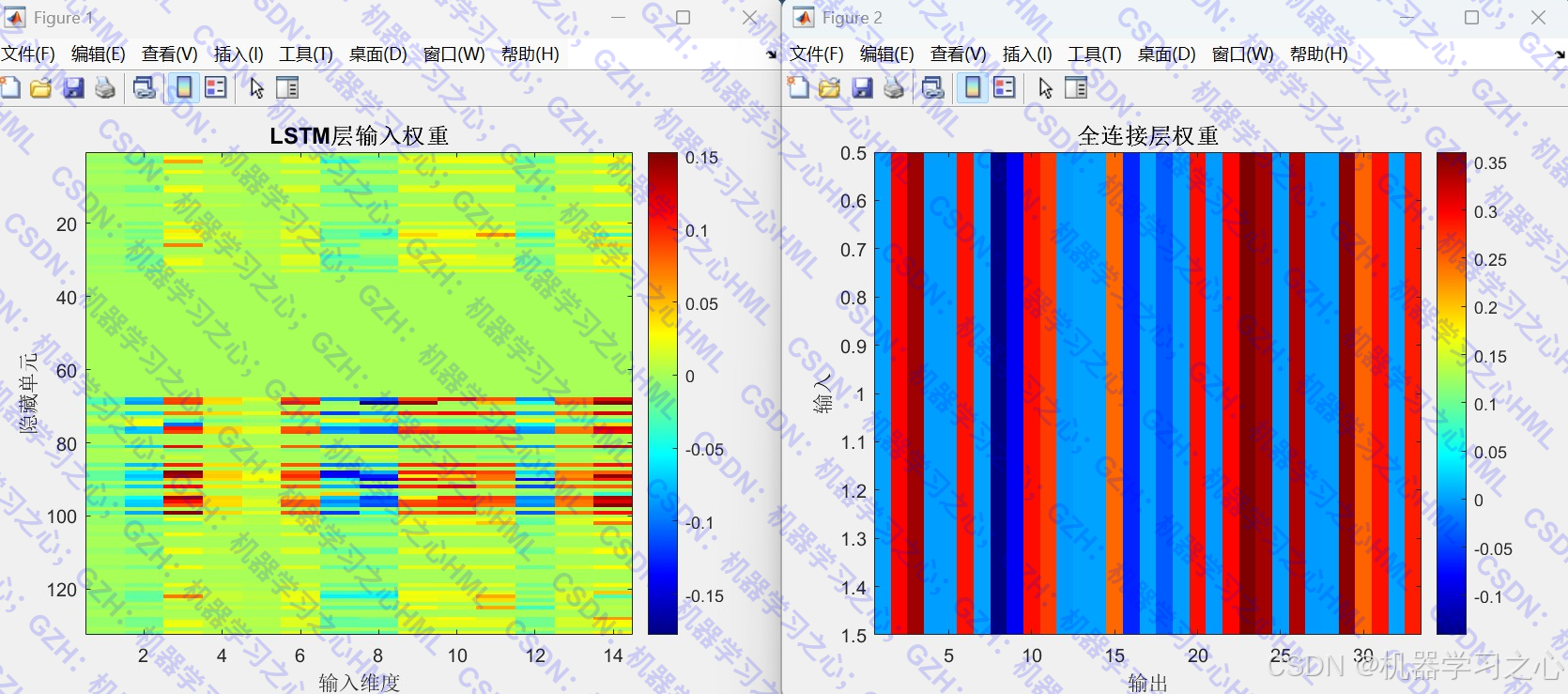

- 模型构建:结合Transformer的自注意力机制和LSTM的序列建模能力

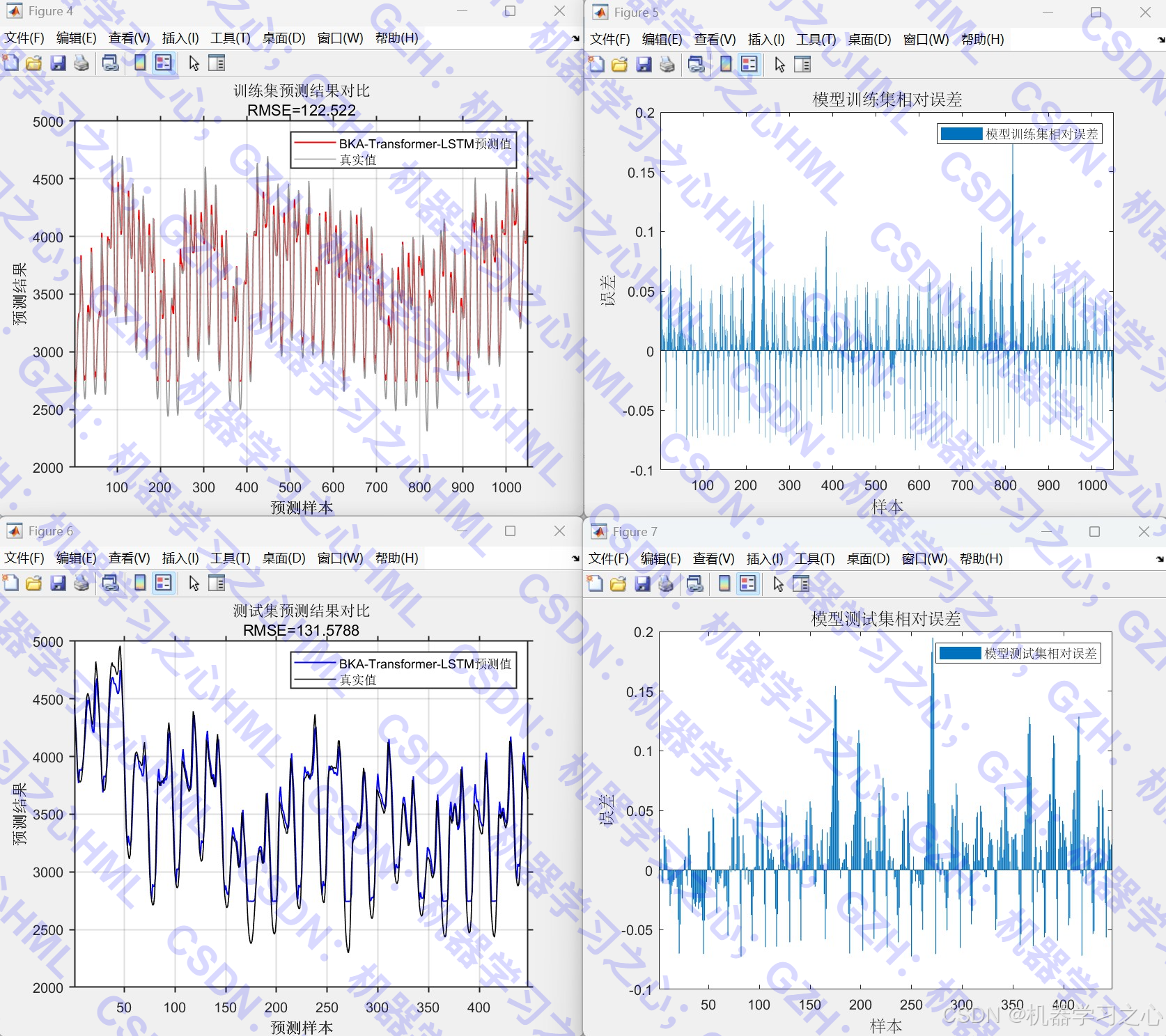

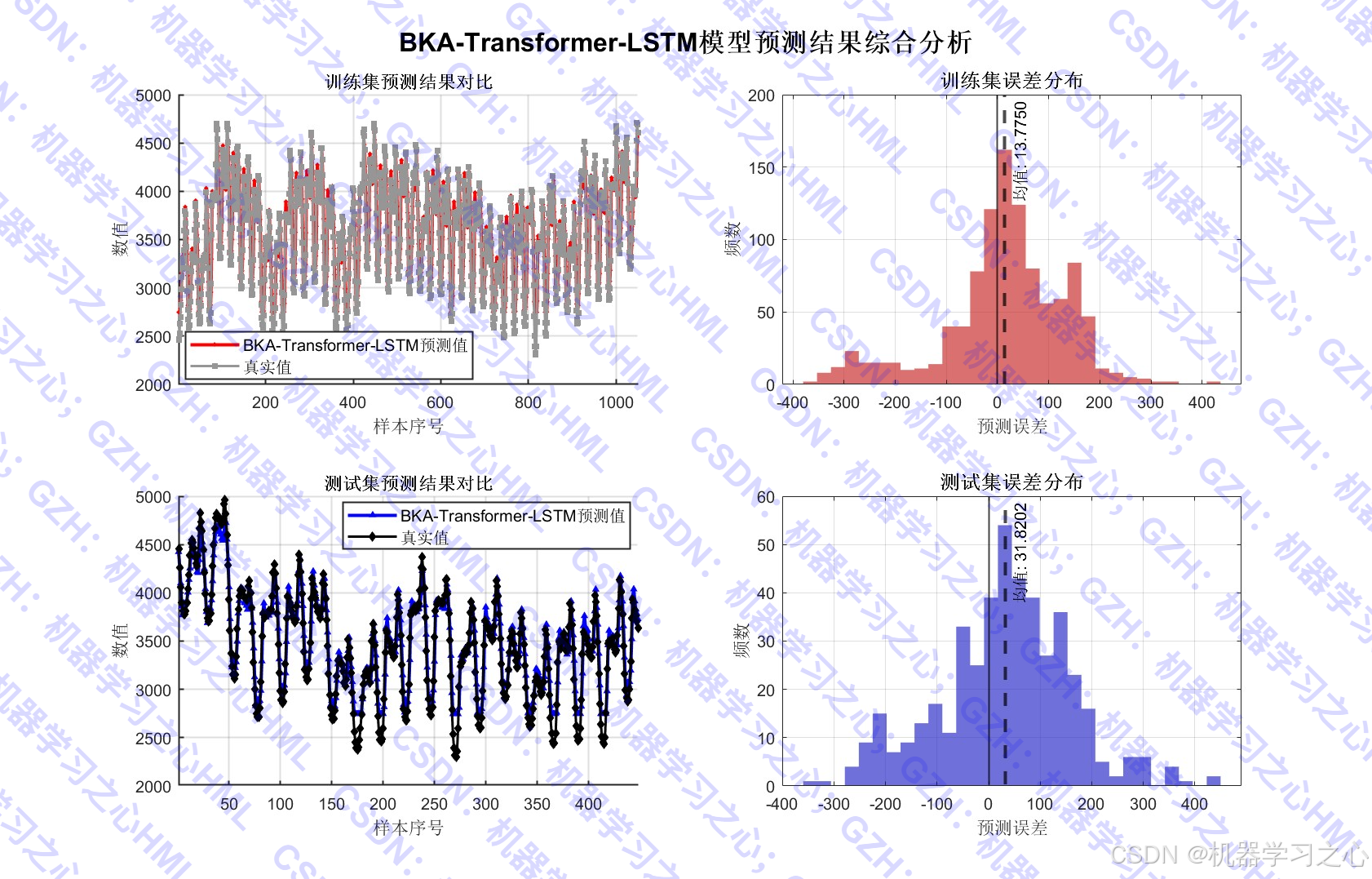

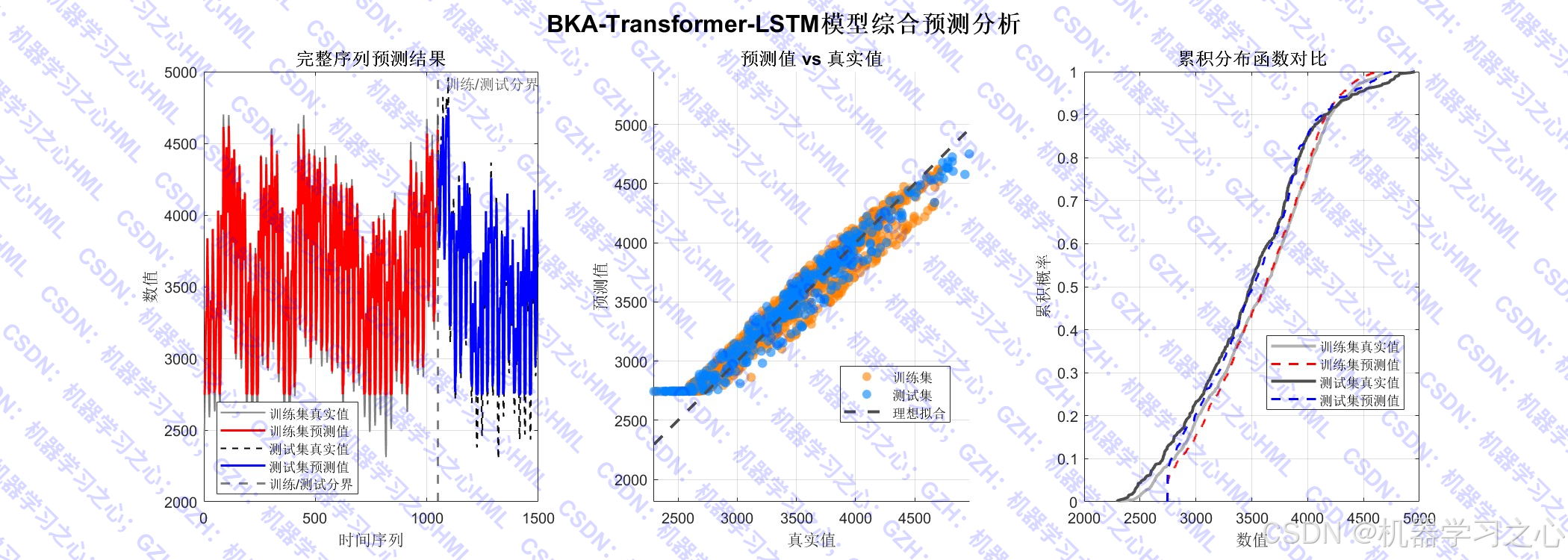

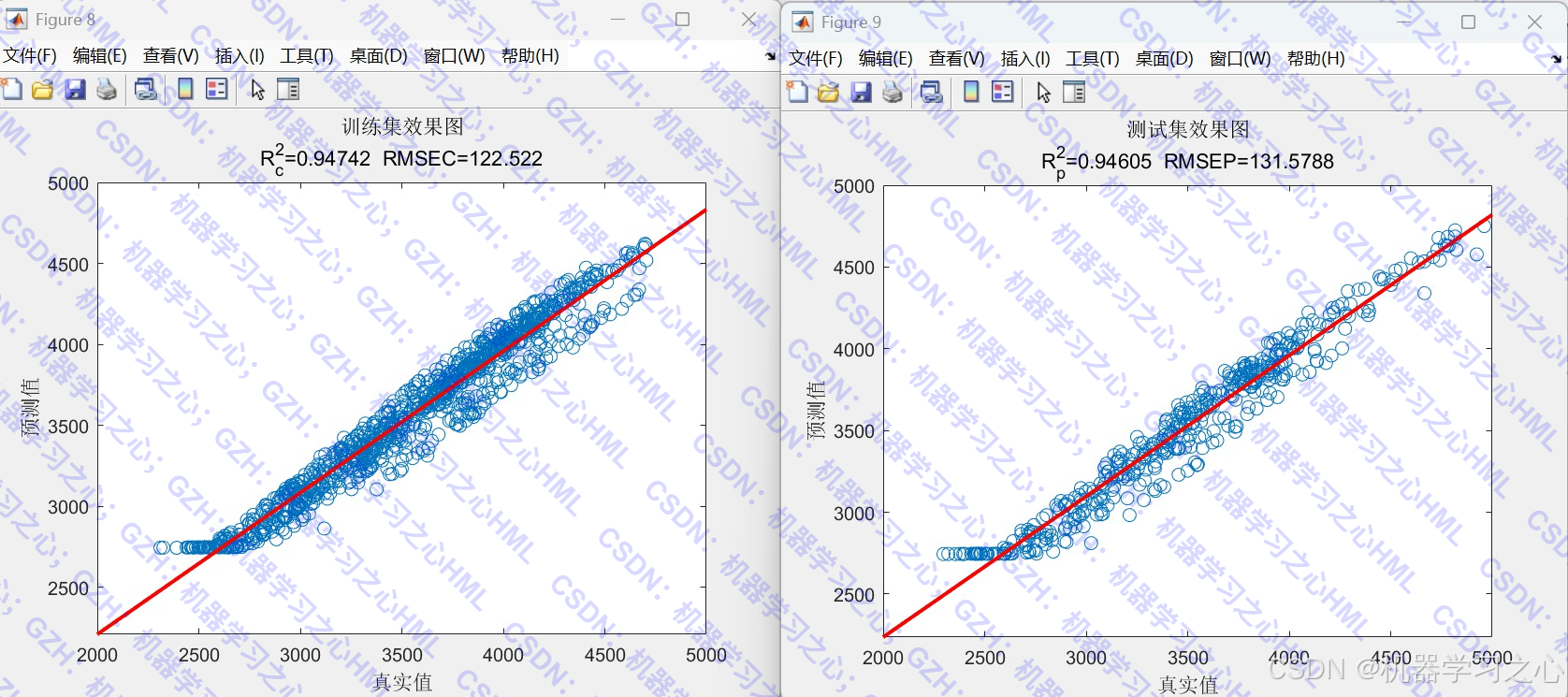

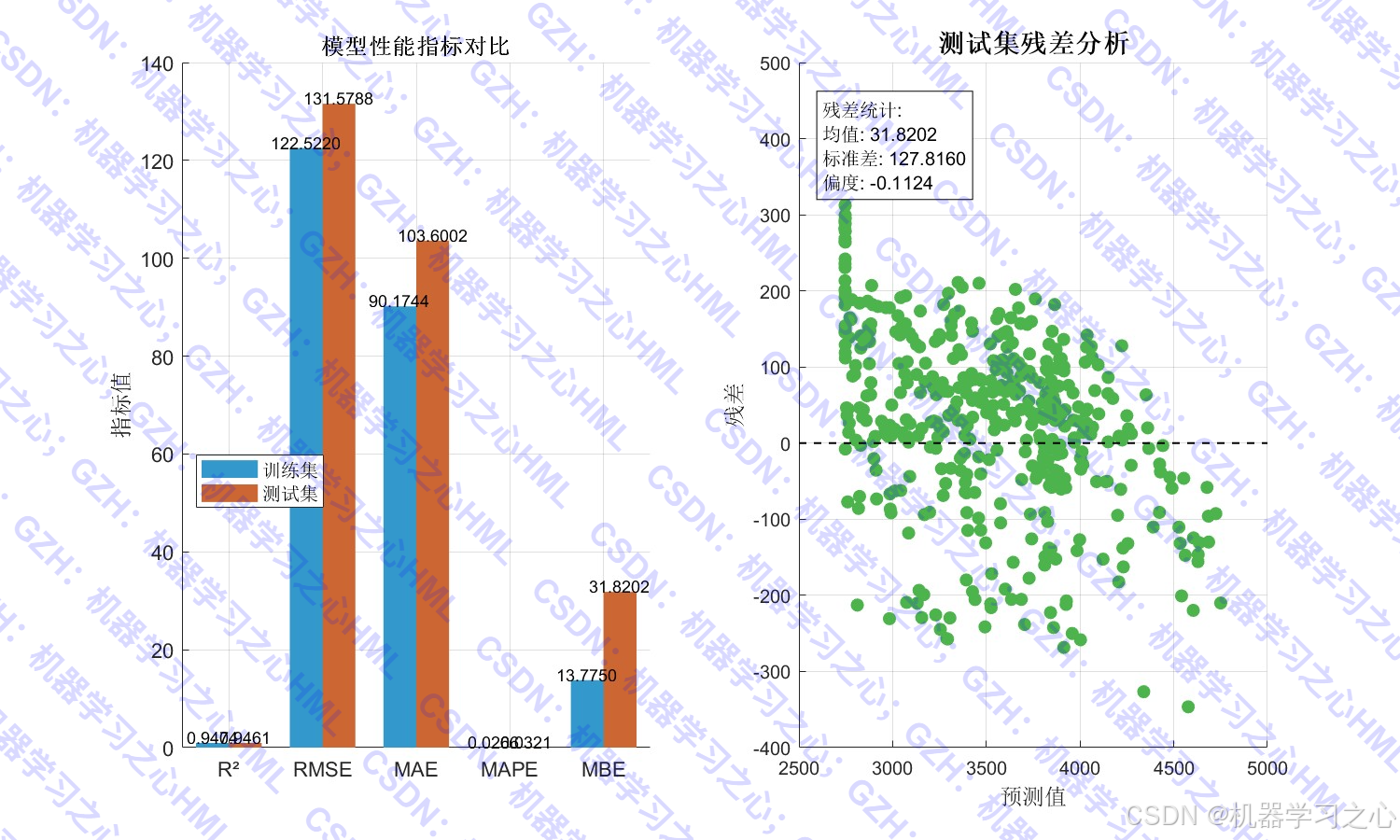

- 模型训练与评估:训练混合神经网络并进行多指标性能评估

- 结果可视化:提供丰富的图表展示预测效果和误差分析

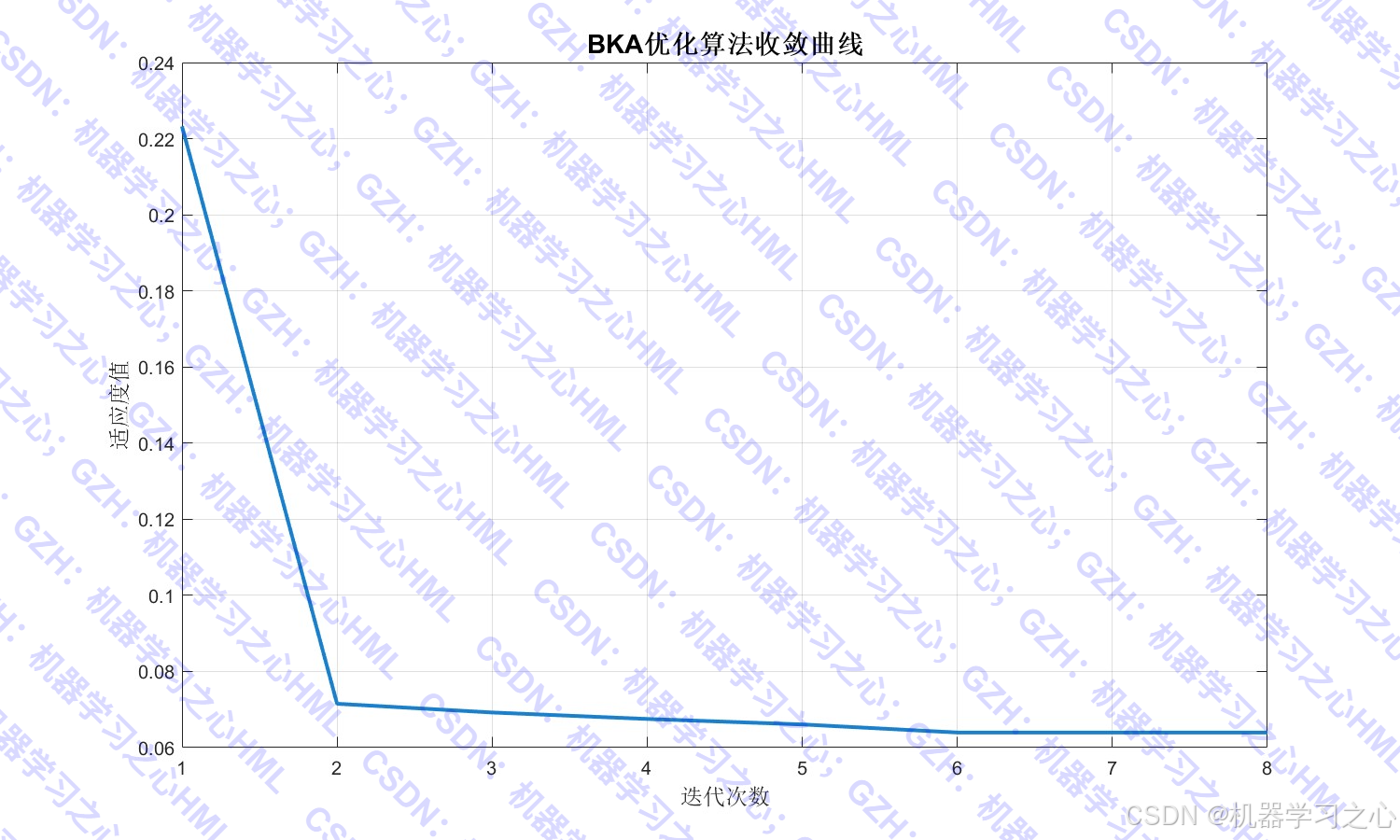

黑翅鸢优化算法(Black-winged Kite Algorithm, BKA)具有独特的生物启发特征,不仅捕捉了黑翅鸢在自然界中的飞行和捕食行为,还深入模拟了它们对环境变化和目标位置的高适应性。BKA中引入了柯西变异策略,有助于算法跳出局部最优解,并增加在全局搜索空间中发现更好解的概率。同时,BKA集成了一种领导策略,模拟了风筝社区中领导者的领导作用,确保算法能够有效利用当前的最佳解并指导搜索方向。

算法步骤

1. 数据预处理阶段

数据导入 → 时间序列重构 → 数据集划分 → 数据归一化 → 数据格式转换2. 模型优化阶段

BKA优化算法 → 超参数搜索 → 最佳参数确定3. 模型构建与训练

网络层搭建 → 参数设置 → 模型训练 → 权重可视化4. 预测与评估

仿真预测 → 数据反归一化 → 多指标计算 → 结果可视化技术路线

核心架构:Transformer + LSTM

matlab

输入层 → 位置编码 → 自注意力层 ×2 → LSTM层 → 全连接层 → 输出层关键技术组件:

- 位置编码层:处理序列位置信息

- 自注意力机制:捕捉长距离依赖关系

- LSTM层:学习时序模式

- BKA优化器:自动调参

公式原理

1. 自注意力机制

Attention(Q,K,V)=softmax(QKT/√dk)V其中:Q=查询矩阵,K=键矩阵,V=值矩阵,dk=维度 Attention(Q,K,V) = softmax(QKᵀ/√d_k)V 其中:Q=查询矩阵, K=键矩阵, V=值矩阵, d_k=维度 Attention(Q,K,V)=softmax(QKT/√dk)V其中:Q=查询矩阵,K=键矩阵,V=值矩阵,dk=维度

2. LSTM门控机制

遗忘门:ft=σ(Wf⋅[ht−1,xt]+bf) 遗忘门: f_t = σ(W_f·[h_{t-1}, x_t] + b_f) 遗忘门:ft=σ(Wf⋅[ht−1,xt]+bf)

输入门:it=σ(Wi⋅[ht−1,xt]+bi) 输入门: i_t = σ(W_i·[h_{t-1}, x_t] + b_i) 输入门:it=σ(Wi⋅[ht−1,xt]+bi)

输出门:ot=σ(Wo⋅[ht−1,xt]+bo) 输出门: o_t = σ(W_o·[h_{t-1}, x_t] + b_o) 输出门:ot=σ(Wo⋅[ht−1,xt]+bo)

3. 评价指标公式

- RMSE = √(Σ(y_pred - y_true)²/N)

- MAE = Σ|y_pred - y_true|/N

- MAPE = Σ|(y_true - y_pred)/y_true|/N × 100%

- R² = 1 - Σ(y_true - y_pred)²/Σ(y_true - y_mean)²

参数设定

优化参数范围:

- 学习率:0.001 ~ 0.1

- 隐藏层单元:32 ~ 128

- L2正则化:0.001 ~ 0.1

网络结构参数:

- 注意力头数:4

- 关键通道数:128

- 最大位置编码:256

- 丢弃率:0.2

训练参数:

- 最大训练轮数:200

- 批大小:64

- 学习率下降因子:0.5

- 下降周期:50轮

运行环境

软件要求:

- MATLAB (推荐R2023b及以上版本)

依赖文件:

data.xlsx:输入数据文件fical.m:目标函数文件BKA.m:优化算法文件

应用场景

主要应用领域:

- 金融预测:股票价格、汇率预测

- 能源负荷:电力需求预测

- 气象预报:温度、降水量预测

- 工业生产:设备故障预测、产量预测

- 交通流量:道路拥堵预测

适用数据特点:

- 时间序列数据

- 具有时序依赖关系

- 中等至长期预测任务

- 需要捕捉复杂模式的数据

优势:

- 结合Transformer和LSTM优势

- 自动超参数优化

- 全面的评估体系

- 丰富的可视化分析

该模型特别适合于需要同时考虑长期依赖和局部时序模式的时间序列预测任务。