在WSL Ubuntu中部署CUDAToolkit cuDNN tensorflow显卡加速

| 软件 | 版本 |

|---|---|

| ubuntu | 24.04 |

| cuda-tookit | 12.9 |

| cudnn | 9.15.0 |

| tensorflow | 2.20.0 |

在WSLUbuntu中部署Python3.12、CUDAToolkit和cuDNN的官方下载页面及步骤如下:

bash

mkdir ~/cuda ~/cudnn1.安装WindowsGPU驱动(WSL专用)

WSL2的GPU加速依赖Windows驱动,需下载NVIDIAWSL2专用驱动。

官方下载页面 :NVIDIACUDAonWSLDownloads

选择适合你显卡型号的驱动版本,下载后直接在Windows中安装。

注意:安装驱动后需重启Windows,并确保WSL已升级到版本2。

2.安装CUDAToolkit(WSL专用)

NVIDIA提供针对WSL的CUDAToolkit安装包。

官方下载页面 :CUDAToolkit13forWSL

选择以下命令下载并安装:

注意:

英文官网上命令:sudo apt-get -y install cuda-toolkit-13-0

中文官网上命令:sudo apt-get -y install cuda-toolkit-12-4但不可用

cuda-toolkit12推荐命令:sudo apt-get -y install cuda-toolkit-12-9

由于 tensorflow 目前 还没有支持cuda13,因此 本案例安装的是cuda12

bash

wget https://developer.download.nvidia.com/compute/cuda/repos/wsl-ubuntu/x86_64/cuda-keyring_1.1-1_all.deb -P ~/cuda

sudo dpkg -i ~/cuda/cuda-keyring_1.1-1_all.deb

sudo apt-get update

sudo apt-get -y install cuda-toolkit-12-9安装完成后,配置环境变量:

bash

echo 'export PATH=/usr/local/cuda-12/bin:$PATH' >> ~/.bashrc

echo 'export LD_LIBRARY_PATH=/usr/local/cuda-12/lib64:$LD_LIBRARY_PATH' >> ~/.bashrc

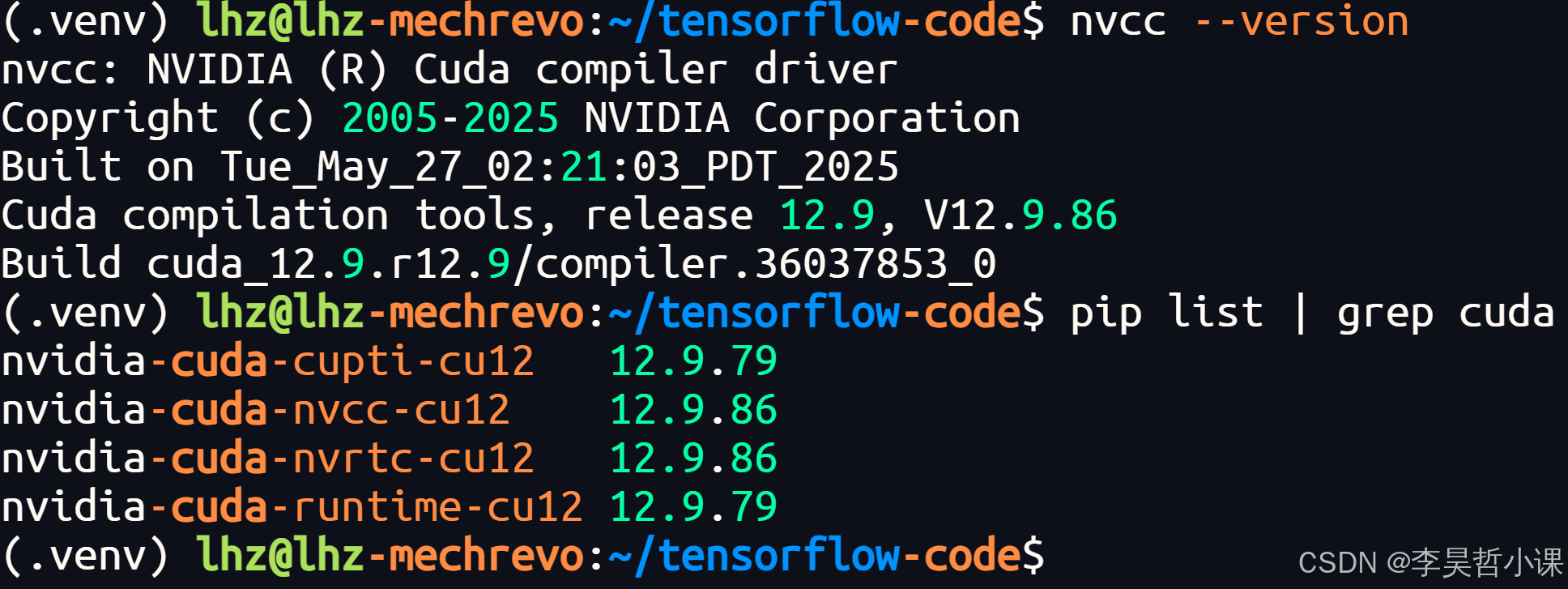

source ~/.bashrc验证安装:

bash

nvcc --version

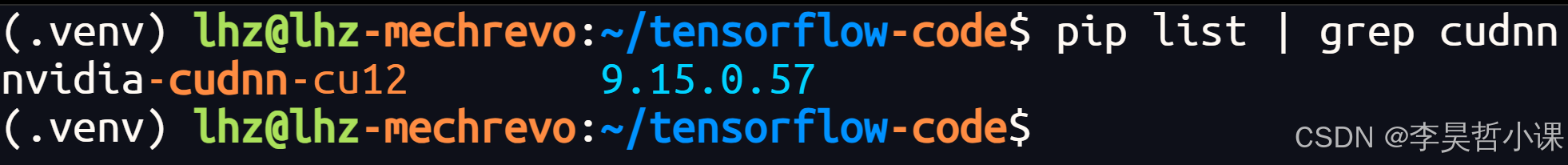

3.安装cuDNN

cuDNN需与CUDAToolkit版本匹配,不推荐当独安装,在安装tensorflow的时候会自动安装匹配的版本。

-官方下载页面 :

NVIDIAcuDNNDownload

下载后执行以下命令安装:

bash

wget https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2404/x86_64/cuda-keyring_1.1-1_all.deb -P ~/cudnn

sudo dpkg -i ~/cudnn/cuda-keyring_1.1-1_all.deb

sudo apt-get update

sudo apt-get -y install cudnn-jit-验证cudnn

bash

ldconfig -p | grep libcudnn

4.安装Python3.12和PyTorch

-

安装Python3.12相关工具(WSLUbuntu中默认可能未预装):

bashsudo apt update sudo ap -y install python3 python3-pip python3.12-venv -

创建虚拟环境

bashmkdir tensorflow-code && cd tensorflow-code python3 -m venv .venv source .venv/bin/activate python -m pip install --upgrade pip setuptools -i https://pypi.tuna.tsinghua.edu.cn/simple -

安装tensorflow :

可通过官方 nightly 版本安装,命令示例:

bashpip install tensorflow[and-cuda] -i https://pypi.tuna.tsinghua.edu.cn/simple -

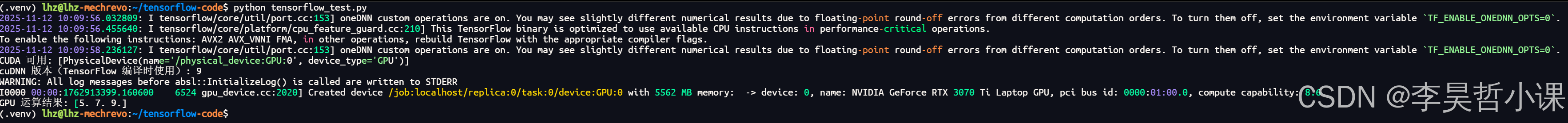

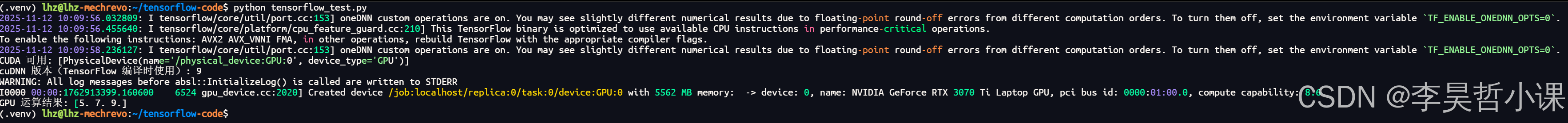

验证tensorflow可调用CUDA和cuDNN:

pythonimport tensorflow as tf # 验证 CUDA 可用性 print("CUDA 可用:", tf.config.list_physical_devices('GPU')) # 验证 cuDNN 可用性 # 获取 TensorFlow 编译时的依赖信息 build_info = tf.sysconfig.get_build_info() print("cuDNN 版本(TensorFlow 编译时使用):", build_info['cudnn_version']) # 测试 GPU 运算 if tf.config.list_physical_devices('GPU'): with tf.device('/GPU:0'): a = tf.constant([1.0, 2.0, 3.0]) b = tf.constant([4.0, 5.0, 6.0]) c = a + b print("GPU 运算结果:", c.numpy()) else: print("未检测到 GPU 支持,请检查安装")

通过以上步骤,可在WSLUbuntu中完成Python3.12、CUDAToolkit和cuDNN的部署,并验证GPU加速功能。