前言

作为开源的LLM应用开发平台,Dify凭借易用的可视化操作、完善的RAG引擎和灵活的工作流编排能力,成为比LangChain更适合生产环境的选择。很多开发者想搭建专属AI应用,但本地部署受硬件限制,云服务器部署成为最优解。

本文结合阿里云服务器的选型推荐,带大家从零实现Dify完整部署,包括服务器配置、环境搭建、Ollama关联和应用开发,全程实操无坑,新手也能轻松上手!

一、阿里云服务器选型推荐(性价比首选)

Dify部署需要依赖Docker容器,同时运行大模型对CPU、内存要求较高,结合个人/小型团队使用场景,推荐以下配置:

| 配置类型 | 规格 | 适用场景 | 优势 | 参考价格(年付) |

|---|---|---|---|---|

| 入门级 | 2核4G,40G云盘,CentOS 8.2 | 个人测试、小型应用开发 | 成本低,满足基础部署需求 | 约300-500元 |

| 进阶级 | 4核8G,80G云盘,CentOS 8.2 | 团队协作、多模型运行 | 性能均衡,支持并发访问 | 约800-1200元 |

| 专业级 | 8核16G,100G云盘,CentOS 8.2 | 生产环境、复杂工作流 | 运行流畅,支持大模型推理 | 约1500-2000元 |

选型关键要点:

- 操作系统优先选择CentOS 8.2或Ubuntu 20.04,兼容性更好

- 内存建议≥4G,否则运行Dify+Ollama会卡顿

- 云盘选择SSD类型,读写速度更快,提升部署效率

- 带宽建议≥1M,保证模型拉取和应用访问流畅

- 购买后记得在阿里云控制台开放80、443、11434、5000端口(安全组配置)

也可以通过链接,能看到里面一系列云主机型号选择

二、服务器环境准备(全程命令行操作)

2.1 连接阿里云服务器

使用Xshell或FinalShell工具连接,输入服务器公网IP、用户名(默认root)和密码,连接成功后进入命令行界面。

2.2 安装Docker和Docker Compose

Dify基于Docker部署,先完成环境依赖安装:

bash

# 更新系统包

yum update -y

# 安装Docker依赖

yum install -y yum-utils device-mapper-persistent-data lvm2

# 设置Docker镜像源(阿里云加速)

yum-config-manager --add-repo https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

# 安装Docker

yum install -y docker-ce docker-ce-cli containerd.io

# 启动Docker并设置开机自启

systemctl start docker

systemctl enable docker

# 验证Docker安装成功

docker --version

# 安装Docker Compose

curl -L "https://github.com/docker/compose/releases/download/v2.20.2/docker-compose-$(uname -s)-$(uname -m)" -o /usr/local/bin/docker-compose

# 赋予执行权限

chmod +x /usr/local/bin/docker-compose

# 验证Docker Compose安装成功

docker-compose --version2.3 配置Docker镜像加速(关键步骤)

阿里云服务器默认有Docker镜像加速地址,配置后拉取镜像速度提升10倍:

bash

# 创建Docker配置目录

mkdir -p /etc/docker

# 编写配置文件(替换为自己的阿里云加速地址,在容器镜像服务中获取)

tee /etc/docker/daemon.json <<-'EOF'

{

"registry-mirrors": ["https://xxxx.mirror.aliyuncs.com"]

}

EOF

# 重启Docker服务

systemctl daemon-reload

systemctl restart docker三、Dify部署步骤(社区版)

3.1 下载Dify源码

推荐使用1.1.3稳定版本,兼容性更好:

bash

# 安装Git

yum install -y git

# 克隆Dify源码

git clone https://github.com/langgenius/dify.git

# 进入源码目录

cd dify

# 切换到1.1.3版本

git checkout v1.1.3

# 进入docker目录

cd docker3.2 配置环境变量

bash

# 复制环境变量模板

cp .env.example .env

# 编辑.env文件(可根据需求修改端口和数据库配置)

vim .env

# 关键配置项(默认即可,无需修改)

# WEB_PORT=5000

# DB_PASSWORD=dify_db_password

# REDIS_PASSWORD=dify_redis_password3.3 启动Dify服务

bash

# 后台启动所有服务

docker-compose up -d

# 查看启动状态(确保所有容器都是up状态)

docker-compose ps首次启动会拉取多个镜像,耐心等待5-10分钟(取决于服务器带宽)。启动成功后

通过浏览器 访问 http://服务器公网IP:5000/install 即可进入Dify初始化页面。

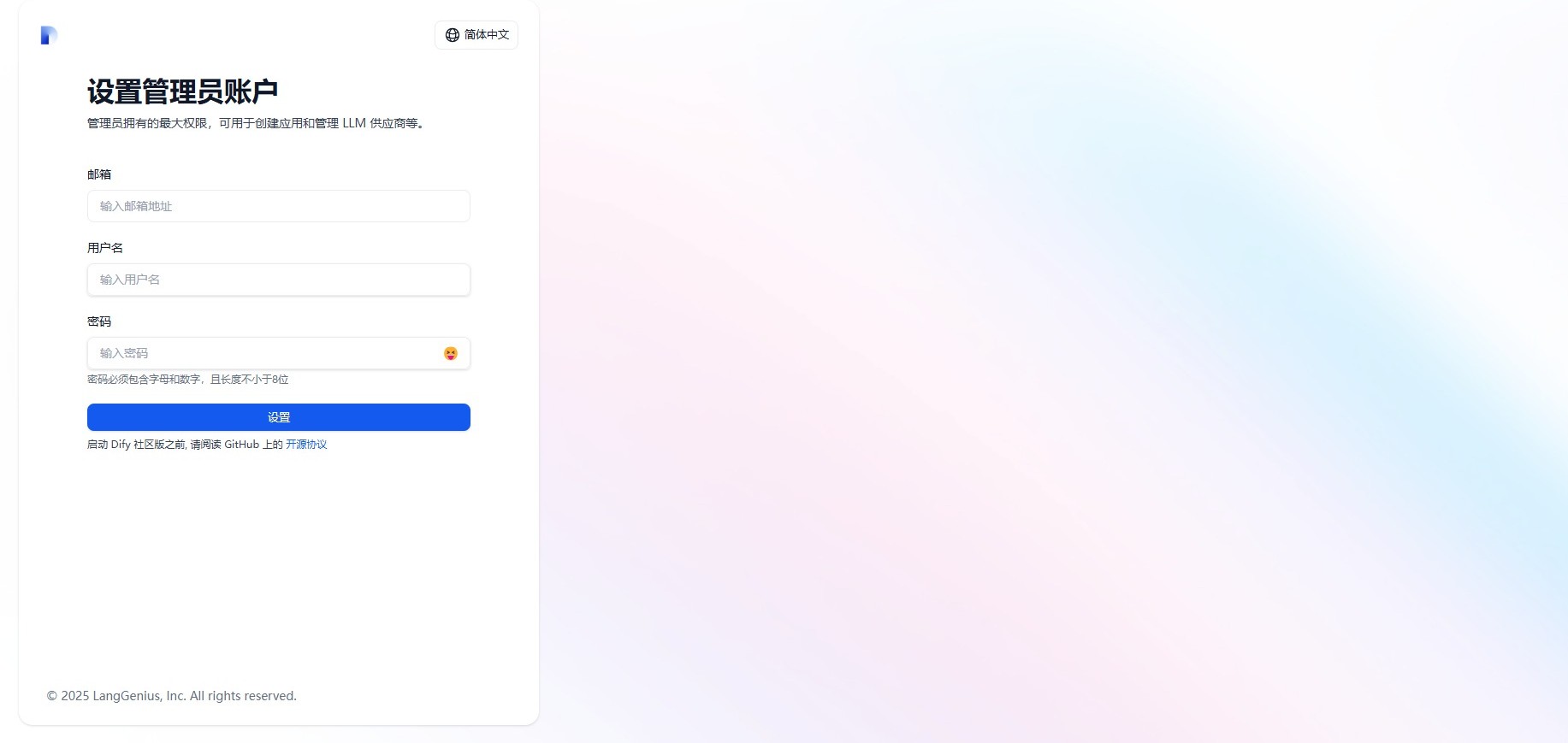

3.4 初始化Dify

- 访问初始化页面,选择简体中文

- 设置管理员账户(邮箱、用户名、密码,密码需包含字母和数字,长度≥8位)

- 点击"设置"完成初始化,进入Dify登录页面

- 输入账号密码登录,看到主界面说明Dify部署成功!

四、Ollama部署与Dify关联

4.1 在阿里云服务器安装Ollama

Ollama是轻量级本地大模型运行工具,支持Llama 2、DeepSeek等模型:

bash

# 下载Ollama安装脚本

curl -fsSL https://ollama.com/install.sh | sh

# 启动Ollama服务

systemctl start ollama

systemctl enable ollama

# 验证安装成功

ollama --version

# 拉取DeepSeek-R1小模型(适合服务器运行)

ollama pull deepseek-r1:1.5b4.2 配置Dify关联Ollama

- 编辑Dify的.env文件,添加Ollama配置:

bash

# 进入Dify的docker目录

cd /root/dify/docker

# 编辑.env文件

vim .env

# 在文件末尾添加以下配置

CUSTOM_MODEL_ENABLED=true

OLLAMA_API_BASE_URL=http://localhost:11434

# 重启Dify服务使配置生效

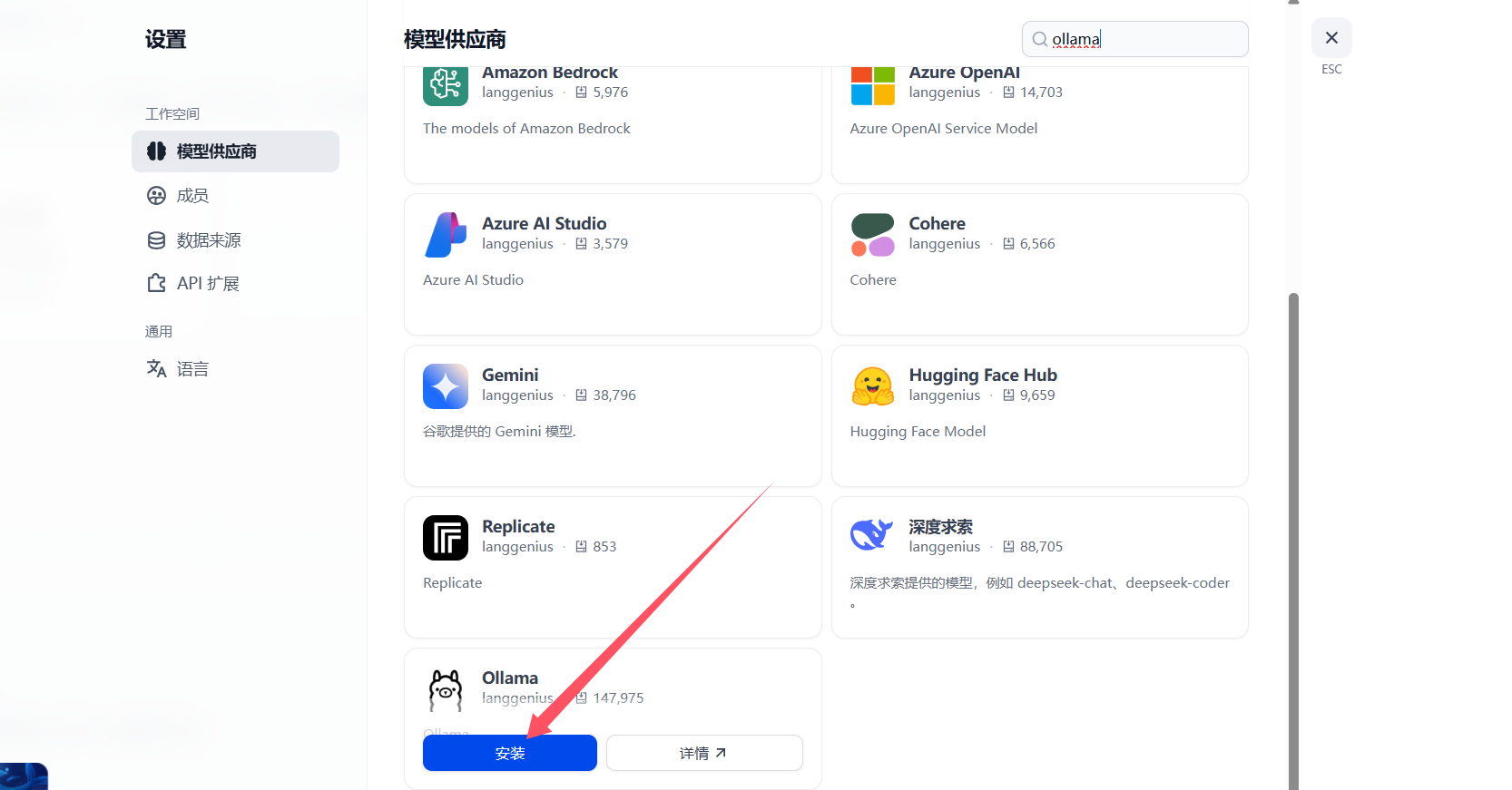

docker-compose restart- 在Dify界面配置Ollama模型:

-

登录Dify,点击右上角用户名→"设置"→"模型供应商"

-

找到"Ollama",点击"安装模型供应商"

-

点击"添加模型",配置如下:

- 模型类型:LLM

- 模型名称:deepseek-r1:1.5b(与Ollama拉取的模型名称一致)

- 基础URL:http://localhost:11434

- 上下文长度:4096

-

点击"保存",模型添加成功!

五、测试Dify应用功能

5.1 创建聊天助手应用

- 点击"Dify工作室"→"创建空白应用"→选择"聊天助手"

- 应用名称填写"测试助手",点击"创建"

- 在"编排"页面,选择模型为deepseek-r1:1.5b

- 提示词输入:"你是一个智能助手,负责解答用户的问题"

- 点击"调试与预览",输入"你是谁?",模型会返回响应,说明功能正常!

5.2 知识库功能测试

- 创建新应用,选择"聊天助手",名称填写"知识库助手"

- 点击"知识库"→"添加"→"创建知识库"

- 上传本地PDF或TXT文件(支持15MB以内,格式包括PDF、DOCX、MD等)

- 文本分段设置:最大长度500tokens,重叠长度50tokens,点击"下一步"

- 索引方式选择"经济",点击"完成"

- 在编排页面,启用"知识库",选择刚刚创建的知识库

- 预览时输入文件中的相关问题,Dify会从知识库中检索答案并回复!

六、服务器安全配置与优化

6.1 安全组配置

在阿里云控制台→云服务器ECS→安全组→配置规则,开放以下端口:

- 80/tcp:HTTP访问

- 443/tcp:HTTPS访问

- 5000/tcp:Dify访问

- 11434/tcp:Ollama服务

- 22/tcp:SSH连接(仅允许自己的IP访问,提高安全性)

6.2 性能优化

- 调整Docker资源限制,编辑docker-compose.yaml,添加资源配置:

yaml

services:

web:

deploy:

resources:

limits:

cpus: '2'

memory: 2G

api:

deploy:

resources:

limits:

cpus: '2'

memory: 2G- 定期清理Docker镜像和容器,释放空间:

bash

# 清理未使用的镜像

docker image prune -a

# 清理停止的容器

docker container prune七、常见问题排查

- Dify访问不了?

- 检查安全组是否开放5000端口

- 查看Docker容器状态:docker-compose ps,确保所有容器正常运行

- 查看日志:docker-compose logs -f web

- Ollama模型拉取失败?

- 检查服务器网络是否正常,可配置阿里云DNS:223.5.5.5

- 更换更小的模型,如llama2:7b

- 模型响应缓慢?

- 升级服务器配置(增加内存和CPU)

- 选择更小的模型版本

- 关闭不必要的Docker容器,释放资源

总结

通过阿里云服务器部署Dify+Ollama,我们可以拥有一个完全自主可控的AI应用开发平台,支持聊天助手、文本生成、知识库问答等多种场景。相比本地部署,阿里云服务器稳定性更高、可扩展性更强,适合个人开发者和小型团队长期使用。

按照本文步骤操作,全程无复杂配置,即使是新手也能顺利完成部署。接下来就可以基于Dify的工作流、Agent等高级功能,开发自己的专属AI应用了!如果遇到问题,欢迎在评论区交流~