ID-COMPOSER:具有分层身份保持的多主体视频合成

paper是PKU发布在Arxiv 2025的工作

paper title:ID-COMPOSER: MULTI-SUBJECT VIDEO SYNTHESIS WITH HIERARCHICAL IDENTITY PRESERVATION

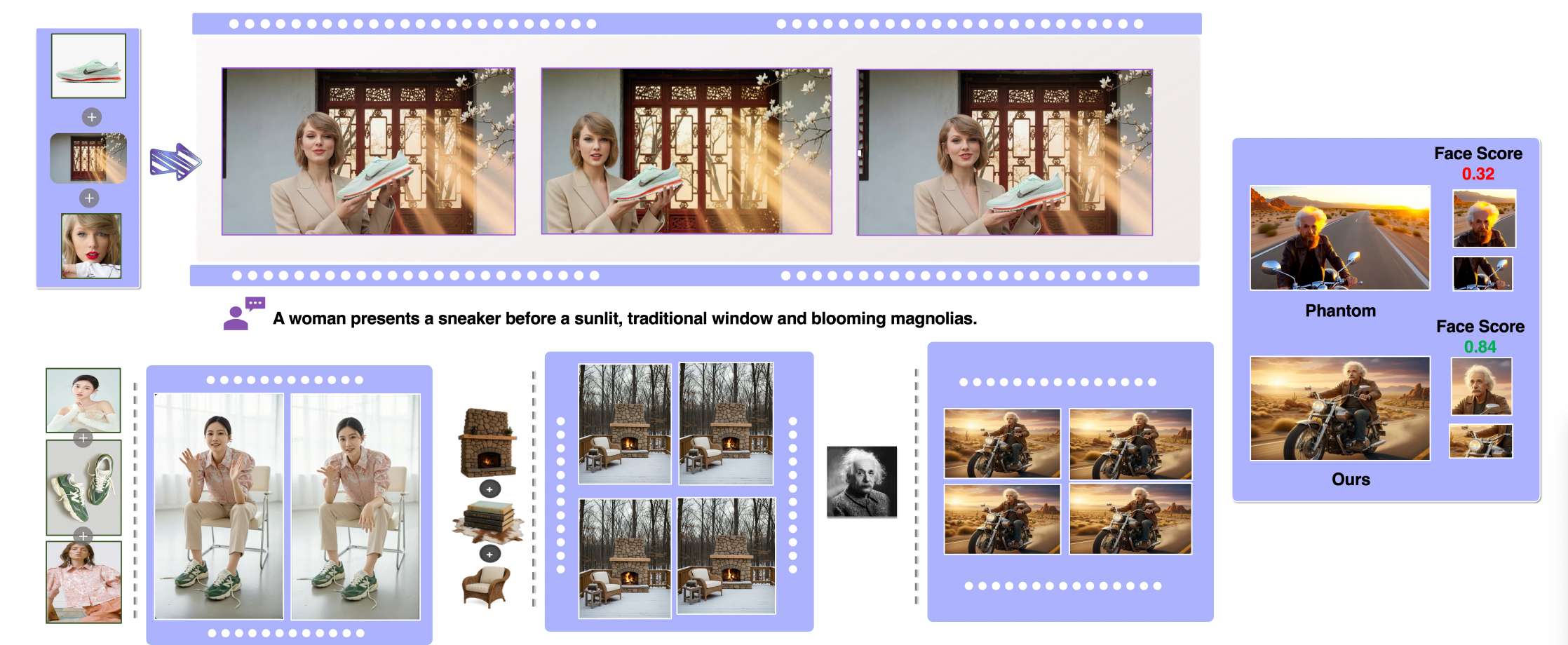

图 1:给定文本提示和多张参考图像,ID-COMPOSER 能生成主体一致的视频,并在主体身份保持方面相比先前的最先进方法(如 Phantom(Liu 等,2025b))取得了令人印象深刻的效果。请放大查看细节。

ABSTRACT

大型数据集上预训练的视频生成模型能够生成高质量的视频,但通常依赖文本或单张图像作为条件,从而限制了可控性与适用性。我们提出 ID-COMPOSER,这是一种新颖的框架,通过从文本提示和参考图像生成多主体视频来弥补这一空缺。该任务具有挑战性,因为它需要在生成的视频中保持主体身份、整合跨主体与跨模态的语义信息,并维持时间一致性。为了在合成视频中忠实保持主体一致性和文本信息,ID-COMPOSER 设计了一种分层身份保持注意力机制,可以有效聚合主体内部及跨主体、跨模态的特征。为了有效实现用户意图的语义跟随,我们引入基于预训练视觉-语言模型(VLM)的语义理解,利用 VLM 卓越的语义理解能力提供细粒度指导,并捕捉多主体之间的复杂交互。鉴于标准扩散损失在对齐诸如主体身份等关键概念时常常失败,我们采用在线强化学习阶段,将 ID-COMPOSER 的整体训练目标推进为 RLVR。大量实验表明,我们的模型在身份保持、时间一致性和视频质量方面均超越了现有方法。代码和训练数据将公开发布。

1 INTRODUCTION

近期的视频生成模型研究(OpenAI, 2023; Yang 等, 2024b; Vidu, 2024; keling, 2024; Wan, 2025)已经能够生成高保真视频,但它们通常依赖稀疏输入(如文本提示或单张初始图像),从而严重限制了可控性。受现代图像生成模型(Deng 等, 2025a; Fortin 等, 2025)的组合灵活性启发,我们通过专注于多主体视频生成来解决这一限制。这一能力进一步促进了主体驱动的视频生成、动态场景组合和可控产品植入等下游应用,并有望推动个性化内容创作、虚拟叙事与广告生成的发展。

尽管具有重要意义,多主体视频生成相比于已建立的单主体视频生成流程仍面临诸多挑战:(1)在整个视频中保持多个主体的身份一致性愈发困难;(2)在更多主体和模态间进行语义整合需要在语义信息对齐和平衡上解决更高难度的问题;(3)多主体视频的时间一致性要求在连续帧之间保持外观与运动的连贯性。

一个朴素的解决方案是构建一个代理系统:先利用现成的主体驱动图像生成模型(Ruiz 等, 2023),根据文本提示和参考图像生成第一帧,再使用视频生成模型(OpenAI, 2023; Yang 等, 2024b; Wan, 2025)生成后续帧。然而,这种两阶段流程缺乏视频与参考主体之间的显式对应关系,并高度依赖第一帧的质量,导致主体身份保持欠佳、时间一致性不足,并容易产生误差累积。

为解决这些挑战,近期工作(Deng 等, 2025b; Liu 等, 2025b; Xue 等, 2025a)提出通过将多主体信息注入预训练视频扩散模型(Wan, 2025)的多模态扩散 Transformer(MMDiT)(Esser 等, 2024)中,实现端到端生成。尽管这些方法有效,但它们仅将所有主体的视觉 token 和文本 token 简单拼接到噪声 token 上。这导致在语义整合与跨主体冲突解析过程中出现更高的困惑度,并因缺乏主体间与模态间交互的显式建模而出现性能瓶颈。

为此,我们提出 ID-COMPOSER,这是一种全新的多主体视频生成框架,在身份保持、时间一致性和整体视频质量方面达到了最新的性能水平。ID-COMPOSER 的核心设计包括两点:

(1)分层身份保持注意力机制。我们面临的任务包含多个主体和模态,因此需要有效聚合主体内部与跨主体、跨模态的特征。受近期局部-全局注意力方法(Wang 等, 2025a; Lin 等, 2025)的启发,我们设计了分层注意力机制,在三个递进层次上进行注意力操作:主体内部注意力、主体间注意力和跨模态注意力。该设计通过捕捉每个主体的细粒度细节、建模主体之间的交互以及整合跨模态信息,实现了有效的身份一致性与文本忠实度。

(2)基于预训练视觉-语言模型(VLM)的语义理解。我们的模型采用 VLM 作为文本编码器,以提供细粒度指导,并捕捉多个主体之间的复杂交互。与传统文本编码器(Radford 等, 2021)相比,VLM(Yang 等, 2024a)在语义理解与跨模态对齐上具有显著优势,这对多主体视频生成至关重要。

ID-COMPOSER 构建在强大的视频扩散模型(Wan, 2025)之上,将上述两项设计集成到 MMDiT(Esser 等, 2024)架构中,使模型能够有效生成包含多个特定主体的高质量视频。为了激励模型生成高质量且具有强身份保持的视频,我们在初始扩散训练后进一步引入在线强化学习阶段(Liu 等, 2025a; Guo 等, 2025)。此外,我们构建了一个新的多主体视频生成数据集。我们提出的数据整理流程利用视觉-语言模型和先进图像编辑模型,涉及自动过滤、字幕生成和主体分解等阶段,从而构建了一个混合模态数据集。

如图 1 所示,ID-COMPOSER 能够生成高质量的视频,准确保持多个主体的身份,与提示一致,并维持时间一致性。实验表明,我们的模型在身份保持、时间一致性和视频质量方面均优于现有方法。消融实验验证了所提出设计的有效性。

总而言之,我们的贡献包括:

- 我们提出了 ID-COMPOSER,这一用于多主体视频生成的新框架,能够有效保持主体身份、整合语义并维持时间一致性。

- 我们提出的分层身份保持注意力机制、基于预训练 VLM 的语义理解机制以及在线强化学习的引入,显著提升了模型处理多主体及多模态任务的能力。

- 我们构建了新的多主体视频生成数据集,并进行了大量实验,展示了 ID-COMPOSER 相比现有方法的优越性。

2 RELATED WORKS

主体驱动图像生成 近期主体驱动图像生成的进展使得高保真视觉资产的创建成为可能,并对数字内容创作产生了深远影响。一类重要方法是基于微调(tuning-based)的方法,它们通过在少量参考图像上微调生成模型来实现高主体保真度。这些方法从对整个模型权重进行优化(如 DreamBooth(Ruiz 等, 2023)),到学习主体特定的文本嵌入(Gal 等, 2022),再到采用参数高效的微调策略(Hu 等, 2021; Han 等, 2023; Yuan 等, 2023)不等。然而,这类方法的一个显著缺点是对每个主体都需要进行高昂的计算开销。为克服这一限制,出现了无需微调(tuning-free)的方法(Ye 等, 2023; Wang 等, 2024; Sun 等, 2024; Wu 等, 2024; Liu 等, 2025c),它们在推理过程中通过各种条件机制注入身份信息,从而提供一种更高效的替代方案。近期又出现了一种新的范式,即通用型模型(Chen 等, 2024; Xiao 等, 2024; Lu, 2024; Wu 等, 2025a; Gao 等, 2025; Fortin 等, 2025),其将主体驱动生成作为众多能力之一。尽管取得了进展,将主体驱动生成从图像扩展到视频领域仍然是一个艰巨的挑战,主要原因是难以在跨帧中同时维持身份一致性和时间一致性。

主体一致的视频生成 主体一致性视频生成(keling, 2024; Vidu, 2024; Pika, 2024; Jiang 等, 2025)通常通过增强模型的注意力机制以整合外观线索来实现。更灵活的范式也不断涌现,包括基于适配器的方法,如 ID-Animator(He 等, 2024)、ConsisID(Yuan 等, 2024)和 Stand-In(Xue 等, 2025a)。针对多主体这一更具挑战性的场景,一种路由器机制被提出(Mou 等, 2025)。其他工作则探索了更丰富的定制维度:Wang 等(2025b)提出 FantasyPortrait,通过表情增强扩散 Transformer 改进多角色肖像动画;Hu 等(2025)提出 PolyVivid,通过跨模态交互提升多主体场景中的生动性与一致性;Huang 等(2025)提出 Videomage,使文生视频扩散能够同时支持多主体和运动定制。我们的方法与 Phantom(Liu 等, 2025b)、Concat-ID(Zhong 等, 2025)、SkyReels-A2(Fei 等, 2025)和 CINEMA(Deng 等, 2025b)最为相关,它们专注于基于注意力的特征注入。然而,这些方法及相关扩展在主体身份与文本提示之间的冲突以及一致性维持方面仍然存在困难。此外,ID-COMPOSER 提出了新的方法来缓解这些冲突,并在多个层面实现一致性,从而提升多主体视频生成的鲁棒性与质量。

用于生成任务的强化学习 直接偏好优化(DPO)(Gao 等, 2025)凭借其计算效率,已经成为对文本到图像模型进行后训练以对齐人类偏好的常用技术,如提升美学质量和提示遵循度。随后的工作例如 DenseDPO(Wu 等, 2025b),通过改进配对数据的构建方式和偏好标注的粒度,将这一范式扩展到视频领域,从而生成具有更高视觉质量和运动动态的视频。然而,这些方法的主要限制在于其离线特性,无法进行在线参数更新。近期,可验证奖励模型如 OpenAI 的 o1(Jaech 等, 2024)和 Deepseek-R1(Guo 等, 2025)解决了这一问题。同时,在线学习的兴趣不断增长,推动了各种在线强化学习(RL)方法的发展,包括 ReFL(Xu 等, 2023)、DRaFT(Clark 等, 2023)、FlowGRPO(Liu 等, 2025a)、DanceGRPO(Xue 等, 2025b)和 SRPO(Shen 等, 2025),它们在提升图像美学和文本呈现保真度方面取得了可喜成果。然而,这些方法在主体一致性视频生成中的应用仍十分有限。为填补这一空白,我们为主体一致性视频生成引入了任务特定奖励,以缓解奖励黑客问题,并生成具有高身份一致性的视频。

3 METHOD

我们正在处理多主体视频生成任务。给定文本提示 CtxtC_{\text{txt}}Ctxt 和一组 NNN 个参考图像 I:={Ik}k=1N\mathcal{I} := \{ I_k \}{k=1}^NI:={Ik}k=1N,其中每个 IkI_kIk 描述一个独特的主体,我们的目标是生成一个视频 VVV,该视频与提示 CtxtC{\text{txt}}Ctxt 保持一致,并忠实地以高保真度和时间一致性保持来自 I\mathcal{I}I 的所有 NNN 个主体的身份。

在接下来的章节中,我们首先描述我们方法的预备知识(Sec. 3.1),随后介绍所提出方法的架构(Sec. 3.2)、训练方案(Sec. 3.3),以及数据整理流程(Sec. 3.4)。

3.1 PRELIMINARIES: RECTIFIED FLOW FOR VIDEO GENERATION

我们的方法基于潜变量视频扩散 Transformer(Peebles & Xie, 2023; Wan, 2025),并使用 Rectified Flow(RF)(Lipman 等, 2022; Liu 等, 2022; Esser 等, 2024)进行训练。在潜变量视频扩散中,一个视频片段 V∈RT×H×W×3V \in \mathbb{R}^{T \times H \times W \times 3}V∈RT×H×W×3 首先通过变分自编码器(VAE)的编码器 E\mathcal{E}E 投影到潜变量空间,得到表示 z0:=E(V)∈Rf×c×h×wz_0 := \mathcal{E}(V) \in \mathbb{R}^{f \times c \times h \times w}z0:=E(V)∈Rf×c×h×w。对应的 VAE 解码器记为 D(z0)\mathcal{D}(z_0)D(z0)。

生成过程基于 Rectified Flow 构建,它定义了一个在数据分布样本 z0∼pdataz_0 \sim p_{\text{data}}z0∼pdata 与先验分布样本(通常为标准高斯 ϵ∼N(0,I)\epsilon \sim \mathcal{N}(0, \mathbf{I})ϵ∼N(0,I))之间的直线路径。该路径由时间变量 t∈[0,1]t \in [0, 1]t∈[0,1] 参数化:

zt:=(1−t)z0+tϵ.(1) z_t := (1 - t) z_0 + t \epsilon. \tag{1} zt:=(1−t)z0+tϵ.(1)

该路径诱导了一个恒定速度场 v=ϵ−z0\mathbf{v} = \epsilon - z_0v=ϵ−z0。核心目标是训练一个由参数 θ\thetaθ 控制的视频扩散 Transformer vθ\mathbf{v}_\thetavθ 来预测该速度。训练目标被表述为对该速度场的回归损失:

LRF:=Et,z0,ϵ[w(t) ∥vθ(zt,t,Cctx)−(ϵ−z0)∥22],(2) \mathcal{L}{\text{RF}} := \mathbb{E}{t, z_0, \epsilon} \left[ w(t) \, \| \mathbf{v}\theta(z_t, t, C{\text{ctx}}) - (\epsilon - z_0) \|_2^2 \right], \tag{2} LRF:=Et,z0,ϵ[w(t)∥vθ(zt,t,Cctx)−(ϵ−z0)∥22],(2)

其中 CctxC_{\text{ctx}}Cctx 表示条件信息(例如文本或图像提示),w(t)w(t)w(t) 是一个平衡不同噪声水平损失的加权函数。

3.2 ID-COMPOSER: MULTI-SUBJECT VIDEO GENERATION

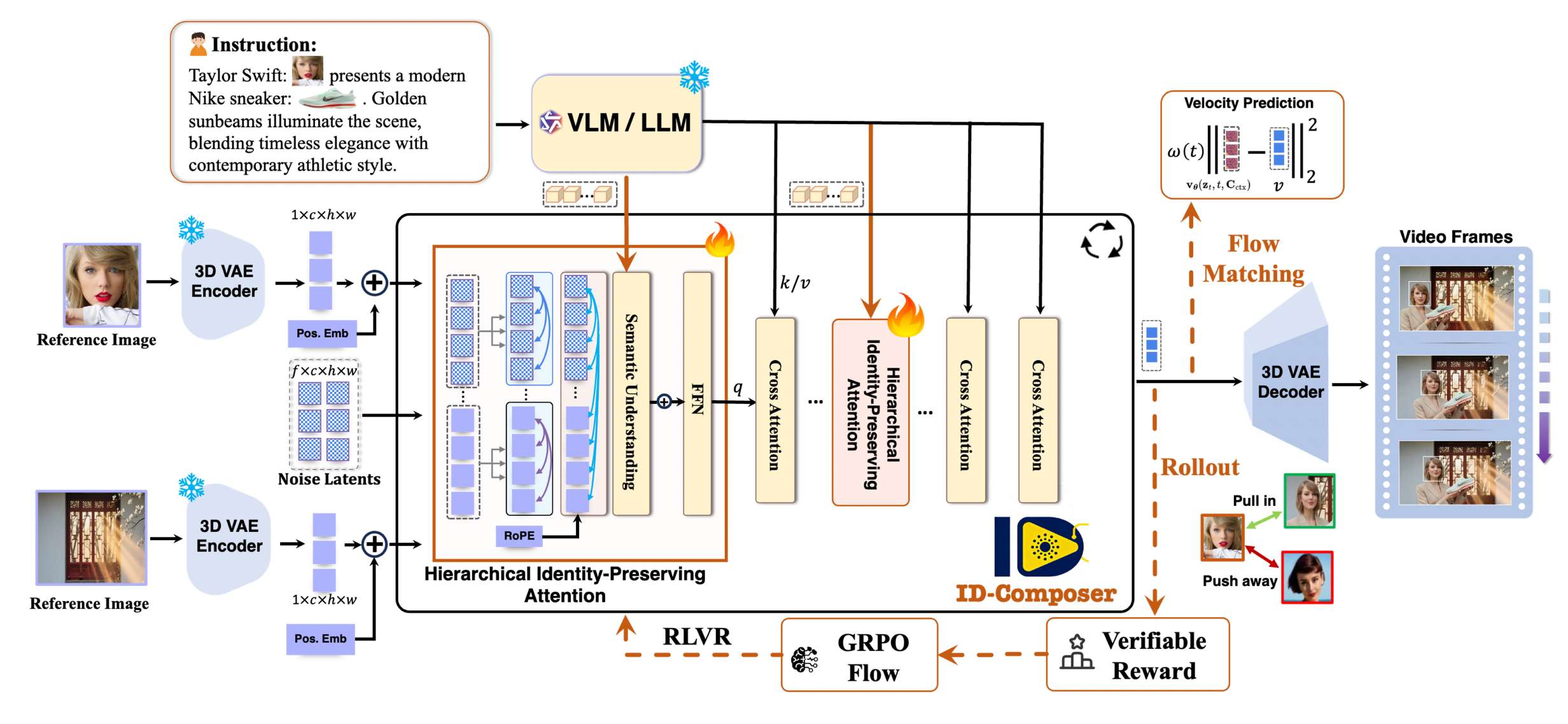

如图 2 所示,ID-COMPOSER 在 DiT 架构的潜变量视频扩散模型基础上进行了扩展,并通过引入两项关键的结构创新来应对多主体条件建模的复杂性:(1)分层身份保持注意力机制,用于分层聚合特征;(2)基于预训练视觉-语言模型(VLM)的语义理解,我们将其作为处理文本与图像输入的高级编码器。为了进一步增强模型的语义对齐与身份保持能力,我们在初始流匹配训练之后加入了在线强化学习阶段。

图 2:ID-COMPOSER 概述。我们的模型在视频 DiT 中结合了分层身份保持注意力机制和能够对多模态输入进行推理的 VLM,从而实现多主体视频生成。在线强化学习阶段进一步优化概念对齐效果。

3.2.1 MODEL ARCHITECTURE

分层身份保持注意力机制 我们的模型基于多模态 DiT(MMDiT),其中潜变量视频 token 与条件 token 在一系列变换块中共同处理。随后,我们首先使用预训练图像编码器(例如 Wan-VAE)对输入参考图像集 I\mathcal{I}I 进行编码,以获得视觉特征图 {Fk}k=1N\{F_k\}{k=1}^N{Fk}k=1N,其中每个 Fk∈Rc×h×wF_k \in \mathbb{R}^{c \times h \times w}Fk∈Rc×h×w 对应第 kkk 个主体。这些特征图随后被展平成 token 序列 {fk}k=1N\{f_k\}{k=1}^N{fk}k=1N,其中每个 fk∈Rhw×cf_k \in \mathbb{R}^{hw \times c}fk∈Rhw×c。文本提示 CtxtC_{\text{txt}}Ctxt 使用预训练文本编码器编码,生成一系列文本 token ftxt∈Rl×cf_{\text{txt}} \in \mathbb{R}^{l \times c}ftxt∈Rl×c,其中 lll 是文本 token 的数量。完整的条件 token 集为 Cctx=[ftxt;f1;...;fN]C_{\text{ctx}} = [f_{\text{txt}}; f_1; \ldots; f_N]Cctx=[ftxt;f1;...;fN]。

为了有效整合来自多个主体与模态的信息,我们在每个 Transformer 块内部引入了分层注意力机制。该机制包括三个阶段:(1)主体内注意力(Intra-subject attention):每个主体的 token fkf_kfk 独立进行自注意力,使模型能够捕获主体内部的细粒度细节与空间关系。(2)主体间注意力(Inter-subject attention):将各主体经过主体内注意力处理的输出拼接后,再经过另一个自注意力层,使模型能够学习不同主体间的交互与关系。(3)多模态注意力(Multi-modal attention):将组合后的主体特征与文本 token ftxtf_{\text{txt}}ftxt 及潜变量视频 token 拼接,随后进行自注意力操作以融合跨模态信息。该分层机制确保模型能够有效保持各主体的身份,同时捕捉主体间复杂动态,并与文本提示对齐。

通过视觉-语言模型进行语义推理 尽管分层注意力机制旨在保持身份一致性,但在含有模糊用户指令的情况下,将多个主体进行连贯组合依然极具挑战性。此外,训练数据通常缺乏适应真实世界多样性场景所需的推理能力。为克服这些限制,我们利用强大的预训练视觉-语言模型(VLM),以获得更高级的语义理解能力,从而更准确地理解提示并指导多主体组合。

我们使用 Qwen2.5-VL 模型(Bai 等, 2025),因为其多模态推理能力出色。VLM 同时处理文本提示 CtxtC_{\text{txt}}Ctxt 和参考图像集 I\mathcal{I}I,生成语义增强后的文本 token,我们记为 ftxtf_{\text{txt}}ftxt:

ftxt=VLMenc(Ctxt,I)∈Rl′×cf_{\text{txt}} = \text{VLM}{\text{enc}}(C{\text{txt}}, \mathcal{I}) \in \mathbb{R}^{l' \times c}ftxt=VLMenc(Ctxt,I)∈Rl′×c。

这些 token 不仅捕捉文本语义,还包含主体的视觉概念,使模型能够更全面地理解用户意图。

这些由 VLM 增强的 token 将替代传统文本编码器生成的嵌入。最终的条件 token 集通过将增强文本 token 与各主体 token 拼接得到:

Cctx=[ftxt;f1;...;fN]∈R(l′+N⋅hw)×cC_{\text{ctx}} = [f_{\text{txt}}; f_1; \ldots; f_N] \in \mathbb{R}^{(l' + N \cdot hw) \times c}Cctx=[ftxt;f1;...;fN]∈R(l′+N⋅hw)×c。

通过结合 VLM 的高级推理能力,ID-COMPOSER 实现了更强的语义对齐与身份保持能力,从而生成更高质量的视频,能够忠实反映复杂的多主体提示。

3.3 TRAINING WITH ONLINE REINFORCEMENT LEARNING

GRPO 我们使用 Flow-GRPO(Liu 等, 2025a)进行在线强化学习(RL),以进一步提升视频生成质量。对于每个条件 qqq,GRPO(Guo 等, 2025)从旧策略 πθold\pi_{\theta_{\text{old}}}πθold 中采样一组输出 {o1,o2,...,oG}\{o_1, o_2, \ldots, o_G\}{o1,o2,...,oG},并通过最大化以下目标来优化策略模型:

JGRPO(θ)=Eq∼P(Q),{oi}i=1G∼πθold(O∣q)[1G∑i=1G1∣oi∣∑t=1∣oi∣{min[rti(θ) A^i,t, clip(rti(θ), 1−ϵ, 1+ϵ)A^i,t] − βDKL[πθ ∥ πref]}],(3) \mathcal{J}{\text{GRPO}}(\theta) = \mathbb{E}{q \sim P(Q), \{o_i\}{i=1}^G \sim \pi{\theta_{\text{old}}}(O|q)} \left[ \frac{1}{G} \sum_{i=1}^G \frac{1}{|o_i|} \sum_{t=1}^{|o_i|} \left\{ \min \left[ r_t^i(\theta)\,\hat{A}{i,t},\; \text{clip}\left(r_t^i(\theta),\, 1-\epsilon,\, 1+\epsilon\right)\hat{A}{i,t} \right] \;-\; \beta \mathbb{D}{\text{KL}}[\pi\theta \,\|\, \pi_{\text{ref}}] \right\} \right], \tag{3} JGRPO(θ)=Eq∼P(Q),{oi}i=1G∼πθold(O∣q) G1i=1∑G∣oi∣1t=1∑∣oi∣{min[rti(θ)A^i,t,clip(rti(θ),1−ϵ,1+ϵ)A^i,t]−βDKL[πθ∥πref]} ,(3)

其中

r_t\^i(\\theta) \\frac{\\pi_\\theta(o_{i,t}\\mid q, o_{i,\< t})}{\\pi_{\\theta_{\\text{old}}}(o_{i,t}\\mid q, o_{i,\< t})}.

第 iii 个响应的相对质量 A^i,t\hat{A}_{i,t}A^i,t 计算为:

$$

\hat{A}_{i,t}

\frac{r_i - \text{Mean}({r_1, r_2, \ldots, r_n})}

{\text{Std}({r_1, r_2, \ldots, r_n})}.

Flow-GRPO 将 GRPO 扩展至 rectified flow 设置,同时通过在流积分的每一步注入噪声,将原本确定性的 flow matching 生成过程转化为随机过程。更新规则定义为: ##

\mathbf{x}_{t+\Delta t}

\mathbf{x}t

+

\Big[

v \theta(\mathbf{x}_t, t)

\frac{\sigma_t^2}{2t}

\big(

\mathbf{x}t + (1-t)v \theta(\mathbf{x}_t, t)

\big)

\Big]\Delta t

\sigma_t \sqrt{\Delta t},\epsilon,

\tag{4}

其中 ϵ∼N(0,I)\\epsilon \\sim \\mathcal{N}(0, I)ϵ∼N(0,I) 为生成过程注入随机性,且 σt=at1−t\\sigma_t = a\\sqrt{\\frac{t}{1-t}}σt=a1−tt 。 Reward 为进一步提升模型输出效果,我们在初始 RF 训练之后,提出一个在线强化学习(RL)阶段来微调生成模型 vθv_\\thetavθ。该阶段采用定制的策略梯度算法,以最大化复合奖励函数 Rtotal\\mathcal{R}_{\\text{total}}Rtotal,该函数由视频质量与身份一致性指标加权求和而成: ##

\theta^*

\arg\max_\theta

\mathbb{E}{V \sim p \theta}

\left[

\mathcal{R}_{\text{total}}(V)

\right],

\tag{5}

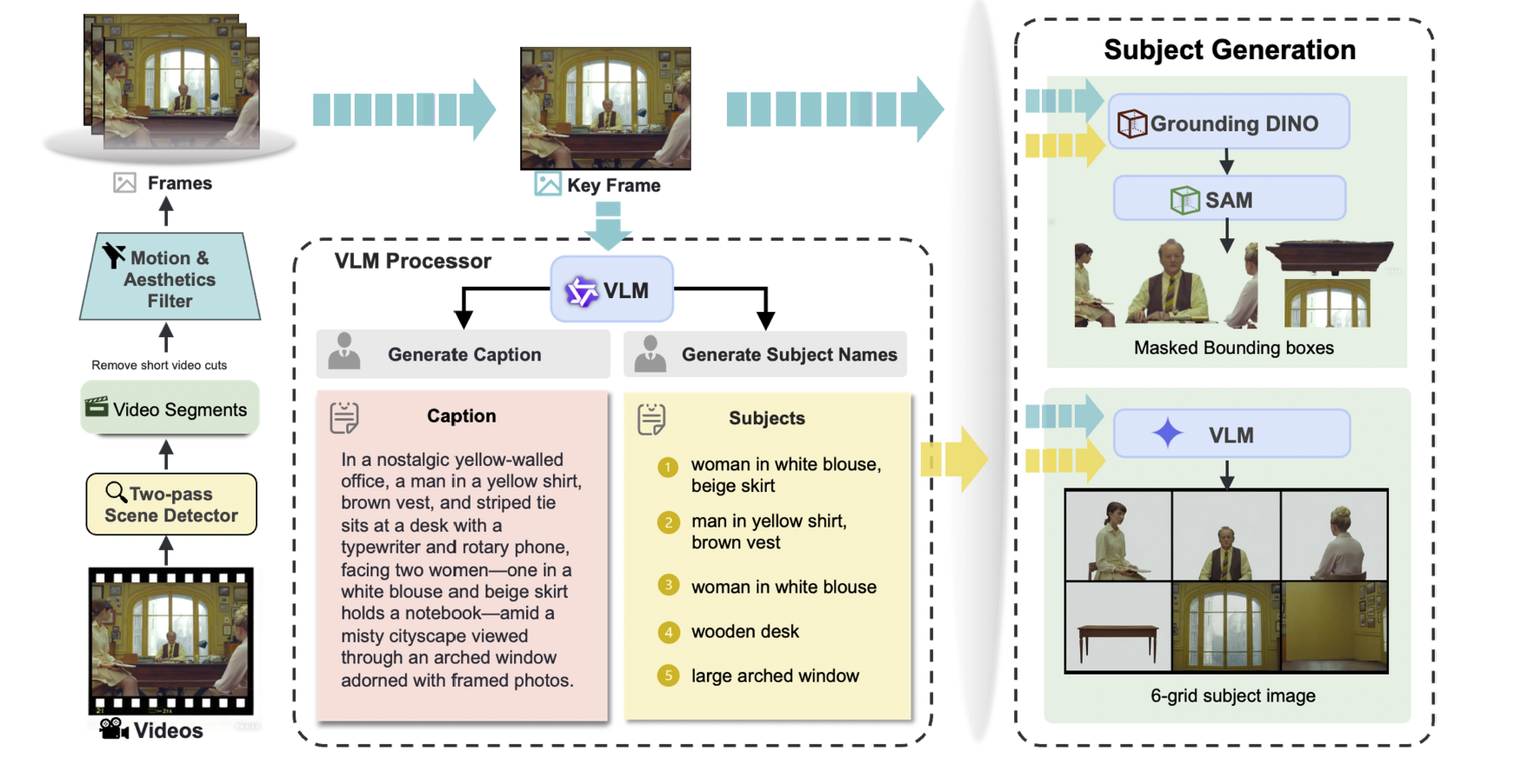

其中 Rtotal(V):=λqualRqual(V)+λidRid(V,I). \\mathcal{R}_{\\text{total}}(V) := \\lambda_{\\text{qual}} \\mathcal{R}_{\\text{qual}}(V) + \\lambda_{\\text{id}} \\mathcal{R}_{\\text{id}}(V, \\mathcal{I}). Rtotal(V):=λqualRqual(V)+λidRid(V,I). 这里,Rqual\\mathcal{R}_{\\text{qual}}Rqual 评估视频的感知质量,而 Rid\\mathcal{R}_{\\text{id}}Rid 衡量视频与参考图像集 I\\mathcal{I}I 之间的身份保持程度。权重 λqual\\lambda_{\\text{qual}}λqual 和 λid\\lambda_{\\text{id}}λid 用于平衡这两个目标。 ### 3.4 TRAINING DATA CURATION *** ** * ** ***  > 图 3:ID-COMPOSER 的数据整理流程。 现有的主体到视频生成方法在输出质量和多样性方面存在明显不足。这些缺陷主要源于成对训练数据的局限性,该类数据不足以刻画真实世界中主体运动、相机视角以及场景布局的复杂变化。为克服这些限制,我们提出了一条精细的数据整理流程,该流程充分利用了现代视觉-语言模型(VLM)(Bai 等, 2025)以及强大的图像编辑模型(Fortin 等, 2025)的能力。如图 3 所示,这一流程最终构建出一个大规模的复合数据集,经过精心打造,用于推动下一代多主体视频合成模型的发展。 该数据集由三类异构数据源组成。第一部分是从多样化的 OpenS2V-Nexus(Yuan 等, 2025)数据集中提取的主体-视频对,提供了丰富多样的真实场景和动作。第二部分是合成生成的数据,其中通过最前沿的图像编辑模型渲染的主体被置于全新的上下文中,从而系统性地提升了主体与背景组合的多样性。第三部分则是一批高保真的专业拍摄视频,并配有详细标注。更多技术细节见附录 C。 ## 4 EXPERIMENTS ### 4.1 EXPERIMENTAL SETTINGS *** ** * ** *** 实现细节 我们的模型 ID-COMPOSER 由 Wan-Video-1.3B 模型(Wan, 2025)的权重初始化。为利用更强的语义理解能力,我们采用双文本编码器架构,将 T5(Raffel 等, 2020)与 Qwen2.5-VL-7B-Instruct(Bai 等, 2025)结合使用。模型在我们整理的数据集上以 480p 分辨率训练了 30,000 次迭代,使用了 16 张 H20 GPU。推理阶段,我们使用 50 步的 Euler 采样器和无分类器引导(Ho \& Salimans, 2022)来调节图像与文本条件的影响,将无分类器引导系数设置为 2.5。 基线模型 我们将方法与支持原生主体到视频生成的最新开源模型进行对比基准测试,包括 Phantom(Liu 等, 2025b)和 SkyReels-A2(Fei 等, 2025)(均提供 1.3B 和 14B 参数规模的版本),以及 VACE(Jiang 等, 2025)。为进行更全面的评估,我们还与领先的商用系统进行定性对比,如 VIDU(Vidu, 2024)、Pika(Pika, 2024)和 Kling(keling, 2024)。 评估指标 参考 OpenS2V-Nexus(Yuan 等, 2025)的基准协议,我们在一个包含 180 个独特主体-文本对的多样化数据集上进行评测。我们报告了一系列自动化指标,包括 Aesthetics、Motion quality、Face Similarity(FaceSim),以及在三个基准上的对齐得分(GmeScore、NexusScore、NaturalScore)。Total Score 是这些指标的归一化加权和。更多细节见附录 D。