前言

近年来,人工智能技术迎来爆发式发展,AIGC、Agent、MCP等概念相继涌现并快速迭代,推动AI从单一工具向协同生态演进,AI技术从"能对话"进化到"能干活"。2022年ChatGPT点燃了AIGC;Function Calling催生了Agent;再往后,行业发现「如何让模型低成本地调用外部世界」成为新瓶颈,于是MCP、A2A和AG-UI三大协议陆续登场。

本文将梳理AIGC的基础能力、Agent以及支撑Agent生态的三大核心协议MCP、A2A和AG-UI,为读者朋友们构建从技术原理到应用生态的完整认知添砖加瓦。

AIGC - 人工智能内容生成的基石

AIGC(AI Generated Content,人工智能生成内容)是指利用大模型自动生成文本、图像、音频、视频等内容的技术,其兴起以2022年ChatGPT上线为标志,开启了生成式AI的浪潮。

ChatGPT上线后,Stable Diffusion、Midjourney等多模态模型跟进,把AI从"能答"推向"能画、能剪、能唱"。

但痛点也很快出现:

知识实效性 --- 大模型的知识主要来源于训练数据在某个截止日期之前的数据,对这个时间之后或者最新资讯,大模型可能并不了解。

幻觉 --- 本正经地编答案。

不可溯源/特定领域知识不足 --- 无法给出生成答案的集体数据来源,缺乏对某个特定领域/私有知识库的理解。

于是RAG(Retrieval-Augmented Generation,检索增强生成)被提出:先在外部知识库检索,再让模型基于检索结果生成答案,既实时又可验证。是一种将信息检索(IR)与大型语言模型(LLM)的文本生成能力相结合的人工智能框架。

RAG是AIGC领域的关键技术,其核心是将信息检索与LLM生成结合:当LLM需回答问题时,先从外部知识库检索相关信息,再基于这些信息生成答案,从而解决LLM的知识过时、易产生 "幻觉"、缺乏来源验证等问题。

例如,当询问"2025年最新AI协议进展"时,RAG会先检索2024年之后的相关资料,再让LLM基于检索结果生成准确回答,而非依赖模型训练日期截止前的旧知识。

Agent - 从生成工具到自主决策系统

Agent(智能体)是在AIGC、LLM等基础上发展的高阶AI系统,其核心特征是自主感知环境、决策并调用工具,以完成复杂任务。

与 AIGC(专注于生成任务)不同,Agent是集模型能力与工程实现于一体的复杂系统,需要处理模型和外界的信息交互(借助Function Calling实现),可集成AIGC作为子模块,实现更通用的任务处理。

核心优势:

- 获取实时信息,如调用ES等搜索引擎获取信息。

- 执行精准计算,如调用外部定义的代码。

- 操作外部系统,如发送邮件通知等。

MCP - AI的USB-C接口

Function Calling虽好,但不同厂商接口格式各异,工具一多就成了M×N噩梦。2024年,Anthropic开源MCP(Model Context Protocol),一个把模型与工具的"插头"标准化的开放协议。

MCP规范了应用程序如何向LLM提供上下文。将MCP想象成AI应用程序的USB-C端口。正如USB-C提供了一种将设备连接到各种外围设备和配件的标准化方式一样,MCP提供了一个将AI模型连接到不同数据源和工具的标准化方法。

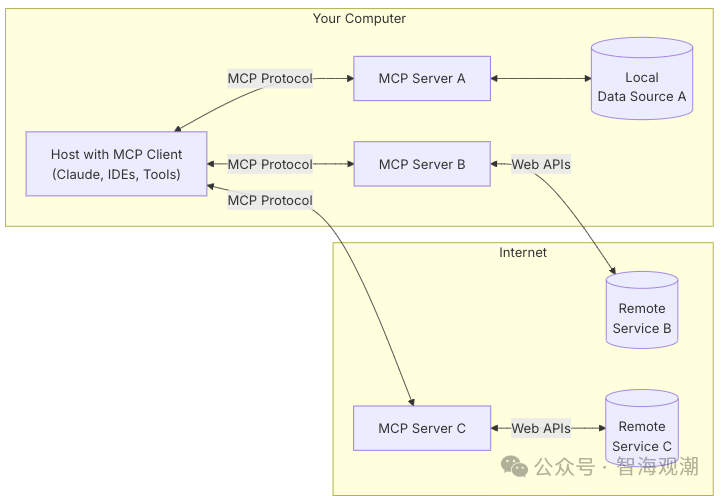

MCP角色划分如下:

MCP Hosts:像Claude Desktop、IDE或AI工具这样的程序,它们希望通过MCP访问数据。

MCP Clients:与服务器保持1:1连接的协议客户端。

MCP Servers:轻量级程序,每个程序都通过标准化的模型上下文协议公开特定的功能。

Local Data Sources(本地数据源):MCP服务器可以安全访问的计算机文件、数据库和服务。

Remote Services(远程服务):MCP服务器可以通过互联网(例如,通过API)连接到的外部系统。

腾讯、阿里、百度、AWS等随后把自家云服务封装成MCP Server,生态迅速膨胀,mcp.so、smithery.ai成了"插件商店"。

一句话总结:MCP让Agent长出了"手脚",且换工具像换USB设备一样简单。

A2A - Agent之间的"社交协议"

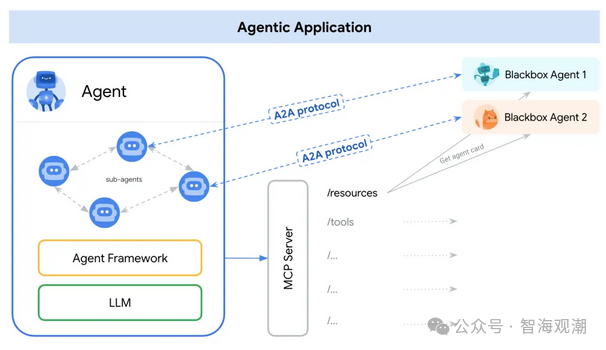

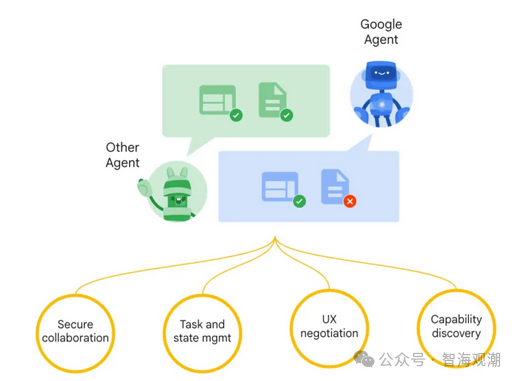

MCP解决了"Agent与工具"的通信。2025年,谷歌推出A2A(Agent-to-Agent)协议,让不同公司、不同框架的Agent可以彼此发现、协商、委任务。

(下图来源于:https://a2aprotocol.ai/)

A2A 作为一个开放协议,充分考虑了Agent在和用户、企业打通的过程中所面临的一些挑战,主要特性如下:

Capability discovery(功能发现):提供了Agent之间相互发现各自能力的机制。

Secure collaboration(安全协作):通过引入认证/授权机制,保证Agent之间的身份互信。

Task and state mgmt(任务状态管理):实现了Agent之间互操作任务以及任务状态的可管理性。

UX negotiation(用户体验协商):不同的Agent通过协商的方式,对用户提供无缝的体验。

目前多Agent系统的成功率仍相对较低,A2A更多处于实验阶段,但似乎已被视为下一波协作式AI应用的基石。

AG-UI - Agent与前端的双向通道

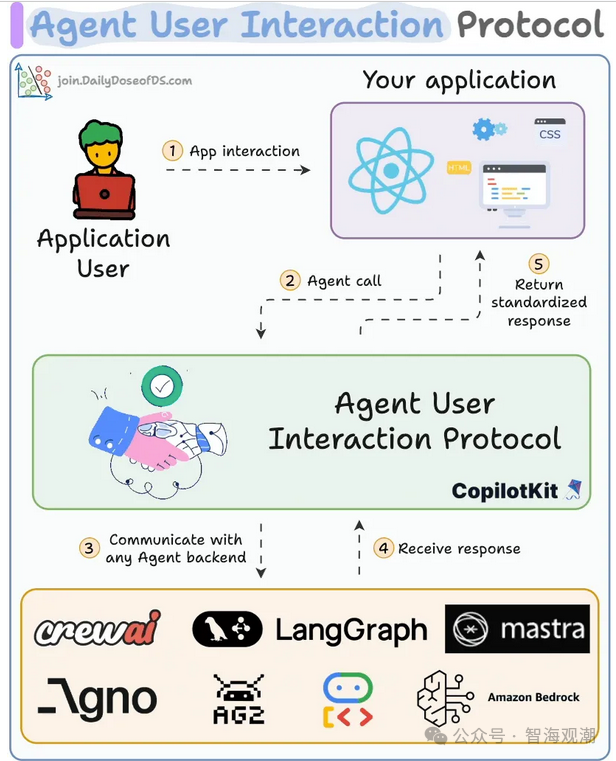

同样是2025年,CopilotKit团队开AG-UI(Agent-User Interaction Protocol,智能体用户交互协议),补完最后一环:让Agent与Web/App前端实时互动。

AG-UI是一个开放的、轻量的、基于事件的协议,通过标准HTTP或可选的二进制通道,以流式方式传输一系列JSON事件,主要用来对AI agent和前端应用程序的交互进行标准化。

(下图来源于https://webflow.copilotkit.ai/)

协议基于SSE/WebSocket流式通道,定义了四类事件:

- 消息文本事件,用于实时流式文本生成,处理对话内容。

- 工具调用事件,用于完整的工具调用生命周期管理,执行特定功能。

- 状态管理事件,用于状态同步,更新应用状态以确保客户端和服务端状态一致。

- 生命周期事件,进行执行控制,管理会话流程以及整个代理执行的生命周期。

当前Agent三大协议对比如下:

(下图来源于阿里云)