1 研究背景

1.1 MTS的重要性

工业多变量时间序列(MTS)是理解设备状态的核心依据,它被广泛应用于异常检测、剩余寿命预测、故障诊断等,也是训练高精度深度学习模型和构建工业大模型的基础。

1.2 现有生成方法的局限性

MTS数据因时间尺度、噪声水平及潜在特征差异而呈现异质性,加之各工业企业的数据隐私顾虑,特定场景下的工业时间序列数据稀缺,这一点制约了工业智能的发展。

目前主流的数据生成方法主要包括变分自编码器(VAEs)和生成对抗网络(GANs),但二者均存在显著不足。VAEs主要依赖重构损失函数,其核心目标是实现高效编码和稳定重构,这导致生成样本的真实性欠佳,难以有效捕捉工业数据的复杂特征。GANs采用生成器与判别器的对抗训练机制,但面临两个关键挑战:一是训练过程不稳定且收敛困难(工业数据噪声大、时序关系复杂,导致生成器难以学习有效规律,判别器则容易区分真假样本);二是条件一致性较差(需要额外训练分类器或判别器来实现条件控制,造成生成数据与输入条件的匹配度不足)。

1.3 扩散模型的潜力与不足

去噪扩散模型(DDPM)通过加噪和去噪的过程学习数据分布,在图像生成领域表现优异。但由于工业MTS数据中具有非平稳性,且涉及复杂的时间依赖关系,DDPM难以处理它的动态变化,生成的时序数据保真度不足。

因此,本文提出了一种时序增强型条件自适应模型------差分多时间序列(Diff-MTS),旨在解决 GANs的训练不稳定性、条件一致性差,以及传统扩散模型时序捕捉能力弱的问题,生成高质量工业MTS数据。

2 核心思想与模型框架

2.1 整体设计思路

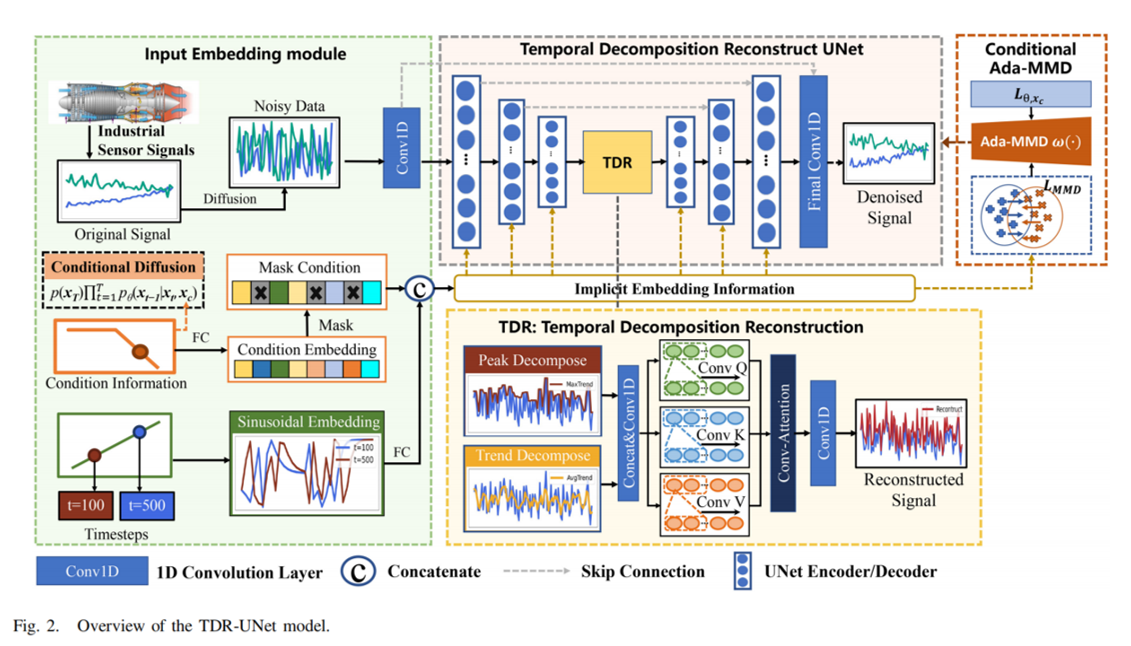

Diff-MTS主要由三大部分组成:条件DDPMs、条件自适应最大均值差异扩散方法(Ada- MMD)、时序分解重构网络(TDRUNet)。模型处理流程:首先,将工业传感器信号、条件信息与时间步经输入嵌入模块处理;接着,嵌入后的信息输入TDR-UNet模块,通过编码器进行特征提取,再使用TDR通过时序分解和注意力机制实现重建;随后,重建后的信息输入解码器;最后,结合Ada-MMD机制计算正则化损失以提升条件一致性,实现工业多元时间序列的生成。

2.2 三大核心模块详细解析

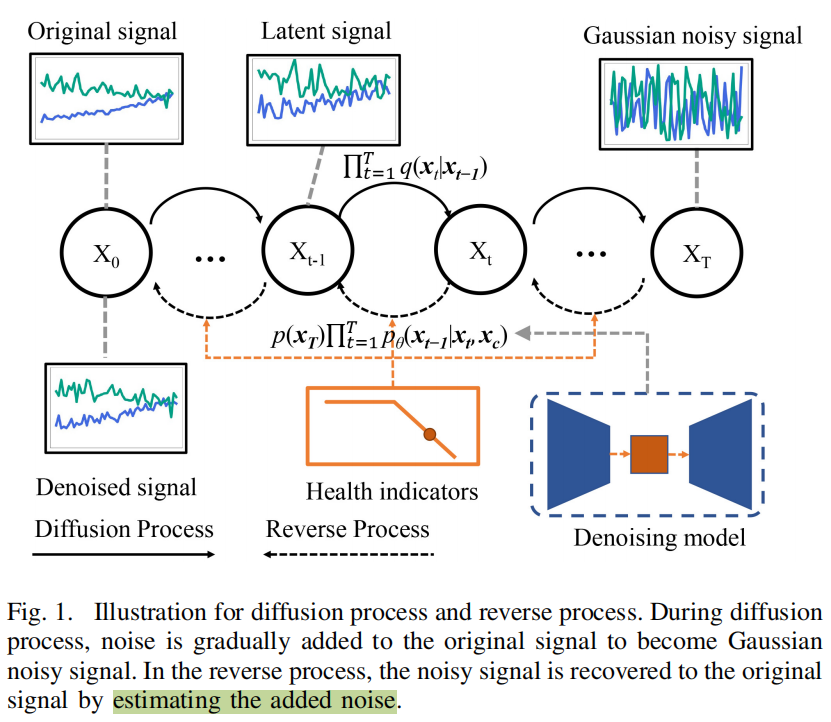

2.2.1 去噪扩散概率模型(DDPM基础)

该方法在传统DDPM的反向过程引入健康指标作为条件信息,修改反向过程的概率公式如下:

定义为扩散模型前向过程中所加的真实噪声,

为反向过程中预测的噪声。通过以下方式来最小化噪声估计损失:

在原始的DDPM工作中,作者采用了线性噪声调度:

然而,在复杂的信号处理场景中,这种调度方式难以达到最佳效果。强线性调度会导致噪声时间序列快速退化为纯噪声,从而加速了噪声引入阶段的信息丢失。为解决这一问题,本文采用了余弦调度方案:

余弦调度旨在噪声生成过程中更长时间内保留噪声时间序列中的信息,更适合时序数据。

2.2.2 条件自适应最大均值差异(Ada-MMD)

Ada-MMD旨在解决传统扩散模型在实现条件生成时必须额外训练分类器、条件一致性差的问题,核心是无分类器引导和自适应条件对齐。

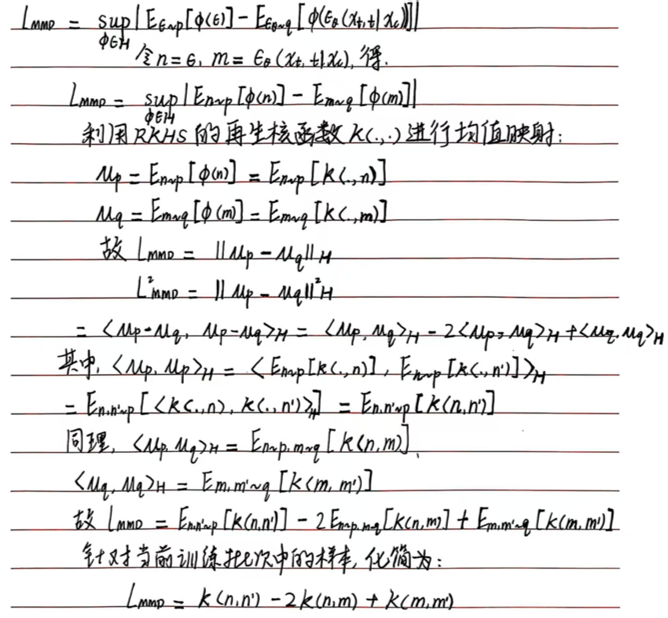

(1)核心思想

最大均值差异(MMD)是衡量两个分布差异性的指标,它通过核函数将数据映射到高维特征空间,计算两个分布的均值差异。差异越小,代表两个分布越接近。它的自适应机制使得模型可以不用依靠外部分类器,能够自动学习给定条件和生成数据之间的互信息。

(2)关键公式

将设为

,

设为

,

为正定核函数,则噪声之间的分布差异

的推导过程如下:

最终可表示为:

为了平衡保真度和条件一致性,总损失函数如下:

其中,是自适应权重,根据训练进度调整

的重要性。在训练初期,模型需要重点学习工业MTS数据的分布规律。在模型具备生成基本真实的工业MTS数据后,需要逐步提高对条件信息的关注度,实现可控生成。

2.2.3 时序分解重构网络(TDR-UNet)

传统的UNet难以捕捉工业MTS数据中复杂的时序依赖关系,TDR-UNet在此基础上引入了时序分解技术,并结合注意力机制实现了数据的重构。

(1)模块结构

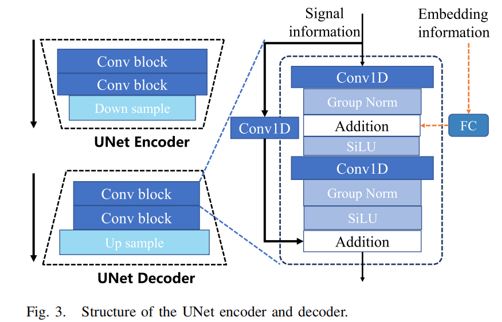

TDR-UNet主要包括输入嵌入模块和时序分解重构模块,模型架构图如下所示:

其中编码器-解码器结构如下:

①输入嵌入模块

该模块需要对输入进行嵌入处理。使用一维卷积层对进行嵌入处理:

使用正弦位置编码和两层全连接网络将离散时间步转化为连续特征,让模型理解加噪阶段:

使用全连接层和掩码机制处理条件,增强模型对条件的感知:

用来控制条件信息的强度,防止过拟合。

②时序分解重构模块

对于经过编码器处理的特征,用平均池化提取趋势特征,捕捉数据整体变化规律:

用最大池化提取峰值特征,捕捉数据的突变:

将趋势和峰值特征进行拼接,送入卷积块:

通过卷积注意力机制强化关键时序信息的捕捉:

其中:

,

,

是卷积生成的查询、键、值矩阵,

是缩放因子,避免梯度爆炸;

最后通过1维卷积层重构时序特征,再经解码器恢复到原始数据维度,输出预测噪声。

(2)核心优势

该警告采用分解-重构策略,将复杂时序数据分解为"可预测趋势项"和"波动峰值项",并运用注意力机制聚焦关键特征,使模型能够准确捕捉工业多变量时序数据中的非平稳依赖关系和动态变化规律。

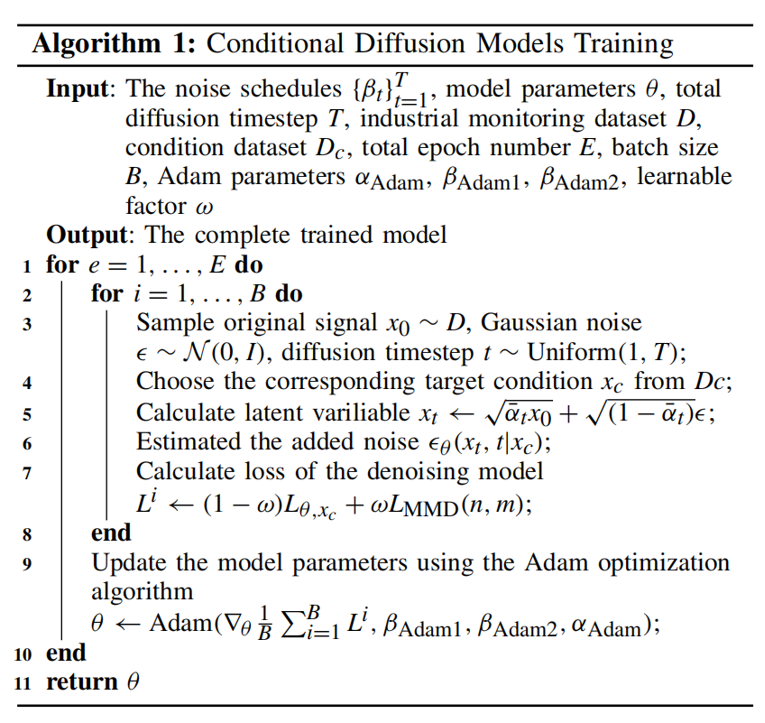

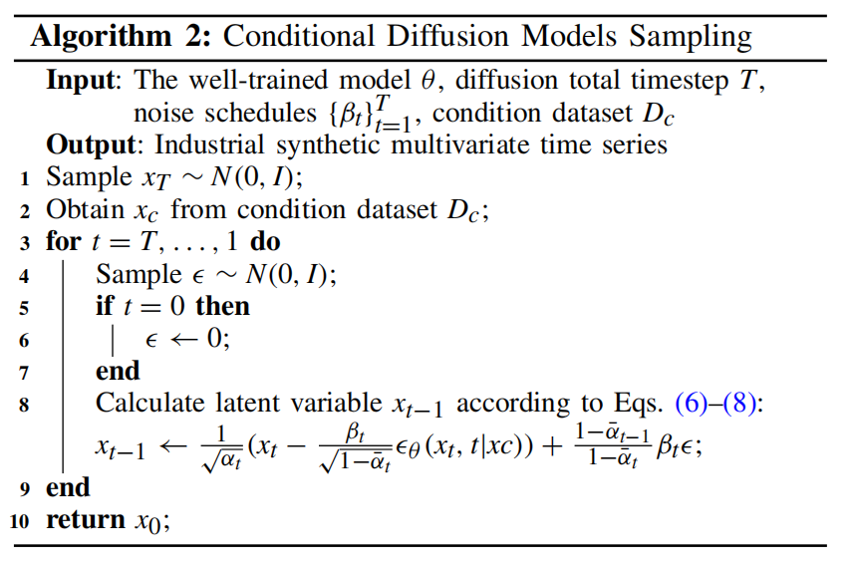

2.3 训练与采样流程

2.3.1 训练流程

2.3.2 采样流程

3 总结

本研究提出的Diff-MTS模型创新性地采用"时序增强+条件自适应"策略,有效攻克了工业多变量时序数据生成的三大关键挑战:首先,采用扩散模型替代传统GAN框架,从根本上规避了对抗训练的不稳定性问题;其次,创新设计Ada-MMD机制,无需依赖分类器即可实现高度条件一致性;最后,构建TDR-UNet网络架构,显著提升了模型对复杂时序依赖关系的捕捉能力。