在人工智能与量子计算交汇的时代,图像识别技术正迎来前所未有的范式转变,面对数据量的急剧增长和模型复杂度的不断攀升,传统的深度学习方法正逐步逼近其计算瓶颈。与此同时,量子计算以其指数级并行性为机器学习提供了新的加速途径,尤其是在模式识别、特征提取与概率分布建模等任务中,展现出超越经典算法的潜力。

据了解,微美全息(NASDAQ:WIMI)作为行业内领先的量子算法研发机构,在深入研究量子卷积神经网络(QCNN)的基础上,提出了一种新型的混合量子-经典学习技术。该技术通过创新性地回收被丢弃的量子比特状态信息,并与经典全连接层(FC)联合训练,实现了在多类图像分类任务上的显著性能提升。

图像分类是人工智能的核心应用之一。从人脸识别到医学影像分析,深度卷积神经网络(CNN)已成为主流。然而,随着模型深度增加,其训练时间与计算能耗呈指数级增长,对硬件算力的依赖愈发强烈。即便在GPU集群或TPU阵列的支持下,模型优化仍受到瓶颈制约。另一方面,数据安全、隐私保护与计算能效等问题,正在迫使学术界与产业界重新思考智能计算的底层架构。

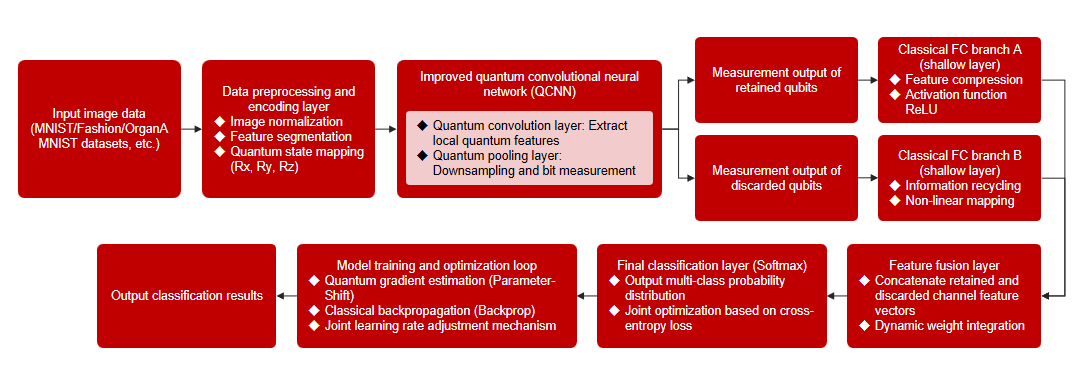

为了综合解决关键问题,微美全息设计了一种混合量子-经典学习架构(Hybrid Quantum-Classical Learning Architecture)。该架构的核心创新在于同时利用保留量子比特与被丢弃量子比特的信息,从而在特征层面上实现量子信息的最大化利用。

在传统QCNN中,经过若干量子卷积层与量子池化层后,部分量子比特被测量或移除,以减少系统维度并实现下采样操作。经典CNN中的池化操作会选择性保留高激活特征,而QCNN的池化通常通过测量或丢弃部分量子比特来实现。由于量子纠缠的存在,被丢弃的量子比特与保留比特之间往往存在非局域的量子相关性,直接丢弃这部分量子比特等同于信息损失。

微美全息提出的架构中,所有被丢弃量子比特在测量后,其测量结果将被保留并输入到一个独立的经典全连接分支中。同时,保留量子比特的测量结果则输入另一个全连接分支。这两个分支分别执行非线性变换与特征压缩,之后在融合层中进行向量级拼接与权重整合。最终,融合后的综合特征通过一个联合分类层完成最终预测。

这种结构可以被看作是一种量子-经典双通道特征融合网络。它不仅弥补了QCNN在池化阶段的量子信息损失,还能通过联合优化策略让量子参数(由量子门角度决定)与经典参数(由权重矩阵决定)协同进化,从而实现全局性能的自适应提升。

更为关键的是,微美全息设计了一种动态学习率调整机制。量子部分采用较高的初始学习率以加速量子态探索,而经典部分则以平稳收敛为目标逐步降低学习率。通过这种策略,在MNIST、Fashion-MNIST及OrganAMNIST等数据集上均实现了优于现有轻量级模型的性能表现。

这项技术的意义在于,它重新定义了混合量子-经典学习模型的信息利用方式。传统量子神经网络在结构上追求量子纯粹性,即尽可能保持全量子化处理过程。而微美全息的研究显示,在当前量子硬件条件下,量子与经典的协同共融反而是实现实际性能突破的关键。通过充分利用被丢弃量子比特的信息,打破了量子池化即信息损失的固有假设,使量子计算能够在信息利用率与能效之间取得平衡。

微美全息用于多类图像分类的混合量子-经典学习技术,代表着一种新型量子智能的方向。它不依赖于理想化的量子硬件,而是在现实的NISQ限制下探索可行的最优路径。这一成果在量子计算逐步走向实用化的未来,成为连接理论与产业的关键桥梁,将为智能视觉、医学诊断、自动驾驶等领域带来颠覆性的创新力量。