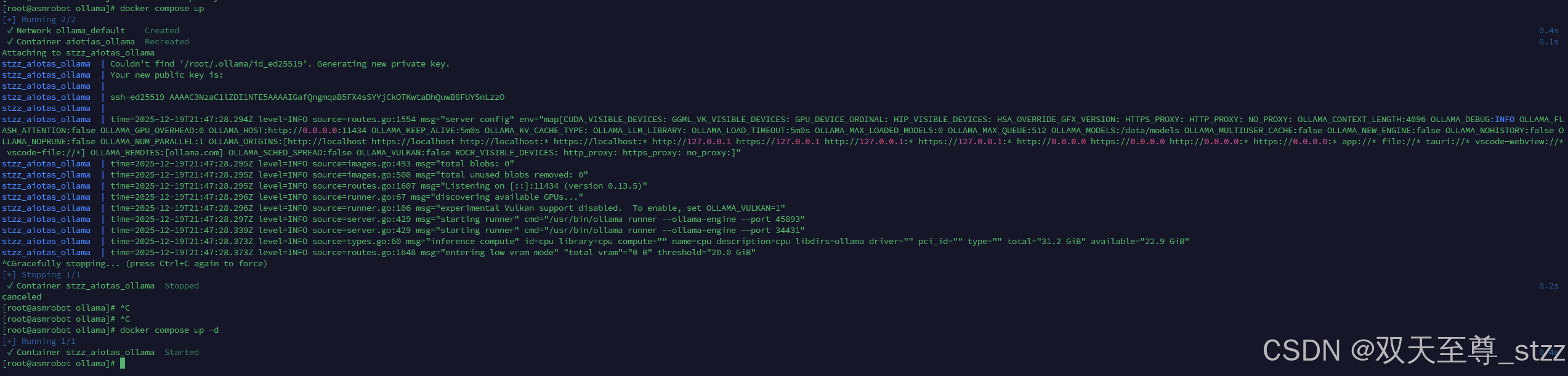

创建并配置docker-compose.yml:

bash

services:

ollama:

restart: always

image: ollama/ollama:latest

container_name: stzz_aiotas_ollama

ports:

- "11434:11434"

environment:

- OLLAMA_HOST=0.0.0.0:11434

- OLLAMA_MODELS=/data/models

volumes:

- ./data:/root/.ollama

- ./models/:/data/models