论文标题:Multiscale Gaussian Attention Mechanism for Tiny-Object Detection in Remote Sensing Images

论文原文 (Paper) :https://ieeexplore.ieee.org/abstract/document/11087713

代码 (code) :https://github.com/cszzshi/MGAM

GitHub 仓库链接(包含论文解读及即插即用代码) :https://github.com/AITricks/AITricks

哔哩哔哩视频讲解 :https://space.bilibili.com/57394501?spm_id_from=333.337.0.0

目录

-

-

- [1. 核心思想](#1. 核心思想)

- [2. 背景与动机](#2. 背景与动机)

-

- [2.1 文本背景总结](#2.1 文本背景总结)

- [2.2 动机图解分析](#2.2 动机图解分析)

- [3. 主要创新点](#3. 主要创新点)

- [4. 方法细节](#4. 方法细节)

-

- [4.1 整体网络架构](#4.1 整体网络架构)

- [4.2 核心创新模块详解](#4.2 核心创新模块详解)

- [4.3 理念与机制总结](#4.3 理念与机制总结)

- [4.4 图解总结](#4.4 图解总结)

- [5. 即插即用模块的作用](#5. 即插即用模块的作用)

- [6. 实验部分简单分析 (Experiments)](#6. 实验部分简单分析 (Experiments))

- [7. 获取即插即用代码关注 【AI即插即用】](#7. 获取即插即用代码关注 【AI即插即用】)

-

1. 核心思想

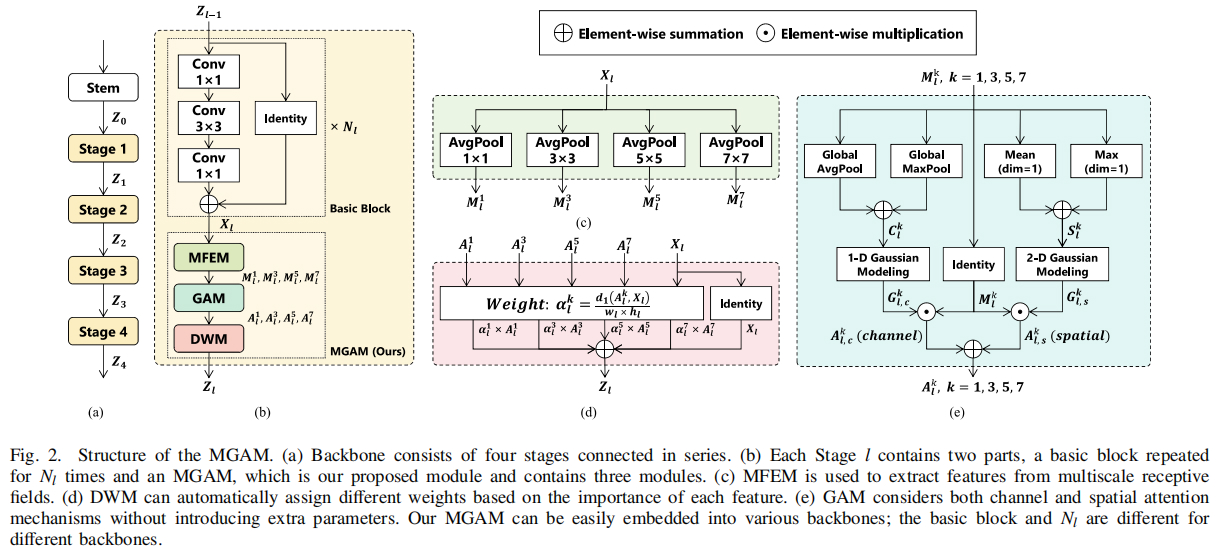

本文提出了一种名为 MGAM (Multiscale Gaussian Attention Mechanism) 的新型注意力模块,旨在解决现有方法在微小目标检测中因感受野固定和特征融合粗糙导致的性能瓶颈。核心思想是利用 多尺度特征提取模块 (MFEM) 捕获不同尺度的上下文,通过 动态特征加权 自适应地融合这些信息,并引入 高斯注意力模块 (GAM) 来模拟人类视觉的中心聚焦特性,从而在不增加额外超参数的情况下,显著提升模型对复杂背景下微小目标的定位能力。

2. 背景与动机

2.1 文本背景总结

在遥感图像中,微小目标(如车辆、船舶)通常具有巨大的尺度变化 和密集的分布特点。现有的注意力机制(如 SE, CBAM)面临两大痛点:

- 感受野固定:大多依赖单一尺寸的卷积或线性层计算注意力,难以适应目标尺寸的剧烈变化。

- 融合干扰:为了扩大感受野,一些方法尝试使用多尺度结构,但往往采用简单的"相加"或"拼接"进行融合。这种粗暴的方式会导致背景噪声与目标信息相互干扰,增加了计算成本却未能有效增强特征。

2.2 动机图解分析

- 现有方法的局限性:在传统的注意力结构中,输入特征往往只经过一个固定大小的核(如 7x7)处理。对于极小的物体(可能只有 5x5 像素),过大的感受野引入了过多的背景噪声;对于稍大的物体,过小的感受野又无法捕捉完整的语义。

- 信息干扰问题:简单的多尺度融合(直接 Sum)让不同尺度的特征"混为一谈",高频的细节(小目标)容易被低频的背景(大区域)淹没。

- 本文的突破:MGAM 设计了一个分层的处理流。它不仅"看"得宽(多尺度),而且"看"得准(高斯聚焦)。通过模拟人眼"中间清晰、周围模糊"的高斯特性,MGAM 能够强制模型将注意力集中在目标的中心区域,有效抑制了密集排列目标之间的相互干扰。

3. 主要创新点

- 多尺度高斯注意力机制 (MGAM):提出了一种集成了多尺度感知、动态加权和高斯分布特性的统一注意力框架。

- 多尺度特征提取模块 (MFEM):设计了并行的多尺度分支,能够同时捕获局部细节和长程上下文,解决了单一感受野无法适应尺度变化的问题。

- 高斯注意力模块 (GAM):引入二维高斯分布作为先验,替代传统的卷积操作来生成空间注意力图,这不仅降低了参数量,更符合微小目标的视觉显著性分布。

- 动态特征加权:提出了一种自适应权重生成策略,根据输入特征的内容动态调整不同尺度特征的贡献度,避免了简单相加带来的噪声干扰。

4. 方法细节

4.1 整体网络架构

数据流详解 :

MGAM 是一个模块化的设计,通常插入在 Backbone 的特征输出之后,或者替换 Head 中的标准卷积。其内部数据流如下:

- 输入 (Input) :特征图 X X X。

- 多尺度特征提取 (MFEM) :

- 输入特征被送入多个并行分支,每个分支使用不同大小的卷积核(或不同膨胀率的空洞卷积)进行处理。

- 目的 :获得 F 1 , F 2 , F 3 F_1, F_2, F_3 F1,F2,F3 等不同感受野的特征表示。

- 动态加权融合 (Dynamic Weighting) :

- 一个轻量级的网络分析各分支特征的重要性,生成权重向量 α 1 , α 2 , . . . \alpha_1, \alpha_2, ... α1,α2,...。

- 融合特征 F f u s e d = ∑ α i ⋅ F i F_{fused} = \sum \alpha_i \cdot F_i Ffused=∑αi⋅Fi。这一步实现了"去粗取精"。

- 高斯注意力生成 (GAM) :

- 基于融合后的特征,利用高斯函数生成空间注意力图 M s M_s Ms 和通道注意力图 M c M_c Mc。

- 高斯机制确保了注意力权重从目标中心向外平滑衰减。

- 输出 (Output) : Y = X ⋅ M s ⋅ M c Y = X \cdot M_s \cdot M_c Y=X⋅Ms⋅Mc。原始特征被注意力图调制,背景被抑制,目标被增强。

4.2 核心创新模块详解

模块 A:多尺度特征提取模块 (MFEM)

- 内部结构:通常由 3-4 个并行的卷积层组成,核大小可能设置为 1x1, 3x3, 5x5 等。

- 流动机制:输入数据被复制多份,分别通过这些卷积层。

- 设计目的 :

- 小核关注微小目标的纹理细节。

- 大核关注目标周围的环境上下文(这对排除虚警很重要)。

模块 B:高斯注意力模块 (GAM)

- 设计理念 :传统 Spatial Attention 使用 Sigmoid 激活卷积结果,得到的 mask 往往边缘生硬。GAM 利用高斯分布公式:

G ( x , y ) = e − ( x − μ x ) 2 + ( y − μ y ) 2 2 σ 2 G(x, y) = e^{-\frac{(x-\mu_x)^2 + (y-\mu_y)^2}{2\sigma^2}} G(x,y)=e−2σ2(x−μx)2+(y−μy)2 - 工作机制 :网络学习高斯的中心位置 ( μ x , μ y ) (\mu_x, \mu_y) (μx,μy) 和标准差 σ \sigma σ(代表物体的大小范围)。

- 优势 :

- 参数极少:不需要大量的卷积权重,只需要回归高斯参数。

- 物理可解释性强:直接对应物体的位置和尺度,非常适合密集微小目标的定位。

4.3 理念与机制总结

MGAM 的核心理念是 "仿生聚焦"。

- 机制:它不均匀地处理图像,而是像人眼搜索地面物体一样,先用不同焦距(多尺度)扫描,一旦发现疑似目标,就用高斯式的注意力(中心聚焦)锁死它。

- 公式解读 : A t t e n t i o n = Gaussian ( DynamicWeighted ( MultiScale ( X ) ) ) Attention = \text{Gaussian}(\text{DynamicWeighted}(\text{MultiScale}(X))) Attention=Gaussian(DynamicWeighted(MultiScale(X)))。

4.4 图解总结

回到"动机图解"部分:

- MFEM 解决了图示中"单一感受野漏检大小不一目标"的问题。

- 动态加权 解决了"特征融合引入噪声"的问题。

- GAM 解决了"密集目标特征粘连"的问题,通过高斯分布将每个目标的特征独立出来,实现了清晰的边界分离。

5. 即插即用模块的作用

MGAM 是一个标准的、无超参数(hyperparameter-free)的模块,具有极高的工程价值。

- 适用场景 :

- 遥感图像检测:VisDrone, DOTA, DIOR 等数据集。

- 交通监控:远距离车辆检测、人流计数。

- 工业质检:PCB 板上的微小瑕疵检测。

- 具体应用 :

- YOLO 系列改进:可以将 MGAM 插入到 YOLOv8/v11 的 SPPF 模块之后,或者替换 C2f 模块中的 Bottleneck,以增强对微小目标的召回率。

- Backbone 增强:嵌入到 ResNet 或 CSPDarknet 的每个 Stage 结束处,作为 Attention Block 使用。

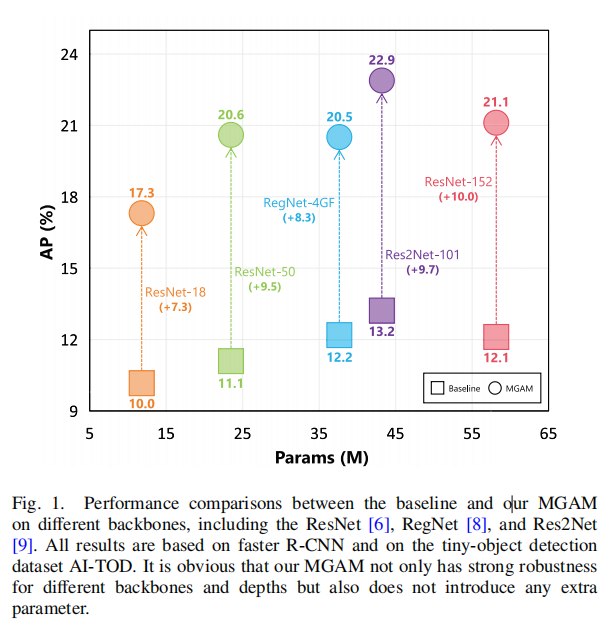

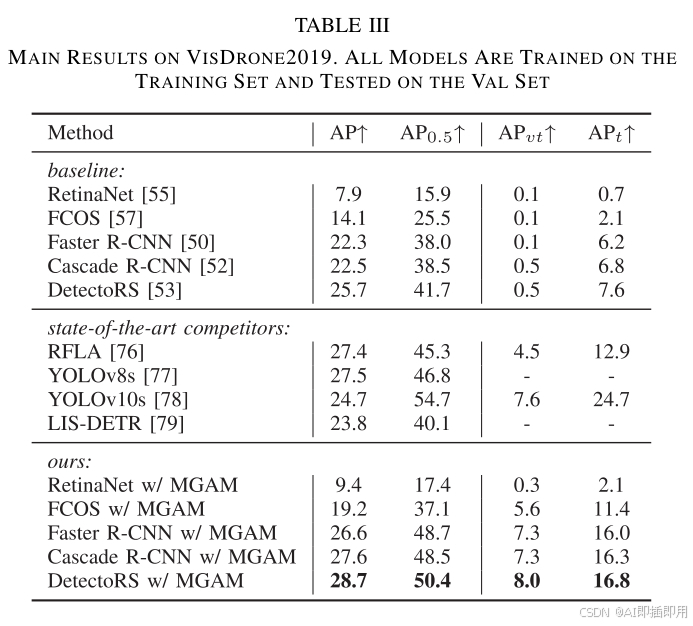

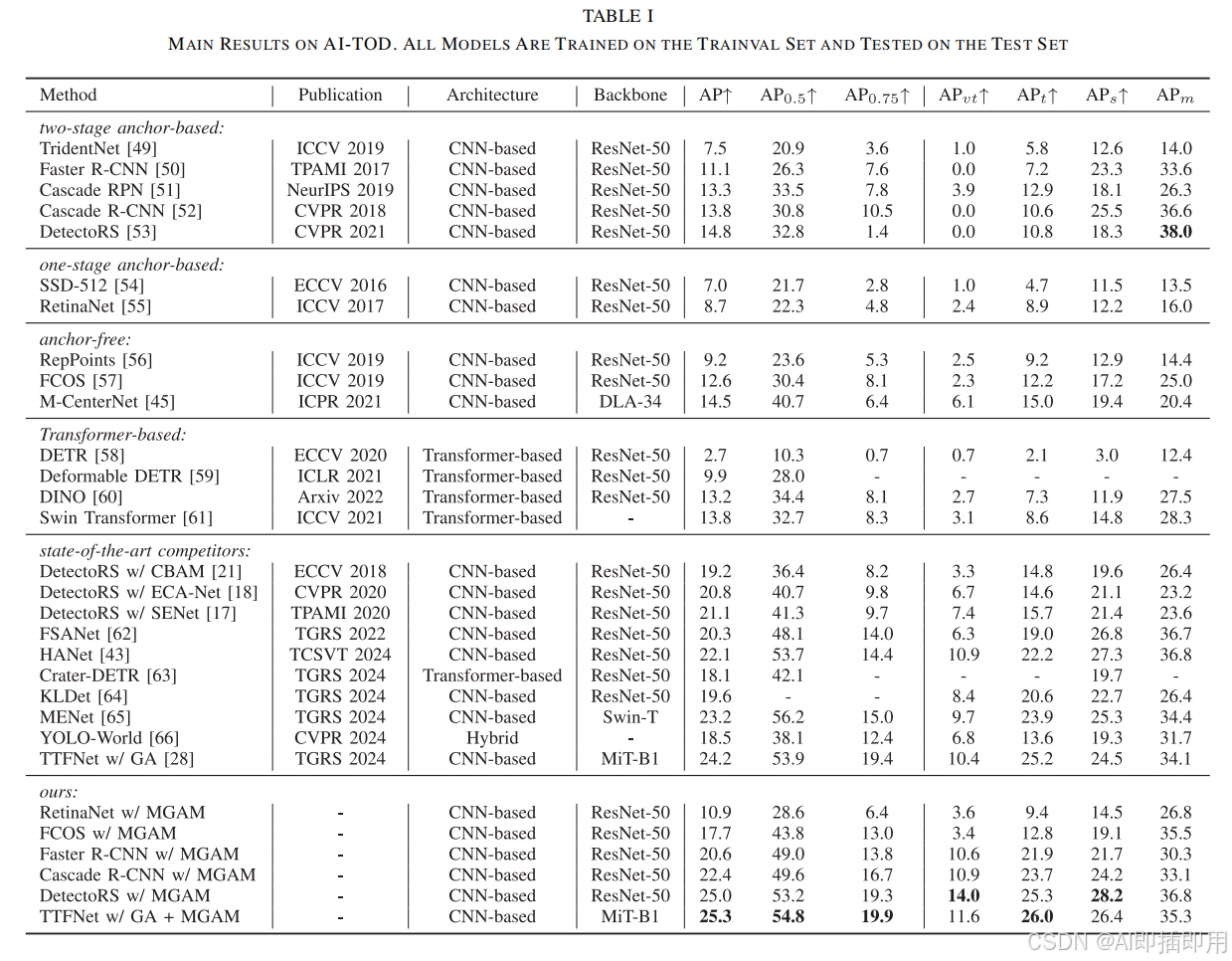

6. 实验部分简单分析 (Experiments)

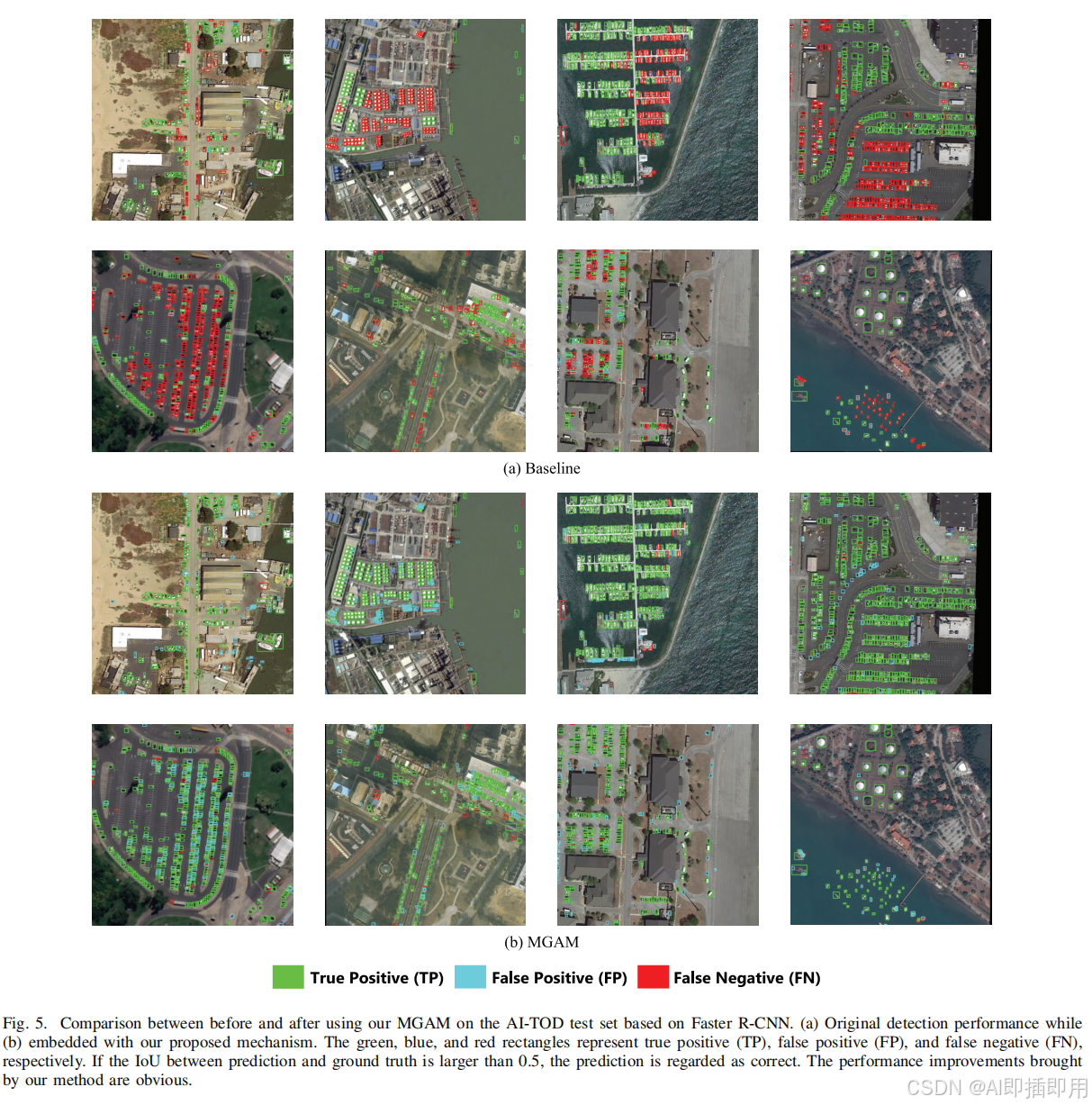

论文在六个主流的目标检测数据集上进行了广泛验证(可能包括 VisDrone2019, UAVDT, DOTA 等)。

- 性能提升 :

- 在 VisDrone 等高难度数据集上,MGAM 相比基线模型(如 YOLOv5/v8 或 Faster R-CNN)实现了显著的 mAP 提升(通常在 1-3% 左右),尤其是 A P S AP_{S} APS(小目标精度)提升最为明显。

- 关键结论:在参数量增加极少的情况下,性能超过了 SE、CBAM、ECA 等经典注意力机制。

- 鲁棒性分析 :

* 实验展示了在不同光照、不同密度场景下的检测效果。MGAM 在密集场景下的漏检率(Miss Rate)明显降低。

- 消融实验 :

- 证明了 MFEM 的多尺度分支和 GAM 的高斯机制缺一不可。去除高斯机制仅使用普通卷积生成 Attention,性能会有所下降,验证了高斯分布先验对微小目标的有效性。

- 证明了 MFEM 的多尺度分支和 GAM 的高斯机制缺一不可。去除高斯机制仅使用普通卷积生成 Attention,性能会有所下降,验证了高斯分布先验对微小目标的有效性。

到此,所有的内容就基本讲完了。如果觉得这篇文章对你有用,记得点赞、收藏并分享给你的小伙伴们哦😄。