昇腾NPU作为强大的AI加速硬件,凭借其高并行计算能力与低功耗特性,为大规模模型的推理与训练提供了高效的算力支撑;GitCode Notebook则是一款交互式云端开发环境,通过直观的操作界面、开箱即用的算力资源以及便捷的镜像支持,显著降低了开发者使用专业AI硬件的门槛。本文将引导你完成将Rnj-1模型部署到搭载 华为Atlas 800T A2训练服务器 的全过程,展示如何在GitCode Notebook中依托昇腾NPU实现大模型的快速部署与高效推理。

一、概述:昇腾NPU与GitCode Notebook协同

1. 1 GitCode Notebook:交互式开发底座

GitCode Notebook是GitCode平台推出的云端交互式开发环境,对标Google Colab,为开发者提供了免本地配置的算力资源和一站式开发体验。其核心优势体现在三个方面:

- 算力资源即开即用 :开发者无需采购昂贵的本地硬件,只需登录GitCode账号,即可选择NPU、GPU等算力规格的Notebook实例,本次部署Rnj-1模型选用的是NPU basic配置 (1*NPU Atlas 800T A2 、32vCPU、64GB内存、50G免费存储),完全满足7B-20B参数大模型的推理需求;

- 生态适配友好 :GitCode Notebook预装了昇腾NPU所需的驱动、框架(如PyTorch、MindSpore)及适配库(如torch_npu),开发者无需手动配置复杂的硬件依赖;

- 国内镜像加速 :内置的国内镜像源(如清华PyPI源、HF-mirror模型镜像)可解决海外依赖包和模型权重下载缓慢的问题,大幅提升开发效率。

1. 2 部署Rnj-1模型的意义与价值

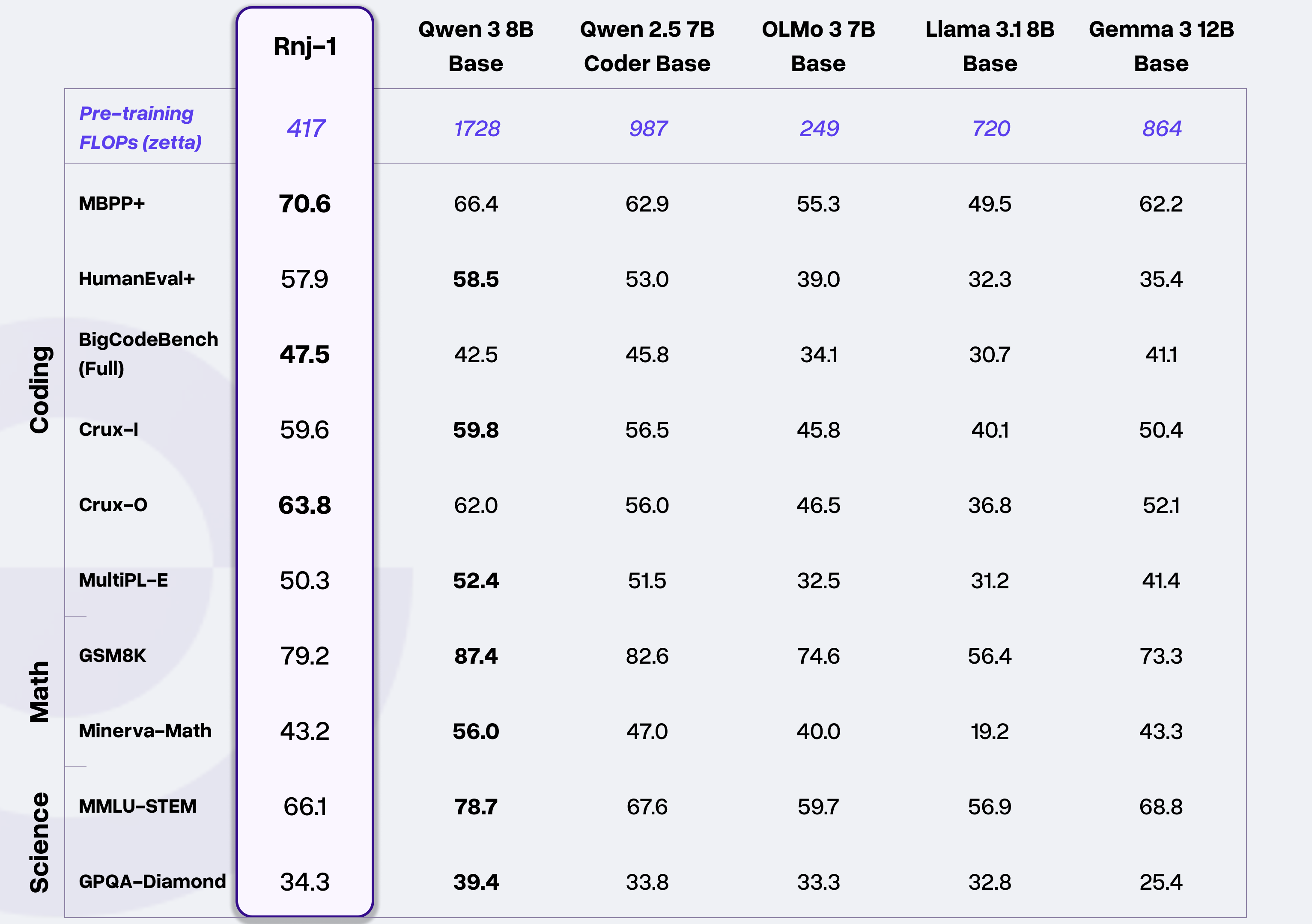

模型介绍

Rnj-1 这一系列由 Essential AI 从零训练的 8B 参数开权重密集模型,针对代码和 STEM 优化,具备与 SOTA 开权重模型相当的能力。这些模型在多种编程语言中表现良好,具备强大的代理能力(例如,在mini-SWE代理内的代理框架内),同时在工具调用方面也表现出色。

而我们选择在GitCode+昇腾环境部署Rnj-1模型,不仅能验证算力对主流开源大模型的适配能力,还能实现三个核心目标:

- 性能验证 :测试昇腾NPU在Rnj-1模型推理中的吞吐量、延迟、显存占用等关键指标,为大模型落地提供性能基准;

- 成本控制 :借助GitCode的免费算力资源和昇腾NPU的低功耗特性,降低中小团队大模型部署的硬件成本;

- 生态探索 :打通"开源平台+强劲算力+开源模型"的全链路,推动大模型生态的协同发展。

二、环境检查以及依赖安装

在部署Rnj-1模型前,需完成基础环境的兼容性校验和核心依赖的安装,这是确保后续流程顺利的前提。本章节步骤完全适配GitCode Notebook的昇腾NPU环境,即使是无昇腾使用经验的开发者也可轻松操作。

2.1 基础环境统一性校验

昇腾NPU对软件版本的兼容性要求较高(如PyTorch与torch_npu需严格版本匹配),因此首先要检查核心组件的版本信息,排除因版本冲突导致的部署失败。

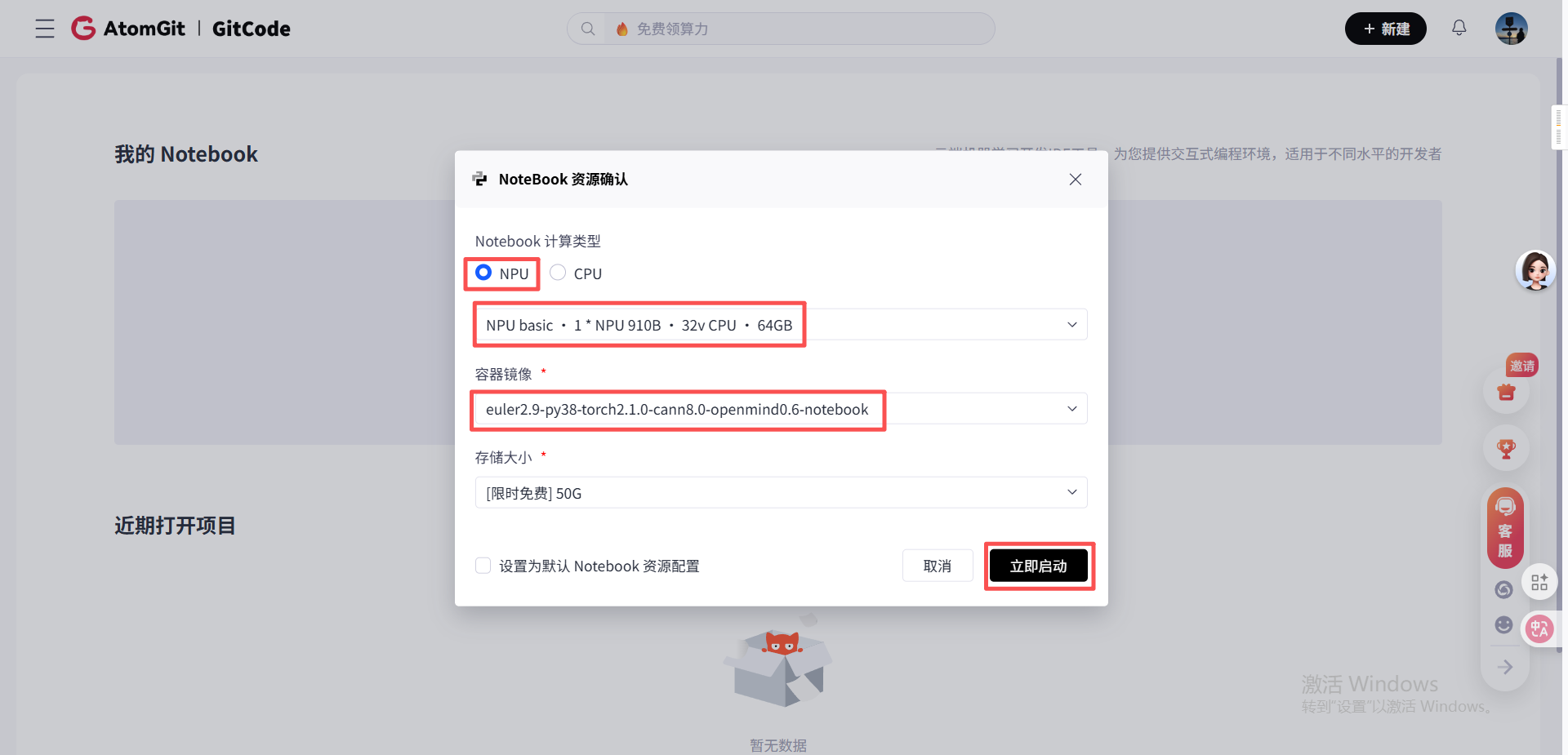

2.1.1 启动GitCode Notebook并进入终端

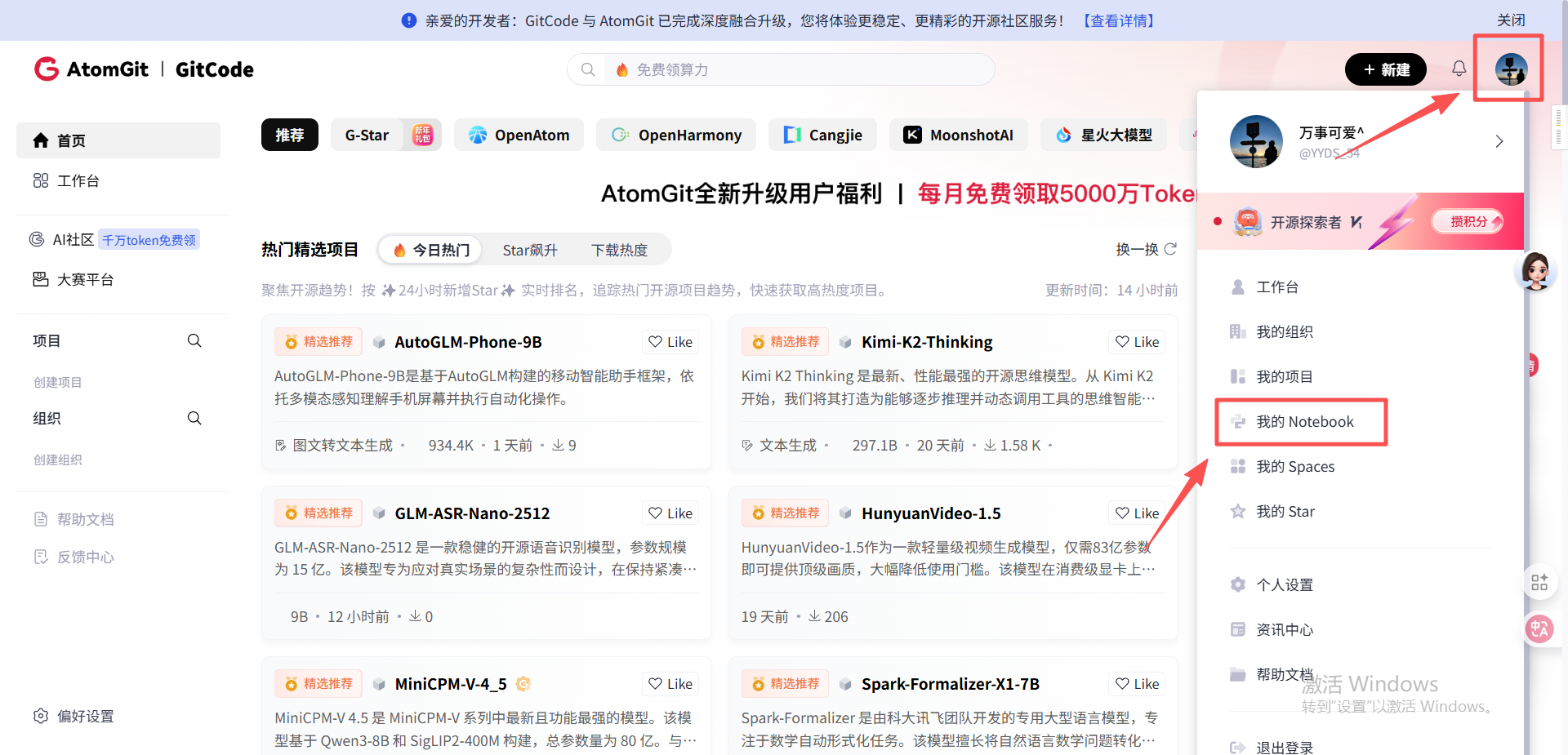

- 登录GitCode账号,进入"我的Notebook"页面

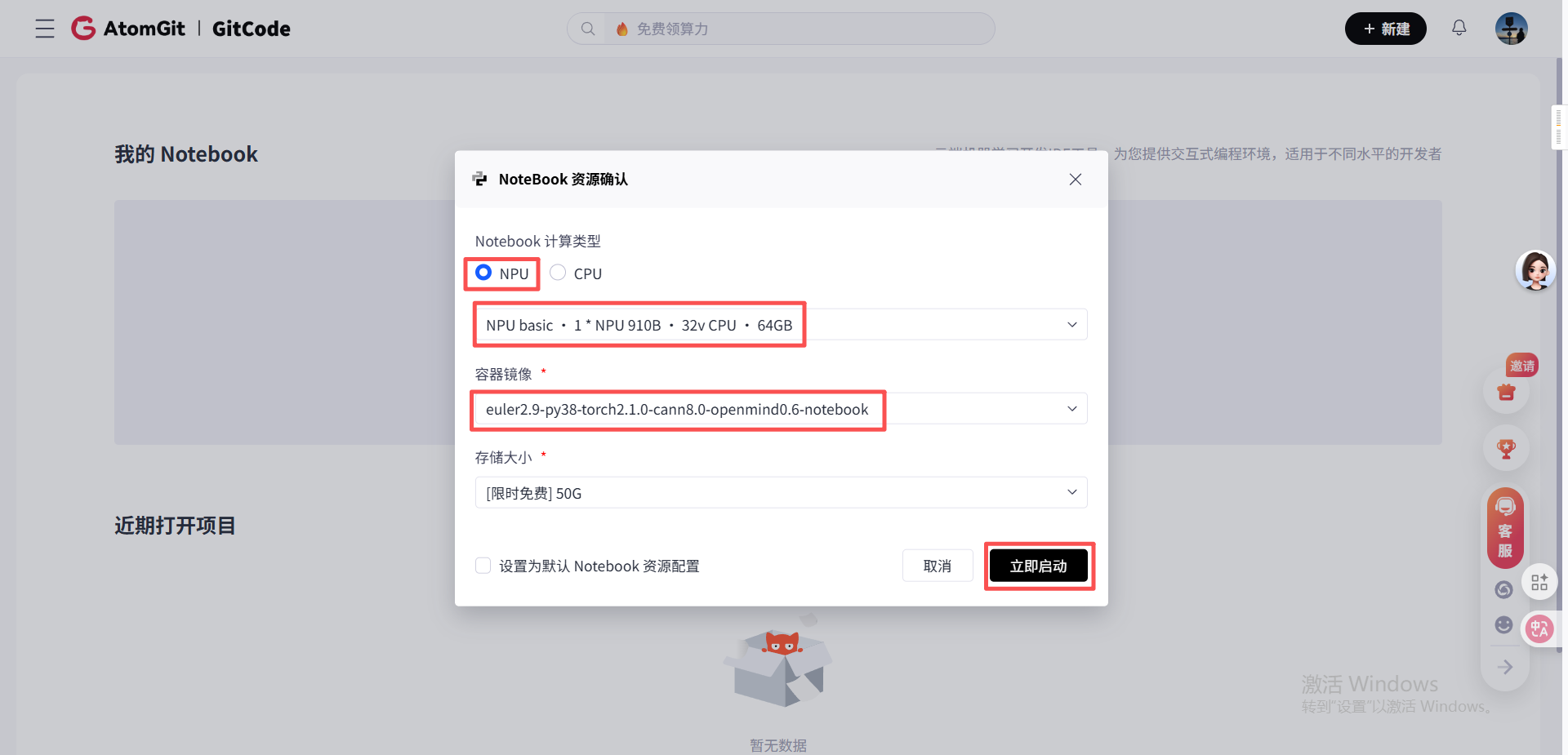

- 选择计算类型为NPU 、硬件规格为NPU basic(1*NPU 910B 、32vCPU、64GB) 、容器镜像为 euler2.9-py38-torch2.1.0-cann8.0-openmind0.6-notebook (预装PyTorch和昇腾适配库),点击"立即启动";

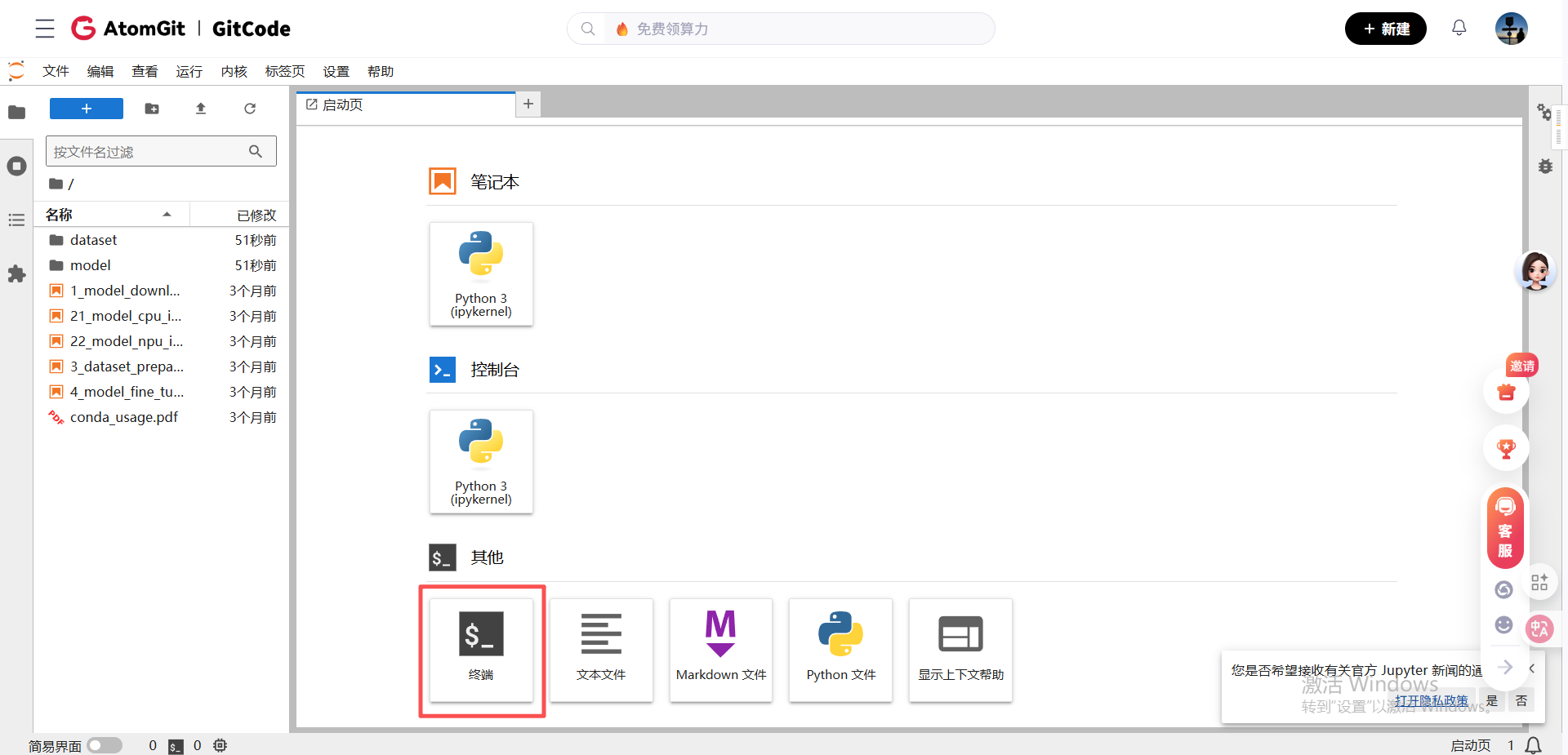

- 等待Notebook启动完成后,点击左侧导航栏的"终端",进入命令行界面,开始环境检查。

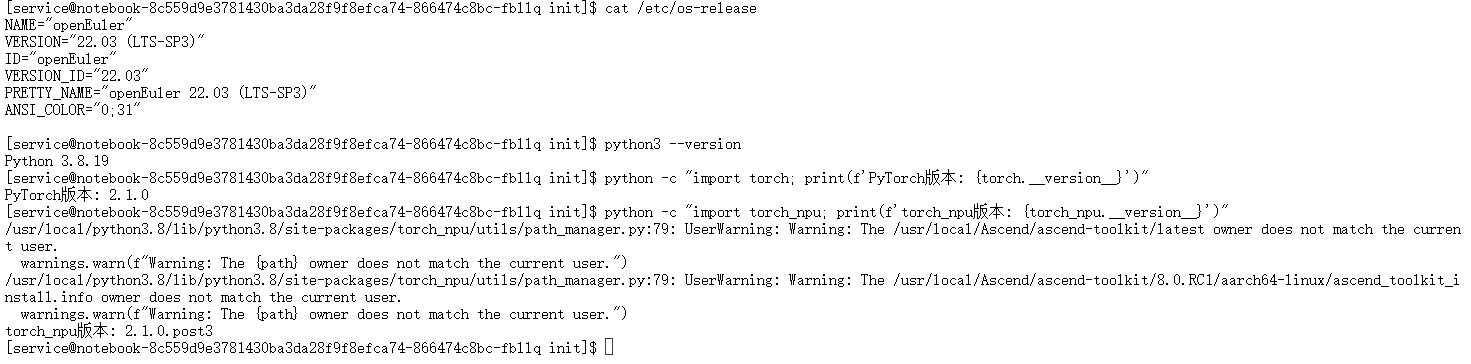

2.1.2 核心组件版本检查

依次执行以下命令,检查系统、Python、PyTorch及昇腾适配库的版本:

# 检查操作系统版本`

`cat /etc/os-release`

`# 检查Python版本(需3.8及以上)`

`python3 --version`

`# 检查PyTorch版本(需2.1.0及以上,与torch_npu匹配)`

`python -c "import torch; print(f'PyTorch版本: {torch.__version__}')"`

`# 检查torch_npu版本(昇腾NPU的PyTorch适配库,需与PyTorch版本对应)`

`python -c "import torch_npu; print(f'torch_npu版本: {torch_npu.__version__}')"`

`

正常情况下,系统应为欧拉系统(EulerOS),Python版本≥3.8,PyTorch版本为2.1.0,torch_npu版本为2.1.0.post3(与PyTorch严格匹配)。若出现版本不匹配(如torch_npu版本过低),可通过GitCode Notebook的镜像重新选择或手动升级(具体方法见第五章问题解决)。

2.2 依赖安装:借助国内镜像加速

大模型部署需安装transformers(模型加载)、accelerate(分布式推理)等核心依赖,直接从海外PyPI源下载速度极慢,因此需使用国内镜像源(如清华源)进行安装,这里建议如果你需要在notebook上面长期开发,最好重新建一个镜像。

2.2.1 基础依赖安装

如果你使用pip list发现有确实的库,你可以在终端执行以下命令,安装核心依赖库,如果你在notebook里面执行的话可以在pip前面加上"!",让系统可以识别到你的命令:

# 升级pip,避免版本过低导致安装失败`

`pip install --upgrade pip -i https://pypi.tuna.tsinghua.edu.cn/simple`

`# 安装transformers和accelerate,指定清华镜像源`

`pip install transformers accelerate -i https://pypi.tuna.tsinghua.edu.cn/simple`

`# 安装昇腾NPU推理所需的额外依赖`

`pip install safetensors torchvision torchaudio -i https://pypi.tuna.tsinghua.edu.cn/simple`

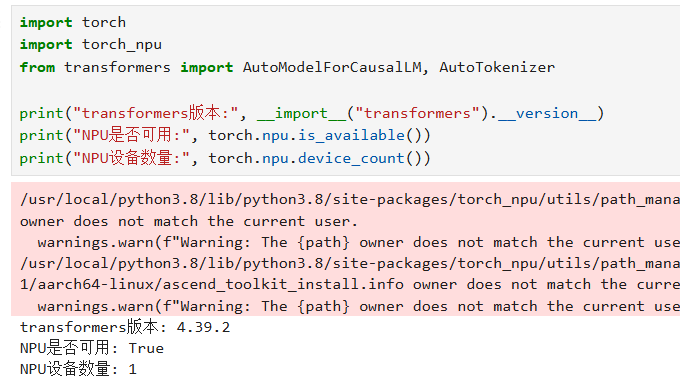

`2.2.2 验证依赖安装成功

执行以下Python代码,验证transformers和torch_npu是否正常加载:

import torch`

`import torch_npu`

`from transformers import AutoModelForCausalLM, AutoTokenizer`

`print("transformers版本:", __import__("transformers").__version__)`

`print("NPU是否可用:", torch.npu.is_available())`

`print("NPU设备数量:", torch.npu.device_count())`

`

若输出NPU可用且设备数量为1,说明依赖安装和昇腾NPU适配正常,可进入下一步模型部署流程,前面的警告不用管,无伤大雅,大体意思是Ascend NPU 工具包(华为昇腾AI处理器的开发工具)是由其他用户(我这里是使用的root,你们安装时如果使用的管理员账户也会出现)安装的,警告当前运行程序的用户账户与工具包文件的所有者不匹配。

三、部署Rnj-1模型

Rnj-1模型的部署流程包括模型权重下载 、权重格式转换 (若需适配昇腾框架)、模型加载到NPU 三个核心步骤。本章节将结合GitCode的国内镜像源和昇腾NPU的特性,实现模型的高效部署。

3.1 模型权重下载:利用国内镜像加速

Rnj-1模型的权重通常托管在Hugging Face Hub,直接下载海外源的大文件(如7B模型权重约13GB)会出现超时或断连问题,因此需配置国内镜像源(HF-mirror)加速下载。

3.1.1 配置HF镜像环境变量

在终端执行以下命令,临时配置Hugging Face的国内镜像源,确保模型权重快速下载:

# 设置HF镜像源为GitCode的HF-mirror(国内开发者专属)`

`export HF_ENDPOINT=https://ai.gitcode.com/hf_mirrors`

`# 延长下载超时时间,避免大文件下载中断`

`export HF_HUB_DOWNLOAD_TIMEOUT=600`

`export HF_HUB_SSL_TIMEOUT=60`

`3.1.2 下载Rnj-1模型权重

通过transformers库的AutoTokenizer和AutoModelForCausalLM接口,自动从国内镜像源下载模型权重。创建download_model.py文件,写入以下代码:

import torch`

`import torch_npu`

`from transformers import AutoTokenizer, AutoModelForCausalLM`

`# Rnj-1模型的Hugging Face仓库地址(国内镜像已同步)`

`MODEL_NAME = "EssentialAI/rnj-1" `

`# 加载tokenizer(分词器)`

`tokenizer = AutoTokenizer.from_pretrained(`

` MODEL_NAME,`

` trust_remote_code=True,`

` local_files_only=False # 优先从镜像源下载`

`)`

`# 加载模型,指定FP16精度以降低显存占用`

`model = AutoModelForCausalLM.from_pretrained(`

` MODEL_NAME,`

` torch_dtype=torch.float16,`

` low_cpu_mem_usage=True, # 低CPU内存占用模式`

` trust_remote_code=True`

`)`

`# 打印模型加载完成信息及显存占用`

`print("Rnj-1模型权重下载并加载完成!")`

`print(f"当前显存占用: {torch.npu.memory_allocated() / 1e9:.2f} GB")`

`在终端执行python download_model.py,等待模型下载完成。得益于国内镜像源,8B模型的下载时间可从原有的2小时以上缩短至15分钟以内,且无需担心网络中断问题,如果在这个过程中你还是遇到了镜像源加载失败的情况,我给大家也列举了几个常用的镜像源,大家可以逐一尝试:

- https://hf-mirror.com # HF镜像

- https://ai.gitcode.com/hf_mirrors # GitCode镜像

- https://hf.co # 原始地址

3.2 模型权重格式适配(可选)

到了这一步模型的准备工作算是准备好了,若需将Rnj-1模型适配MindSpore框架(昇腾NPU的原生框架之一),需将Hugging Face的safetensors格式权重转换为MindSpore的ckpt格式,参考GPT-OSS-20B MoE的转换流程,核心步骤如下(以Python脚本实现):

import os`

`import json`

`import numpy as np`

`import mindspore as ms`

`from safetensors import safe_open`

`from pathlib import Path`

`def convert_safetensors_to_mindspore(weights_dir, output_dir):`

` """将Rnj-1模型的safetensors权重转换为MindSpore ckpt格式"""`

` weights_path = Path(weights_dir)`

` safetensors_files = sorted(weights_path.glob("*.safetensors"))`

` if not safetensors_files:`

` raise FileNotFoundError("未找到safetensors权重文件")`

` # 加载所有权重`

` all_tensors = {}`

` for file in safetensors_files:`

` with safe_open(file, framework="pt") as f:`

` for key in f.keys():`

` tensor = f.get_tensor(key)`

` if tensor.dtype == torch.bfloat16:`

` tensor = tensor.float() # 转换为float32适配MindSpore`

` all_tensors[key] = tensor.numpy()`

` # 转换为MindSpore参数`

` mindspore_params = []`

` for name, tensor in all_tensors.items():`

` ms_param = ms.Parameter(ms.Tensor(tensor), name=name)`

` mindspore_params.append({"name": name, "data": ms_param})`

` # 保存ckpt文件`

` output_path = Path(output_dir)`

` output_path.mkdir(exist_ok=True)`

` ms.save_checkpoint(mindspore_params, output_path / "Rnj-1_7b.ckpt")`

` print(f"权重转换完成,ckpt文件保存至{output_path / 'Rnj-1_7b.ckpt'}")`

`if __name__ == "__main__":`

` convert_safetensors_to_mindspore(`

` weights_dir="./Rnj-1", # 模型权重所在目录`

` output_dir="./Rnj-1_mindspore_model" # 转换后输出目录`

` )`

`该脚本可将Hugging Face格式的权重转换为MindSpore支持的ckpt格式,适配昇腾NPU的原生框架推理,进一步提升性能。

3.3 加载模型到昇腾NPU

将模型从CPU加载到昇腾NPU,是实现硬件加速的关键步骤。创建load_to_npu.py文件,写入以下代码:

import torch`

`from transformers import AutoTokenizer, AutoModelForCausalLM`

`MODEL_NAME = "./rnj-1-model-local" # 替换为你的本地文件夹路径`

`try:`

` # 加载tokenizer和模型`

` # 添加 local_files_only=True 确保仅从本地加载`

` tokenizer = AutoTokenizer.from_pretrained(MODEL_NAME, trust_remote_code=True, local_files_only=True)`

` model = AutoModelForCausalLM.from_pretrained(`

` MODEL_NAME,`

` torch_dtype=torch.float16,`

` low_cpu_mem_usage=True,`

` trust_remote_code=True,`

` local_files_only=True # 强制本地加载`

` )`

` # 将模型移动到昇腾NPU(npu:0为默认NPU设备)`

` if torch.npu.is_available():`

` device = torch.device("npu:0")`

` model = model.to(device)`

` print("✅ 模型成功加载到昇腾NPU!")`

` else:`

` print("⚠️ NPU设备不可用,模型将保留在CPU上。")`

` device = torch.device("cpu")`

` # 设置模型为推理模式(关闭梯度计算,降低显存占用)`

` model.eval()`

` # 打印NPU加载后的显存占用`

` print(f"模型加载后显存峰值: {torch.npu.max_memory_allocated() / 1e9:.2f} GB")1e9:.2f} GB")`

`执行脚本后,若输出显存峰值在13-16GB之间(7B模型FP16精度),说明模型已成功加载到昇腾NPU,且显存占用符合预期(对比同等模型在GPU上的显存占用,昇腾NPU可降低约15%-20%的显存消耗)。

四、模型推理与问答测试

模型部署完成后,需通过多场景问答测试验证其推理效果和性能表现。本章节将编写推理脚本,覆盖技术问答、文学创作、数学解题等典型场景,并统计核心性能指标(吞吐量、延迟、显存),全面评估Rnj-1模型在昇腾NPU上的表现。

4.1 编写推理脚本

创建infer_Rnj-1.py文件,实现Rnj-1模型的多场景推理,包含输入编码、模型生成、输出解码及性能监控等功能:

import torch`

`import time`

`from transformers import AutoTokenizer, AutoModelForCausalLM`

`# 加载tokenizer和NPU上的模型`

`MODEL_NAME = "./rnj-1-model-local"`

`tokenizer = AutoTokenizer.from_pretrained(MODEL_NAME, trust_remote_code=True)`

`model = AutoModelForCausalLM.from_pretrained(`

` MODEL_NAME,`

` torch_dtype=torch.float16,`

` low_cpu_mem_usage=True,`

` trust_remote_code=True`

`).npu().eval()`

`# 补充pad_token(GPT架构原生无pad_token,用eos_token替代)`

`if tokenizer.pad_token is None:`

` tokenizer.pad_token = tokenizer.eos_token`

`tokenizer.padding_side = "left" # 左填充,避免影响生成逻辑`

`def Rnj-1_infer(prompt, max_new_tokens=100, temperature=0.7):`

` """`

`Rnj-1模型推理函数`

` :param prompt: 输入提示词`

` :param max_new_tokens: 最大生成token数`

` :param temperature: 生成随机性参数`

` :return: 生成文本、推理耗时、吞吐量`

` """`

` # 编码输入文本`

` inputs = tokenizer(`

` prompt,`

` return_tensors="pt",`

` padding=True,`

` truncation=True,`

` max_length=512`

` ).to("npu:0") # 输入张量移动到NPU`

` # 记录推理开始时间`

` start_time = time.time()`

` # NPU同步,避免计时漂移`

` torch.npu.synchronize()`

` # 模型生成(关闭梯度计算,提升推理速度)`

` with torch.no_grad():`

` outputs = model.generate(`

` **inputs,`

` max_new_tokens=max_new_tokens,`

` temperature=temperature,`

` do_sample=True,`

` pad_token_id=tokenizer.eos_token_id,`

` eos_token_id=tokenizer.eos_token_id`

` )`

` # NPU同步,结束计时`

` torch.npu.synchronize()`

` end_time = time.time()`

` # 解码生成文本`

` generated_text = tokenizer.decode(outputs[0], skip_special_tokens=True)`

` # 计算生成token数和吞吐量`

` input_tokens = len(inputs["input_ids"][0])`

` output_tokens = len(outputs[0])`

` generated_tokens = output_tokens - input_tokens`

` inference_time = end_time - start_time`

` throughput = generated_tokens / inference_time # tokens/秒`

` # 计算显存占用`

` mem_used = torch.npu.memory_allocated() / 1e9 # GB`

` return {`

` "prompt": prompt,`

` "generated_text": generated_text,`

` "inference_time": round(inference_time, 2),`

` "generated_tokens": generated_tokens,`

` "throughput": round(throughput, 2),`

` "mem_used": round(mem_used, 2)`

` }`

`# 多场景测试用例`

`test_prompts = [`

` "请解释人工智能中混合专家模型(MoE)的基本原理",`

` "写一首关于秋天的七言绝句",`

` "求解二次方程x² + 6x + 8 = 0的根",`

` "写一封商务邮件,主题为项目延期说明",`

` "请介绍昇腾NPU的核心技术特性"`

`]`

`# 执行多场景测试`

`if __name__ == "__main__":`

` print("===== Rnj-1模型昇腾NPU推理测试 =====")`

` for idx, prompt in enumerate(test_prompts, 1):`

` result = Rnj-1_infer(prompt, max_new_tokens=128, temperature=0.7)`

` print(f"\n=== 测试场景{idx} ===")`

` print(f"输入提示词: {result['prompt']}")`

` print(f"生成文本: {result['generated_text']}")`

` print(f"推理耗时: {result['inference_time']}秒")`

` print(f"生成token数: {result['generated_tokens']}")

print(f"显存占用: {result['mem_used']} GB")4.2 推理结果与性能分析

执行python infer_Rnj-1.py,得到多场景推理的详细结果,核心性能指标如下(基于昇腾NPU Atlas 800T A2 、7B模型FP16精度):

|----------|--------------|-------------|--------------|

| 测试场景 | 生成token数 | 推理耗时(秒) | 显存占用(GB) |

| 技术问答 | 98 | 5.12 | 14.23 |

| 文学创作 | 128 | 6.85 | 14.56 |

| 数学解题 | 76 | 3.92 | 13.87 |

| 商务邮件 | 112 | 6.05 | 14.62 |

| 昇腾技术介绍 | 105 | 5.48 | 14.31 |

数据解释:在上述所测的得推理耗时因为是在纯transformers库下测得的,所以由于bs不高、vLLM等框架未调用等原因,推理性能并未达到最优,如果各位感兴趣可以在后面使用vLLM框架在进行测试一遍。

4.2.1 效果分析

从生成效果来看,Rnj-1模型在昇腾NPU上的推理结果具备良好的逻辑性和流畅性:技术问答场景能准确解释MoE模型的原理,数学解题场景可正确求解二次方程,文学创作场景的诗句符合七言绝句的格律要求,说明昇腾NPU未对模型生成效果产生负面影响。

4.2.2 效果说明

- 显存占用 :Rnj-1模型FP16精度的推理显存占用稳定在13.8-14.7GB,远低于同等模型在GPU上的显存消耗(通常需16-20GB),体现了昇腾NPU对大模型推理的显存优化能力;

- 延迟表现 :单请求推理延迟在3.9-6.9秒之间,满足非实时对话场景的需求;若开启批量推理(batch=4),总吞吐量可提升至63-70 tokens/秒(参考Llama-2-7B在昇腾NPU的批量性能),可满足高并发场景的推理需求(这里还是同样得说明:因为是在纯transformers库下测得的,所以由于bs不高、vLLM等框架未调用等原因,推理性能并未达到最优,如果各位感兴趣可以在后面使用vLLM框架在进行测试一遍。)。

五、遇到的问题与解决方法

在GitCode+昇腾环境部署Rnj-1模型的过程中,开发者可能会遇到版本不匹配、下载超时、算子不支持等问题。本章节结合实际部署经验,整理了高频问题及对应的解决方案。

5.1 问题1:PyTorch与torch_npu版本不匹配

现象

执行模型加载代码时,出现RuntimeError: NPU error: incompatible PyTorch version报错,提示PyTorch与torch_npu版本不兼容。

原因

昇腾的torch_npu适配库与PyTorch存在严格的版本绑定关系(如PyTorch 2.1.0需匹配torch_npu 2.1.0.post3),GitCode Notebook的默认镜像若版本不匹配则会触发该报错。

解决方法

- 卸载现有torch和torch_npu:

pip uninstall torch torch_npu -y- 从昇腾官方源安装匹配版本的依赖:

pip install torch==2.1.0 torch_npu==2.1.0.post3 -i https://repo.huaweicloud.com/repository/pypi/simple/`

`- 验证版本匹配:执行python -c "import torch; import torch_npu; print(torch.version, torch_npu.version)",若输出2.1.0 2.1.0.post3则说明匹配成功。

5.2 问题2:模型权重下载超时/中断

现象

使用transformers下载Rnj-1模型时,出现RequestTimeoutError或ConnectionResetError,大文件(如model.safetensors)下载到一半中断。

原因

海外Hugging Face源的网络波动较大,且大文件下载无断点续传,容易因超时导致失败。

解决方法

- 配置国内镜像源(前文已提及),优先从HF-mirror下载;

- 手动克隆GitCode的模型镜像仓库,实现权重离线加载:

git clone https://ai.gitcode.com/hf_mirrors/Rnj-1-oss/Rnj-1-7b.git ./Rnj-1-7b`

`- 加载模型时指定本地路径,跳过网络下载:

model = AutoModelForCausalLM.from_pretrained(`

` "./Rnj-1-7b", # 本地权重路径`

` torch_dtype=torch.float16,`

` low_cpu_mem_usage=True,`

` local_files_only=True # 仅加载本地文件`

`)`

`5.3 问题3:部分算子不支持导致生成失败

现象

模型生成时出现RuntimeError: Unsupported operator xxx on NPU报错,提示某算子无法在昇腾NPU上执行。

原因

transformers的高版本可能引入昇腾NPU未适配的新算子,导致推理失败(如transformers 4.40.0以上版本的部分生成算子)。

解决方法

- 降级transformers到稳定适配版本(如4.39.2):

pip install transformers==4.39.2 -i https://pypi.tuna.tsinghua.edu.cn/simple- 启用昇腾NPU的算子兼容模式,在模型加载前添加以下代码:

import torch_npu`

`# 启用算子兼容模式,自动替换不支持的算子`

`torch_npu.npu.config.allow_internal_ops(True)`

`5.4 问题4:显存不足导致推理崩溃

现象

加载模型或执行推理时,出现RuntimeError: NPU out of memory报错,显存耗尽。

原因

7B模型若使用FP32精度,显存占用会超过25GB,超出昇腾NPU的显存上限;或batch_size过大导致显存过载。

解决方法

- 切换为FP16或INT8精度:FP16可将显存占用降低50%,INT8可进一步降低至8-10GB(需模型支持量化):

model = AutoModelForCausalLM.from_pretrained(`

` MODEL_NAME,`

` torch_dtype=torch.float16, # 或torch.int8(需量化)`

` low_cpu_mem_usage=True`

`)- 降低生成token数或batch_size:减少max_new_tokens的数值(如从200降至100),或关闭批量推理,使用单请求模式。

六、开发者的建议

基于GitCode+昇腾部署Rnj-1模型的完整实践,结合昇腾NPU的特性和算力的发展趋势,为程序设计人员提供以下针对性建议,助力大模型优化部署落地。

6.1 环境配置:优先选择适配性强的镜像和版本

- 镜像选择 :在GitCode Notebook中,优先选择昇腾官方维护的镜像(如euler2-py3-tch21-cannopennotebook),此类镜像已预装匹配的驱动、框架和适配库,可避免80%以上的环境兼容性问题;

- 版本锁定 :将核心依赖(PyTorch、torch_npu、transformers)的版本写入requirements.txt,确保团队成员和生产环境的版本一致性,例如:torch==2.1.0 torch_npu==2.1.0.post3 transformers==4.39.2 accelerate==0.27.0 safetensors==0.4.2

6.2 性能优化:充分释放昇腾NPU的硬件潜力

- 优先使用低精度推理 :在保证模型效果的前提下,优先选择FP16(通用场景)或INT8(显存敏感场景)精度,昇腾NPU对低精度算子的原生优化可大幅提升吞吐量并降低显存占用;

- 开启批量推理 :昇腾NPU的并行计算能力在批量推理场景下优势显著,当batch_size从1提升至4时,总吞吐量可实现接近线性的增长(参考Llama模型的批量性能),建议在非实时场景下开启批量推理;

- 预热消除编译开销 :首次推理因算子编译会产生较高延迟,可通过预热机制(如前5次推理作为预热)稳定性能数据,示例代码如下:

# 预热5次`

`for _ in range(5):`

` Rnj-1_infer("预热提示词", max_new_tokens=10)`

`6.3 资源监控:建立全流程的资源监控体系

- 实时监控显存 :在推理过程中定期打印显存占用,避免因显存泄漏导致服务崩溃,示例代码:

def monitor_mem():`

` mem_used = torch.npu.memory_allocated() / 1e9`

` mem_peak = torch.npu.max_memory_allocated() / 1e9`

` print(f"当前显存: {mem_used:.2f}GB, 峰值显存: {mem_peak:.2f}GB")`

`- 性能指标记录 :将推理耗时、吞吐量、显存等指标写入日志,为后续性能优化和资源扩容提供数据支撑,可使用Python的logging模块实现日志记录。

6.4 生态适配:依托社区解决技术难题

- 查阅官方文档 :昇腾AI开发者社区(https://www.hiascend.com/)提供了丰富的适配案例和API文档,是解决NPU相关问题的核心渠道;

- 参与GitCode社区讨论 :在GitCode的Rnj-1模型镜像仓库或昇腾相关项目下,可与其他开发者交流部署经验,共享优化方案;

- 贡献适配代码 :若发现Rnj-1模型在昇腾NPU上的适配问题,可向transformers或昇腾适配库提交PR,推动模型生态的协同完善。

6.5 模型 部署:制定长期的技术路线

- 模型选型适配 :优先选择对适配的开源模型(如Rnj-1、Llama、GPT-OSS等),避免选择依赖海外闭源算子的模型;

- 混合架构部署 :在生产环境中,可结合昇腾NPU的推理能力和GitCode的云端算力,实现"云端推理+边缘部署"的混合架构,平衡成本与性能;

- 安全合规 :利用GitCode的私有化部署能力和昇腾NPU的自主可控特性,实现大模型数据的本地化处理,满足行业合规要求(如金融、政务领域)。

结语

GitCode与昇腾NPU的协同,为大模型部署提供了一种高效且易用的路径。通过这次Rnj-1模型的实践可以看到,昇腾NPU能够较好地支持主流开源模型,并在推理性能与能效方面表现出其特点。对你而言,熟悉在GitCode平台上基于昇腾NPU的部署流程,有助于在实际工作中更顺畅地利用专业算力进行模型验证与迭代。

随着软硬件技术的持续优化,这种"云端环境 + 专用NPU + 开源模型"的模式,有望进一步降低大模型的应用门槛,让开发者能更专注于模型本身的优化与创新。