文章前瞻:优质数据集与检测系统精选

点击链接:************更多数据集与系统目录清单****************

一、交通事故等级检测数据集介绍

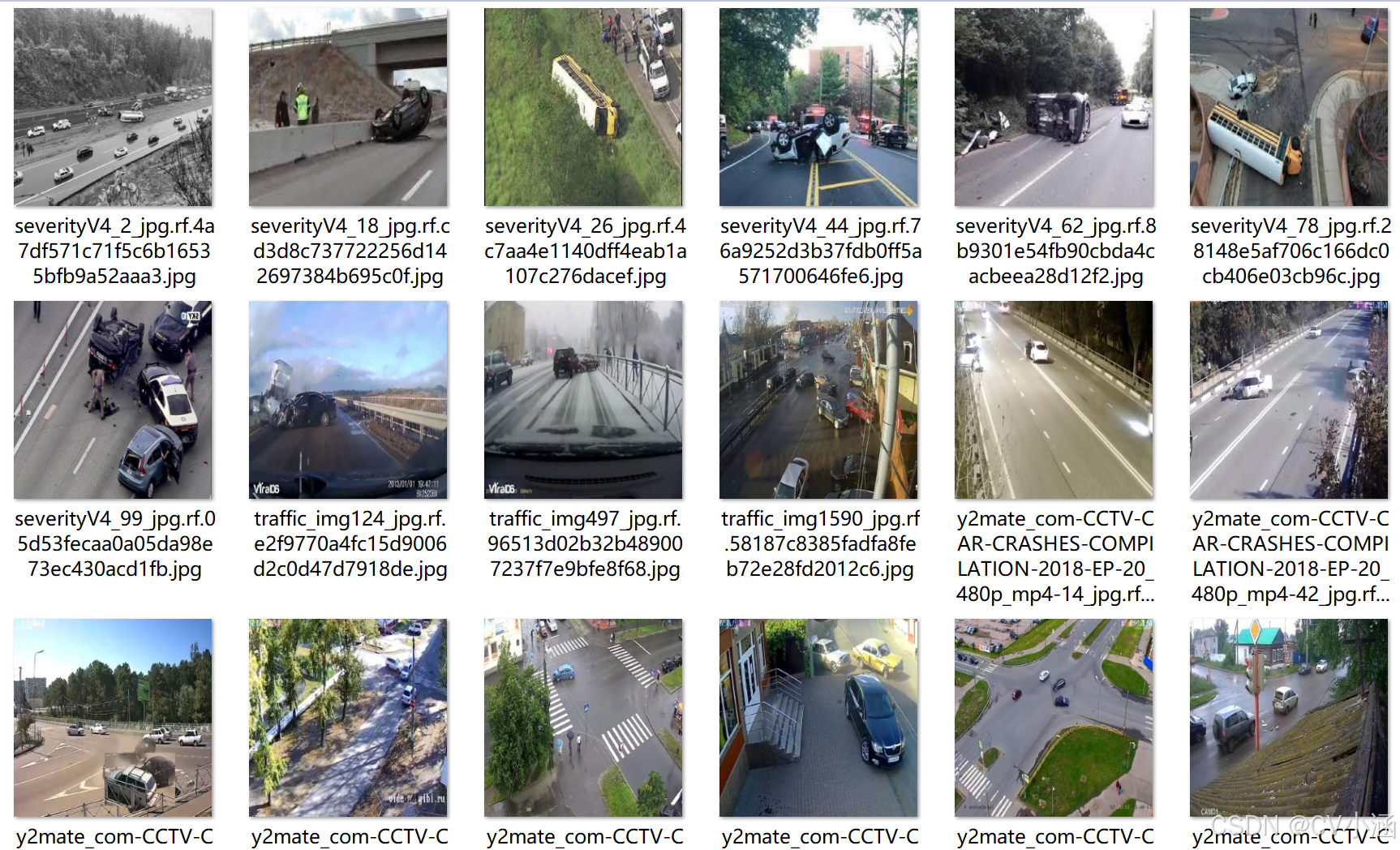

【数据集】yolo车祸检测数据集 7869 张 ,目标检测,包含YOLO/VOC格式标注,训练、验证、测试集已划分。

数据集中标签包含3种分类 :names = ['mild', 'moderate', 'severe'] ,代表轻微事故、中度事故、严重事故。

检测场景为城市道路、乡镇道路、高速、交通路口等场景 ,可用于保障生命安全、提升应急处置效率、优化交通管理体系、打造智慧交通管理系统 等。

文章底部名片或主页私信获取数据集和系统~

1、数据概述

车祸等级识别的重要性

首先,保障生命安全是首要价值。不同等级的交通事故对应不同的人员伤亡与车辆损毁程度,轻微事故需简单疏导,重大事故则需急救、消防、交警多部门联动。YOLO算法可通过路面监控、车载设备实时捕捉事故现场的车辆损毁状态、人员被困情况、交通阻断范围等关键信息,快速判定事故等级,为救援力量调配提供精准依据,缩短救援到达时间,提升重伤员救治成功率。其次,提升应急处置科学性。传统人工判定易因报案人表述不清、现场信息缺失导致等级误判,进而出现资源过度投入或供给不足的问题。YOLO算法通过量化分析事故现场特征,实现等级的客观判定,助力应急指挥部门制定针对性处置方案,优化资源配置效率。最后,弥补传统处置短板。在夜间、恶劣天气或偏远路段,人工现场勘查耗时久、风险高,而YOLO可依托全域覆盖的监控网络实现远程实时检测,突破时空限制,确保事故等级判定的及时性与稳定性。

基于YOLO的车祸检测系统

在城市道路交通应急管控中,YOLO事故等级检测系统可与城市智慧交通指挥平台无缝对接,通过路口监控实时识别事故等级。一旦判定为较大及以上等级事故,系统可自动触发应急响应机制,同步调度附近急救车、消防车、交警力量,并推送事故精准位置与现场概况,同时引导周边车辆分流,避免交通拥堵加剧救援阻碍。在高速公路场景中,YOLO算法可搭载于巡逻车、无人机或沿线监控设备,快速识别多车连环相撞、车辆侧翻等重大事故等级,及时向高速管控中心反馈,协助封闭相关车道、规划救援绿色通道,降低二次事故风险。

此外,在交通管理优化领域,长期积累的事故等级检测数据可助力研判不同路段、时段的事故高发规律与等级分布特征,为道路安全设施升级、交通规则优化提供数据支撑;在保险理赔环节,精准的事故等级判定可快速明确理赔责任与金额范围,缩短理赔流程,减少纠纷;在应急指挥体系建设中,该技术可提升跨部门联动响应的协同效率,完善"监测 - 判定 - 调度 - 处置"的全链条应急闭环。

综上,基于YOLO实现交通事故等级检测,有效破解了传统判定模式的滞后性与主观性难题,通过技术赋能推动交通事故处置从"被动响应"向"主动预判、精准调度"转型,对保障生命安全、提升应急处置效率、优化交通管理体系具有不可替代的作用,在智慧交通与应急管理领域拥有广阔应用前景。

该数据集含有 7869 张图片,包含Pascal VOC XML 格式和YOLO TXT 格式,用于训练和测试城市道路、乡镇道路、高速、交通路口等场景进行车祸等级检测。

图片格式为jpg格式,标注格式分别为:

YOLO:txt

VOC:xml

数据集均为手工标注,保证标注精确度。

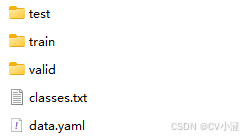

2、数据集文件结构

Accident-level/

------test/

------------Annotations/

------------images/

------------labels/

------train/

------------Annotations/

------------images/

------------labels/

------valid/

------------Annotations/

------------images/

------------labels/

------data.yaml

- 该数据集已划分训练集样本,分别是:test 目录(测试集)、train 目录(训练集)、valid目录(验证集);

- Annotations文件夹为Pascal VOC格式的XML文件 ;

- images文件夹为jpg格式的数据样本;

- labels文件夹是YOLO格式的TXT文件;

- data.yaml是数据集配置文件,包含车祸等级检测的目标分类和加载路径。

Annotations目录下的xml文件内容如下:

XML

<annotation>

<folder></folder>

<filename>2-33_jpg.rf.db77b02e32672eec4cff7e78b0360fef.jpg</filename>

<path>2-33_jpg.rf.db77b02e32672eec4cff7e78b0360fef.jpg</path>

<source>

<database>Accident-Level</database>

</source>

<size>

<width>640</width>

<height>640</height>

<depth>3</depth>

</size>

<segmented>0</segmented>

<object>

<name>moderate</name>

<pose>Unspecified</pose>

<truncated>0</truncated>

<difficult>0</difficult>

<occluded>0</occluded>

<bndbox>

<xmin>230</xmin>

<xmax>309</xmax>

<ymin>204</ymin>

<ymax>309</ymax>

</bndbox>

</object>

<metadata>

</metadata>

</annotation>labels目录下的txt文件内容如下:

bash

2 0.246875 0.54453125 0.1484375 0.1218753、数据集适用范围

- 目标检测 场景,监控 识别,无人机识别

- yolo训练模型或其他模型

- 城市道路、乡镇道路、高速、交通路口等场景

- 可用于保障生命安全、提升应急处置效率、优化交通管理体系、打造智慧交通管理系统等

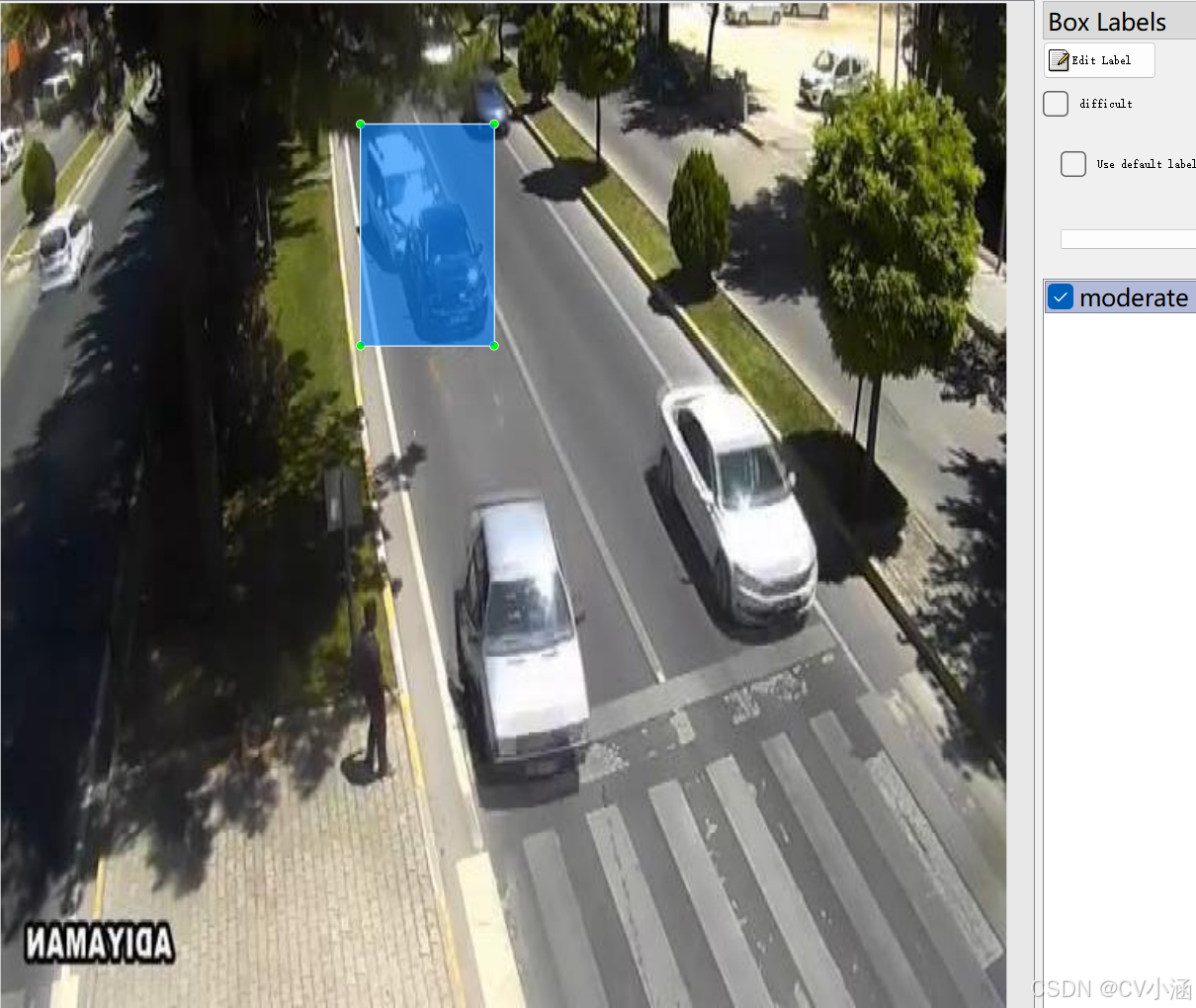

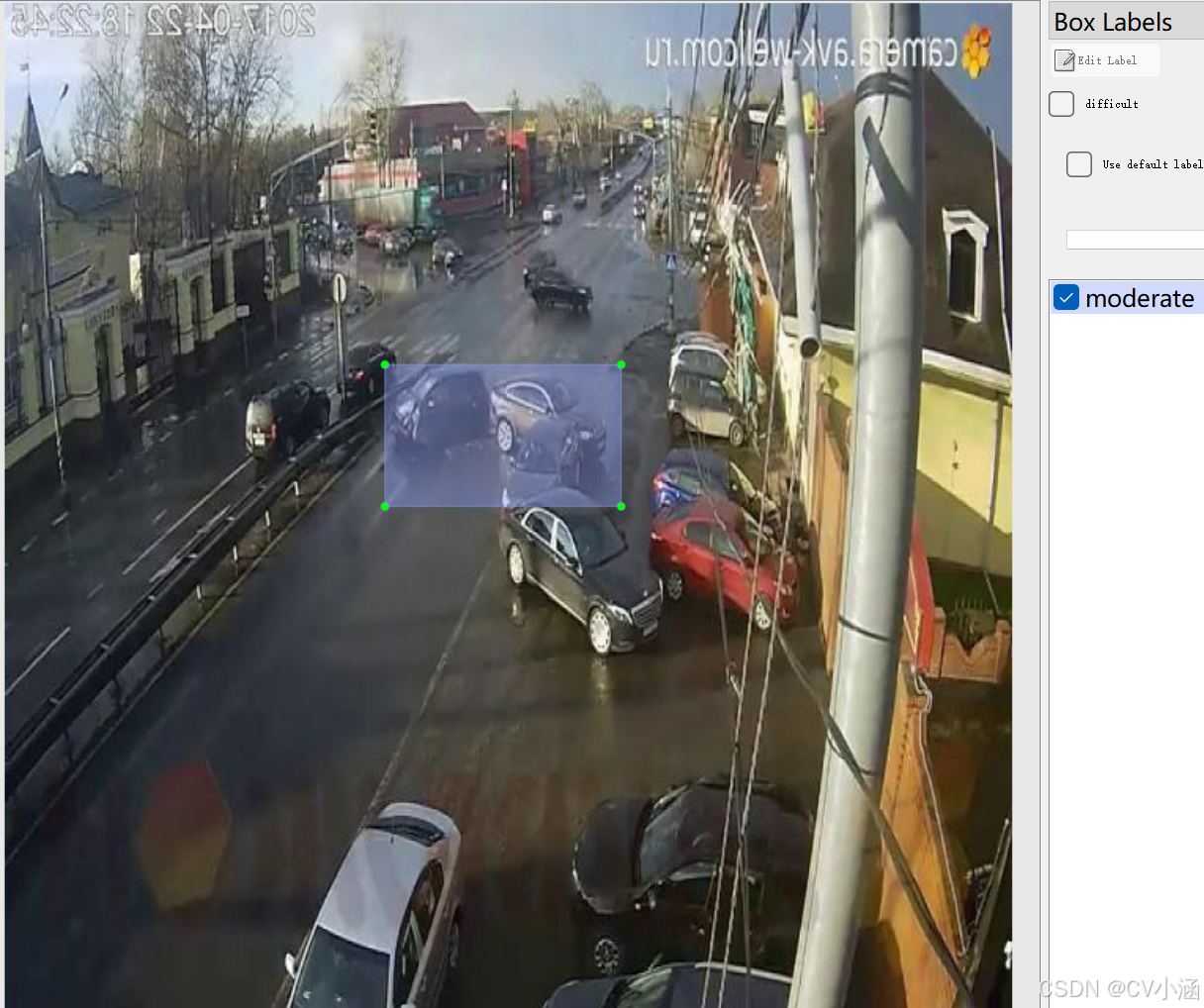

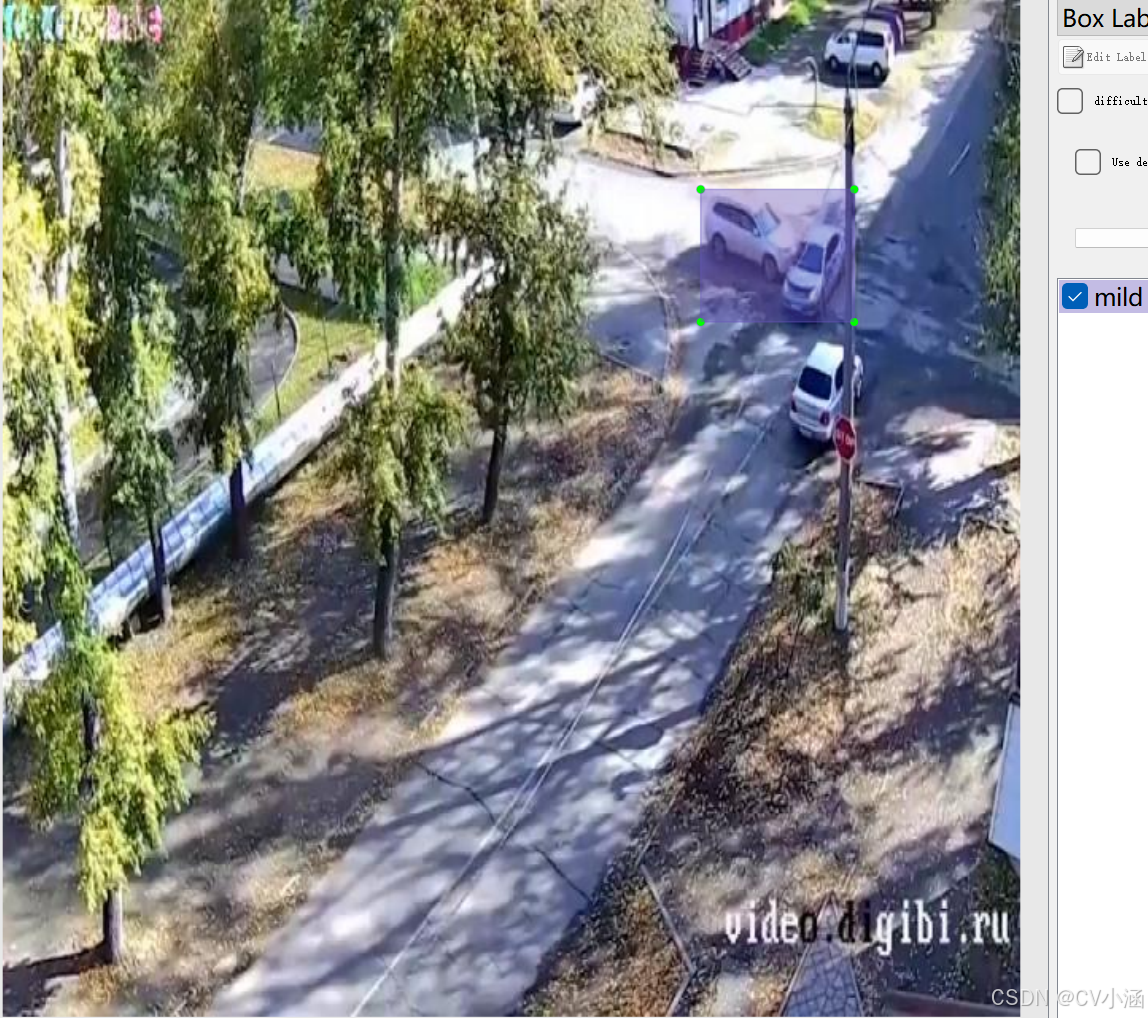

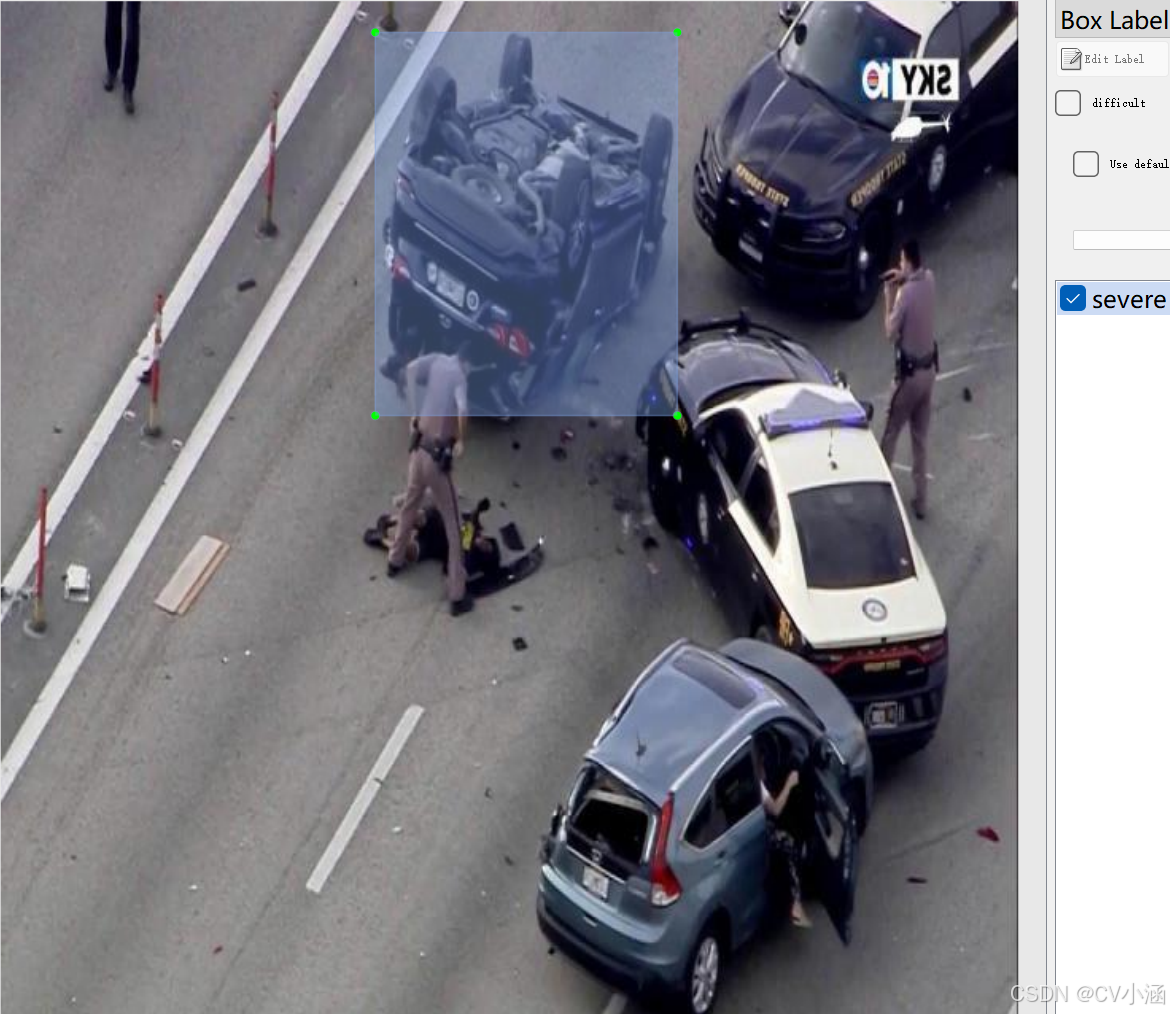

4、数据集标注结果

4.1、数据集内容

- 场景视角:无人机视角数据样本、监控视角数据样本、车辆视角数据样本;

- 标注内容:['mild', 'moderate', 'severe'] ,总计3个分类;

- 图片总量:7869张图片数据;

- 标注类型:含有Pascal VOC XML 格式和yol o TXT格式;

5、训练过程

5.1、导入训练数据

下载YOLOv8项目压缩包,解压在任意本地workspace文件夹中。

下载YOLOv8预训练模型,导入到ultralytics-main项目根目录下。

在ultralytics-main 项目根目录下,创建data文件夹,并在data文件夹下创建子文件夹:Annotations、images、imageSets、labels, 其中,将pascal VOC格式的XML文件 手动导入到Annotations文件夹中,将JPG格式的图像数据导入到images文件夹中,imageSets和labels两个文件夹不导入数据。

data目录结构如下:

data/

------Annotations/ //存放xml文件

------images/ //存放jpg图像

------imageSets/

------labels/

整体项目结构如下所示:

5.2、数据分割

首先在ultralytics-main目录下创建一个split_train_val.py文件,运行文件之后会在imageSets文件夹下将数据集划分为训练集train.txt、验证集val.txt、测试集test.txt,里面存放的就是用于训练、验证、测试的图片名称。

python

import os

import random

trainval_percent = 0.9

train_percent = 0.9

xmlfilepath = 'data/Annotations'

txtsavepath = 'data/ImageSets'

total_xml = os.listdir(xmlfilepath)

num = len(total_xml)

list = range(num)

tv = int(num * trainval_percent)

tr = int(tv * train_percent)

trainval = random.sample(list, tv)

train = random.sample(trainval, tr)

ftrainval = open('data/ImageSets/trainval.txt', 'w')

ftest = open('data/ImageSets/test.txt', 'w')

ftrain = open('data/ImageSets/train.txt', 'w')

fval = open('data/ImageSets/val.txt', 'w')

for i in list:

name = total_xml[i][:-4] + '\n'

if i in trainval:

ftrainval.write(name)

if i in train:

ftrain.write(name)

else:

fval.write(name)

else:

ftest.write(name)

ftrainval.close()

ftrain.close()

fval.close()

ftest.close()5.3、数据集格式化处理

在ultralytics-main目录下创建一个voc_label.py文件,用于处理图像标注数据,将其从XML格式(通常用于Pascal VOC数据集)转换为YOLO格式。

convert_annotation函数

-

这个函数读取一个图像的XML标注文件,将其转换为YOLO格式的文本文件。

-

它打开XML文件,解析树结构,提取图像的宽度和高度。

-

然后,它遍历每个目标对象(

object),检查其类别是否在classes列表中,并忽略标注为困难(difficult)的对象。 -

对于每个有效的对象,它提取边界框坐标,进行必要的越界修正,然后调用

convert函数将坐标转换为YOLO格式。 -

最后,它将类别ID和归一化后的边界框坐标写入一个新的文本文件

python

import xml.etree.ElementTree as ET

import os

from os import getcwd

sets = ['train', 'val', 'test']

classes = ['mild', 'moderate', 'severe'] # 根据标签名称填写类别

abs_path = os.getcwd()

print(abs_path)

def convert(size, box):

dw = 1. / (size[0])

dh = 1. / (size[1])

x = (box[0] + box[1]) / 2.0 - 1

y = (box[2] + box[3]) / 2.0 - 1

w = box[1] - box[0]

h = box[3] - box[2]

x = x * dw

w = w * dw

y = y * dh

h = h * dh

return x, y, w, h

def convert_annotation(image_id):

in_file = open('data/Annotations/%s.xml' % (image_id), encoding='UTF-8')

out_file = open('data/labels/%s.txt' % (image_id), 'w')

tree = ET.parse(in_file)

root = tree.getroot()

size = root.find('size')

w = int(size.find('width').text)

h = int(size.find('height').text)

for obj in root.iter('object'):

difficult = obj.find('difficult').text

cls = obj.find('name').text

if cls not in classes or int(difficult) == 1:

continue

cls_id = classes.index(cls)

xmlbox = obj.find('bndbox')

b = (float(xmlbox.find('xmin').text),

float(xmlbox.find('xmax').text),

float(xmlbox.find('ymin').text),

float(xmlbox.find('ymax').text))

b1, b2, b3, b4 = b

# 标注越界修正

if b2 > w:

b2 = w

if b4 > h:

b4 = h

b = (b1, b2, b3, b4)

bb = convert((w, h), b)

out_file.write(str(cls_id) + " " + " ".join([str(a) for a in bb]) + '\n')

wd = getcwd()

for image_set in sets:

if not os.path.exists('data/labels/'):

os.makedirs('data/labels/')

image_ids = open('data/ImageSets/%s.txt' % (image_set)).read().strip().split()

list_file = open('data/%s.txt' % (image_set), 'w')

for image_id in image_ids:

list_file.write(abs_path + '/data/images/%s.jpg\n' % (image_id))

convert_annotation(image_id)

list_file.close()5.4、修改数据集配置文件

在ultralytics-main目录下创建一个data.yaml文件

python

train: data/train.txt

val: data/val.txt

test: data/test.txt

nc: 3

names = ['mild', 'moderate', 'severe']5.5、执行命令

python

model = YOLO('yolov8s.pt')

results = model.train(data='data.yaml', epochs=200, imgsz=640, batch=16, workers=0)也可以在终端执行下述命令:

bash

yolo train data=data.yaml model=yolov8s.pt epochs=200 imgsz=640 batch=16 workers=0 device=05.6、模型预测

你可以选择新建predict.py预测脚本文件,输入视频流或者图像进行预测。

代码如下:

python

import cv2

from ultralytics import YOLO

# Load the YOLOv8 model

model = YOLO("./best.pt") # 自定义预测模型加载路径

# Open the video file

video_path = "./demo.mp4" # 自定义预测视频路径

cap = cv2.VideoCapture(video_path)

# Get the video properties

frame_width = int(cap.get(cv2.CAP_PROP_FRAME_WIDTH))

frame_height = int(cap.get(cv2.CAP_PROP_FRAME_HEIGHT))

fps = cap.get(cv2.CAP_PROP_FPS)

# Define the codec and create VideoWriter object

fourcc = cv2.VideoWriter_fourcc(*'mp4v') # Be sure to use lower case

out = cv2.VideoWriter('./outputs.mp4', fourcc, fps, (frame_width, frame_height)) # 自定义输出视频路径

# Loop through the video frames

while cap.isOpened():

# Read a frame from the video

success, frame = cap.read()

if success:

# Run YOLOv8 inference on the frame

# results = model(frame)

results = model.predict(source=frame, save=True, imgsz=640, conf=0.5)

results[0].names[0] = "自行修改中文名称"

# Visualize the results on the frame

annotated_frame = results[0].plot()

# Write the annotated frame to the output file

out.write(annotated_frame)

# Display the annotated frame (optional)

cv2.imshow("YOLOv8 Inference", annotated_frame)

# Break the loop if 'q' is pressed

if cv2.waitKey(1) & 0xFF == ord("q"):

break

else:

# Break the loop if the end of the video is reached

break

# Release the video capture and writer objects

cap.release()

out.release()

cv2.destroyAllWindows()图片推理,代码如下:

python

import warnings

warnings.filterwarnings('ignore')

from ultralytics import YOLO

if __name__ == '__main__':

model = YOLO('models/best.pt')

model.predict(source='test_pic',

imgsz=640,

save=True,

conf=0.25

)也可以直接在命令行窗口或者Annoconda终端输入以下命令进行模型预测:

python

yolo predict model="best.pt" source='demo.jpg'6、获取数据集

文章底部名片或主页私信获取数据集或检测系统~

二、YOLO交通事故级别检测系统

1、功能介绍

1. 模型管理

支持自定义上传模型文件,一键加载所选模型,基于 YOLO 框架进行推理。

2. 图片检测

-

支持上传本地图片文件,自动完成格式校验。

-

对上传图片进行目标检测,检测结果以带有边框和标签的图片形式返回并展示。

-

检测结果可下载保存。

3. 视频检测与实时流

-

支持上传本地视频文件,自动完成格式校验。

-

对视频逐帧检测,检测结果通过 MJPEG 流实时推送到前端页面,用户可边看边等。

-

支持摄像头实时检测(如有接入摄像头)。

4. 置信度阈值调节

-

前端可实时调整检测置信度阈值,动态影响检测结果。

-

阈值调整后,后端推理自动应用新阈值,无需重启。

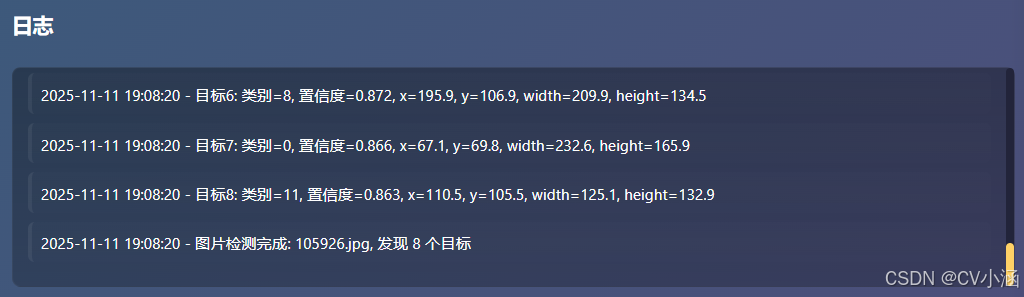

5. 日志与状态反馈

-

前端集成日志区,实时显示模型加载、推理、文件上传等操作的进度与结果。

-

检测异常、错误信息及时反馈,便于排查。

-

一键清空日志,笔面长期占用内存。

2、创建环境并安装依赖:

bash

conda create -n ultralytics-env python=3.10

conda activate ultralytics-env

pip install -r requirements.txt3、启动项目

bash

python app.py**打开浏览器访问:**http://localhost:5000

4、效果展示

4.1、推理效果

(以车牌检测为例)

4.2、日志文本框

4.3、摄像头检测

(以中草药检测为例)

5、前端核心页面代码

html

<!doctype html>

<html lang="zh-CN">

<head>

<meta charset="utf-8">

<meta name="viewport" content="width=device-width,initial-scale=1">

<title>视觉检测系统 - Web UI</title>

<link rel="stylesheet" href="/static/style.css">

<link rel="icon" href="/favicon.ico">

</head>

<body>

<div class="container main-flex">

<!-- 左侧内容区 -->

<div class="left-content">

<header>

<h1>YOLO交通事故级别检测系统</h1>

<div id="currentModelDisplay" class="modelDisplay" title="当前模型">当前模型:未上传模型</div>

</header>

<main>

<div class="videoPanel">

<div class="pane">

<h3>原图 / 视频</h3>

<div class="preview" id="srcPreview">预览区</div>

</div>

<div class="pane">

<h3>检测结果</h3>

<div class="preview" id="detPreview">检测结果</div>

</div>

</div>

<section class="logArea">

<div class="logHeader">

<h3>日志</h3>

</div>

<div class="logInner">

<div id="logs" class="logs"></div>

</div>

</section>

</main>

</div>

<!-- 右侧按钮栏 -->

<aside class="right-bar">

<!-- 1. 模型上传/加载区 -->

<section class="model-section">

<button id="uploadModelBtn" class="ghost">上传模型

<input id="modelFileInput" type="file" accept=".pt" title="选择 .pt 模型文件">

</button>

<button id="loadModel">加载模型</button>

</section>

<!-- 2. 检测方式选择区 -->

<section class="detect-mode-section">

<div class="detect-mode-title">请选择检测方式</div>

<div class="detect-mode-radio-group">

<label><input type="radio" name="detectMode" value="upload" checked> 图片/视频</label>

<label><input type="radio" name="detectMode" value="camera"> 摄像头</label>

</div>

<div id="detectModeUpload" class="detect-mode-panel">

<div class="uploaded-file-name">

<span id="uploadedFileName" class="placeholder">未选择文件</span>

</div>

<div style="height: 22px;"></div>

<button id="uploadBtn">上传文件

<input id="fileInput" type="file" accept="image/*,video/*" title="上传图片或视频" aria-label="上传图片或视频">

</button>

</div>

<div id="detectModeCamera" class="detect-mode-panel" style="display:none;">

<button id="cameraDetectBtn" class="ghost">开启摄像头</button>

<div id="cameraPreview" class="camera-preview">

<video id="localCameraVideo" autoplay muted playsinline></video>

<div class="camera-controls">

<button id="stopCameraBtn" class="ghost">关闭摄像头</button>

</div>

</div>

</div>

<div class="confWrap">

<label class="conf">置信度

<input id="confRange" type="range" min="0.01" max="0.99" step="0.01" value="0.5">

<input id="confValue" type="number" min="0.01" max="0.99" step="0.01" value="0.5">

</label>

</div>

</section>

<!-- 3. 操作按钮区 -->

<section class="action-btn-section">

<button id="startBtn" disabled class="start">开始检测</button>

<button id="stopBtn" disabled class="stop">停止</button>

<button id="clearLogs" class="ghost">清空日志</button>

</section>

</aside>

</div>

<script src="/static/app.js"></script>

</body>

</html>6、代码获取

文章底部名片或私信获取系统源码和数据集~

以上内容均为原创。