前言

在大模型应用开发的早期,我们像工厂老板一样,把AI当作一条高效但死板的流水线:输入进来,经过A、B、C几个固定工位,最后吐出结果。这种DAG(有向无环图)模式确实快,可一旦任务复杂一点,比如需要反复试错、中途查资料、甚至"我刚才说错了",这套系统就直接宕机。LangChain早期的Chain设计正是如此------线性、脆弱、没有"后悔药"。

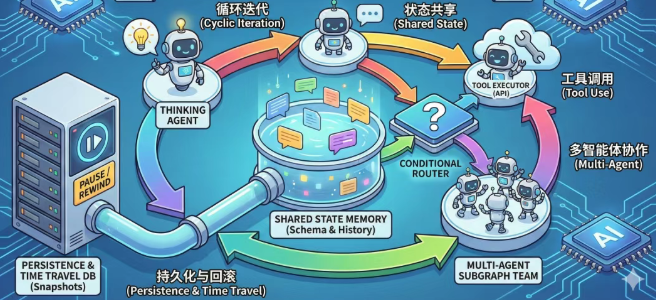

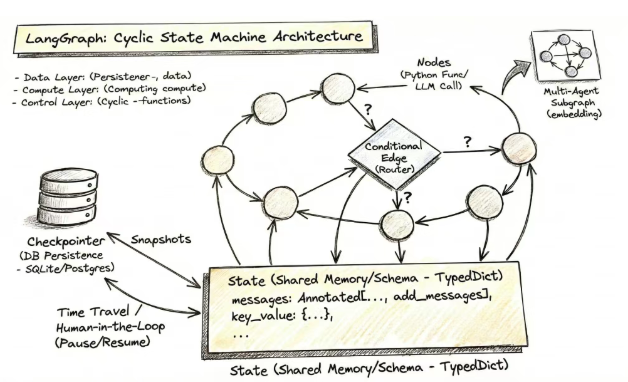

LangGraph的出现,彻底打破了这种思维枷锁。它不再把AI当作机器,而是模拟人类思考的真实过程:尝试、失败、反思、再尝试。这种"循环迭代"的能力,靠的不是魔法,而是一套精巧的状态机架构。State作为共享白板,Nodes作为功能工位,Conditional Edge作为调度员,Checkpointer则像游戏存档------四者合力,让AI拥有了"记忆"和"时间旅行"的超能力。本文将带你一层层拆解LangGraph的核心组件,看它如何从底层重构了我们对智能体的认知。更重要的是,我们会探讨:为什么说"循环"才是Agentic AI的灵魂?为什么"状态驱动"比"链式传递"更接近真实智能?读完你就会明白,LangGraph不是又一个工具库,而是一次开发范式的跃迁。

1. 从"流水线"到"活大脑":LangGraph的范式革命

传统LLM应用开发如同搭建乐高积木,每一块(Chain)必须严丝合缝地接上,一旦中间出错,整条链就崩了。这种线性思维忽略了人类智能最核心的特征:非线性。我们解决问题时,常常会走弯路、回溯、甚至推倒重来。LangGraph的诞生,正是为了捕捉这种动态性。

1.1 线性链的致命缺陷:没有"后悔药"

在DAG模型中,信息流是单向的。假设一个任务需要先调用工具获取数据,再生成报告。如果工具返回错误,系统无法自动回到工具调用步骤重试------它只能报错或硬着头皮往下走。这种"一锤子买卖"的设计,在简单场景下尚可,但在复杂任务中极易崩溃。开发者不得不手动插入大量if-else逻辑来处理异常,代码迅速变得臃肿不堪。

1.2 循环图的破局之道:允许"回头看"

LangGraph引入了循环(Cycles),让流程图不再是"有向无环",而是可以包含回路。这意味着系统能根据当前状态,动态决定下一步走向哪里。比如,当LLM发现工具调用失败,它可以生成新的参数,重新触发工具节点。这种"尝试-反馈-修正"的闭环,正是人类学习的本质。LangGraph通过状态机实现这一机制,将整个应用建模为一系列状态转换,而非固定步骤。

2. 核心组件解剖:智能体的四大器官

LangGraph的架构看似复杂,实则高度模块化。四个核心组件各司其职,共同构建了一个有记忆、能决策、可回溯的智能体。

2.1 State:全局共享的"白板"

State是LangGraph的基石,它定义了整个应用的单一事实来源。所有节点都从这里读取信息,也将结果写回这里。这种设计彻底摒弃了传统编程中"变量传递"的模式,转而采用"共享内存"范式。

- TypedDict/Schema :State的结构由类型注解严格定义,比如规定

messages字段必须是消息列表,task字段是当前任务描述。这确保了数据的一致性和可预测性。 - Reducer机制 :当多个节点试图修改同一字段时,Reducer决定如何合并变更。默认行为是覆盖(如更新天气),但通过

Annotated[list, add_messages],可以实现追加(如聊天记录)。这种增量更新机制,是短期记忆的物理实现。

2.2 Nodes:专注单一职责的"工位"

每个Node是一个纯函数,接收当前State,执行特定逻辑,返回待更新的字段。这种设计强调原子性 和轻量级。

- 输入输出 :Node只关心自己需要的数据,也只返回自己修改的部分。例如,一个天气查询Node只需读取

location字段,返回{ "weather": "Sunny" }。 - 封装性:Node内部可以是任意逻辑------调用LLM、查询数据库、甚至嵌套另一个LangGraph(Subgraph)。外部无需关心细节,只需关注其对State的贡献。

2.3 Conditional Edge:动态路由的"调度员"

普通边(Edge)定义了固定的执行顺序,而条件边(Conditional Edge)则根据State内容动态决定流向。这是智能体"自主决策"的核心。

- 路由逻辑 :调度员会检查State中的关键字段。例如,若

messages末尾包含tool_calls,则路由到ToolNode;若包含FINAL_ANSER,则结束流程。 - 灵活性:条件边可以组合成复杂的决策树,支持多分支、循环甚至并行路径,极大提升了流程的适应性。

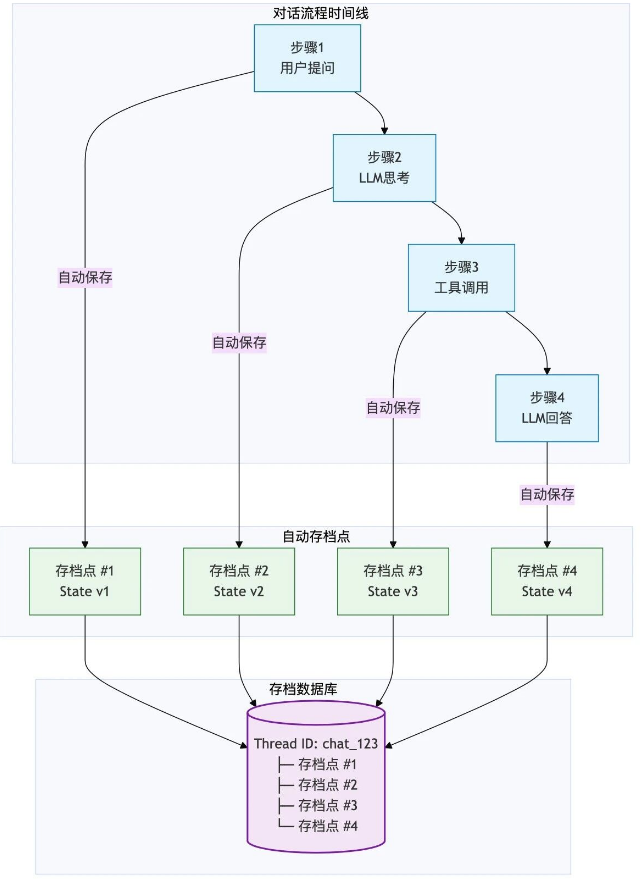

2.4 Checkpointer:可回溯的"存档系统"

Checkpointer为State提供持久化能力,将每次状态变更保存为快照。这不仅是容错机制,更是人机协作的桥梁。

- Thread ID:每个对话线程拥有唯一ID,用于隔离不同用户的上下文。开发者可通过ID随时恢复任意历史状态。

- 时间旅行:在Human-in-the-loop场景中,人类可暂停流程,修改State中的错误(如纠正工具参数),然后继续执行。AI会无缝衔接修正后的状态,仿佛从未出错。

3. 状态驱动 vs 链式传递:为何"围观"优于"传递"

传统Chain模式依赖显式的数据传递,每个步骤必须明确知道前一步的输出格式。这种方式在小型应用中可行,但随着复杂度增加,维护成本指数级上升。

3.1 链式传递的痛点

- 耦合度高:修改一个Chain的输出格式,可能需要连锁调整后续所有步骤。

- 调试困难:要理解当前状态,必须追踪整个调用链,无法直观查看全局上下文。

- 扩展性差:新增功能往往需要重构现有链条,难以复用。

3.2 状态驱动的优势

LangGraph的State模式将数据与逻辑解耦。所有节点"围观"同一块白板,按需读写。这种设计带来三大好处:

- 低耦合:节点只需关注自己负责的字段,无需了解其他节点的实现。

- 易调试:打印State即可获得完整上下文,无需跟踪调用栈。

- 高复用:同一Node可被不同流程复用,只要State结构兼容。

| 对比维度 | 链式传递 (Chain) | 状态驱动 (LangGraph) |

|---|---|---|

| 数据流 | 显式传递 | 共享内存 |

| 耦合度 | 高 | 低 |

| 调试难度 | 需追踪调用链 | 直接查看State |

| 扩展性 | 难以复用 | 节点可跨流程复用 |

| 错误恢复 | 通常需重头开始 | 可回溯到任意历史状态 |

4. 持久化与人机协作:给AI装上"存档键"

Checkpointer不仅是技术亮点,更是产品体验的分水岭。它让AI应用从"一次性计算"升级为"持久服务"。

4.1 快照机制的价值

每次Node执行后,State会被自动序列化并存储。这种快照机制支持:

- 长周期任务:用户中断后可随时恢复,无需重复操作。

- 审计追踪:完整记录任务执行轨迹,便于分析问题。

- A/B测试:对比不同策略下的State演变,优化决策逻辑。

4.2 Human-in-the-loop的终极形态

传统人机协作往往是"人类提需求,AI执行"。LangGraph则实现了更深度的协同:

- 暂停与修正:在关键步骤前设置中断点,人类可审查并修改State。

- 时间旅行:修正错误后,AI从修正点继续执行,无需重新开始。

- 责任分离:人类负责高阶决策和纠偏,AI负责机械性执行,各司其职。

笔者认为,这种设计真正体现了Agentic AI的精髓------不是取代人类,而是成为人类的"智能外脑"。开发者无需再为容错逻辑焦头烂额,因为系统本身已内置了"后悔药"。

5. Subgraph:构建复杂系统的"分形艺术"

面对超大规模任务,单个LangGraph可能力不从心。Subgraph机制允许将复杂流程分解为嵌套的子图,实现"分而治之"。

5.1 封装与抽象

一个Node内部可以是一个完整的LangGraph,对外只暴露输入输出接口。主图无需关心子图的内部细节,只需将其视为黑盒。这种分层设计:

- 降低认知负荷:开发者可聚焦于当前层级的逻辑。

- 促进模块化:子图可独立开发、测试和复用。

- 支持多智能体:不同子图可代表不同角色的Agent,协同完成任务。

5.2 实际应用场景

例如,一个客服系统可分解为:

- 主图:负责用户意图识别和任务分发。

- 子图1:处理订单查询,内部包含验证、查询、格式化等节点。

- 子图2:处理投诉,包含情绪分析、升级判断、解决方案生成等节点。

这种架构让系统既保持整体一致性,又具备局部灵活性。

结语

LangGraph的出现,标志着LLM应用开发从"脚本时代"迈入"智能体时代"。它用状态机和循环图,赋予了AI记忆、反思与自我修正的能力。State作为共享白板,Nodes作为功能单元,Conditional Edge作为决策中枢,Checkpointer作为存档系统------四者协同,构建了一个真正有"生命"的智能体。开发者不再需要预设所有路径,而是设计一套规则,让AI在动态环境中自主探索。这种范式转变,不仅提升了应用的鲁棒性和用户体验,更让我们离"通用人工智能"的愿景更近了一步。站在这个节点回望,LangChain的Chain不过是婴儿学步,而LangGraph才是真正奔跑的开始。