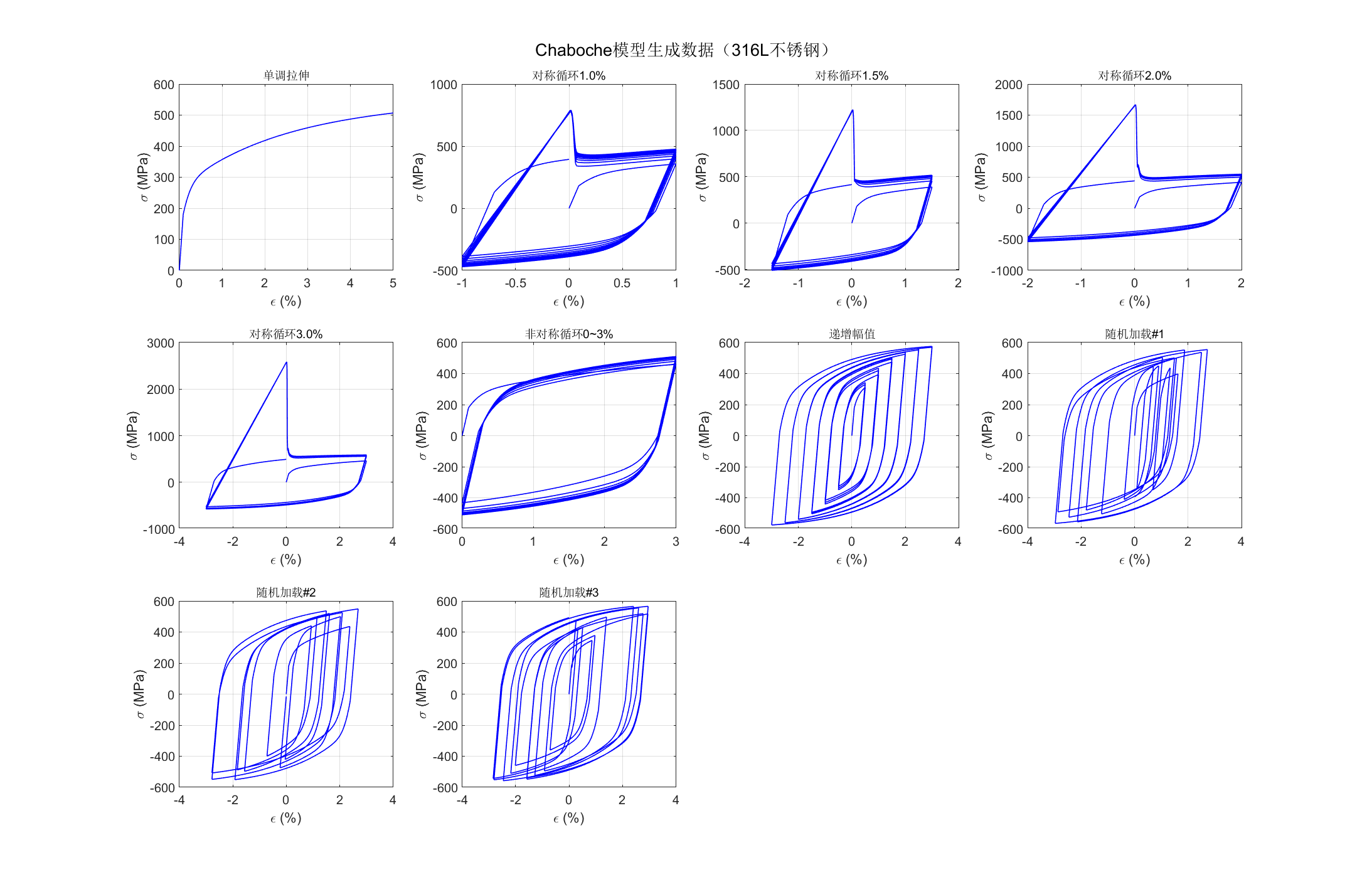

摘要:金属材料在循环载荷下呈现复杂弹塑性行为,传统Chaboche模型参数标定繁琐且泛化能力有限。本文以316L不锈钢为对象,基于Chaboche双背应力模型生成涵盖单调拉伸、对称/非对称循环、递增幅值及随机加载等10条路径的应力-应变数据集,以当前应变与应变增量为输入,构建双层LSTM网络学习本构关系。

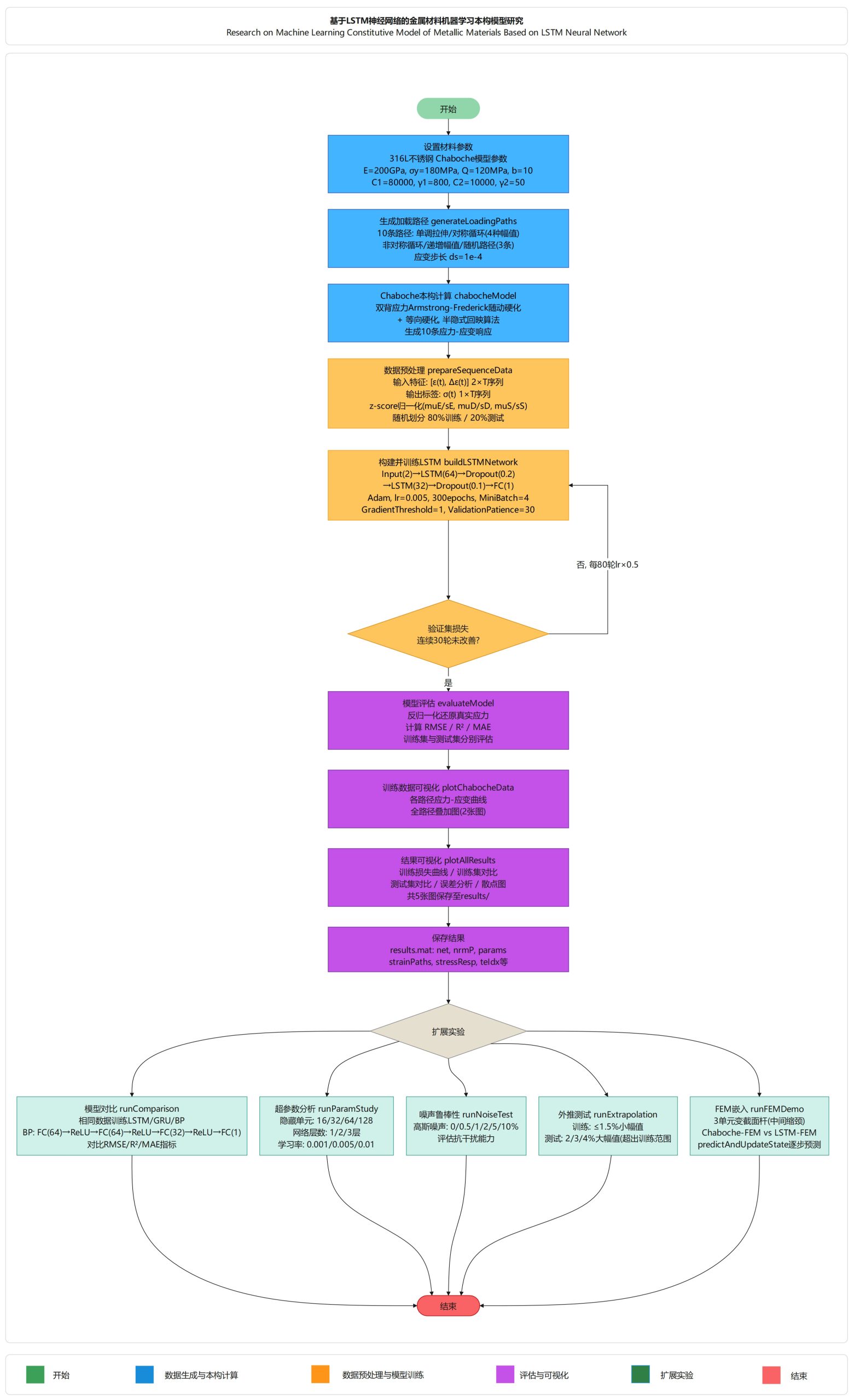

项目方案:基于LSTM神经网络的金属材料机器学习本构模型研究

项目简介

基于LSTM神经网络学习316L不锈钢Chaboche循环塑性本构关系,通过模型对比、超参数分析、噪声鲁棒性、外推能力及有限元嵌入五组实验验证其在数据驱动本构建模中的可行性。

系统概述

金属材料在循环载荷下表现出复杂的弹塑性行为,传统本构模型(如Chaboche模型)虽然理论严谨,但参数标定繁琐且难以适应多变的加载工况。本文提出一种基于长短期记忆(LSTM)神经网络的机器学习本构建模方法,以316L不锈钢为研究对象,利用Chaboche双背应力循环塑性模型生成包含单调拉伸、对称循环、非对称循环、递增幅值及随机加载等10条典型加载路径的应力-应变数据集,以当前应变ε(t)和应变增量Δε(t)为输入特征,应力σ(t)为输出标签,构建双层LSTM序列回归网络进行本构关系学习。

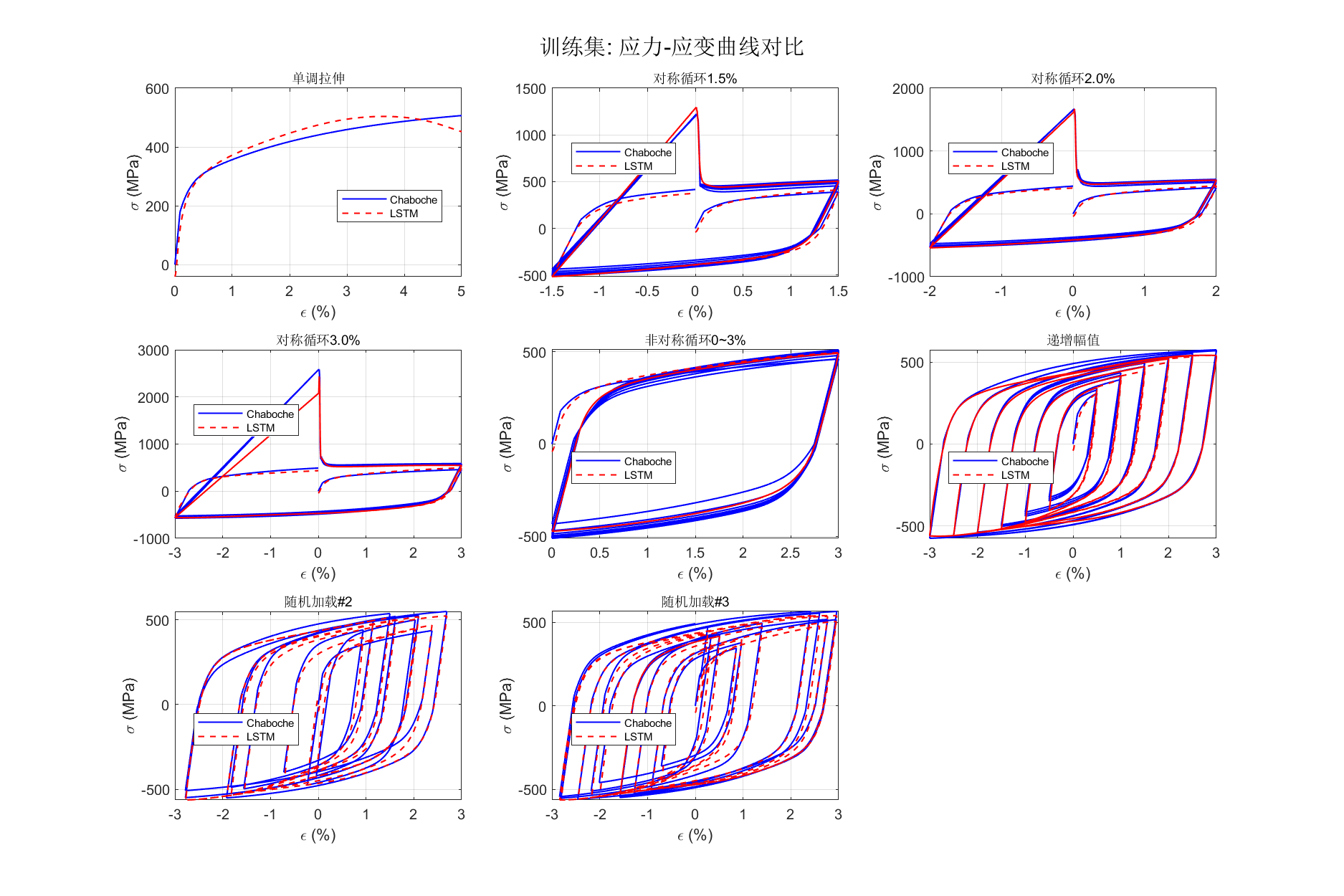

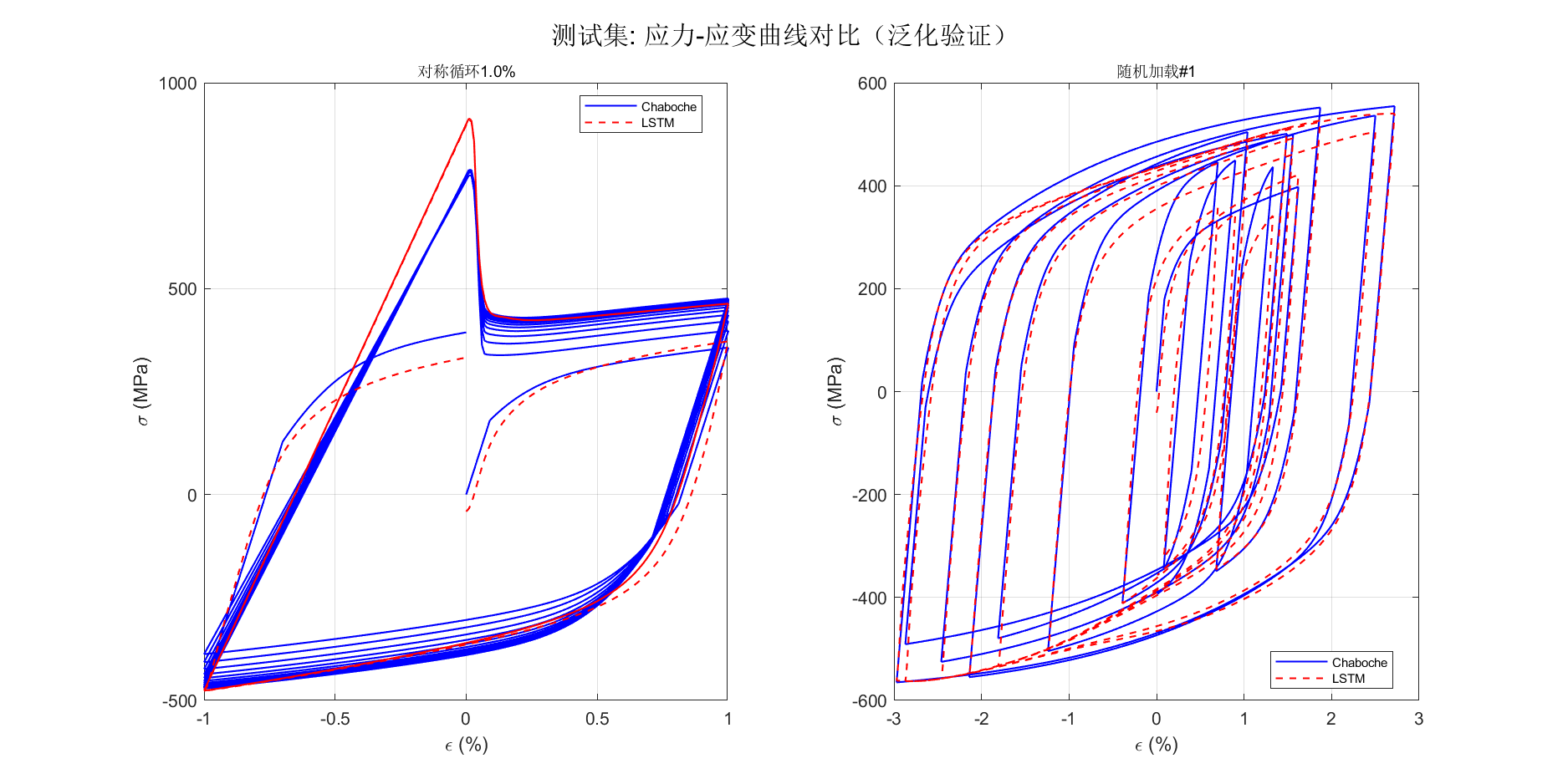

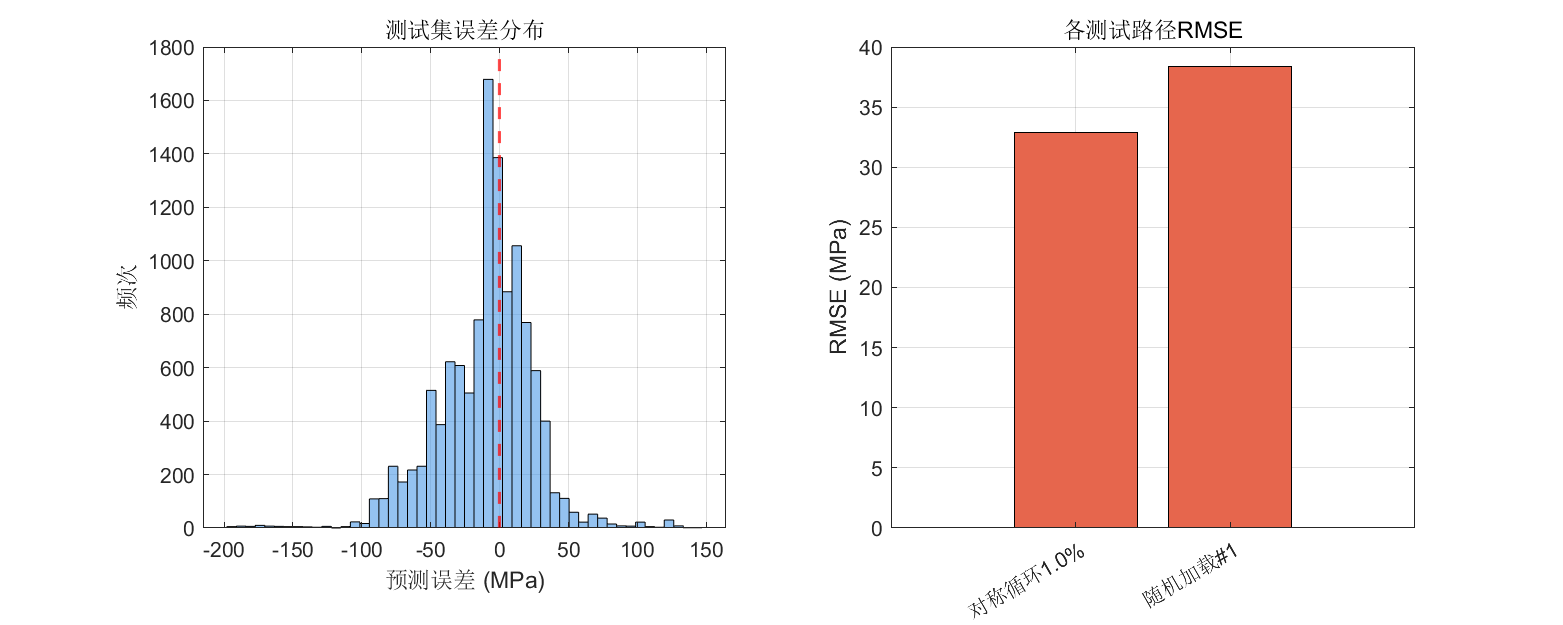

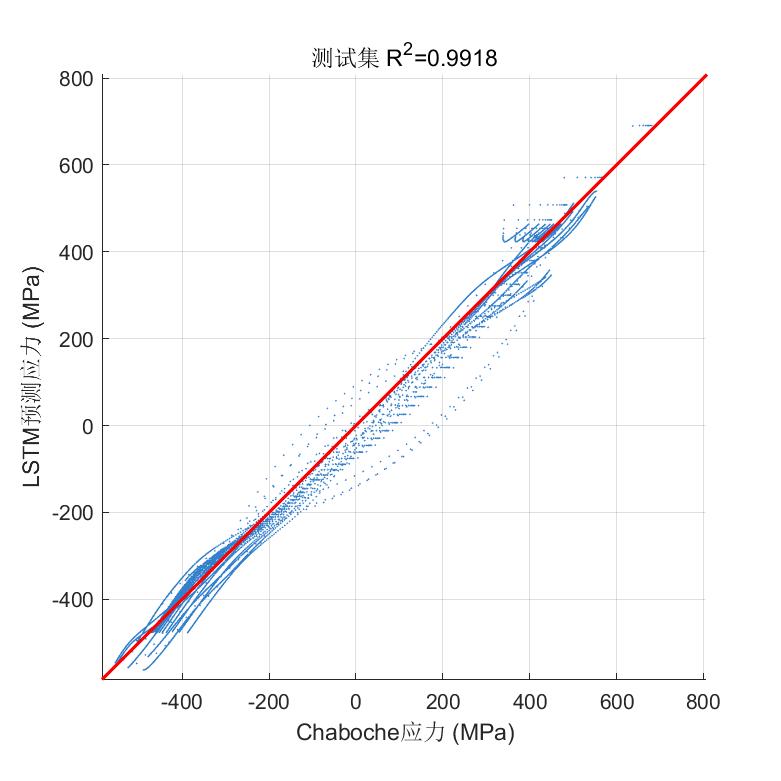

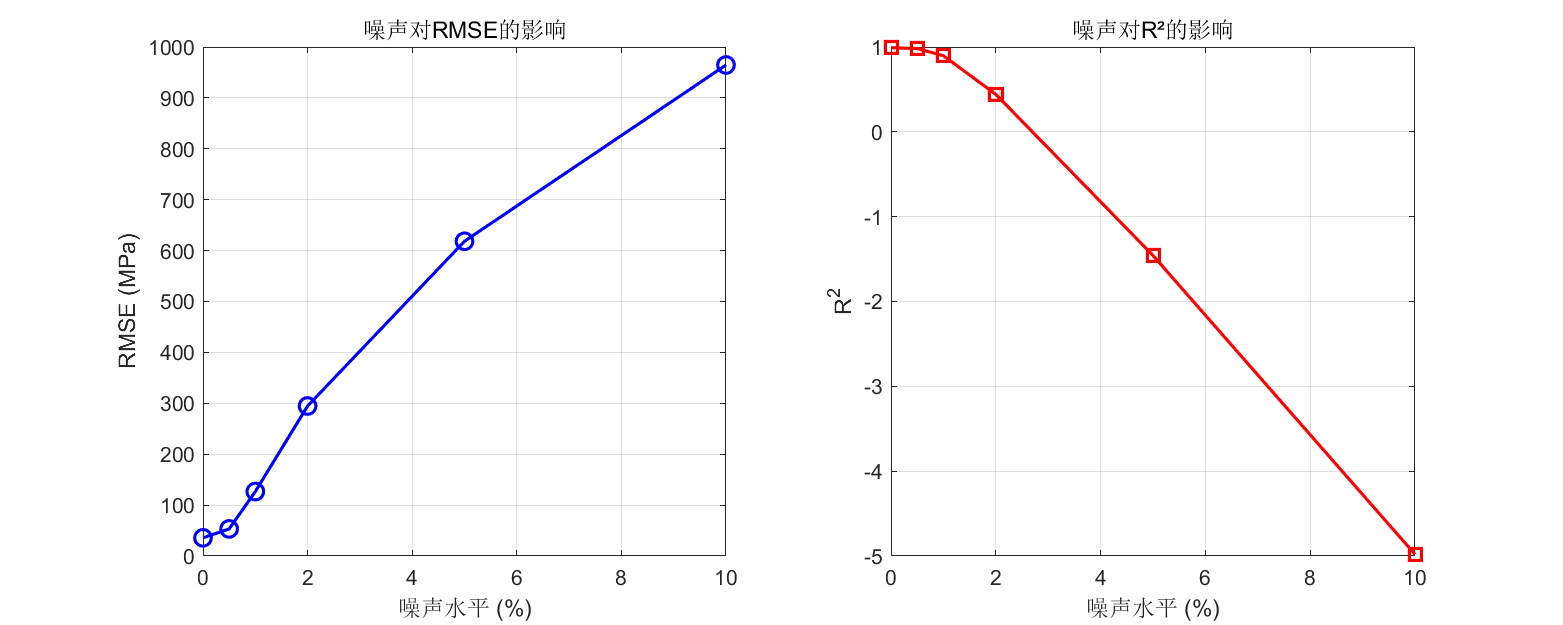

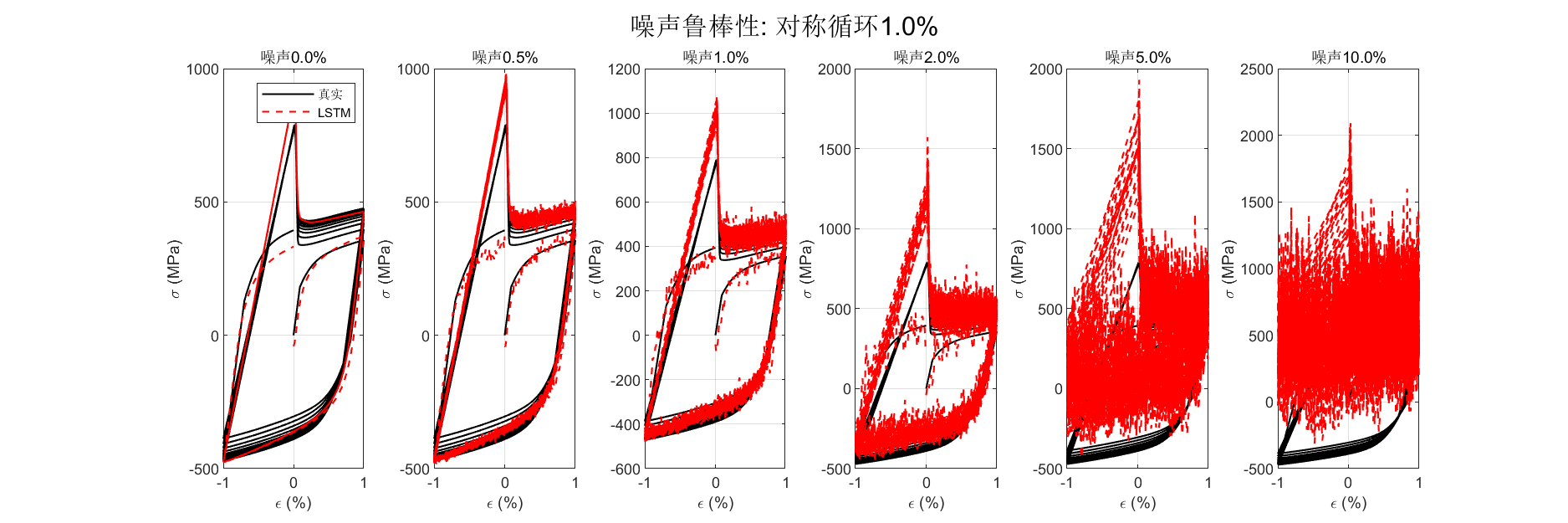

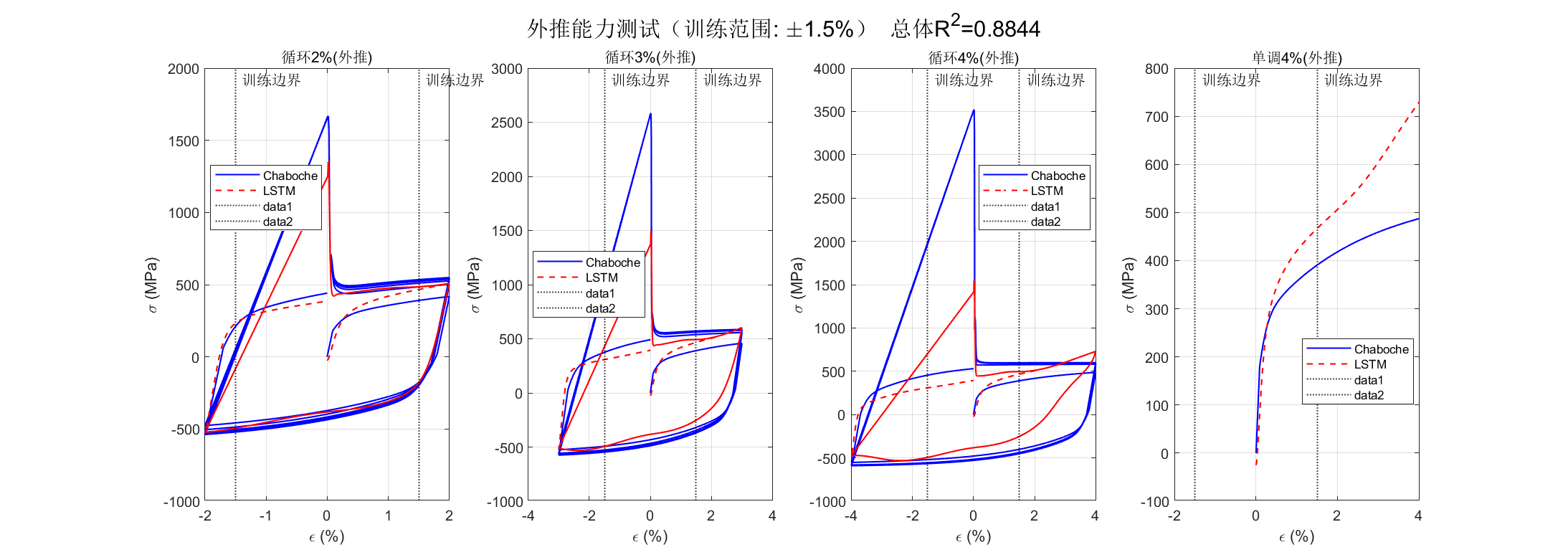

实验结果表明,LSTM模型在测试集上取得了R²=0.9918、RMSE=35.67MPa的预测精度。模型对比实验中,LSTM(R²=0.9915)与GRU(R²=0.9912)性能相当,均显著优于无记忆的BP网络(R²=0.8250),验证了循环神经网络在路径依赖本构建模中的优势。超参数敏感性分析表明,128个隐藏单元、2层网络、学习率0.001为最优配置。噪声鲁棒性测试显示,模型在0.5%噪声水平下仍保持R²=0.98的高精度,1%噪声时R²降至0.90。外推能力测试中,模型在训练范围(±1.5%)外的2%循环加载下R²=0.989,3%时R²=0.945,4%时R²=0.807,表现出一定的泛化能力。

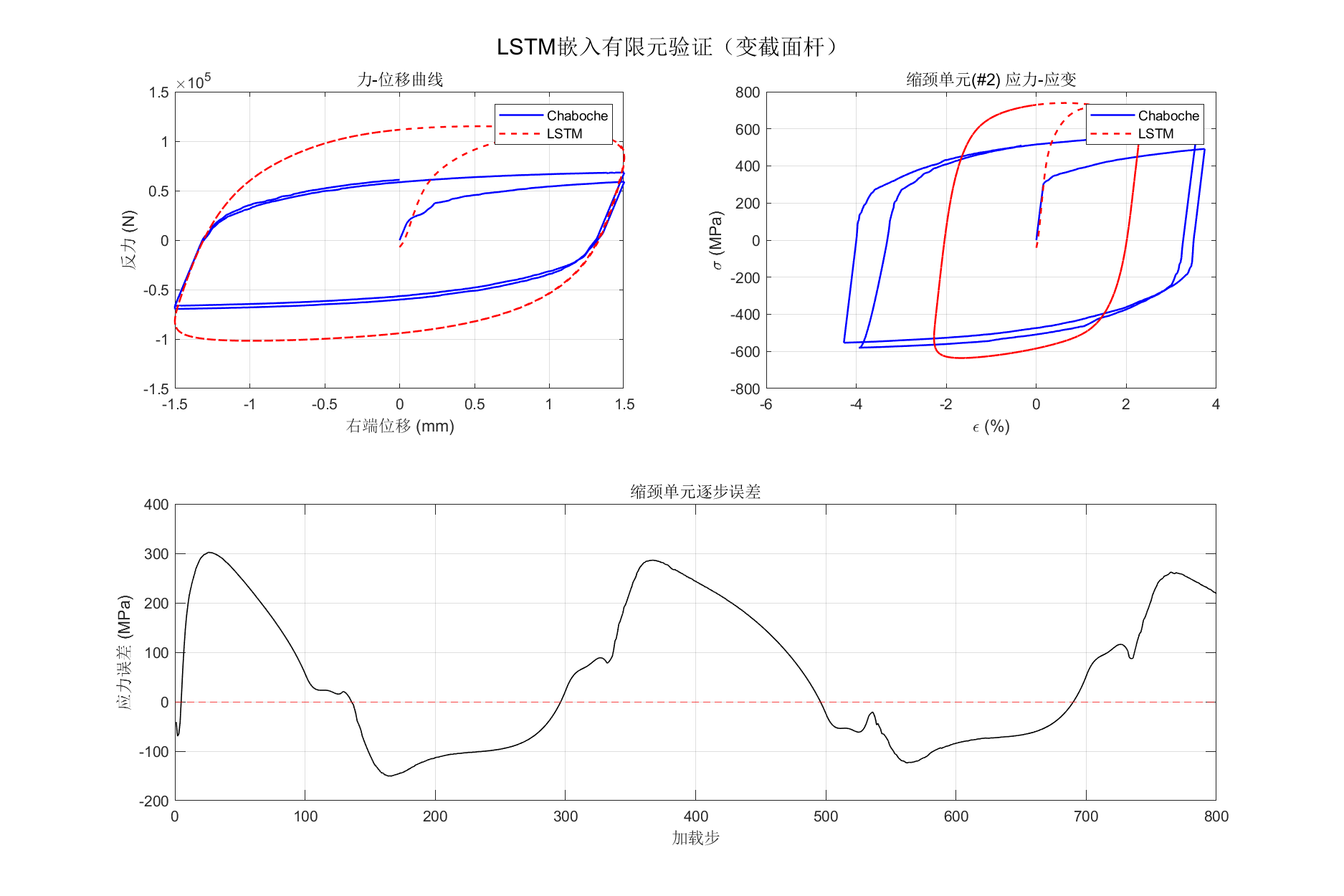

本文进一步将训练好的LSTM本构模型嵌入有限元框架,对3单元变截面杆(中间缩颈)进行了循环加载模拟,验证了机器学习本构模型在工程数值计算中的可行性。研究结果表明,LSTM神经网络能够有效学习金属材料的循环塑性本构关系,为数据驱动本构建模提供了一种可行的技术路径。

系统架构

以Chaboche模型生成应力-应变数据为输入,经z-score归一化后送入双层LSTM(64-32)序列回归网络训练,输出本构预测结果并通过6个独立实验脚本完成评估与可视化。

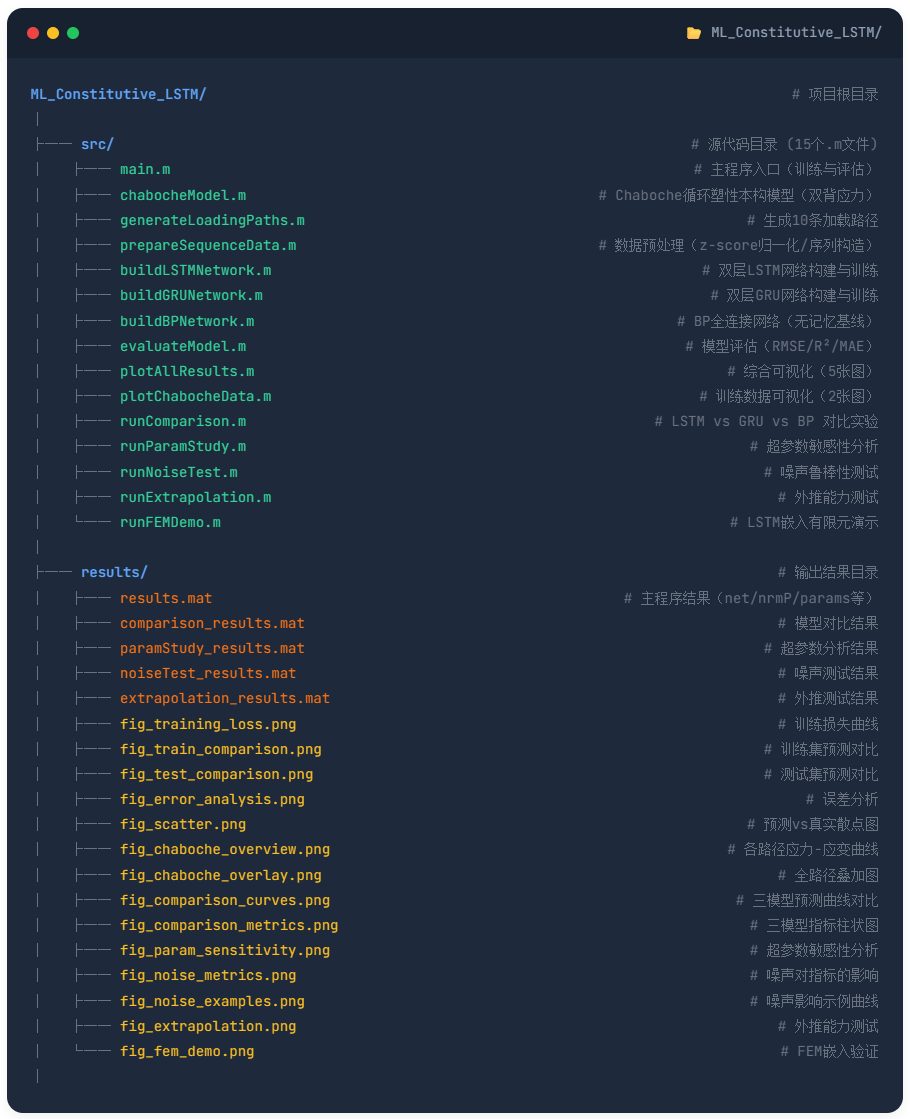

项目结构

基于MATLAB Deep Learning Toolbox的金属材料机器学习本构建模项目。以 chabocheModel.m 实现双背应力循环塑性本构的回映算法生成316L不锈钢应力-应变数据,prepareSequenceData.m 构造[ε(t), Δε(t)]→σ(t)序列并z-score归一化,buildLSTMNetwork.m 构建双层LSTM(64-32)序列回归网络,evaluateModel.m 计算RMSE/R²/MAE指标。5个实验脚本分别完成模型对比、超参数分析、噪声测试、外推测试和FEM嵌入验证。所有.mat数据与14张PNG图表保存至 results/。

目录结构

核心模块

核心模块包括:chabocheModel.m实现双背应力Armstrong-Frederick循环塑性本构的回映算法,作为数据生成引擎产出10条应力-应变响应;prepareSequenceData.m将原始数据 构造为[ε(t), Δε(t)]→σ(t)的序列格式并进行z-score归一化与80/20训练测试划分;buildLSTMNetwork.m构建Input(2)→LSTM(64)→Dropout(0.2)→LSTM(32)→Dropout(0.1)→FC(1) 的双层LSTM序列回归网络,采用Adam优化器训练300轮;evaluateModel.m对预测结果反归一化后计算RMSE、R²、MAE三项指标,完成模型精度评估。

快速开始

在MATLAB中打开 src/ 目录,依次运行:main.m(数据生成、LSTM训练与基础评估)→ runComparison.m(模型对比)→ runParamStudy.m(超参数分析)→ runNoiseTest.m(噪声测试)→ runExtrapolation.m(外推测试)→ runFEMDemo.m(FEM嵌入)。所有结果自动保存至 results/ 文件夹。需要 MATLAB Deep Learning Toolbox。

环境要求

MATLAB R2021a 及以上版本,依赖工具箱:Deep Learning Toolbox(trainNetwork / predict / predictAndUpdateState)。无需GPU,CPU即可运行全部实验。

查看结果

数据:5个.mat文件(results.mat 含训练好的LSTM网络net、归一化参数nrmP、材料参数params等)。图表:plotChabocheData 2张 + plotAllResults 5张 + runComparison 2张 + runParamStudy 1张 + runNoiseTest 2张 + runExtrapolation 1张 + runFEMDemo 1张,共14张PNG。

实验结果

LSTM测试集R²=0.9918,显著优于BP网络(0.8250),在0.5%噪声和2倍训练范围内外推仍保持高精度,但噪声超过1%、外推超过3倍训练范围后精度明显下降,FEM嵌入验证了工程应用可行性。

结果展示

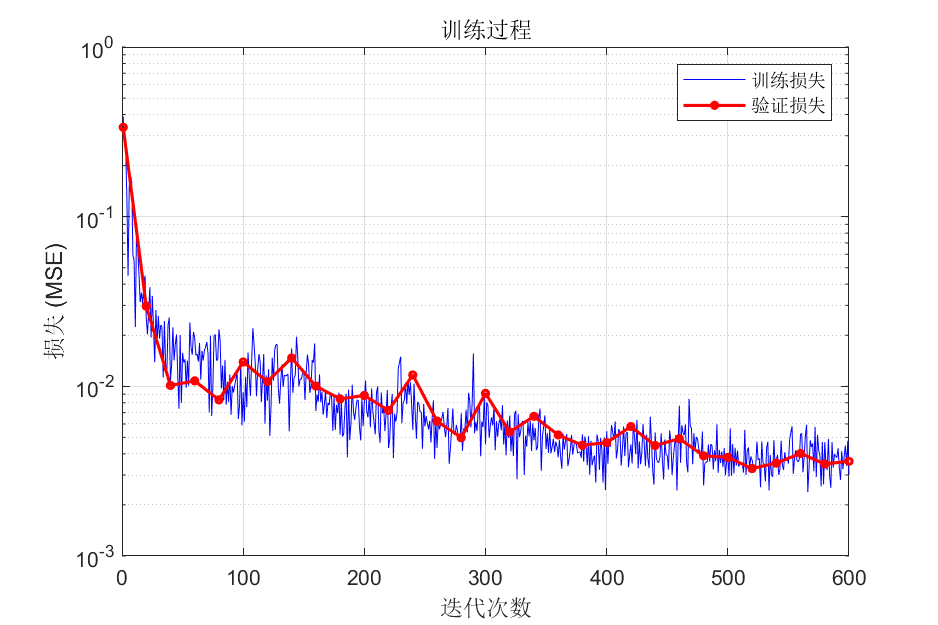

运行main.m

图1 训练损失曲线

图2 训练集预测对比

图3 测试集预测对比

图4 误差分析

图5 预测vs真实散点图

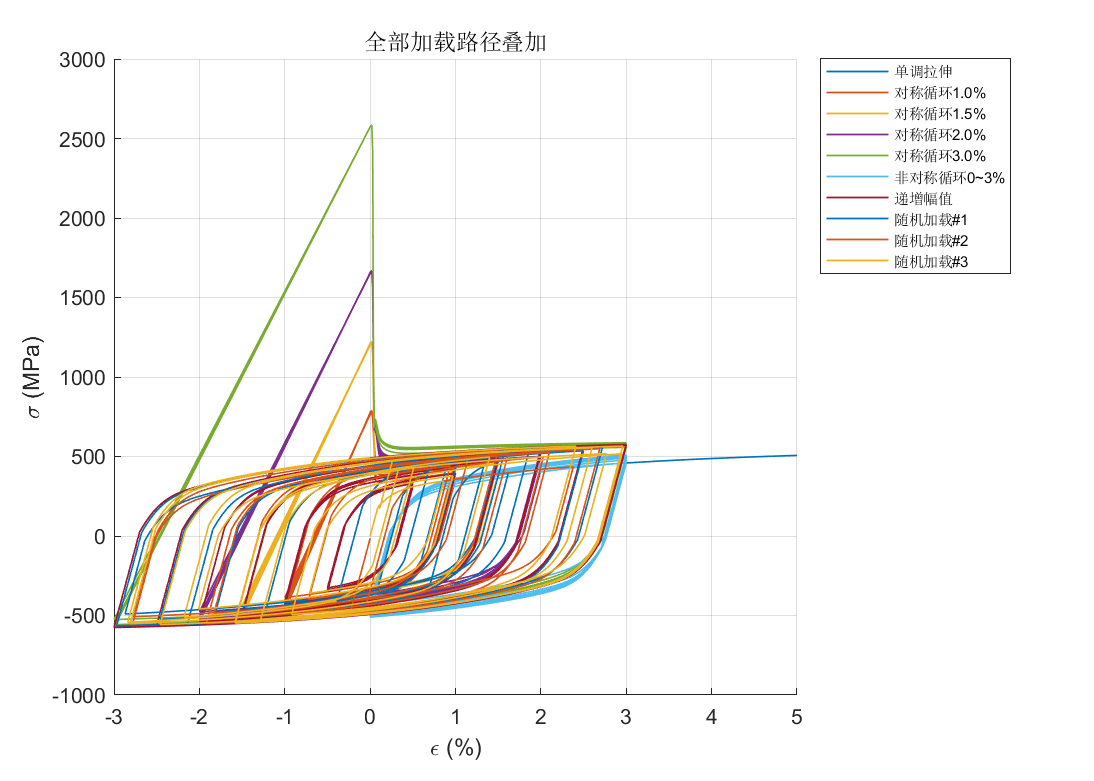

图6 各路径应力-应变曲线

图7 全路径叠加图

运行runComparison.m

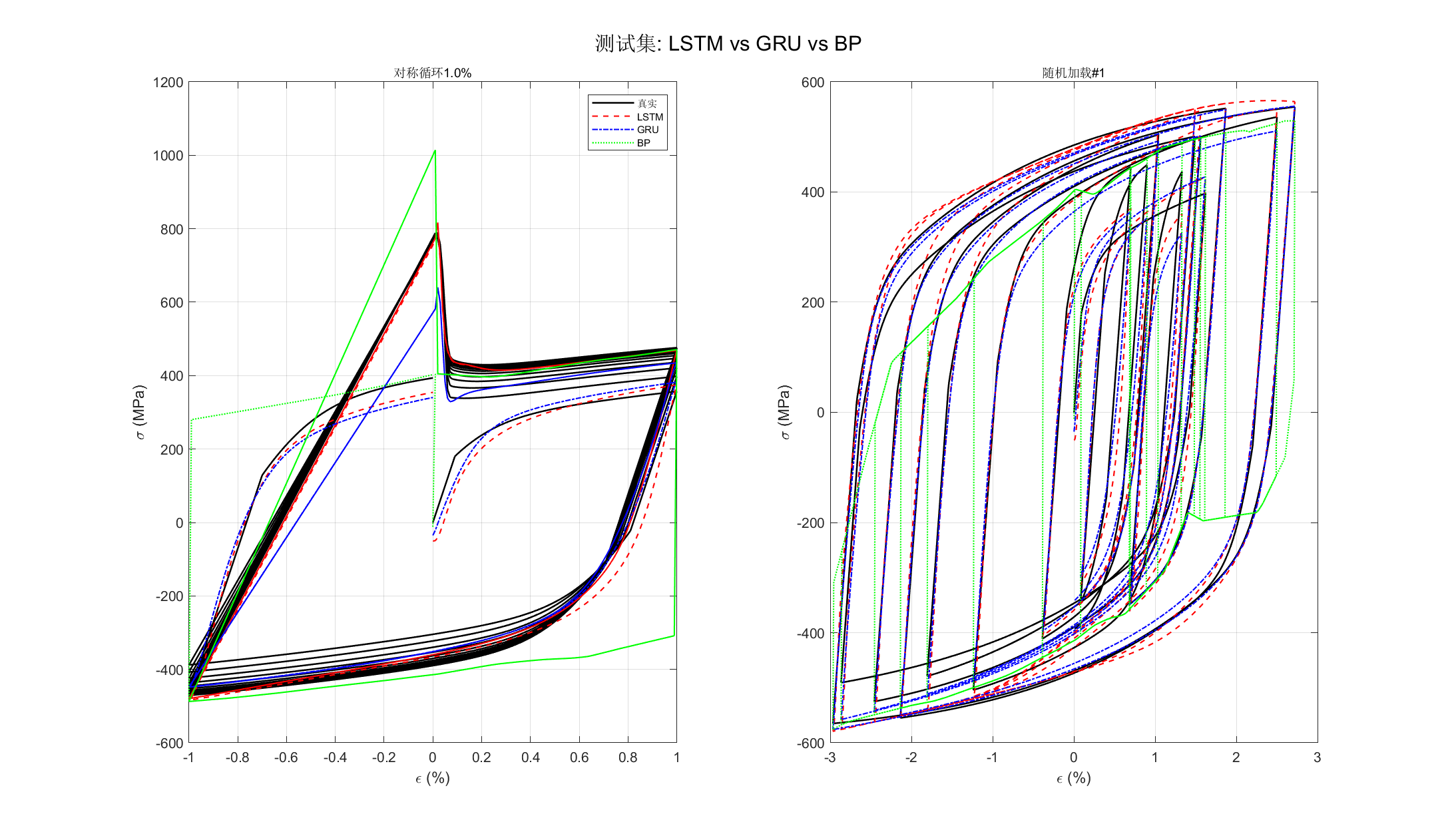

图8 三模型预测曲线对比

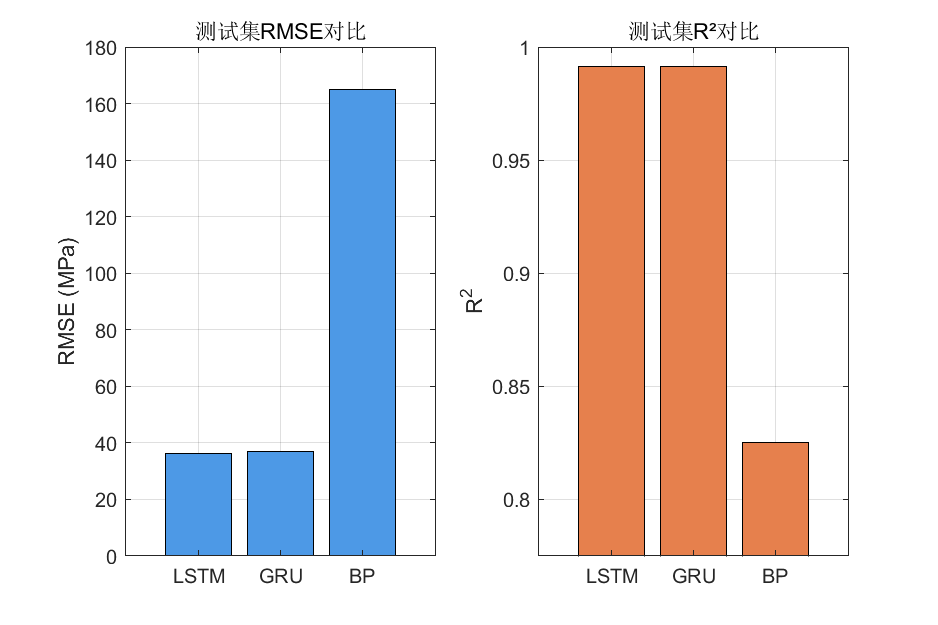

图9 三模型指标柱状图

运行runParamStudy.m

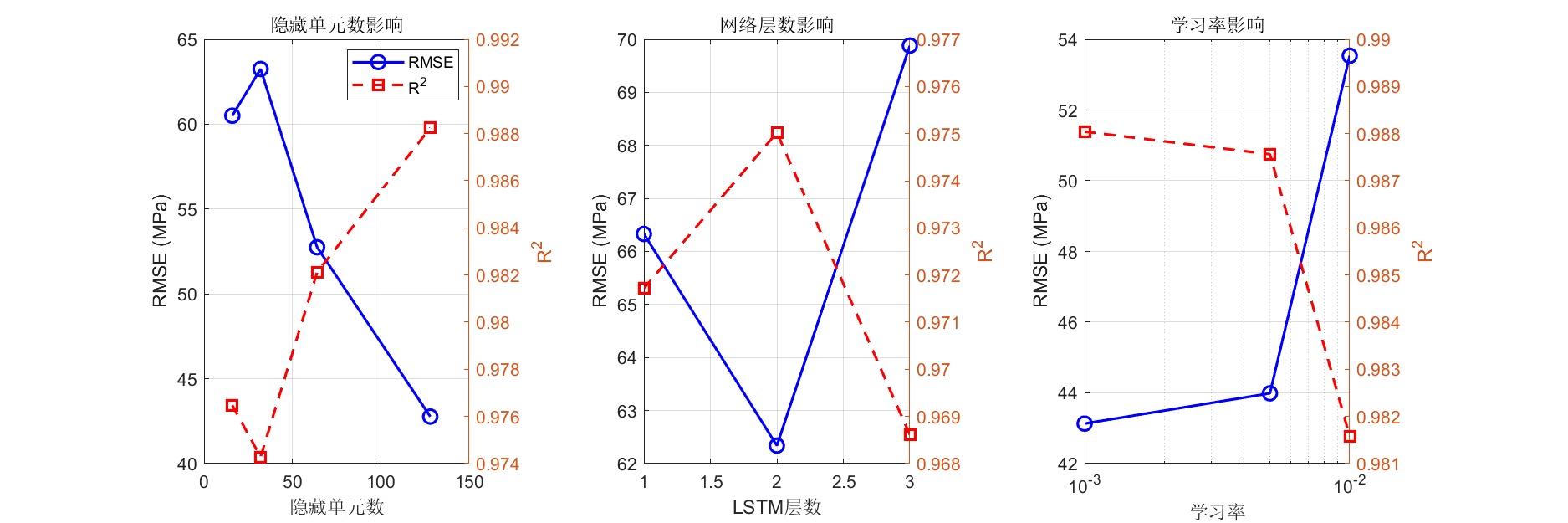

图10 超参数敏感性分析

运行runNoiseTest.m

图11 噪声对指标的影响

图12 噪声影响示例曲线

运行runExtrapolation.m

图13 外推能力测试

运行runFEMDemo.m

图14 FEM嵌入验证

结果点评

实验结果表明,LSTM模型在测试集上达到R²=0.9918(RMSE=35.67 MPa),训练集R²=0.9953,二者差距较小,未出现明显过拟合。 模型对比实验中LSTM(R²=0.9915)与GRU(R²=0.9912)性能相当,均显著优于无记忆的BP网络(R²=0.8250),验证了循环神经网 络在路径依赖本构建模中的必要性。超参数分析显示128个隐藏单元、2层网络、学习率0.001为最优配置,过浅欠拟合、过深则过 拟合。噪声鲁棒性方面,模型在0.5%噪声下仍保持R²=0.98,但1%噪声时降至0.90,表明直接应用于真实实验数据前需进行去噪预 处理。外推测试中,模型在2%循环加载下R²=0.989,3%时降至0.945,4%时为0.807,单调4%拉伸R²=-1.12完全失效,反映出LSTM对 超出训练范围的未知加载模式泛化能力有限,这也是当前数据驱动本构模型的普遍瓶颈。FEM嵌入实验中反力相对RMSE为47.92%, 精度受限于LSTM缺乏切线刚度矩阵导致的应变分配误差累积,但验证了机器学习本构模型嵌入有限元框架的可行性。

项目资源

包括完整的项目源代码、演示视频、运行截图,开箱即用。

关于项目

本项目基于MATLAB Deep Learning Toolbox,以Chaboche双背应力循环塑性模型生成316L不锈钢应力-应变数据,训练双层LSTM(64 -32)网络学习本构映射关系,通过模型对比、超参数分析、噪声鲁棒性、外推能力及FEM嵌入五组实验系统验证了数据驱动本构建 模的可行性与局限性,包含15个源文件、5个.mat数据文件和14张结果图表。

项目背景

传统金属材料循环塑性本构模型(如Chaboche模型)参数标定依赖大量实验且难以适应复杂加载工况,近年来机器学习方法为本构建模提供了新思路,其中LSTM神经网络凭借其序列记忆能力天然适合描述金属材料的路径依赖弹塑性行为,本项目即探索以LSTM替代传统本构方程实现应变-应力映射的可行性。

作者信息

作者:Bob (张家梁)

项目编号:MP-4

原创声明:本项目为原创作品