方案背景

经过近期作者在本地PC上搭建和试用OpenClaw后有一些思考和改进的想法,OpenClaw试水可以参考

目前OpenClaw的能力较大范围的受限于当前的架构和设计。目前很多指令和功能都需要依赖于将用户的指令转换为Shell(或PowerShell)命令进行执行,这种方式首先会因为用户试用的不同系统造成最终执行结果的差异较大,并且会造成消耗的Tokens和算力数量不确定等问题。例如上面OpenClaw试水中执行简单Windows的磁盘空间查询过程中消耗了大量的Tokens。

因此近期作者在试用过程中在思考有没有更好的方案可以实现本地Agent操作个人PC,在这个过程中发现了去年字节开源的项目UI-TARS和UI-TARS-desktop。通过项目的介绍可以看到,UI-TARS是一个基于视觉大模型开源的多模态Agent系统,能够基于类人的视觉模型在本地机器中执行各种各样的任务。

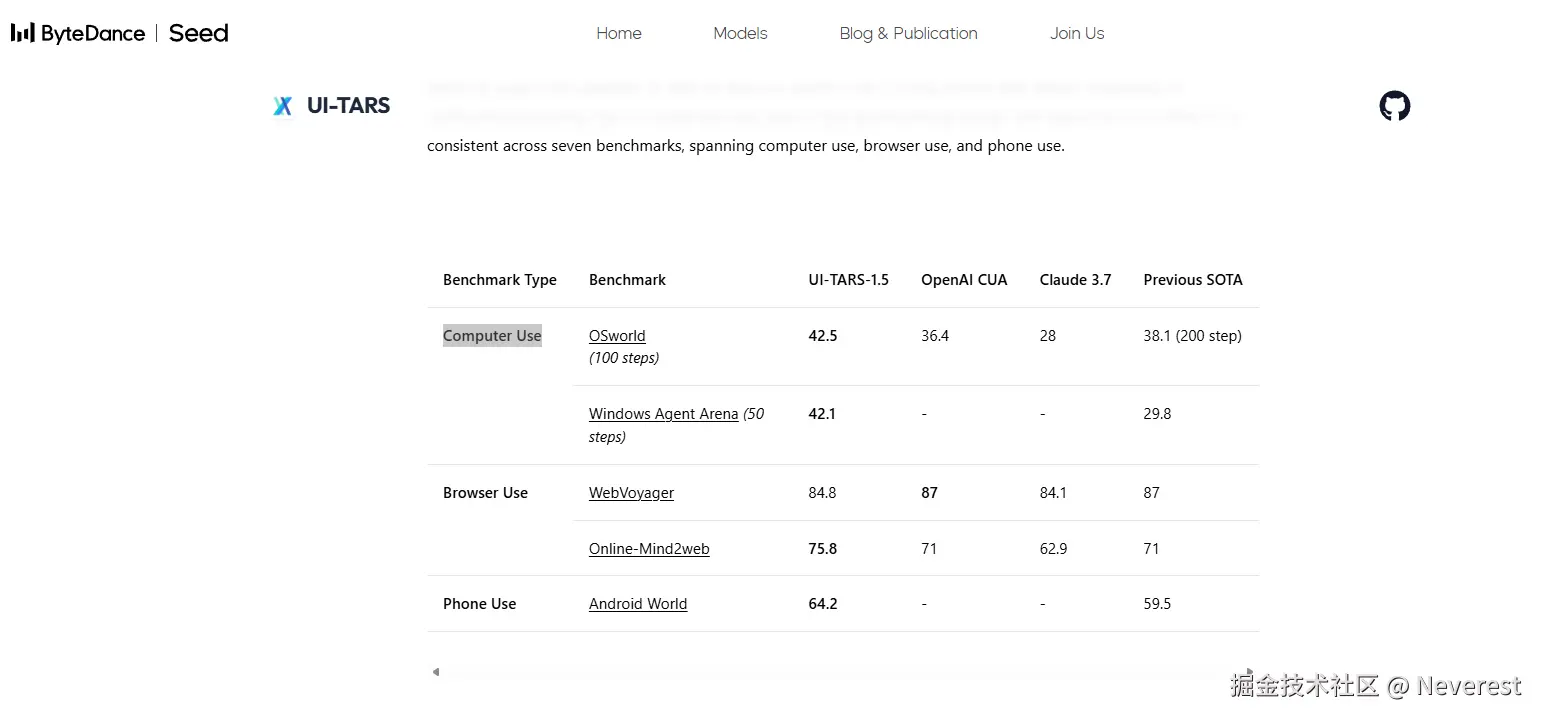

根据字节官网介绍,UI-TARS-1.5在发布时对比OpenAI和Claude 3.7等业界优秀的模型在Computer Use、Browser Use和Phone Use的Benchmark中拥有更好的效果。

UI-TARS试水

在了解了UI-TARS之后,作者对于它能做到的能力和效果产生了极大的兴趣,但是在本地试用的过程中发现字节并没有很好的维护和继续演进UI-TARS。目前能找到的相关编译和测试教程,基本都是去年的文章,并且大部分是基于MacOS进行试用。由于作者日常试用的WinPC没办法很好的进行从头编译安装,尝试了本地最终失败放弃,因此中间一度放弃了这个方向。

本地安装UI-TARS-desktop

后续某天在搜索UI-TARS-desktop过程中,无意发现网上部分文章提到WinPC中有直接可以试用的exe安装文件,因此重新激起了试用这块的兴趣,经过一番寻找后发现,UI-TARS-desktop在目前最新的v0.3.0版本中进发布了源代码,但是在稍早些的v0.2.4版本中曾今发布过WinPC可用的exe文件,可以直接下载试用,虽然不是最新的版本,但是对于本地进行试用也是可以满足基本要求了。

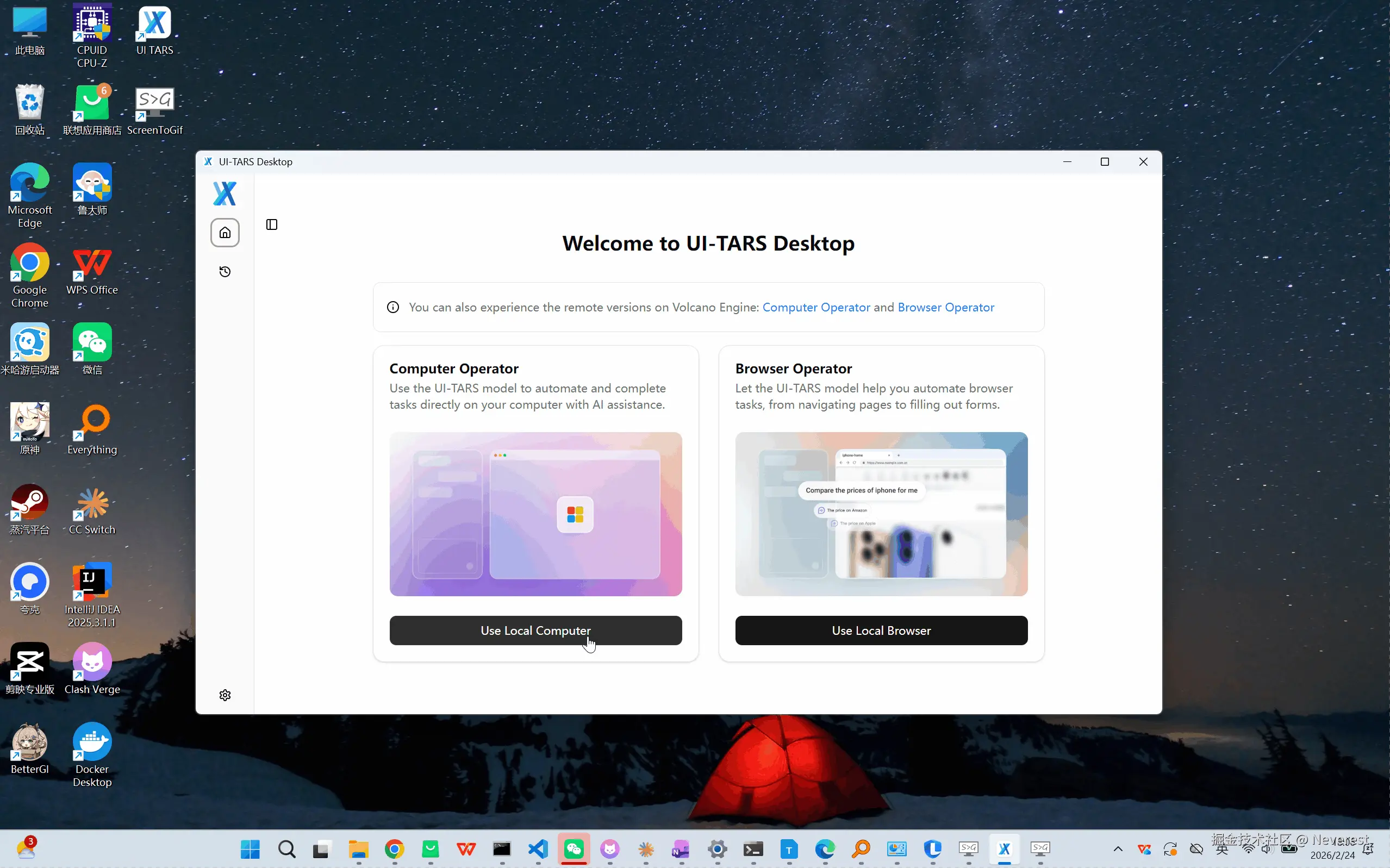

本地试用UI-TARS-desktop效果展示

通过上一章节中直接下载的exe文件,可以在Win11的个人电脑中直接进行试用,最终测试效果如下:

效果结论:UI-TARS-desktop可以直接调用火山方舟的云端模型,根据本地用户给出的prompt直接基于图像的视觉大模型对WinPC进行操作。

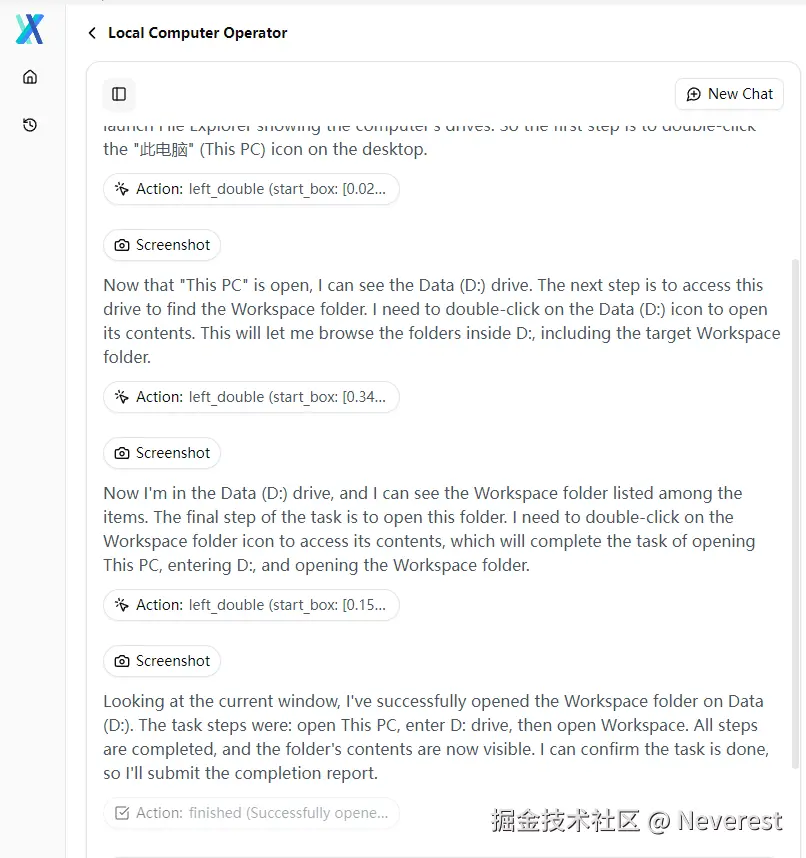

UI-TARS-desktop的测试过程如下:

步骤一:提供prompt并且执行截图后上传大模型处理

prompt:open my computer and then enter disk d:, open Workspace folder 本地调用桌面截图后上传给大模型处理,大模型识根据指令识别到应该调用鼠标点击的位置,直接调用鼠标 Action: left_double

步骤二:根据后续指令继续执行上述循环操作,直到完成任务

可以看到此处的任务在打开此电脑后,继续执行 截图 -> 上传大模型识别处理 -> Action: left_double打开盘符D -> 截图 -> 上传大模型识别处理 -> Action: left_double打开Workspace文件夹

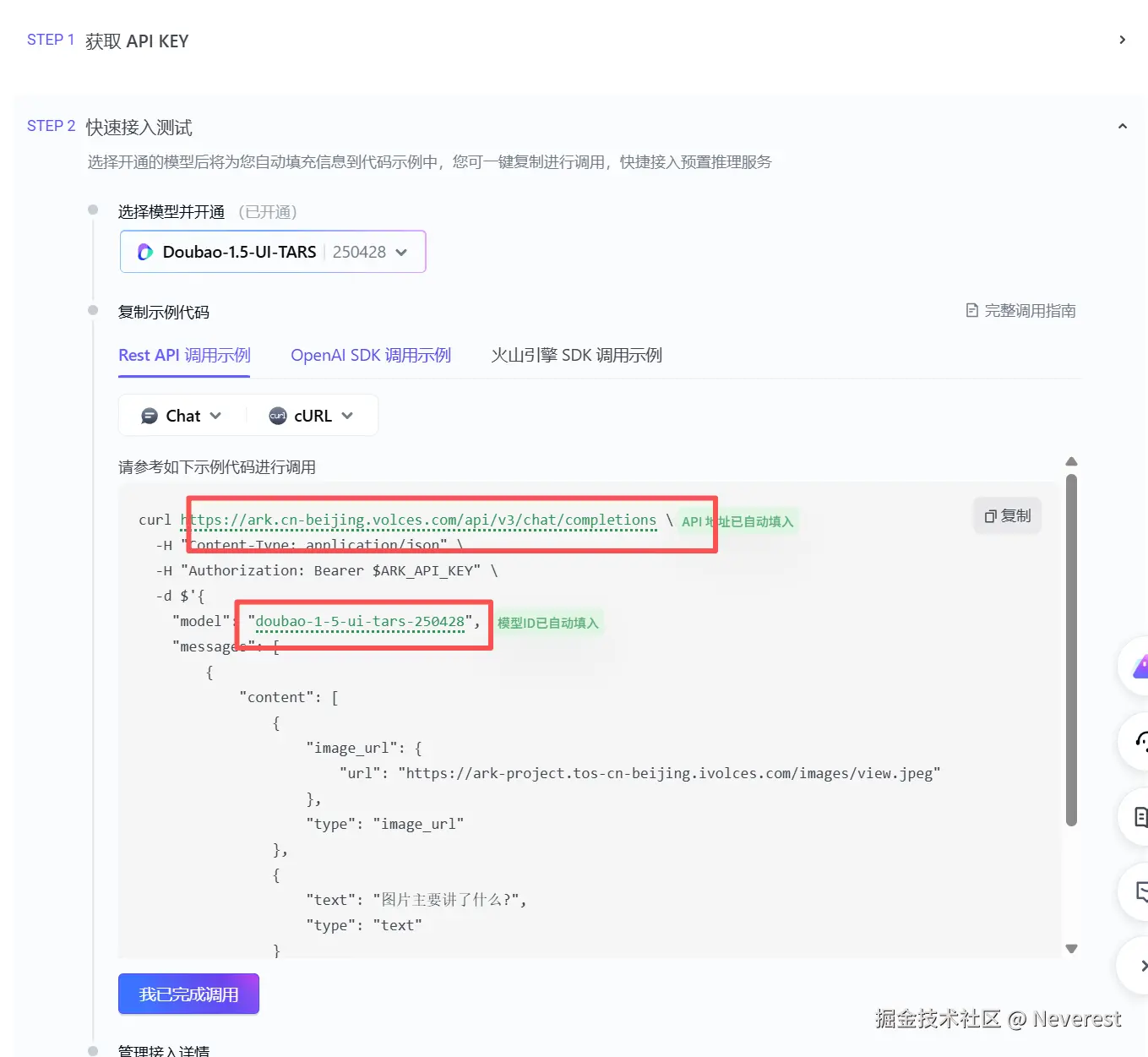

过程中碰到的坑:Doubao-1.5-UI-TARS云端无法使用

由于作者的办公电脑未配置独立的GPU,并且根据火山方舟的模型广场中界面展示已经提供了 Doubao-1.5-UI-TARS 模型,因此作者在试用过程中优先选择使用云端部署的 Doubao-1.5-UI-TARS 模型。

但是在UI-TARS-desktop中配置了对应接入点和模型后,一直无法使用,界面在输入prompt之后会卡死(这里吐槽一下GUI工具的异常处理做的不太好)。

按照火山方舟模型广场中提供的配置如下:

经过多次尝试,Doubao-1.5-UI-TARS模型还是以调用失败告终,最终在自定义推理接入点中发现 Doubao-1.5-UI-TARS模型已经计划日落,无法新增使用(这里要吐槽火山方舟,模型的日落和使用管理比较混乱,在模型广场的主入口没有进行相关提示)

|

|

|---|

最终选择Doubao-Seed-1.8的多模态模型进行测试,创建对应的自定义推理接入点可以正常测试。