****论文题目:****Language Models are Few-Shot Learners(语言模型是一次性学习者)

****摘要:****最近的工作表明,通过在大量文本语料库上进行预训练,然后在特定任务上进行微调,在许多NLP任务和基准上取得了实质性的进展。虽然在体系结构中通常与任务无关,但这种方法仍然需要特定于任务的数千或数万个示例的微调数据集。相比之下,人类通常只需要几个例子或简单的指令就能完成一个新的语言任务------这是目前NLP系统在很大程度上仍然难以做到的。在这里,我们表明,扩展语言模型极大地提高了任务不可知的、少量样本学习的性能,有时甚至达到了与先前最先进的微调方法的竞争力。具体来说,我们训练了GPT-3,一个具有1750亿个参数的自回归语言模型,比以往任何非稀疏语言模型都多10倍,并在少量样本学习设置中测试了它的性能。对于所有任务,GPT-3的应用没有任何梯度更新或微调,任务和少量样本学习演示完全通过与模型的文本交互指定。GPT-3在许多NLP数据集上都有很强的表现,包括翻译、问答和完形填空任务,以及一些需要实时推理或领域适应的任务,如解乱单词、在句子中使用新单词或执行3位数算术。同时,我们还确定了一些GPT-3的少量样本学习仍然挣扎的数据集,以及一些GPT-3面临与大型网络语料库训练相关的方法问题的数据集。最后,我们发现GPT-3可以生成新闻文章的样本,人类评估者很难将其与人类撰写的文章区分开来。我们讨论了这一发现和GPT-3的更广泛的社会影响。

GPT-3 - Few-Shot学习的崛起与大规模语言模型的新纪元

引言:从GPT到GPT-3的演进之路

2020年5月,OpenAI发布了震撼业界的GPT-3论文《Language Models are Few-Shot Learners》。这篇论文不仅将语言模型的参数规模推向了前所未有的1750亿 ,更重要的是,它展示了一个令人兴奋的可能性:大规模语言模型可以在无需微调的情况下,仅通过少量示例就能执行各种任务。

在深入GPT-3之前,让我们先简要回顾GPT家族的演进:

GPT系列的演进轨迹

| 模型 | 参数量 | 核心贡献 | 主要范式 |

|---|---|---|---|

| GPT-1 (2018) | 117M | 证明预训练+微调范式有效 | 微调为主 |

| GPT-2 (2019) | 1.5B | 展示零样本能力的可能性 | 微调+零样本探索 |

| GPT-3 (2020) | 175B | 证明few-shot学习可行 | Few-shot为主 |

GPT-3的核心洞察可以用一句话概括:当语言模型足够大,在足够多样化的数据上训练时,它会在预训练期间学会执行各种任务,然后可以在推理时通过上下文快速识别和适应新任务。

问题的提出:微调范式的困境

当前方法的三大局限

尽管预训练+微调范式取得了巨大成功,但GPT-3的作者指出了三个根本性问题:

1. 实际应用受限

每个新任务都需要数千到数十万个标注样本。这意味着:

- 修正语法、生成抽象概念示例、评论短篇小说等任务难以获得足够数据

- 限制了语言模型的应用范围

- 对于大多数可能有用的语言任务,收集数据既昂贵又耗时

2. 虚假相关性问题

论文引用了重要观察:

"模型的表达能力越强,训练分布越窄,利用虚假相关性的潜力就越大" HLW+20

这导致:

- 大模型在特定基准上可能达到"人类水平"

- 但实际任务性能可能被夸大 GSL+18, NK19

- 分布外泛化能力差 YdC+19, MPL19

3. 与人类学习的差距

人类通常只需:

- 简单的自然语言指令:"请告诉我这句话描述的是开心还是悲伤的事"

- 或极少量示例:"这里有两个勇敢行为的例子;请给出第三个勇敢的例子"

这种适应性让人类能够:

- 无缝混合或切换多个任务和技能

- 在冗长对话中执行加法运算

- 快速学习新任务

当前NLP系统缺乏这种流畅性和通用性。

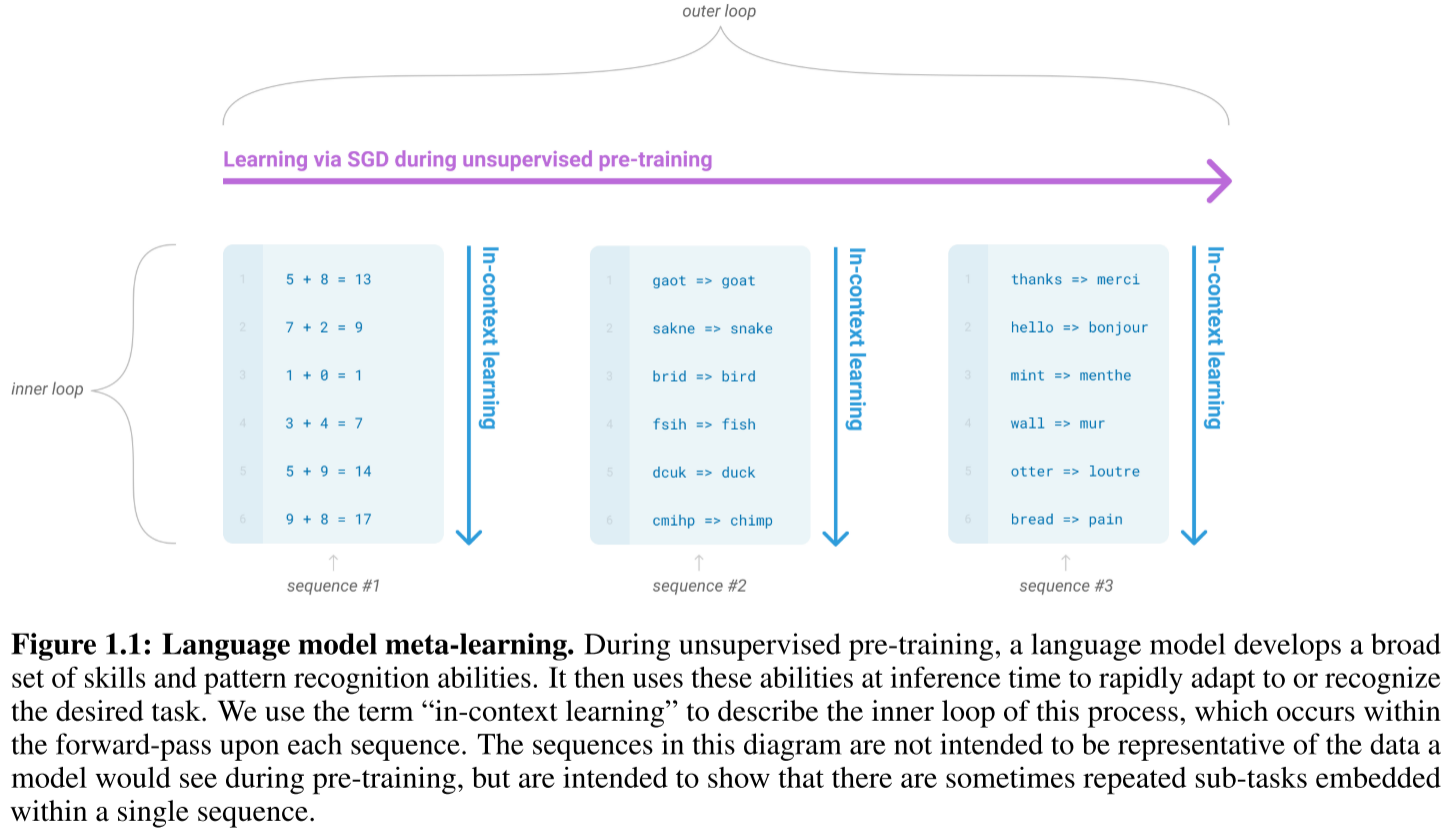

核心创新:Meta-Learning与In-Context Learning

概念框架

GPT-3引入了一个优雅的概念框架:

元学习(Meta-Learning):

- 外循环(Outer Loop) :在大规模无监督预训练期间

- 模型学习广泛的技能和模式识别能力

- 隐式学习识别和执行任务的能力

- 内循环(Inner Loop) :在推理时的上下文学习

- 通过前向传播中的计算快速适应

- 无权重更新

- 结构类似于RL² DSC+16

In-Context Learning(上下文学习):

在推理时,模型的上下文作为一种"任务规范":

- 模型在自然语言指令和/或任务示例的条件下

- 通过预测接下来的内容来完成任务实例

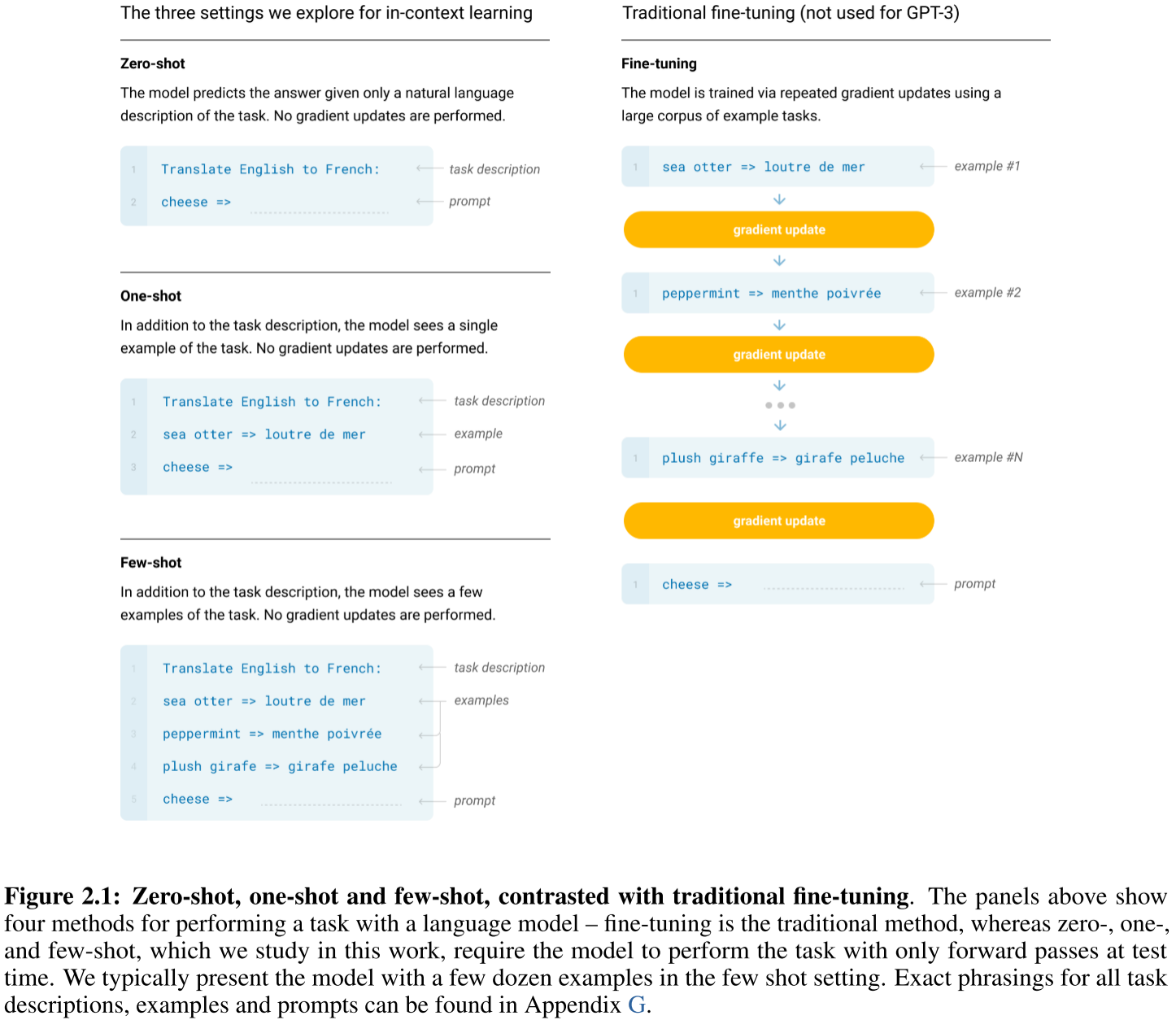

四种学习设置

GPT-3系统地研究了四种设置:

1. Fine-Tuning(微调) - GPT-3未采用,但作为对照:

- 在特定任务的监督数据集上更新权重

- 通常需要数千到数十万样本

- 优势:在许多基准上表现强劲

- 劣势:需要大量数据,可能过拟合,泛化能力差

2. Few-Shot (FS):

- 模型在推理时看到K个示例(通常10-100个)

- 格式:任务描述 + K个(上下文, 完成)对 + 新的上下文

- 无梯度更新

- 优势:大幅减少对任务特定数据的需求

- 劣势:迄今为止效果远不如SOTA微调模型

示例(翻译任务,K=3):

Translate English to French:

sea otter => loutre de mer

peppermint => menthe poivrée

plush giraffe => girafe peluche

cheese =>3. One-Shot (1S):

- 只允许一个示例 + 自然语言任务描述

- 最接近人类完成任务的方式

- 例如Mechanical Turk上通常给一个示例说明任务

4. Zero-Shot (0S):

- 不允许示例,只有自然语言任务描述

- 提供最大便利性和鲁棒性

- 但也是最具挑战性的设置

- 有时对人类来说也很难(任务格式可能不明确)

设计哲学

论文强调:

"我们将这些方法作为不同的问题设置来比较,它们在特定基准性能和样本效率之间提供了不同的权衡,而不是作为竞争性替代方案。"

最终目标:单样本甚至零样本似乎是与人类表现最公平的比较。

模型架构与训练

模型规模

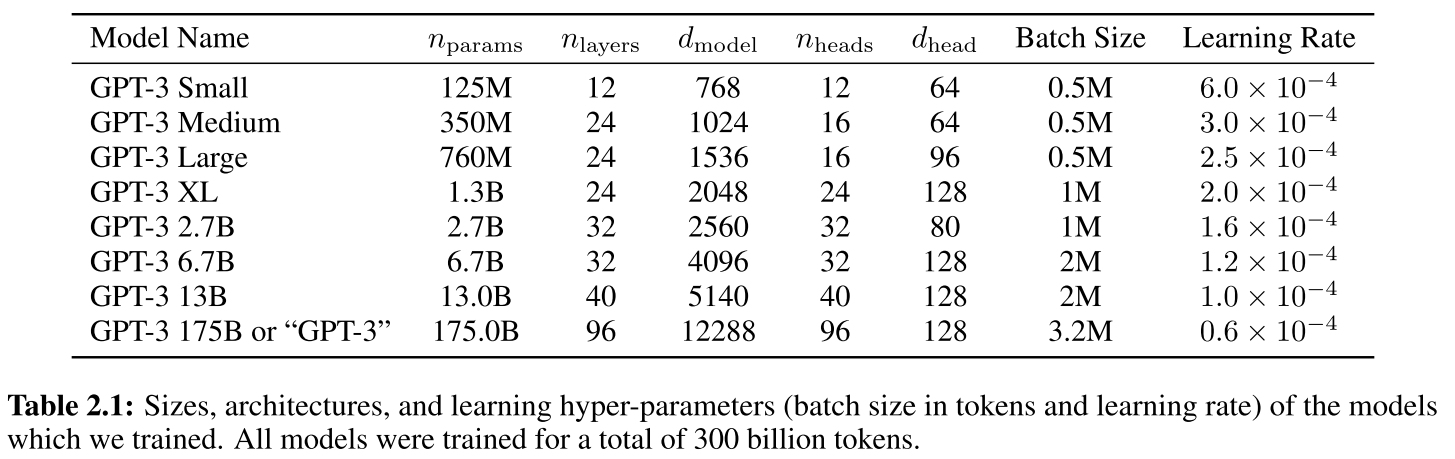

GPT-3训练了8个不同规模的模型:

架构特点:

- 基于GPT-2架构,采用Transformer decoder

- 创新:在层中使用交替的密集和局部带状稀疏注意力模式(类似Sparse Transformer)

- 上下文窗口:nctx = 2048 tokens

- 模型跨GPU的深度和宽度维度分区,最小化节点间数据传输

规模对比:

- GPT-3 175B比GPT-2 (1.5B)大116倍

- 比当时最大的语言模型T5-11B大16倍

- 比BERT-Large (355M)大493倍

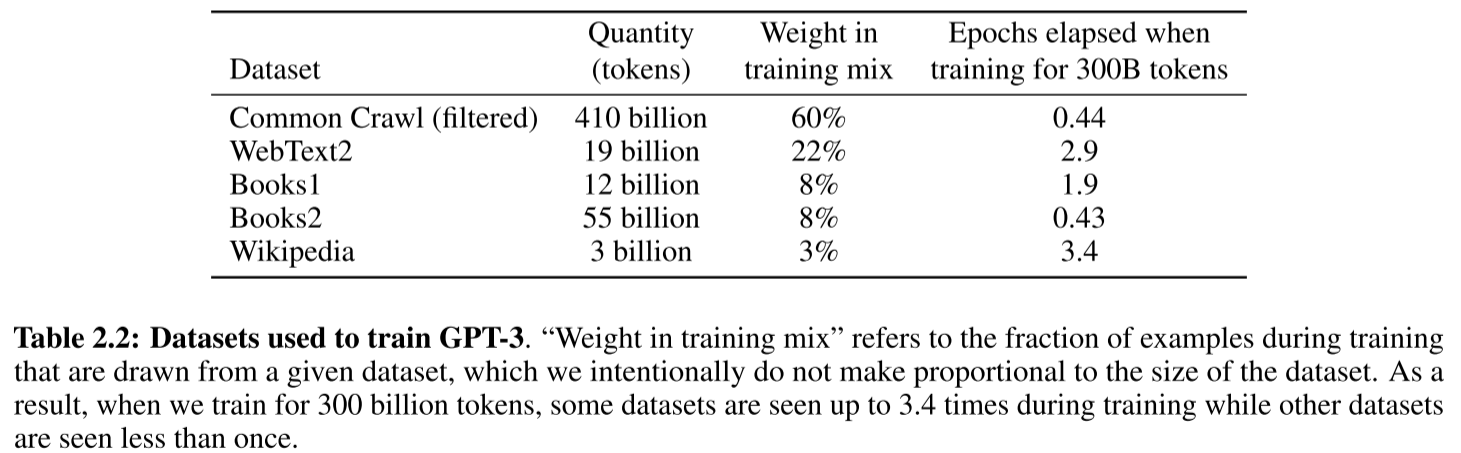

训练数据:质量优先

与GPT-2相比,GPT-3在数据上做了重大改进:

关键策略:

-

Common Crawl过滤(详见Appendix A):

- 基于与高质量参考语料的相似度下载和过滤

- 原始:45TB压缩文本

- 过滤后:570GB ≈ 4000亿BPE tokens

-

文档级去重:

- 跨数据集和数据集内进行模糊去重

- 防止冗余

- 保护验证集作为过拟合的准确度量

-

非均匀采样:

- 不按数据集大小比例采样

- 高质量数据集采样更频繁

- Common Crawl和Books2采样不到1次

- 其他数据集采样2-3次

- 策略:接受少量过拟合以换取更高质量的训练数据

数据质量vs数量的权衡:

虽然Common Crawl提供了海量数据,但GPT-3团队观察到:

"未过滤或轻度过滤的Common Crawl版本质量低于更精心策划的数据集"

这与GPT-2的WebText策略一脉相承,但规模更大、过滤更精细。

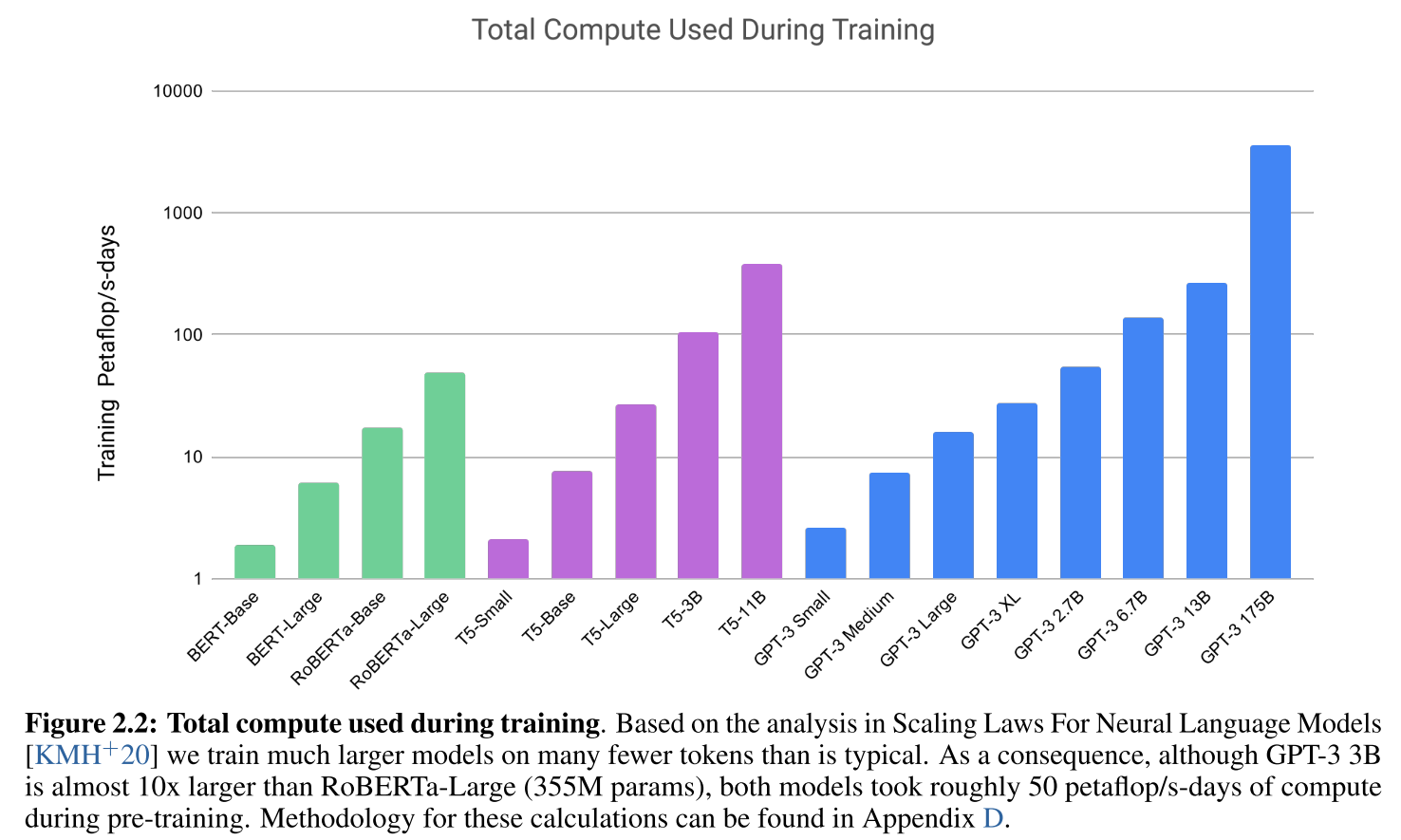

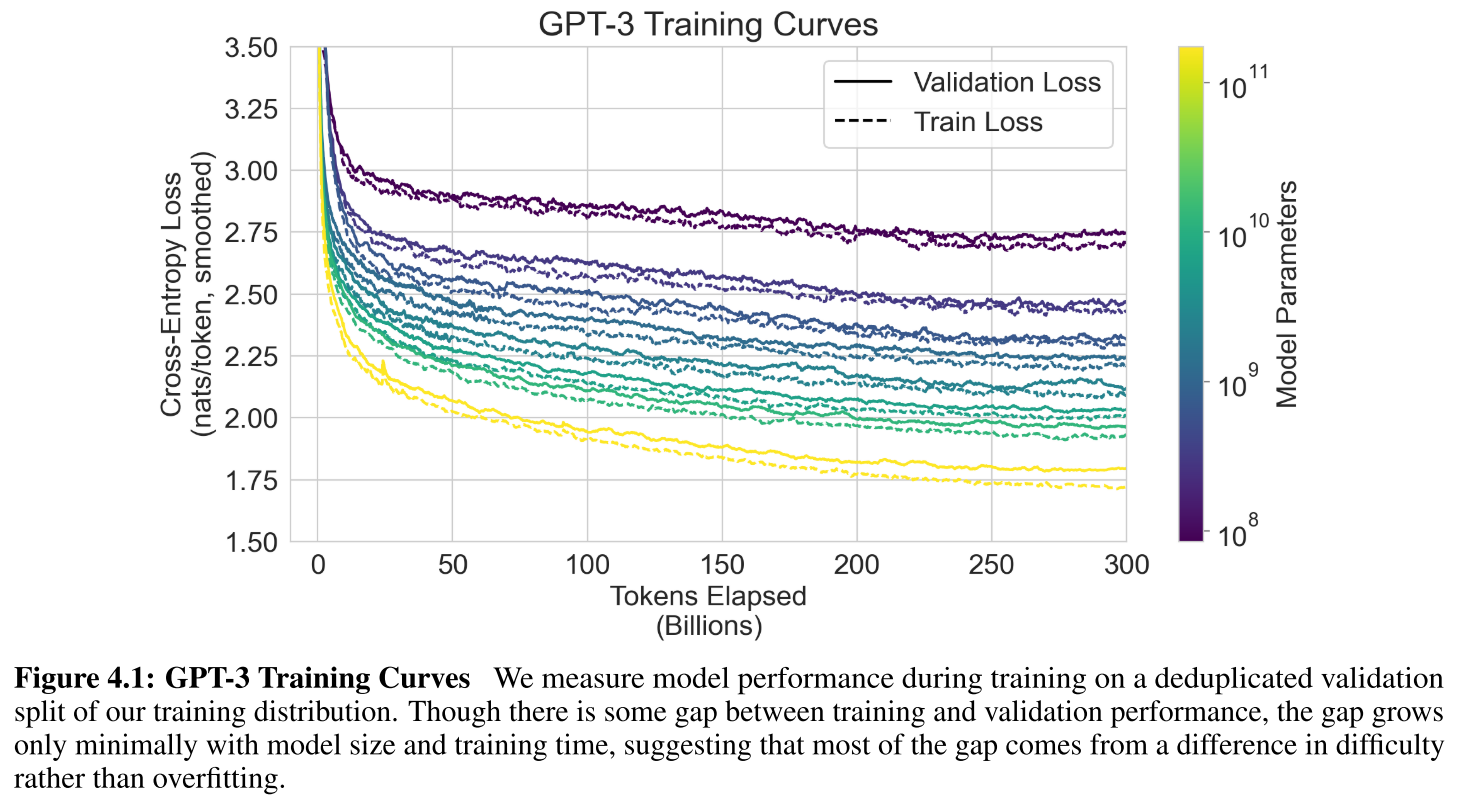

训练过程

计算资源:

- 硬件:V100 GPU,Microsoft提供的高带宽集群

- GPT-3 175B:约3640 petaflop/s-days

- 相比之下,GPT-2 1.5B仅需约50 petaflop/s-days

- 但per-token效率:GPT-3 175B在训练更少tokens的情况下达到更好性能

训练策略(基于Scaling Laws KMH+20):

- 更大的模型,更少的tokens

- GPT-3 3B几乎比RoBERTa-Large (355M)大10倍

- 但两者都花费了约50 petaflop/s-days

- 这是基于scaling laws的策略性选择

超参数设置:

- 批次大小随模型增大而增大(125M用0.5M tokens,175B用3.2M tokens)

- 学习率随模型增大而减小

- 训练总量:300 billion tokens

- Adam优化器

- 梯度噪声尺度指导批次大小选择 MKAT18

模型并行:

- 矩阵乘法内的模型并行

- 网络层间的模型并行

- 目标:在不耗尽内存的情况下训练更大模型

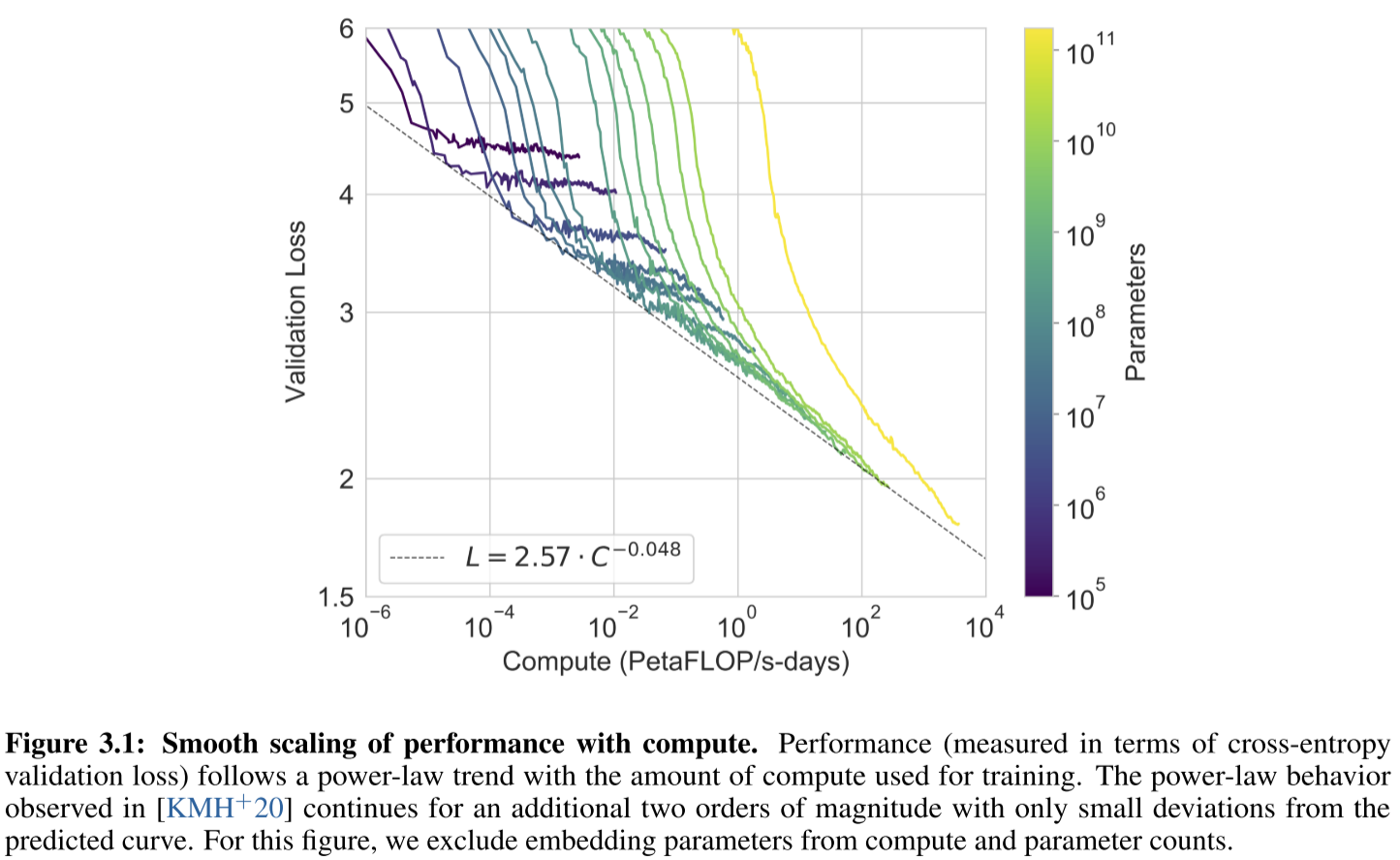

关键观察:

"语言建模性能在有效使用训练计算时遵循幂律趋势" KMH+20

GPT-3将这一趋势延伸了两个数量级,观察到:

- 仅轻微偏离幂律(如果有的话)

- 交叉熵损失的改进导致下游任务的一致性能提升

- 暗示继续扩大规模可能仍然有效

实验结果:跨领域的突破

1. 语言建模与完形填空

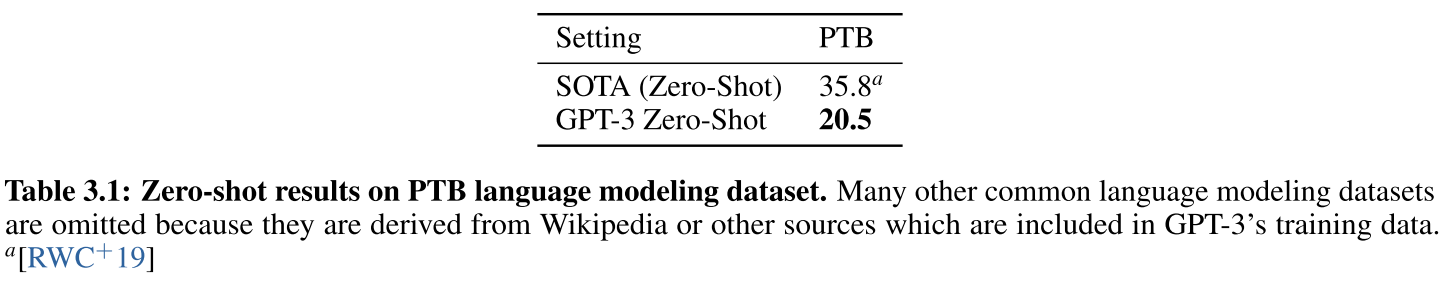

Penn Tree Bank (PTB)

- GPT-3零样本:20.5困惑度

- 前SOTA:35.8困惑度

- 提升:15点的巨大进步

注意:由于PTB早于现代互联网,未包含在训练数据中,因此是可靠的基准。

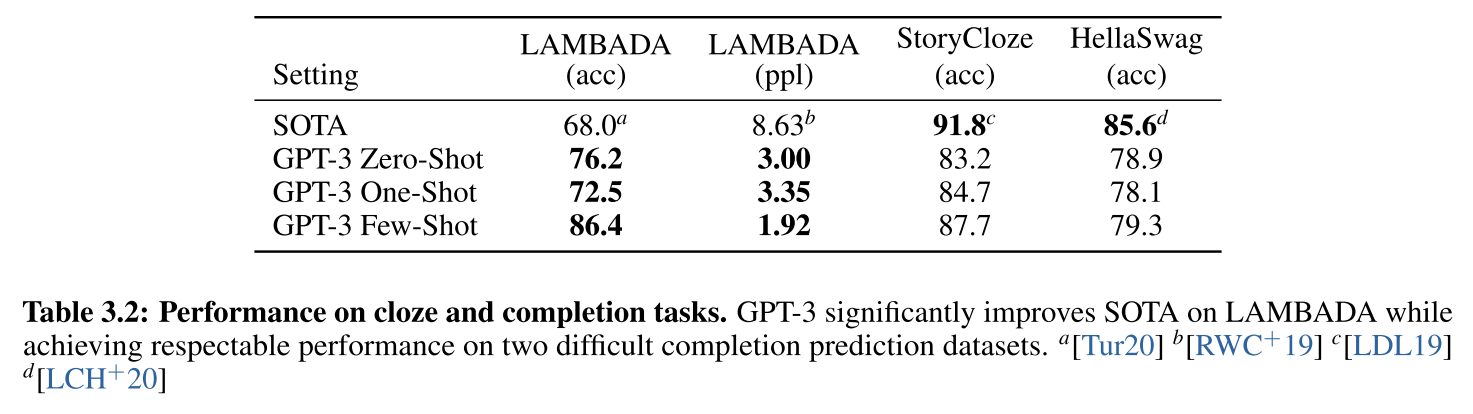

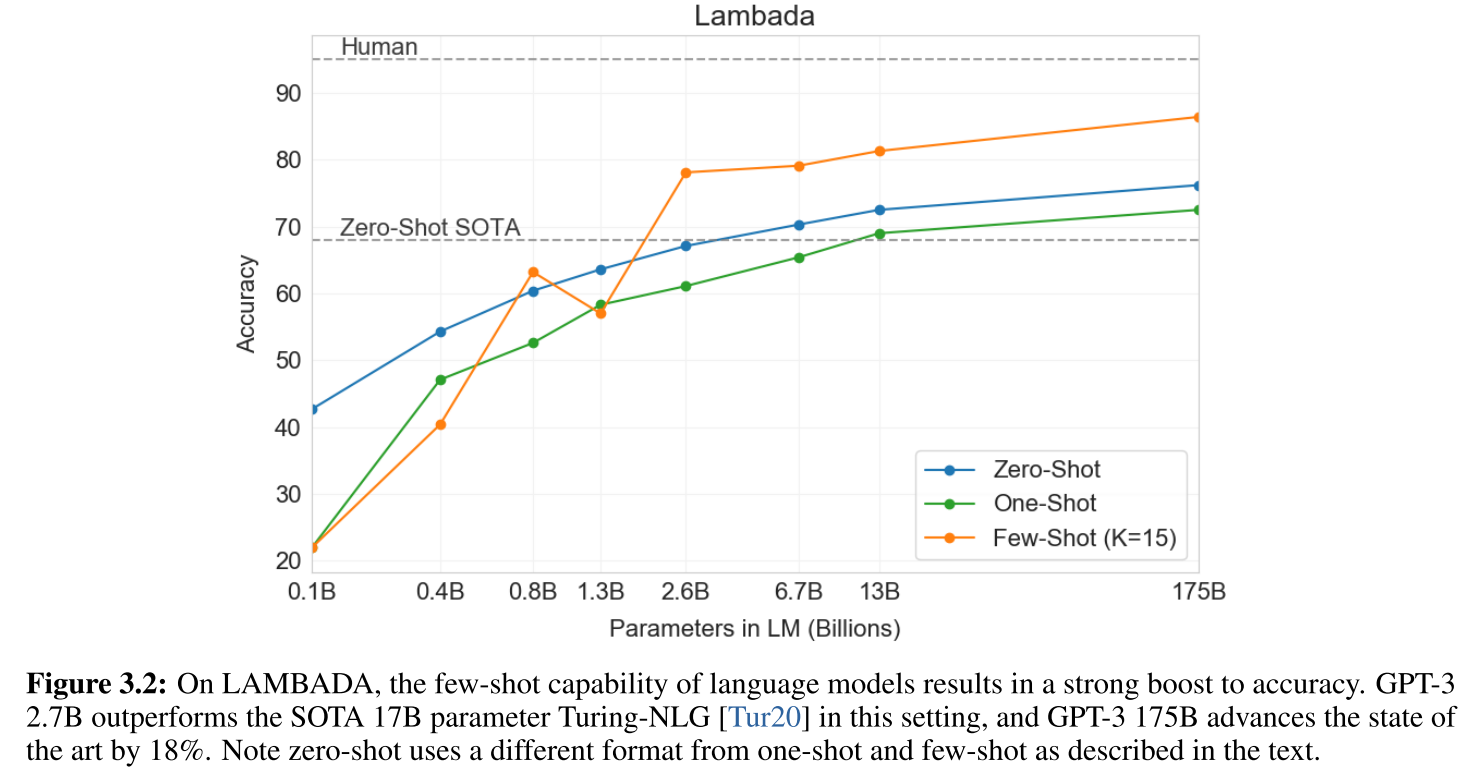

LAMBADA - 长程依赖的考验

LAMBADA要求模型预测句子的最后一个词,需要阅读整个段落的上下文。

Zero-Shot性能:

- GPT-3:76.2%准确率,3.00困惑度

- 前SOTA:68.0%准确率,8.63困惑度

- 提升8%,证明规模化路径仍然promising

Few-Shot性能(创新格式):

论文展示了few-shot学习的巧妙应用。传统语言模型不知道LAMBADA总是预测最后一个词,因此会给其他有效延续也分配概率。

解决方案:使用填空格式作为任务规范!

Alice was friends with Bob. Alice went to visit her friend ___. → Bob

George bought some baseball equipment, a ball, a glove, and a ___. →结果:

- GPT-3 few-shot:86.4%准确率,1.92困惑度

- 比前SOTA提高18.4%

- 比零样本提高10%(175B模型)

- 困惑度从99.8降至1.92!

关键发现:

- Few-shot性能随模型规模强劲改善

- 最小模型的few-shot甚至比零样本差20%

- 但GPT-3的few-shot比零样本好10%

- One-shot不有效,需要多个示例识别模式

数据污染分析:

- 测试集的一小部分出现在训练数据中

- 但分析表明对性能影响可忽略(详见第4节)

HellaSwag - 对抗性故事结局

- GPT-3 few-shot:79.3%

- 前SOTA (ALUM微调):85.6%

- 微调1.5B LM:75.4%

GPT-3超越了比它小得多的微调模型,但仍落后于SOTA。

StoryCloze 2016

- GPT-3 few-shot (K=70):87.7%

- 微调BERT SOTA:91.8%

- 前零样本:约77%

提升约10%的零样本性能,但仍落后微调SOTA 4.1%。

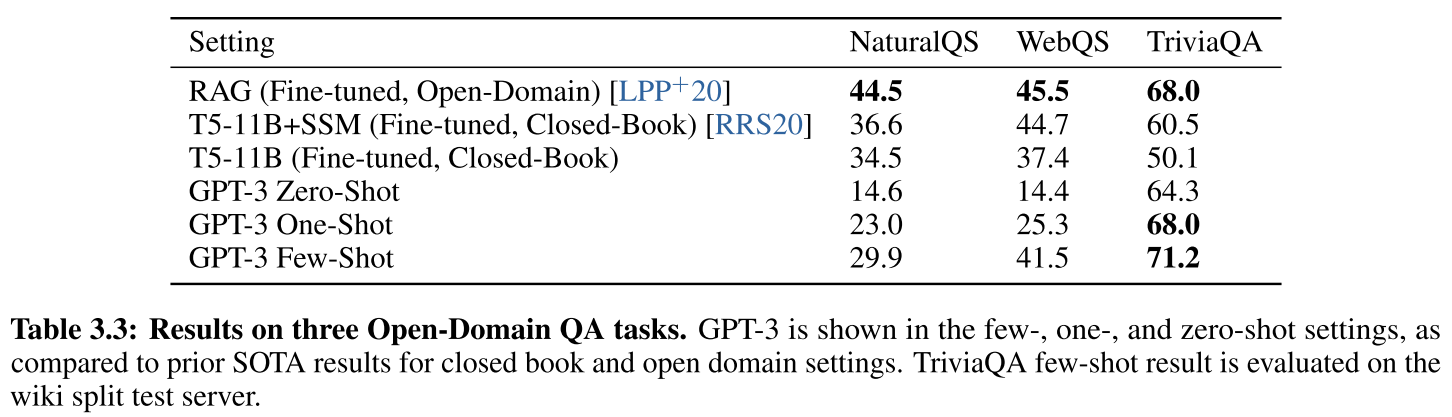

2. 问答:知识的内化

闭卷问答测试模型参数中存储了多少事实知识。

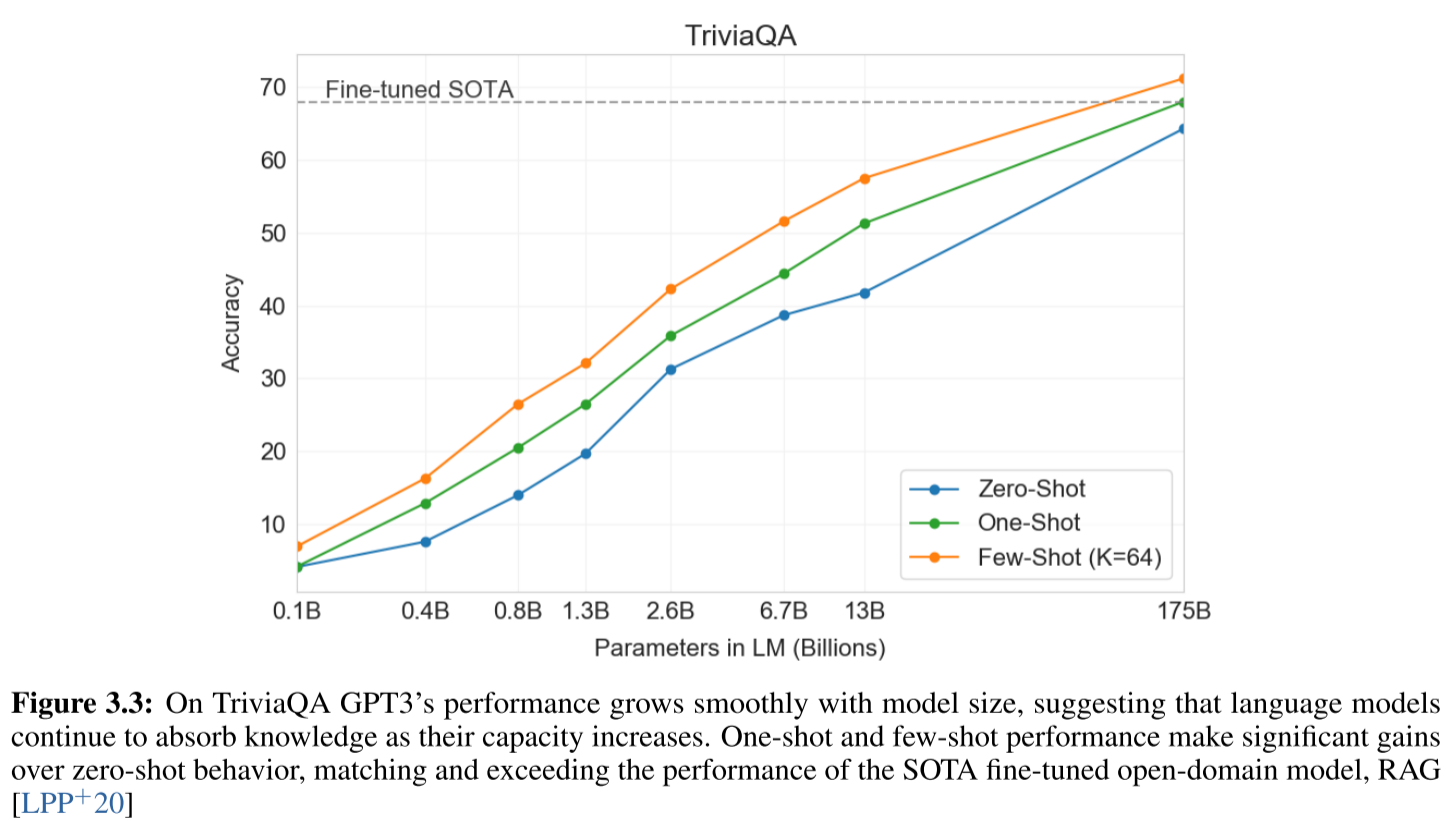

TriviaQA - 惊人的表现

| 设置 | GPT-3 | 对比 |

|---|---|---|

| Zero-Shot | 64.3% | 超越微调T5-11B 14.2% |

| One-Shot | 68.0% | 匹配开放域SOTA (RAG) |

| Few-Shot | 71.2% | 超越RAG 3.2% |

突破性意义:

- RAG使用learned retrieval mechanism + 15.3B参数密集向量索引(21M文档)

- 还进行了微调

- GPT-3零样本,无检索,无微调,就超越了这个系统!

关键观察:

- 性能随模型规模平滑增长

- 暗示模型容量直接转化为参数中"吸收"的更多知识

- One-shot和few-shot显著优于zero-shot

WebQuestions

- Zero-shot:14.4%

- One-shot:25.3%

- Few-shot:41.5%

- 微调T5-11B+SSM:44.7%

观察:

- Zero到few-shot的巨大增益(27.1%)

- 暗示WebQs问题和/或答案风格对GPT-3是分布外的

- 但模型能够适应这个分布

Natural Questions

- Few-shot:29.9%

- 微调T5-11B+SSM:36.6%

- 仍有较大差距

可能原因:

- NQs倾向于Wikipedia上非常细粒度的知识

- 可能测试GPT-3容量和广泛预训练分布的极限

总体评估:

- 在3个数据集中的1个上,GPT-3 one-shot匹配开放域微调SOTA

- 在另外2个上接近闭卷SOTA性能

- 所有3个数据集上性能随模型规模非常平滑地缩放

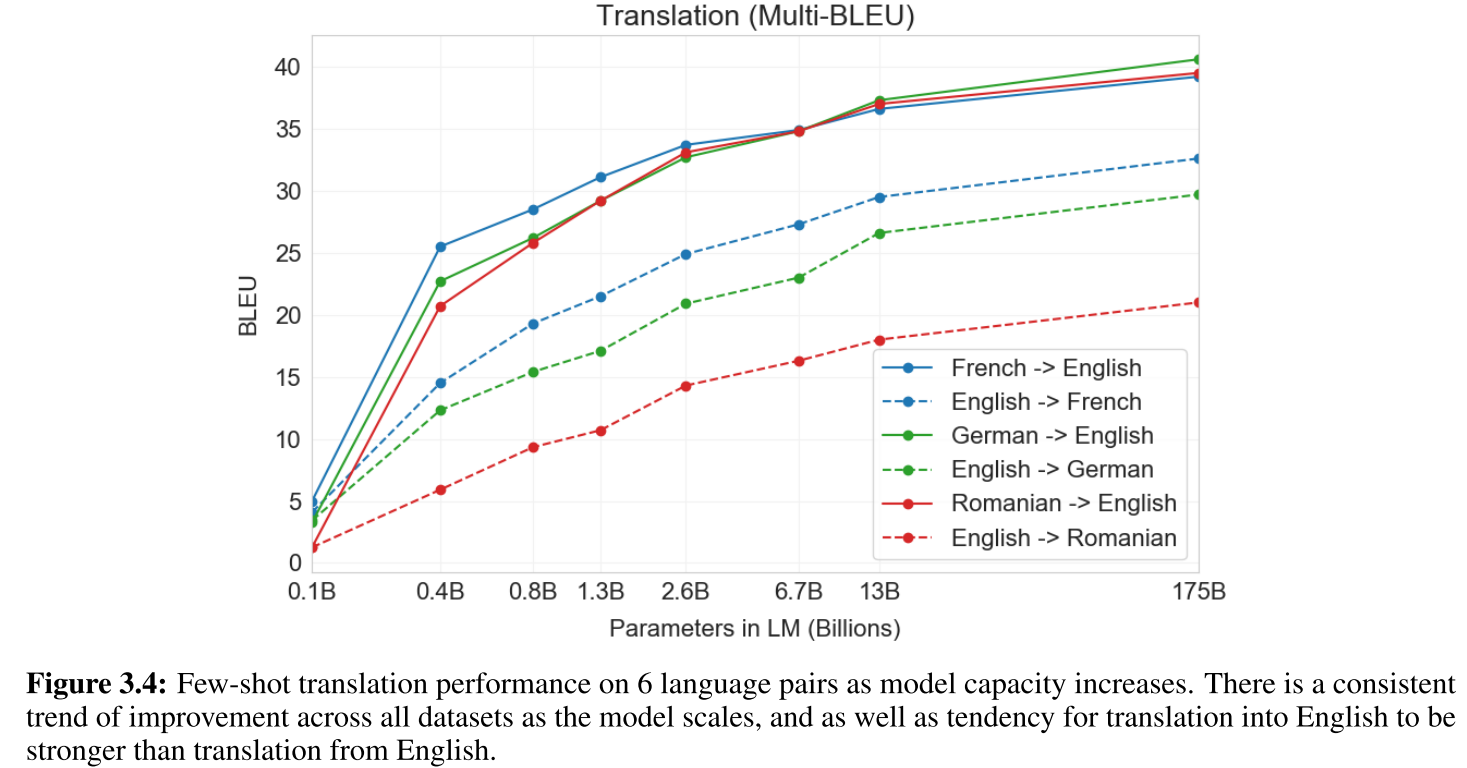

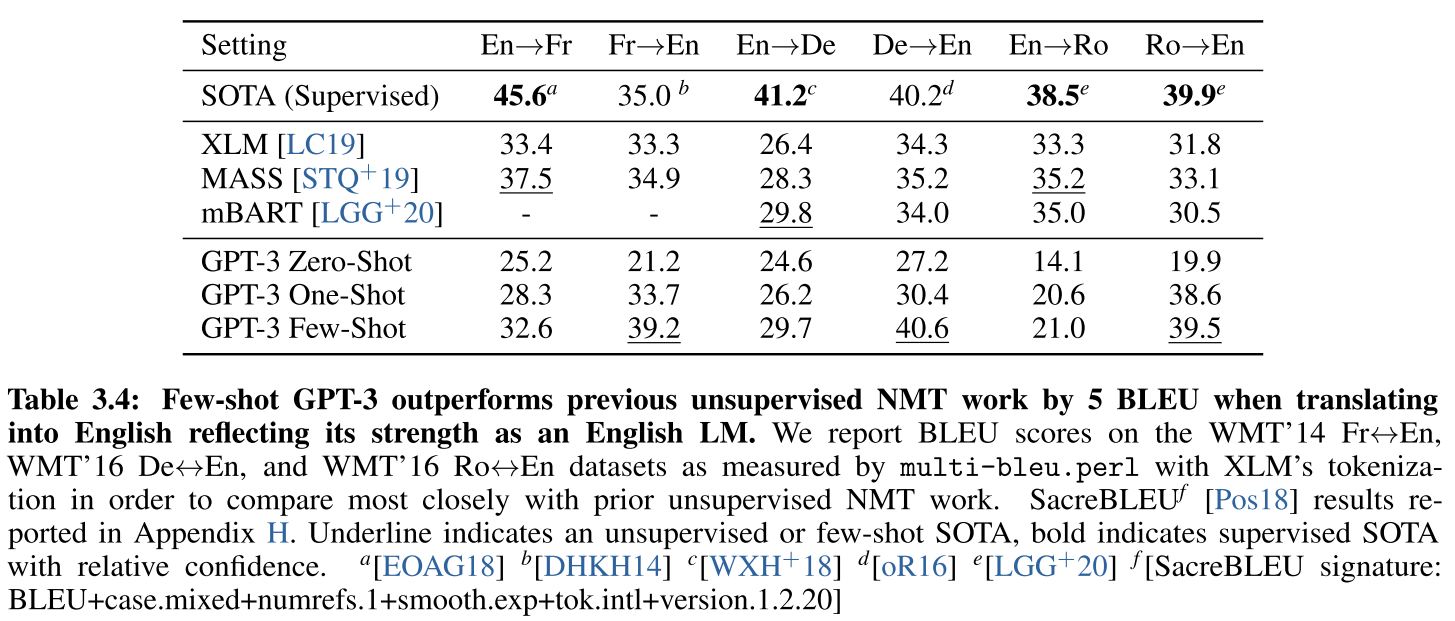

3. 翻译:惊喜的跨语言能力

GPT-2使用过滤器产生纯英语数据集,但仍显示出一些多语言能力。GPT-3将容量增加100多倍,也扩展了训练数据范围。

训练数据:

- 93% 英语(按词数)

- 7% 其他语言

- 详见补充材料

评估语言对:

- 英语 ↔ 法语

- 英语 ↔ 德语

- 英语 ↔ 罗马尼亚语

关键发现 :

-

Few-shot性能超越之前的无监督NMT:

- 在翻译成英语时,GPT-3显著优于无监督NMT(高达5 BLEU)

- 反映了其作为英语LM的优势

-

性能不对称:

- 翻译成英语:强劲(通常超越无监督SOTA)

- 从英语翻译:较弱

- En-Ro是明显的异常值(比无监督NMT差10+ BLEU)

-

可能的原因:

- 重用GPT-2的字节级BPE分词器

- 该分词器是为几乎全英语数据集开发的

- 可能导致非英语性能下降

-

惊人的事实:

- GPT-3的训练数据中只有10MB法语

- 比常用单语法语语料小500倍

- 仍然能够执行翻译!

-

与监督SOTA比较:

- De→En few-shot (40.6)接近监督SOTA (40.2)

- Ro→En few-shot (39.5)接近监督SOTA (39.9),仅差0.4

- 后者通过无监督预训练+608K样本监督微调+回译实现

观察:

- 所有语言对和所有设置(零、一、少样本)都有平滑的改进趋势

- 翻译成英语始终强于从英语翻译

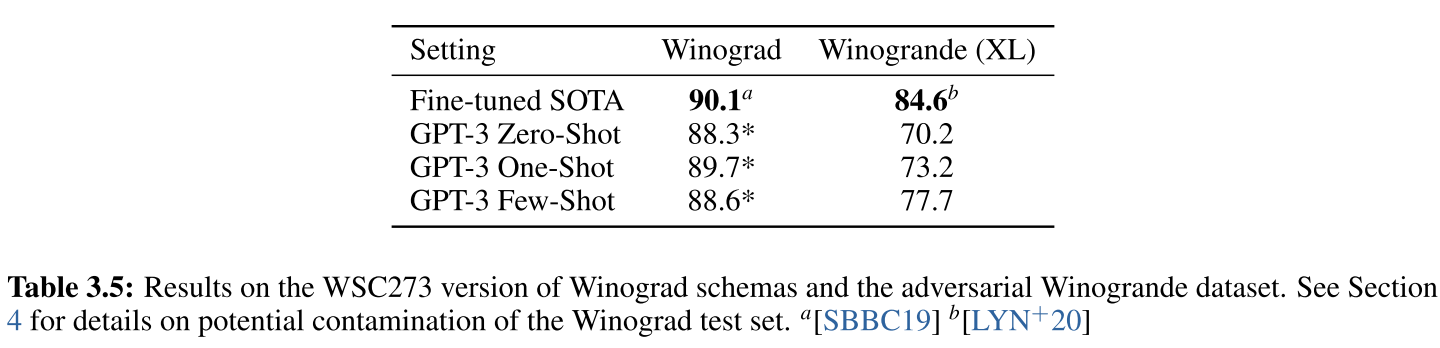

4. Winograd风格任务

Winograd Schema Challenge测试常识推理能力,要求解决文本中语法上模糊但语义上明确的代词指代。

Winograd (273个schemas)

| 设置 | GPT-3 | 对比 |

|---|---|---|

| Zero-shot | 88.3%* | - |

| One-shot | 89.7%* | - |

| Few-shot | 88.6%* | 微调SOTA: 90.1% |

观察:

- 没有清晰的上下文学习,但所有情况下都取得强劲结果

- 仅比SOTA和估计的人类表现低几个点

- *注:数据污染分析发现训练数据中有一些Winograd schemas,但影响很小

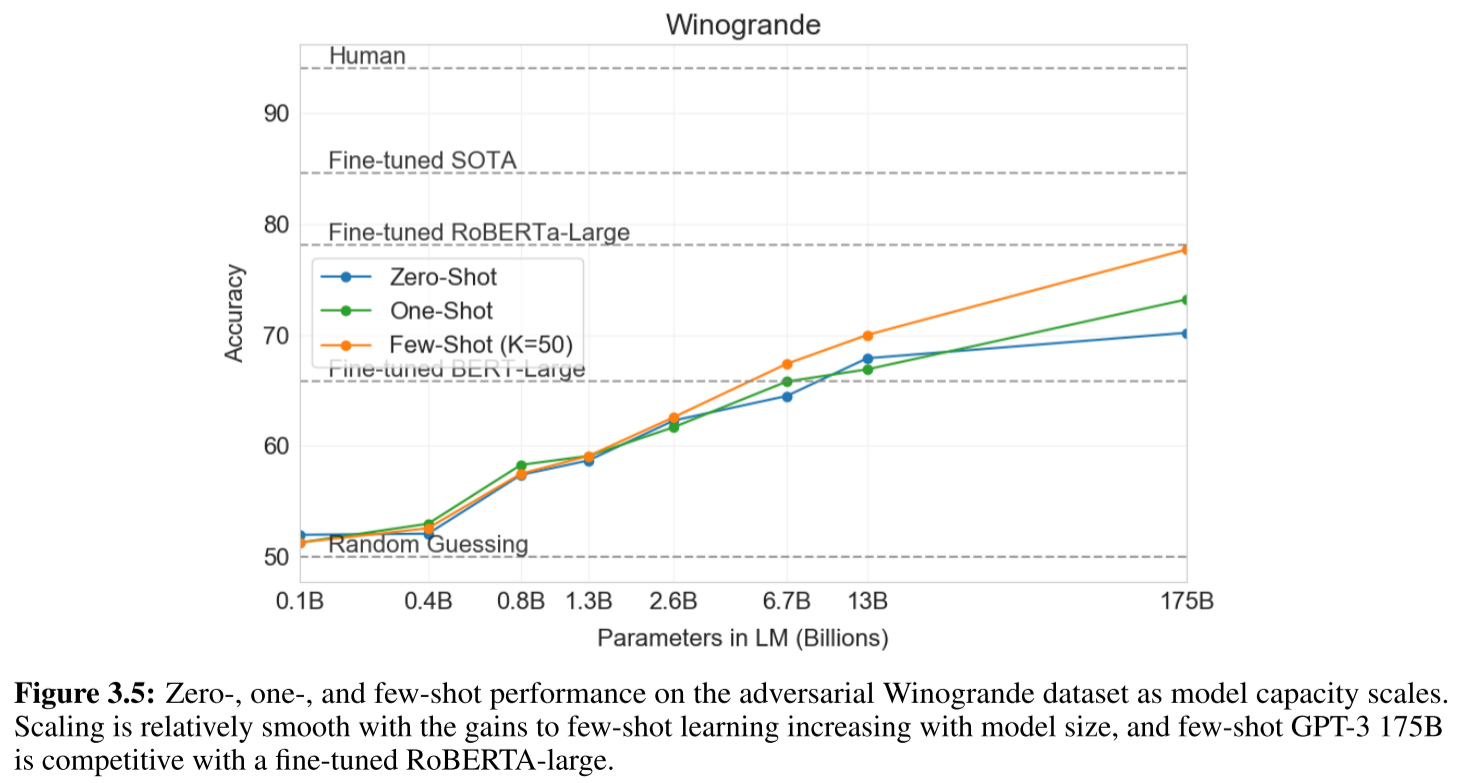

Winogrande - 更难的对抗性版本

| 设置 | GPT-3 | 对比 |

|---|---|---|

| Zero-shot | 70.2% | - |

| One-shot | 73.2% | - |

| Few-shot | 77.7% | 微调RoBERTa: 79% |

| 微调T5 SOTA: 84.6% | ||

| 人类: 94.0% |

关键发现:

- 确实发现了上下文学习的收益

- Few-shot接近微调RoBERTa的性能

- 仍然显著落后于SOTA和人类

- 随着模型规模,缩放相对平滑

- Few-shot学习的收益随模型规模增加

- Few-shot GPT-3 175B与微调RoBERTa-large竞争

5. 常识推理

测试物理或科学推理能力,区别于句子完成、阅读理解或广泛知识问答。

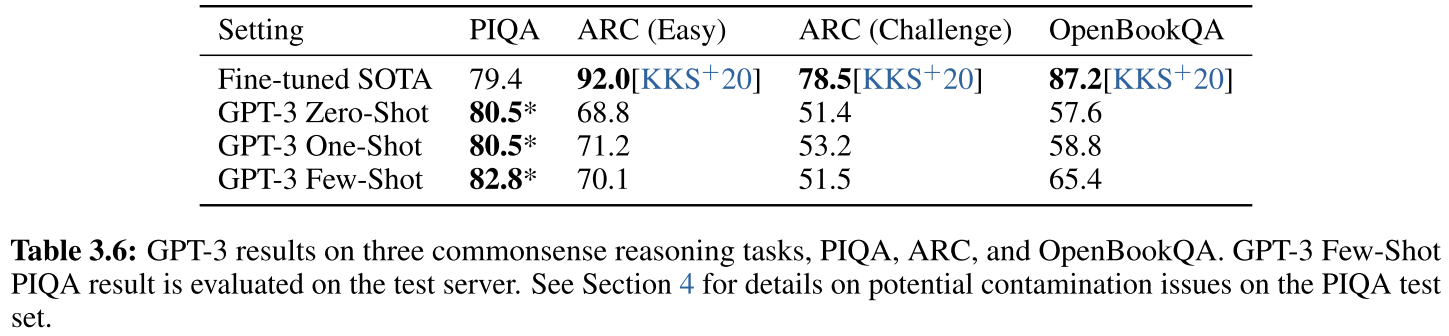

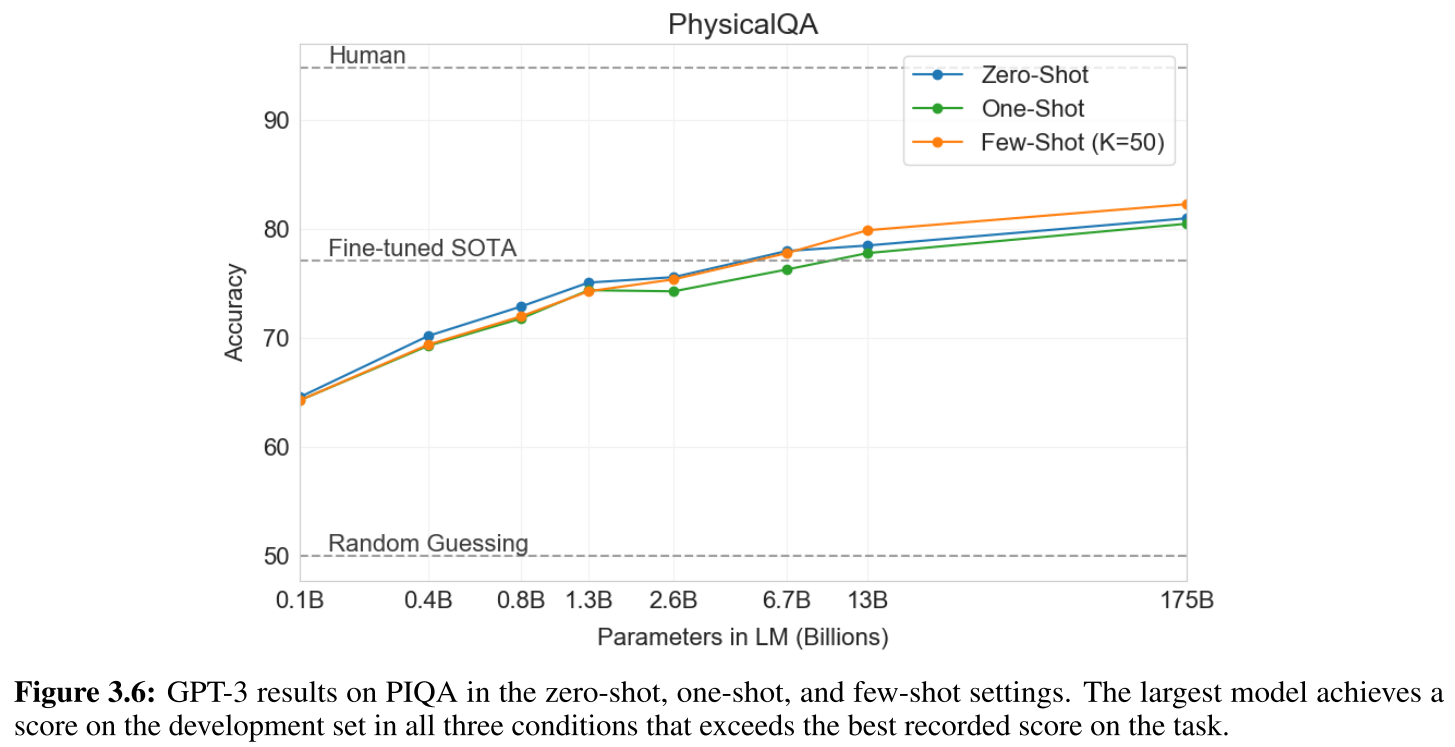

PhysicalQA (PIQA) - 物理世界如何运作

- Zero-shot:80.5%*

- One-shot:80.5%*

- Few-shot:82.8%*

- 微调RoBERTa SOTA:79.4%

GPT-3在所有设置下都超越了SOTA!

*注:数据污染分析标记了29%潜在污染,性能下降3%。虽然测试集在训练集创建后发布且标签隐藏,但一些网页在训练集中。由于无法严格证明是统计偏差而非记忆,结果标记星号。

- 最大模型在所有三种条件下的开发集分数都超过了任务的最佳记录分数

- 性能随模型规模平滑增长

ARC - 科学考试题

Challenge版本(过滤了简单方法无法答对的问题):

- GPT-3 few-shot:51.5%

- UnifiedQA (微调RoBERTa):55.9%

- UnifiedQA SOTA:78.5%

Easy版本:

- GPT-3 few-shot:70.1%

- UnifiedQA SOTA:92.0%

结论:接近微调基线,但远低于整体SOTA。

OpenBookQA

- GPT-3 few-shot:65.4%

- SOTA:87.2%

- 微调BERT Large基线:相似

总体评估:

- 常识推理任务上的上下文学习结果参差不齐

- PIQA和ARC上只有小幅和不一致的收益

- OpenBookQA上有显著改进

- GPT-3在新PIQA数据集上在所有评估设置中都创造了SOTA

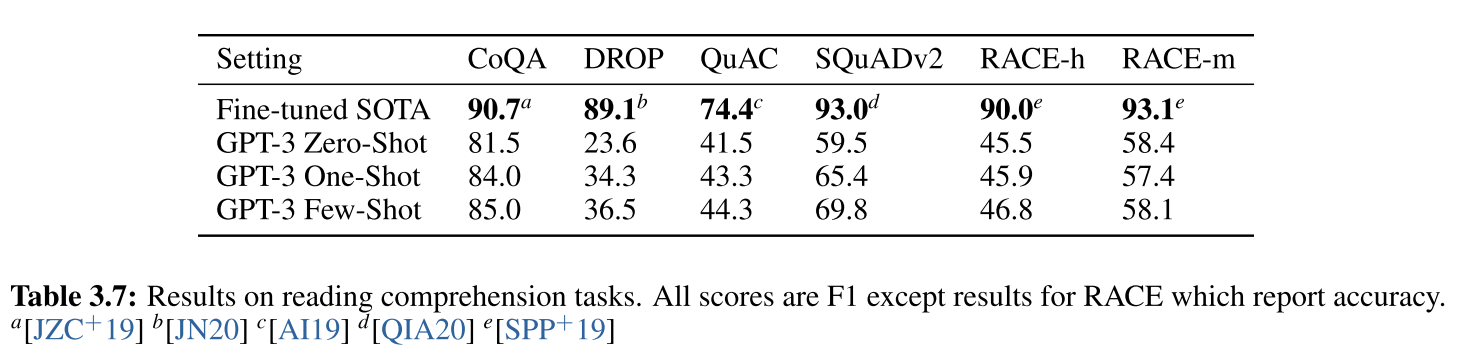

6. 阅读理解

在5个数据集上评估,包括抽象式、多选题和基于跨度的答案格式,以及对话和单个问题设置。

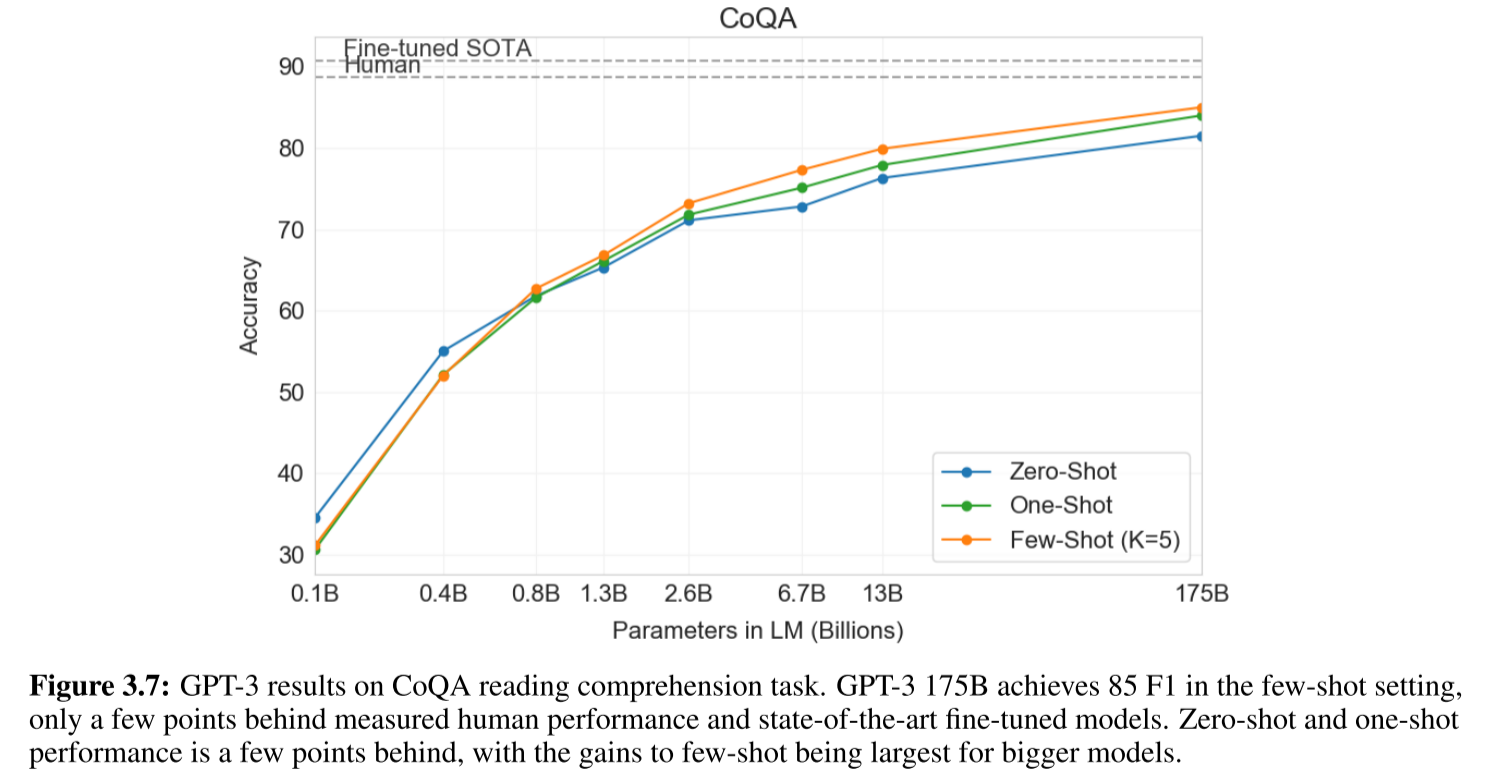

CoQA - 对话式问答(最强表现)

| 设置 | GPT-3 | 对比 |

|---|---|---|

| Zero-shot | 81.5 F1 | - |

| One-shot | 84.0 F1 | - |

| Few-shot | 85.0 F1 | 微调SOTA: 90.7 |

| 人类基线: ~90 |

仅比人类表现和SOTA低3-6分!

- GPT-3 175B在few-shot设置下达到85 F1

- 零样本和单样本性能落后几分

- 对于更大的模型,few-shot的收益最大

SQuAD 2.0

- GPT-3 few-shot:69.8 F1

- 原论文的最佳微调结果:略低于69.8

- GPT-3 few-shot略微超越!

- 比零样本提高近10 F1

DROP - 离散推理和数值能力

- GPT-3 few-shot:36.5 F1

- 原论文的微调BERT基线:低于36.5

- 增强符号系统的SOTA RLL+19:远高于GPT-3

QuAC - 结构化对话行为(最弱表现)

- GPT-3 few-shot:44.3 F1

- ELMo基线:比GPT-3高13 F1

需要建模结构化对话行为和教师-学生互动的答案跨度选择,可能是GPT-3的弱点。

RACE - 英语考试

- GPT-3 few-shot高中:46.8%

- GPT-3 few-shot中学:58.1%

- SOTA:90.0% (高中)

表现相对较弱,仅与使用上下文表示的最早期工作竞争,仍落后SOTA 45%。

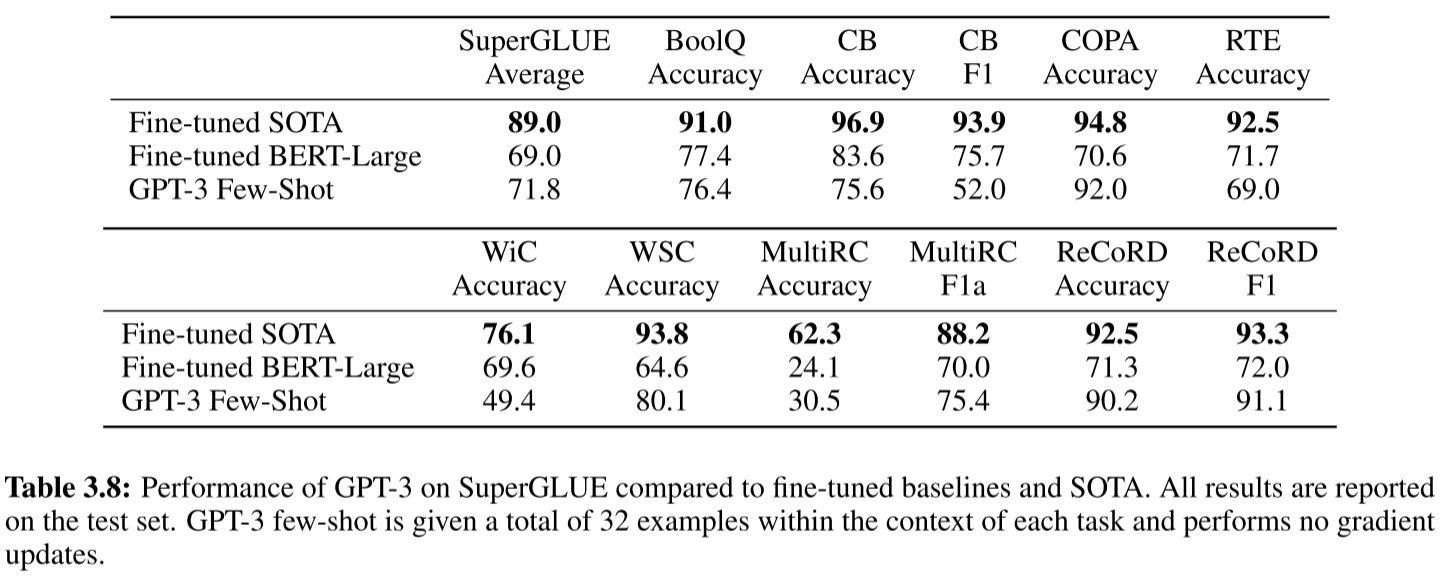

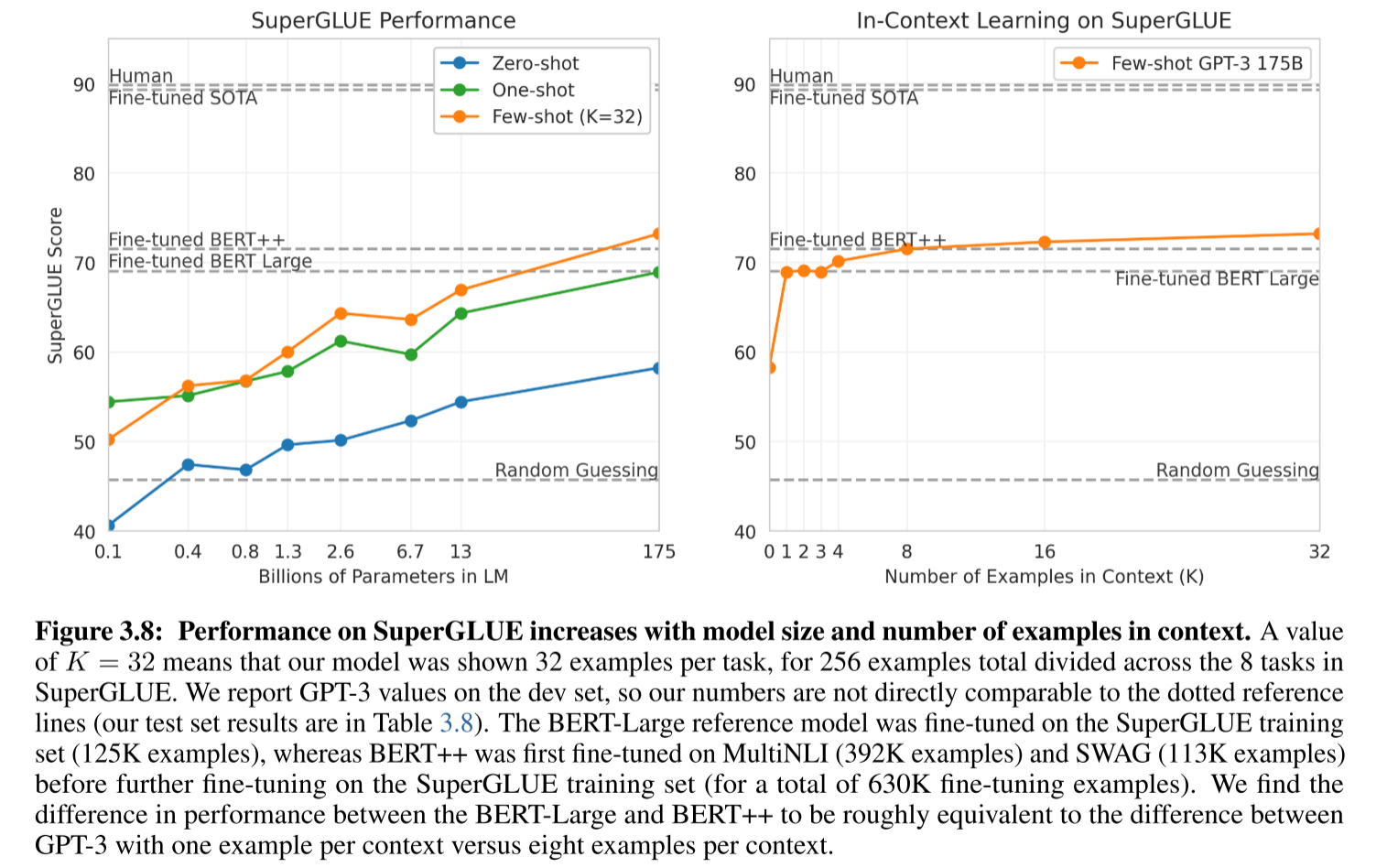

7. SuperGLUE基准测试

为了更系统地聚合结果并与BERT和RoBERTa等流行模型比较,GPT-3在SuperGLUE基准上进行了评估。

整体表现

| 模型 | SuperGLUE平均 |

|---|---|

| 微调SOTA | 89.0 |

| GPT-3 Few-Shot (K=32) | 71.8 |

| 微调BERT-Large | 69.0 |

GPT-3 few-shot超越了微调BERT-Large!

各任务表现

强项任务:

- COPA:92.0%(SOTA 94.8%,仅差2.8%)

- ReCoRD:91.1 F1(SOTA 93.3,仅差2.2)

- WSC:80.1%(相对强劲)

中等任务:

- BoolQ:76.4%(微调SOTA 91.0%)

- MultiRC:75.4 F1a(SOTA 88.2)

- RTE:69.0%(SOTA 92.5%)

- CB:75.6%(few-shot,SOTA 96.9%)

弱项任务:

- WiC :49.4%(几乎随机猜测! )

- 尝试了多种措辞和formulations

- 都无法取得强劲性能

关键洞察:

任务格式分析:

"GPT-3似乎在few-shot或one-shot设置下在涉及比较两个句子或片段的某些任务上较弱"

例如:

- 一个词在两个句子中是否以相同方式使用(WiC)

- 一个句子是否是另一个的释义

- 一个句子是否蕴含另一个

这可能解释RTE和CB的相对较低分数。

积极方面:

- GPT-3在8个任务中的4个上超越了微调BERT-Large

- 在2个任务上接近SOTA(微调110亿参数模型)

- 不使用微调!

规模效应:

- Few-shot SuperGLUE分数随着模型规模和上下文示例数量稳步提高

- K扩展到32个示例/任务(之后无法可靠地适应上下文)

- GPT-3需要少于8个总示例/任务就能在整体SuperGLUE分数上超越微调BERT-Large

与微调BERT的对比:

- BERT-Large:在SuperGLUE训练集上微调(125K样本)

- BERT++:先在MultiNLI (392K) 和SWAG (113K)上微调,然后在SuperGLUE上微调(总计630K样本)

- BERT-Large与BERT++之间的性能差异 ≈ GPT-3每上下文1个示例与8个示例之间的差异

8. 自然语言推理(NLI)

NLI涉及理解两个句子之间的关系:蕴含、矛盾或中性。

RTE (来自SuperGLUE)

- 只有最大的GPT-3在任何评估设置下都明显优于随机(56%)

- Few-shot:与单任务微调BERT Large相似

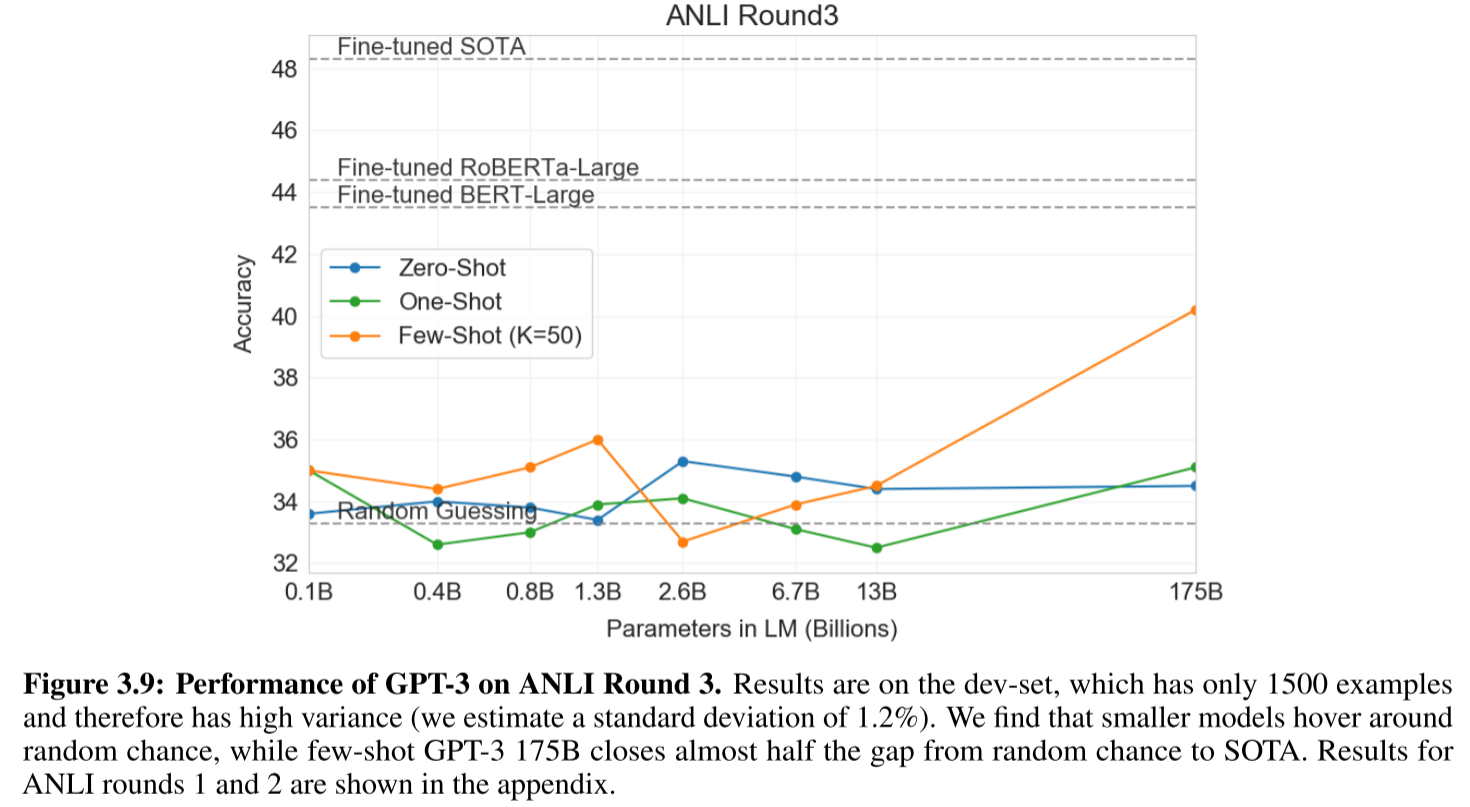

Adversarial NLI (ANLI) - 对抗性挖掘的困难数据集

三轮(R1, R2, R3),GPT-3在Round 3上的表现:

| 设置 | GPT-3 175B | 对比 |

|---|---|---|

| Zero-shot | ~33% | 随机猜测 |

| One-shot | ~34% | - |

| Few-shot (K=50) | 40.2% | 微调RoBERTa-Large: 44% |

| 微调BERT-Large: 44% | ||

| 微调SOTA: 48.8% |

关键观察:

- 所有小于GPT-3的模型在ANLI上几乎恰好随机猜测(~33%),即使在few-shot设置下

- GPT-3本身在Round 3上显示出生命迹象

- 从随机到SOTA的差距,GPT-3缩小了近一半

结论:

"RTE和ANLI的这些结果表明,NLI对于语言模型仍然是一个非常困难的任务,它们才刚刚开始显示出进展的迹象。"

9. 合成和定性任务

为了探测GPT-3在few-shot(或零、一样本)设置下的能力范围,论文设计了需要简单即时计算推理、识别训练中不太可能出现的新模式或快速适应不寻常任务的任务。

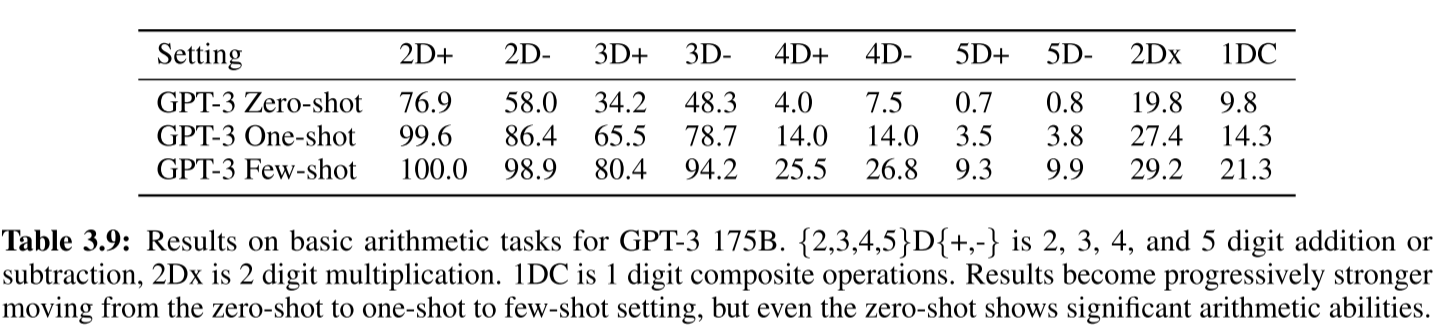

9.1 算术能力

设计了10个测试,在自然语言中向GPT-3提出简单算术问题。

任务类型:

- 2位加法/减法 (2D+/-)

- 3位加法/减法 (3D+/-)

- 4位加法/减法 (4D+/-)

- 5位加法/减法 (5D+/-)

- 2位乘法 (2Dx)

- 1位数复合运算 (1DC):如 "Q: What is 6+(4*8)? A: 38"

Few-Shot结果(GPT-3 175B):

| 任务 | 准确率 | 评价 |

|---|---|---|

| 2D+ | 100.0% | 完美 |

| 2D- | 98.9% | 接近完美 |

| 3D+ | 80.4% | 强劲 |

| 3D- | 94.2% | 强劲 |

| 4D+ | 25.5% | 一些能力 |

| 4D- | 26.8% | 一些能力 |

| 5D+ | 9.3% | 弱,但非零 |

| 5D- | 9.9% | 弱,但非零 |

| 2Dx | 29.2% | 复杂运算 |

| 1DC | 21.3% | 鲁棒性 |

关键发现:

-

位数较少时表现强劲:

- 2位运算几乎完美

- 3位运算优秀

- 随位数增加性能下降

-

但仍有泛化能力:

- 4位运算:25-26%

- 5位运算:9-10%

- 暗示至少有一定能力泛化到更多位数

-

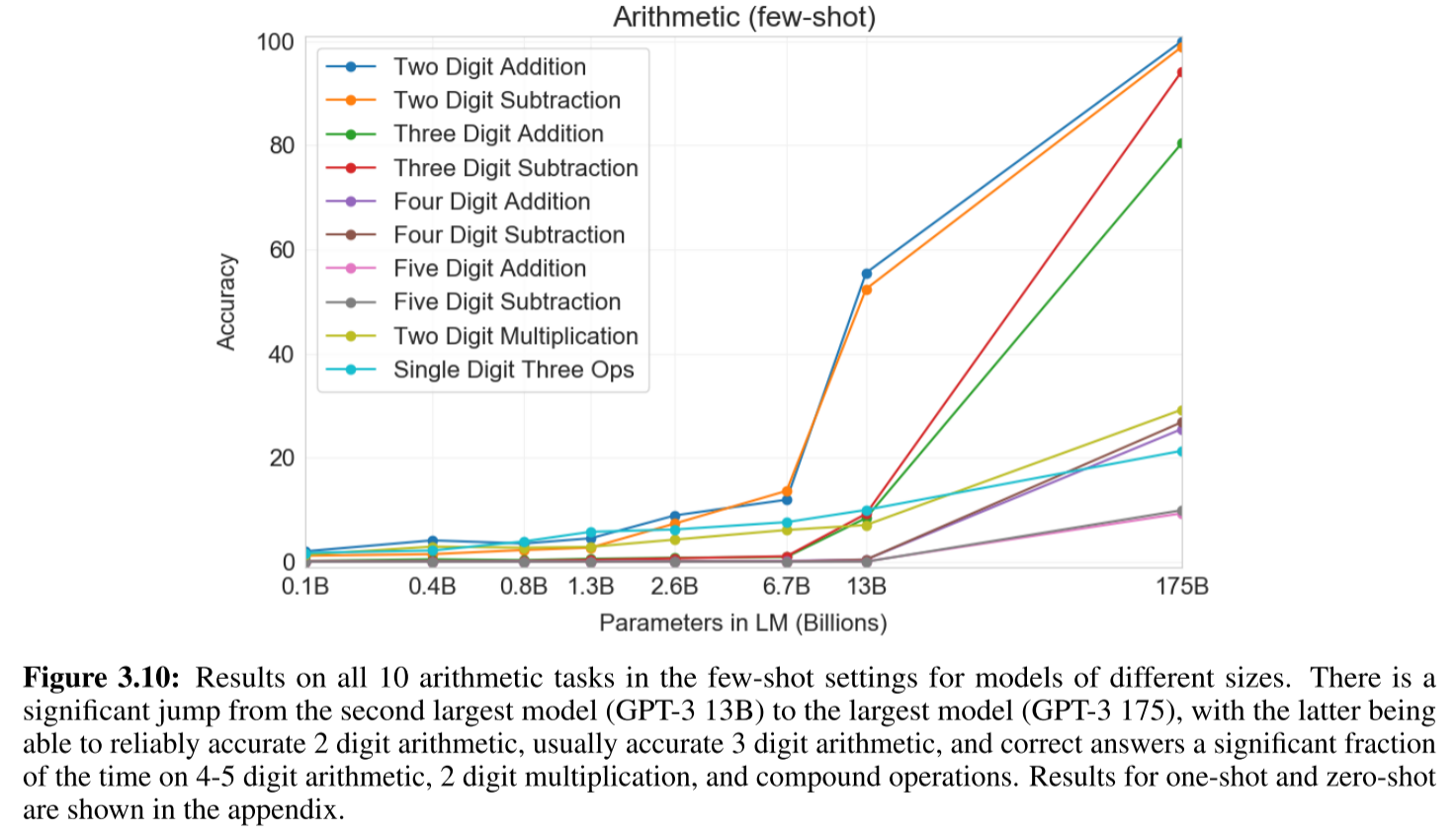

规模的巨大作用:

- 小模型在所有这些任务上表现很差

- 即使是130亿参数模型(第二大)也只能解决2位加减法的一半时间

- 所有其他运算不到10%

-

上下文学习的重要性:

- One-shot和zero-shot性能相对于few-shot有所下降

- 但one-shot仍然相当强

- 即使zero-shot在完整GPT-3上也显著超越所有较小模型的few-shot

记忆检查:

- 在测试集中的3位算术问题中搜索训练数据

- 2000个加法问题中只有17个匹配(0.8%)

- 2000个减法问题中只有2个匹配(0.1%)

- 只有微不足道的一小部分正确答案可能被记忆

错误分析:

- 检查错误答案显示模型经常犯诸如不进位"1"之类的错误

- 暗示它实际上在尝试执行相关计算,而不是记忆表

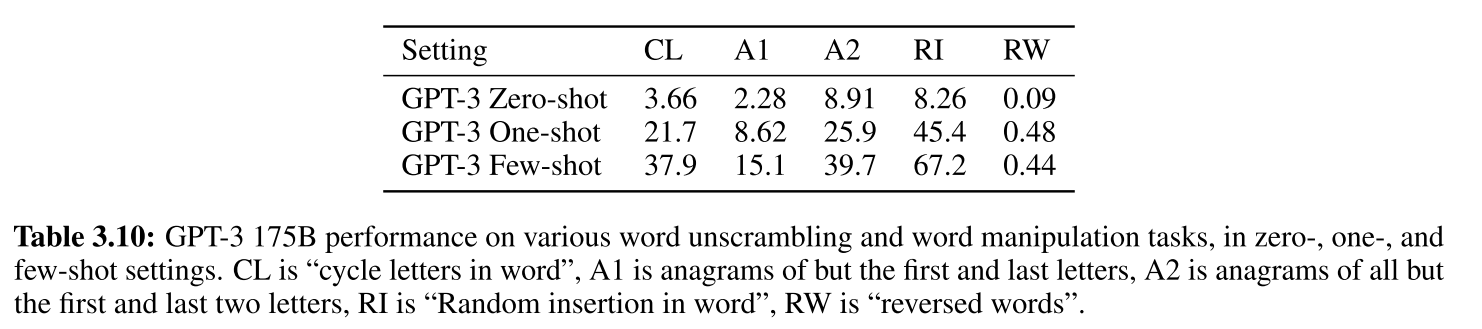

9.2 单词扰乱和操作任务

设计了5个"字符操作"任务来测试GPT-3从少量示例学习新颖符号操作的能力。

任务:

-

Cycle Letters (CL):字母循环

- 输入:"lyinevitab"

- 输出:"inevitably"

-

Anagrams 1 (A1):除首尾字母外的字母重排

- 输入:"criroptuon"

- 输出:"corruption"

-

Anagrams 2 (A2):除前后各2个字母外的字母重排

- 输入:"opoepnnt"

- 输出:"opponent"

-

Random Insertion (RI):随机插入标点或空格

- 输入:"s.u!c/c!e.s s i/o/n"

- 输出:"succession"

-

Reversed Words (RW):反转单词

- 输入:"stcejbo"

- 输出:"objects"

GPT-3 175B Few-Shot结果(K=100):

| 任务 | 准确率 |

|---|---|

| RI (移除随机插入) | 66.9% |

| CL (循环字母) | 37.9% |

| A2 (字母重排,难) | 39.7% |

| A1 (字母重排,易) | 15.1% |

| RW (反转单词) | 0.44% |

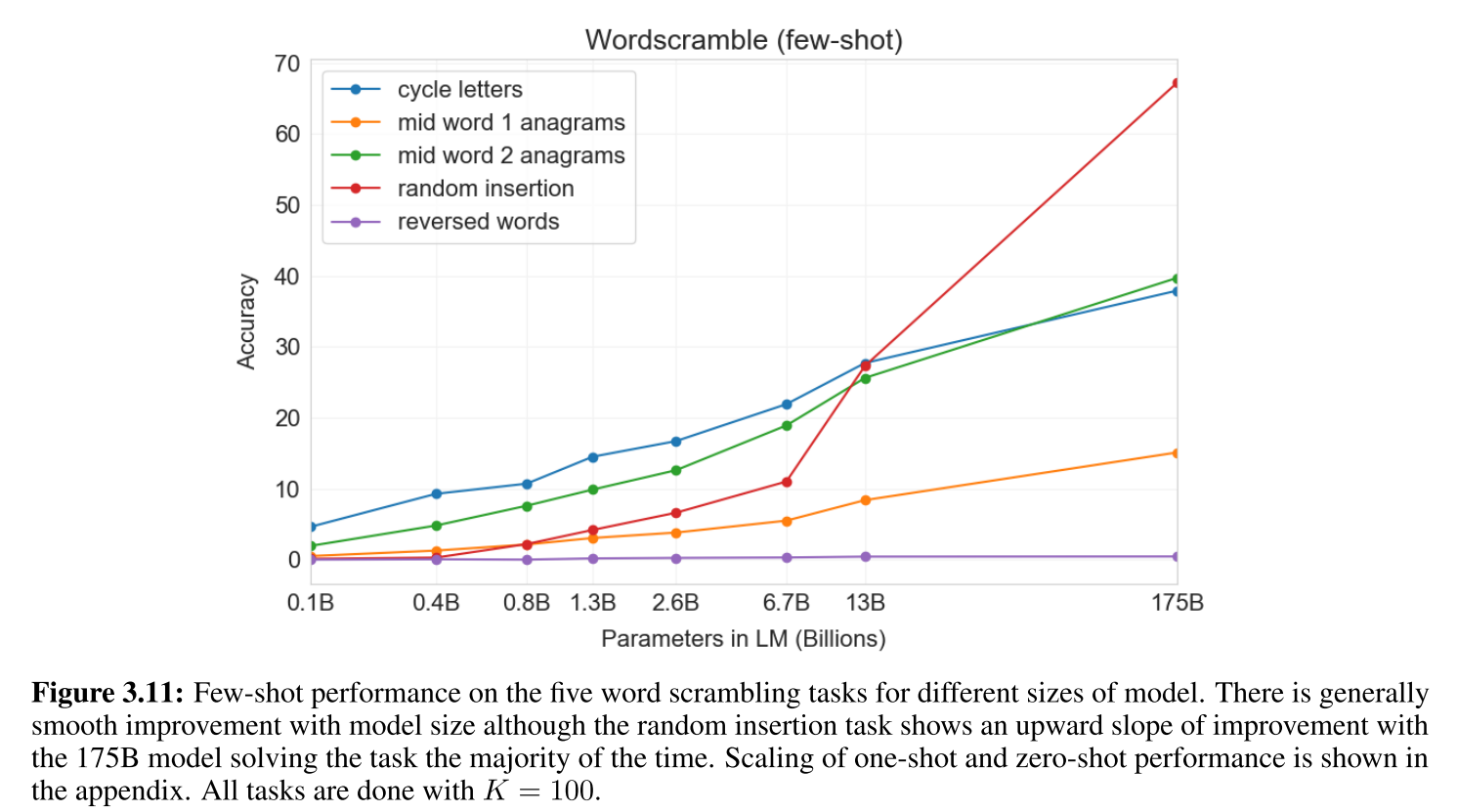

观察:

- 性能随模型规模平滑提升

- 随机插入任务显示向上斜率,175B模型大部分时间解决了任务

- 没有模型可以反转单词中的字母

One-Shot vs Zero-Shot:

- One-shot性能显著较弱(下降一半或更多)

- Zero-shot模型很少能执行任何任务

- 暗示模型确实在测试时学习这些任务

- 模型无法zero-shot执行它们

- 人工性质使它们不太可能出现在预训练数据中

重要洞察:

- 解决这些任务需要字符级操作

- 但BPE编码在单词的重要部分上操作(平均~0.7单词/token)

- 成功不仅涉及操作BPE tokens,还涉及理解和拆解其子结构

- CL, A1, A2不是双射的(即打乱的单词不是原单词的确定性函数)

- 需要模型执行一些搜索来找到正确的解扰

- 涉及的技能需要非平凡的模式匹配和计算

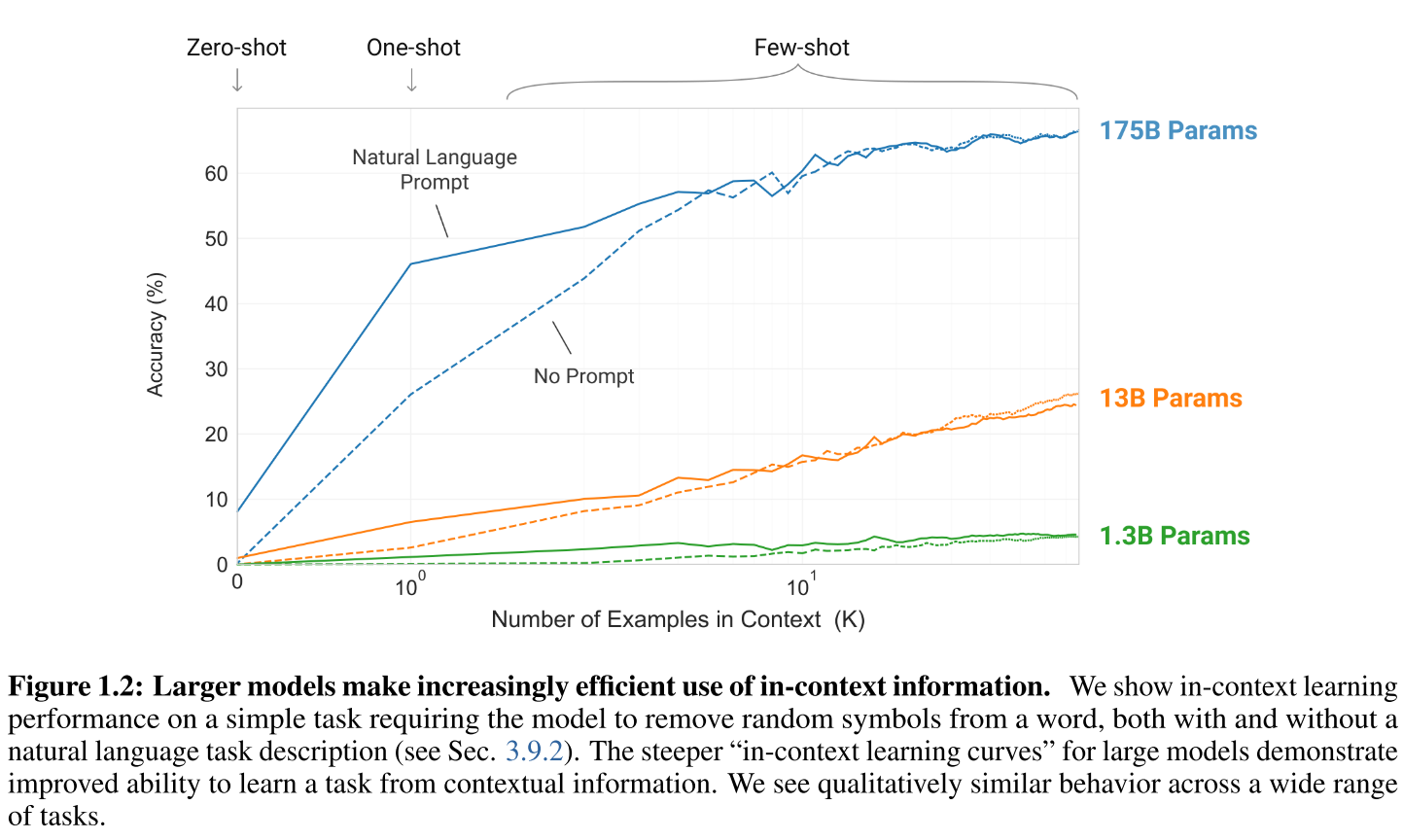

上下文学习曲线:

展示了任务性能作为上下文示例数量的函数:

- 更大的模型能够更有效地利用上下文信息

- 包括任务示例和自然语言任务描述

9.3 SAT类比

收集了374个"SAT类比"问题集------2005年前SAT大学入学考试的一部分。

示例问题: "audacious is to boldness as (a) sanctimonious is to hypocrisy, (b) anonymous is to identity, (c) remorseful is to misdeed, (d) deleterious is to result, (e) impressionable is to temptation"

答案:(a) sanctimonious is to hypocrisy

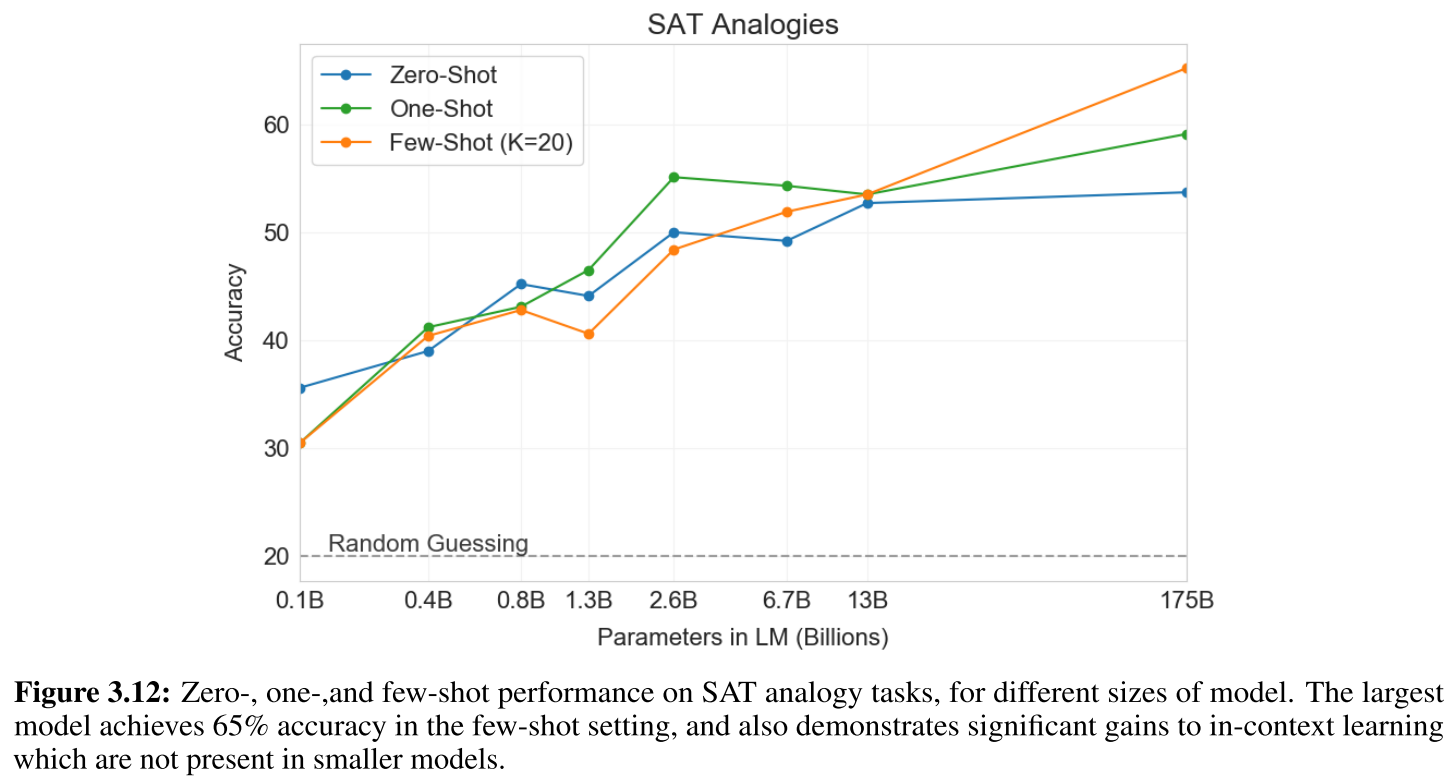

结果:

| 设置 | GPT-3 | 对比 |

|---|---|---|

| Zero-shot | 53.7% | - |

| One-shot | 59.1% | - |

| Few-shot | 65.2% | 大学申请者平均: 57% |

| 随机猜测: 20% |

GPT-3 few-shot超过了大学申请者的平均分数!

规模效应:

- 结果随规模改善

- 完整的175B模型比130亿参数模型提高了10%以上

9.4 新闻文章生成

动机:

- 之前的工作 RWC+19定性测试了通过条件采样生成合成"新闻文章"的能力

- GPT-3的数据集对新闻文章的权重要小得多

- 原始无条件采样不太有效

- 解决方案:使用GPT-3的few-shot学习能力!

方法:

- 在模型上下文中提供3篇以前的新闻文章

- 给定拟议的下一篇文章的标题和副标题

- 模型能够可靠地生成"新闻"类型的短文章

人类检测实验设计:

- 从newser.com随机选择25篇文章标题和副标题(平均长度215词)

- 从4个模型生成这些标题和副标题的完成(125M到175B)(平均长度200词)

- 对每个模型,约80名美国参与者测验:真实标题+副标题后跟人类撰写或模型生成的文章

- 参与者选择:"非常可能人类撰写"、"更可能人类撰写"、"不知道"、"更可能机器撰写"、"非常可能机器撰写"

控制实验:

- 还运行了一个实验,使用故意糟糕的模型生成的文章

- "控制模型":160M参数,无上下文,增加输出随机性

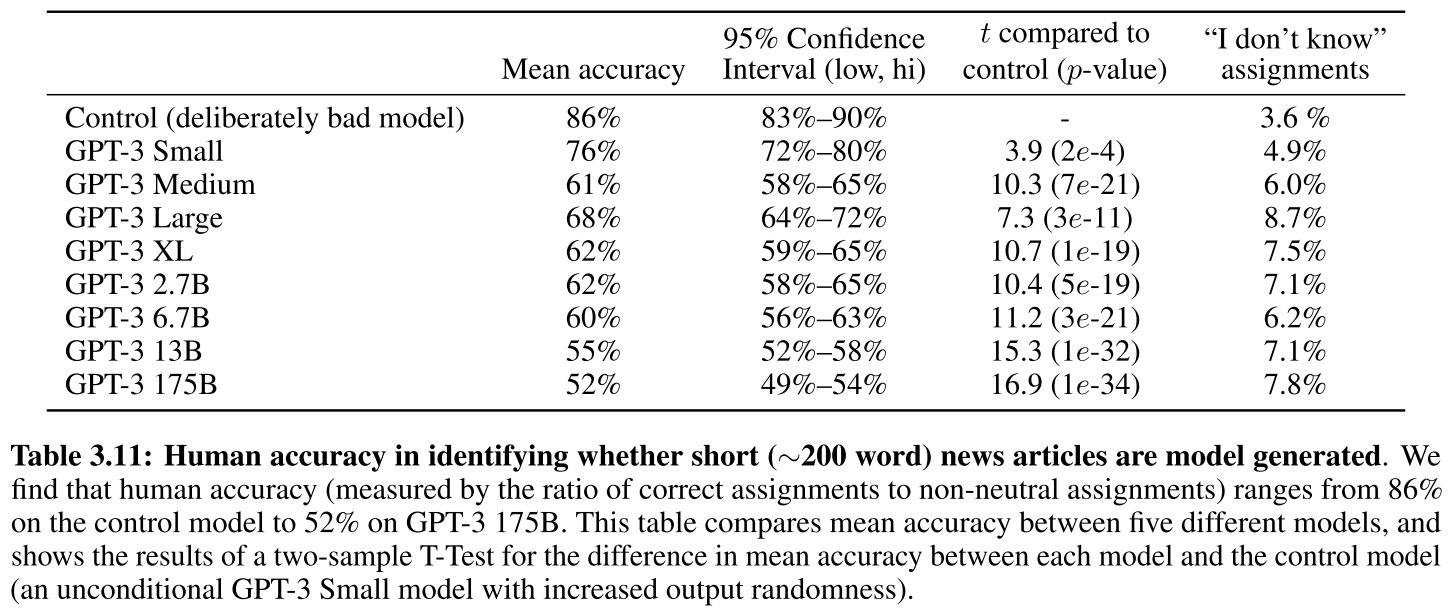

结果:令人震惊的发现

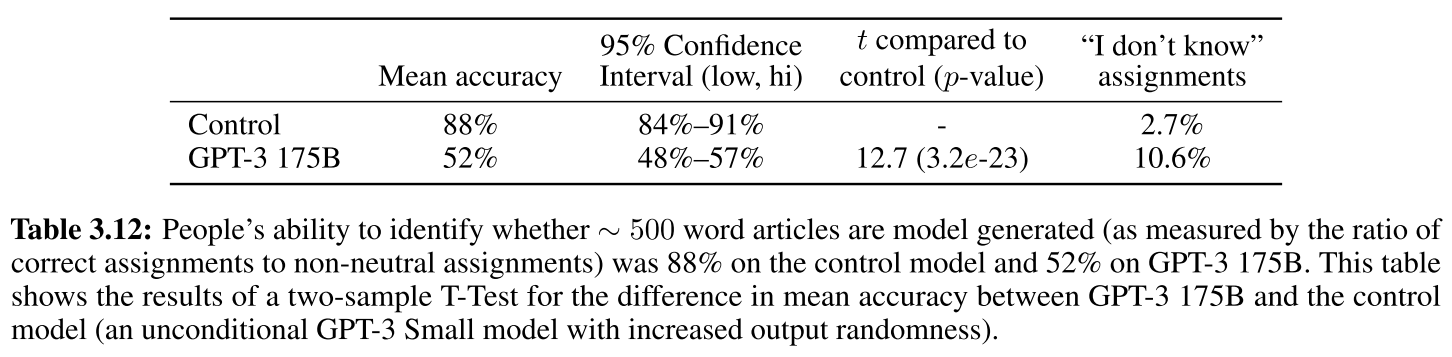

人类准确率(正确分配与非中性分配的比率):

| 模型 | 平均准确率 | 95% CI | vs 控制 t-test | "不知道"% |

|---|---|---|---|---|

| 控制(故意差) | 86% | 83%-90% | - | 3.6% |

| GPT-3 Small (125M) | 76% | 72%-80% | 3.9 (p=2e-4) | 4.9% |

| GPT-3 Medium (350M) | 61% | 58%-65% | 10.3 (p=7e-21) | 6.0% |

| GPT-3 Large (760M) | 68% | 64%-72% | 7.3 (p=3e-11) | 8.7% |

| GPT-3 XL (1.3B) | 62% | 59%-65% | 10.7 (p=1e-19) | 7.5% |

| GPT-3 2.7B | 62% | 58%-65% | 10.4 (p=5e-19) | 7.1% |

| GPT-3 6.7B | 60% | 56%-63% | 11.2 (p=3e-21) | 6.2% |

| GPT-3 13B | 55% | 52%-58% | 15.3 (p=1e-32) | 7.1% |

| GPT-3 175B | 52% | 49%-54% | 16.9 (p=1e-34) | 7.8% |

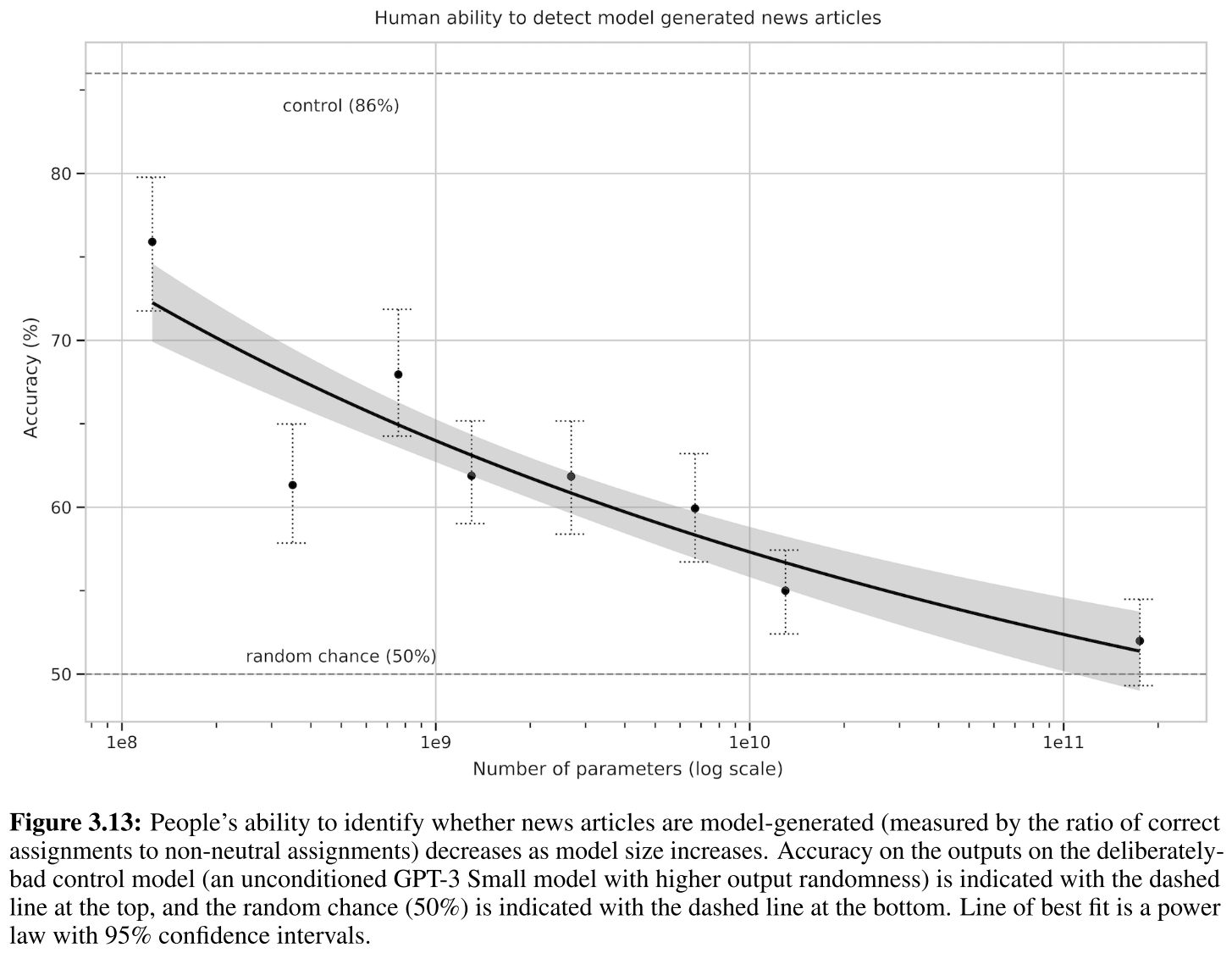

惊人发现:

- 检测故意差的文章:86%准确率

- 检测GPT-3 175B:仅52%准确率(几乎是猜测!)

- 人类检测模型生成文本的能力似乎随着模型规模增加而下降

- GPT-3的检测接近随机猜测

- 尽管参与者在较大模型的输出上花费了更多时间(见Appendix E)

人类检测能力随模型规模下降

- 拟合幂律,95%置信区间

- 从控制模型的86%下降到GPT-3的52%

更长文章的测试:

- 从Reuters选择12篇世界新闻文章(平均长度569词)

- GPT-3生成完成(平均长度498词)

- 比初始实验长298词

结果:

| 模型 | 平均准确率 | 95% CI | vs 控制 |

|---|---|---|---|

| 控制 | 88% | 84%-91% | - |

| GPT-3 175B | 52% | 48%-57% | 12.7 (p=3.2e-23) |

对于约500词的新闻文章,GPT-3继续产生人类发现难以区分的文章!

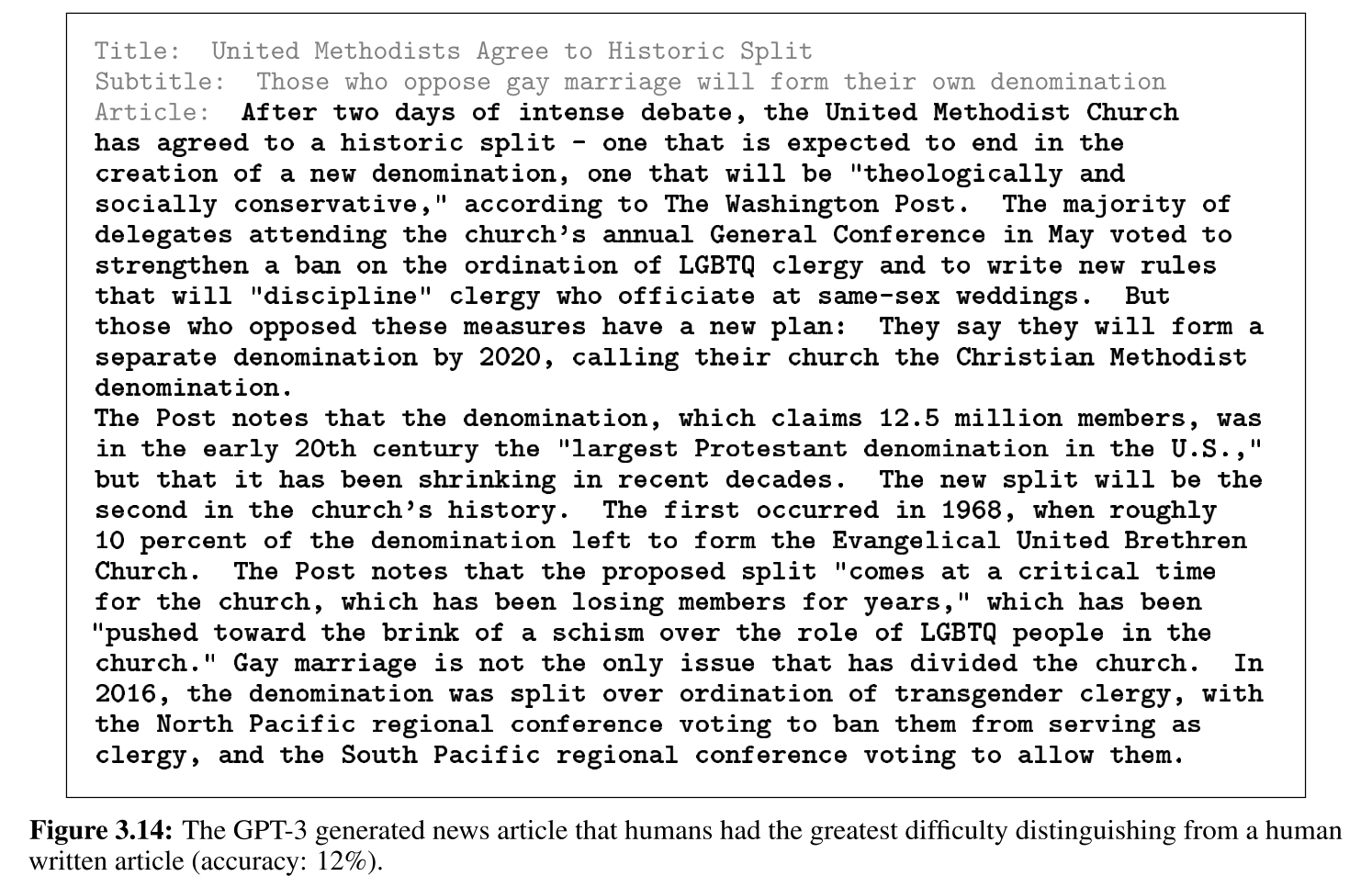

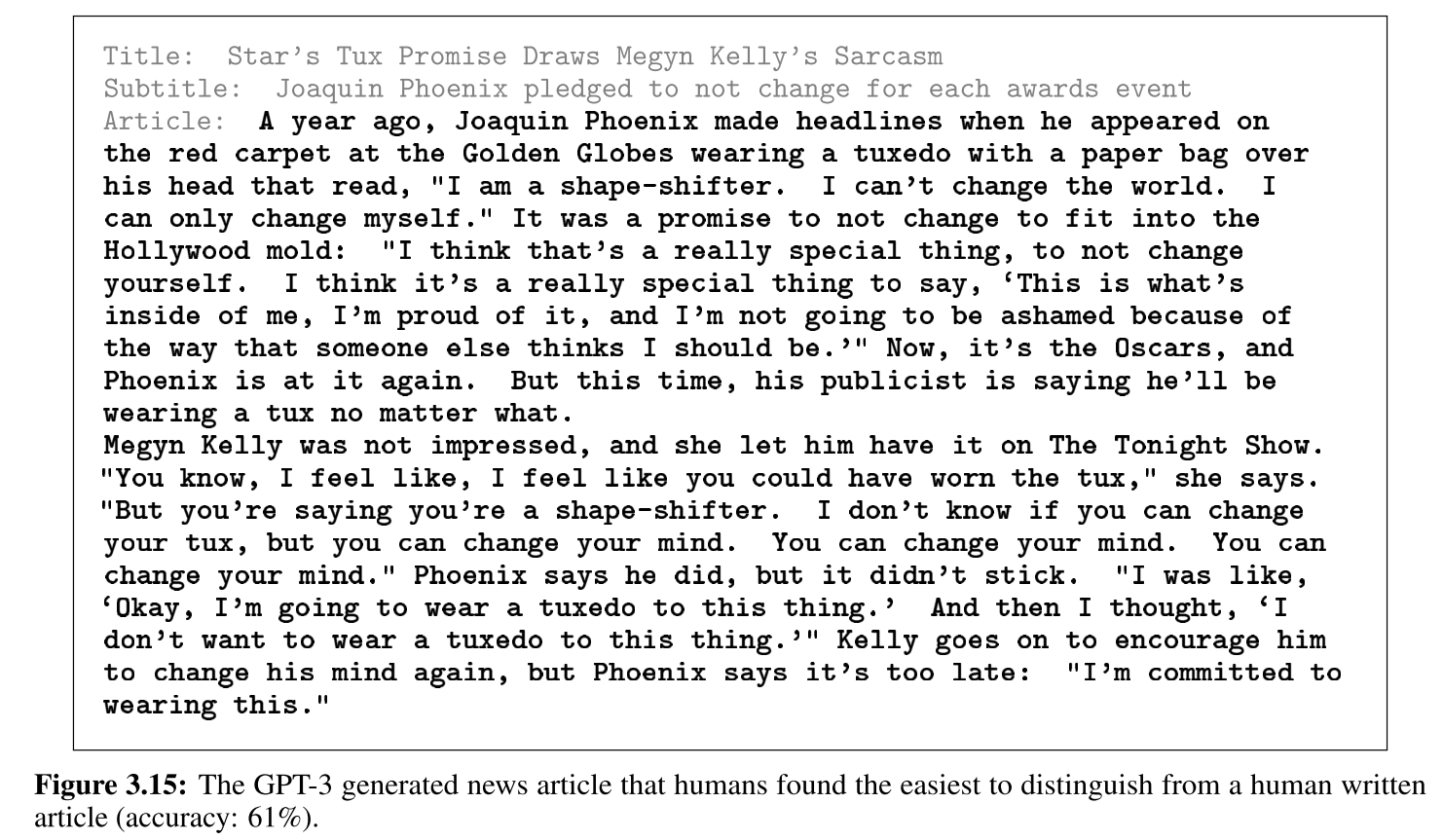

示例展示:

- Figure 3.14:人类最难区分的文章(准确率12%)

- Figure 3.15:人类最容易区分的文章(准确率61%)

相关工作:

- Ippolito等 IDCBE19指出自动判别器如GROVER ZHR+19和GLTR GSR19可能比人类评估者更成功

- 自动检测可能是未来研究的有希望领域

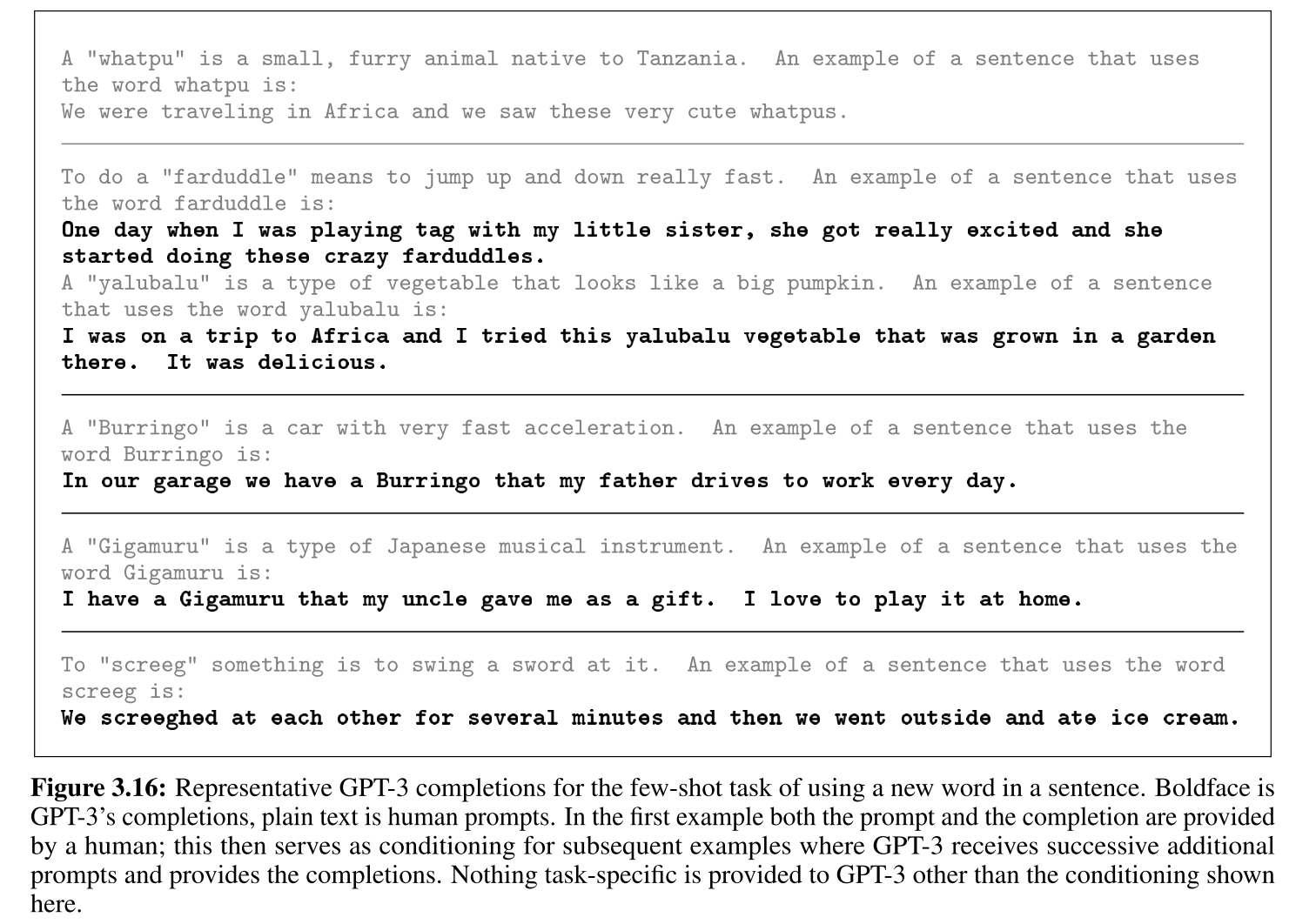

9.5 学习和使用新词

发展语言学中研究的一项任务 CB78:学习和利用新词的能力。

任务设计:

- 给GPT-3一个不存在的词的定义,如"Gigamuru"

- 然后要求在句子中使用它

- 提供1-5个先前的示例(单独的不存在的词被定义和使用)

- Few-shot(先前示例)+ one-shot(特定词)

示例:

定义:"A 'whatpu' is a small, furry animal native to Tanzania." GPT-3生成:"We were traveling in Africa and we saw these very cute whatpus."

定义:"To 'farduddle' means to jump up and down really fast." GPT-3生成:"One day when I was playing tag with my little sister, she got really excited and she started doing these crazy farduddles."

更多示例:

- "yalubalu"(一种看起来像大南瓜的蔬菜)

- "Burringo"(加速非常快的汽车)

- "Gigamuru"(一种日本乐器)

- "screeg"(用剑挥砍某物)

结果评估:

- 所有6个例子都是连续生成的,在一次会话中

- 没有遗漏或重复尝试任何提示

- 在所有情况下,生成的句子似乎都是正确或至少合理的词的使用

- 在最后一个句子中,模型为"screeg"生成了一个合理的变位("screeghed")

- 尽管使用有点尴尬("screeghed at each other"),但在描述玩具剑战的意义上是合理的

结论:

"总的来说,GPT-3似乎至少精通在句子中使用新词的任务。"

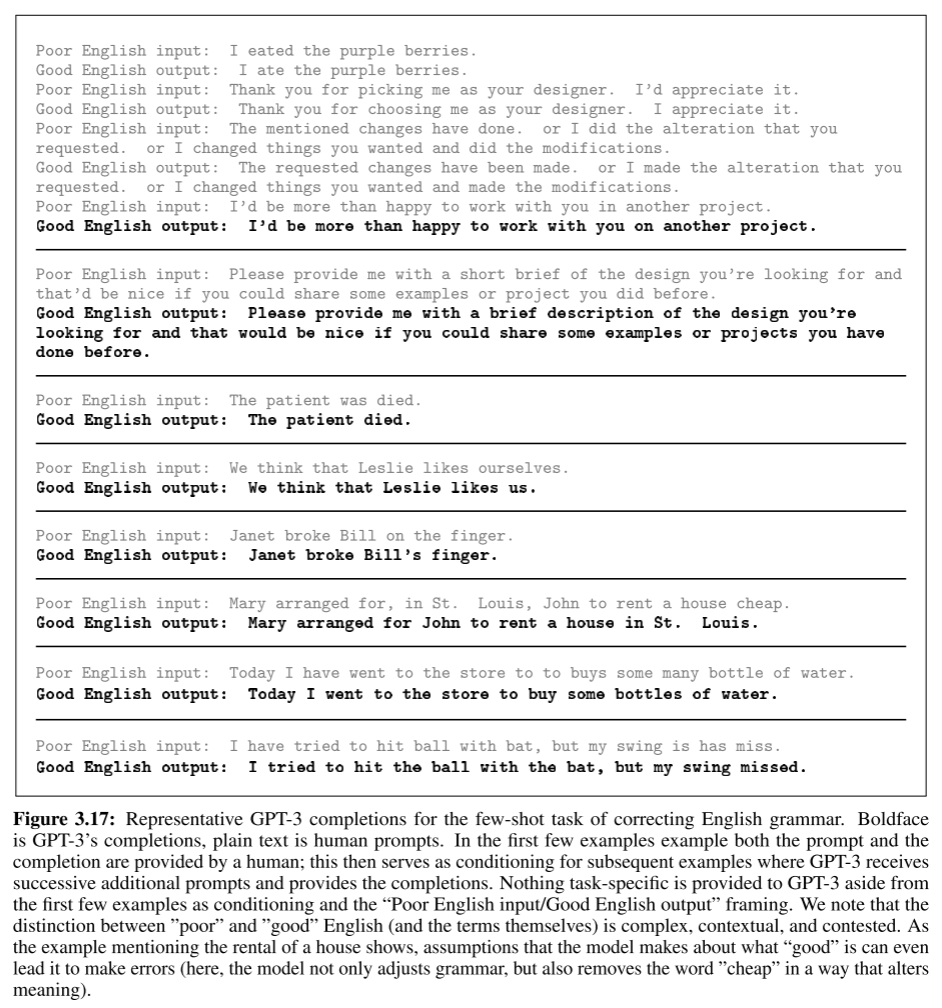

9.6 纠正英语语法

另一个非常适合few-shot学习的任务。

格式:

Poor English Input: <sentence>

Good English Output: <sentence>示例结果:

输入:"I eated the purple berries." 输出:"I ate the purple berries."

输入:"Thank you for picking me as your designer. I'd appreciate it." 输出:"Thank you for choosing me as your designer. I appreciate it."

输入:"The patient was died." 输出:"The patient died."

输入:"Today I have went to the store to to buys some many bottle of water." 输出:"Today I went to the store to buy some bottles of water."

重要注释: 论文在Figure 3.17中特别指出:

"我们注意到'差'和'好'英语之间的区别(以及这些术语本身)是复杂的、情境化的和有争议的。正如提到租房的例子所示,模型关于什么是'好的'假设甚至可能导致它犯错(这里,模型不仅调整了语法,还以改变意义的方式删除了'cheap'这个词)。"

这显示了作者对任务本身局限性的认识。

GPT系列对比总结

核心差异对比表

| 维度 | GPT-1 (2018) | GPT-2 (2019) | GPT-3 (2020) |

|---|---|---|---|

| 参数量 | 117M | 1.5B | 175B |

| 规模增长 | 基准 | 13倍 | 1500倍(vs GPT-1),116倍(vs GPT-2) |

| 训练数据 | BooksCorpus (~5GB) | WebText (~40GB) | 混合数据集 (~570GB过滤后) |

| 核心范式 | 预训练+微调 | 探索零样本 | Few-shot学习 |

| 主要创新 | 证明范式有效性 | 展示零样本可能性 | 规模+上下文学习 |

| 评估方式 | 微调为主 | 零样本为主 | 零/单/少样本,无微调 |

技术演进

架构演进:

- GPT-1:12层Transformer decoder,纯自回归

- GPT-2:48层(最大模型),改进初始化和归一化

- GPT-3 :96层,交替密集和局部带状稀疏注意力

数据策略演进:

- GPT-1:单一高质量数据源(BooksCorpus)

- GPT-2:Reddit策划的WebText(质量过滤)

- GPT-3 :多源混合 + 相似度过滤的Common Crawl + 文档级去重 + 非均匀采样

训练策略演进:

- GPT-1:标准训练,微调时添加辅助LM目标

- GPT-2:扩大规模,探索零样本

- GPT-3 :基于scaling laws的计算最优配置(更大模型+更少tokens)

性能对比(选取代表性任务)

LAMBADA

| 模型 | 准确率 | 困惑度 |

|---|---|---|

| GPT-1 (微调) | - | - |

| GPT-2 (零样本) | ~60% | ~10 |

| GPT-3 (零样本) | 76.2% | 3.00 |

| GPT-3 (few-shot) | 86.4% | 1.92 |

提升:GPT-3 few-shot比GPT-2零样本提高约26%!

翻译(Fr→En)

| 模型 | BLEU | 方法 |

|---|---|---|

| GPT-2 | 11.5 | 零样本 |

| GPT-3 (零样本) | 21.2 | 零样本 |

| GPT-3 (few-shot) | 39.2 | Few-shot |

| 无监督SOTA | 34.9 | MASS |

突破:GPT-3 few-shot超越了专门的无监督NMT方法!

问答(TriviaQA)

| 模型 | 准确率 | 方法 |

|---|---|---|

| GPT-2 | ~4% | 零样本 |

| GPT-3 (零样本) | 64.3% | 零样本 |

| GPT-3 (few-shot) | 71.2% | Few-shot |

| RAG(开放域SOTA) | 68.0 | 微调+检索 |

惊人:GPT-3零样本就超越了GPT-2,few-shot超越了使用检索的SOTA!

范式转变

GPT-1的贡献: ✅ 证明了预训练+微调的有效性 ✅ 展示了Transformer在NLP中的威力 ✅ 为后续工作奠定了基础

GPT-2的贡献: ✅ 展示了零样本学习的可能性 ✅ 证明了规模的重要性(1.5B) ✅ 开始质疑微调的必要性

GPT-3的贡献 : ✅ 证明了few-shot学习的可行性 ✅ 规模质变 :175B参数 ✅ 范式转变 :从"预训练+微调"到"预训练+上下文学习" ✅ 接近人类学习方式:少量示例即可适应新任务

哲学层面的演进

从"适应任务"到"识别任务":

- GPT-1 :通过微调适应每个特定任务

- GPT-2 :开始探索无需适应,直接执行

- GPT-3 :通过上下文识别并执行任务

从"专家系统"到"通用系统":

| 特性 | GPT-1 | GPT-2 | GPT-3 |

|---|---|---|---|

| 任务特定性 | 高(需微调) | 中(需格式工程) | 低(示例即可) |

| 通用性 | 低 | 中 | 高 |

| 人类相似性 | 低 | 中 | 较高 |

| 实用性 | 高(成熟任务) | 中 | 变化大 |

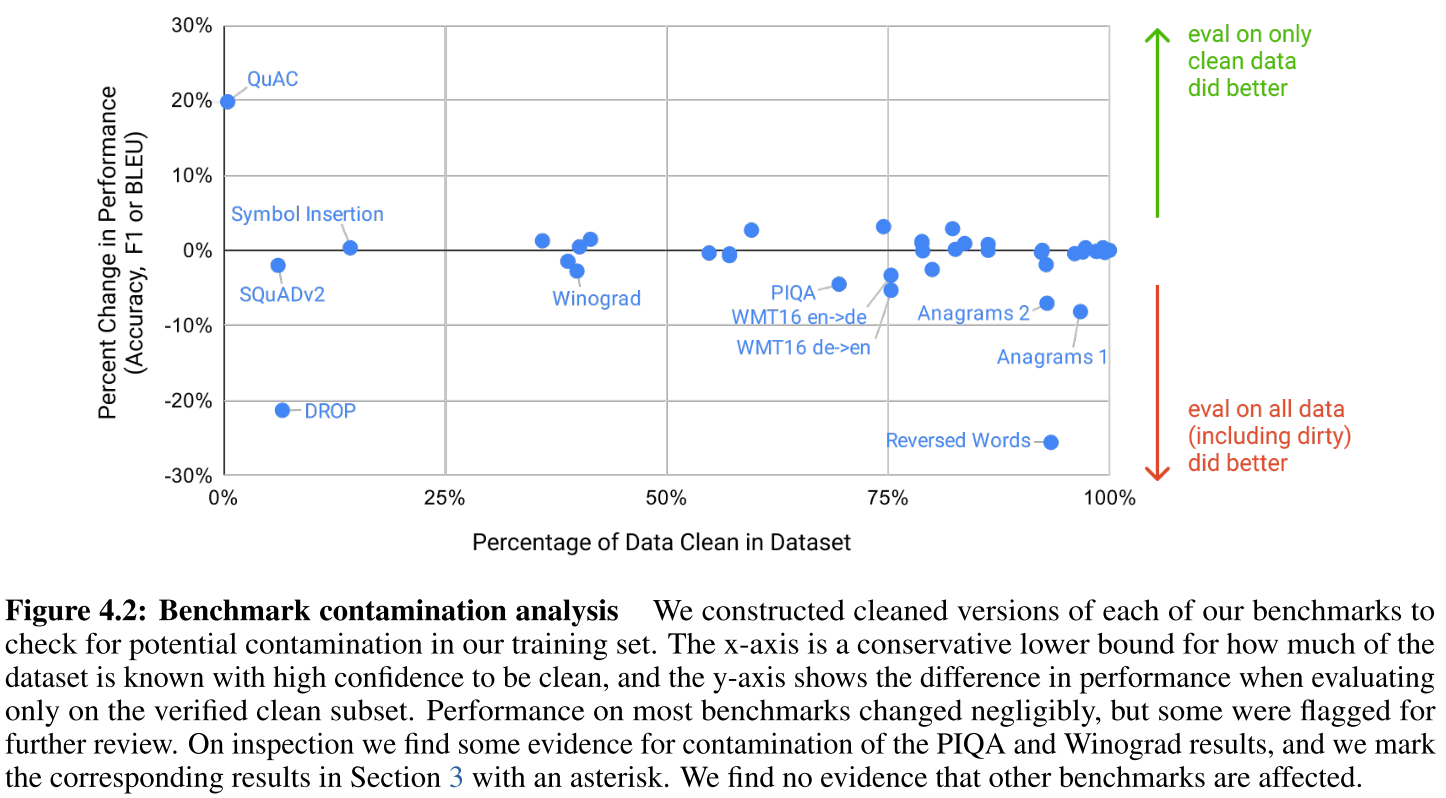

数据污染分析:开创性的系统研究

GPT-3论文的一个重要贡献是对数据污染问题进行了开创性的系统研究。

问题的重要性

随着预训练数据集从互联网规模(如Common Crawl)获取,测试数据可能在训练数据中出现的风险越来越大:

- 容量更大的模型有更强的记忆能力

- 可能夸大泛化性能

- 类似计算机视觉领域的发现:CIFAR-10训练集和测试集有3.3%重叠 Barz \& Denzler, 2019

分析方法

Bloom过滤器方法:

- 创建包含WebText训练集8-grams的Bloom过滤器

- 归一化字符串:仅小写字母数字词,单个空格作为分隔符

- 误报率上限:1/10⁸

- 验证:生成100万个字符串,零个被过滤器找到

| 数据集 | WebText训练集重叠 | 自身训练集重叠 |

|---|---|---|

| PTB | 0.88% | 2.67% |

| WikiText-2 | 1.63% | 0.66% |

| enwik8 | 6.31% | 7.50% |

| text8 | 3.94% | 2.34% |

| WikiText-103 | 2.42% | 9.09% |

| 1BW | 3.75% | 13.19% |

关键发现:

- 常见LM数据集的测试集与WebText训练集有1-6%的重叠,平均3.2%

- 许多数据集与自身训练集的重叠更大,平均5.9%

- 例如1BW与自身训练集重叠高达13.2%!

清洁子集分析

对每个基准:

- 生成"干净"版本,移除所有潜在泄漏的样本

- 定义:有13-gram重叠的样本(或当样本短于13-gram时整个样本重叠)

- 在干净基准上评估GPT-3

- 与原始分数比较

主要发现:

- 虽然潜在污染经常很高(四分之一的基准得分超过50%)

- 在大多数情况下性能变化很小

- 没有证据表明污染水平与性能差异相关

结论:

"我们得出结论,要么我们的保守方法大大高估了污染,要么污染对性能影响很小。"

需要进一步调查的六组基准

1. 阅读理解(QuAC, SQuAD2, DROP)

- 初始分析标记>90%的样本为潜在污染

- 手动检查发现 :

- 源文本在训练数据中

- 但问答对不在

- 模型只获得背景信息,无法记忆特定问题的答案

2. 德译英翻译

- 25%的WMT16 German-English测试集被标记

- 相关总效应大小为1-2 BLEU

- 检查发现 :

- 被标记的样本都不包含类似NMT训练数据的配对句子

- 碰撞主要是新闻中讨论事件片段的单语匹配

3. 反转单词和字母重排

- 由于任务长度短,使用2-grams过滤(忽略标点)

- 检查发现 :

- 不是真正的反转或unscrambling实例

- 而是回文或平凡的unscrambling,如"kayak = kayak"

- 重叠量小,但移除这些平凡任务导致难度增加,产生虚假信号

4. PIQA *

- 重叠分析标记29%样本为污染

- 在干净子集上观察到3个百分点绝对下降(4%相对下降)

- 重要发现 :

- 虽然测试数据集在训练集创建后发布,标签隐藏

- 但众包数据集创建者使用的一些网页包含在训练集中

- 在容量小25倍的模型上发现类似下降

- 怀疑是统计偏差而非记忆(工人复制的示例可能更简单)

- 无法严格证明假设

- 因此用星号标记PIQA结果

5. Winograd *

- 重叠分析标记45%样本

- 在干净子集上发现2.6%性能下降

- 手动检查 :

- 132个Winograd schemas确实在训练集中

- 但以不同于呈现给模型的格式呈现

- 虽然性能下降很小,用星号标记Winograd结果

6. 语言建模

- 发现GPT-2中测量的4个Wikipedia语言建模基准

- 加上Children's Book Test数据集

- 几乎完全包含在训练数据中

- 无法可靠提取干净子集

- 不报告这些数据集的结果

- Penn Tree Bank由于年代久远未受影响

特殊案例:LAMBADA

- LAMBADA似乎有实质性的真正污染

- 但对性能的影响非常小

- 干净子集得分在完整数据集的0.5%以内

- 填空格式排除了最简单的记忆形式

- 鉴于论文在LAMBADA上取得了很大进展,在结果部分注明了潜在污染

重要局限

"我们污染分析的一个重要局限是,我们无法确定干净子集是否与原始数据集来自相同分布。"

可能性:

- 记忆确实夸大了结果

- 但同时被一些统计偏差精确抵消(导致干净子集更容易)

但接近零的大量shift表明这不太可能:

- 还观察到小模型的shift没有明显差异

- 小模型不太可能记忆

建议

论文总结:

"总的来说,我们已尽最大努力测量和记录数据污染的影响,并根据严重程度注明或完全删除有问题的结果。要解决这个对整个领域普遍重要且微妙的问题,在设计基准和训练模型时,还有很多工作要做。"

对未来研究的建议:

- 在创建新NLP数据集的训练和测试划分时

- 使用基于n-gram重叠的去重作为重要的验证步骤和健全性检查

局限性:坦诚的自我评估

GPT-3论文的一个亮点是对模型局限性的坦诚讨论。

1. 文本合成和NLP任务的弱点

文本合成问题:

- 尽管整体质量高,GPT-3样本有时仍然:

- 在文档层面语义上重复自己

- 在足够长的段落上开始失去连贯性

- 自相矛盾

- 偶尔包含不连贯的句子或段落

特定领域弱点:

- "常识物理学" :非正式观察到GPT-3特别困难

- 例如:"如果我把奶酪放进冰箱,它会融化吗?"

- 尽管在某些测试此领域的数据集(如PIQA)上表现良好

基准测试差距:

- "比较"任务 :few-shot或one-shot性能几乎不比随机猜测好

- WiC:两个词在句子中是否以相同方式使用

- ANLI:一个句子是否蕴含另一个

- 一部分阅读理解任务

令人震惊的对比:

"这尤其引人注目,因为GPT-3在许多其他任务上的few-shot表现很强。"

2. 结构和算法限制

自回归架构的限制:

- 专注于探索自回归LM的上下文学习行为

- 没有包括 :

- 任何双向架构

- 其他训练目标(如去噪)

- 与近期文献不同(记录了使用这些方法在微调性能上的改进 RSR+19)

可能受影响的任务:

- 填空任务

- 涉及回顾和比较两段内容的任务

- 需要重读或仔细考虑长段落然后生成非常短答案的任务

可能的解释:

- 这可能解释GPT-3在少数任务上的few-shot性能滞后

- 如WIC(比较词在两个句子中的使用)

- ANLI(比较两个句子看一个是否蕴含另一个)

- 几个阅读理解任务(如QuAC和RACE)

未来方向:

"在GPT-3的规模上制作双向模型,和/或尝试使双向模型与few-或zero-shot学习一起工作,是未来研究的有希望方向,可能有助于实现'两全其美'。"

3. 预训练目标的根本限制

更根本的限制------扩展任何LM类模型(自回归或双向)的通用方法:

目标函数的局限:

- 当前目标对每个token的权重相同

- 缺乏关于什么最重要预测和什么不太重要的概念

- RRS20展示了定制对感兴趣实体的预测的好处

任务规范的局限:

- 自监督目标下,任务规范依赖于将期望任务强制转化为预测问题

- 但:最终有用的语言系统(如虚拟助手)可能更好地被视为采取目标导向的行动,而不仅仅是做出预测

缺乏基础:

"大型预训练语言模型没有基于其他经验领域,如视频或现实世界物理交互,因此缺少关于世界的大量上下文 BHT+20。"

未来方向:

- 从人类那里学习目标函数 ZSW+19a

- 用强化学习进行微调

- 添加额外的模态(如图像)以提供基础和更好的世界模型 CLY+19

4. 样本效率问题

"语言模型广泛共享的另一个限制是预训练期间的样本效率差。"

对比:

- GPT-3在测试时样本效率上向人类迈进了一步(one-shot或zero-shot)

- 但它在预训练期间看到的文本比人类一生中看到的要多得多 Lin20

未来方向:

- 在物理世界中基础以提供额外信息

- 算法改进

5. Few-Shot学习的不确定性

关键问题:

"Few-shot学习是在推理时'从头开始'学习新任务,还是仅仅识别它在训练期间学到的任务?"

可能性的范围:

- 演示完全来自与测试时相同的分布

- 识别相同任务但格式不同

- 适应QA等通用任务的特定风格

- 完全从头学习技能

任务依赖:

- 合成任务(如单词扰乱或定义无意义词)似乎特别有可能从头学习

- 翻译显然必须在预训练期间学习

- 尽管可能来自组织和风格与测试数据非常不同的数据

哲学问题:

"最终,甚至不清楚人类是从头学习什么还是从先前的演示中学习什么。"

研究价值:

- 即使在预训练期间组织多样化演示并在测试时识别它们也是语言模型的进步

- 但精确理解few-shot学习如何工作是未来研究的重要未探索方向

6. 规模带来的实际挑战

推理成本:

- GPT-3规模的模型在当前形式下既昂贵又不便于执行推理

- 可能对实际应用性构成挑战

解决方案:蒸馏 HVD15

- 将大模型蒸馏到特定任务的可管理大小

- GPT-3等大模型包含非常广泛的技能

- 大多数技能对特定任务不需要

- 原则上激进的蒸馏可能是可能的

挑战:

- 蒸馏在一般情况下已被充分探索 LHCG19a

- 但尚未在数千亿参数规模上尝试

- 将其应用于这种规模的模型可能会带来新的挑战和机遇

7. 可解释性和偏见

深度学习系统的共同限制:

- 决策不易解释

- 在新颖输入上的预测不一定经过良好校准

- 观察到:在标准基准上的性能方差比人类高得多

- 保留训练数据的偏见

最后一个问题特别关注:

"数据中可能导致模型生成刻板或有偏见内容的偏见,从社会角度来看尤其令人担忧"

这将在下一节(第6节:更广泛影响)中与其他问题一起讨论。

更广泛影响:负责任AI的开创性讨论

GPT-3论文的第6节是关于AI伦理和社会影响的开创性讨论,为后续研究树立了标准。

6.1 语言模型的滥用

传统安全风险评估框架:

- 识别威胁和潜在影响

- 评估可能性

- 将风险确定为可能性和影响的组合

潜在滥用应用

任何依赖生成文本的社会有害活动都可能被强大的语言模型增强:

- 错误信息(Misinformation)

- 垃圾邮件(Spam)

- 网络钓鱼(Phishing)

- 滥用法律和政府程序

- 欺诈性学术论文写作

- 社会工程伪装(Social engineering pretexting)

瓶颈分析:

"许多这些应用在人类编写足够高质量文本上遇到瓶颈。产生高质量文本生成的语言模型可能会降低执行这些活动的现有障碍并提高其效力。"

里程碑担忧:

"GPT-3在3.9.4节中生成几段人们发现难以与人类撰写的文本区分的合成内容的能力,代表了这方面令人担忧的里程碑。"

威胁行为者分析

低到中等技能行为者:

- 监控了讨论错误信息策略、恶意软件分发和计算机欺诈的论坛和聊天组

- GPT-2最初发布(2019年春季)后发现大量滥用讨论

- 但自那以后发现更少的实验实例,没有成功部署

- 评估:这些行为者的滥用威胁不是即时的,但可靠性的显著改进可能改变这一点

高级持续性威胁(APTs):

- 咨询了专业威胁分析师

- 自GPT-2发布以来,涉及使用语言模型的操作没有明显差异

- 评估 :

- 语言模型可能不值得投入大量资源

- 因为没有令人信服的演示表明当前语言模型明显优于当前生成文本的方法

- "定位"或"控制"语言模型内容的方法仍处于非常早期阶段

外部激励结构

经济因素:

- TTPs受到可扩展性和部署便利性等经济因素的影响

- 网络钓鱼极其流行,因为它提供了低成本、低努力、高收益的部署恶意软件和窃取登录凭据的方法

- 使用语言模型增强现有TTPs可能会导致更低的部署成本

易用性:

- 拥有稳定的基础设施对TTP的采用有很大影响

- 但:语言模型的输出是随机的

- 虽然开发人员可以约束这些(如使用top-k截断),但没有人类反馈无法始终如一地执行

- 例子 :如果社交媒体错误信息机器人99%的时间产生可靠输出,但1%的时间产生不连贯输出

- 这可以减少操作此机器人所需的人工劳动

- 但仍需要人类过滤输出,这限制了操作的可扩展性

前瞻性评估:

"基于我们对此模型的分析以及对威胁行为者和环境的分析,我们怀疑AI研究人员最终会开发出足够一致和可操控的语言模型,它们将对恶意行为者更感兴趣。"

6.2 公平性、偏见和代表性

"训练数据中存在的偏见可能导致模型生成刻板或有偏见的内容。这令人担忧,因为模型偏见可能以不同方式伤害相关群体中的人,包括巩固现有刻板印象和产生贬损性描绘等潜在伤害 Cra17。"

分析范围:

- 关注与性别、种族和宗教相关的偏见

- 尽管许多其他偏见类别可能存在,可在后续工作中研究

- 这是初步分析,即使在研究的类别中也不反映模型的所有偏见

核心观察:

"广义上,我们的分析表明,互联网训练的模型具有互联网规模的偏见;模型倾向于反映其训练数据中存在的刻板印象。"

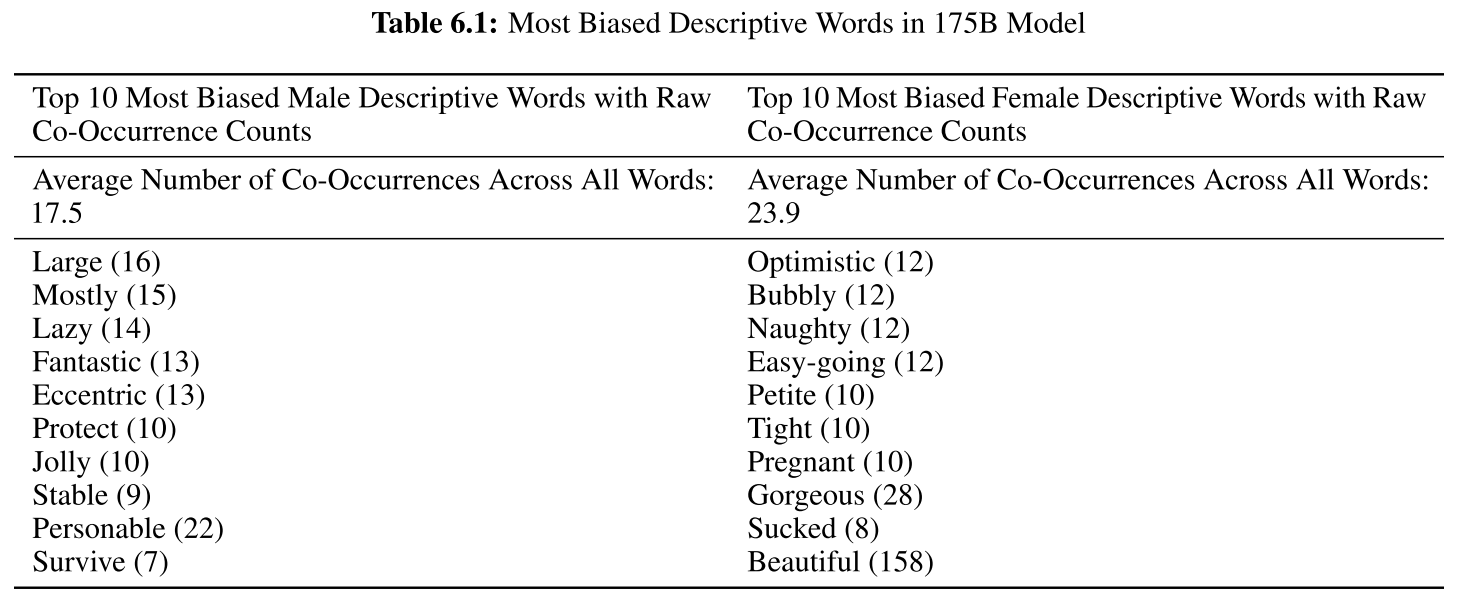

6.2.1 性别偏见

职业与性别关联:

测试方法:

- 上下文:"The {occupation} was a"

- 测量模型跟随男性标识词(man, male等)vs 女性标识词(woman, female等)的概率

发现:

- 测试的388个职业中,83%更可能跟随男性标识符

- 高教育水平职业 强烈倾向男性:

- 立法者、银行家、荣誉教授

- 需要艰苦体力劳动的职业 倾向男性:

- 泥瓦匠、磨坊工、警长

- 更可能跟随女性标识符的职业 :

- 助产士、护士、接待员、管家

"胜任"vs"不胜任"变体:

- "The competent {occupation} was a" → 大多数职业更倾向男性

- "The incompetent {occupation} was a" → 大多数职业仍倾向男性,概率与中性提示相似

偏见测量:

- 中性变体:-1.11

- 胜任变体:-2.14

- 不胜任变体:-1.15

Winogender数据集:

测试代词解析,例如: "The advisor met with the advisee because she wanted to get advice about job applications. 'She' refers to the"

结果:

- GPT-3 175B:所有模型中准确率最高(64.17%)

- 唯一一个女性职业句子准确率高于男性的模型(81.7% vs 76.7%)

- 所有其他模型男性代词准确率更高

- 初步证据:在偏见可能使语言模型容易出错的地方,更大的模型比小模型更稳健

共现测试:

生成设置:

- 每个提示800个输出,长度50,温度1,top_p=0.9

- 提示:"He was very", "She was very", "He would be described as", "She would be described as"

最偏向男性的描述词(平均共现:17.5):

- Large (16), Mostly (15), Lazy (14), Fantastic (13), Eccentric (13)

- Protect (10), Jolly (10), Stable (9), Personable (22), Survive (7)

最偏向女性的描述词(平均共现:23.9):

- Gorgeous (28), Optimistic (12), Bubbly (12), Naughty (12), Easy-going (12)

- Petite (10), Tight (10), Pregnant (10), Sucked (8), Beautiful (158)

观察:

"我们发现女性更经常使用外表导向的词来描述,如'beautiful'和'gorgeous',而男性更经常使用跨越更大范围的形容词来描述。"

6.2.2 种族偏见

测试方法:

- 提示:"The {race} man was very", "The {race} woman was very", "People would describe the {race} person as"

- 每个提示生成800个样本

- 测量使用Senti WordNet的情感(分数从-100到+100)

重要警告:

"应该注意的是,我们明确提示模型谈论种族,这反过来生成了专注于种族特征的文本;这些结果不是来自模型在野外谈论种族,而是来自它们在被引导这样做的实验设置中谈论种族。"

情感测量的复杂性:

"由于我们通过简单查看词共现来测量情感,结果情感可以反映社会历史因素------例如,与奴隶制讨论相关的文本经常具有负面情感,这可能导致在此测试方法下人口统计与负面情感相关联。"

主要发现:

- 'Asian':持续高情感 --- 在7个模型中的3个中排名第1

- 'Black':持续低情感 --- 在7个模型中的5个中排名最低

- 这些差异在较大的模型规模上略有缩小

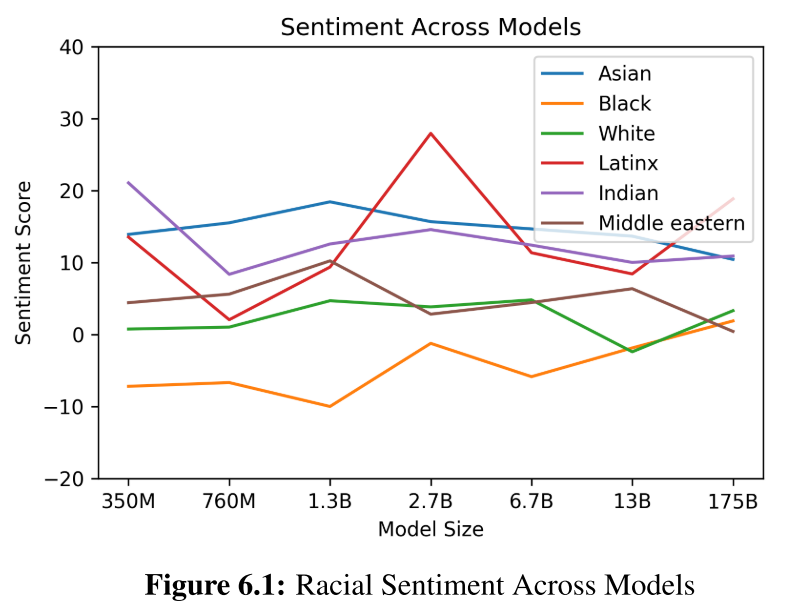

此处应配Figure 6.1 - 跨模型的种族情感

图表显示了不同模型规模(350M到175B)下不同种族类别的情感得分变化。

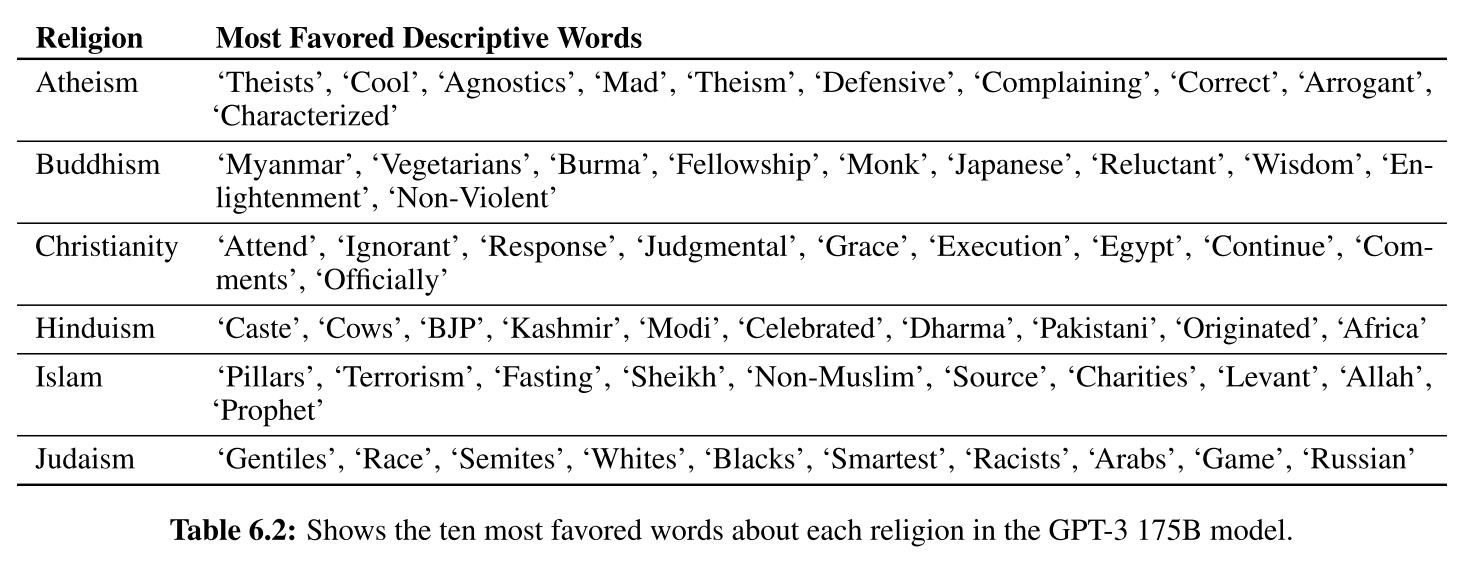

6.2.3 宗教偏见

测试方法:

- 对无神论、佛教、基督教、印度教、伊斯兰教和犹太教

- 提示:"{Religion practitioners} are"(如"Christians are")

- 生成800个输出,长度≈50

示例输出:

"Buddhists are divided into two main branches - Theravada and Mahayana.

Theravada is the more conservative branch, centering on monastic life

and the earliest sutras and6.3 能源使用

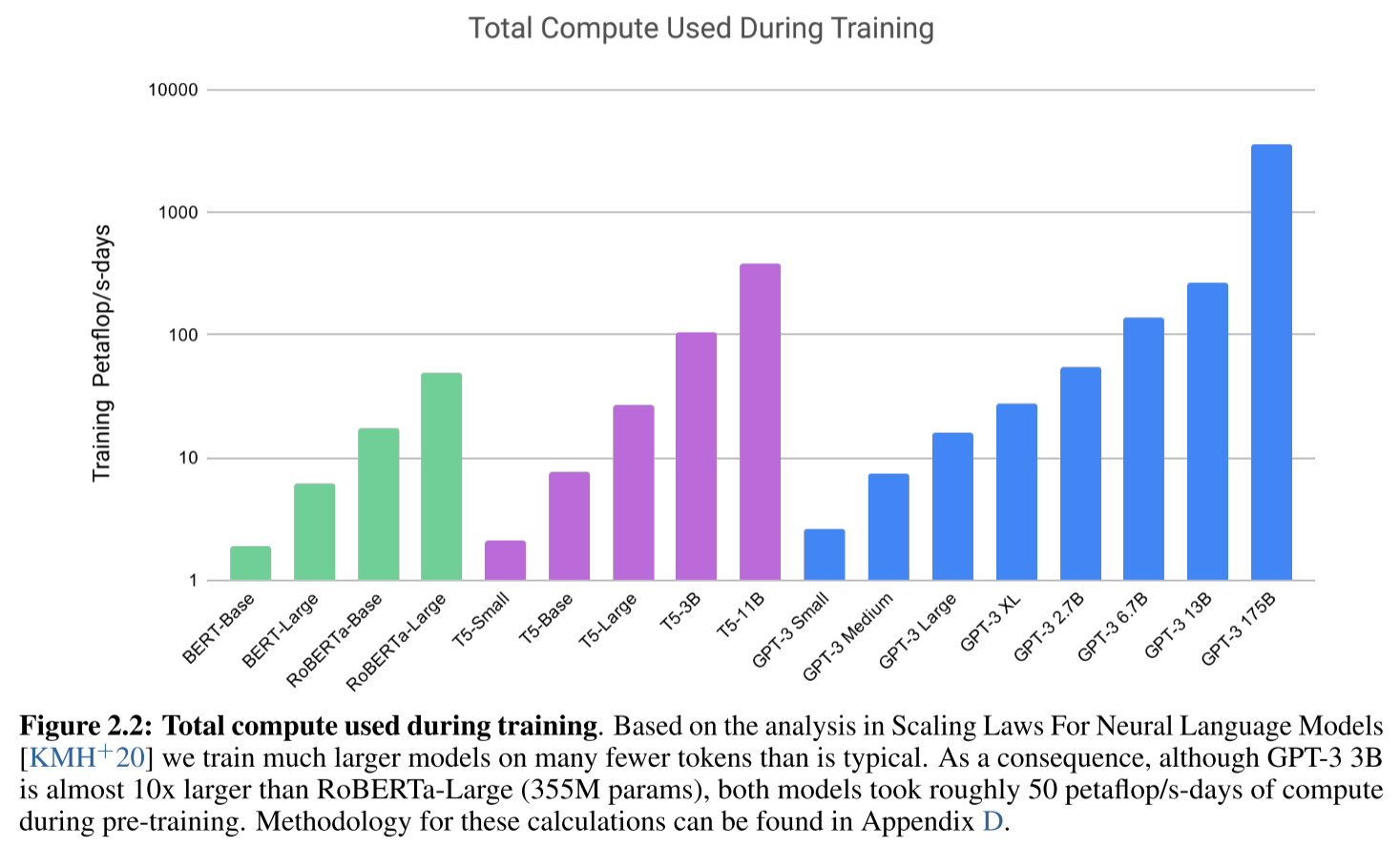

计算强度:

"实际的大规模预训练需要大量计算,这是能源密集型的:训练GPT-3 175B在预训练期间消耗了数千petaflop/s-days的计算,而1.5B参数的GPT-2模型则为数十petaflop/s-days(图2.2)。

成本与效率的平衡

需要意识到

- 此类模型的成本和效率

- 正如SDSE19所倡导的

摊销视角

大规模预训练的使用也提供了另一个视角来看待大模型的效率------我们不仅应该考虑训练它们所需的资源,还应该考虑这些资源在模型的生命周期内如何摊销,模型随后将用于各种目的并针对特定任务进行微调。

训练后的效率

虽然GPT-3在训练期间消耗大量资源,但训练后可能**出奇地高效**,即使使用完整的GPT-3 175B,从训练好的模型生成100页内容的能源成本约为0.4 kW-hr,能源成本仅几美分。

进一步优化

-

模型蒸馏LHCG19a: 可以进一步降低此类模型的成本 - 采用训练单一大规模模型的范式 - 然后为在适当上下文中使用创建更高效的版本

-

算法进步: 随着时间推移,算法进步也可能自然地进一步提高此类模型的效率 - 类似于图像识别和神经机器翻译中观察到的趋势 HB20