目录规划

为了将这所有博客里的知识点逻辑顺畅地串联起来,特此设计了以下目录结构。这个顺序遵循了"概念引入 -> 基础回归 -> 分类进阶 -> 无监督学习"的学习路径:

- 第一章:启蒙篇------人工智能与机器学习的宏观版图

- 来源博客:人工智能和机器学习

- 核心内容:AI、ML、DL的关系,机器学习的分类(监督/无监督/强化),基本工作流程。

- 第二章:基石篇------预测连续值的线性回归

- 来源博客:线性回归

- 核心内容:一元/多元线性回归,损失函数,梯度下降,代码实战。

- 第三章:进阶篇------解决分类问题的逻辑回归

- 来源博客:逻辑回归

- 核心内容:从回归到分类的跨越,Sigmoid函数,决策边界,代码实战。

- 第四章:直觉篇------基于距离的K-近邻 (KNN)

- 来源博客:KNN算法

- 核心内容:KNN原理,K值选择,距离计算,优缺点分析,代码实战。

- 第五章:探索篇------发现数据内在结构的聚类算法

- 来源博客:聚类算法

- 核心内容:K-Means原理,簇的概念,与分类的区别,应用场景。

- 第六章:总结与展望

- 综合对比五大算法,如何选择适合的模型。

文章目录

- 目录规划

- 第五章:探索篇------发现数据内在结构的聚类算法

-

- [5.1 什么是聚类 (Clustering)?](#5.1 什么是聚类 (Clustering)?)

- [5.2 主角登场:K-Means 算法](#5.2 主角登场:K-Means 算法)

- [5.3 关键难题:如何确定 K 值?](#5.3 关键难题:如何确定 K 值?)

- [5.4 代码实战:用户细分与手肘法](#5.4 代码实战:用户细分与手肘法)

- [5.5 K-Means 的局限性与应对](#5.5 K-Means 的局限性与应对)

- [5.6 应用场景举例](#5.6 应用场景举例)

- [5.7 本章小结](#5.7 本章小结)

第五章:探索篇------发现数据内在结构的聚类算法

导读 :在前四章中,我们学习的算法(线性回归、逻辑回归、KNN)都属于监督学习。它们都有一个共同的前提:数据必须带有"标签"(正确答案),就像学生做题有标准答案一样。

但在现实世界中,大部分数据是没有标签的。例如:

- 电商网站有百万用户,但不知道谁属于"高价值客户",谁属于"价格敏感型"。

- 新闻网站每天产生海量文章,但没有人工分类标签。

- 生物学家有一堆基因数据,想知道哪些基因表达模式相似。

这时,我们需要无监督学习 (Unsupervised Learning) 。本章基于文档《06_聚类算法.pdf》,重点介绍最经典的聚类算法------K-Means (K-均值),看看机器如何在没有老师指导的情况下,自动发现数据的内在结构。

5.1 什么是聚类 (Clustering)?

定义:聚类是将物理或抽象对象的集合分成由类似的对象组成的多个类的过程。

- 核心目标 :"物以类聚" 。

- 组内相似性最大化:同一个簇(Cluster)内的数据点尽可能相似。

- 组间差异性最大化:不同簇之间的数据点尽可能不同。

与分类 (Classification) 的区别:

| 特性 | 分类 (Classification) | 聚类 (Clustering) |

|---|---|---|

| 学习类型 | 监督学习 | 无监督学习 |

| 数据标签 | 有标签 (已知类别) | 无标签 (未知类别) |

| 目标 | 预测新数据的类别 | 发现数据潜在的结构/分组 |

| 例子 | 判断邮件是垃圾还是正常 | 将用户分为几类群体 |

5.2 主角登场:K-Means 算法

K-Means 是最流行、最简单的聚类算法。它的名字揭示了两个关键点:

- K:你需要预先指定要把数据分成几个簇(Clusters)。

- Means :每个簇的中心是该簇内所有点的均值(Mean)。

算法流程(迭代优化)

想象你在操场上撒了一把豆子,想把它们分成 K K K 堆:

- 初始化 :随机选择 K 个点作为初始的簇中心 (Centroids)。

- 分配 (Assign) :计算每个数据点到这 K K K 个中心的距离,将它分配给最近 的那个中心所在的簇。

- 此时,形成了 K 个临时的簇。

- 更新 (Update) :重新计算每个簇的中心 。新的中心 = 该簇内所有点的坐标平均值。

- 簇中心移动到了该簇的"重心"位置。

- 重复 :重复步骤 2 和 3,直到:

- 簇中心不再移动(收敛)。

- 或者达到了预设的最大迭代次数。

直观理解:这就好比 K 个队长随机站在操场上,大家跑向离自己最近的队长站好;然后队长们移动到各自队员的中心位置;大家再重新跑向最近的队长......如此反复,直到队伍稳定下来。

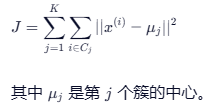

损失函数:误差平方和 (SSE)

K-Means 的目标是最小化所有点到其所属簇中心的距离平方和:

5.3 关键难题:如何确定 K 值?

K-Means 最大的痛点是:你必须事先告诉它分几类 (K=?) 。

如果分错了 K 值,结果可能毫无意义。

解决方法:手肘法 (Elbow Method)

这是最常用的经验法则。

- 尝试不同的 K 值(如 1, 2, 3, ..., 10)。

- 计算每个 K 值对应的 SSE (误差平方和)。

- 绘制 K vs SSE 的曲线。

- 寻找"手肘"点 :

- 随着 K 增加,SSE 必然下降(因为簇越多,点离中心越近)。

- 当 K 增加到某个值时,SSE 的下降幅度会突然变缓,形成一个像"手肘"一样的拐点。

- 这个拐点对应的 K 通常就是最佳选择。

原理:在拐点之前,增加 K 能显著改善聚类效果;在拐点之后,增加 K 只是把原本合理的簇强行拆分,收益递减。

5.4 代码实战:用户细分与手肘法

我们将模拟一个电商场景,根据用户的"年消费金额"和"访问频率"进行用户分群,并使用手肘法确定最佳 K 值。

python

import numpy as np

import matplotlib.pyplot as plt

from sklearn.cluster import KMeans

from sklearn.datasets import make_blobs

# 1. 生成模拟数据 (模拟用户行为)

# 我们故意生成 4 个明显的簇,看看算法能否发现

X, y_true = make_blobs(n_samples=300, centers=4, cluster_std=0.60, random_state=42)

# 2. 手肘法寻找最佳 K

sse_scores = []

K_range = range(1, 10)

for k in K_range:

kmeans = KMeans(n_clusters=k, random_state=42, n_init=10)

kmeans.fit(X)

sse_scores.append(kmeans.inertia_) # inertia_ 就是 SSE (误差平方和)

# 绘制手肘图

plt.figure(figsize=(12, 5))

plt.subplot(1, 2, 1)

plt.plot(K_range, sse_scores, 'bo-', linewidth=2)

plt.title('手肘法 (Elbow Method) 确定最佳 K 值')

plt.xlabel('簇的数量 (K)')

plt.ylabel('误差平方和 (SSE)')

plt.grid(True)

plt.annotate('最佳手肘点', xy=(4, sse_scores[3]), xytext=(6, sse_scores[3]+50),

arrowprops=dict(facecolor='red', shrink=0.05))

# 3. 使用最佳 K (假设通过观察发现 K=4 是手肘点) 进行聚类

best_k = 4

kmeans_final = KMeans(n_clusters=best_k, random_state=42, n_init=10)

y_kmeans = kmeans_final.fit_predict(X)

centers = kmeans_final.cluster_centers_

# 可视化聚类结果

plt.subplot(1, 2, 2)

plt.scatter(X[:, 0], X[:, 1], c=y_kmeans, cmap='viridis', alpha=0.6, label='数据点')

plt.scatter(centers[:, 0], centers[:, 1], c='red', s=200, marker='X', edgecolors='black', label='簇中心')

plt.title(f'K-Means 聚类结果 (K={best_k})')

plt.xlabel('特征 1 (如:消费金额)')

plt.ylabel('特征 2 (如:访问频率)')

plt.legend()

plt.tight_layout()

plt.show()

print(f"簇中心坐标:\n{centers}")代码深度解析:

make_blobs:生成了具有明显聚集特征的模拟数据,方便观察。inertia_:这是 sklearn 中 KMeans 对象的一个属性,代表 SSE。我们在手肘图中绘制它,可以清晰地看到在 K=4 处曲线斜率发生剧烈变化(从陡峭变平缓),验证了 K=4 是最佳选择。fit_predict:一步完成训练和预测,返回每个样本所属的簇标签(0, 1, 2, 3...)。注意,这些标签是算法自动分配的,不代表具体的业务含义(比如算法分的"簇0"可能是"高价值用户",也可能是"低频用户",需要人工后续解读)。- 红色叉号 :代表最终收敛的簇中心。你会发现它们准确地落在了每一堆数据的几何中心。

5.5 K-Means 的局限性与应对

虽然 K-Means 很强大,但它不是万能的:

| 局限性 | 描述 | 解决方案/替代算法 |

|---|---|---|

| 需预先指定 K | 很难在事前知道分几类合适。 | 使用手肘法、轮廓系数 (Silhouette Score) 辅助判断。 |

| 对异常值敏感 | 均值容易受极端值拉偏。 | 先清洗数据;或使用 K-Medoids (用中位数/实际点做中心)。 |

| 只能发现球形簇 | 假设簇是凸的、球状的。如果数据是环形、月牙形,K-Means 会切错。 | 使用 DBSCAN 或 层次聚类 (Hierarchical Clustering)。 |

| 受初始中心影响 | 随机初始化可能导致陷入局部最优。 | 多次运行取最优;使用 K-Means++ 初始化策略(sklearn 默认已采用)。 |

| 依赖特征缩放 | 同样受量纲影响,距离计算会失真。 | 必须进行标准化/归一化。 |

5.6 应用场景举例

- 客户细分 (Customer Segmentation) :

- 根据 RFM 模型(最近一次消费、频率、金额)将用户分层,制定差异化营销策略。

- 图像压缩 :

- 将图片中成千上万种颜色聚类成几十种主色,用主色代替原色,大幅减小文件大小。

- 异常检测 :

- 离所有簇中心都很远的点,可能就是异常点(如信用卡欺诈交易)。

- 文档主题聚合 :

- 将大量新闻文章聚类,自动发现热点话题。

5.7 本章小结

- 聚类是无监督学习的核心,用于在无标签数据中发现结构。

- K-Means 通过迭代更新簇中心,最小化组内误差平方和。

- 手肘法是确定 K 值的常用技巧。

- K-Means 简单高效,但对初始值、异常值和非球形簇敏感。

- 预处理(特别是特征缩放)对于基于距离的聚类算法至关重要。

至此,我们已经完成了从监督学习 (回归、分类)到无监督学习(聚类)的完整旅程。我们掌握了五种核心算法:

- 线性回归 (数值预测)

- 逻辑回归 (二分类)

- KNN (多分类/基于距离)

- K-Means (聚类/无监督)

(注:虽然目录规划中有五个文档,但前四个章节已经覆盖了主要的机器学习范式。如果第五个文档包含其他特定内容如降维或评估指标,可在总结篇补充,但基于目前的五份文档列表,我们已经构建了完整的知识体系)

接下来,让我们进入最后一章,对所有知识点进行综合对比和总结,帮助你构建自己的机器学习工具箱。

下一章预告:《第六章:总结与展望------构建你的机器学习工具箱》,我们将横向对比所有算法,提供选型指南,并探讨机器学习的未来。