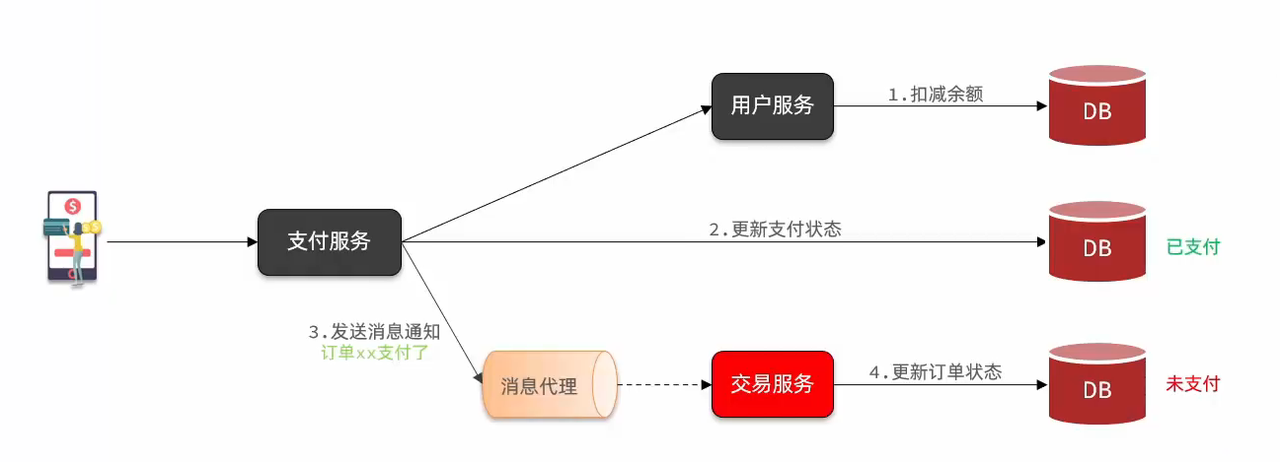

在分布式系统的异步通信架构中,RabbitMQ 承担着服务解耦、流量削峰、事件通知的核心职责,但消息从生产到消费的完整链路中,任何一个环节的异常都可能导致消息丢失、数据不一致,进而引发严重的业务故障。正如图示的电商支付核心业务场景:支付服务完成用户余额扣减、支付状态更新后,通过 RabbitMQ 发送「订单 xx 支付成功」的事件通知,驱动交易服务更新订单状态。一旦这条消息在投递、存储、消费的任意一环丢失,就会出现用户已实际扣款、支付状态已标记为已支付,但订单仍为未支付状态的资损级事故,这也是生产环境中消息中间件必须解决的核心问题。

RabbitMQ 的消息可靠性保障,需要覆盖消息流转的完整生命周期,我们将其拆解为三大核心维度,分别是:

-

发送者(生产者)端可靠性:保障消息 100% 从生产者成功投递到 RabbitMQ Broker;

-

MQ 服务端(Broker)可靠性:保障消息成功到达 Broker 后,不会因服务宕机、重启、节点故障等异常丢失;

-

消费者端可靠性:保障消息被消费者成功接收、业务逻辑正常执行,不会因消费异常、服务宕机导致消息丢失。

接下来的内容,我们将针对每个环节的故障场景,逐一拆解对应的根因分析、解决方案、配置实现与生产环境实践。

1.发送者的可靠性

生产者端可靠性的核心目标,是确保消息 100% 从生产者应用成功投递到 RabbitMQ Broker,杜绝因网络波动、连接异常、路由失败、Broker 故障等问题导致的消息无感知丢失,同时为异常场景提供可观测、可追溯、可兜底的处理能力,是分布式系统消息全链路可靠性的第一道核心防线。

1.1生产者重连

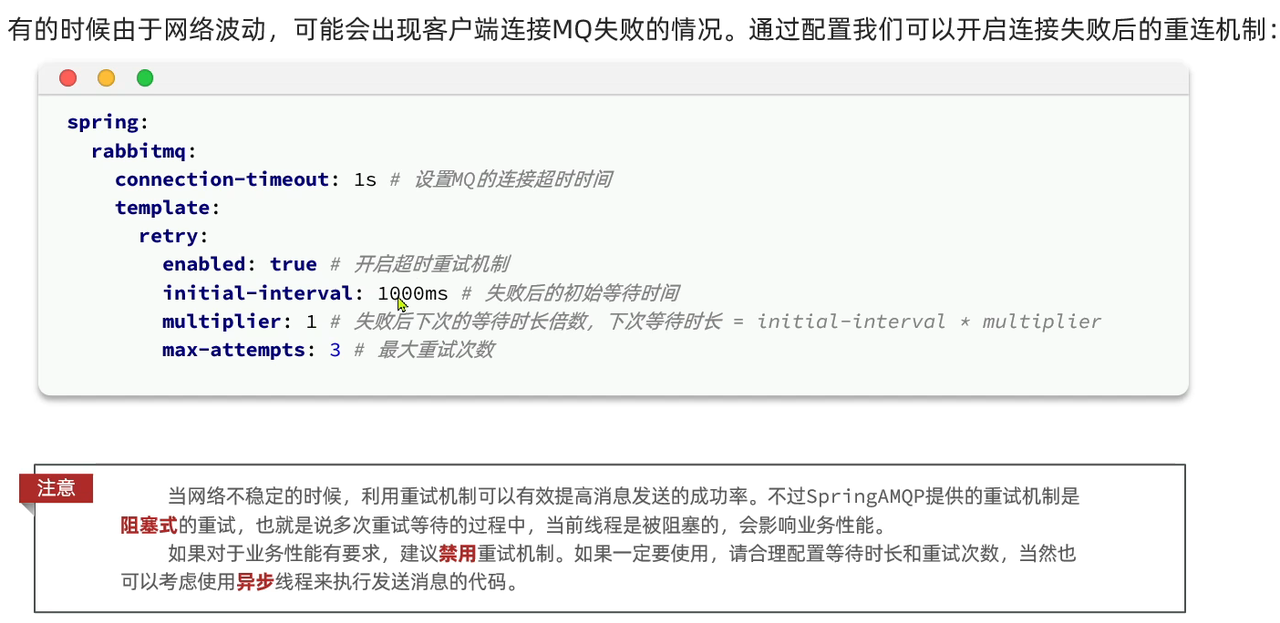

在分布式部署环境中,网络波动、Broker 节点临时重启、防火墙拦截、DNS 解析异常等场景,都会导致生产者客户端与 RabbitMQ Broker 的 TCP 连接建立失败,进而引发消息发送失败。

生产者重连机制,就是针对连接层面的临时异常,提供客户端本地的自动重试能力,无需业务代码手动处理,大幅提升临时异常场景下的消息发送成功率。

Spring AMQP 提供的该重试机制,是客户端本地的阻塞式重试:在多次重试等待的过程中,当前业务线程会被全程阻塞,直接影响接口响应时间与系统吞吐量,这是该机制最核心的限制。

基于此,我们给出生产环境的选型与优化建议:

-

适用场景:非核心业务链路、同步消息发送、对接口响应时间不敏感的低并发场景。

-

禁用场景:高并发核心链路、对接口 RT(响应时间)要求高的业务,阻塞重试会严重影响系统性能。

-

优化方案:

-

若必须使用,需合理配置参数:建议最大重试次数≤3,初始间隔≤1000ms,开启指数退避(multiplier≥2),减少对业务线程的阻塞影响;

-

高并发场景优先禁用同步重试,改用「异步线程池发送消息 + 异步重试」的方案,不阻塞业务主线程;

-

配合下文的生产者确认机制,仅在收到明确的 NACK 异常后,触发针对性的重试,而非无差别重试。

-

1.2生产者确认

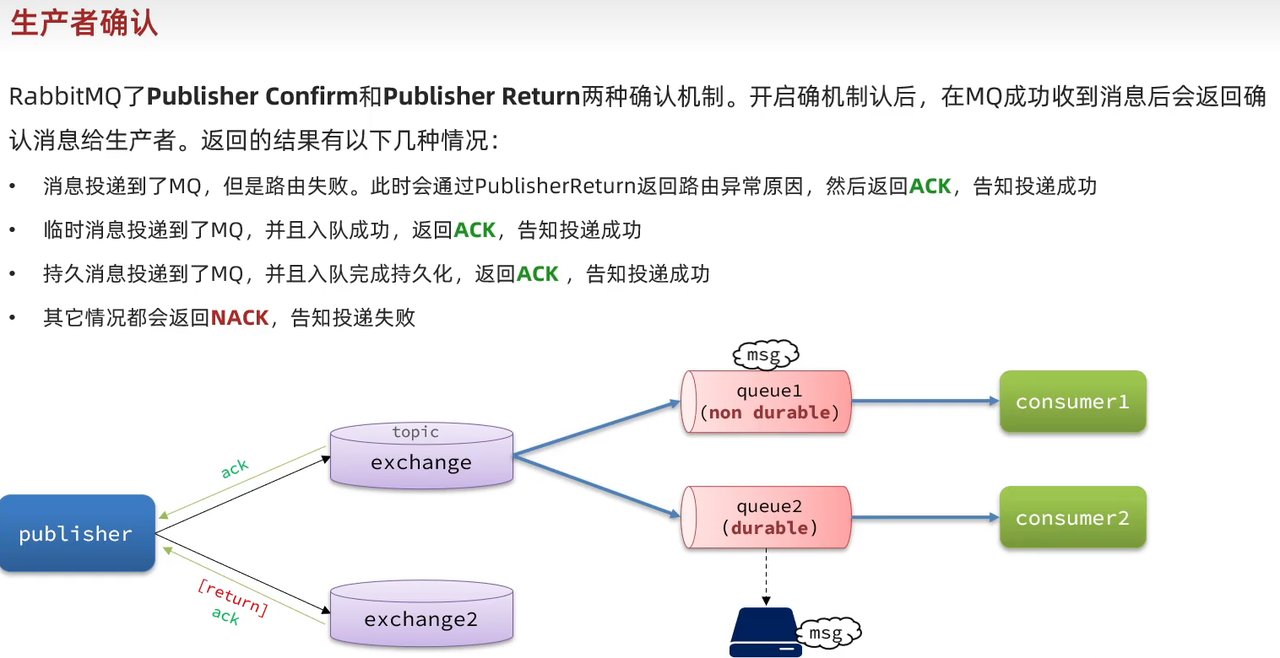

生产者重连仅能解决连接层面的临时异常,而消息发送后,生产者无法感知消息是否成功到达 Broker、是否成功路由入队导致的消息丢失,需要通过 RabbitMQ 提供的生产者确认机制解决,这是生产者端可靠性的核心保障。

RabbitMQ 提供了两套互补的确认机制,覆盖消息投递的完整链路:

-

Publisher Confirm(发布者确认):覆盖「生产者 → Broker Exchange」环节,确认消息是否成功到达交换机;

-

Publisher Return(发布者回退):覆盖「Exchange → 目标 Queue」环节,确认消息成功到达交换机后,是否成功路由到匹配的队列。

开启确认机制后,RabbitMQ 会在消息处理完成后,向生产者返回对应的回执结果,回执分为 ACK(确认成功)和 NACK(确认失败)两类,具体触发场景如下:

|----------------------------------------|---------------------------------|-----------------------------------------------|

| 投递场景 | 回执结果 | 补充说明 |

| 消息成功到达 Exchange,且成功路由到所有匹配队列 | ACK | 临时消息:入队内存后返回 ACK;持久化消息:入队并完成磁盘持久化后返回 ACK |

| 消息成功到达 Exchange,但路由失败(无匹配队列、队列不存在) | 先触发 Publisher Return 回调,再返回 ACK | 消息已成功到达 Broker,仅路由失败,不属于 Broker 接收失败,因此返回 ACK |

| 消息无法到达 Exchange(交换机不存在、权限不足、Broker 宕机) | NACK | 同时返回失败原因,可针对性处理 |

| Broker 内部异常、消息格式非法等其他错误 | NACK | 同时返回异常描述,便于问题排查 |

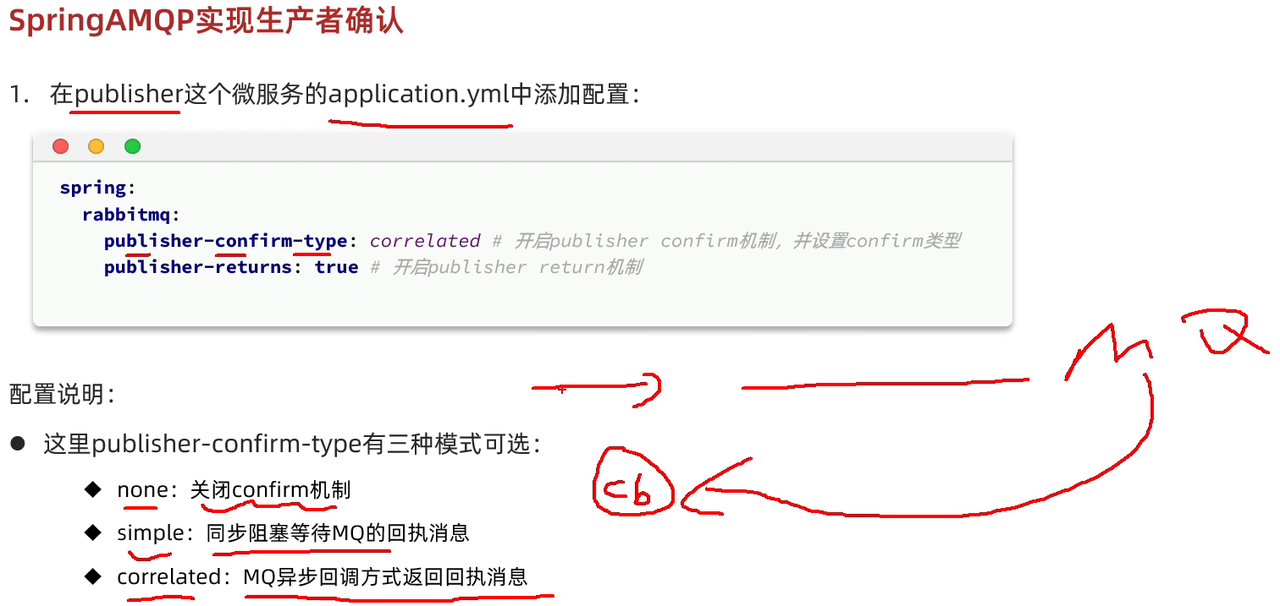

1.2.2 Spring AMQP 配置实现

bash

spring:

rabbitmq:

# 开启Publisher Confirm机制,设置确认类型,生产环境必须使用correlated模式

publisher-confirm-type: correlated

# 开启Publisher Return机制,默认false,生产环境建议开启,否则路由失败的消息会直接丢弃

publisher-returns: true其中publisher-confirm-type有三种可选模式,核心差异如下:

|------------|----------------------------------------------------|-----------------------------|

| 模式 | 核心逻辑 | 生产环境建议 |

| none | 关闭 Confirm 机制,消息发送后无任何回执 | 严禁使用,消息丢失完全无感知 |

| simple | 同步阻塞模式,发送消息后线程阻塞,等待 Broker 的 ACK 回执,超时则失败 | 仅适用于低并发、非核心场景,吞吐量极低 |

| correlated | 异步回调模式,发送消息后线程不阻塞,Broker 处理完成后通过异步回调通知 ACK/NACK 结果 | 强烈推荐,性能高,不影响业务主线程,支持消息全链路追踪 |

1.2.3全局 ReturnCallback 配置

java

package com.xxx.publisher.Config;

@Configuration

@Slf4j

public class MQConfirmConfig implements ApplicationContextAware {

@Override

public void setApplicationContext(ApplicationContext applicationContext) throws BeansException {

RabbitTemplate rabbitTemplate = applicationContext.getBean(RabbitTemplate.class);

//配置确认回调--确认消息是否到达交换机

rabbitTemplate.setConfirmCallback(new RabbitTemplate.ConfirmCallback() {

@Override

public void confirm(CorrelationData correlationData, boolean b, String s) {

log.debug("收到消息--回调:correlationData:{},ack:{},msg:{}", correlationData, b, s);

}

});

//配置失败回调--确认消息是否到达队列

rabbitTemplate.setReturnsCallback(returned -> {

log.debug("消息发送失败--回调:message={}, replyCode={}, replyText={}, exchange={}, routingKey={}",

returned.getMessage(),

returned.getReplyCode(),

returned.getReplyText(),

returned.getExchange(),

returned.getRoutingKey());

});

}

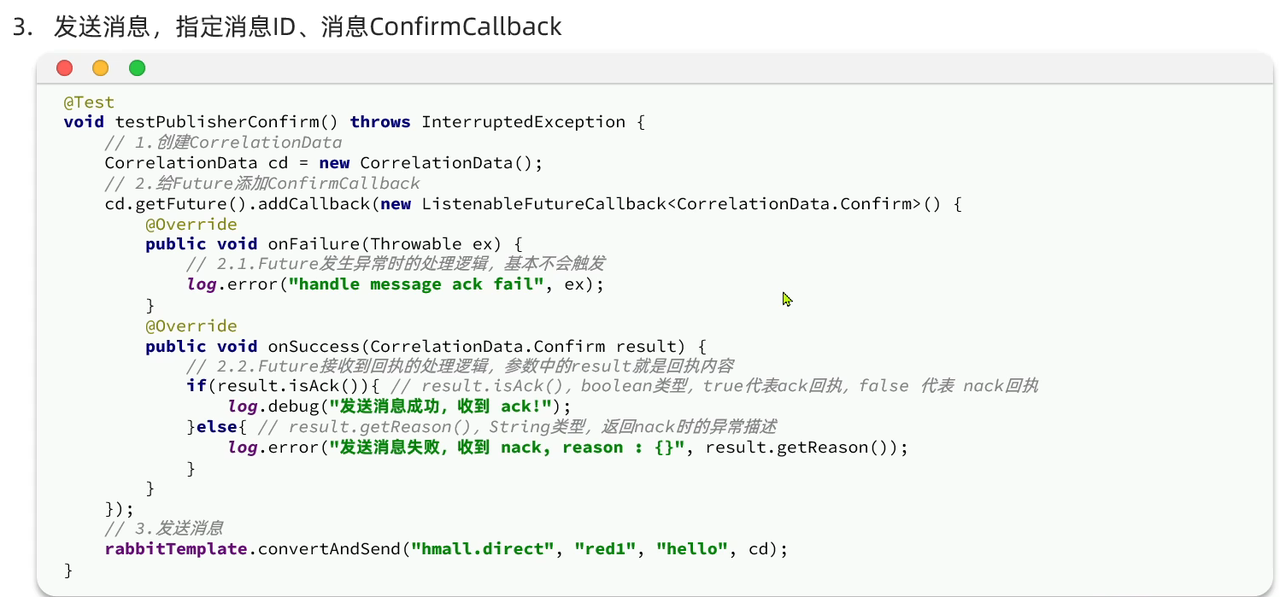

}1.2.4ConfirmCallback 配置与消息发送

通过CorrelationData对象,为每条消息绑定唯一标识与对应的 Confirm 回调,实现消息与回执的关联,完成消息发送与结果确认:

java

@Test

void testConfirmCallback() throws InterruptedException {

CorrelationData cd = new CorrelationData(UUID.randomUUID().toString());

cd.getFuture().addCallback(new ListenableFutureCallback<CorrelationData.Confirm>() {

/**

* Future发生系统级异常时触发,基本不会触发

*/

@Override

public void onFailure(Throwable ex) {

log.debug("发送失败:", ex);

}

/**

* 收到 Broker的ACK/NACK回执时触发

*/

@Override

public void onSuccess(CorrelationData.Confirm result) {

log.debug("收到回执");

if (result.isAck()) {

log.debug("消息发送成功");

} else {

log.error("消息发送失败,nack,原因:{}", result.getReason());

}

}

});

rabbitTemplate.convertAndSend("admin.direct","red2","hello,rabbitmq",cd);

Thread.sleep(5000);

}1.2.5实践建议

-

双机制必须同时开启:Confirm 机制保障消息到达交换机,Return 机制保障消息路由到队列,二者配合才能覆盖消息投递的全链路,缺一不可。

-

异常处理必须落地:禁止仅打印日志不做兜底处理,需针对 NACK 和 Return 场景设计完整的闭环方案:

-

路由失败(Return 回调):核心告警,优先排查交换机与队列的绑定关系、路由键规则,避免配置类问题;

-

投递失败(NACK 回执):触发有限次数的异步重试,重试失败则转入死信队列,同时触发告警通知。

-

-

消息全链路追踪 :

CorrelationData必须设置全局唯一的消息 ID,关联业务流水号,同时将消息 ID 打印到日志中,实现消息从生产到消费的全链路可追溯。 -

回调 逻辑轻量化:Confirm 和 Return 的回调中,禁止执行复杂业务逻辑、数据库操作、阻塞操作,避免回调线程池被占满,导致后续回执无法处理。

-

配合持久化机制:核心业务必须同时开启交换机持久化、队列持久化、消息持久化,持久化消息的 ACK 会在消息落盘后返回,最大程度避免 Broker 宕机导致的消息丢失。

-

幂等性保障:重试机制可能导致消息重复发送,生产者端需保证消息发送的幂等性,同时消费者端必须做幂等性校验,避免重复消费引发业务异常。

-

监控告警接入:针对 NACK、Return 回调的异常场景,必须接入监控系统,设置阈值告警,实时感知线上消息投递异常,避免故障扩大。

1.3 生产者端可靠性方案总结

生产者重连机制与生产者确认机制,是互补而非替代的关系:

-

生产者重连,是前置的、针对连接临时异常的被动重试保障,解决网络抖动等场景的连接问题;

-

生产者确认,是核心的、针对投递全链路的主动结果感知,解决消息是否成功到达 Broker、是否成功入队的确定性问题。

需将二者结合,同时配合「本地消息表、异步重试、死信队列、监控告警」等兜底方案,才能实现生产者端消息投递可靠性,从源头杜绝消息无感知丢失。

2.MQ的可靠性

MQ 服务端的可靠性,是消息全链路可靠性的核心基石 。其核心目标是确保消息在 RabbitMQ Broker 内部绝对不丢失,同时应对高并发、大流量、消费者异常等场景下的内存溢出与服务阻塞风险。

我们将从基础数据持久化 (防止 Broker 宕机丢失)和高级惰性队列(防止内存溢出与阻塞)两个维度,完整拆解 MQ 服务端的可靠性方案。

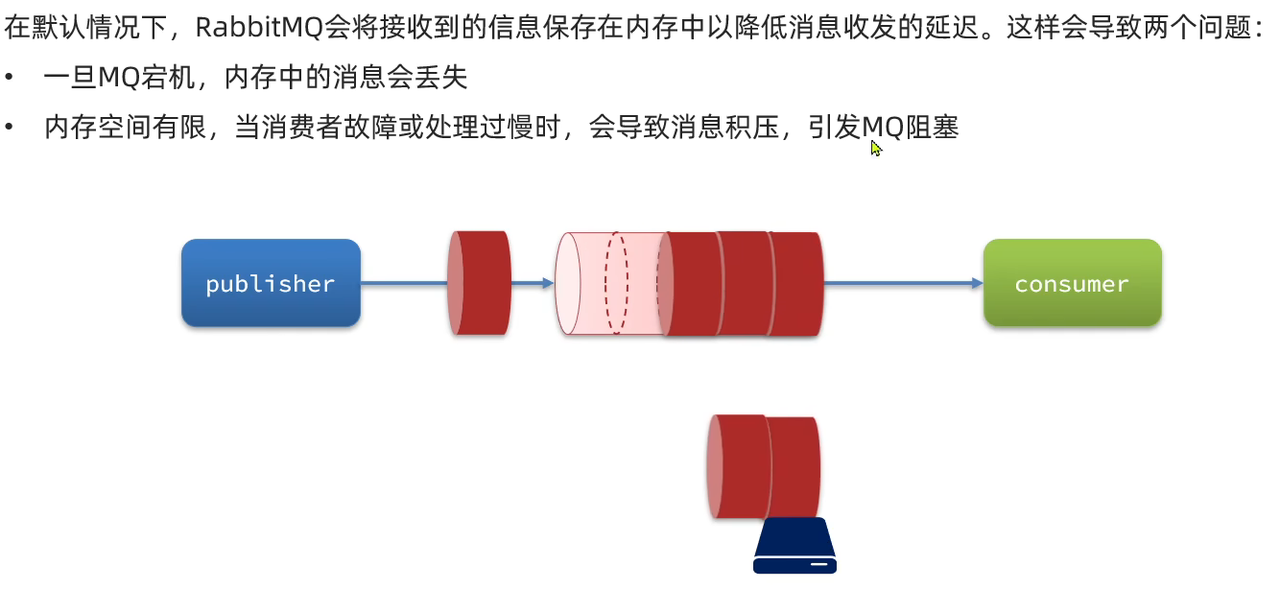

2.1数据持久化

默认情况下,RabbitMQ 将消息存储在内存中以降低读写延迟。一旦 MQ 服务宕机、重启或节点故障,内存中的所有未消费消息将瞬间丢失,这在支付、订单等核心业务中是不可接受的。

数据持久化 的目标就是:将消息、 交换机 、队列的元数据写入磁盘。即使 Broker 彻底宕机重启,所有声明的结构和存储的消息依然存在,实现 "断电不丢数"。

2.1.1 三级持久化机制

必须保证交换机 、队列、消息三者全部持久化,才能实现 100% 的 Broker 端可靠性,缺一不可。

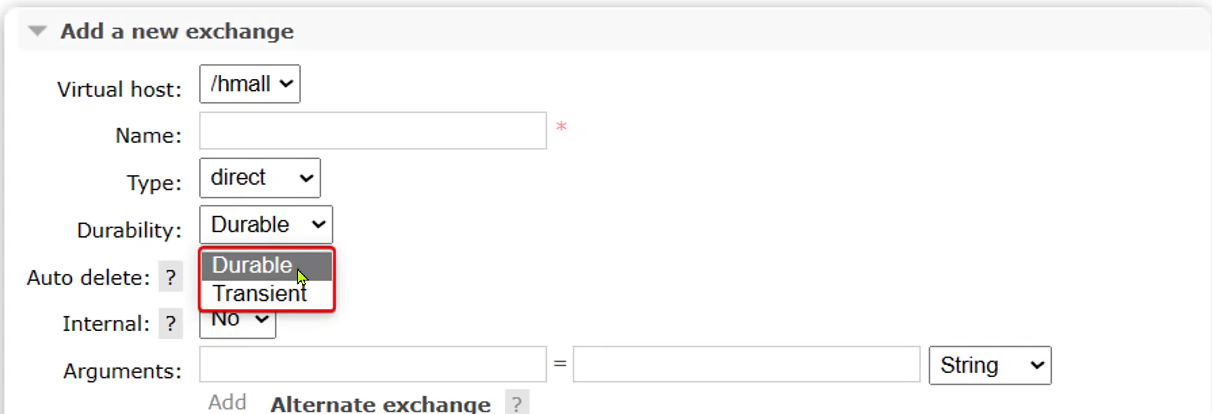

1.交换机持久化

交换机是消息的路由中枢,必须持久化才能保证重启后路由规则依然存在。

-

属性 :

Durable(持久化),默认开启。 -

配置方式:

-

控制台 :创建 Exchange 时,

Durability选择Durable(持久化),而非Transient(临时)。 -

代码 :使用

ExchangeBuilder.durableExchange()构建。

-

-

效果:Broker 重启后,交换机依然存在,路由规则不丢失。

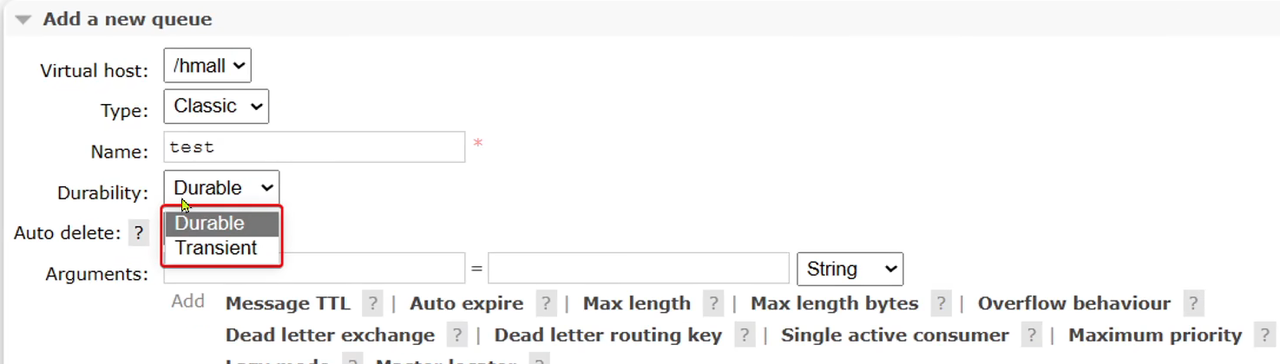

2.队列持久化

队列是消息的存储容器,必须持久化才能保证消息的存放地址存在。

-

属性 :

Durable(持久化),默认开启。 -

配置方式:

-

控制台 :创建 Queue 时,

Durability选择Durable。 -

代码 :使用

QueueBuilder.durable()构建。

-

-

效果:Broker 重启后,队列依然存在,等待消息恢复。

上述两种spring默认为持久化

3.消息持久化

这是最容易出错的一环。队列和 交换机 持久化只能保证结构不丢,只有消息标记为持久化,才能保证数据本体不丢。

-

原理:

-

临时消息(Transient):消息仅存内存,重启丢失。

-

持久化消息(Persistent):消息发布时同时写入磁盘,Broker 收到消息先写磁盘再入队。

-

-

配置方式:

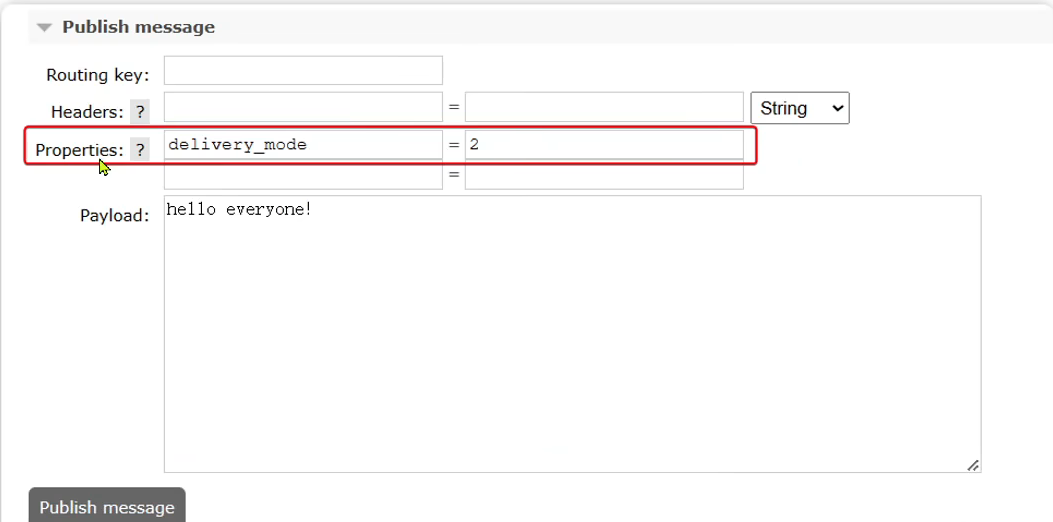

-

控制台 :发布消息时,设置 Properties 参数:

delivery_mode = 2(代表持久化)。 -

代码 :Spring AMQP 中,默认情况下发送的对象 / 字符串消息会自动标记为持久化;若需精确控制,可通过

MessagePostProcessor设置MessageDeliveryMode.PERSISTENT。

-

2.1.2 持久化的代价与注意事项

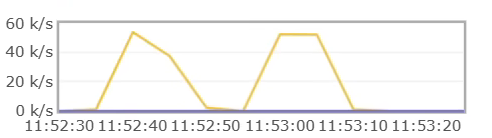

消息非持久化

消息持久化

两者的对比发现,消息非持久化 就会出现吞吐峰值,然后吞吐量跌为低位,处理内存数据到磁盘,然后继续接收消息;而消息持久化不会突然出现强堵塞,但是吞吐量似乎不是很好,因此后续还有更好的惰性队列。

-

性能损耗:磁盘 IO 速度远慢于内存,开启持久化会降低消息发送吞吐量。

-

组合失效陷阱:

-

交换机 持久化 + 队列非持久化:MQ 重启后,交换机还在,但队列没了,消息依然丢失。

-

交换机 / 队列持久化 + 消息非持久化:MQ 重启后,结构在,但消息体没了。

-

最佳实践:三者必须同时开启持久化。

-

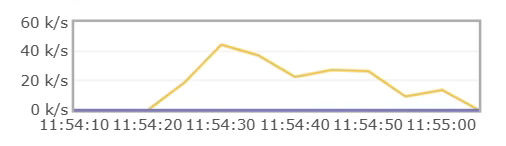

2.2LazyQueue

2.2.1 产生背景与核心痛点

虽然开启了持久化,但传统的 RabbitMQ 存储模式依然遵循 " 内存 为主,磁盘为辅" 的策略:

-

内存 溢出风险:所有消息优先存内存,当消息量巨大(如百万级)或消费者处理过慢导致消息大量堆积时,Broker 内存会瞬间爆满,导致 OOM(内存溢出)或服务被系统强制杀掉。

-

阻塞风险:内存放不下时,RabbitMQ 会进行 Page Out(换页到磁盘),这会导致严重的读写性能下降甚至系统阻塞。

2.2.2 惰性队列(Lazy Queue)核心定义

从 RabbitMQ 3.6.0 版本引入,3.12 版本后成为默认甚至唯一模式。

核心思想 :把磁盘当成主力存储, 内存 当成辅助缓存。

-

生产者发来的消息,直接写入磁盘,而不是先写内存。

-

内存中只保留索引和最近最少使用(LRU)的少量热点消息(默认保留最近 2048 条)。

-

消费者拉取消息时,主动从磁盘读取并加载到内存。

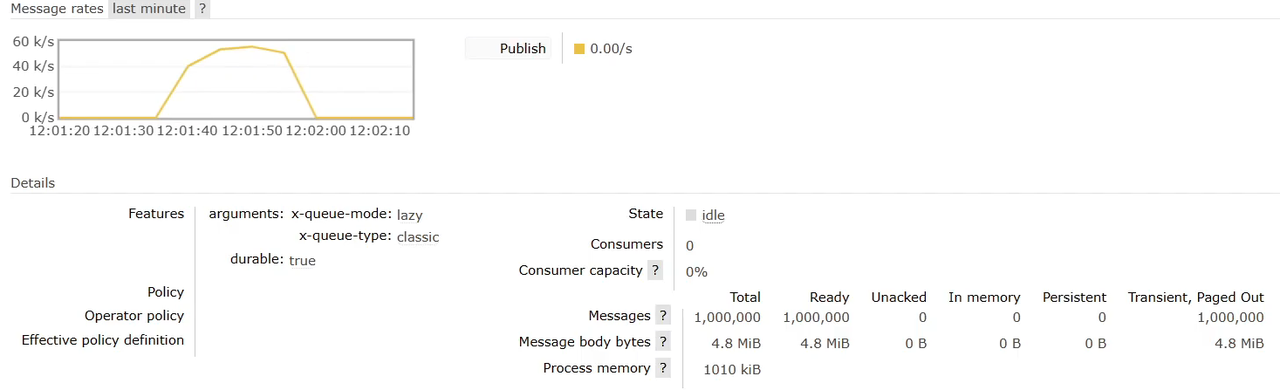

2.2.3 核心优势

-

极致抗压 :存储能力不受内存限制,支持数百万条甚至更多消息的持久化存储,不怕消息堆积压垮服务器。

-

内存 占用极低:消息常驻磁盘,内存仅存索引,In memory(内存占用)数值极低(对应图示中 In memory 为 0B)。

-

读写分离友好:消费时才加载,避免了无效消息占用内存。

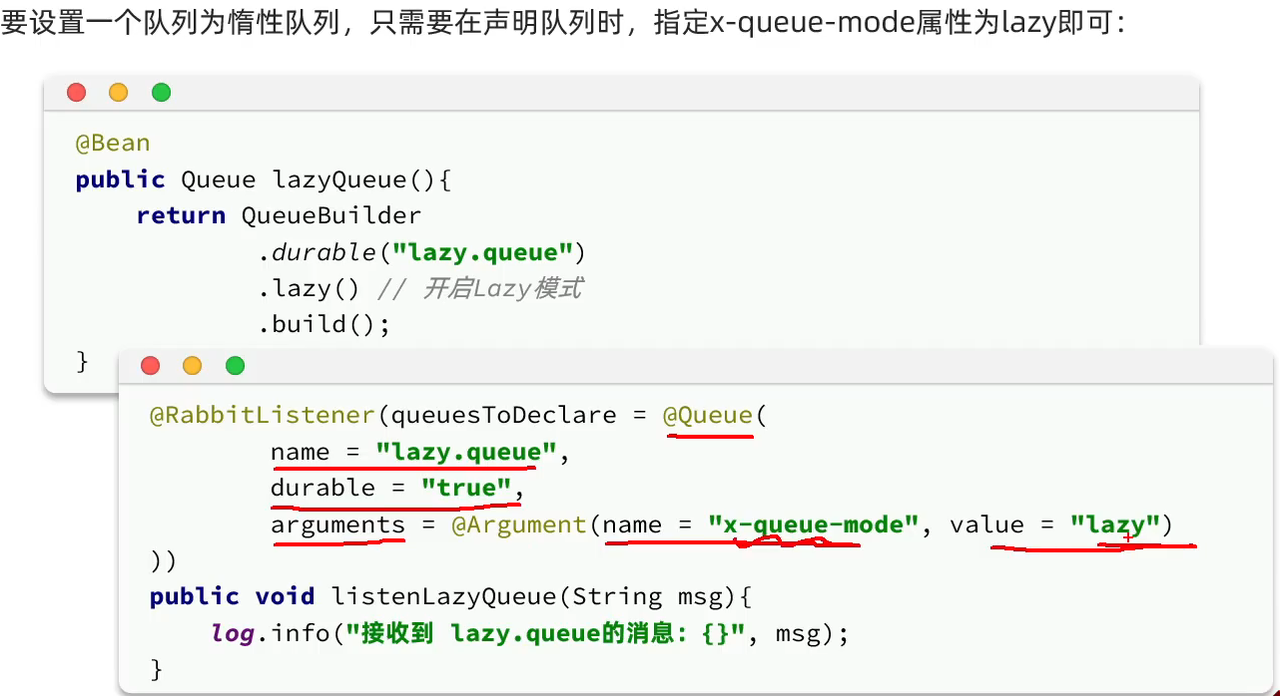

2.2.4 配置与声明方式

1.核心参数

声明队列时,添加扩展参数:x-queue-mode = lazy。

2.代码声明方式(Spring AMQP)

可以看到在惰性队列模式下,性能是比较高的。

3.消费者的可靠性

消费者端是消息全链路可靠性的最后一道防线 ,其核心目标是:确保消息从 RabbitMQ Broker 投递到消费者后,被正确处理,不丢失、不重复、不积压,同时解决消费异常、重复消费、跨服务业务数据不一致等核心生产问题。

我们将从四大核心维度,完整拆解消费者端可靠性的实现方案:

-

消费者确认机制( ACK ):从协议层面保证消息不丢失,只有业务处理完成才会从 Broker 删除消息;

-

消费失败处理策略:解决消费异常导致的无限重试、消息积压、服务阻塞问题,提供异常兜底方案;

-

业务幂等性保障:解决消息重复投递导致的业务数据异常,保证重复消费不改变业务状态;

-

最终一致性 兜底方案:极端场景下的业务数据对齐,确保跨服务状态最终一致。

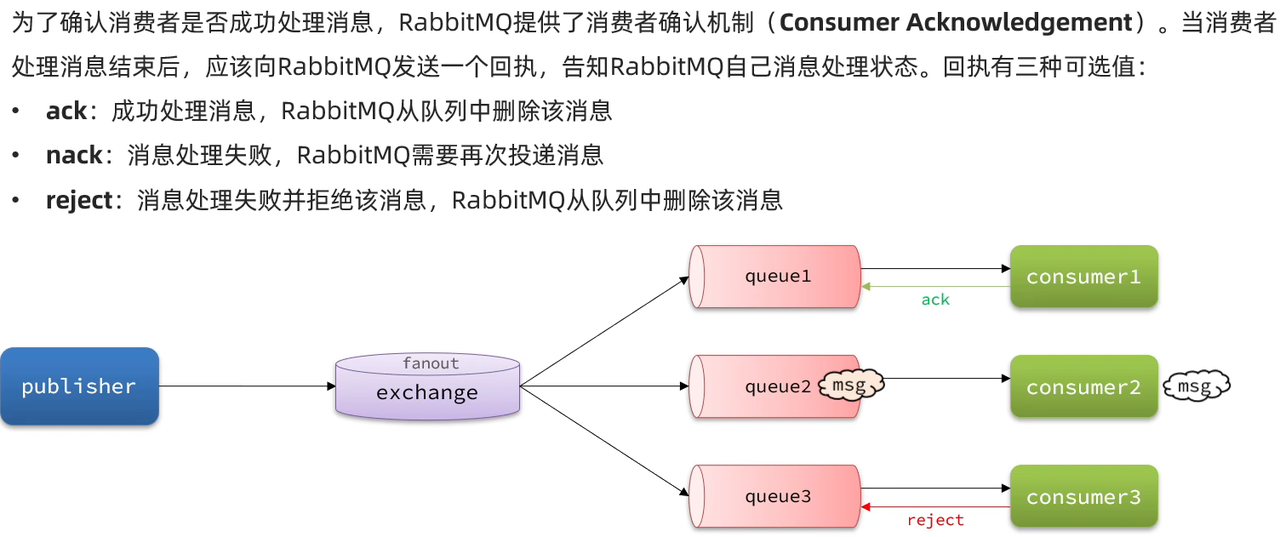

3.1消费者确认机制(Consumer Acknowledgement, ACK)

默认情况下,RabbitMQ 将消息投递给消费者后,会立刻从队列中删除该消息。如果消费者在处理消息的过程中发生服务宕机、业务异常、系统崩溃,这条消息就会永久丢失,在支付、订单等核心业务中会造成严重的资损事故。

消费者确认机制的核心逻辑是:消息投递后不会立刻删除,必须等待消费者返回处理结果的回执,Broker 才会根据回执类型决定是否删除消息、是否重新投递。

3.1.1三种回执类型与处理规则

RabbitMQ 定义了三种标准回执,对应不同的业务处理结果,Broker 会执行不同的处理逻辑:

|--------|----------------|--------------------------------|----------------------------------|

| 回执类型 | 核心含义 | Broker 处理逻辑 | 典型适用场景 |

| ack | 消息成功处理 | 立刻从队列中永久删除该消息 | 业务逻辑正常执行完成,无任何异常 |

| nack | 消息处理失败,申请重新投递 | 根据配置决定是否将消息重新入队,重新入队后会再次投递给消费者 | 临时异常(如数据库连接超时、网络波动),可通过重试解决的业务失败 |

| reject | 消息处理失败,拒绝接收该消息 | 直接从队列中删除消息(若配置了死信队列,则转入死信队列) | 消息格式非法、业务参数错误,重试也无法解决的永久性失败 |

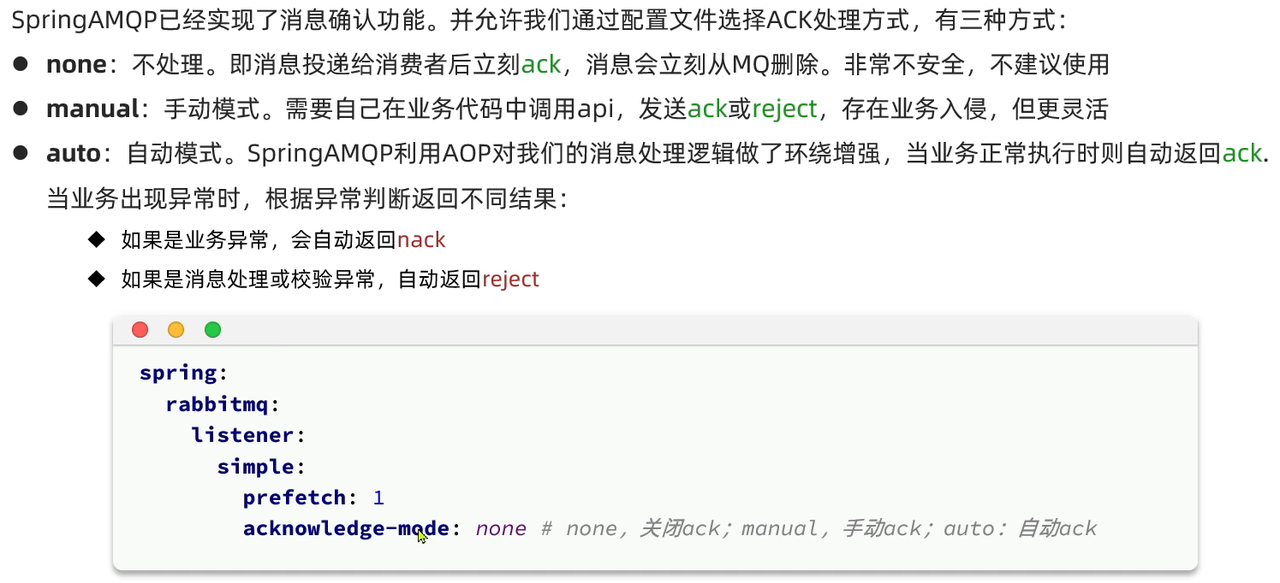

3.1.2Spring AMQP 三种 ACK 模式与配置

Spring AMQP 对原生 ACK 机制做了封装,提供了三种可配置的 ACK 模式,通过spring.rabbitmq.listener.simple.acknowledge-mode配置项控制,覆盖绝大多数业务场景。

三种模式详解

none:无确认模式(自动 ACK)

-

核心逻辑:消息投递给消费者后,立刻自动返回 ack,Broker 立刻删除消息。

-

风险:消费者处理过程中宕机、异常,消息会永久丢失,完全无保障。

-

生产环境建议 :严禁使用,仅适用于完全不关心消息丢失的非核心场景。

auto:自动确认模式(默认推荐)

-

核心逻辑:Spring AMQP 通过 AOP 对消费逻辑做环绕增强,根据业务执行结果自动返回对应回执,无需手动编写 ACK 代码。

-

自动回执规则:

-

业务方法正常执行完成,无任何异常 → 自动返回ack,Broker 删除消息;

-

抛出业务异常(如空指针、业务校验失败)→ 自动返回nack,消息重新入队;

-

抛出消息处理 / 校验异常(如消息格式非法、反序列化失败)→ 自动返回reject,直接丢弃消息。

-

-

优势:无业务代码入侵,适配绝大多数常规业务场景,兼顾安全性与开发效率。

-

注意事项:需配合消费者本地重试机制使用,避免业务异常导致消息无限循环重试。

manual:手动确认模式(灵活)

-

核心逻辑:完全由开发者在业务代码中,通过 API 手动调用方法返回 ack/nack/reject,Spring 不会做任何自动处理。

-

适用场景:复杂业务逻辑(如多数据库事务、跨服务调用)、需要精细化控制回执时机的场景。

3.2消费失败处理

在 auto 模式下,业务异常会触发 nack,消息会重新入队并再次投递,形成无限循环重试,不仅会占用大量 Broker 和消费者的 CPU、内存资源,还会打满日志,甚至导致服务阻塞。

Spring AMQP 提供了完整的消费失败处理方案,分为本地有限重试 和重试耗尽兜底策略两个环节。

3.2.1 消费者本地重试配置

开启本地重试后,业务异常会先在消费者本地进行有限次数的重试,而非直接返回 nack 重新入队,避免无限循环。

完整配置

bash

spring:

rabbitmq:

listener:

simple:

prefetch: 1

acknowledge-mode: auto

retry:

enabled: true # 开启消费者本地重试

max-attempts: 3 # 最大重试次数(含首次调用)

initial-interval: 1000ms # 首次重试的等待间隔

multiplier: 2 # 重试间隔倍数,实现指数退避(1s → 2s → 4s)

max-interval: 10000ms # 最大重试间隔

stateless: true # 无状态模式,默认true核心规则

-

重试仅在消费者本地执行,不会向 Broker 发送任何回执,Broker 不会感知到重试过程;

-

重试次数耗尽后,若业务依然失败,会调用

MessageRecoverer接口执行兜底处理; -

重试仅对业务异常生效,消息格式、反序列化等非业务异常不会触发重试,直接 reject。

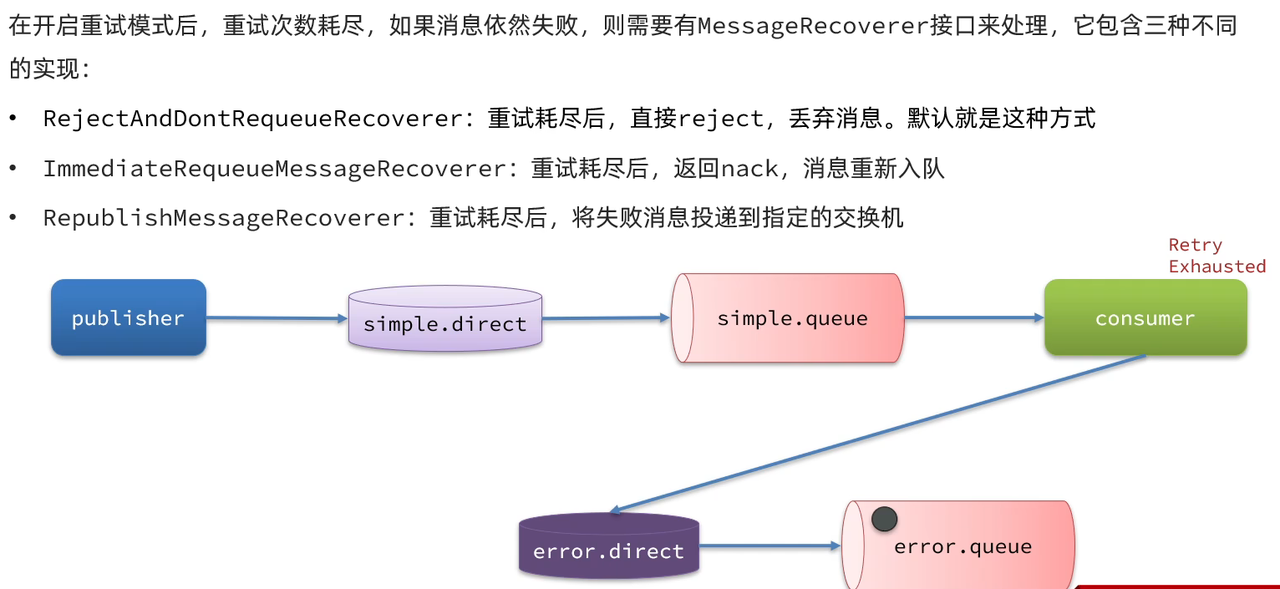

3.2.2 重试耗尽的兜底策略(MessageRecoverer)

当本地重试次数耗尽,消息依然处理失败时,Spring AMQP 会通过MessageRecoverer接口处理失败消息,提供了三种内置实现,覆盖不同业务场景:

|----------------------------------|---------------------------------------------------------------|-------------------------|----------------------------------|

| 实现类 | 核心逻辑 | 适用场景 | 生产环境建议 |

| RejectAndDontRequeueRecoverer | 重试耗尽后,直接返回 reject,丢弃消息 | 完全不重要的非核心业务,消息丢失无影响 | 不推荐,默认值,核心业务会丢消息 |

| ImmediateRequeueMessageRecoverer | 重试耗尽后,返回 nack,消息重新入队,无限循环重试 | 必须 100% 处理成功、无其他兜底方案的业务 | 不推荐,极易导致无限重试、服务阻塞 |

| RepublishMessageRecoverer | 重试耗尽后,将失败消息、异常信息完整转发到指定的「异常交换机 / 死信交换机」,存入异常队列,同时返回 ack 删除原消息 | 所有核心业务场景 | 强烈推荐,既不会无限重试,也不会丢失消息,支持人工排查与二次重试 |

3.2.3 推荐方案:RepublishMessageRecoverer 实现

该方案的核心思路是:将处理失败的消息转入独立的异常队列,避免影响正常业务的消费,同时保留完整的消息与异常信息,便于人工排查和手动重试。

步骤 1:声明异常交换机、队列与绑定关系

java

import org.springframework.amqp.core.*;

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

@Configuration

public class ErrorMessageConfig {

// 异常交换机

@Bean

public DirectExchange errorExchange() {

return ExchangeBuilder.directExchange("error.direct").durable(true).build();

}

// 异常消息队列

@Bean

public Queue errorQueue() {

return QueueBuilder.durable("error.queue").build();

}

// 绑定异常队列到异常交换机

@Bean

public Binding bindErrorQueue(DirectExchange errorExchange, Queue errorQueue) {

return BindingBuilder.bind(errorQueue).to(errorExchange).with("error");

}

}步骤 2:声明 RepublishMessageRecoverer Bean

java

import org.springframework.amqp.rabbit.core.RabbitTemplate;

import org.springframework.amqp.rabbit.retry.RepublishMessageRecoverer;

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

@Configuration

public class MessageRecovererConfig {

/**

* 重试耗尽后,将失败消息转发到异常交换机

* 参数:RabbitTemplate、异常交换机名称、路由键

*/

@Bean

public RepublishMessageRecoverer republishMessageRecoverer(RabbitTemplate rabbitTemplate) {

return new RepublishMessageRecoverer(rabbitTemplate, "error.direct", "error");

}

}3.3 业务幂等性保障

3.3.1 幂等性核心定义

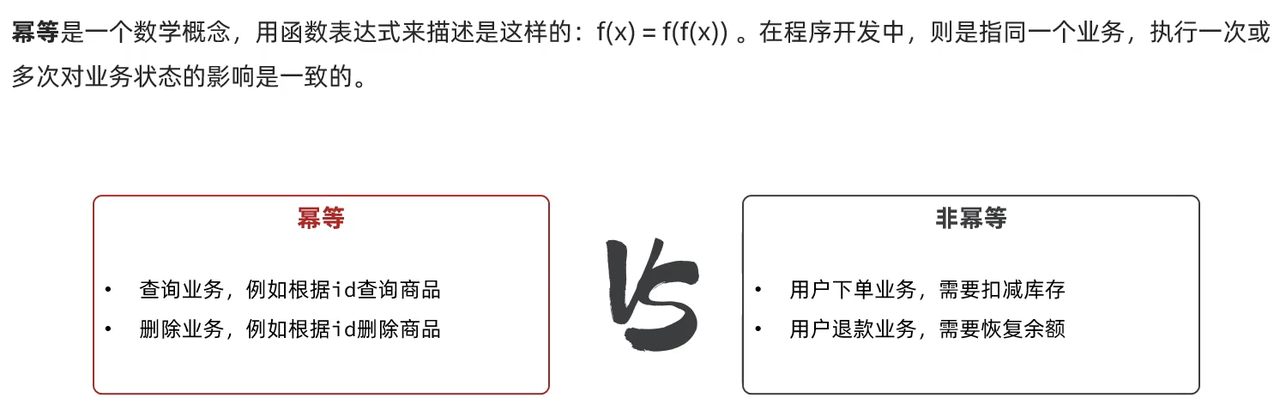

幂等性原本是数学概念,表达式为 f(x) = f(f(x)),在业务开发中,指同一条业务 指令 ,执行一次和执行多次,对业务状态的影响完全一致。

在 MQ 消费场景中,由于网络波动、重试机制、Broker 重启等原因,同一条消息可能会被重复投递多次,若消费逻辑不做幂等处理,会导致重复扣减库存、重复生成订单、重复发送短信等严重业务事故。

幂等与非幂等业务区分

|-----------------------|------------------------------------|

| 幂等业务 | 非幂等业务(必须做幂等处理) |

| 根据 ID 查询商品、根据 ID 删除数据 | 用户下单扣减库存、用户退款恢复余额、订单状态更新、短信 / 邮件发送 |

前置场景:接口层幂等设计(表单提交示例)

和 MQ 消费幂等的核心思路一致,接口层的重复提交也需要幂等处理,典型方案为Token 令牌池方案:

-

用户进入表单页面时,服务端生成全局唯一 Token,存入 Redis / 令牌池,同时将 Token 返回给前端;

-

前端提交表单时,必须携带该 Token;

-

服务端接收到请求后,先判断 Token 是否存在于池中:

-

存在:执行业务逻辑,执行完成后从池中删除该 Token;

-

不存在:判定为重复提交,直接拒绝请求;

-

-

该方案保证同一份表单只会被处理一次,彻底解决重复提交问题。

3.3.2 MQ 消费主流幂等方案

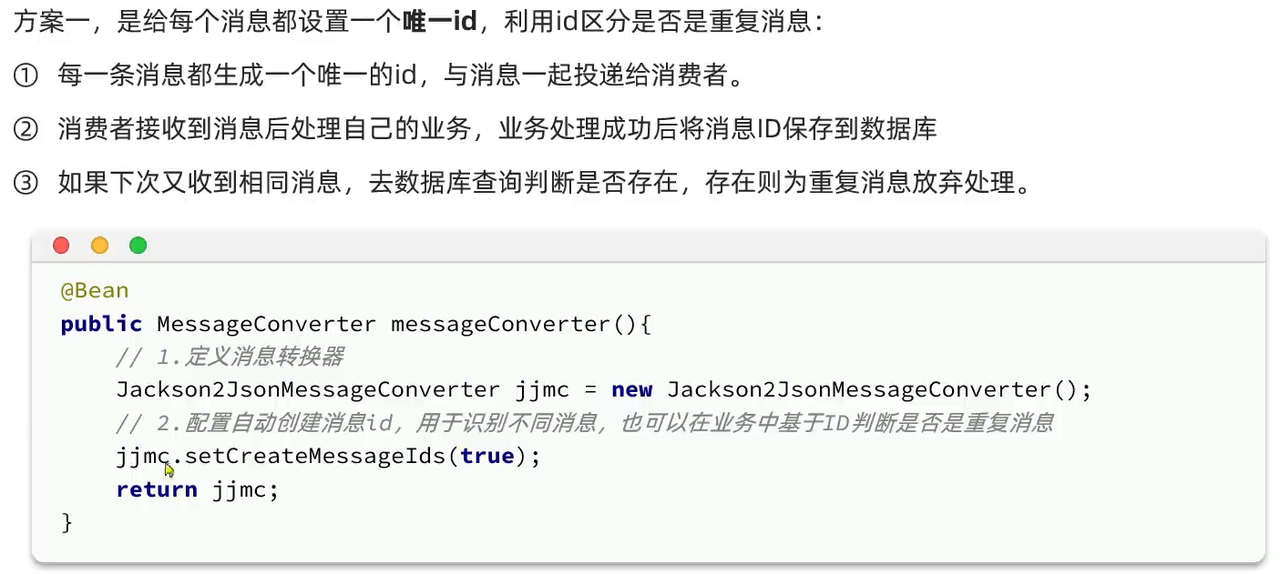

方案一:全局唯一消息 ID + 去重表(通用解耦方案)

这是最通用、和业务解耦的幂等方案,适用于绝大多数 MQ 消费场景。

核心原理

给每条消息生成全局唯一 ID,消费前先通过该 ID 判断消息是否已经被处理过:已处理则直接 ack 跳过,未处理则执行业务,处理完成后记录该 ID,实现去重。

实现步骤

1.消息 ID 生成与传递

生产者发送消息时,为消息绑定全局唯一 ID,Spring AMQP 提供了开箱即用的支持:

java

@Configuration

public class MessageConverterConfig {

@Bean

public MessageConverter jackson2JsonMessageConverter() {

Jackson2JsonMessageConverter converter = new Jackson2JsonMessageConverter();

// 自动为每条消息生成全局唯一messageId,用于幂等去重

converter.setCreateMessageIds(true);

return converter;

}

}其中消息id是UUID生成的,若需要自定义 ID 生成规则(如雪花算法、业务 ID 拼接),可通过MessagePostProcessor重写消息 ID:

java

// 发送消息时,自定义消息ID

CorrelationData correlationData = new CorrelationData(UUID.randomUUID().toString());

rabbitTemplate.convertAndSend("order.direct", "order.pay", message, new MessagePostProcessor() {

@Override

public Message postProcessMessage(Message message) throws AmqpException {

// 自定义雪花算法生成消息ID

message.getMessageProperties().setMessageId(snowFlake.nextId().toString());

return message;

}

}, correlationData);2.消费者端幂等处理

java

import lombok.extern.slf4j.Slf4j;

import org.springframework.amqp.rabbit.annotation.RabbitListener;

import org.springframework.amqp.support.AmqpHeaders;

import org.springframework.data.redis.core.StringRedisTemplate;

import org.springframework.messaging.handler.annotation.Header;

import org.springframework.stereotype.Component;

import javax.annotation.Resource;

import java.util.concurrent.TimeUnit;

@Slf4j

@Component

public class IdempotentConsumer {

@Resource

private StringRedisTemplate stringRedisTemplate;

// 消息去重key前缀

private static final String MESSAGE_ID_PREFIX = "mq:message:processed:";

@RabbitListener(queues = "order.pay.queue")

public void listenOrderPay(String message, @Header(AmqpHeaders.MESSAGE_ID) String messageId) {

// 1. 构建去重key

String redisKey = MESSAGE_ID_PREFIX + messageId;

// 2. SETNX命令:key不存在则设置,返回true;存在则返回false

Boolean isFirstProcess = stringRedisTemplate.opsForValue()

.setIfAbsent(redisKey, "1", 24, TimeUnit.HOURS); // 设置24小时过期,避免key无限堆积

if (Boolean.FALSE.equals(isFirstProcess)) {

// 3. 消息已处理过,直接ack跳过

log.warn("重复消息,直接跳过,messageId:{}", messageId);

return;

}

// 4. 首次处理,执行业务逻辑

try {

log.info("处理订单支付消息:{}", message);

// 业务处理完成

} catch (Exception e) {

// 5. 业务处理失败,删除去重key,下次重试可以重新处理

stringRedisTemplate.delete(redisKey);

throw e; // 抛出异常,触发重试

}

}

}方案优缺点

-

优点:通用型强,和业务完全解耦,开发成本低,适配所有消费场景;

-

缺点:需要依赖 Redis / 数据库做去重存储,有轻微的性能损耗。

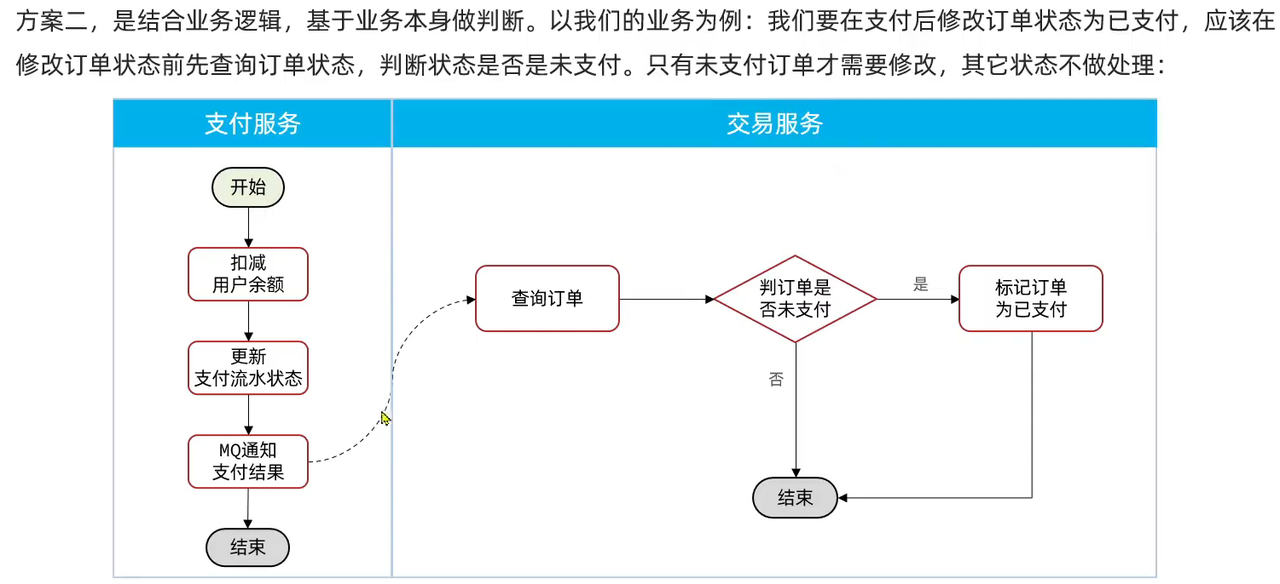

方案二:业务状态机校验(天然幂等方案)

基于业务本身的状态流转约束实现幂等,无需额外的去重存储,性能最高,适用于有明确状态流转的核心业务。

核心原理

在执行业务操作前,先查询业务当前状态,只有状态符合预期时才执行操作,否则直接跳过。典型场景为订单支付状态更新,对应图示的业务流程。

实现示例(订单状态更新)

java

import lombok.extern.slf4j.Slf4j;

import org.springframework.amqp.rabbit.annotation.RabbitListener;

import org.springframework.stereotype.Component;

import javax.annotation.Resource;

@Slf4j

@Component

public class OrderStatusConsumer {

@Resource

private OrderMapper orderMapper;

@RabbitListener(queues = "order.pay.queue")

public void updateOrderStatus(OrderPayMessage message) {

Long orderId = message.getOrderId();

// 1. 先查询订单当前状态

Order order = orderMapper.selectById(orderId);

// 2. 只有订单状态为「未支付」时,才更新为「已支付」

if (order == null || !order.getStatus().equals(OrderStatus.UNPAID)) {

// 订单不存在,或已支付,直接跳过

log.warn("订单无需处理,orderId:{},当前状态:{}", orderId, order.getStatus());

return;

}

// 3. 执行状态更新,通过SQL实现乐观锁,保证并发安全

int updateRows = orderMapper.updateStatusToPaid(orderId);

if (updateRows > 0) {

// 更新成功,执行业务后续逻辑

log.info("订单状态更新成功,orderId:{}", orderId);

}

}

}方案优缺点

-

优点:无额外存储依赖,性能最高,和业务深度绑定,安全性强;

-

缺点:通用性差,不同业务需要单独设计状态校验规则,仅适用于有明确状态流转的场景。

补充方案:分布式锁

对于高并发、无明确状态流转的业务,可采用 Redis 分布式锁实现幂等:以消息 ID 为锁 key,只有拿到锁的消费者才能执行业务,没拿到锁则直接跳过,避免并发场景下的重复处理。

3.4 最终一致性兜底方案

即使完成了上述所有可靠性保障,极端场景下(如 MQ 集群完全宕机、磁盘损坏)依然可能出现消息通知失败,导致跨服务业务状态不一致。

生产环境必须增加最终一致性 兜底方案 ,典型实现为定时任务对账补单:

-

在交易服务中设置定时任务,按固定周期(如每小时 / 每天)执行对账;

-

定时任务查询「支付流水表中状态为已支付,但订单表中状态为未支付」的异常订单;

-

对异常订单自动执行补单操作,更新订单状态为已支付,完成业务对齐;

-

对账完成后,对无法自动修复的异常订单触发告警,人工介入处理。

该方案作为最终兜底,确保即使 MQ 通知完全失效,业务数据也能实现最终一致。

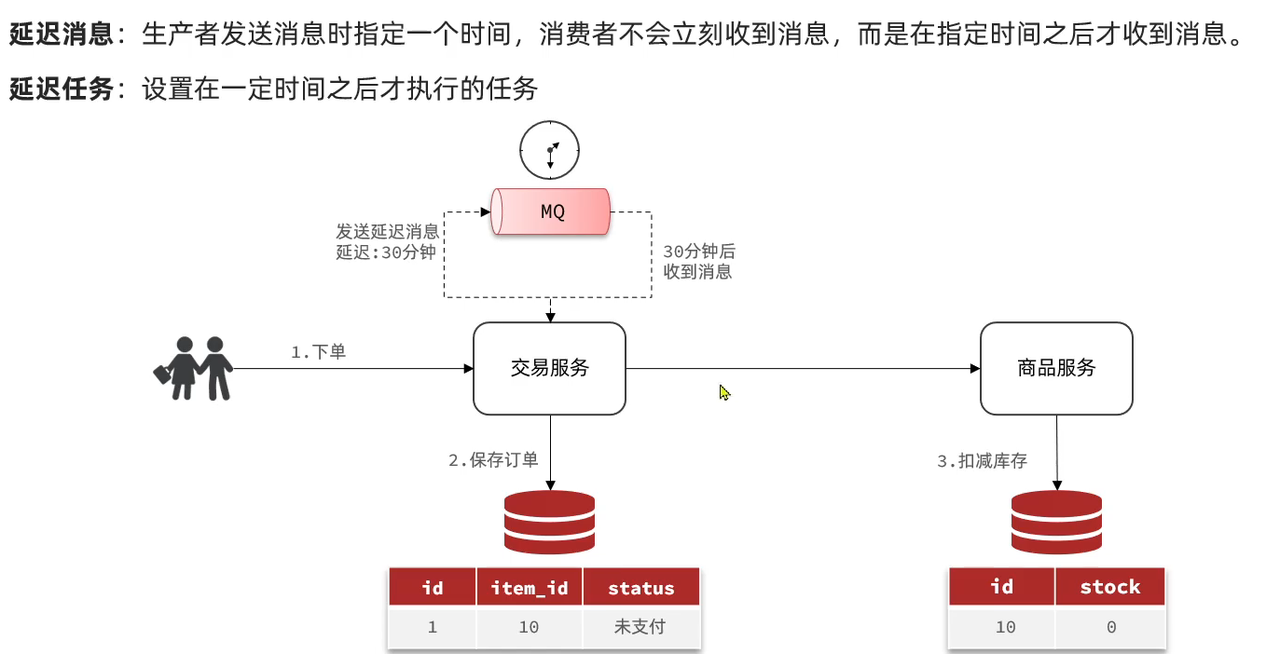

4.延迟消息

-

延迟消息:生产者发送消息时指定一个延迟时长,消费者不会立刻收到消息,仅在指定的延迟时间到期后,才会收到消息并执行业务处理。

-

延迟任务:基于延迟消息实现的、需要在指定时间之后执行的业务任务,典型场景包括电商超时订单自动取消、预约服务到期提醒、用户注册后 N 天未登录的召回推送、支付成功后延迟对账等。

延迟消息是 RabbitMQ 企业级开发中最常用的高级特性之一,核心价值是替代定时任务扫表的 轮询 方案,大幅降低数据库压力,同时提升业务实时性与服务器资源利用率。

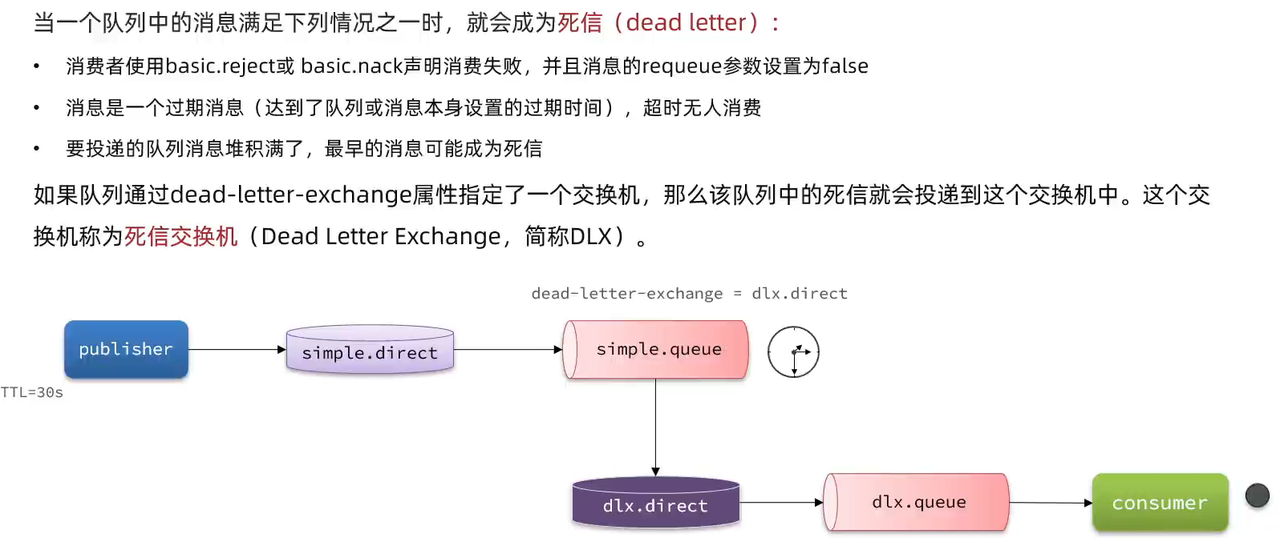

4.1基于死信交换机(DLX)的原生延迟消息实现

这是 RabbitMQ 无需额外插件、基于原生特性实现延迟消息的方案,核心依赖「TTL + 死信交换机」的组合能力。

4.1.1 死信与死信交换机核心定义

1. 死信(Dead Letter)的触发条件

当队列中的消息满足以下任意一个条件时,就会变为死信(Dead Letter):

-

消费者使用

basic.reject或basic.nack声明消费失败,且消息的requeue参数设置为false(不重新入队); -

消息达到了队列或消息本身设置的 TTL(过期时间),超时后仍未被消费;

-

消息投递的队列已满,达到最大消息长度 / 容量限制,最早的消息会被转为死信。

2. 死信交换机(DLX)

死信交换机(Dead Letter Exchange,简称 DLX),本质是一个普通交换机(常用 Direct 类型),它的特殊之处在于:我们可以给普通业务队列通过x-dead-letter-exchange属性指定一个死信交换机。当该队列中产生死信时,RabbitMQ 会自动将死信转发到这个指定的 DLX 中,再由 DLX 路由到绑定的死信队列,消费者监听死信队列即可实现延迟处理。

4.1.2基于 TTL+DLX 实现延迟消息的核心原理

-

创建一个无消费者的延迟队列,为队列绑定死信交换机 DLX,同时给发送到该队列的消息设置 TTL(延迟时长);

-

生产者将消息发送到这个延迟队列,因无消费者消费,消息会在队列中等待 TTL 到期,自动变为死信;

-

消息到期后,被自动转发到 DLX,再路由到绑定的死信队列;

-

消费者监听死信队列,收到消息即达到了预设的延迟效果。

4.1.3Spring AMQP 完整实现代码

步骤 1:声明死信交换机、延迟队列、死信队列

java

import org.springframework.amqp.core.*;

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

import java.util.HashMap;

import java.util.Map;

@Configuration

public class DlxDelayMessageConfig {

// 死信交换机名称

public static final String DLX_EXCHANGE = "order.dlx.exchange";

// 死信队列名称(消费者监听的业务队列)

public static final String DLX_QUEUE = "order.dlx.queue";

// 延迟队列名称(无消费者,用于暂存消息)

public static final String DELAY_QUEUE = "order.delay.queue";

// 死信路由键

public static final String DLX_ROUTING_KEY = "order.dlx";

/**

* 1. 声明死信交换机(普通Direct交换机)

*/

@Bean

public DirectExchange dlxExchange() {

return ExchangeBuilder.directExchange(DLX_EXCHANGE).durable(true).build();

}

/**

* 2. 声明死信队列,消费者监听此队列处理延迟任务

*/

@Bean

public Queue dlxQueue() {

return QueueBuilder.durable(DLX_QUEUE).build();

}

/**

* 3. 绑定死信队列到死信交换机

*/

@Bean

public Binding bindDlxQueue(DirectExchange dlxExchange, Queue dlxQueue) {

return BindingBuilder.bind(dlxQueue).to(dlxExchange).with(DLX_ROUTING_KEY);

}

/**

* 4. 声明延迟队列,核心配置:指定死信交换机与路由键

*/

@Bean

public Queue delayQueue() {

Map<String, Object> args = new HashMap<>();

// 核心:指定队列的死信交换机

args.put("x-dead-letter-exchange", DLX_EXCHANGE);

// 指定死信转发的路由键

args.put("x-dead-letter-routing-key", DLX_ROUTING_KEY);

// 也可给队列设置统一TTL,消息单独设置TTL优先级更高

// args.put("x-message-ttl", 30 * 60 * 1000);

return new Queue(DELAY_QUEUE, true, false, false, args);

}

}步骤 2:发送延迟消息

java

import org.springframework.amqp.core.Message;

import org.springframework.amqp.core.MessagePostProcessor;

import org.springframework.amqp.rabbit.core.RabbitTemplate;

import org.springframework.beans.factory.annotation.Autowired;

import org.springframework.stereotype.Component;

@Component

public class DlxDelayMessageProducer {

@Autowired

private RabbitTemplate rabbitTemplate;

/**

* 发送延迟消息

* @param orderId 订单ID

* @param delayTime 延迟时长,单位毫秒

*/

public void sendDelayMessage(Long orderId, long delayTime) {

String message = "order:" + orderId;

// 设置消息TTL过期时间

MessagePostProcessor messagePostProcessor = msg -> {

msg.getMessageProperties().setExpiration(String.valueOf(delayTime));

return msg;

};

// 发送到延迟队列

rabbitTemplate.convertAndSend(DlxDelayMessageConfig.DELAY_QUEUE, message, messagePostProcessor);

}

}步骤 3:消费者监听死信队列,处理延迟任务

java

import lombok.extern.slf4j.Slf4j;

import org.springframework.amqp.rabbit.annotation.RabbitListener;

import org.springframework.stereotype.Component;

@Slf4j

@Component

public class DlxDelayMessageConsumer {

@RabbitListener(queues = DlxDelayMessageConfig.DLX_QUEUE)

public void handleDelayMessage(String message) {

log.info("收到延迟消息,开始处理超时订单:{}", message);

// 执行订单取消、库存释放等业务逻辑

}

}4.1.4方案优缺点

|-----------------------------------|----------------------------------------------------------------------|

| 优点 | 缺点 |

| 基于 RabbitMQ 原生特性实现,无需安装任何插件,兼容性极强 | 存在队列头部阻塞问题:先发送 30 分钟延迟的消息,再发送 10 秒延迟的消息,10 秒的消息会被阻塞,必须等前一个消息到期后才会被处理 |

| 实现简单,运维成本低 | 延迟时长必须在发送消息时确定,无法动态修改 |

| 支持任意类型的交换机,灵活性高 | 大量延迟消息会占用队列资源,高并发场景下对 MQ 压力极大 |

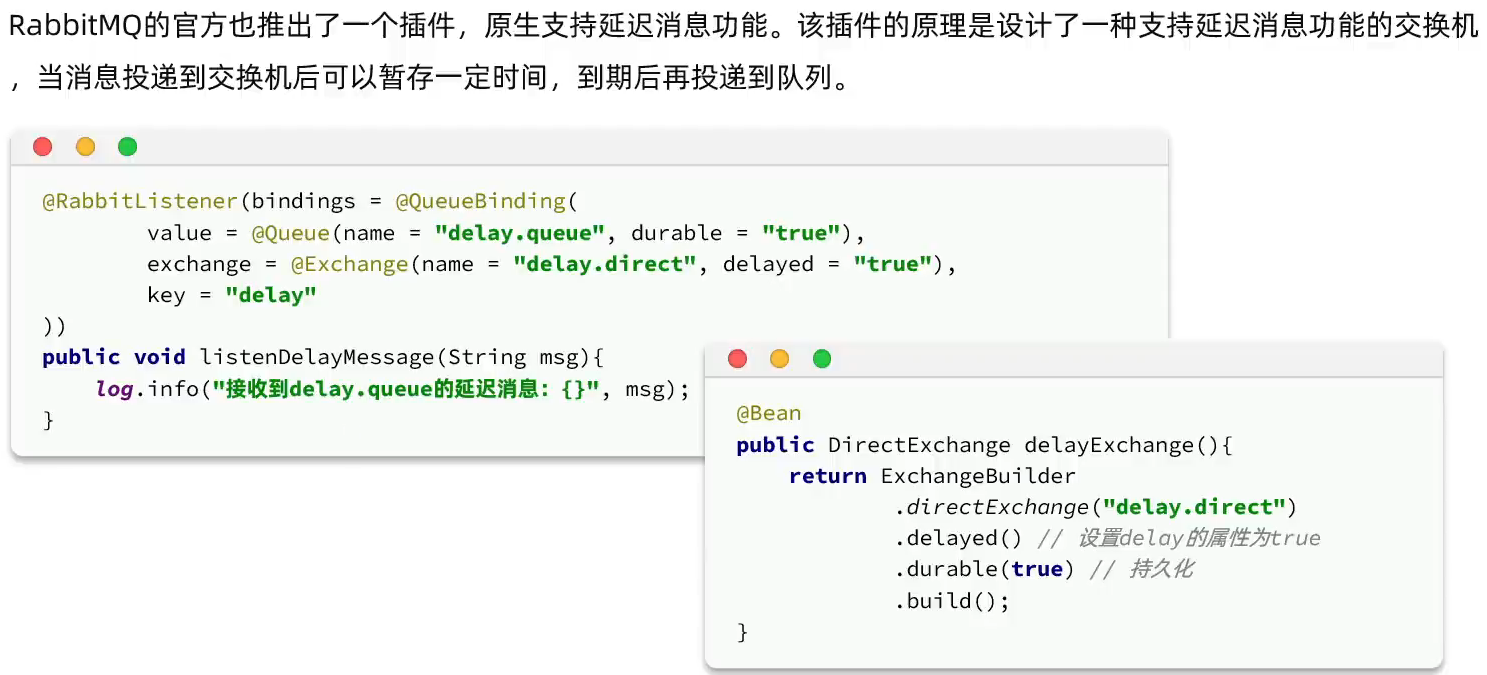

4.2 官方延迟消息插件(Delayed Message Exchange)

这是 RabbitMQ 官方推出的延迟消息解决方案,完美解决了 DLX 方案的队列头部阻塞问题,是目前生产环境的首选方案。

4.2.1 插件核心原理

该插件提供了一种自定义的x-delayed-message类型交换机,核心运行逻辑:

-

生产者发送消息时,通过消息头

x-delay指定延迟毫秒数; -

消息投递到该交换机后,不会立刻路由到队列,而是先持久化到磁盘;

-

交换机内部会定时扫描消息,当延迟时间到期后,再将消息路由到绑定的目标队列,投递给消费者。

4.2.2Spring AMQP 完整实现

步骤 1:声明延迟交换机与队列

提供两种声明方式,适配不同开发习惯。

方式一:@Bean 配置类声明(推荐,集中管理)

java

import org.springframework.amqp.core.*;

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

import java.util.HashMap;

import java.util.Map;

@Configuration

public class PluginDelayMessageConfig {

// 延迟交换机名称

public static final String DELAY_EXCHANGE = "delay.direct";

// 延迟队列名称

public static final String DELAY_QUEUE = "delay.queue";

// 路由键

public static final String DELAY_ROUTING_KEY = "delay";

/**

* 声明延迟交换机

* 核心:类型为x-delayed-message,开启延迟能力

*/

@Bean

public CustomExchange delayExchange() {

Map<String, Object> args = new HashMap<>();

// 指定交换机的底层路由类型为direct,也可使用topic/fanout

args.put("x-delayed-type", "direct");

// 核心:交换机类型为x-delayed-message

return new CustomExchange(DELAY_EXCHANGE, "x-delayed-message", true, false, args);

}

/**

* 声明延迟消费队列,开启持久化、惰性模式

*/

@Bean

public Queue delayQueue() {

return QueueBuilder

.durable(DELAY_QUEUE)

.lazy() // 大促场景开启惰性模式,避免消息堆积导致内存溢出

.build();

}

/**

* 绑定队列到延迟交换机

*/

@Bean

public Binding bindDelayQueue(CustomExchange delayExchange, Queue delayQueue) {

return BindingBuilder

.bind(delayQueue)

.to(delayExchange)

.with(DELAY_ROUTING_KEY)

.noargs();

}

}方式二:@RabbitListener 注解声明

java

import lombok.extern.slf4j.Slf4j;

import org.springframework.amqp.rabbit.annotation.Exchange;

import org.springframework.amqp.rabbit.annotation.Queue;

import org.springframework.amqp.rabbit.annotation.QueueBinding;

import org.springframework.amqp.rabbit.annotation.RabbitListener;

import org.springframework.stereotype.Component;

@Slf4j

@Component

public class AnnotationDelayConsumer {

@RabbitListener(bindings = @QueueBinding(

value = @Queue(name = "delay.queue", durable = "true"),

// 核心:delayed = "true" 声明为延迟交换机

exchange = @Exchange(name = "delay.direct", delayed = "true"),

key = "delay"

))

public void listenDelayMessage(String msg) {

log.info("接收到delay.queue的延迟消息:{}", msg);

}

}步骤 2:发送延迟消息

核心是通过setDelay()方法设置延迟时长,单位为毫秒。

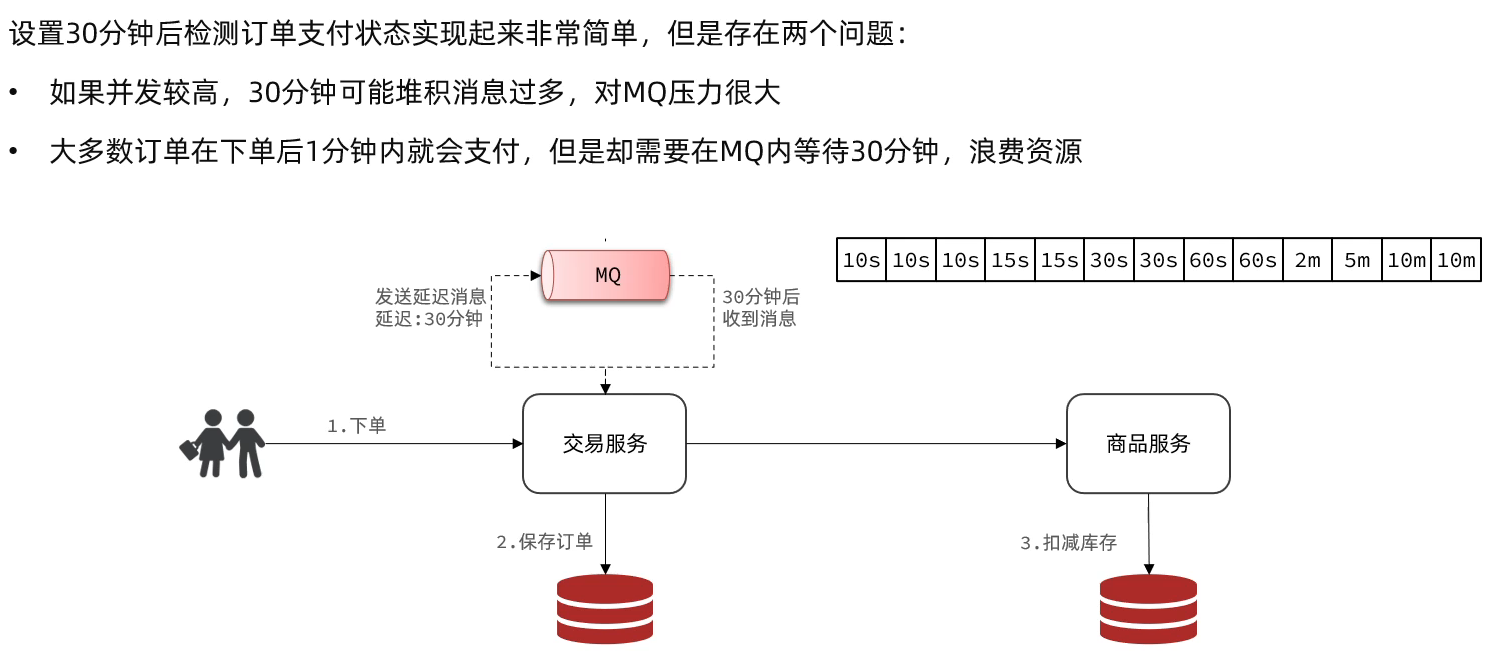

4.3实战场景:超时订单自动取消

这是延迟消息最经典的业务场景,也是电商系统的核心刚需。

4.3.1 业务需求与背景

电商场景中,用户下单后会锁定商品库存,同时获得 30 分钟的支付窗口期。如果用户在 30 分钟内未完成支付,系统需要自动取消订单、释放锁定的库存,避免库存被无效占用,影响商品正常售卖。

4.3.2 传统方案的核心痛点

方案一:定时任务扫表

-

实现:通过定时任务每分钟扫描数据库中「待支付且超时」的订单,批量取消。

-

痛点:实时性差、数据库压力极大、大量无效扫表操作,大促场景下会拖垮核心数据库。

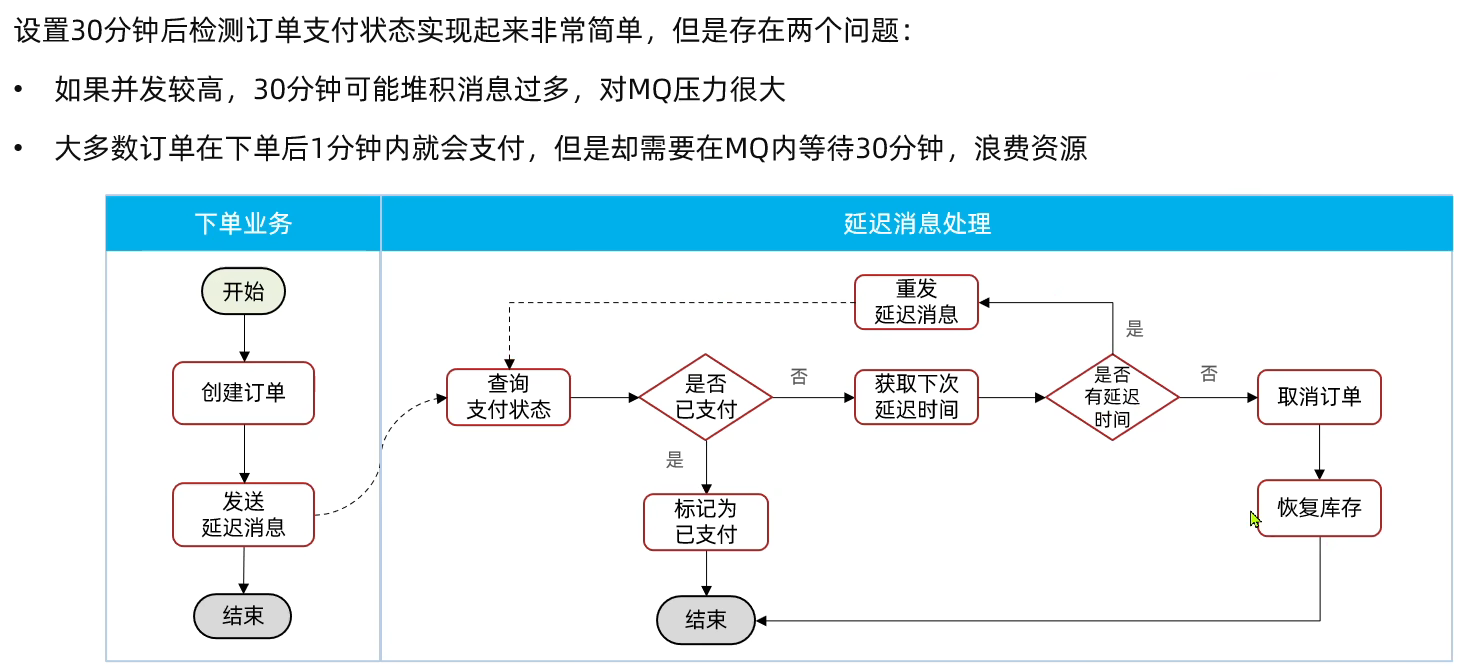

方案二:固定 30 分钟长延迟消息

-

实现:用户下单时,发送一条延迟 30 分钟的消息,到期后检测订单状态,未支付则取消。

-

核心痛点:

-

MQ 压力巨大:高并发大促场景下,30 分钟窗口期会在 MQ 中堆积百万级延迟消息,占用大量资源,影响 MQ 稳定性;

-

资源严重浪费:90% 以上的订单会在下单后 1 分钟内完成支付,但这些订单的延迟消息依然会在 MQ 中占用 30 分钟资源,全程无业务价值。

-

4.3.3 最优解决方案:阶梯式延迟消息(指数退避检测)

核心思路:不一次性设置 30 分钟长延迟,而是拆分为多个递增的短延迟阶梯,每次延迟到期后检测订单状态,已支付则终止流程,未支付则发送下一个阶梯的延迟消息,直到达到最大超时时间,执行订单取消。

4.3.3.1 阶梯设计

典型的阶梯时长设计(总时长 30 分钟):10s → 10s → 10s → 15s → 15s → 30s → 30s → 60s → 60s → 2m → 5m → 10m → 10m

-

前期短间隔:快速检测已支付订单,提前终止流程,减少无效消息堆积;

-

后期长间隔:减少消息发送次数,降低 MQ 压力。

4.3.3.2 完整业务流程

整个流程分为下单业务 和延迟消息处理两个闭环,完全解耦:

第一部分:下单业务流程

-

用户发起下单请求,交易服务创建订单,状态设置为「待支付」;

-

调用商品服务,预扣商品库存(锁定库存,避免超卖);

-

发送第一条阶梯延迟消息(延迟 10s),消息携带订单 ID、当前阶梯序号、下单时间;

-

下单流程结束,等待用户支付。

第二部分:延迟消息处理核心流程

-

延迟时间到期,消费者收到消息,根据订单 ID 查询订单当前支付状态;

-

状态判断 - 已支付:标记订单为已完成,终止整个延迟流程,不再发送新消息,流程结束;

-

状态判断 - 未支付:进入阶梯校验环节,判断是否已达到 30 分钟最大超时时间;

-

未达到最大超时时间:获取下一个阶梯的延迟时长,重新发送对应延迟的消息,回到步骤 1,进入下一轮检测;

-

已达到最大超时时间:执行订单取消逻辑,更新订单状态为「已取消」,调用商品服务释放预扣的库存,流程终止。

-

4.3.3 方案核心优势

-

极致降低 MQ 压力:90% 以上的订单会在前 3 个 10s 阶梯内完成支付,提前终止流程,MQ 中不会堆积大量无效消息,资源占用仅为固定长延迟方案的 10% 不到;

-

资源利用率最大化:只有真正超时未支付的订单,才会走完完整阶梯流程,MQ 资源完全用于有效业务;

-

无数据库压力:完全基于消息驱动,无需定时任务全表扫描,数据库仅在消息到期时执行单条查询,压力极低;

-

实时性可控:前期短间隔保证了订单支付后,最多 10s 就能检测到状态变更,库存释放及时,业务体验更好;

-

弹性适配业务:阶梯时长可根据大促、日常场景灵活调整,适配不同的业务流量。

4.4.总结

-

延迟消息的核心价值:替代定时任务轮询,实现业务的异步延迟执行,降低数据库压力,提升系统性能与资源利用率。

-

两种实现方案选型:

-

测试环境、无法安装插件的场景,可使用TTL +DLX原生方案,注意规避队列头部阻塞问题;

-

生产环境优先使用官方延迟消息插件,稳定性强、灵活性高,无队列阻塞问题。

-

-

超时订单实战 :采用阶梯式延迟消息方案,完美解决传统方案的痛点,是电商场景的工业级最佳实践。

-

生产环境注意事项:

-

延迟队列建议开启惰性模式,避免大促场景下消息堆积导致的内存溢出;

-

延迟消息必须配合消息持久化,避免 MQ 重启导致延迟消息丢失;

-

消费者逻辑必须保证幂等性,避免消息重试导致的重复取消订单等业务异常。

-