具身机器人在实际场景中的安全保障,是安全内核设计 在更复杂、更智能系统上的全面升级。当机器人从执行预设程序的工具,进化为具备自主决策能力的智能体,安全问题也从"如何控制"上升为"如何信任"。

结合最新的行业标准和技术进展(2025-2026年),系统梳理具身机器人安全保障的核心架构、关键技术及与现有技术栈的集成路径。

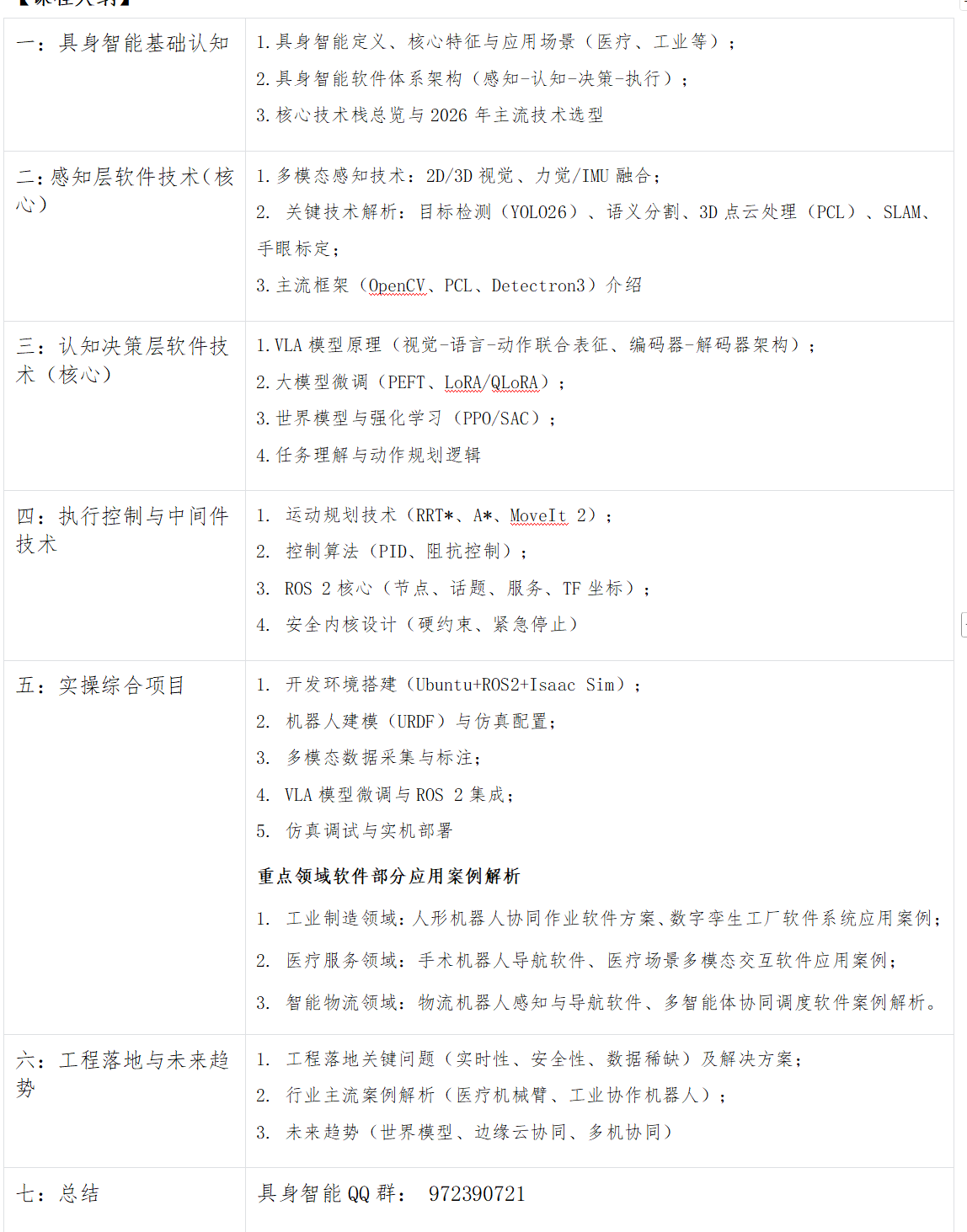

一、为什么具身智能需要全新的安全框架?

随着VLA模型赋予机器人强大的理解与决策能力,安全问题变得前所未有的复杂:

英特尔研究院副总裁宋继强形象地指出:"今天的具身智能机器人,像是一个'天才儿童':在理想状态下表现惊艳,一旦遇到意外,就可能手足无措。" 这正是安全保障体系需要解决的核心问题------抬高机器人的下限,确保其不会因幻觉或意外产生灾难性后果 。

二、三层安全架构:从"智能"到"可靠"

英特尔联合学界及产业界发布的《具身智能机器人安全子系统白皮书》,提出了一套系统化的三层安全架构:

2.1 主系统:承载"智能"

主系统是机器人的"大脑",负责决策、规划与行动生成。英特尔力推的"神经符号AI"方法旨在结合神经网络的泛化能力与符号逻辑的可靠性与可解释性。这与你之前讨论的VLA模型 直接相关------既运用神经网络的泛化能力,又能将传统基于符号、规则与知识的方法融合进来。

2.2 安全系统:永远在线的"副驾驶"

安全系统是一个轻量、高可靠的监控层,持续比对机器人的执行状态与预设安全规则。一旦发现偏离即刻告警或干预。

PMDF安全架构将带有安全功能的机器人系统按功能划分为四个逻辑上相互独立的模块:

M、D、F三个模块组成一个安全子系统,可通过RISC-V等单独的硬件实现,既能保障高安全性,又可以直接在机器人本体上部署。

2.3 后备系统:最后的"安全网"

若安全系统也无法处理,例如机器人即将摔倒,后备系统将被激活。它的目标不是让机器人"急停",而是引导其进入一个可靠的降级状态:

"例如,机器人可以像汽车一样慢速靠边停靠;若即将摔倒,可选择无人区域,通过锁定部分关节实现缓慢摔倒。"

这种优雅降级 的理念,与你之前讨论的安全内核设计 中的"故障安全"一脉相承。

三、VLSA架构:为VLA模型装上"安全层"

针对VLA模型在真实环境中"听得懂不等于做得对、更不等于做得安全"的核心痛点,清华大学、天创机器人与阿里达摩院联合提出了VLSA(Vision-Language-Safe Action)架构 。

3.1 AEGIS安全执行守护系统

VLSA的核心是AEGIS(Action Execution Guarded by Invariant Safety),它像一位"永远在线却不抢方向盘"的智能副驾驶,在关键时刻精准干预,确保安全无虞:

核心技术特点:

3.2 SafeLIBERO安全基准

为科学评估安全性能,研究团队在主流具身智能基准LIBERO基础上,构建了首个专注于物理安全的测试集SafeLIBERO:

- 16个任务 × 2种干扰等级(贴近干扰/路径阻挡)

- 引入摩卡壶、酒瓶、书本等日常高风险障碍物

- 共计1600个随机化测试片段

实验结果 :与OpenVLA等主流VLA模型相比,AEGIS模块显著提升了系统的安全性与任务执行能力。为什么任务成功率反而更高?因为避免了碰撞引发的连锁失败------杯子没打翻、目标没移位、环境未破坏,任务自然更容易完成。

四、标准体系与产业化:从"各自为战"到"行业共识"

2026年2月,中国首个《人形机器人与具身智能标准体系(2026版)》正式发布,由工信部人形机器人与具身智能标准化技术委员会组织120余家单位联合编制。

4.1 标准体系的六大组成部分

4.2 标准体系的四项安全作用

标委会副主任委员兼秘书长梁靓指出,标准体系在安全方面有四项重要作用:

- 降低产业链协同成本:统一上游核心零部件的接口、性能与测试规范

- 规范场景化落地要求:制定场景专属应用标准,明确各场景的安全规范

- 筑牢产业落地安全底线:构建覆盖物理本体、网络数据、智能行为、伦理治理的全生命周期安全伦理体系

- 完善产业发展生态 :建立急用标准快速通道和动态更新机制

五、与现有技术栈的集成路径

结合已有的Ubuntu 24.04 + ROS 2 Jazzy + 感知与VLA技术积累 ,推荐以下集成路径:

5.1 安全分层实现

5.2 安全规则库构建

基于之前的价值对齐 和可解释性,可以构建手术场景的安全规则库:

python

伪代码:安全规则监控节点

class SafetyMonitor(Node):

def __init__(self):

super().__init__('safety_monitor')

订阅VLA输出

self.vla_sub = self.create_subscription(

Action, '/vla_output', self.check_safety, 10)

发布安全修正

self.safe_pub = self.create_publisher(

SafeAction, '/safe_action', 10)

安全规则库

self.safety_rules = {

'max_force': 20.0, 最大允许力(N)

'min_distance': 0.05, 最小安全距离(m)

'forbidden_zones': [...], 禁止进入区域

'velocity_limits': {...} 速度限制

}

def check_safety(self, action):

1. 监控执行状态

violation = self.detect_violation(action)

if violation:

2. 安全决策

safe_action = self.decide_intervention(action, violation)

3. 生成解释

explanation = self.generate_explanation(violation)

self.publish_explanation(explanation)

return safe_action

return action5.3 与VLSA架构的集成

可以将AEGIS安全层封装为ROS 2的插件式节点:

六、总结:安全是智能的基石

具身机器人的安全保障,是已有技术栈的自然延伸和高级整合:

核心原则 :真正的智能,必须是负责任的智能。具身机器人要真正走进工厂、走向家庭,必须跨过"可靠性"这座大山。

从安全内核设计 起步,逐步引入PMDF分层架构 和VLSA/AEGIS安全层 ,可以构建起一套完整的具身智能安全保障体系。