导读

住宅建筑的外立面检测传统上依赖人工------爬脚手架、挂绳索、拿检测仪逐面墙检查。一栋 34 层高楼,人工检测需要 2-3 天,覆盖率只有 40-60%,而且肉眼看不到墙体内部的渗漏。

深圳大学团队提出了一套无人机 RGB+热红外双模态检测方案:用 DJI Mavic 3 Thermal 无人机同时拍摄可见光和热红外图像,可见光用于检测裂缝 ,热红外用于检测渗漏 (水分蒸发导致的温度异常)。在深圳三个住宅小区的实测中,裂缝检测 mIoU 达到 87.86%,渗漏检测 mIoU 达到 79.05%。一栋 34 层高楼的完整外立面检测约 2 小时完成,覆盖率 ≥95% 。

论文信息

-

**标题:**UAV and Deep Learning for Automated Detection and Visualization of Façade Defects in Existing Residential Buildings

-

**作者:**Yue Fan, Jinghua Mai, Fei Xue(通讯), Stephen Siu Yu Lau, San Jiang, Yiqi Tao(通讯), Xiaoxing Zhang, Wing Chi Tsang

-

**机构:**深圳大学(亚热带建筑与城市科学国家重点实验室、广东省城市信息学重点实验室);香港大学建筑学院;香港都会大学;深圳物策地理信息技术有限公司

一、为什么需要两种模态?

建筑外立面有两类主要缺陷,单一模态各有盲区:

| 缺陷类型 | 可见光(RGB) | 热红外 |

|---|---|---|

| 裂缝 | ✓ 几何特征清晰 | ✗ 空间分辨率不足(640×512) |

| 渗漏 | ✗ 墙体内部水分肉眼不可见 | ✓ 水分蒸发造成温度异常 |

-

可见光能看到裂缝的几何形状(宽度、走向、分支),但看不到墙体内部的渗漏------水分可能已经渗入保温层但表面无明显痕迹

-

热红外能检测到渗漏区域的温度异常(蒸发冷却效应),但空间分辨率仅 640×512 像素,无法分辨细小裂缝

两种模态互补:RGB 负责裂缝,热红外负责渗漏。

图片来源于原论文

二、三阶段检测流水线

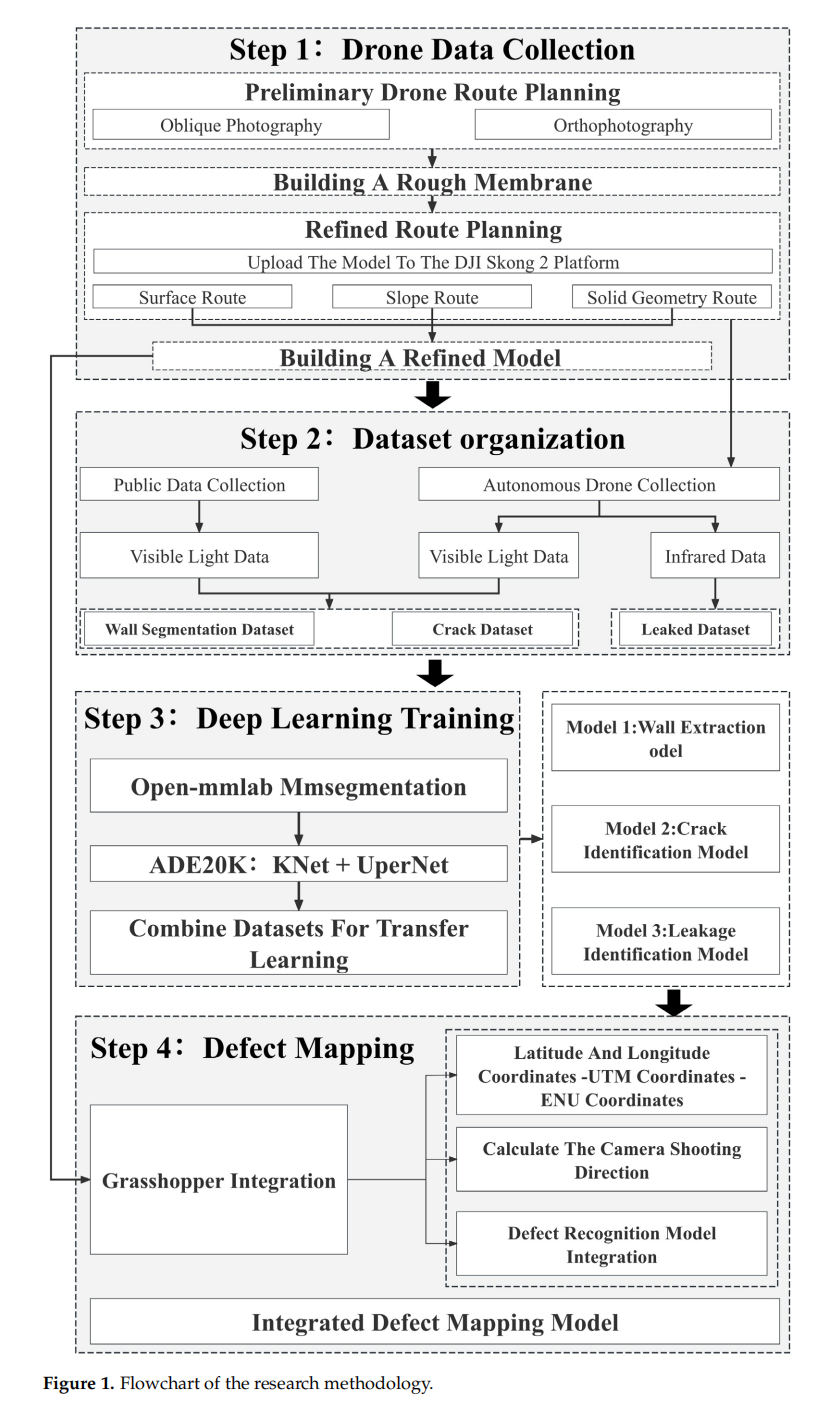

图片来源于原论文

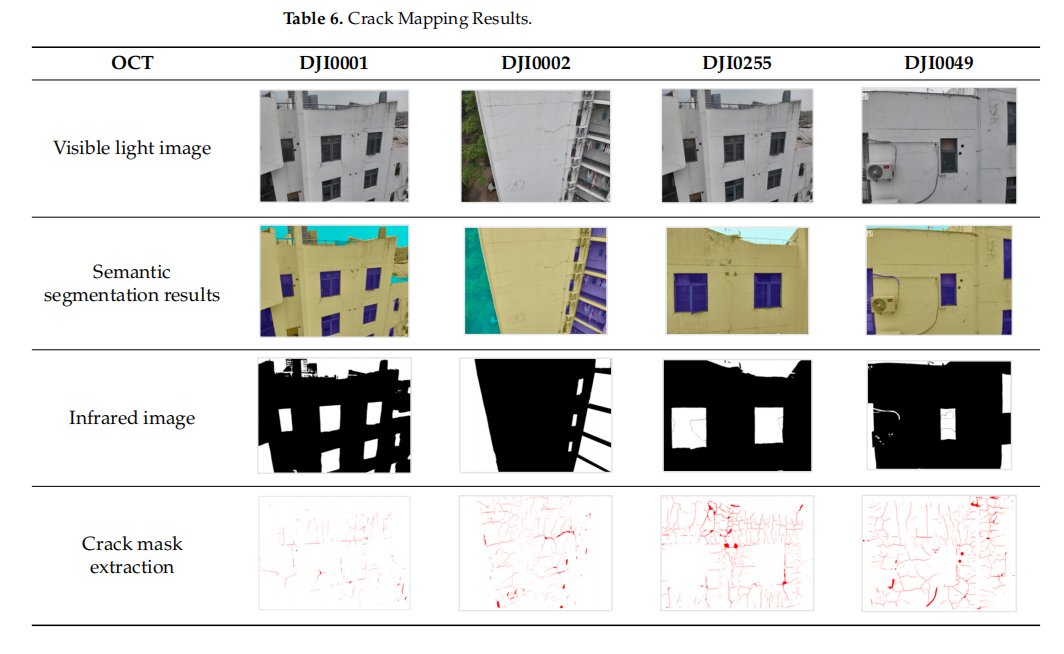

阶段一:墙体提取

用 SegFormer从无人机拍摄的图像中提取建筑墙体区域,排除天空、地面、植被等背景干扰。在 WHU 墙体数据集(900 张标注图像)上微调。

阶段二:裂缝检测(RGB)

对提取的墙体区域,用 K-Net + UPerNet 做语义分割检测裂缝。采用滑动窗口策略------将高分辨率外立面图像切割为与训练分辨率匹配的小块,逐块检测后拼接。

训练数据:1,892 张公开裂缝数据集图像。

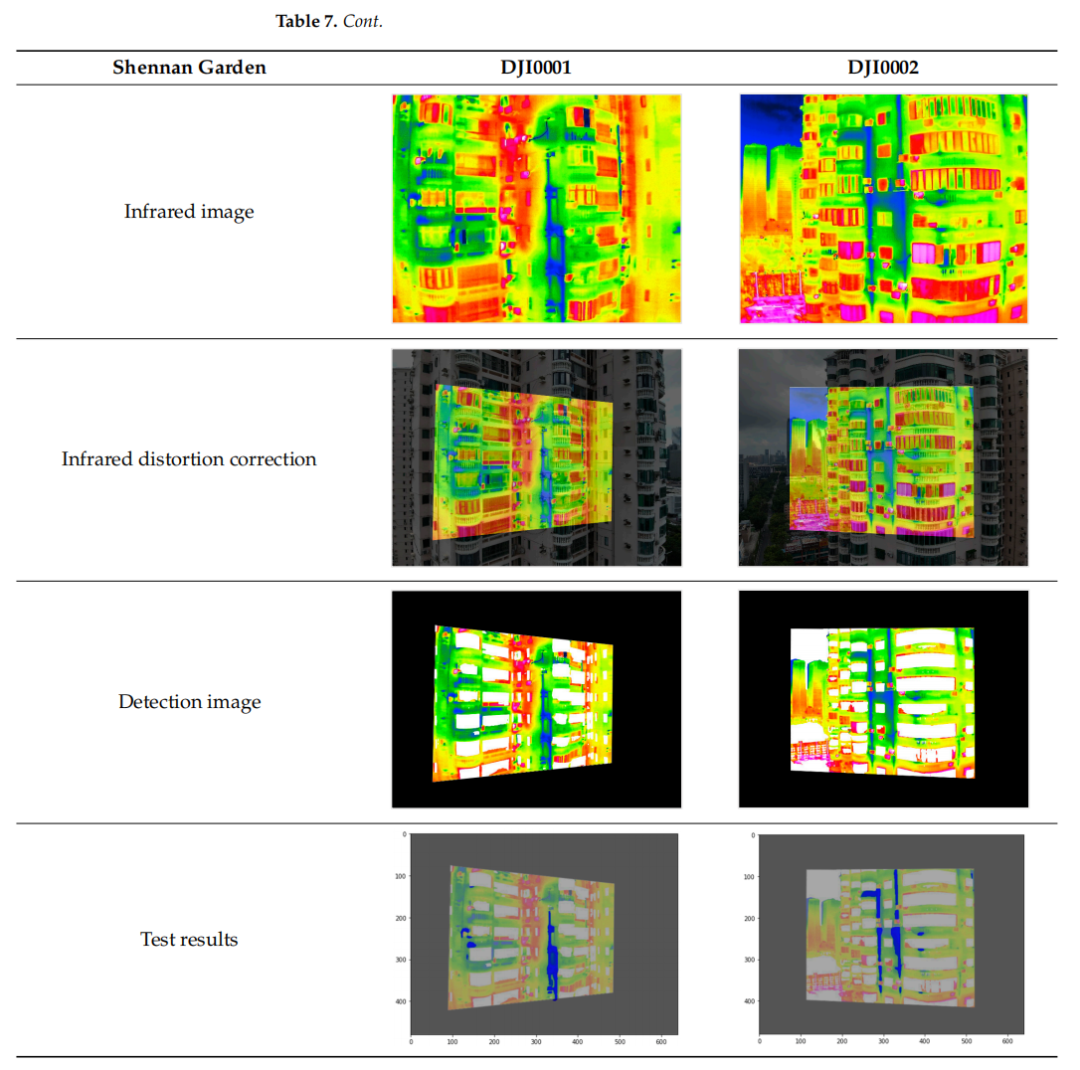

阶段三:渗漏检测(热红外)

同样用 K-Net + UPerNet对热红外图像做语义分割检测温度异常区域。标注数据经过可见光图像中的渗水痕迹/泛碱现象交叉验证。

训练数据:340 张自建热红外标注图像。

双模态配准与 3D 可视化

可见光和热红外图像通过单应性矩阵(手动选择 4 个以上匹配点)配准到统一坐标系。

论文的另一个重要环节是将检测结果映射到 3D 建筑模型上 。整个数据采集分两步:第一步是粗略倾斜摄影 (30m 高度拍摄,用于 SfM 三维重建获取建筑外轮廓和几何信息),第二步才是精细近距拍摄(5-25m,用于缺陷检测)。粗略阶段重建的 3D 模型作为载体,精细阶段检测到的缺陷通过坐标转换(WGS84 → UTM → ENU)映射到模型上,最终在 Grasshopper/Rhino 中实现参数化可视化------每处缺陷都有精确的三维坐标和面积。

三、硬件与飞行方案

无人机平台(规格来自 DJI 官方)

| 参数 | 规格 |

|---|---|

| 型号 | DJI Mavic 3 Thermal(M3T) |

| 广角相机 | 1/2" CMOS, 48MP, 24mm 等效焦距 |

| 长焦相机 | 1/2" CMOS, 12MP, 162mm 等效, 56× 混合变焦 |

| 热红外相机 | 非制冷 VOx 微测辐射热计, 640×512, NETD ≤50mK |

| 续航 | 45 分钟 |

| 重量 | 920g |

飞行参数建议

| 建筑类型 | 高度 | 拍摄距离 | 单栋耗时 |

|---|---|---|---|

| 低层(≤7 层) | ~21m | 5-10m | ~45 分钟 |

| 中层(8-18 层) | --- | 15-20m | --- |

| 高层(≥19 层) | ~100m | 20-25m | ~1.2-1.6 小时 |

关键约束:拍摄距离超过 30m后,裂缝检测和低温差渗漏检测性能明显下降。

四、实验结果:深圳三个住宅小区实测

训练配置

| 参数 | 规格 |

|---|---|

| GPU | NVIDIA RTX 4090 (24GB) |

| 训练迭代 | 墙体提取 40,000 / 裂缝 36,000 / 渗漏 9,500 |

| 学习率 | 0.0001, Poly 衰减 |

检测精度

| 任务 | 整体准确率 | mIoU | mPrecision | mRecall |

|---|---|---|---|---|

| 墙体提取 | 86.11% | 64.04% | 78.9% | 76.33% |

| 裂缝检测 | 98.03% | 87.86% | 94.21% | 92.31% |

| 渗漏检测 | 98.41% | 79.05% | 87.54% | 86.44% |

与传统方法对比

| 维度 | 传统人工检测 | 无人机 + 深度学习 |

|---|---|---|

| 单栋高楼耗时 | 2-3 天 | ~2 小时 |

| 覆盖率 | 40-60% | ≥95% |

| 裂缝宽度精度 | ±0.1mm | ±1cm |

| 人工参与度 | 90% | 20% |

无人机方案在效率、覆盖率和人工参与度上大幅领先,但裂缝宽度测量精度(±1cm)远低于传统裂缝计(±0.1mm)------适合大面积筛查,不替代精密测量。

实测案例

在深圳三个住宅小区部署:

| 小区 | 楼层 | 拍摄距离 | 图像对数 |

|---|---|---|---|

| OCT 社区 | 7 层 | 5m | 1,034 |

| 深南花园 | 34 层 | 22m | 1,400 |

| 汇芳花园 | 33 层 | 25m | 1,811 |

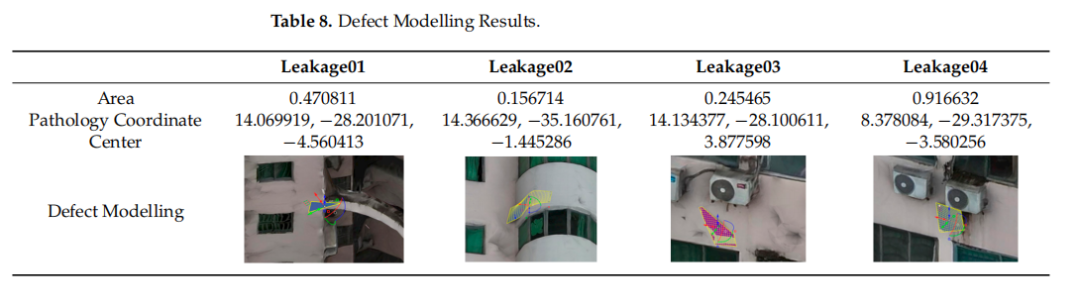

在深南花园识别出 4 处渗漏缺陷,面积分别为 0.16、0.25、0.47、0.92 m²,并在 3D 模型中定位了精确坐标。

图片来源于原论文

五、总结与思考

这篇论文展示了一套完整的无人机双模态建筑外立面检测方案,从飞行规划到缺陷检测到 3D 可视化:

-

双模态互补:RGB 检测裂缝(mIoU 87.86%),热红外检测渗漏(mIoU 79.05%)

-

效率提升:单栋高楼从 2-3 天缩短到约 2 小时,覆盖率从 40-60% 提升到 ≥95%

-

定位为筛查工具:论文明确将方案定位为"第一阶段筛查",识别重点区域后再做精密检测

值得注意的几点:

-

只覆盖两类缺陷:裂缝和渗漏。建筑外立面还有脱落、空鼓、保温层损坏等缺陷类型未涉及

-

热红外标注数据量有限:仅 340 张标注图像训练渗漏检测模型,泛化到更多建筑类型和场景需要更多数据验证

-

环境因素敏感:热红外检测受立面朝向、材质、天气影响大。论文实测在深圳(亚热带气候),在北方寒冷气候下的热对比度特性可能不同

-

双模态配准是手动的:需要人工选择 4 个以上匹配点做单应性配准,这限制了全自动化部署

-

精度 vs 效率的定位清晰:论文没有声称替代传统精密检测,而是定位为大面积筛查工具------这个定位务实且合理